MCP/A2A/Agent Skills引爆智能体互联网时代!

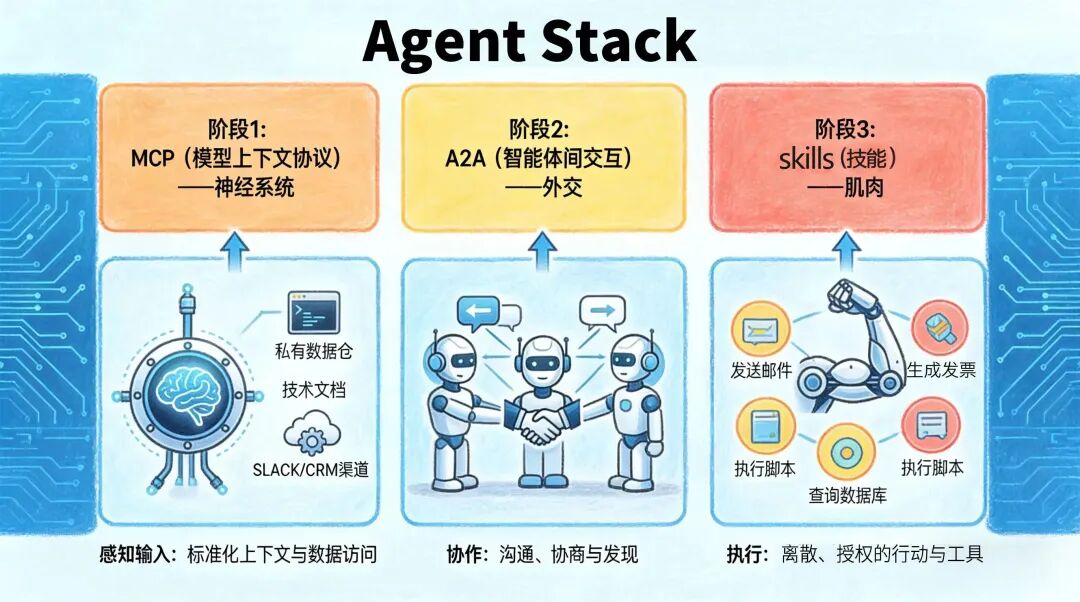

AI智能体技术栈推动人工智能进入协作时代。通过MCP(模型上下文协议)、A2A(智能体间协议)和Agent Skills(智能体技能)三大核心技术,AI实现了从感知到协作再到高效执行的进化:MCP为智能体建立标准化感知系统,A2A实现跨组织智能体协作,Agent Skills将复杂任务封装为可复用模块。2025年被预测为Agent元年,大模型与行业结合将成为重要方向。该技术栈为企业构建AI原生业务

从聊天机器人到能自主协作、执行复杂任务的AI智能体,人工智能的进化早已突破单模型局限,迈入IoA(智能体互联网) 时代。而支撑这场变革的,正是由MCP、A2A和Agent Skills构成的智能体技术栈,让AI从孤立的推理引擎,变成能跨组织、自主协作的数字劳动力。

智能体的成长三部曲:从感知到协作,再到高效执行

AI智能体的进化,像极了人类的成长过程,从感知世界,到社交协作,再到掌握专属技能,一步步拥有自主行动的能力,而MCP、A2A、Agent Skills正是对应这三个阶段的标准化解决方案:

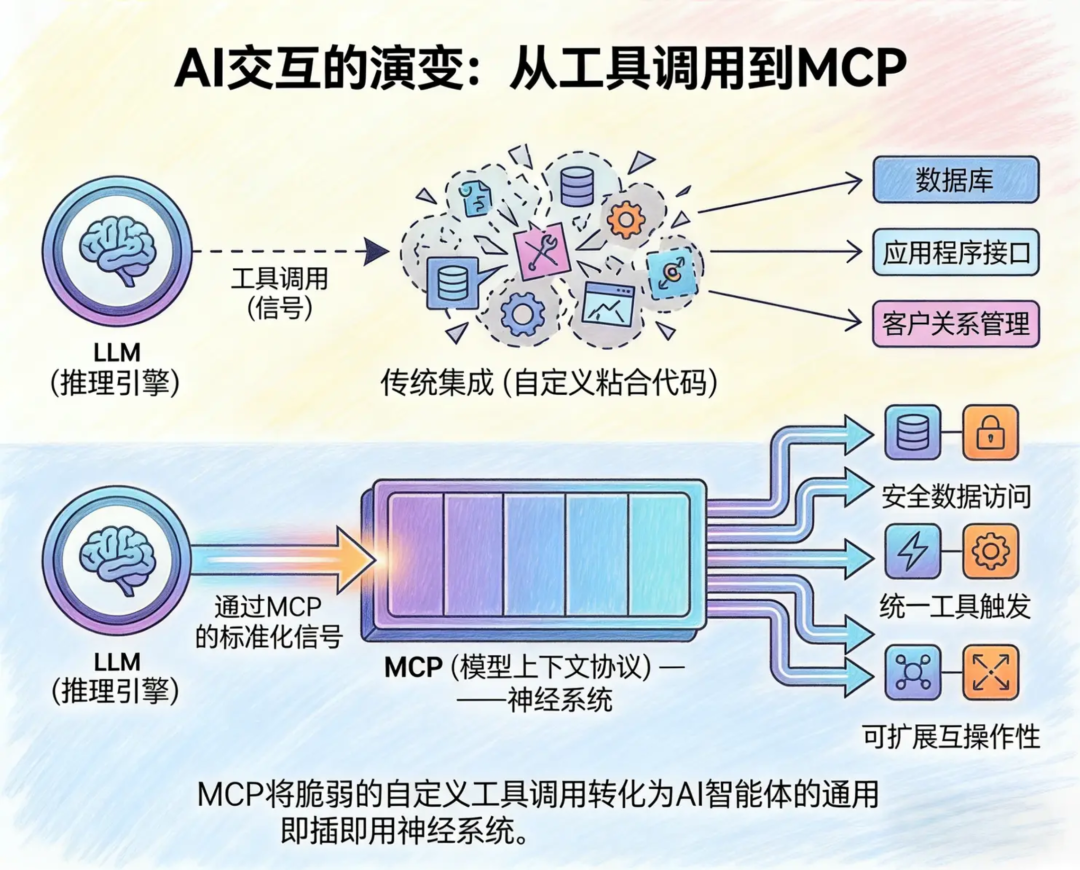

阶段1:感知世界(MCP)

早期大模型的痛点是看不见、摸不着:只能依赖静态提示词获取数据,要么冗余浪费算力,要么面对未知场景束手无策。即便工具调用功能解决了部分问题,却因定制化集成带来碎片化成本,开发慢、难复用。

2024年底,Anthropic提出的MCP(模型上下文协议) 彻底解决了这个问题:它为AI搭建了标准化的感知桥梁,像神经系统一样,让智能体能实时、安全地感知私有数据仓、外部工具,还能将指令转化为工具调用信号。

简单说,MCP让AI从被动接收数据的机器,变成能主动探索环境的智能体,也是企业构建AI原生业务的基础,通过这套神经系统,AI能深度适配企业独有的业务环境。

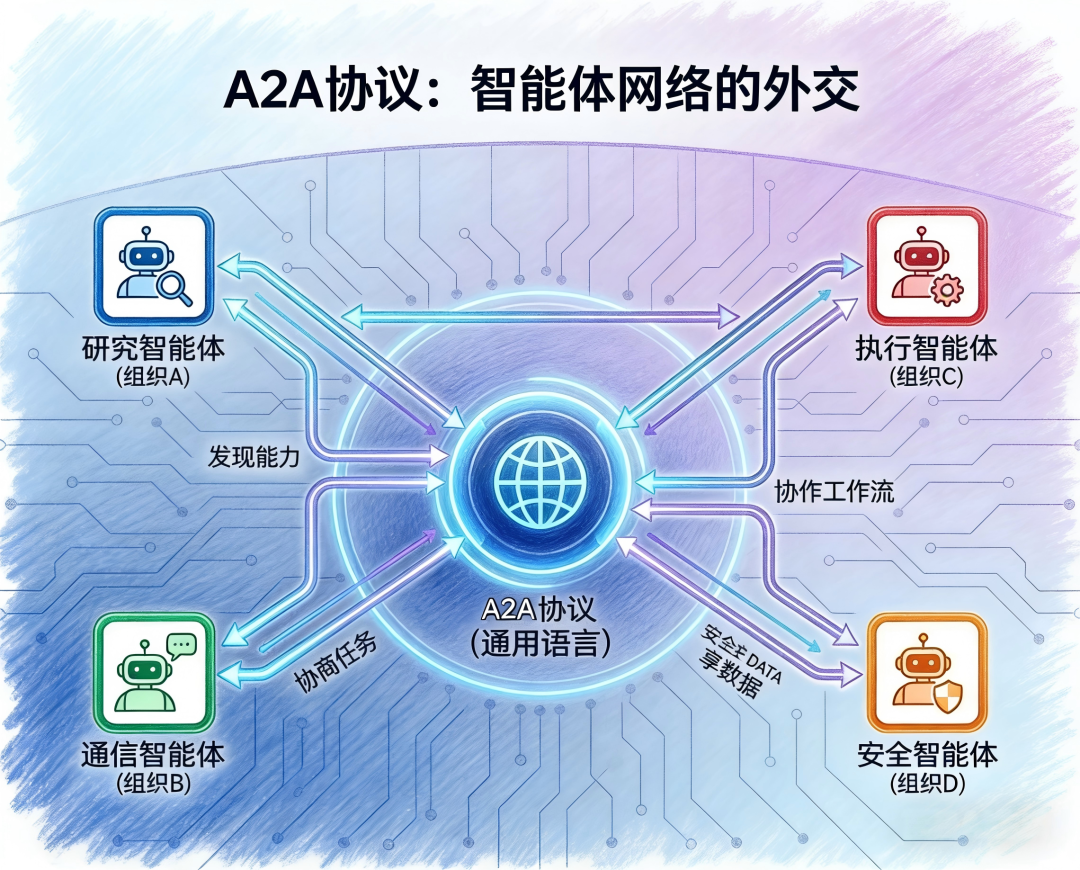

阶段2:协作社交(A2A)

单个智能体的能力始终有限,就像人类无法独自完成复杂社会分工,智能体也需要沟通协作。2025年中,Google提出并捐赠给Linux基金会的A2A(智能体间协议),就是智能体的通用世界语。

它构建了智能体的外交层:不同厂商、不同领域的智能体,能通过A2A自主发现彼此的能力、协商任务分工、跨组织调用功能。比如旅行智能体订机票时,无需适配人类设计的界面,直接通过A2A和航空公司的订票智能体对话,效率和准确性大幅提升。

没有A2A,智能体只是孤立的工具;有了A2A,才真正形成了智能体互联网,让全球智能体成为一个协作的整体。

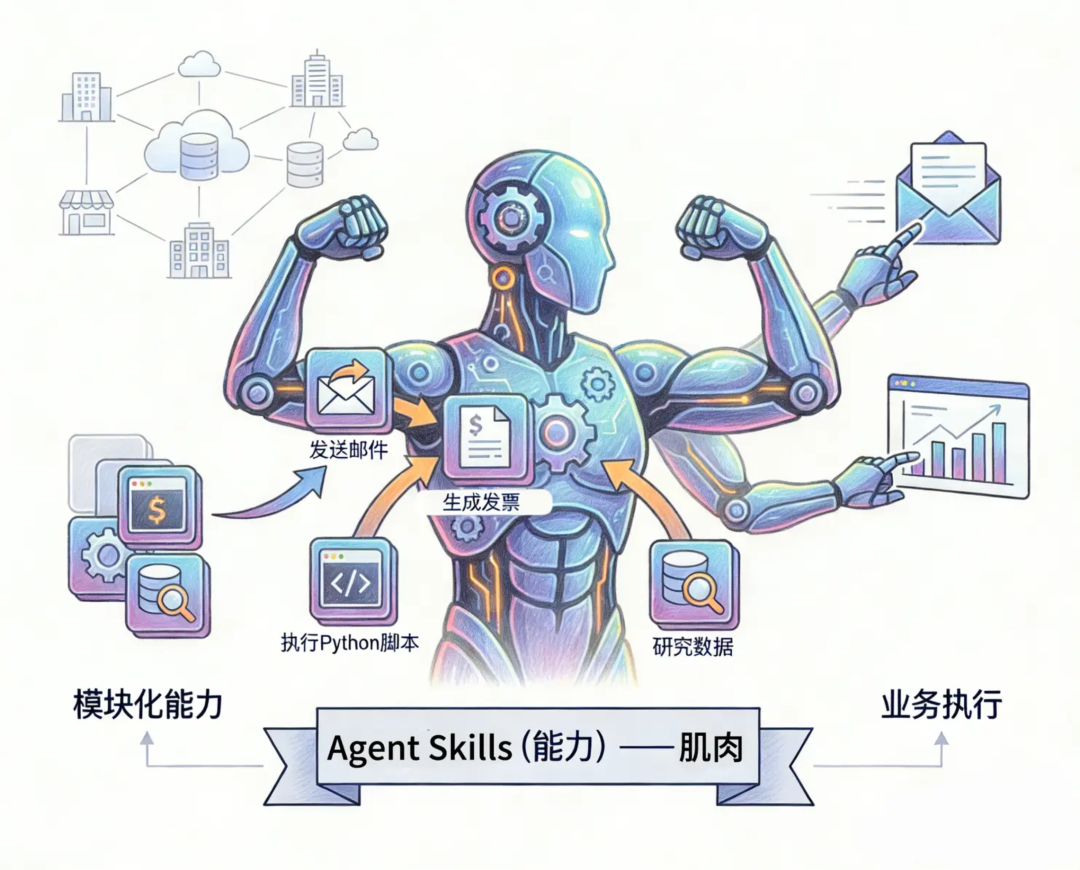

阶段3:高效执行(Agent Skills)

能感知、会沟通,还得能落地执行。过去软件开发总陷入重复造轮子:发邮件、生成发票这类基础功能,每个开发者都要写定制代码,质量参差不齐还浪费创造力。

2025年底Anthropic推出的Agent Skills(智能体技能),将数字工作的核心能力标准化:把复杂功能封装成可复用、可移植的模块化技能(如 send_email, generate_invoice),让它能一键执行复杂任务,而非一步步编排底层指令。

更关键的是,技能能独立升级、授权,企业只需为智能体配置专属技能库,就能实现精细化的权限管控,既避免了无差别系统访问的风险,又能快速为智能体赋能,无需重构整个系统。

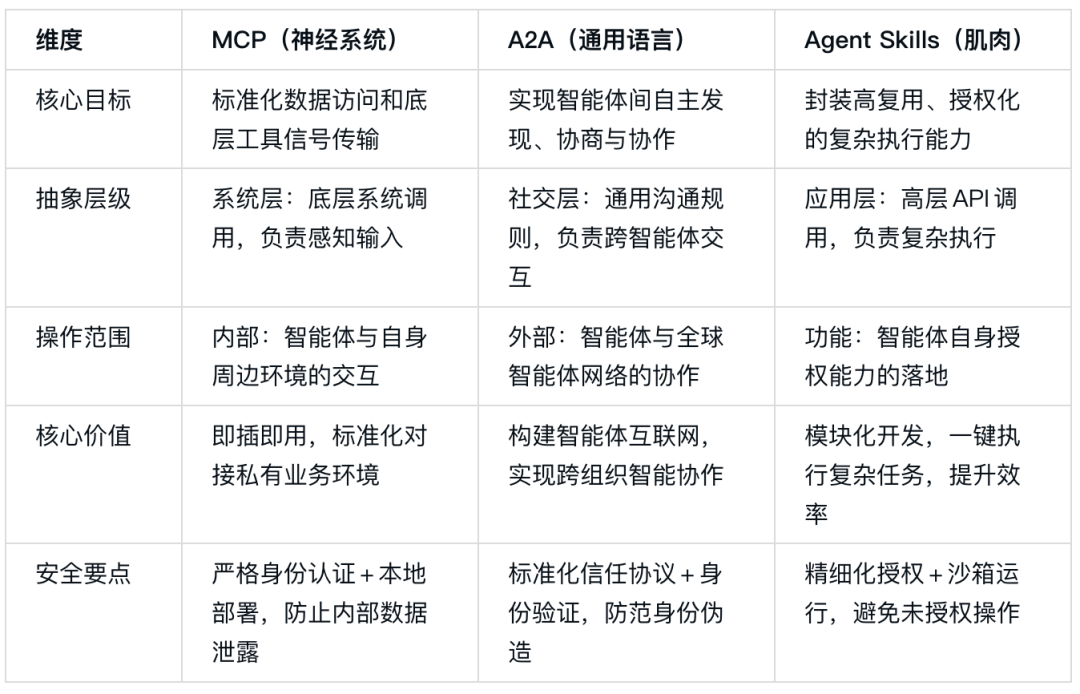

一张表看懂:MCP/A2A/Agent Skills的核心差异

很多人容易混淆这三个概念,其实它们的抽象层级、应用范围、核心价值完全不同,一张表就能理清:

最容易混淆的就是Agent Skills和MCP,前者是高层应用功能,后者是底层系统调用:

- MCP是神经信号,负责传递要做什么的指令,比如调用数据库查数据;

- Agent Skills是肌肉动作,负责把指令落地成完整结果,比如生成销售报表(背后可能包含多次MCP调用,但对智能体来说是一键执行)。

简单说,MCP是搭积木的零件,Agent Skills是拼好的积木块,前者让智能体能触达工具,后者让智能体能高效完成任务。

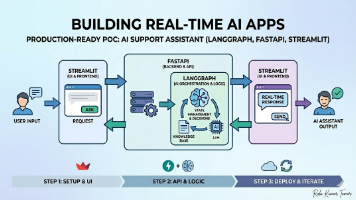

智能体技术栈的实战指南

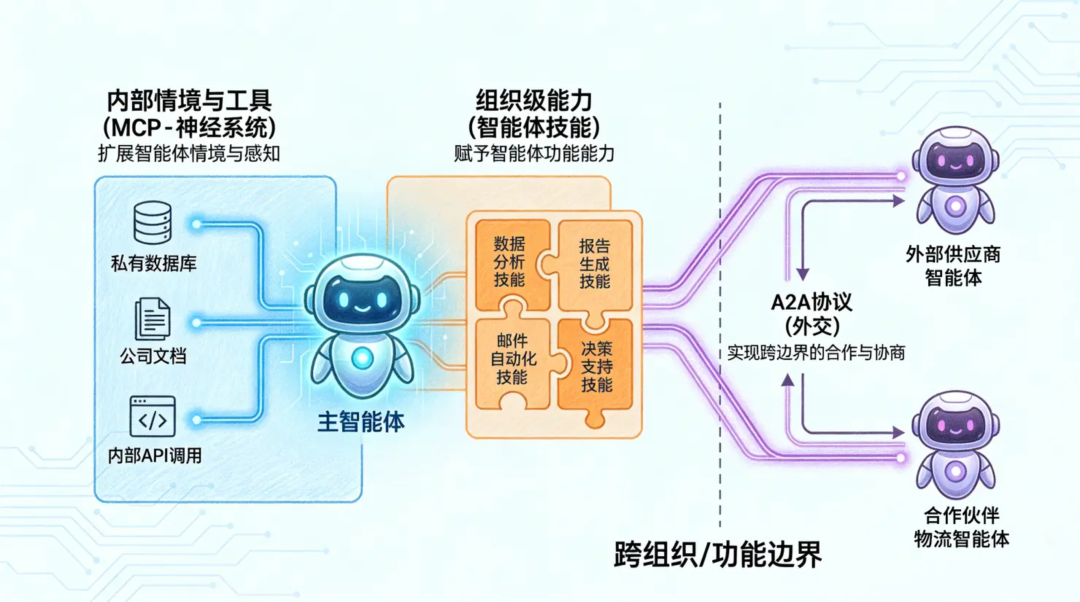

理解了这三个核心概念,你可能会问:在实际构建AI系统时,该如何运用它们?

简单来说,它们协同工作的方式如下:

- 当AI需要接入你的私域数据时:你需要实现 MCP,让它能看见并触摸数据。

- 当你的AI需要与外部代理合作时:你需要采用 A2A,让它能对话与协商。

- 当你想快速赋予AI特定执行能力时:你需要为其装备 Agent Skills,让它有肌肉去行动。

最近两年大模型发展很迅速,在理论研究方面得到很大的拓展,基础模型的能力也取得重大突破,大模型现在正在积极探索落地的方向,如果与各行各业结合起来是未来落地的一个重大研究方向

大模型应用工程师年包50w+属于中等水平,如果想要入门大模型,那现在正是最佳时机

2025年Agent的元年,2026年将会百花齐放,相应的应用将覆盖文本,视频,语音,图像等全模态

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

扫描下方csdn官方合作二维码获取哦!

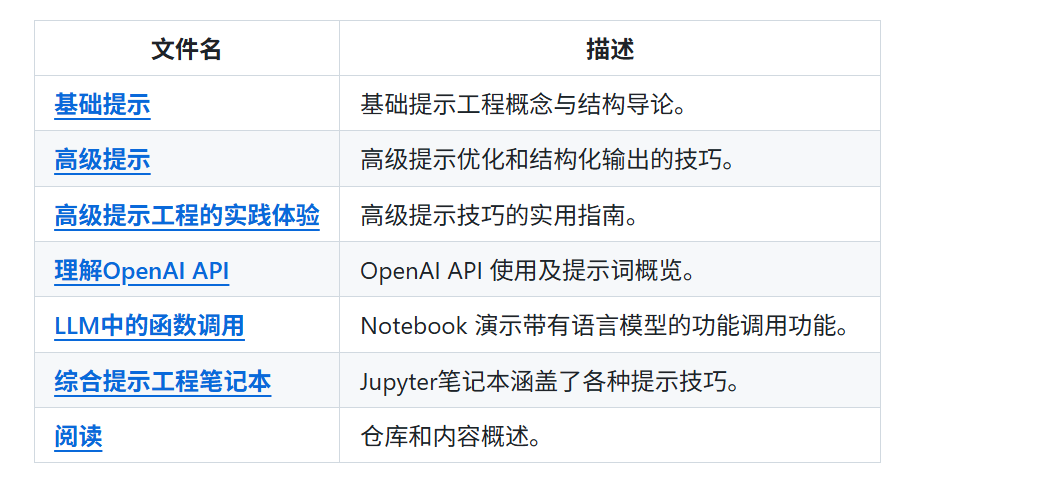

给大家推荐一个大模型应用学习路线

这个学习路线的具体内容如下:

第一节:提示词工程

提示词是用于与AI模型沟通交流的,这一部分主要介绍基本概念和相应的实践,高级的提示词工程来实现模型最佳效果,以现实案例为基础进行案例讲解,在企业中除了微调之外,最喜欢的就是用提示词工程技术来实现模型性能的提升

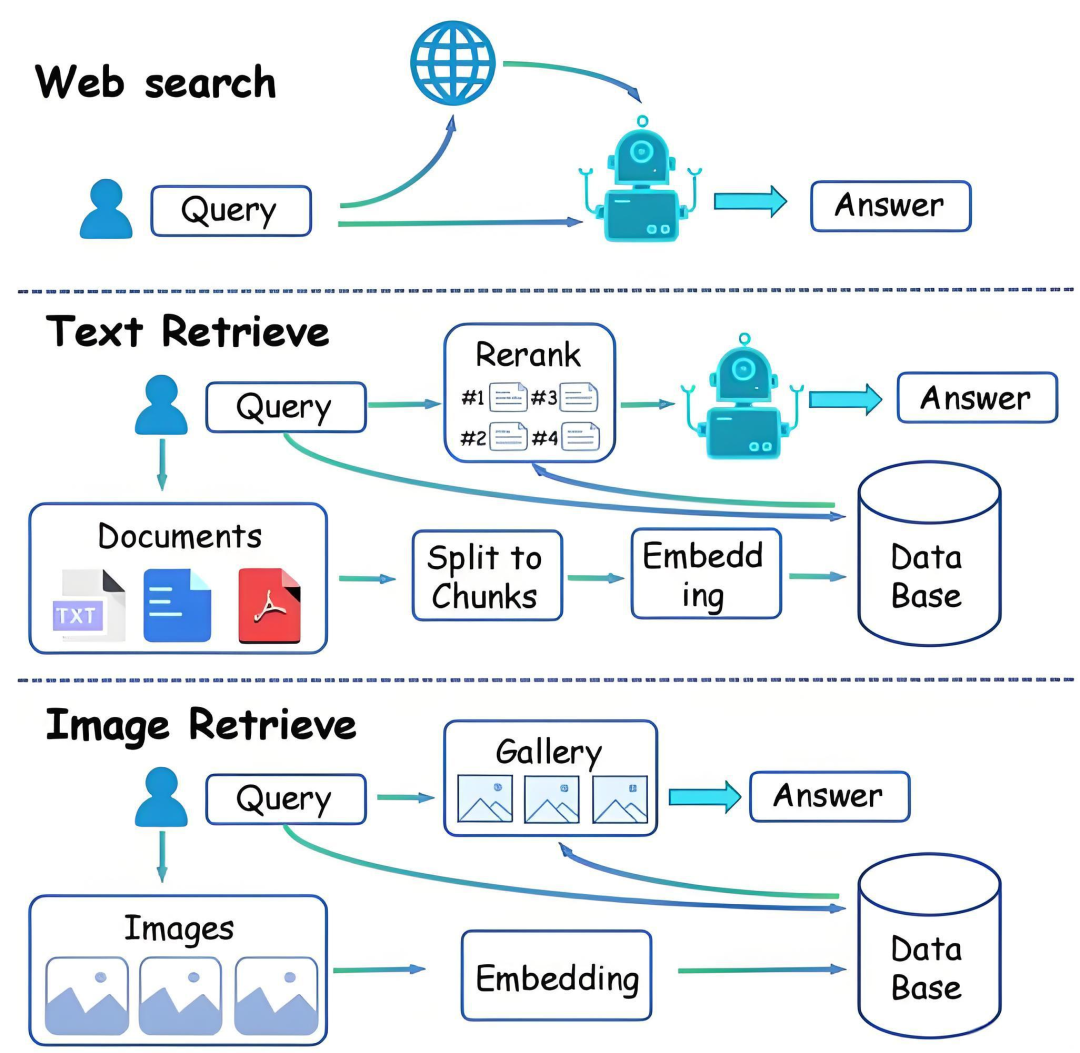

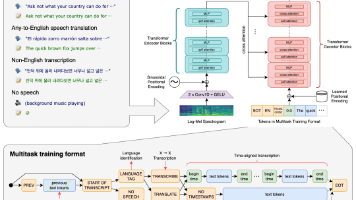

第二节:检索增强生成(RAG)

可能大家经常会看见RAG这个名词,这个就是将向量数据库与大模型结合的技术,通过外部知识来增强改进提升大模型的回答结果,这一部分主要介绍RAG架构与组件,从零开始搭建RAG系统,生成部署RAG,性能优化等

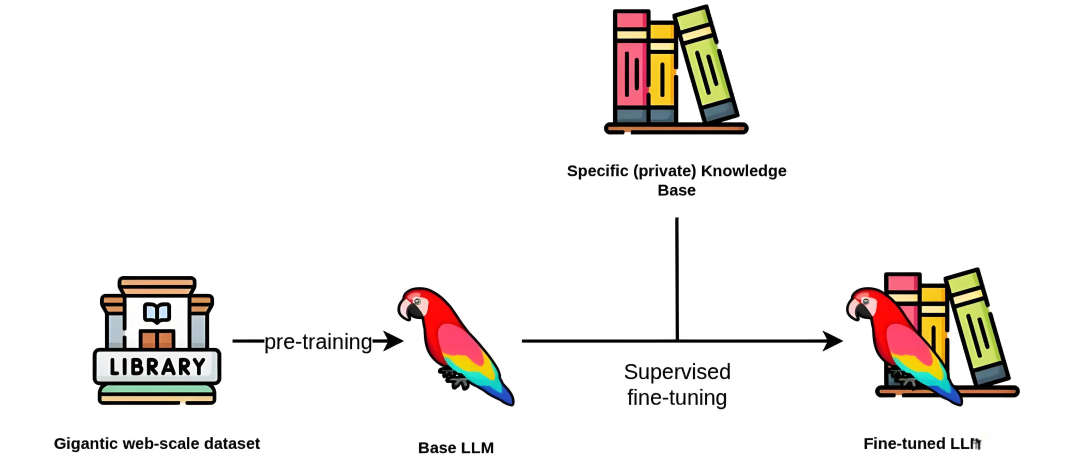

第三节:微调

预训练之后的模型想要在具体任务上进行适配,那就需要通过微调来提升模型的性能,能满足定制化的需求,这一部分主要介绍微调的基础,模型适配技术,最佳实践的案例,以及资源优化等内容

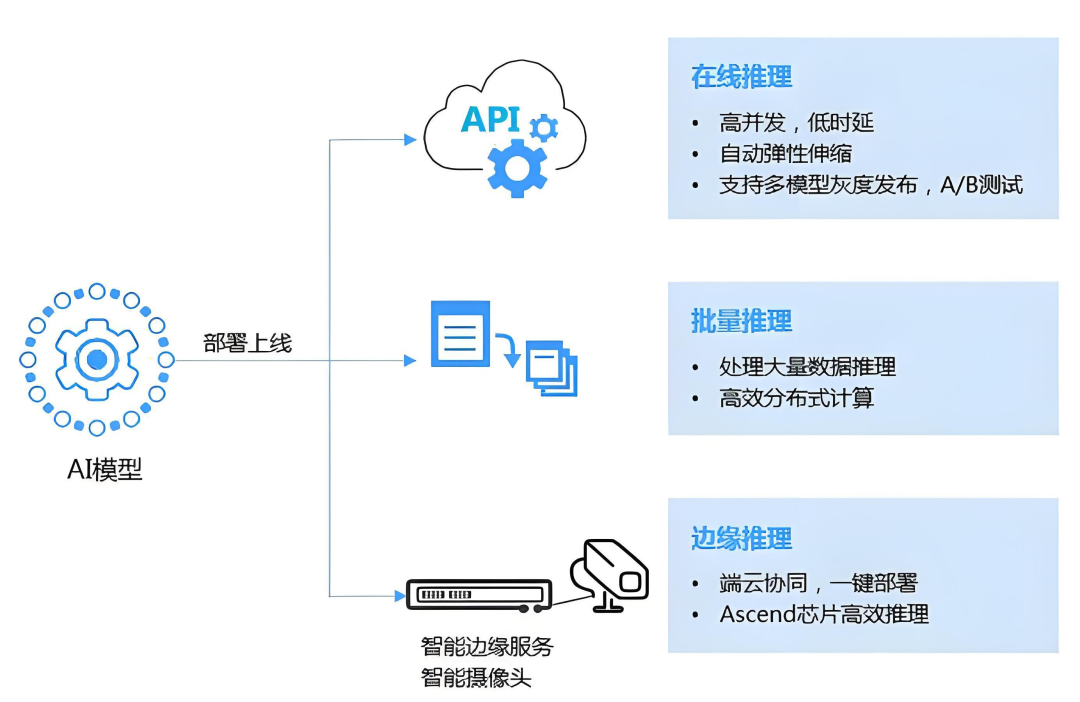

第四节:模型部署

想要把预训练或者微调之后的模型应用于生产实践,那就需要部署,模型部署分为云端部署和本地部署,部署的过程中需要考虑硬件支持,服务器性能,以及对性能进行优化,使用过程中的监控维护等

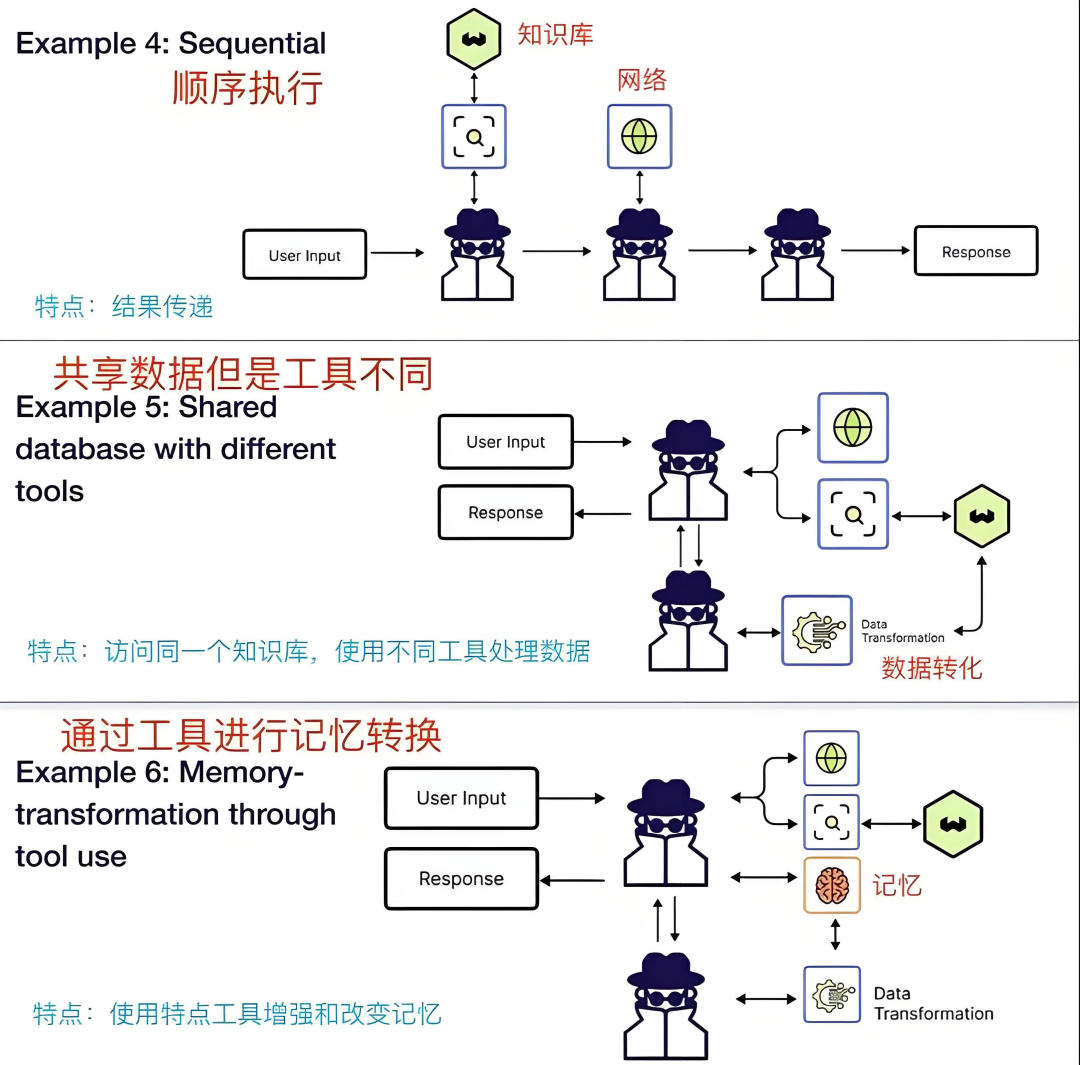

第五节:人工智能系统和项目

这一部分主要介绍自主人工智能系统,包括代理框架,决策框架,多智能体系统,以及实际应用,然后通过实践项目应用前面学习到的知识,包括端到端的实现,行业相关情景等

学完上面的大模型应用技术,就可以去做一些开源的项目,大模型领域现在非常注重项目的落地,后续可以学习一些Agent框架等内容

上面的资料做了一些整理,有需要的同学可以下方添加二维码获取(仅供学习使用)

更多推荐

已为社区贡献800条内容

已为社区贡献800条内容

所有评论(0)