LangChain + 国产大模型构建企业级智能知识库实践

本文聚焦大模型落地难题。文章指出,大模型存在知识时效性差、无法接入私有数据等短板,而LangChain作为AI应用开发框架,能有效连接模型与外部数据工具。核心内容涵盖LangChain的Model I/O、Retrieval、Chains三大组件,并以ChatGLM3为例,详细演示了构建本地知识库问答系统的完整技术路径——包括文档加载、向量化存储、检索增强生成等关键步骤。最后结合农业政策问答、企业

文章目录

一、为什么大模型需要LangChain?

1.1 大模型的“先天不足”

虽然大语言模型(LLM)展现出了惊人的能力,但它存在几个关键短板:

- 知识时效性差:模型训练时使用的数据是静态的,无法自动获取最新信息

- 私有数据隔离:企业内部的知识库、政策文档、业务数据无法被模型访问

- 任务协同困难:单一模型难以完成“查询-分析-执行”的复杂任务链条

- 事实幻觉风险:当无法回答时,模型可能会“一本正经地胡说八道”

这些问题的核心在于:大模型就像一个博学但“与世隔绝”的天才,它拥有广博的知识,却无法接入你的私有数据,也无法调用外部工具完成实际工作。

1.2 LangChain的定位:AI应用的“万能胶水”

LangChain正是为解决这些问题而生。它不是一个独立的大模型,而是一个开源开发框架,允许开发者将大语言模型与外部计算和数据来源结合起来。

用更形象的比喻来说:如果把构建AI应用比作搭乐高积木,那么LangChain就是那本“乐高说明书”加上“万能胶水”。它本身不是积木,但能让你把各种积木(大模型、数据库、API、工具)高效地拼接在一起。

目前,LangChain以Python和JavaScript包的形式提供,拥有活跃的开源社区和丰富的生态组件。

二、LangChain核心组件深度解析

LangChain的架构设计体现了“模块化、可组合”的思想。其核心组件可以分为三大板块:

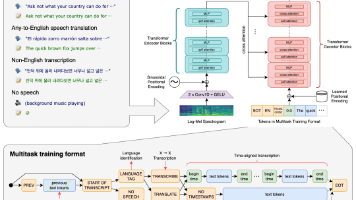

2.1 Model I/O:与大模型高效对话

Model I/O负责管理与大模型的输入输出,是LangChain最基础的组件。它包含三个关键部分:

1. Models(模型)

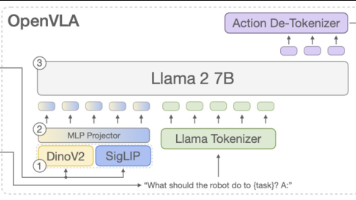

LangChain提供了统一的LLM接口,支持OpenAI、Anthropic、智谱AI、百度文心等数十种模型。这意味着你可以用相同的API调用不同厂商的模型,极大降低了切换成本。

在LangChain中加载国产模型ChatGLM3,需要继承langchain.llms.base.LLM类,通过@property装饰器将_llm_type方法转为只读属性,并重写_call方法来加载自己的模型,确保输出符合LangChain要求。

2. Prompts(提示词模板)

提示词模板是生成语言模型提示的“配方”。LangChain提供了丰富的模板类型:

- 少量描述的提示词:适用于简单指令场景

- 少样本的提示词:通过示例指导模型输出格式

- 思维链的提示词:引导模型展示推理过程,提升复杂问题的准确率

3. Output Parsers(输出解析器)

大模型返回的是文本,但应用需要的是结构化数据。输出解析器负责将模型的文本响应转换为JSON、XML、列表等结构化格式,便于后续处理。

2.2 Retrieval:为大模型配“资料库”

Retrieval模块是解决大模型知识实时性和私有数据接入问题的关键。它的核心思想是:不要重新训练模型,而是让模型在回答前先检索相关知识。

检索增强生成(RAG)的流程如下:

- 文档加载:使用

document_loaders加载PDF、Word、Markdown、TXT等多种格式的文档 - 文本分割:通过

text_splitter将长文档切分成适合模型处理的文本块 - 向量化存储:将文本块转换为嵌入向量(Embedding),存入向量数据库

- 相似度检索:用户提问时,将问题向量化,检索最相关的文本块

- 增强生成:将检索结果与原始问题组合,形成增强提示,交给模型生成答案

对于图片类文件,处理思路是先通过OCR识别图片中的文本,再进行后续的文本分割和向量化流程。

2.3 Chains & Agents:让AI“动起来”

如果说前两个模块解决的是“理解”问题,那么Chains和Agents解决的就是“行动”问题。

Chains(链):将多个组件串联成固定的工作流。LangChain支持多种链类型:

| 链类型 | 功能简介 |

|---|---|

| LLMChain | 最基础的链,格式化输入→调用模型→解析输出 |

| SequentialChain | 顺序执行多个大模型调用,前一步输出作为后一步输入 |

| RouterChain | 动态判断条件,路由到不同的处理链 |

| RetrievalQA | 专门用于检索增强问答的链,是构建知识库的核心 |

Agents(代理):比Chain更灵活,让AI自主决定下一步行动。Agent可以判断:“这个问题需要查数据库?还是上网搜索?还是调用计算器?”然后动态选择工具执行。

三、实战:基于LangChain+ChatGLM3的本地知识库

理论总是枯燥的,让我们通过一个完整的实战案例,看看如何用LangChain和国产大模型搭建本地知识库问答系统。

3.1 技术选型

- 大模型:ChatGLM3-6B,清华大学KEG实验室和智谱AI联合发布的开源模型,在int4精度下仅需13GB显存即可流畅运行

- 框架:LangChain,提供统一的模型接口和检索增强能力

- 向量数据库:Chroma或FAISS,用于存储和检索文档向量

- 嵌入模型:HuggingFace上的中文嵌入模型,如

text2vec-large-chinese

3.2 系统架构

整个系统的数据流如下:

- 企业文档(PDF、Word、TXT)通过Loader加载

- 文本经过分割后,通过嵌入模型向量化

- 向量数据存入向量数据库,同时保留原始文本

- 用户提问时,问题被向量化并在数据库中进行相似度检索

- 检索到的相关文本片段与问题组合成增强提示

- ChatGLM3根据增强提示生成精准答案

3.3 关键代码实现

步骤1:配置模型

from langchain.llms.base import LLM

from transformers import AutoTokenizer, AutoModel

class ChatGLM3LLM(LLM):

# 自定义ChatGLM3加载类

def _call(self, prompt, stop=None):

# 调用ChatGLM3的推理接口

response = self.model.chat(self.tokenizer, prompt)

return response

步骤2:文档加载与分割

from langchain.document_loaders import TextLoader

from langchain.text_splitter import CharacterTextSplitter

loader = TextLoader("knowledge_base/agriculture_policy.txt")

documents = loader.load()

text_splitter = CharacterTextSplitter(chunk_size=500, chunk_overlap=50)

docs = text_splitter.split_documents(documents)

步骤3:向量化存储

from langchain.embeddings import HuggingFaceEmbeddings

from langchain.vectorstores import Chroma

embeddings = HuggingFaceEmbeddings(model_name="text2vec-large-chinese")

vectorstore = Chroma.from_documents(docs, embeddings)

步骤4:构建问答链

from langchain.chains import RetrievalQA

qa_chain = RetrievalQA.from_llm(

llm=chatglm3_llm,

retriever=vectorstore.as_retriever(),

return_source_documents=True

)

# 测试

response = qa_chain("2024年农业补贴政策有哪些变化?")

print(response['result'])

3.4 效果对比

在某农业政策问答系统的测试中,研究者对比了ChatGPT、原生ChatGLM2-6B和经过LangChain增强的系统:

| 模型 | 专业问题准确率 | 知识库利用能力 | 综合评分 |

|---|---|---|---|

| ChatGPT | 中等 | 无 | 75.6 |

| ChatGLM2-6B | 一般 | 无 | 71.2 |

| ChatGLM2-6B+QLoRA | 较好 | 有限 | 78.5 |

| LangChain+ChatGLM2-6B+QLoRA | 优秀 | 完整 | 86.3 |

专家打分评价结果显示,结合了LangChain检索增强的系统在农业政策专业领域的回答质量显著优于单纯微调的模型。

四、技术展望与最佳实践

5.1 LangChain的技术演进

从搜索结果来看,LangChain生态正在向以下方向发展:

- LCEL(LangChain Expression Language):更简洁的链式表达语法,降低开发门槛

- LangSmith:AI应用监控和调试工具,提升生产环境可观测性

- 多模态支持:从纯文本扩展到图片、视频等非结构化数据的处理

5.2 企业落地最佳实践

基于现有案例,我总结了以下几点经验:

1. 选择合适的微调策略

- 如果只是让模型了解私有知识,RAG通常优于微调,成本更低且知识可实时更新

- 如果涉及特殊格式输出或特定风格,QLoRA等轻量级微调可以有效提升效果

2. 重视数据预处理质量

- 文档分割的粒度直接影响检索效果,建议根据业务场景调整chunk_size

- 对于扫描件、图片类文档,需要OCR预处理

3. 关注国产化方案

- ChatGLM系列在中文场景表现出色,且支持低显存部署

- 国产算力(如华为昇腾)正在快速发展,与国产模型形成互补

结语

从ChatGPT引爆大模型热潮,到如今各行业积极探索落地路径,我们正在见证AI从“技术驱动”向“应用驱动”的关键转变。在这一过程中,LangChain作为连接大模型与实际应用的桥梁,正在扮演越来越重要的角色。

对于开发者而言,掌握LangChain不仅是学习一个框架,更是建立一种思维方式:大模型不是终点,而是构建智能应用的起点。通过LangChain,我们可以将模型的通用能力与企业的私有数据、业务逻辑无缝融合,真正实现从“会用”到“慧用”的跨越。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)