10 ComfyUI IPAdapter 实战:上传一张参考图,轻松实现人物一致性控制

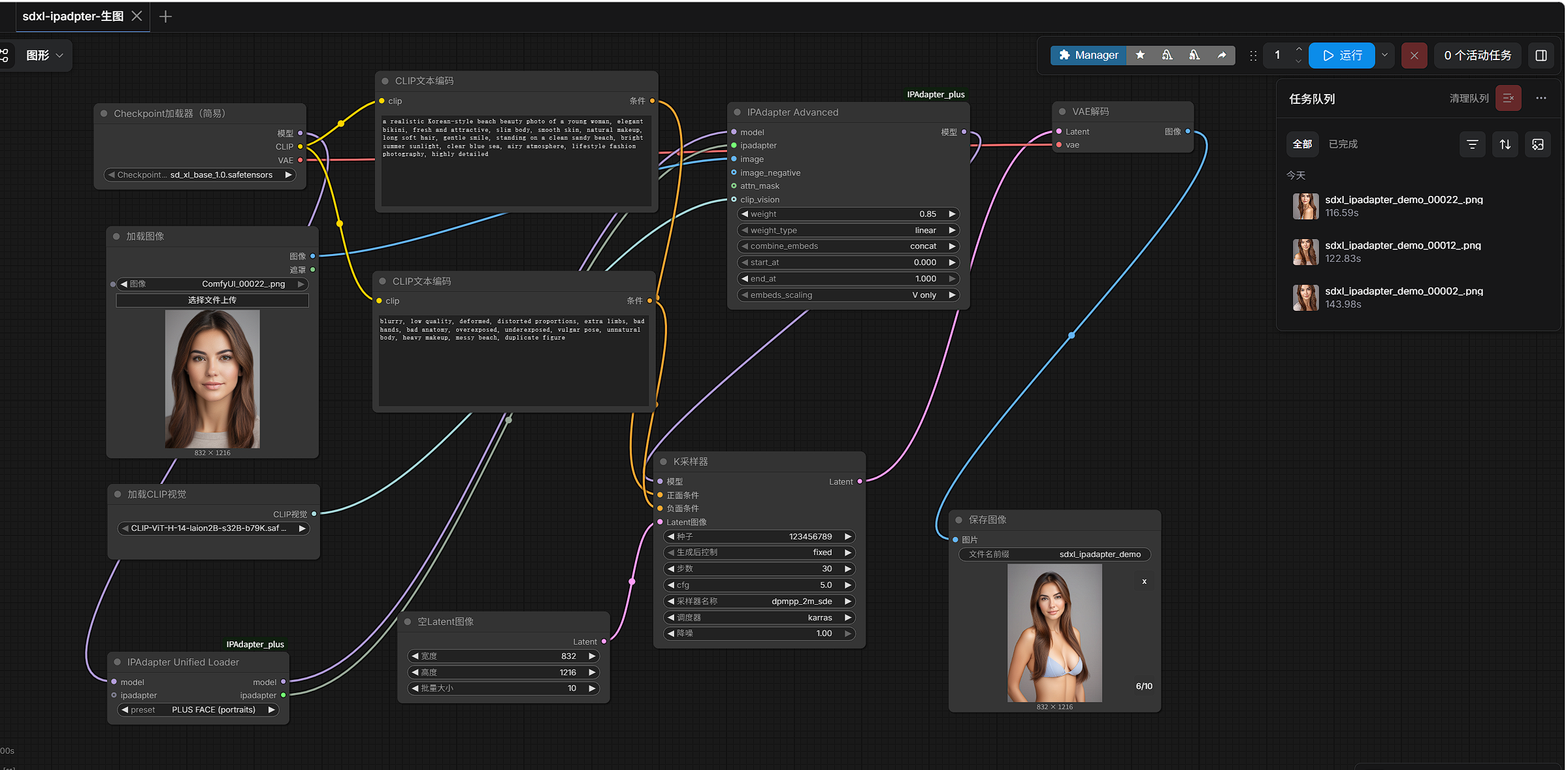

本文基于 ComfyUI 的一套 IPAdapter 工作流,手把手讲解如何使用参考图实现人物“锁脸感”生图。教程适合新手入门,内容包括工作流原理、核心节点说明、实操步骤以及常见问题排查。该工作流使用 IPAdapterUnifiedLoader 加载人像模式 PLUS FACE (portraits),通过 IPAdapterAdvanced 将参考图特征注入模型,并使用 832×1216 的竖

ComfyUI IPAdapter 实战:上传一张参考图,轻松实现人物一致性控制

前言

很多人刚开始用 ComfyUI 画人像时,都会遇到一个特别烦的问题:

人物不稳定。

第一张图看着还不错,第二张、第三张就像换了个人。

尤其是你想让 AI 按照某张人物照片继续生成时,这种问题会更明显。

这时候,一个非常实用的方案就是:

IPAdapter 参考图生图

你可以把它理解成一句话:

先给 AI 看一张人物参考图,再告诉它你想画什么,最后让它参考这张图去生成新图。

很多人把这种效果叫做“锁脸”,

但更严谨一点,它其实更接近:

- 参考图生图

- 人物特征引导

- 人物一致性控制

- 锁脸感生成

这篇文章就带你用一套 非常适合新手 的 ComfyUI 工作流,快速学会:

- 什么是 IPAdapter

- 什么叫“锁脸感”

- 怎么跑通这套工作流

- 新手最容易踩哪些坑

- 怎么判断自己有没有跑对效果

本章的效果:

工作流

图片效果,可以很刑的!!!

1. 这篇教程适合谁?

如果你有下面这些需求,这篇文章会非常适合你:

1.1 刚开始接触 ComfyUI

不想一上来就看太复杂的节点图,只想先搞懂“它到底是干什么的”。

1.2 想让 AI 根据人物图生成更像的新图

比如你有一张参考人物图,希望继续生成风格相似、脸部感觉接近的新图。

1.3 想做人物写真、换场景、换风格

比如同一个人,换成棚拍、街拍、室内、电影感、时尚感等不同效果。

1.4 想解决“人物每次都不一样”的问题

普通文生图很容易每次都像不同的人,参考图工作流能明显改善这一点。

2. 一句话看懂这套工作流

这套工作流的本质就是:

模型负责画图,提示词负责提要求,参考图负责告诉 AI:往这个人物方向靠。

也就是说,它不是只靠文字去猜,而是会真的参考你上传的图片。

3. 这套工作流到底做了什么?

从你这份工作流来看,核心结构非常清晰,主要包括这些节点:

CLIPVisionLoader:加载视觉模型,文件为CLIP-ViT-H-14-laion2B-s32B-b79K.safetensorsCLIPTextEncode:写正向提示词,当前正向提示词为a realistic portrait photo, close-up face, detailed eyes, natural skin texture, studio lighting, high detailCLIPTextEncode:写负向提示词,当前负向提示词为blurry, low quality, deformed face, distorted eyes, bad anatomy, overexposedIPAdapterAdvanced:把参考图特征注入模型,输入包括model、ipadapter、image、clip_visionSaveImage:保存图片,输出前缀为sdxl_ipadapter_demo

简单说,这套流程就是:

参考图 + 提示词 + IPAdapter + 模型

↓

生成更接近参考人物的新图

4. 为什么很多人都在学 IPAdapter?

因为它真的很实用。

普通文生图最大的问题就是:

- 人物不稳定

- 每一张脸都不一样

- 气质飘来飘去

- 很难保持“像同一个人”

而 IPAdapter 的作用就在于:

4.1 让人物更接近参考图

不是完全复制,但会明显往参考图的方向靠。

4.2 让五官和脸型更稳定

比纯提示词生图更容易保持统一感。

4.3 让画面气质更像原图

包括发型、妆感、氛围、光影倾向等。

4.4 更适合做人像延展

尤其适合写真、电商、模特、穿搭类场景。

5. 为什么这里叫“锁脸感”,而不是直接叫“锁脸”?

这是很多新手最容易误解的一点。

5.1 它不是 100% 复制原脸

很多人一听“锁脸”,会以为:

- 上传一张图就能完全复刻同一张脸

- 任意角度都还是这个人

- 像训练人物 LoRA 一样稳定

但实际上,这类工作流更准确的能力是:

- 让人物脸部特征更接近

- 让五官风格和气质更像

- 提升一致性

- 做出“像同一个人”的感觉

5.2 更准确的说法是“人物特征引导”

所以写教程时,用“锁脸感”会更专业,也更不容易引起误解。

6. 小白怎么理解这套工作流原理?

如果你完全是新手,可以直接记住下面这句话:

给 AI 看一张人物图,它会学习这张图的人物特征,再结合你的提示词重新生成。

比如你给它一张女生写真图,它可能会学习到:

- 脸型

- 五官倾向

- 发型

- 光影感觉

- 整体气质

然后你再写文字提示词,比如:

- 写实人像

- 近景脸部特写

- 高细节

- 摄影棚打光

最后 AI 就会朝“这个人 + 这个风格”的方向去生成。

7. 工作流里的核心节点,必须看懂

7.1 CLIPVisionLoader:让 AI 看懂图片

这个节点的作用就是加载视觉模型。

你这套工作流里加载的是:

CLIP-ViT-H-14-laion2B-s32B-b79K.safetensors

它的作用可以简单理解成:

让 AI 具备“看图”的能力。

没有它,IPAdapter 就没法正确理解你的参考图。

7.2 CLIPTextEncode:处理提示词

这套工作流里有两个 CLIPTextEncode 节点,一个负责正向提示词,一个负责负向提示词。

正向提示词

当前工作流中的正向提示词是:

a realistic portrait photo, close-up face, detailed eyes, natural skin texture, studio lighting, high detail

它的意思大概是:

- 写实人像照片

- 近景脸部特写

- 眼睛细节丰富

- 自然皮肤质感

- 摄影棚灯光

- 高细节

负向提示词

当前工作流中的负向提示词是:

blurry, low quality, deformed face, distorted eyes, bad anatomy, overexposed

它的作用就是告诉 AI:

- 不要模糊

- 不要低质量

- 不要脸崩

- 不要眼睛变形

- 不要人体结构错误

- 不要过曝

7.3 IPAdapterAdvanced:整套流程的灵魂节点

这个节点是最关键的。

从工作流结构里可以看到,IPAdapterAdvanced 会接收:

modelipadapterimageclip_vision

然后输出新的 MODEL 给后续采样使用 。

也就是说,它做的事情其实就是:

- 读取原始模型

- 读取 IPAdapter

- 读取参考图

- 读取视觉模型

- 把参考图特征注入模型

- 输出一个“会参考图片”的模型

一句话总结就是:

IPAdapterAdvanced 是把“参考图的影响力”真正加到模型里的地方。

7.4 SaveImage:保存最终图片

工作流最后使用了 SaveImage 节点,输出前缀是:

sdxl_ipadapter_demo

也就是说,最终出图后,你会在输出目录里看到以这个名字开头的图片文件 。

8. 手把手实操:新手怎么跑这套工作流?

下面直接进入最实用的部分。

8.1 准备一张参考图

建议你优先选择下面这种图片:

- 脸部清晰

- 主体突出

- 光线正常

- 遮挡少

- 尽量是正脸或半侧脸

因为参考图越清晰,AI 学到的人物特征通常越稳定。

8.2 导入工作流

把你的 JSON 工作流拖到 ComfyUI 里。

如果导入后没有出现大片红节点,说明基础环境基本没问题。

8.3 检查视觉模型是否正常

找到 CLIPVisionLoader 节点,确认加载的是:

CLIP-ViT-H-14-laion2B-s32B-b79K.safetensors

如果这里正常,就说明“看图”部分基本可以工作 。

8.4 检查提示词

你这套工作流已经带了现成的正向和负向提示词。

正向提示词

a realistic portrait photo, close-up face, detailed eyes, natural skin texture, studio lighting, high detail

负向提示词

blurry, low quality, deformed face, distorted eyes, bad anatomy, overexposed

如果你是第一次测试,建议先不要大改,先跑通效果再说 。

8.5 上传你自己的参考图

把原本的示例图替换成你自己的人物照片。

只要接到参考图输入位置即可。

8.6 确认 IPAdapterAdvanced 连接正常

重点检查这个节点是否正确接入了:

- 模型

- IPAdapter

- 参考图

- CLIP Vision

因为它是整套工作流最关键的一环 。

8.7 开始运行

确认没问题后,直接点击运行。

这时工作流会做这些事情:

- 读取你的提示词

- 读取你的参考图

- 通过视觉模型理解参考图

- 通过

IPAdapterAdvanced将参考图特征注入模型 - 输出最终图片

8.8 查看输出结果

运行完成后,到输出目录查看图片。

输出文件名前缀为:

sdxl_ipadapter_demo

这就是当前工作流里 SaveImage 的命名方式 。

9. 怎么判断自己是不是跑对了?

很多新手第一次跑这种工作流时,不知道效果到底算不算正常。

你可以用下面几个标准判断:

9.1 如果出现这些现象,说明流程是有效的

- 生成人物明显参考了原图

- 五官和脸型更接近参考图

- 发型、气质、氛围更像

- 比纯文生图更稳定

9.2 如果你期待这些效果,要先有心理预期

这类工作流不一定能做到:

- 每次都一模一样

- 任意角度都绝对同一个人

- 完全复刻参考图细节

因为它更偏向“特征引导”,不是绝对复制。

10. 新手最容易踩的坑

10.1 误以为参考图生图 = 完全复制原脸

不是。

它更像是:

- 特征靠近

- 气质接近

- 脸部方向一致

- 人物一致性增强

10.2 参考图太糊、太小、太乱

如果你给 AI 的参考图本身就不清楚,那最终结果当然也会受影响。

正确做法

优先使用:

- 高清

- 主体突出

- 人脸明显

- 背景简单

的图片。

10.3 提示词写得太复杂

很多新手一开始就堆很多提示词,结果把参考图的作用都盖掉了。

正确做法

先用简单的提示词测试,能看出“有没有参考图效果”最重要。

10.4 工作流报红不知道怎么排查

如果你导入后报错,可以优先检查:

- 是否缺少 IPAdapter 相关插件

- 是否缺少视觉模型

- 是否缺少底模

- 节点版本是否不一致

11. 这套工作流适合哪些场景?

如果你问我它最适合用来做什么,我会推荐下面这些方向:

11.1 人物写真

这是最适合的应用场景之一。

11.2 人像换场景

比如同一个人物,换成棚拍、街拍、咖啡馆、电影感等。

11.3 穿搭图生成

参考一个模特图,继续延展不同服装和姿态。

11.4 电商模特图

特别适合“人物气质保持相近”的需求。

11.5 风格迁移

保留人物基本感觉,再换一种视觉风格。

12. 给新手的使用建议

12.1 第一次先别乱调参数

先把工作流跑通,比什么都重要。

12.2 先测试参考图影响

最简单的方式就是:

- 不加参考图生成一张

- 加参考图再生成一张

- 对比两张图差异

这样你最容易看出 IPAdapter 的价值。

12.3 优先换参考图,不要先疯狂调节点

很多时候,参考图质量比你乱调参数更重要。

12.4 提示词先少后多

一开始尽量简单,等效果稳定了再慢慢加细节词。

13. 总结

对于刚接触 ComfyUI 的朋友来说,这套 IPAdapter 参考图生图工作流 非常值得学。

因为它可以解决一个非常常见的问题:

人物不稳定。

而你这套工作流本身也具备了比较完整的结构,包括:

CLIPVisionLoader加载视觉模型CLIP-ViT-H-14-laion2B-s32B-b79K.safetensorsCLIPTextEncode处理正向和负向提示词IPAdapterAdvanced注入参考图特征SaveImage以sdxl_ipadapter_demo前缀保存图片

如果你以前只会普通文生图,那么学会这套流程之后,你对“人物一致性”和“参考图生图”的理解会直接提升一个层次。

最后你只需要记住一句话:

让 AI 先看图,再画图。

这就是 IPAdapter 最核心的价值。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)