MCP 接入高德、支付宝之后:AI 系统测试到底怎么做?

摘要:随着AI系统通过MCP协议调用外部能力,测试重点转向能力编排验证。文章系统阐述了MCP测试体系,包括:1)三层架构测试(模型决策、调度层、MCP服务);2)五层测试方法(工具路由、参数正确性、异常处理、权限控制、性能成本);3)合规追溯框架;4)多工具链路风险;5)测试能力补充方向(能力评估指标、Prompt注入测试、可观测体系等)。文章指出,AI测试已从功能验证升级为可信能力验证,测试工程

关注 霍格沃兹测试学院公众号,回复「资料」, 领取人工智能测试开发技术合集

当大模型开始通过 MCP 调用高德地图、支付宝、搜索系统等外部能力时,测试对象已经发生变化。

我们不再只是验证“接口是否返回 200”,而是在验证:

-

模型是否正确决策调用工具

-

工具结果是否被正确融合

-

多工具链路是否稳定

-

输出是否合规且可追溯

MCP 让 AI 系统进入“能力编排”阶段,测试体系必须随之升级。

目录

-

MCP 在 AI 架构中的位置

-

MCP 调用流程与可观测点

-

MCP 测试方法分层拆解

-

合规与可追溯的验证框架

-

多工具链路与性能风险

-

AI 测试体系的能力补充方向

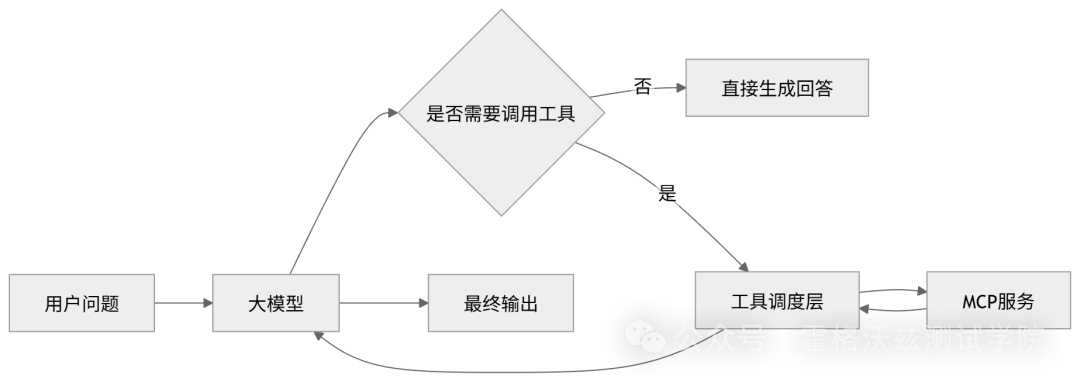

一、MCP 在 AI 架构中的位置

MCP(Model Context Protocol)的核心作用,是让模型具备调用外部系统的能力。

但需要澄清一个事实:

模型不会“直接访问”外部系统,必须存在工具调度层或权限控制层。

一个更完整的结构是:

职责划分:

-

模型:决策是否调用工具

-

调度层:安全控制与参数校验

-

MCP 服务:提供真实能力

测试必须覆盖三层,而不是只测接口本身。

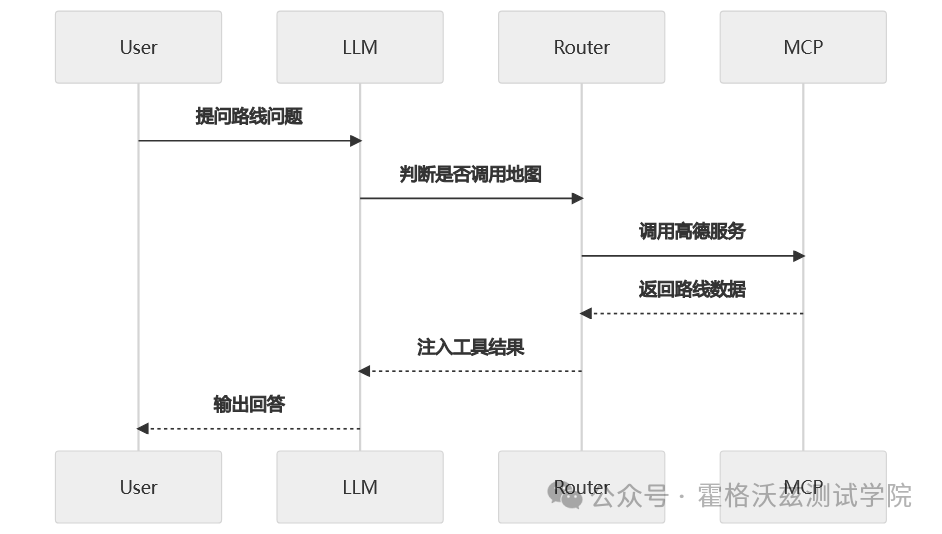

二、MCP 调用流程与可观测点

以高德导航为例,完整链路如下:

测试可观测点包括:

-

决策是否准确

-

参数是否正确构造

-

返回数据是否完整

-

是否发生结果篡改

-

输出是否引用真实数据

如果缺少可观测能力,系统一旦出错将无法定位。

三、MCP 测试方法分层拆解

工程实践中,MCP 测试可分为五个层面。

第一层:工具路由决策测试

-

应调用却未调用

-

不应调用却调用

-

被提示词诱导误调用

第二层:参数与结果正确性

-

参数是否符合协议

-

单位是否被错误转换

-

是否遗漏关键字段

-

是否二次计算错误

第三层:异常与降级机制

-

MCP 超时

-

返回空值

-

返回结构变化

-

限流或异常

验证是否具备:

-

重试机制

-

降级策略

-

明确错误提示

第四层:权限与安全控制

-

是否可越权调用

-

是否存在隐藏工具泄露

-

是否可绕过权限限制

第五层:性能与成本控制

真实响应时间由三部分组成:

模型推理时间

-

MCP 服务响应时间

-

数据注入与二次推理时间

多工具场景下,延迟会叠加,必须做链路级性能测试。

四、合规与可追溯的验证框架

当 AI 可以调用真实世界能力时,风险边界扩大。

合规测试不再是简单的敏感词过滤。

必须验证:

-

敏感话题处理能力

-

对抗式提示词攻击

-

工具调用是否合法

-

输出是否具备数据来源

-

是否可进行完整审计

关键在于“可追溯性”。

需要记录:

-

是否调用 MCP

-

调用了哪个服务

-

调用时间

-

原始返回数据

-

最终输出是否修改

在金融、医疗等场景,没有可追溯体系,就无法承担责任。

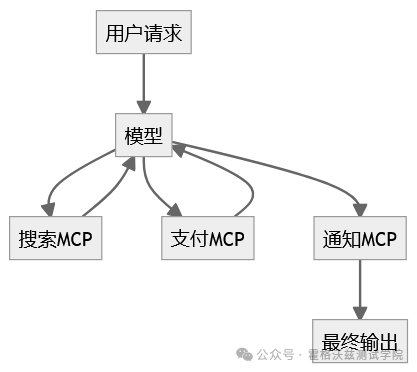

五、多工具链路与性能风险

在真实系统中,一个问题可能触发多次工具调用:

flowchart TD

A[用户请求] --> B[模型]

B --> C[搜索MCP]

C --> B

B --> D[支付MCP]

D --> B

B --> E[通知MCP]

E --> F[最终输出]

风险点包括:

-

工具之间数据依赖

-

中间状态不一致

-

循环调用

-

Token 成本失控

-

延迟累积

测试必须从“单接口验证”升级为“能力链路验证”。

六、AI 测试体系的能力补充方向

现有测试体系仍有不足,需要补充以下能力。

第一,建立能力级评估指标

不仅评估回答是否正确,还需评估:

-

工具选择准确率

-

工具使用成功率

-

结果融合准确率

-

幻觉率

第二,构建 Prompt Injection 专项测试

验证模型是否会被恶意提示词诱导:

-

越权调用工具

-

泄露系统信息

-

绕过安全策略

第三,完善可观测体系

必须具备:

-

工具调用日志

-

Token 消耗监控

-

调用失败率统计

-

链路追踪能力

第四,补充多模型与多智能体测试

当系统引入多个模型或多个 Agent 时:

-

决策冲突如何处理

-

工具重复调用如何避免

-

状态同步如何保证

这些都是 MCP 场景下的新问题。

写在最后

MCP 让 AI 从“回答问题”变成“调用世界”。

测试的核心问题也发生变化:

不是功能是否正确,

而是能力是否可信、链路是否稳定、行为是否可控。

当模型开始决策工具调用时,

测试工程师必须从接口思维,升级到能力编排思维。

这是 AI 系统测试真正的分水岭。

推荐学习

开源AI助理 OpenClaw(龙虾)公开课,手把手带你打造24小时不休的AI打工人。

扫码进群,报名学习。

关于我们

霍格沃兹测试开发学社,隶属于 测吧(北京)科技有限公司,是一个面向软件测试爱好者的技术交流社区。

学社围绕现代软件测试工程体系展开,内容涵盖软件测试入门、自动化测试、性能测试、接口测试、测试开发、全栈测试,以及人工智能测试与 AI 在测试工程中的应用实践。

我们关注测试工程能力的系统化建设,包括 Python 自动化测试、Java 自动化测试、Web 与 App 自动化、持续集成与质量体系建设,同时探索 AI 驱动的测试设计、用例生成、自动化执行与质量分析方法,沉淀可复用、可落地的测试开发工程经验。

在技术社区与工程实践之外,学社还参与测试工程人才培养体系建设,面向高校提供测试实训平台与实践支持,组织开展 “火焰杯” 软件测试相关技术赛事,并探索以能力为导向的人才培养模式,包括高校学员先学习、就业后付款的实践路径。

同时,学社结合真实行业需求,为在职测试工程师与高潜学员提供名企大厂 1v1 私教服务,用于个性化能力提升与工程实践指导。

更多推荐

已为社区贡献202条内容

已为社区贡献202条内容

所有评论(0)