【机器人系统】机器人的大脑:具身智能

人形机器人由大脑、小脑、肢体三部分组成。“大脑”主要基于AI 大模型,根据环境、任务和目标等信息,自主做出最优决策,以实现自主导航、任务执行、人机交互等功能。“小脑”基于人工智能、自动控制、机器人操作系统(ROS)等技术,实现复杂环境下的运动控制。“肢体”基于多种传感器,能够感知非结构化场景并根据不同情况做出反应,实现高动态、高精度的运动。机器人大模型和通用大模型有一定区别,难以直接共用。LLM

人形机器人由大脑、小脑、肢体三部分组成。“大脑”主要基于AI 大模型,根据环境、任务和目标等信息,自主做出最优决策,以实现自主导航、任务执行、人机交互等功能。“小脑”基于人工智能、自动控制、机器人操作系统(ROS)等技术,实现复杂环境下的运动控制。“肢体”基于多种传感器,能够感知非结构化场景并根据不同情况做出反应,实现高动态、高精度的运动。

机器人大模型和通用大模型有一定区别,难以直接共用。LLM 是“语言预测器”,不是机器人控制器。LLM 的训练目标是下一个 token 的概率建模,它擅长把语言模式、常识与统计相关性连成可读文本,但并不包含传感器实时流、物理动力学或机器人本体的低阶行为模型。这意味着 LLM 很擅长“告诉你怎么做一件事”的文本步骤,但不能保证这些步骤在当前机器人成本结构/环境/物理条件下可执行。

一、机器人大模型的能力

从功能需求角度出发,人形机器人的“大脑”大模型需要具备以下能力:

- 实时交互能力。人形机器人需要具备与人类实时的任务级交互能力,快速理解人类通过语言、手势等方式给出的指令,并有效执行。当出现指令理解不清或任务执行完毕后,可以与人类进行进一步的多轮交互。

- 多模态感知能力。为了在复杂环境中做出正确决策,人形机器人要能够通过视觉、听觉、触觉等多种感官获取信息。大模型需要整合这些多模态感知数据,以实现对环境的全面理解。

- 自主可靠决策能力。人形机器人在执行任务时,需要能够理解任务的复杂性,并将其分解为一系列可执行的子任务。这要求大模型具备强大的语言理解能力和对物理世界的深刻理解。例如,机器人可能需要理解“清理房间”这一任务,包括识别哪些物品需要移动,哪些需要丢弃。

- 涌现和泛化能力。除了在训练数据上的表现,大模型还应具备超出训练范围的执行能力。具体表现为人形机器人能够在未见过的新环境中执行任务,适应新的、未知的情况。面对新挑战时,展现出创新性的解决方案。

二、机器人大模型的技术路线

从技术路线上看,目前基于大模型的“大脑”技术路线正处在并行探索阶段,并逐渐向端到端的大模型演进。具身智能算法层的技术路线,存在三条主流路径。

第一条是端到端 VLA 技术路线,采用单一模型直接从感知到动作的端到端学习方式,虽然具备一定泛化能力,但主要适用于短程任务,在复杂长程任务上存在局限性。

第二条是大脑+小脑分层技术路线,这是目前相对成熟的主流方向。该路线以多模态大模型作为“大脑”负责高层决策和任务规划,配合专门的“小脑”模型处理具体的运动控制和执行任务,通过分层协作实现更强的任务处理能力。

第三条是世界模型技术路线,代表最前沿的探索方向。世界模型旨在构建对物理世界的完整建模,通过预测未来状态来优化动作决策。

目前 VLA 还是一个非常难的问题,有很多研究的空间。世界模型的研究仍处于特别早期,大小脑技术路线可以实现模块化、可泛化和可解释的一些优势。

此外,类脑智能和脑机接口等创新技术也为人形机器人“大脑”的解决方案带来无限可能。类脑智能是人工智能技术的进一步延伸,是通过对人脑生物结构和思维方式进行直接模拟,使智能体能够像人脑一样精确高效处理多场景下的复杂任务,是未来有望代替大模型的新技术路线。脑机接口是在人脑与外部设备间建立连接通路的技术,实现人脑与外界设备的信息交换。未来有望基于脑机接口实现“大脑”的“人+机”混合智能。

三、机器人大模型的训练方法

具身智能的训练方法可分为模仿学习和强化学习两种路线。模仿学习是指智能体通过观察和模仿专家(经验丰富的人类操作者或具有高级性能的系统)的行为来学习任务。强化学习是指智能体通过与环境的交互来学习最佳行为策略,以最大化某种累积奖励。这两类技术路线,在架构上差异很大。模仿学习通常是标准的监督学习架构(如卷积神经网络+全连接层),直接输出动作。训练相对稳定,但是学习到的行为策略受限于专家数据,对于未见过的情况泛化能力较差。而强化学习的架构更复杂,通常包含策略网络和价值网络。需要考虑时序关系,常使用循环神经网络或Transformer,训练稳定性是核心挑战。需要大量的探索和试错,学习过程缓慢;对于复杂任务,设计合适的奖励函数难度较高。

具身智能的两类训练方法与三类模型架构结合来看,就能发现不同的架构最适宜的训练方法:

|

模型架构 |

最亲和的训练方法 |

为什么?—— 核心逻辑 |

典型代表 |

|

端到端架构 |

模仿学习 |

需求:海量、精准的“输入-输出”对。 端到端模型是一个巨大的“黑箱”,直接学习从传感器数据到动作指令的映射。模仿学习正好提供了这种“标准答案”(状态->专家动作),让模型可以像训练一个超大的分类器一样,通过监督学习来拟合这些数据。 |

特斯拉Optimus (训练初期), RT-2 |

|

分层架构 |

强化学习 (尤其是结合模仿学习) |

需求:分层优化,逐级反馈。 分层架构的“高层”做任务规划,“低层”做运动控制。强化学习非常适合这种结构:高层可以根据环境反馈的稀疏奖励,学习如何制定长时序任务;低层则可以在高层的指导下,通过强化学习优化出更稳健、更动态的运动技能。 |

大多数足式机器人运动控制 (如宇树H1的行走), Google的SayCan |

|

世界模型 |

强化学习 (基于模型的强化学习) |

需求:学习环境的动态规律。 世界模型本身就是用来预测“如果我做了A,世界会变成B”。这完美契合了强化学习中“模型”的概念。智能体可以先通过交互(强化学习的一种形式)学习一个世界模型,然后在模型内部进行“脑补”和规划,而不需要每次都去真实世界冒险,大大提高了学习效率。 |

Dreamer系列, MuZero, UniSim |

四、机器人大模型的数据获取

具身智能大模型研发的难点,一个是数据获取,另一个是学习训练。

具身智能大模型训练数据难以获得。不同于文本、图像等互联网数据可以轻松爬取和积累,具身智能需要的是机器人与物理世界交互的行为数据,这类数据天然稀缺且获取门槛极高。数据主要分为真实数据与仿真数据。

真实数据是智能体通过自身物理身体上的各类传感器(如摄像头、麦克风、触觉传感器等 ),在与真实物理环境进行交互过程中,实时采集获取的数据。真实数据主要来源有:机器人遥操(通过人工远程操控获取真实场景下的操作数据)、动作捕捉(记录人类在特定环境中的行为模式)。

真实数据被公认为训练效果最好的“黄金数据”,但采集成本更高,并且格式不统一。不同机器人本体由于硬件设计、控制系统的差异,产生的数据在坐标系定义、时间戳格式、动作标签规范上完全不兼容,每个机器人平台都需要重新积累数据,严重制约了技术迭代效率。即使是同一个抓取任务,不同操作员的执行轨迹可能相差很多。

相比之下,仿真数据可以大规模生成,成本低廉,但训练出来的模型往往不适应。仿真数据是借助计算机模拟技术,在虚拟环境中生成的、用于训练具身智能的数据。通过构建虚拟场景、物体和智能体,模拟智能体与虚拟环境的交互过程来产生数据。即利用仿真环境生成训练数据。短期来看,仿真数据用于解决简单任务,助力具身智能实现0到1的突破。尤其针对跑步、跳跃或者跳舞等简单的运动任务,仿真数据已经足够支撑。反正数据的优势在于获取快、成本低且数据量大。

现有仿真环境很难准确还原真实世界的复杂物理交互,特别是遇到柔性物体操作、复杂环境建模时,仿真与现实的差距就暴露无遗。具身智能学习训练难度大。具身智能的学习训练方法还有待探索,目前企业多采用世界模型、遥控操作、仿真迁移、模拟训练等方法,但都有局限性,无法获得通用泛化能力。

具身智能数据质量把控是重要一环。具身智能开发和验证所需的数据集包括任务语言描述、场景语义、3D空间、本体状态、运动轨迹、视触感知等多模态、强异构的数据,涉及不同的数据采集设备和数据获取方式,且需要经过多阶段的数据处理,因此对数据质量的把控是很重要的一个环节。

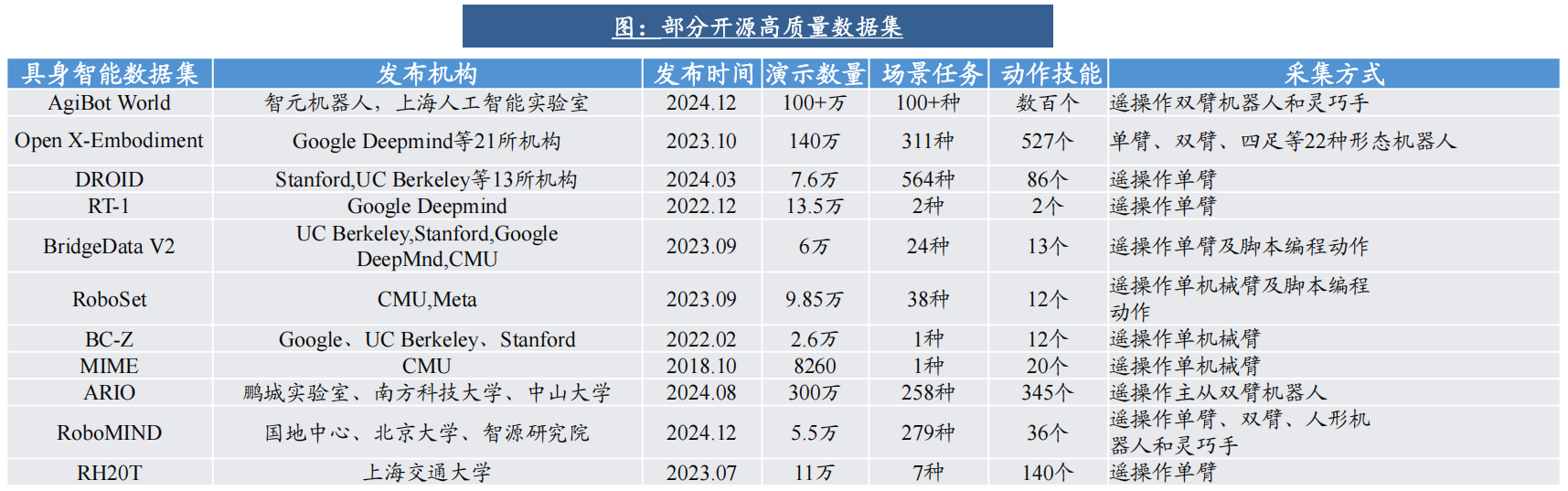

当前具身智能机器人数据多为厂商自采集。当前给人形机器人采集的高质量数据通常在现实世界中获取,采集方式主要有直接接触数据(真机数据)和间接接触数据(人工控制数据)两种。最理想的数据采集方式是通过人形机器人本体直接触达物理世界,让其准确理解真实环境。但是,大规模真机数据的采集成本高昂,需要投入许多人力、物力和时间资源,数据标注和采集设备都存在门槛。与此同时,物理世界的运行规律错综复杂,数据的采集往往难以全面反映所有相关的物理现象与知识。目前市面上存在丰富的高质量具身智能数据集,具备丰富的演示数量、场景任务和动作技能等。

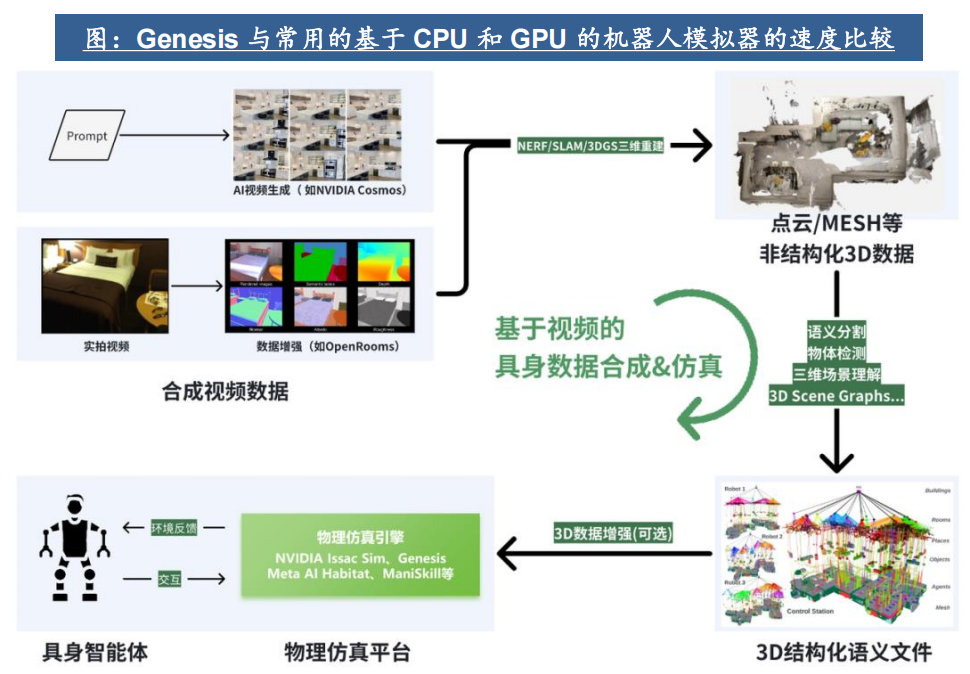

机器人仿真数据主要依赖虚拟场景,而场景的合成方案可拆解成两个关键部分:场景生成(Gen)与模拟(Sim)。场景生成引擎(Gen)主要有两种技术路径:

合成视频+3D重建:这是一条“从像素到几何”的路径。基于像素流驱动,先生成视频或图像,再重建为点云或mesh等非结构化3D数据,最终转为结构化语义模型。如Hillbot、群核科技、World labs(李飞飞)等。重建后得到的是非结构化的mesh或点云。如果想要得到“墙壁”、“窗户”、“椅子”这些独立的语义物体,还需要额外做一步语义分割和物体提取(即“结构化”过程)。

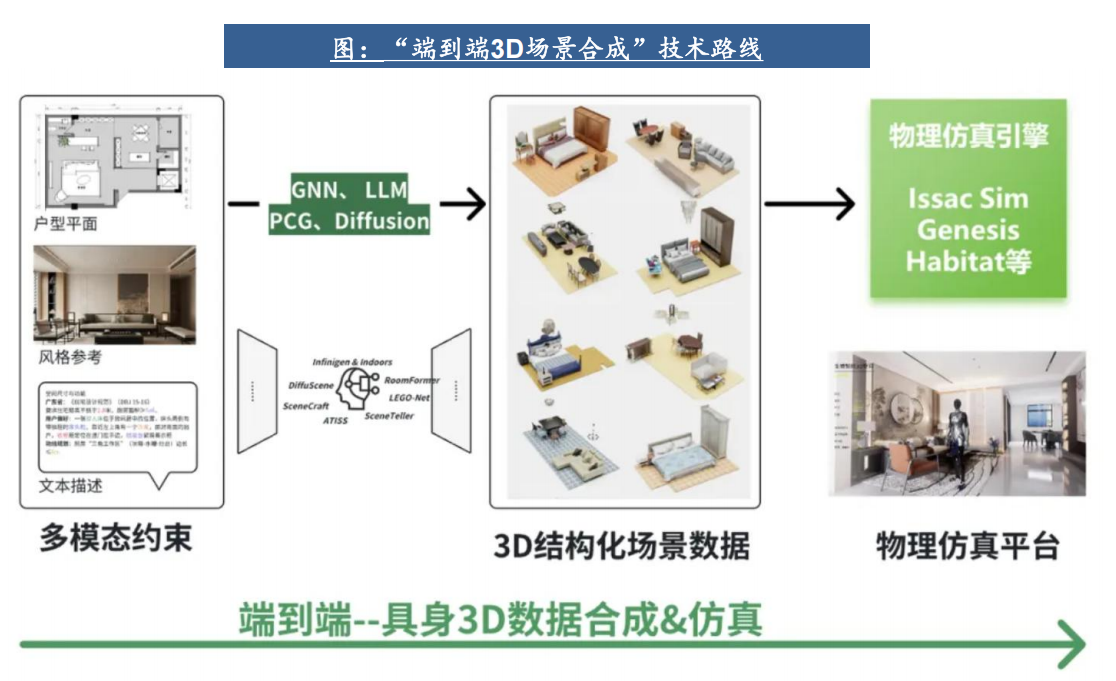

AIGC直接合成3D数据:这是一条“从语义到几何”的路径。利用图神经网络(GNN)、扩散模型(Diffusion)、注意力机制(Attention)等方法,直接合成结构化空间数据。如 ATISS、LEGO-Net、DiffuScene、RoomFormer 等代表模型,部分方案结合程序化生成技术,如 Infinigen(CVPR 2024)。生成的就是结构化的数据。例如,直接输出一个场景图(Scene Graph),明确节点A是“沙发”,节点B是“茶几”,以及它们之间的相对变换矩阵。或者直接生成一个参数化的CAD模型序列。这种路径产出的数据天生具备可编辑性。因为生成的是结构化数据,你可以轻松地移除沙发、替换茶几模型,或者改变墙壁的颜色。

在核心技术栈方面,合成视频+3D重建更侧重于:图形学渲染(光线追踪、着色器)、多视角几何、NeRF(神经辐射场)和3D Gaussian Splatting(3D高斯泼溅)。AIGC直接合成3D更侧重于:图神经网络(处理物体间关系)、扩散模型(在3D空间去噪)、Transformer(捕捉场景上下文的长期依赖关系),以及程序化生成(用代码规则生成地形或建筑结构)。

机器人操控的本质,是与物体发生物理接触,而接触这个行为,会让问题的难度呈指数级上升。具身智能大模型难点在于如何创造一个可以大规模应用于任何任务的配方,只需有一个小配方,然后一个接一个地应用,每个任务都能接连解决,无论使用的是何种硬件。这里所说的小配方,不是单一的算法或模型,而是一个包含了“数据配比 + 训练流程 + 模型架构 + 虚实迁移”的系统性方案。这个“配方”的终极目标是:让机器人只需极少量(甚至为零)的真实世界尝试,就能像一个熟练的学徒一样,从容地应对每一次全新的物理接触,真正从“仿真王者”变成“实操大师”。

五、机器人大模型的计算平台

具身智能四个最关键的因子:算法、算力 、机器人硬件、数据。算力层面:国外以英伟达、AMD为代表,国内以寒武纪、海光信息、地平线等公司为代表,正在快速突围。

机器人对芯片的需求非常特殊,它不是简单的“CPU+GPU”组合就能完美满足的。机器人需要的是一个能同时处理“思考”和“本能反应”的异构计算平台。

- 实时性要求:机器人运动控制需要在毫秒甚至微秒级内做出响应。如果依赖云端计算,网络延迟可能导致机器人摔倒或撞墙。

- 多传感器融合:一台人形机器人可能搭载20多个摄像头以及激光雷达、IMU等多种传感器,需要芯片能在极短时间内处理海量数据。

- 多任务并行:机器人需要同时运行多个模型——大语言模型(对话)、视觉模型(感知)、控制算法(行走)。这些任务对算力和延迟的要求完全不同,需要芯片具备强大的多实例隔离能力(如英伟达的MIG技术)。

- 功耗与散热的严苛限制:机器人是移动设备,电池容量有限。芯片必须在有限的功耗预算内(如Jetson Thor的130W)提供最大算力,能效比是关键指标。

对此,机器人芯片“四大门派”采取了各自不同的产品策略。

英伟达是“大一统”平台战略。打造从云端训练到边缘推理的完整生态,提供“三台计算机”(DGX训练+Omniverse仿真+Jetson部署)的端到端解决方案。英伟达 Jetson系列是专为机器人和嵌入式边缘AI应用设计的计算平台,由Jetson模组、JetPack SDK和生态系统组成,加速软件开发。Jetson系列的主要成员包括Jetson Nano、Jetson TX2和Jetson AGX Xavier,适用于不同的应用场景。Jetson Nano是最小的设备,配备了128核心GPU和四核ARM Cortex-A57 CPU。Jetson Xavier系列模组具有高达32 TOPS的AI性能,适用于自主机器的视觉测距、传感器融合、定位和地图构建等应用。

2024年GTC大会上,英伟达还发布了一款基于 NVIDIA Thor 系统级芯片(SoC)的新型人形机器人计算机 Jetson Thor。Jetson Thor 是一个全新的计算平台,能够执行复杂的任务并安全、自然地与人和机器交互,具有针对性能、功耗和尺寸优化的模块化架构。该 SoC 包括一个带有 transformer engine 的下一代 GPU,其采用 NVIDIA Blackwell 架构,可提供每秒 800 万亿次8位浮点运算 AI 性能,以运行 GR00T 等多模态生成式 AI 模型。凭借集成的功能安全处理器、高性能 CPU 集群和 100GB 以太网带宽,大大简化了设计和集成工作。

|

厂商/机器人 |

芯片方案 |

算力水平 |

关键状态 |

核心差异点 |

|

特斯拉 (Tesla) Optimus |

特斯拉自研 AI5 芯片 |

2000-2500 TOPS |

设计接近完成,计划2026年样品、2027年大规模量产 |

全自研,与FSD汽车共享技术栈,目标是软硬件垂直整合,成本可控。 |

|

智元机器人 (Agibot) 精灵 G2 |

明确提及算力升级目标 |

从500 TOPS向2000 TOPS升级 |

未说明采用Jetson Thor,目前主力产品仍基于Jetson Orin (如远征A1为200 TOPS) |

处于技术规划阶段。当前产品未达此算力,未来方案未定,但英伟达Thor是重要候选。 |

|

其他前沿厂商 (如波士顿动力) |

NVIDIA Jetson Thor |

高达2070 TOPS (FP4) |

平台已发布并进入量产,波士顿动力新版Atlas已宣布采用 |

基于英伟达Blackwell架构,专为机器人设计,拥有强大的AI加速核心和生态支持。 |

根据宇树、众擎、松延动力等厂商官网说明,可以发现目前主流机器人厂商都会将算力模组分为高低两个版本提供用户,其中低配的基础算力模组可以完成一些遥控的走路、跑步、跳跃等基础性动作,二次开发部署潜力较弱,起售价均在10万元以内。宇树、众擎使用英特尔 Core i5及N97作为基础算力模组CPU,其中i5为成熟民用CPU而N97为一款低功耗移动处理器,专为轻量级计算和嵌入式场景设计。如果极客开发者、院校培训、创业者等需要对机器人进行二次开发,则需使用高算力模组的高配版本,整机价格可能会有数倍的价差。目前,绝大部分厂商的高算力模组主要还是基于英伟达Jetson Orin平台进行开发。

AMD不做“标准品”,做“乐高高手”。AMD的策略不是提供一款固定的SoC,而是提供高度可定制化的自适应计算平台。对于需要处理非标准接口、实现超低延迟控制环的工业机器人,开发者可以用FPGA精确地“画”出自己需要的硬件加速电路。这种灵活性是英伟达固定架构的GPU难以比拟的。

英特尔是做“大一统”的简化者。英特尔看到了机器人行业的一个痛点:传统上,运动控制和AI感知需要用两颗甚至多颗不同架构的芯片,开发复杂、成本高。英特尔的答案是:用一颗强大的酷睿Ultra处理器,把“小脑”(实时控制)和“大脑”(AI推理)都装进去。通过隔离能效核做运动控制,用GPU/NPU跑AI模型,实现软硬件的高度整合。这对于成本敏感的服务机器人市场吸引力巨大。

高通是做“能效比”的极致追求者。高通从手机芯片领域带来的核心能力是:在极低功耗下实现极高算力。高通跃龙IQ10在稀疏算力下可达700 TOPS,远超Jetson Orin的275 TOPS。对于需要长时间续航、对散热要求苛刻的商用机器人,高通的方案可能是更优解。而且高通正在构建自己的生态系统,Figure这样的明星公司选择与高通合作,说明其方案已获得市场认可。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)