OpenClaw 部署实战:用 Docker 打造你的私人 AI 员工

OpenClaw 是 GitHub 上热门的 AI Agent 项目,可通过 Docker 快速部署,避免环境冲突问题。只需安装 Docker 并准备 API Key(如 Claude 3.5 或 GPT-4o),拉取镜像后配置 config.json 文件,启动容器即可运行。OpenClaw 支持文件操作、浏览器访问和命令执行,还能连接本地大模型(如 Ollama)。遇到问题可查看日志排查,轻松

最近 GitHub 上最火的项目非 OpenClaw 莫属了,Star 数直冲 24 万。傅盛都说这是 AI Agent 的未来。

很多朋友问我:这东西到底怎么装?是不是还得写代码?

其实没那么复杂。今天我们就来实战一下,用最干净的方式——Docker,把这个“数字员工”请进你的电脑。即使你对编程一窍不通,跟着做也能跑起来。

为什么选择 Docker 部署?

OpenClaw 是一个基于 Node.js 的复杂应用,依赖很多系统库。如果你直接在本机安装(npm install),很容易遇到环境冲突、依赖报错等问题,把你的系统搞得乱七八糟。

用 Docker 的好处是:环境隔离,用完即焚。它把 OpenClaw 锁在一个盒子里,无论怎么折腾,都不会影响你的宿主机系统。

准备工作

你需要准备两样东西:

- Docker Desktop:去 Docker 官网下载安装,傻瓜式操作。安装完后打开终端输入

docker -v,能看到版本号就算成功。 - API Key:推荐使用 Anthropic (Claude 3.5 Sonnet) 或者 OpenAI (GPT-4o) 的 Key。

- 进阶玩家:如果你电脑显卡够强(RTX 3090/4090),也可以配合 Ollama 使用本地模型,完全免费。

第一步:拉取镜像

打开你的终端(Terminal 或 CMD),输入以下命令:

docker pull openclaw/openclaw:latest

这会下载最新的 OpenClaw 镜像。文件可能有点大(约 2GB),耐心等待一下。

第二步:准备配置文件

OpenClaw 的强大在于可配置。我们需要在本地创建一个文件夹来存放它的配置和记忆,这样即使删除容器,你的数据也不会丢。

在你的电脑上创建一个叫 openclaw-data 的文件夹,然后在里面建一个 config.json 文件。

推荐配置(config.json)

把下面的内容复制进去,记得替换 apiKey:

{

"brain": {

"provider": "anthropic",

"model": "claude-3-5-sonnet-20240620",

"apiKey": "sk-ant-api03-...",

"temperature": 0.7,

"maxTokens": 4096

},

"body": {

"capabilities": {

"filesystem": {

"enabled": true,

"basePath": "/app/workspace"

},

"browser": {

"enabled": true,

"headless": true

},

"shell": {

"enabled": true,

"allowedCommands": ["ls", "cd", "cat", "git", "npm"]

}

}

},

"soul": {

"storagePath": "/app/data/memory",

"longTermMemory": true

}

}

注意:shell 能力默认是关闭的,开启后它能执行系统命令,请务必设置 allowedCommands 白名单,防止它误删文件。

第三步:启动容器

关键的一步来了。运行下面的命令启动它:

docker run -d \

--name my-openclaw \

-v $(pwd)/openclaw-data/config.json:/app/config/config.json \

-v $(pwd)/openclaw-data/data:/app/data \

-v $(pwd)/openclaw-data/workspace:/app/workspace \

-p 3000:3000 \

--restart unless-stopped \

openclaw/openclaw

如果你是 Windows 用户,把 $(pwd) 换成你的绝对路径,比如 D:/openclaw-data。

第四步:跟它打个招呼

启动成功后,等待约 30 秒初始化。打开浏览器访问 http://localhost:3000。

你应该能看到 OpenClaw 的控制台界面了。

试着给它下达第一个指令:

“创建一个 Python 脚本,打印 Hello World,并保存到 workspace 目录。然后运行它。”

你会看到日志里疯狂滚动:

Thinking: 用户想写 Python。Action: 调用 FileSystem.write(‘hello.py’)。Action: 调用 Shell.exec(‘python3 hello.py’)。Observation: 输出 “Hello World”。Reply: 任务完成,脚本已创建并执行。

这比单纯的 ChatGPT 对话震撼多了,因为它真的改变了物理世界(虽然只是硬盘上的文件)。

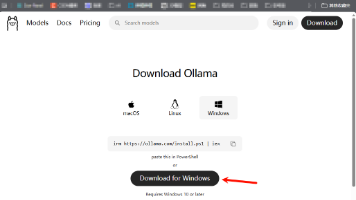

进阶玩法:连接本地大模型 (Ollama)

如果你不想付 API 费用,或者担心隐私泄漏,可以让 OpenClaw 连接本地的 Ollama。

- 先安装 Ollama 并运行

ollama run qwen2.5-coder:7b(推荐 Qwen2.5 Coder,代码能力强)。 - 修改

config.json:

"brain": {

"provider": "ollama",

"model": "qwen2.5-coder:7b",

"baseUrl": "http://host.docker.internal:11434"

}

注意 host.docker.internal 是 Docker 访问宿主机的特殊地址。

常见问题排查 (Troubleshooting)

- 容器启动失败:

- 运行

docker logs my-openclaw查看报错。 - 通常是

config.json格式错误(比如少了个逗号)。

- 运行

- 无法上网:

- 如果你的网络环境需要代理,记得在

docker run时加上-e HTTPS_PROXY=http://your-proxy:7890。

- 如果你的网络环境需要代理,记得在

- 无限复读:

- 这是本地小模型常见的毛病。尝试降低

temperature到 0.2,或者换更强的模型。

- 这是本地小模型常见的毛病。尝试降低

总结

OpenClaw 的部署其实非常简单。只要跑起来,你就拥有了一个不知疲倦的数字员工。

它可以帮你爬虫、写代码、整理文件,甚至在你睡觉时监控币圈行情。

还在等什么?赶紧动手试试吧!

更多推荐

已为社区贡献20条内容

已为社区贡献20条内容

所有评论(0)