openclaw使用本地大模型

openclaw使用本地大模型

·

openclaw使用本地大模型

openclaw的安装参考这里

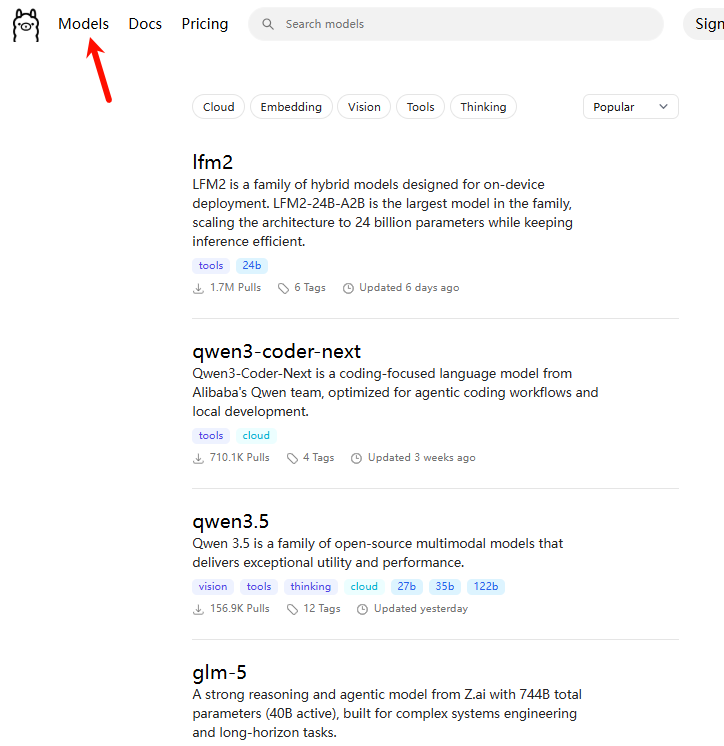

本地大模型安装

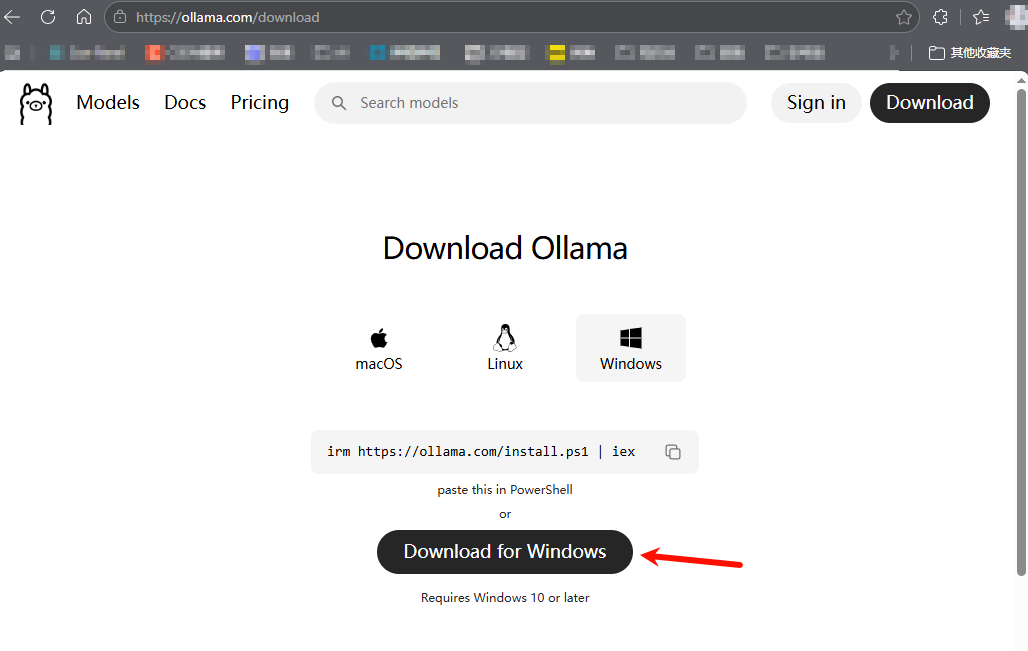

安装ollama

通过管网链接下载对应平台工具:

下载完后一直点击下一步完成安装:

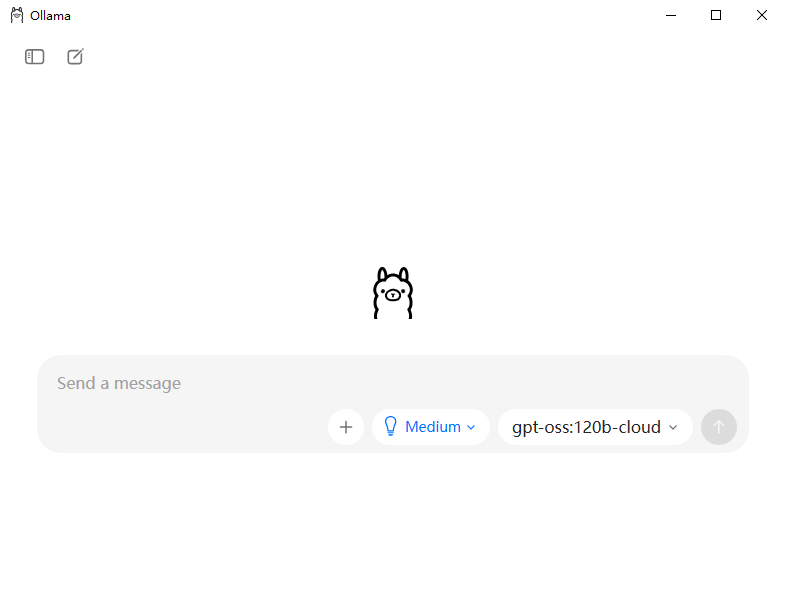

通过cmd命令行查看是否正常:

安装大模型

执行命令下载大模型(如果本地没有会先下载,如果有就是直接运行):

ollama run 模型名字

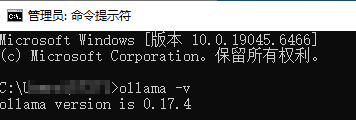

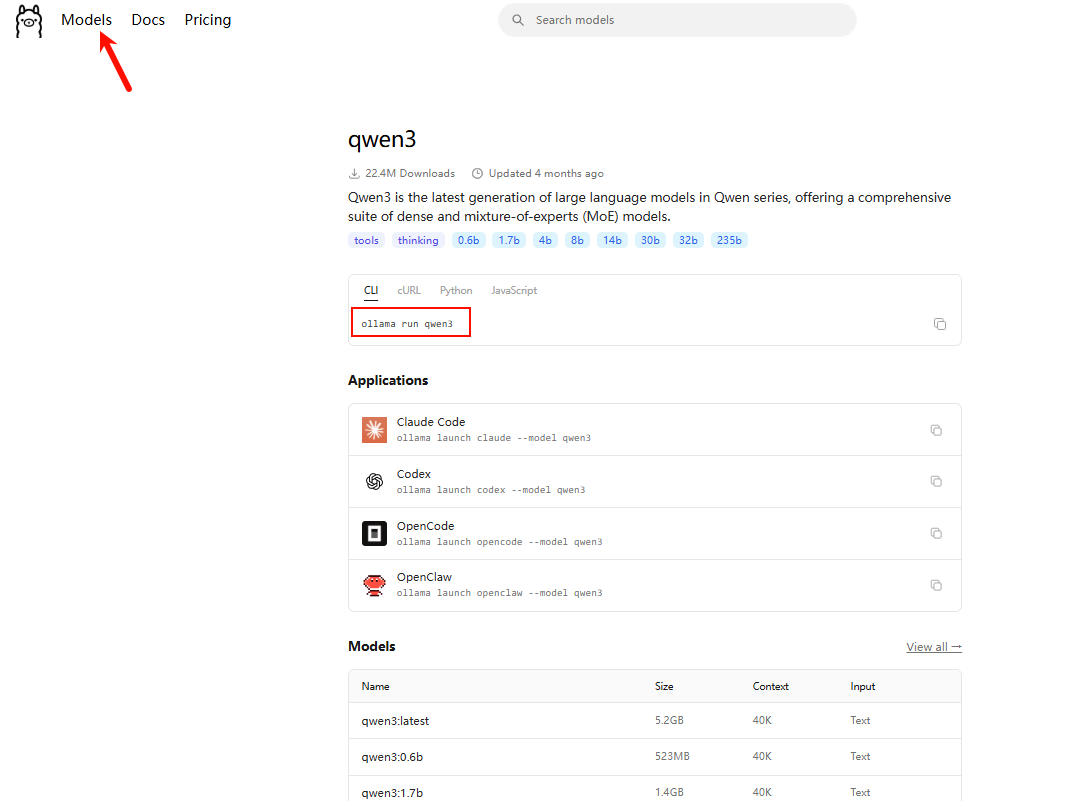

模型可以在ollama管网查找:

选择一个自己感兴趣的点进去就能看到安装命令:

如果需要指定多少b的就在后面加:号补充,比如:

ollama run qwen3:30b

能不能正常跑起来要看本地硬件配置,大致可以参考如下计算方法:

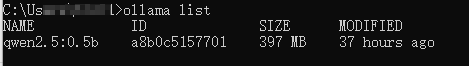

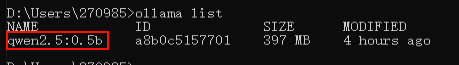

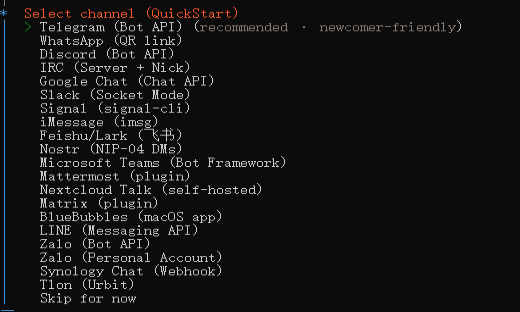

下载了哪些大模型可以通过命令ollama list查看,比如我就下了一个qwen2.5的0.5b:

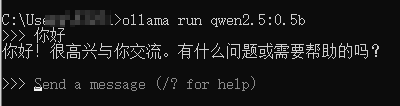

运行起来就是这个样子,在命令行中可以进行交流:

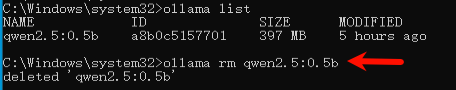

删除大模型

使用命令:

ollama rm 模型名字

openclaw使用本地大模型

部署openclaw时选择

这里顺便提一下windows下最原始的方法安装openclaw(现在也通过如Cherry Studio客户端来安装,更方便):

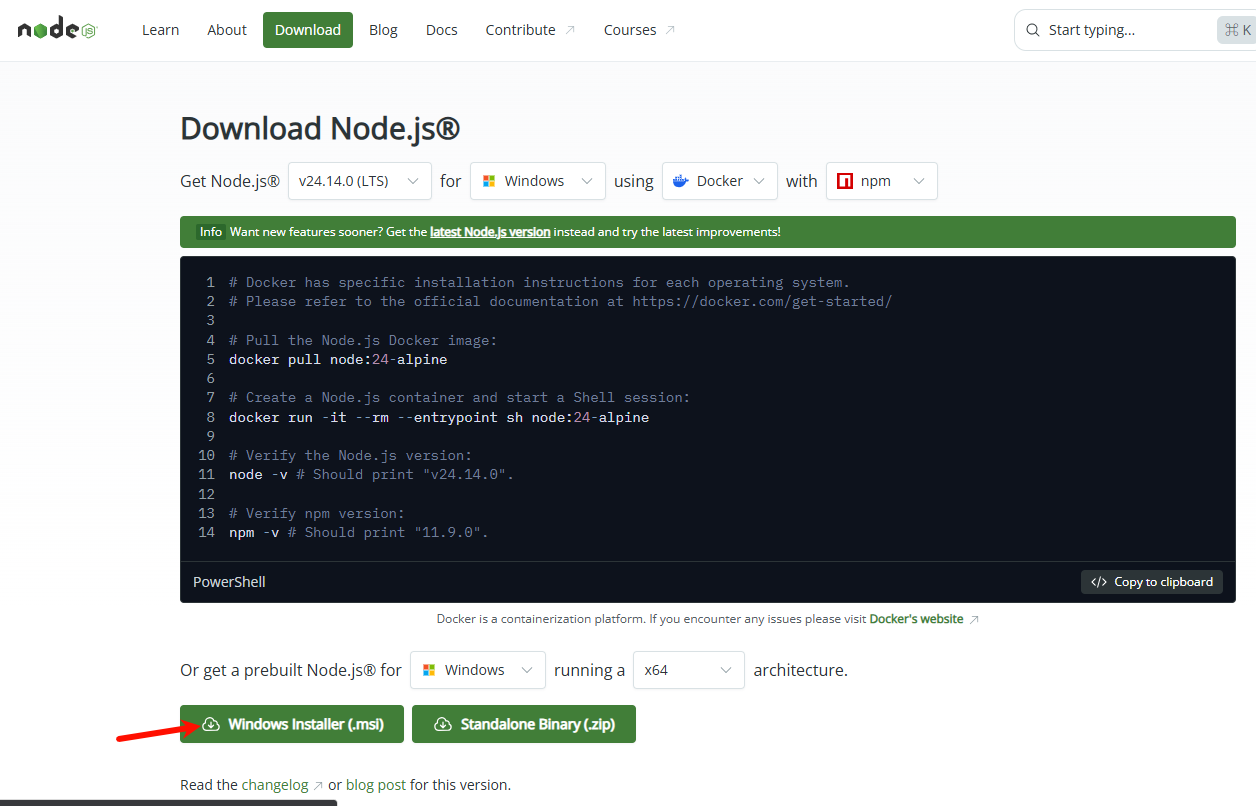

- 安装nodejs(版本大于22.xx.xx,下载后一直下一步即可):

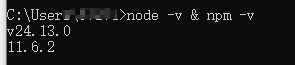

安装完后执行如下命令查看能获取版本就算OK:

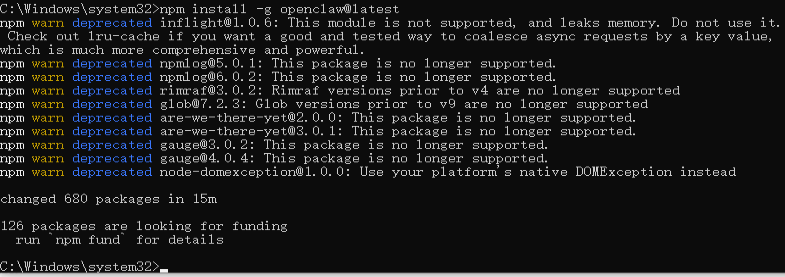

- 命令行执行npm install -g openclaw@latest :

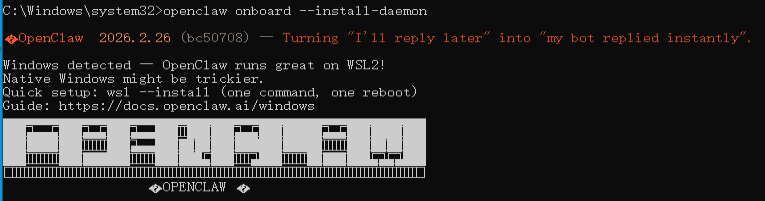

- 执行命令openclaw onboard --install-daemon启动安装指导流程:

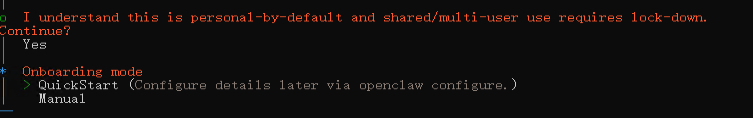

如果正常使用在线大模型就和这里安装openclaw步骤差不多了(先告知风险,再选择安装方式):

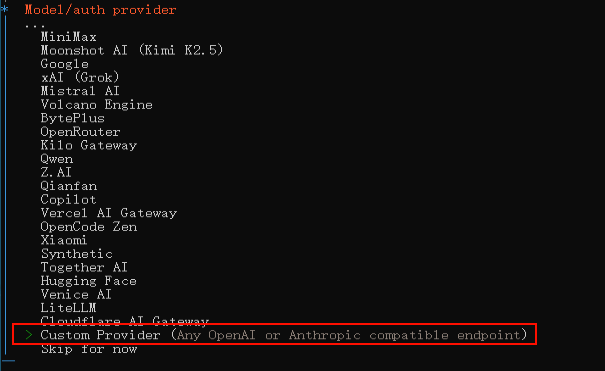

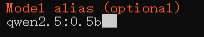

如果选择本地大模型的话从这一步开始有点区别,选择Custom Provider:

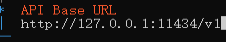

然后回车,下一步默认回车

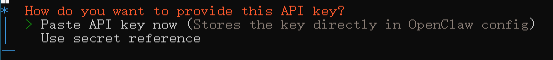

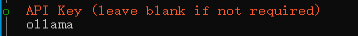

输入key:

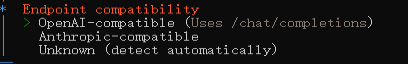

就选择第一个然后回车:

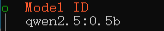

这里写的是模型名字:

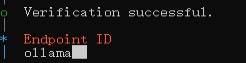

校验通过后写一个端点ID(随意):

这里一般就写模型ID,避免和其他冲突:

回车后就到了这一步,后续就和这里安装openclaw步骤后面一摸一样了: 安装完成后还需要修改一个地方才能正常使用:

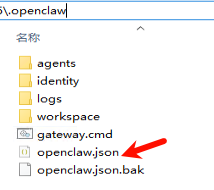

安装完成后还需要修改一个地方才能正常使用:

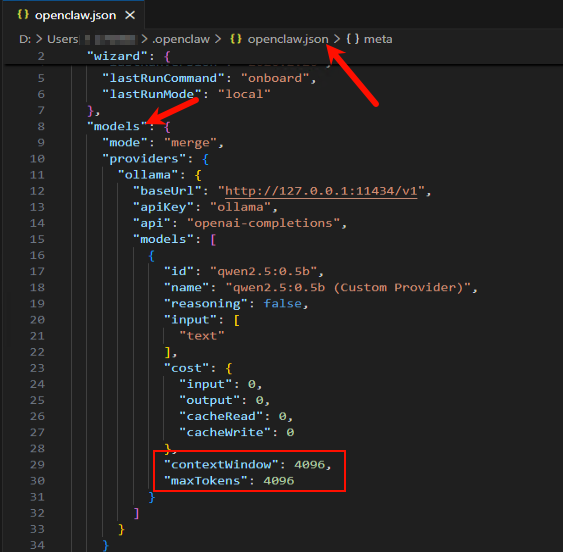

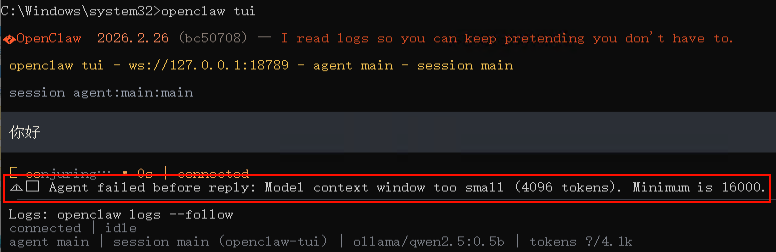

这里的contextwindow默认是4096,执行命令openclaw tui进行对话就会发现有提示:

修改contextwindow超过16000后保存文件,然后执行命令openclaw gateway restart重启网关即可。

部署完成后切换

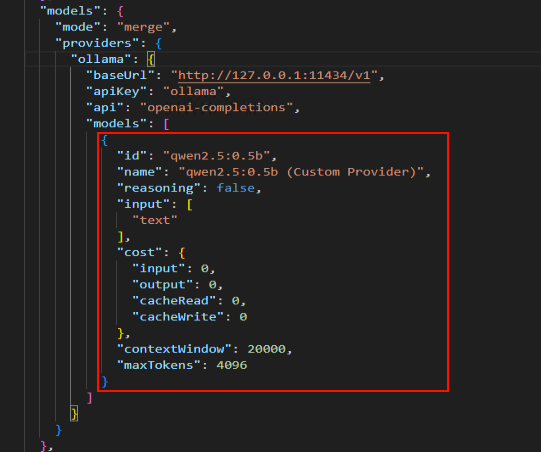

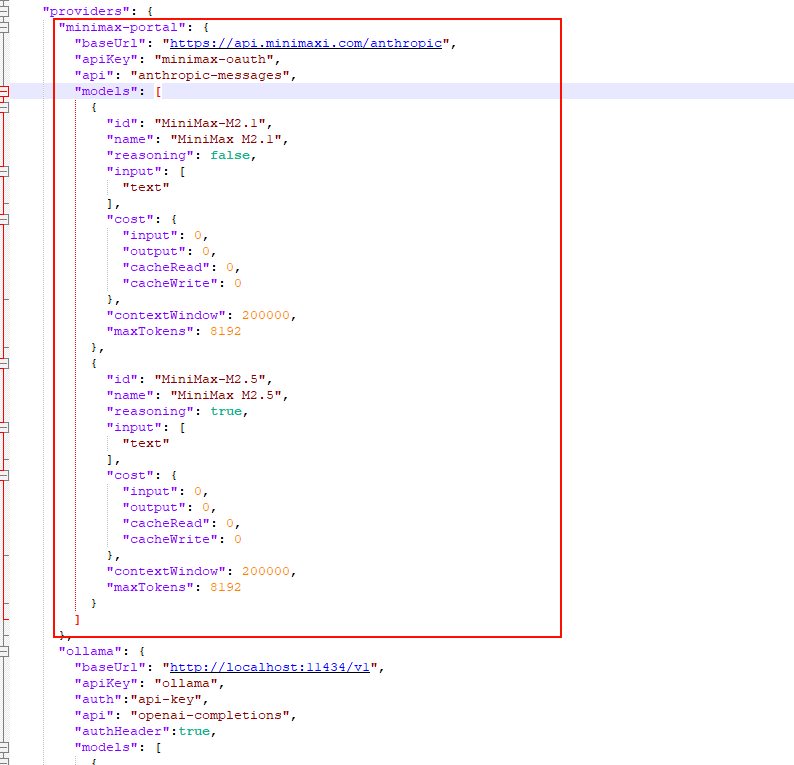

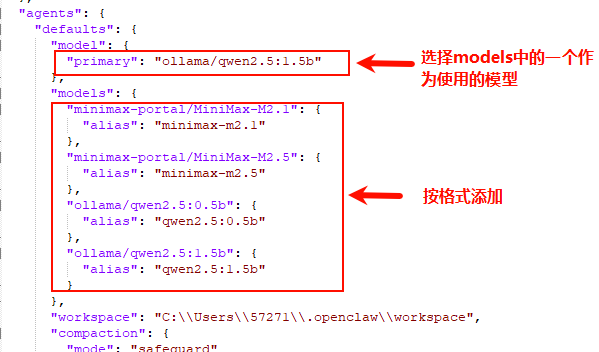

分析openclaw.json文件就会发现,添加或者修改模型只需要按如下2步修改:

- 修改模型参数

models是一个数组,复制一份根据实际情况在后面后修改模型模型描述即可:

如果不是通过ollama来的,参考安装在线大模型那样修改即可(在providers中修改):

- 添加模型到列表并选择默认使用模型:

修改完后需要重启网关openclaw gateway restart

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)