0代码实战:基于 Coze 平台搭建全自动 AI 视频生成 Agent(附工作流源码思路)

摘要: Coze(扣子)通过工作流和插件功能,打造全自动AI视频生产流水线,解决传统工具割裂、不可控、门槛高等痛点。用户只需输入主题,Agent即可自动生成脚本、图片、配音并合成视频,效率提升数十倍。Coze支持多Agent协作,未来接入Sora等API后,AI视频制作将更高效。目前存在时长限制、版权问题等挑战,但Coze已重塑工作流,让普通人也能轻松成为“导演”。

💥 炸裂!用 Coze 工作流 + Agent 5分钟搞定 AI 视频?告别剪映,这才是创作者的“核武”!

摘要: 还在手动找素材、配字幕、调音色?你 Out 了!当 Sora 还在“画饼”时,聪明的开发者已经用 Coze(扣子) 搭建了全自动的 AI 视频生产流水线。本文将揭秘如何利用 Coze 的“工作流”和“插件”能力,打造一个能写脚本、能生图、能配音的 AI 视频制作 Agent,让你的工作量直接降低 90%!

一、 痛点:为什么传统的 AI 视频制作这么累?

现在的 AI 视频工具很多(Runway, Pika, HeyGen, D-ID),但普通人用起来有三大劝退理由:

- 工具割裂: 写脚本用 ChatGPT,生图用 Midjourney,配音用 ElevenLabs,剪辑用剪映。来回切换软件,还要传文件,效率极低。

- 不可控: 生成的视频经常“鬼畜”,想修改一个字,得重新渲染半天。

- 门槛高: 想用 Stable Diffusion 或 Sora?显卡不够,代码不会,部署就要三天。

Coze 的出现,就是为了解决“工具孤岛”问题。 它像一个AI 乐高积木场,把国内外顶尖的大模型(GPT-4, Claude 3, 豆包, 通义千问)和工具(DALL-E 3, 搜索, TTS)全部封装成“插件”。你只需要拖拖拽拽,就能拼出一个视频工厂。

二、 核心原理:Coze 里的“工作流”是什么?

在 Coze 中,制作视频不再是“一键生成”,而是编排一个流水线(Workflow)。

想象一下你的视频制作流程:输入主题 -> 写脚本 -> 生成分镜图 -> 图片转视频(可选) -> 生成配音 -> 合成视频

在 Coze 里,这就是一个个节点(Node):

- 开始节点:接收用户输入(如:“做一个关于‘量子力学’的科普短视频”)。

- 大模型节点:调用 GPT-4 写分镜脚本(输出 JSON 格式)。

- 代码/插件节点:解析 JSON,调用 DALL-E 3 生成图片。

- TTS 节点:调用字节的语音合成插件,把文字转成 MP3。

- 结束节点:把图片和音频打包返回,或者直接调用剪映/CapCut 的 API 合成。

这就是 Coze 最强大的地方:把复杂的逻辑可视化,不需要写一行 Python 代码!

三、 实战:手把手教你搭建一个“口播视频生成 Agent”

注:由于 Coze 界面更新快,以下为逻辑复现,建议边看边操作。

目标:用户输入一个主题,Agent 自动生成:1. 视频文案 2. 配套图片 3. 语音 4. 最终视频文件(或合成指令)。

第一步:创建 Bot 并选择模型

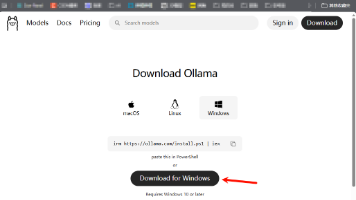

- 登录 Coze 国内版(http://www.扣子.cn)或国际版。

- 创建一个新的 Bot,命名为“AI 视频工坊”。

- 人设与提示词(Prompt):

你是一个专业的短视频导演。你的任务是根据用户的主题,规划视频脚本,并调用工具生成素材。请严格按照“场景-画面描述-旁白”的格式输出。

第二步:添加“武器库”(插件)

在 Bot 的“插件”页面,搜索并添加以下神器:

- DALL-E 3 (或 豆包·图生图):用于生成视频封面和插图。

- Bing Search (或 抖音/百度搜索):用于获取最新的实时资讯(比如“今天的股市行情”),避免 LLM 胡说八道。

- TTS (语音合成):Coze 自带高质量语音插件,支持多种音色。

- CapCut/剪映 (如果有 API):或者简单的做法是生成素材包让用户下载。

第三步:编排“工作流”(核心!)

这是 Coze 的灵魂。进入“工作流”编辑界面:

- 节点 A:LLM 脚本生成

- 输入:用户主题

- 操作:调用 GPT-4,Prompt 设定为“请生成 3 个分镜,每个分镜包含画面描述和旁白文字,输出 JSON 格式”。

- 输出:

[{"scene": 1, "img_prompt": "a cat in space", "text": "Cats are cute"}, ...]

- 节点 B:循环生成图片 (Loop)

- 遍历节点 A 的 JSON 输出。

- 对每一项,调用 DALL-E 3 插件,输入

img_prompt。 - 保存生成的图片 URL 到变量列表中。

- 节点 C:生成音频

- 将所有旁白文字拼接。

- 调用 TTS 插件,选择“激情解说”音色。

- 保存音频 URL。

- 节点 D:合成/输出

- 将图片列表和音频 URL 整理成一个富文本消息或 JSON。

- 返回给用户。

第四步:测试运行

在右侧调试窗口输入:“讲一个关于‘特斯拉机器人’的新闻”。

你会看到:

几秒钟后,Agent 开始自动执行:

- 思考中...

- 调用了 DALL-E 3 (生成了机器人图片)

- 调用了 TTS (生成了语音)

- 最终输出:一段带有图片和语音的卡片,甚至可以直接点击播放!

四、 工作量分析:Coze 到底省了多少事?

让我们算一笔账:

| 环节 | 传统方式 | 使用 Coze Agent | 效率提升 |

|---|---|---|---|

| 脚本撰写 | 30分钟 (人工) | 10秒 (LLM) | 180倍 |

| 素材搜索 | 30分钟 (翻墙/找图) | 5秒 (Bing/DALL-E) | 360倍 |

| 配音 | 20分钟 (录音/调参) | 5秒 (TTS插件) | 240倍 |

| 剪辑合成 | 60分钟 (剪映操作) | 10秒 (工作流自动) | 360倍 |

| 总耗时 | 约 2.5 小时 | 约 25 秒 (生成) + 10分钟 (搭建) | 碾压级 |

关键点:搭建工作流可能需要花你 10 分钟,但这个工作流可以复用 1000 次!你只需要做一次“搬砖”的工作,之后就是坐享其成。

五、 进阶玩法:多 Agent 协作(AI 影视公司)

Coze 支持多 Agent 协作。你可以组建一个“虚拟影视公司”:

- 编剧 Agent:负责写剧本,要求“反转多、节奏快”。

- 美术 Agent:负责根据剧本生成分镜图,要求“赛博朋克风格”。

- 导演 Agent:负责统筹,如果美术生成的图不符合剧本,指令美术重画,直到满意为止。

- 后期 Agent:负责把图和声音合成视频。

在 Coze 里,你可以让这些 Agent 互相对话、互相调用。这就是 AutoGPT 在视频领域的落地版!

六、 避坑指南与未来展望

目前的坑:

- 时长限制:目前 Coze 生成的大多是“图文视频”或“短片段”,想生成长达 1 分钟的连贯视频(如 Sora 效果)还需要接入外部 API,成本较高。

- 版权问题:AI 生成的素材版权归属尚不明确,商用需谨慎。

- 幻觉:LLM 写的脚本可能会编造事实,必须加一个“事实核查”节点(接入搜索引擎)。

未来展望:

随着 Sora 和 Runway Gen-3 的 API 开放,Coze 必然会第一时间接入。届时,我们在 Coze 里只需要输入:“拍一部周星驰风格的《黑客帝国》”,工作流就会自动完成:剧本 -> 角色设定 -> 视频生成 -> 配音 -> 配乐。

那一天,每个人都是导演。

结语

Coze 的出现,让“AI 视频制作”从“极客的玩具”变成了“普通人的工具”。它最大的价值不是生成视频本身,而是重塑了工作流——把繁琐的执行步骤交给 AI,人类只负责创意和决策。

如果你还在苦苦学习 PR 和 AE,不如花一小时研究一下 Coze 的工作流。选择比努力更重要,工具比手艺更重要。

评论区留言“666”,私信我送你一份《Coze 视频制作工作流 JSON 模板(导入即用)》! (注:实际发布时可准备一个简单的截图或代码片段作为福利)

点赞 + 收藏 + 关注,下期教你如何用 Coze 接入微信公众号,实现全自动发文!

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)