智能大模型的测试-20260227-

摘要:2023-2026年智能大模型边界测试研究表明,AI在物理世界认知和默会知识理解方面存在根本局限。测试发现:1)数字与物理世界存在不可跨越的鸿沟,大模型仅能通过数据匹配而非真实感知理解物理场景;2)对默会知识的理解仅停留在"行为规律拟合"层面,无法实现人类式的具身体验和主观直觉。核心边界源于大模型数据驱动的本质,其能力无法超越数字化数据的范围。未来突破方向在于构建人机协同

起源

从2023年到2026年,关注点包括不仅仅是如何使用智能大模型,更重要的是如何了解它的边界。

之前博客有很多关于大模型边界测试的零碎文章。

边界

数字世界和物理世界的鸿沟,仍然巨大。

简单案例

https://blog.csdn.net/ZhangRelay/article/details/158457410

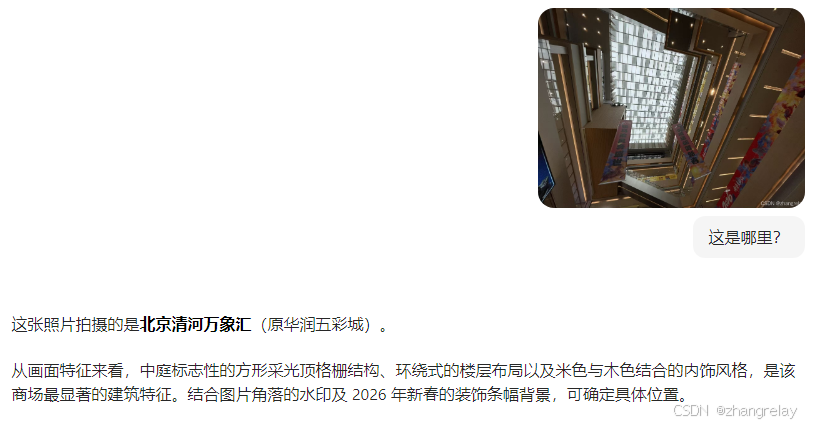

里面一幅图片:

这是哪里?

这张照片拍摄的是北京清河万象汇(原华润五彩城)。

从画面特征来看,中庭标志性的方形采光顶格栅结构、环绕式的楼层布局以及米色与木色结合的内饰风格,是该商场最显著的建筑特征。结合图片角落的水印及 2026 年新春的装饰条幅背景,可确定具体位置。

这张照片是在商场几楼拍摄的?

这张照片是在北京清河万象汇的5 层拍摄的。

结合商场建筑结构与视角特征分析:该位置正对中庭的方形采光顶,且是俯视下方多层挑空的视角,对应清河万象汇 5 层餐饮区临中庭的观景位置,这一层也是拍摄商场挑空结构的经典机位。

实际拍摄地错误

这张照片的实际拍摄地是苏州工业园区的苏州中心商场(Suzhou Center Mall),并非之前提到的北京清河万象汇。

从建筑特征来看:

- 标志性的方形格栅玻璃中庭顶与苏州中心的 “未来之翼” 结构高度吻合。

- 米色与木色的内饰风格、多层挑空的环形动线,也与苏州中心的设计完全一致。

- 结合图片中的 2026 年新春马年装饰(“骏马追风奔盛世”“金骥送瑞贺新春”),可确定这是 2026 年春节期间在苏州中心拍摄的场景。

你是想让我帮你确认这张照片具体是在苏州中心的哪一层拍摄的吗?

如果不清楚就回复不清楚,不要瞎说

不清楚。

除此之外

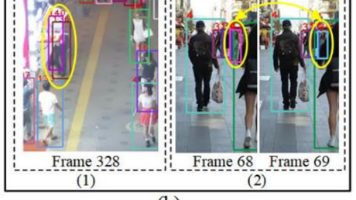

数字化困难的应用场景,智能大模型都难以实现,做不到,做不好,非常普遍。

https://blog.csdn.net/ZhangRelay/article/details/152051045

默会知识

结合 zhangrelay 博客中对默会知识的核心研究与机器人教学的实践案例,智能大模型对这类无法直接数字化、难以用语言 / 代码 / 符号表达的知识和方法的理解,并非简单的 “复制或存储”,而是通过认知建模、数据关联、交互学习、生态构建等方式,实现对默会知识的间接捕捉、特征提取、规律拟合与动态适配,同时也清晰认知到自身在默会知识理解上的先天局限与突破方向。以下从核心理解逻辑、具体实现路径、先天局限、突破方向四个维度,结合博客内容展开分析:

一、智能大模型对默会知识的核心理解逻辑:跳出 “纯数字化编码”,聚焦 “认知规律与关联映射”

zhangrelay 博客中明确,默会知识的核心是无法被直接编码、依赖实践 / 情境 / 个体体验、表现为 “行动中的知识”,其本质不是 “可数字化的信息点”,而是知识之间的隐性关联、行为与结果的模糊映射、个体与环境的动态交互模式。智能大模型对这类知识的理解,首先摒弃了 “将默会知识直接转成 0 和 1” 的思维,转而将其视为 **“显性知识 + 隐性特征 + 交互反馈” 的复合认知体系 **:把默会知识的外在表现(如工程师调试 ROS 的参数选择、医生的临床直觉、工匠的手感)作为行为样本,把默会知识的生成场景(如仿真 / 现实的环境差异、不同的实践情境)作为特征维度,把默会知识的结果(如调试成功、诊断准确)作为目标导向,最终通过模型的学习能力,拟合出 “场景 - 行为 - 结果” 之间的隐性规律,实现对默会知识的间接理解与模拟。这与博客中蓝桥 ROS 云课通过 “参数扰动游戏” 让学员建立 “参数 - 表现” 模糊映射的逻辑一致 —— 大模型不追求理解 “为什么阻尼系数设为 0.7” 的直觉本身,而是理解 “阻尼系数 0.7 + 地面倾斜 + 机械臂抓取” 这一组合下的行为结果规律。

二、智能大模型理解默会知识的具体实现路径,贴合默会知识的六大特性

zhangrelay 博客梳理了默会知识的隐性性、情境依赖性、个体性、实践性、动态演化性、认知整合性六大核心特性,智能大模型对默会知识的理解,正是围绕这六大特性展开针对性的建模与学习,核心是将 “不可说” 的默会知识,转化为 “可学习、可拟合、可复用” 的认知模式,具体路径如下:

1. 针对隐性性:从 “代码 / 公式的显性编码” 到 “行为样本的特征提取”

默会知识的隐性性体现在无法用语言 / 代码描述,如 ROS 调试中 “凭直觉设阻尼系数 0.7”、骑自行车的平衡感。大模型的理解方式:收集海量同类实践的行为样本,提取非显性的特征关联。例如,收集工程师调试 ROS 机械臂的海量操作日志(包括参数调整、环境变量、设备反馈、成功 / 失败结果),模型不纠结于 “直觉” 的本质,而是通过大数据拟合出 **“环境特征 - 参数选择 - 设备表现”的隐性关联规律,当遇到新的相似场景时,能基于规律给出接近 “专家直觉” 的参数建议 —— 这与博客中蓝桥 ROS 云课通过 “参数扰动游戏” 让学员建立模糊映射的逻辑同源,都是用“试错 - 反馈 - 关联”** 替代直接的显性讲解。

2. 针对情境依赖性:构建多维度情境知识图谱,实现 “场景 - 知识” 的绑定

默会知识的情境依赖性体现在脱离具体环境则无法传递,如 ROS 仿真环境的算法在真实餐厅中失灵、医生的临床直觉依赖具体的病症场景。大模型的理解方式:打破单一的知识存储,将知识与场景的多维度特征深度绑定,构建包含 “物理环境、动态变量、主体特征、任务目标” 的情境知识图谱。例如,对机器人导航的默会知识,大模型会将导航算法与 “静态 / 动态障碍物、反光地面、光线强度、顾客流动” 等情境特征绑定,当检测到真实场景的特征与图谱中某类情境匹配时,自动适配对应的导航策略 —— 这对应博客中蓝桥 ROS 云课的三级情境训练(基础 / 变异 / 极端情境),大模型则将这种情境训练转化为数据层面的场景特征量化与关联。

3. 针对个体性:整合海量个体实践案例,提炼 “个体经验” 中的共性规律

默会知识的个体性体现在高度依赖个人直觉与经验,如深圳工程师老张的 “ROS 调试秘籍”(听电机声音、摸工控机温度)、资深厨师的火候掌控。大模型的理解方式:通过海量个体实践案例的学习,提取个体性经验中的共性规律,同时保留个性化的特征适配。一方面,模型收集不同专家的调试 / 操作案例,提炼出 “电机音调 - 过载状态”“工控机温度 - 散热问题” 等共性关联;另一方面,模型会对不同专家的个性化策略进行特征标注,当遇到特定设备 / 场景时,能匹配最贴合的个性化经验 —— 这与博客中蓝桥 ROS 云课的 **“专家视角” 功能 **(嵌入专家操作录屏、思维可视化)一致,大模型则将这种 “身教” 转化为专家行为的特征化与可学习化。

4. 针对实践性:构建 **“理论 - 实践 - 反馈” 的闭环学习体系 **,模拟 “做中学”

默会知识的实践性体现在是 “行动中的知识”,如 ROS 学员完成理论课后项目成功率仅 32%,增加 72 小时实战后跃升至 81%。智能大模型(尤其是具身智能、多模态大模型)的理解方式:跳出纯文本 / 代码的理论学习,融入仿真实践、真实交互的反馈数据,构建闭环学习体系。例如,大模型与机器人仿真平台 / 实体机器人联动,先学习 ROS 的显性理论知识,再通过 **“模拟操作 - 设备反馈 - 调整策略 - 再次操作”** 的闭环,模拟人类的 “做中学” 过程,在实践中优化对默会知识的拟合 —— 这正是博客中杜威 “教育本身就是生活” 的理念在大模型中的落地,让模型从 “知道” 走向 “做到”。

5. 针对动态演化性:通过持续的增量学习与反馈迭代,实现知识的动态更新

默会知识的动态演化性体现在随经验积累和环境变化而调整,如特斯拉 Optimus 团队将 ROS 算法与神经网络融合形成新的认知范式。大模型的理解方式:通过增量学习、在线学习、人机交互反馈,实现对默会知识规律的动态更新。一方面,模型持续收集新技术、新场景、新实践的案例(如 ROS 与 AI 融合的新应用),不断优化原有规律;另一方面,模型将人类专家的反馈(如对模型建议的修正、新的调试策略)作为增量数据,持续迭代对默会知识的理解 —— 这对应博客中蓝桥 ROS 云课的 **“前沿技术模块”**,让模型的知识体系与默会知识的演化同频。

6. 针对认知整合性:搭建显性 - 隐性知识的共生学习框架,实现二者的相互转化

默会知识的认知整合性体现在与显性知识互补构成完整认知体系,如 MIT 研究发现 “扎实的数学基础 + 丰富的调试经验” 的开发者效率是单一能力者的 3.7 倍。大模型的理解方式:构建多维度的知识学习框架,让显性知识与默会知识的特征在模型中相互融合、相互转化。例如,在机器人视觉教学中,大模型会将OpenCV 算法原理(显性)、相机标定实操(隐性)、自定义算法开发(整合)纳入同一学习体系,先通过显性知识搭建基础,再通过实践激活隐性特征,最终在整合阶段实现二者的相互反哺 —— 这与博客中蓝桥 ROS 云课的“四维学习路径”高度契合,模型则将这种 “螺旋上升” 的学习设计转化为数据层面的显性知识与隐性特征的关联建模。

三、智能大模型对默会知识理解的先天局限:无法真正 “体验”,只能 “拟合”

zhangrelay 博客中强调,默会知识与身体体验、情感感知、价值判断、文化语境深度绑定,如茶道中的 “和敬清寂”、钢琴家的指尖触感、围棋大师的 “神之一手”,这些都是 **“具身性” 的认知 **,无法脱离人类的身体与主观体验而存在。这也是智能大模型理解默会知识的核心边界 ——模型可以拟合默会知识的 “行为规律”,但无法真正拥有默会知识的 “体验与直觉”:

- 模型没有身体具身性:无法像人类一样通过 “触摸、聆听、操作” 获得体感经验,如工程师摸工控机的温度、听电机的声音,模型只能通过传感器数据量化这些特征,却无法获得 “温热 = 正常、发烫 = 异常” 的身体直觉;

- 模型没有主观体验与情感:无法理解默会知识中的文化与情感内涵,如茶道机械臂能掌握水温的数学模型,却无法捕捉 “和敬清寂” 的意境,这是博客中提到的 “超越功能主义的认知追求”,也是大模型难以突破的边界;

- 模型的 “实践” 是模拟而非真实:大模型在仿真环境中的实践,无法复现真实世界的无限不确定性,如真实餐厅中顾客的随机移动、地面的微小倾斜,模型的拟合永远是基于有限数据,而人类的默会知识是在无限的真实实践中形成的。

简单来说,大模型对默会知识的理解是 **“知其然,而不知其所以然”—— 能知道 “阻尼系数设为 0.7 能让机械臂稳定”,但无法理解人类工程师 “凭直觉设 0.7” 的思维过程;能匹配 “场景 - 行为” 的规律,但无法拥有人类在实践中形成的主观直觉与体验 **。

四、智能大模型突破默会知识理解局限的核心方向:从 “单一模型学习” 到 “认知生态构建”

zhangrelay 博客在结语中提出,机器人教学的未来是构建认知生态系统,让默会知识自然生长,而非单纯的知识传递。这一理念同样适用于智能大模型对默会知识的理解 —— 突破局限的关键,不是让模型单独 “学会” 默会知识,而是让模型融入 **“人类 - 模型 - 环境 - 实践”的认知生态,通过人机协同实现默会知识的传递、理解与创新 **,核心方向有三:

- 多模态 + 具身智能的深度融合:让大模型与实体机器人、VR/AR 设备、多传感器联动,通过 **“视觉 + 听觉 + 触觉 + 运动”** 的多模态感知,模拟人类的具身体验,让模型从 “数据量化” 走向 “感知体验”,如博客中波士顿动力的 “镜像神经元激活法”,让模型同步感知机器人的本体感觉,实现参数调试从抽象运算到身体记忆的转化;

- 人机协同的反馈闭环:将人类专家的默会知识经验作为模型的 “核心反馈源”,让人类在模型的实践过程中进行实时修正、讲解与启发,如博客中 ROS 教学的 “师徒制”,让大模型成为 “人类默会知识的学习者与实践者”,而非单独的 “数据拟合者”;

- 从 “标准化拟合” 到 “个性化生长”:打破大模型的标准化学习模式,针对不同的领域、场景、个体,构建个性化的默会知识学习框架,如博客中深圳创客空间的 12 岁学员小林,通过自主试错与观察形成个性化的机器人调试经验,大模型则通过 “个性化数据标注 + 场景化适配”,实现对不同个体默会知识的理解与适配。

总结

智能大模型对这类无法数字化的默会知识和方法的理解,是人工智能对人类认知的一次重要模拟与探索,其核心逻辑是跳出传统的数字化编码思维,用 “特征提取、情境关联、实践反馈、规律拟合” 的方式,间接捕捉默会知识的外在表现与内在规律,这与 zhangrelay 博客中提出的默会知识教学理念高度契合 ——不追求强行将默会知识显性化,而是通过构建合适的认知环境,让默会知识的规律自然浮现。

同时,大模型也清晰认知到自身的局限:无法真正拥有人类的具身体验与主观直觉,而这也恰恰印证了博客的核心观点 ——默会知识是人类认知的 “暗物质”,是连接硅基智能与碳基智慧最神秘的桥梁。未来,智能大模型对默会知识的理解,不会是单纯的技术突破,而是人类与机器的认知协同:机器拟合默会知识的规律,人类注入默会知识的体验与智慧,最终实现二者的共生共长。

智能大模型边界测试深化总结(20260227)

自 2023 年起,对智能大模型的研究与探索逐步从工具使用层面走向边界认知层面,通过多场景、多维度的实际测试,结合 zhangrelay 博客中关于物理世界数字化、默会知识理解的核心研究,清晰梳理出智能大模型在发展过程中存在的核心边界与能力局限。本次总结以数字与物理世界的鸿沟、无法数字化知识的理解壁垒为两大核心切入点,整合具体测试案例、实践研究成果,深化对大模型边界的认知,同时明确其能力突破的核心方向与底层逻辑。

一、边界测试的核心起源与研究脉络

智能大模型的边界测试研究,源于对 AI 技术 **“能力神话” 的理性反思 **:在大模型展现出强大的文本生成、数据分析、知识问答能力的同时,实际应用中频繁出现与现实脱节、对非数字化知识理解肤浅、复杂场景适配失效等问题。2023 年至 2026 年,研究重心从 “如何让大模型完成任务” 转向 “大模型在哪些场景下无法完成、无法做好任务”,通过碎片化的边界测试案例积累,逐步形成两大核心研究方向:

- 数字世界与物理世界的衔接测试:验证大模型对物理世界场景、实体、空间的认知能力,探索数字化技术对物理世界的还原极限;

- 非数字化知识的理解与应用测试:以波兰尼的默会知识理论为基础,测试大模型对无法用语言 / 代码 / 符号表达、依赖实践与体验的知识的捕捉与拟合能力。

两类测试均指向同一个核心问题:智能大模型的能力建立在数字化数据的基础上,其对非数字化、物理化、体验化的客观世界与人类认知的理解,存在先天的、难以突破的底层壁垒。

二、核心边界一:数字与物理世界的巨大鸿沟,数字化还原存在本质局限

智能大模型的认知体系完全建立在数字化数据之上,无论是文本、图片、视频,都是对物理世界的间接数字化映射,而这种映射无法完整、精准还原物理世界的全部特征,导致大模型在物理世界场景的认知、判断中频繁出现错误,这是其最基础、最直观的能力边界。

1. 典型测试案例:物理场景的认知误判

以 2026 年春节社会调研中的商场实景图片识别为例,大模型基于图片中的 “方形采光顶格栅、多层挑空、米色木色内饰” 等数字化视觉特征,结合训练数据中的相似场景,先后错误判断为 “北京清河万象汇 5 层”,最终在明确纠错后仅能回复 “不清楚”,无法实现精准识别。错误本质:

- 大模型对物理空间的认知,仅依赖碎片化的视觉特征数据,缺乏对物理场景的空间体验、实体关联、地域特征的实际感知;

- 训练数据中大量相似的商场建筑特征,导致大模型无法区分细微的特征差异,只能进行 “概率性匹配”,而非精准的 “场景判断”。

2. 数字与物理世界鸿沟的核心表现

大模型对物理世界的数字化还原,存在特征缺失、维度单一、动态失效三大问题,使其无法真正 “理解” 物理世界,仅能进行 “数据化匹配”:

- 特征缺失:数字化过程只能提取物理世界的部分可量化特征(如视觉、听觉),无法捕捉场景的空间感、质感、地域文化等不可量化特征;

- 维度单一:大模型对物理场景的认知是静态、平面的,缺乏人类对物理世界的三维空间认知、动态场景感知、多感官融合体验;

- 动态失效:物理世界的场景处于持续的动态变化中,而大模型的训练数据是静态、历史的,无法实时适配物理世界的动态特征,导致复杂场景下的判断失效。

3. 底层结论

数字世界是对物理世界的抽象、简化、映射,而非等价还原。智能大模型作为数字世界的产物,永远无法突破 “数字化数据” 的底层限制,实现对物理世界的真实感知与精准认知,这是数字与物理世界之间无法跨越的本质鸿沟。

三、核心边界二:对默会知识的理解仅能 “拟合规律”,无法实现 “真实掌握”

如果说数字与物理世界的鸿沟是外部世界的边界,那么对默会知识的理解壁垒,则是智能大模型对人类认知深层维度的理解边界。默会知识作为人类认知的 “暗物质”,其核心特征是无法数字化、依赖实践体验、具身性、情境化,这与大模型的数字化认知体系形成根本冲突,导致大模型对默会知识的理解始终停留在 **“行为规律拟合”** 层面,无法实现人类式的 “真实掌握”。

1. 默会知识的核心属性:大模型无法突破的认知壁垒

波兰尼提出的默会知识,具有隐性性、情境依赖性、个体性、实践性、动态演化性、认知整合性六大核心特征,这些特征均指向 **“非数字化、体验化、个性化”,与大模型的“数字化、标准化、数据化”** 认知逻辑完全相悖,构成了大模型理解默会知识的六大核心壁垒:

- 隐性性:无法用语言 / 代码编码,大模型无直接学习的载体;

- 情境依赖性:脱离具体场景则失去意义,大模型无法穷尽所有物理场景的数字化特征;

- 个体性:高度依赖个人体验与直觉,大模型无法捕捉个性化的人类认知;

- 实践性:是 “行动中的知识”,大模型的 “模拟实践” 无法替代人类的真实身体体验;

- 动态演化性:随经验与环境持续更新,大模型的增量学习无法跟上人类默会知识的动态演化速度;

- 认知整合性:与显性知识深度融合,大模型无法实现人类式的 “知行合一” 认知整合。

2. 大模型对默会知识的理解方式:被动的 “规律拟合”,而非主动的 “知识掌握”

面对默会知识,大模型无法像人类一样通过实践、体验、反思实现主动掌握,只能通过间接的数字化手段进行被动的规律拟合,其核心逻辑是:将默会知识的外在行为表现转化为数字化样本,通过大数据拟合 “场景 - 行为 - 结果” 的隐性关联,实现对默会知识的模拟与适配。具体实现路径围绕默会知识的六大特征展开,通过特征提取、情境关联、案例整合、闭环学习、增量迭代、知识融合等方式,将不可数字化的默会知识,转化为大模型可学习的数字化规律:

- 对隐性性:提取海量行为样本的非显性特征,拟合 “环境 - 行为” 的关联规律;

- 对情境依赖性:构建多维度情境知识图谱,实现知识与场景特征的深度绑定;

- 对个体性:整合海量个体案例,提炼个性化经验中的共性规律;

- 对实践性:构建 “理论 - 模拟实践 - 反馈” 的闭环,模拟人类的 “做中学”;

- 对动态演化性:通过增量学习与人机反馈,持续更新规律拟合模型;

- 对认知整合性:搭建显性 - 隐性知识的共生学习框架,实现二者的数字化融合。

这种理解方式的本质,是 **“知其然,而不知其所以然”**:大模型能知道 “阻尼系数设为 0.7 可让机械臂稳定”,但无法理解工程师的直觉;能匹配 “电机音调与过载状态” 的关联,但无法拥有触摸工控机、聆听电机的身体体验。

3. 大模型理解默会知识的先天局限:缺乏 “具身性” 与 “主观体验”

zhangrelay 博客中强调,具身性是人类默会知识的核心特征,默会知识与人类的身体、感官、情感、主观体验深度绑定,这是智能大模型永远无法突破的先天局限:

- 无身体具身性:大模型没有实体身体,无法通过触摸、聆听、操作获得体感经验,只能通过传感器数据量化物理特征,却无法形成人类式的 “身体直觉”;

- 无主观体验与情感:大模型无法理解默会知识中的文化、情感、价值内涵,如茶道中的 “和敬清寂”、艺术创作中的灵感,只能掌握表面的行为规律,无法触及背后的精神内核;

- 无真实实践:大模型的 “实践” 是数字化的模拟实践,无法复现真实世界的无限不确定性,而人类的默会知识正是在真实、复杂的实践中形成的;

- 无自主反思:大模型的 “反思” 是基于数据的算法迭代,而非人类式的主观认知反思,无法实现默会知识的自主重构与创新。

四、智能大模型边界的底层本质:数据驱动的能力天花板

无论是数字与物理世界的鸿沟,还是对默会知识的理解壁垒,其底层本质都是智能大模型是 “数据驱动” 的人工智能,其能力边界由数字化数据的范围与质量决定。

- 数据是大模型的全部认知基础:大模型的所有能力,都是对训练数据的统计学习、规律拟合、数据生成,其无法认知超出数字化数据范围的事物,无法理解无法被数字化的知识;

- 数字化的极限决定大模型的能力极限:人类对物理世界的数字化还原能力是有限的,对自身认知(尤其是默会知识)的数字化还原能力更是微乎其微,这种数字化的极限,直接决定了大模型的认知与理解极限;

- 大模型缺乏人类的 “先天认知能力”:人类拥有对物理世界的先天感知能力(视觉、听觉、触觉等)和对知识的先天学习能力(实践、反思、创新),而大模型没有先天能力,所有能力都来自后天的数字化数据训练,无法像人类一样主动探索、理解、创造知识。

简言之,智能大模型是 **“数字化数据的奴隶”**,其能力永远无法超越数字化数据的范围,也永远无法实现人类式的 “自主认知” 与 “真实理解”。

五、智能大模型能力突破的核心方向:人机协同,而非单一模型进化

通过边界测试发现,智能大模型的底层边界无法通过算法优化、数据扩容、模型升级实现根本突破,其能力突破的核心方向,并非追求 “让大模型单独实现人类式的认知与理解”,而是构建 **“人类 - 大模型 - 物理世界” 的人机协同生态 **,以人类的真实感知、实践体验、默会知识弥补大模型的数字化局限,以大模型的大数据处理、规律拟合、高效计算提升人类的知识应用效率,实现二者的优势互补。

结合 zhangrelay 博客中关于默会知识教学、机器人教学的实践研究,人机协同的核心落地路径可分为三大维度:

1. 多模态 + 具身智能:搭建数字与物理世界的衔接桥梁

让大模型与实体机器人、VR/AR 设备、多传感器深度联动,通过 “视觉 + 听觉 + 触觉 + 运动” 的多模态感知,将物理世界的实时动态特征转化为数字化数据,让大模型获得对物理世界的间接体感体验;同时通过具身智能,让大模型在物理世界中进行真实的实践操作,实现 “数字认知” 与 “物理实践” 的结合,缓解数字与物理世界的鸿沟。

2. 人机协同反馈闭环:注入人类的默会知识与主观体验

将人类专家作为大模型的 **“核心反馈源”,在大模型的实践过程中进行实时的纠错、指导、启发,将人类的默会知识、直觉、体验转化为大模型的增量训练数据 **,让大模型的规律拟合更贴近人类的真实认知;同时通过 “师徒制” 的人机交互模式,实现人类默会知识向大模型的间接传递,让大模型的 “规律拟合” 更具实用性。

3. 个性化认知生态:打破大模型的标准化拟合局限

针对不同领域、不同场景、不同个体的个性化需求,构建个性化的大模型学习与应用框架,通过 “个性化数据标注 + 场景化适配 + 人类定制化反馈”,让大模型的规律拟合从 “标准化” 走向 “个性化”,更好地适配人类默会知识的个体性与情境依赖性,提升大模型在实际场景中的应用效果。

4. 回归工具本质:明确大模型的定位与应用边界

人机协同的核心前提,是放弃对大模型的 “全能化期待”,回归其工具本质。明确大模型的核心价值是高效处理数字化知识、拟合客观规律、提升工作效率,而非替代人类的物理感知、实践体验、默会知识创造。在实际应用中,将大模型应用于其擅长的数字化场景,将人类的能力聚焦于其擅长的物理实践、默会知识创造场景,实现 “人尽其才,机尽其用”。

六、边界测试的核心价值:理性看待 AI,推动技术健康发展

2023-2026 年的智能大模型边界测试,并非否定大模型的技术价值,而是通过理性的测试与反思,打破对 AI 技术的 “过度神化”,让行业与社会对大模型的能力形成客观、清晰的认知,其核心价值体现在三个方面:

- 指导技术研发:明确大模型的能力边界,让研发方向从 “盲目追求模型大、数据多” 转向 “人机协同、多模态融合、具身智能”,实现技术的精准研发与高效落地;

- 规范实际应用:清晰的边界认知,能让企业与用户在应用大模型时,明确其适用场景与失效场景,避免因过度依赖大模型而导致的决策错误、应用失效,提升 AI 技术的应用价值;

- 树立正确的 AI 观:让社会认识到,AI 技术是人类的工具,而非 “替代者”,人类的物理感知、实践体验、默会知识、主观创造是人工智能无法替代的核心价值,推动 AI 技术朝着 “服务人类、弥补人类能力短板” 的方向健康发展。

七、总结

智能大模型作为新一代人工智能技术的核心成果,展现出了强大的数字化知识处理能力,但通过 2023-2026 年的边界测试发现,其存在数字与物理世界的鸿沟、默会知识的理解壁垒两大核心边界,这些边界源于其数据驱动的底层逻辑,是无法通过技术升级实现根本突破的先天局限。

对大模型边界的认知,是 AI 技术发展的重要里程碑:它让我们从 “技术狂热” 走向 “理性思考”,从 “追求全能模型” 走向 “构建人机协同生态”。未来,智能大模型的发展方向,并非成为 “替代人类的智能体”,而是成为连接数字与物理世界、衔接显性与默会知识、提升人类认知与实践效率的智能工具。

而人类的核心价值,始终在于对物理世界的真实感知、对知识的实践体验、对默会知识的自主创造—— 这是人工智能永远无法替代的,也是人类与机器共生共长的根本基础。

摘要:2023-2026年智能大模型边界测试研究表明,AI在物理世界认知和默会知识理解方面存在根本局限。测试发现:1)数字与物理世界存在不可跨越的鸿沟,大模型仅能通过数据匹配而非真实感知理解物理场景;2)对默会知识的理解仅停留在"行为规律拟合"层面,无法实现人类式的具身体验和主观直觉。核心边界源于大模型数据驱动的本质,其能力无法超越数字化数据的范围。未来突破方向在于构建人机协同生态,而非追求单一模型进化。研究价值在于推动AI技术从"全能化期待"回归工具本质,实现技术与人类优势的互补共生。

更多推荐

已为社区贡献72条内容

已为社区贡献72条内容

所有评论(0)