企业本地知识库的搭建和使用「LangChain」,大模型入门到精通,收藏这篇就足够了!

前面我们讲到《企业本地知识库的搭建选型方案》,本节我们介绍其中:LangChain。LangChain 是一个开源框架,集成了灵活丰富的工具集和功能,可帮助开发者使用语言模型创建复杂的应用程序。它简化了诸如构建聊天机器人、总结大量文本或开发结合推理和当前信息检索的 AI 工具等任务。其丰富的可重用组件极大地简化和加速了复杂的 AI 工作流开发。模块化设计:用于提示、数据检索和模型交互的模块化和可互

一、 介绍

前面我们讲到《企业本地知识库的搭建选型方案》,本节我们介绍其中:LangChain。LangChain 是一个开源框架,集成了灵活丰富的工具集和功能,可帮助开发者使用语言模型创建复杂的应用程序。它简化了诸如构建聊天机器人、总结大量文本或开发结合推理和当前信息检索的 AI 工具等任务。其丰富的可重用组件极大地简化和加速了复杂的 AI 工作流开发。

LangChain优势和特点:

模块化设计:用于提示、数据检索和模型交互的模块化和可互换组件使设计、配置和扩展 RAG 应用程序变得容易。

灵活性:支持关键字、向量和自定义搜索,使开发人员能够根据需要使用各种检索方法。

集成方便:允许模型使用计算器或搜索引擎等工具来执行额外任务,并且可以很好地与云平台配合使用。

社区和生态:定期更新和社区贡献的插件扩展了其功能并提高了稳定性。以及提供大量的文档、社区教程和资源。

LangChain有什么用:

LangChain提供了RAG应用程序的所有构建模块 - 从简单到复杂。并负责以下关键步骤: 文档加载 → 文本分块 → 向量化 → 存储 → 检索 → 生成回答。LangChain每个步骤完成的工作大致描述如下:文档加载提供DocumentLoader(加载 PDF/网页/数据库等数据)、文本分块其内置TextSplitter(智能分块避免语义割裂)、向量化其封装有Embedding模型(如 OpenAI、Hugging Face)、存储其集成向量数据库(如 FAISS、Pinecone)、检索其提供了预置RetrievalQA链(自动拼接检索结果和生成步骤)。其好处是LangChain大大降低了RAG开发门槛,开发者无需手动处理分块策略、相似度匹配算法等复杂细节,通过框架API快速搭建流程,构建各种AI应用场景。

帮助手册:https://python.langchain.com.cn/docs/

二、 开发实战

以下代码运行环境:

python = 3.12.9

langchain==0.3.20

langchain-ollama==0.3.2

1、文档加载:

常见加载器包括:TextLoader(文本文档)、CSVLoader(CSV文档)、DirectoryLoader(目录中的所有文档)、FileDirectory(文件目录)、UnstructuredHTMLLoader(HTML超文本标记语言 )、JSONLoader(JSON文档 )、UnstructuredMarkdownLoader(Markdown文档)、AzureAIDocumentIntelligenceLoader(DOCX、XLSX、PPTX )、PyPDFLoader(PDF文档)。

2、文本分块:

把长文档分割成适合模型上下文窗口的小块,以便在检索过程中提取相关内容。文本分割器的工作原理大概如下:将文本分成小的、具有语义意义的块(通常是句子);开始将这些小块组合成一个更大的块,直到达到一定的大小(通过某些函数测量);一旦达到该大小,将该块设为自己的文本片段,然后开始创建具有一些重叠的新文本块(以保持块之间的上下文)。常见的文本分割策略有:CharacterTextSplitter(按字符分割)、MarkdownHeaderTextSplitter(标题文本分割器)、RecursiveCharacterTextSplitter(按字符递归分割)、Split by character(按字符分割)等等,这里采取哪种分割方式需要看使用的场景合适选择。

3、向量化:

文本块形成后,通过LLM进行嵌入(Embeddings)将文本转换为数值表示,让计算机能更轻松处理和比较文本。为了实现跨文本块的语义搜索,我们需要为每个块生成向量嵌入,然后将它们连同嵌入一起存储。生成向量嵌入时LangChain提供标准接口,方便在不同模型之间切换。

4、存储:

向量数据库(Vector Store)是常见的存储向量的方式,LangChain支持多种向量数据库,包括开源和商业产品,如Elasticsearch、Faiss、Chroma和Qdrant等。向量数据库各有特点,适用于不同的应用场景。选择合适的数据库可以提高向量检索的效率和效果。下面列举一下目前市面上常用的向量数据库的类型及其特点:

5、检索:

填充向量数据库后,可以将其定义为检索器组件,该组件根据用户查询和嵌入块之间的语义相似性,在本地向量库中进行相似性搜索,找到最相关的内容。

6、生成:

最后,我们可以将这个增强后的提示输入到LLM模型中,生成最终的回答。

7、最终示例代码:

from langchain_community.document_loaders import PyPDFLoader

from langchain.text_splitter import CharacterTextSplitter

from langchain.chains import RetrievalQA

from langchain_chroma import Chroma

from langchain_ollama import OllamaEmbeddings

from langchain_core.documents import Document

from langchain_ollama import OllamaLLM

import os

from langchain.indexes import VectorstoreIndexCreator

from langchain.prompts import ChatPromptTemplate

from langchain.schema.runnable import RunnablePassthrough

'''1. 文档加载(示例:本地知识库)'''

loader = PyPDFLoader("./2024-成都研发总监-梁先生-xx猎头.pdf")

documents = loader.load()

print('=================len(documents):', len(documents))

'''2. 文本分块(将长文档切分为语义片段)'''

text_splitter = CharacterTextSplitter(chunk_size=30000, chunk_overlap=0)

full_text = "\n".join([doc.page_content for doc in documents]) # 合并所有页面内容

chunks = text_splitter.split_text(full_text)

print('=================len(chunks):', len(chunks))

'''3. 向量化存储(把文本转换为数学向量)'''

# embeddings = OpenAIEmbeddings() # 使用远程OpenAI的嵌入模型

# vector_db = FAISS.from_documents(chunks, embeddings) # 存储到FAISS向量库

embeddings = OllamaEmbeddings(model="bge-m3:latest") # 使用本地ollama的嵌入模型bge-m3:latest

chunk_docs = [Document(page_content=chunk, metadata={"source": "2024-成都研发总监-梁先生-xx猎头.pdf"}) for chunk in chunks]

vectorstore = Chroma.from_documents(chunk_docs, embeddings)

retriever = vectorstore.as_retriever()

# 相似性搜索获得文档结果(场景一)

question = "芯片系统工程师"

docs = vectorstore.similarity_search_with_score(question, k=3) # 适用于需要精确匹配或特定查询条件的场景,实现简单,不需要复杂的向量化过程

for doc, score in docs:

print("内容1:", doc.page_content)

print("元数据1:", doc.metadata['source']) # 元数据

print("相关度分数1:", score)

# 相似性搜索获得文档结果(场景二)

embedding_vector = embeddings.embed_query(question)

docs = vectorstore.similarity_search_by_vector(embedding_vector, k=3) # 适用于非结构化数据,能够提供更灵活和高效的搜索方式,特别适合处理大规模数据集。

for doc in docs:

print("内容2:", doc.page_content)

print("元数据2:", doc.metadata['source'])

'''4. 构建RAG问答链'''

llm = OllamaLLM(model="deepseek-r1:8b")

message = """

请根据提供的上下文回答问题。

问题:

{question}

上下文:

{context}

"""

prompt = ChatPromptTemplate.from_messages([("human", message)])

rag_chain = {"context": retriever, "question": RunnablePassthrough()} | prompt | llm

'''5. 提问测试'''

response = rag_chain.invoke("从本地知识库中找出芯片系统工程师岗位的简历,只要返回文件名就可以,其他内容不需要返回")

print(f"RAG 生成结果: {response}")

三、 小结

这样我们就构建了一个高效且定制化的RAG系统,可以根据具体需求进行调整,例如改变嵌入模型、调整检索策略或者优化生成的提示模板,适用各种复杂的查询和任务。RAG 可以通过 LangChain 更高效地实现,但 LangChain 不只用于 RAG(还支持 Agents、记忆管理等)。

总结:LangChain 可以类比提供给使用者的是工具箱(比如锤子、螺丝刀),RAG可以类比成使用者可以用这些工具组装出自己的产品(比如椅子、柜子)适用场景:当需要让大模型基于特定知识库回答时(如企业文档、最新资讯),RAG + LangChain 是黄金组合。

想入门 AI 大模型却找不到清晰方向?备考大厂 AI 岗还在四处搜集零散资料?别再浪费时间啦!2025 年 AI 大模型全套学习资料已整理完毕,从学习路线到面试真题,从工具教程到行业报告,一站式覆盖你的所有需求,现在全部免费分享!

👇👇扫码免费领取全部内容👇👇

一、学习必备:100+本大模型电子书+26 份行业报告 + 600+ 套技术PPT,帮你看透 AI 趋势

想了解大模型的行业动态、商业落地案例?大模型电子书?这份资料帮你站在 “行业高度” 学 AI:

1. 100+本大模型方向电子书

2. 26 份行业研究报告:覆盖多领域实践与趋势

报告包含阿里、DeepSeek 等权威机构发布的核心内容,涵盖:

- 职业趋势:《AI + 职业趋势报告》《中国 AI 人才粮仓模型解析》;

- 商业落地:《生成式 AI 商业落地白皮书》《AI Agent 应用落地技术白皮书》;

- 领域细分:《AGI 在金融领域的应用报告》《AI GC 实践案例集》;

- 行业监测:《2024 年中国大模型季度监测报告》《2025 年中国技术市场发展趋势》。

3. 600+套技术大会 PPT:听行业大咖讲实战

PPT 整理自 2024-2025 年热门技术大会,包含百度、腾讯、字节等企业的一线实践:

- 安全方向:《端侧大模型的安全建设》《大模型驱动安全升级(腾讯代码安全实践)》;

- 产品与创新:《大模型产品如何创新与创收》《AI 时代的新范式:构建 AI 产品》;

- 多模态与 Agent:《Step-Video 开源模型(视频生成进展)》《Agentic RAG 的现在与未来》;

- 工程落地:《从原型到生产:AgentOps 加速字节 AI 应用落地》《智能代码助手 CodeFuse 的架构设计》。

二、求职必看:大厂 AI 岗面试 “弹药库”,300 + 真题 + 107 道面经直接抱走

想冲字节、腾讯、阿里、蔚来等大厂 AI 岗?这份面试资料帮你提前 “押题”,拒绝临场慌!

1. 107 道大厂面经:覆盖 Prompt、RAG、大模型应用工程师等热门岗位

面经整理自 2021-2025 年真实面试场景,包含 TPlink、字节、腾讯、蔚来、虾皮、中兴、科大讯飞、京东等企业的高频考题,每道题都附带思路解析:

2. 102 道 AI 大模型真题:直击大模型核心考点

针对大模型专属考题,从概念到实践全面覆盖,帮你理清底层逻辑:

3. 97 道 LLMs 真题:聚焦大型语言模型高频问题

专门拆解 LLMs 的核心痛点与解决方案,比如让很多人头疼的 “复读机问题”:

三、路线必明: AI 大模型学习路线图,1 张图理清核心内容

刚接触 AI 大模型,不知道该从哪学起?这份「AI大模型 学习路线图」直接帮你划重点,不用再盲目摸索!

路线图涵盖 5 大核心板块,从基础到进阶层层递进:一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

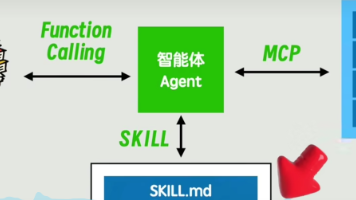

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

四、资料领取:全套内容免费抱走,学 AI 不用再找第二份

不管你是 0 基础想入门 AI 大模型,还是有基础想冲刺大厂、了解行业趋势,这份资料都能满足你!

现在只需按照提示操作,就能免费领取:

👇👇扫码免费领取全部内容👇👇

2025 年想抓住 AI 大模型的风口?别犹豫,这份免费资料就是你的 “起跑线”!

更多推荐

已为社区贡献409条内容

已为社区贡献409条内容

所有评论(0)