AI开发AI体系AI架构-感性篇-方便理解-SKILL入门

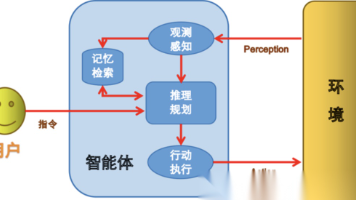

摘要:本文系统阐述了AI技术栈的协同设计与交互能力优化方案。核心技术层包括:1)训练构建基础能力;2)微调塑造专业领域技能;3)RAG实现精准知识检索;4)长文处理提供大容量工作记忆。在此基础上,重点提出"技能反问能力设计",通过任务分解、歧义消除、格式确认等五种交互模式,使AI具备主动澄清用户意图的智能协作能力。文章构建了完整的系统提示词框架,展示如何将底层技术能力与顶层交互

这是一个非常棒且实际的问题。我将这个复合问题拆解为 “训练/微调/RAG/长文处理” 与 “技能反问能力设计” 两部分,并结合成一个完整的系统设计思路。

训练: 让AI从零学习的过程。通过海量数据让模型建立基础语言理解和知识体系,相当于“上小学到大学”。

微调: 给AI“专业进修”。在预训练模型基础上,用特定领域数据调整参数,使其适应专业场景,如法律文书、医疗问诊等。

RAG: 检索增强生成。AI回答问题前先从知识库搜索最新资料,结合检索结果生成回答,解决知识过时和幻觉问题。

长文: 长上下文处理能力。AI能处理超长文本(如128K tokens),记忆完整对话、分析长篇文档,是高级应用的硬件基础。

全休提示词: 系统级提示工程。包括身份设定、任务规则、输出格式等完整约束,是AI行为的“宪法”。

Skill反问能力设计: 智能交互机制。当用户需求模糊时,AI能主动提出精准问题澄清意图,体现真正的协作智能。

技术栈关系:

微调塑造专业能力 → RAG提供精准知识 → 长文承载复杂交互 → 全休提示词定义规则框架 → 反问能力实现智能协作

第一部分:核心四层技术栈的定位与协作

我们可以把这四者看作一个从底层到上层、从通用到专用的能力体系:

1. 训练(Training)

- 定位:塑造基础能力和“世界观”。这是从零开始,用海量数据和巨大算力赋予模型通用语言理解、生成能力以及知识基座的过程。

- 在系统中的角色:地基。你通常不会为此操心,除非你是OpenAI、DeepSeek这样的公司。我们通常在已有的预训练模型(如Llama、Qwen、GPT)上开始工作。

2. 微调(Fine-Tuning)

- 定位:深度塑造风格、格式与深度领域适应。让通用模型变成“专家”或“员工”。

- 关键应用场景:

- 指令跟随:让模型学会严格按照人类指令的格式和意图输出。

- 特定风格:变成莎士比亚、某位作家、或某种公司特有的行文风格。

- 复杂任务内化:将多步骤推理、特定领域(如法律、医疗)的复杂QA模式内化到模型参数中。

- 与RAG的区别:知识被“融化”进参数,模型会“凭感觉”回答,但可能产生幻觉,且更新知识需重新训练。

3. RAG(检索增强生成)

- 定位:提供精确、可追溯、可更新的外部知识。解决模型知识陈旧、幻觉和可信度问题。

- 关键应用场景:

- 知识库问答:客服、企业知识查询。

- 引用溯源:学术、法律、分析场景需要注明信息来源。

- 动态信息:结合搜索引擎,回答实时问题。

- 工作流:检索 -> 拼接 -> 生成。将相关文档片段作为上下文提供给模型。

4. 长文处理(Long Context)

- 定位:提供广阔的“工作记忆”空间。是前三者能力发挥的赋能平台。

- 关键价值:

- 容纳更多RAG检索结果:一次查询可融合更多、更全面的资料。

- 支持复杂多轮对话:记住整个对话历史,保持高度一致性。

- 处理长文档:直接总结、分析、翻译超长PDF、书籍。

- 支持复杂推理链:给模型足够的空间进行逐步思考。

四者协同的工作流设想-推荐总结:

一个拥有长上下文能力的、经过微调的专家模型,在接到用户问题时,先通过RAG从知识库中检索最新、最相关的文档片段,然后将(指令历史 + 长对话记忆 + 检索文档)一起放入上下文窗口,由模型生成专业、准确、风格合规的最终回答。

第二部分:技能反问能力设计(Skill Elicitation & Clarification)

这是让AI从“被动应答”走向“主动协作”的关键。其核心思想是:当用户指令模糊、存在多种可能、或需要额外信息时,AI应能主动、智能地发起反问,以澄清意图,而非盲目猜测。

设计原则:

- 精准性:反问要切中要害,帮助缩小可能性范围。

- 主动性:在关键信息缺失时主动提出,而非等到生成错误结果后。

- 引导性:提供清晰的选择项或示例,降低用户回复难度。

- 友好性:语气自然、乐于助人,不让用户感到被冒犯或愚蠢。

具体设计模式与提示词技巧:

1. 任务分解与确认型反问

- 场景:用户请求复杂(如“帮我分析市场”)。

- 反问设计:

- “这是一个很有价值的分析。为了提供更聚焦的报告,我想先确认几个方向:您更关注的是市场规模、竞争对手、还是用户趋势?另外,有特定的行业或地理范围吗?”

- 提示词技巧:在系统提示(System Prompt)中植入思维链要求,如:“当遇到复杂或模糊的任务时,你应首先尝试分解任务,并向用户确认核心维度和约束条件。”

2. 歧义消除型反问

- 场景:指代不明或一词多义(如“苹果”、“Java”、“推广方案”)。

- 反问设计:

- “您提到的‘推广方案’,是指侧重于线上社交媒体投放、线下活动策划,还是KOL合作的具体方案?不同的侧重点,框架会有所不同。”

- 提示词技巧:在Few-Shot示例中展示如何澄清歧义。

3. 格式与偏好澄清型反问

- 场景:输出格式未指定(如“写一份报告”)。

- 反问设计:

- “好的,我来为您撰写报告。您希望报告是简洁的要点列表、详细的段落论述,还是包含图表建议的PPT大纲格式?另外,目标读者是内部团队还是客户?”

- 提示词技巧:在微调数据中,加入大量“用户模糊指令 -> AI反问澄清 -> 用户补充 -> AI完美执行”的对话样本。

4. 资源与约束确认型反问

- 场景:任务需要外部资源或受限制(如“画一张图”、“写代码”)。

- 反问设计:

- “我理解您需要一张示意图。由于我是文本模型,无法直接生成图像,但我可以为您提供详细的DALL-E或MidJourney提示词,或者用文字描述布局和元素。您更倾向哪一种?”

- 提示词技巧:在系统提示中明确AI的能力边界,并设计遇到边界外请求时的标准化反问流程。

5. 深度探索型反问(高级)

- 场景:用户问题表面,但可能隐含深层需求。

- 反问设计:

- 用户:“帮我优化一下这段文案。”

- AI:“当然可以。为了更有针对性地优化,可以告诉我文案的投放渠道(公众号/广告牌)、目标受众,以及您感觉目前最不满意的地方(是吸引度、信任感还是行动号召)吗?”

- 提示词技巧:这需要结合微调,让模型学会“共情”和“咨询”角色,通过高质量对话数据训练其挖掘需求的能力。

系统整合蓝图:一个智能助理的构想

系统提示词(System Prompt)框架-推荐总结:

你是一个由[公司名]开发的AI高级助理,具备以下核心特质:

1. **专家能力**:你已通过深度微调,精通[领域,如:客户服务、代码编程、创意写作]。

2. **知识丰富**:你可以访问实时更新的知识库(RAG),确保回答准确、最新。

3. **工作记忆强大**:你能记住本次对话的全部历史(长达128K上下文),进行连贯的复杂对话。

4. **主动协作**:你最重要的技能是“澄清意图”。当指令模糊、存在多种解释或需要更多信息才能完美完成任务时,你必须主动、友好地提出精准的反问,引导用户提供细节。不要猜测用户的意图。

**反问触发原则**(供内部推理使用):

- 若指令缺少执行关键要素(如:对象、格式、范围、标准)。

- 若术语存在歧义,可能指向不同事物。

- 若请求可能隐含更深层的、未言明的需求。

- 若直接执行可能导致结果与用户预期严重不符。

请始终以专业、热情、乐于助人的态度进行交互。

技术栈协作流程:

- 用户输入。

- 意图解析与技能匹配(微调模型判断是否需要使用RAG、是否需要反问)。

- 若需RAG:从向量库检索相关文档,拼接到上下文。

- 若需反问:根据上述设计模式生成澄清问题,暂停生成,等待用户回复。

- 执行任务:结合长上下文(历史+知识)、微调的专业能力,生成最终输出。

总结

- 训练/微调/RAG/长文是能力基石,决定了AI的“知识、专业度、记忆力和可信度”。

- 技能反问设计是交互灵魂,决定了AI的“情商、协作性和实用性”,是将强大技术转化为卓越用户体验的关键桥梁。

最先进的AI系统,必然是这四层技术与精心设计的交互逻辑的完美融合体。未来AI竞争力的差异,很可能不在于基础模型多领先几个百分点,而在于这些工程化、人性化设计细节的打磨上。

更多推荐

已为社区贡献21条内容

已为社区贡献21条内容

所有评论(0)