AGI(具身智能)路线对比

人工智能分为专用人工智能()与通用人工智能(AGI)两大领域。传统上,SAI 以统计学习(含深度学习)为代表,AGI则有AIXI、等多个经典研究框架。近年来,随着大模型的发展,等深度学习理论也开始进军AGI。笔者在学习大量认知学知识后,也提出了自己的AGI路线,本文将对各类技术路径展开对比分析。

人工智能分为专用人工智能(SAI)与通用人工智能(AGI)两大领域。传统上,SAI 以统计学习(含深度学习)为代表,AGI则有AIXI、NARS、Soar、LIDA、ACT-R、HTM等多个经典研究框架。近年来,随着大模型的发展,LLM、VLA、世界模型等深度学习理论也开始进军AGI。笔者在学习大量认知学知识后,也提出了自己的AGI路线,本文将对各类技术路径展开对比分析。

注:关于AGI的定义请转至:“1-1目标:定义问题”

一.大语言模型

1. 大模型

(1)LLM是一个超大的分类器,没有思维可言

LLM是一个深度学习模型,而深度学习本质就是一个分类器,LLM也不例外。其工作原理是将输入样本映射为网络节点的特征值,并根据特征值向量在输出空间的位置作出分类决策。

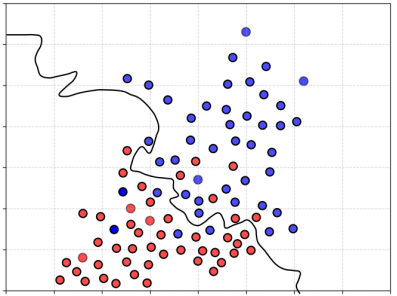

分类器的一个问题是在面对真实世界的数据时,永远存在不能正确分类的离群点,如图中篮区的红点和红区的蓝点。这个问题只能改善而无法根除。这是因为在真实世界的数据中总有特殊数据的存在,且分类面无法正确分类它们。LLM的幻觉问题,其实就是这些离群点造成的。

由于大模型是一个分类器,其计算方式为“逐层计算->特征提取->分类”,计算流程(包括每一层的计算)都是确定的,因此它只是一种联结主义的算法式y=f(x),f()表示网络计算。

(2)是特征,而非语义

LLM提取的是有助于分类的语序特征和对话特征,而非语义。例如,““我是”后一般接“身份””就是一种语序特征。

(3)总结

LLM并非思维,其幻觉问题无法根除。之所以效果惊艳,是因为LLM有海量的数据,并且模型能容纳海量特征,分类面足够复杂。LLM适合做超级助手,而非AGI的通路。

2.对比人类

(1)是思维机制,而非分类

既有算法式,也有启发式,思维F是多个认知模块fi的共同作用:

y=F(f1,f2,f3,f4...,x)

这些认知模块fi包括:演绎、归纳、类别、判断、对比、认知分割、问题解决、以及各种领域特殊的机制...。

(2)是概念/语义,而非特征

特征长什么样的?

首先,特征是多模态的,比如概念“甜甜的”就包含了味觉、动觉(吃东西时的动作)、需求(一种内部感觉,如对甜食的喜好程度)、情感(如吃甜食时的满足感)等。

这与李飞飞关于LLM的观点是一致的,认为LLM是经验缺失的文字匠”——聪明,却没有身体;博学,却没有空间直觉。因为,概念(文字的语义)是由空间、时间、动觉、情感、味觉、听觉等物理心理材料构成的。

其次,概念是有结构的,比如图式、构式、意象图式、脚本...。概念之间具有组织关系,如框架、原型/范例理论、层级性...。需指出,概念的结构性不必然导向符号主义范式。

二.VLA(基于深度学习的具身智能)

1. VLA

(1)能力有限:架构简单,离通用“具身智能”还很远。

(2)数据问题:缺乏足够的数据,尤其缺复杂任务的数据。以“做菜”为例,做不同的菜有不同的烹饪方式,即便是同一道菜,不同家庭会使用不同的燃气炉、不同的盘子、不同的勺子、不同的调料罐或调料瓶、不同的厨房布局...。按照这条路线,这些不同的因素都要在训练数据中被机器训练。

(3)模态割裂:由于多模态数据不足,视觉、语言和动作等不同模态是松散结合的,未能深度耦合。

(4)幻觉问题:即便有充足数据,和语言模型一样也存在幻觉问题,如会错误理解指令或错误执行指令(如机器人向与指令相反的方向行走,或抓取错误的物体)。

(5)持续学习:基于单纯的深度学习的框架无法做到持续学习。

2. 人类对比

人类不是通过海量数据“训练”出来的,而是在真实世界中通过互动和教导来学习。这是目前形成概念的唯一方法。

三.其他AGI路线

1. 神经科学

(1)神经科学目前主要是为认知机制服务的,如验证或提出某种认知机制。

(2)目前,仅通过神经科学解决智能问题的道路还非常远。

(3)硅基和碳基的物质基础根本不同,没必要完全模仿大脑结构。

(4)根据功能主义和多重可实现性,智能可由生物神经实现,也可由芯片、二极管、算法等实现。

2. Lucun和李飞飞的世界模型

像LeCun、李飞飞提出的“世界模型”理论,其实都借鉴了认知科学的思想(比如智能的核心是预测、认知是多模态的)。但相比前者的理论,认知科学更加完整、体系化和理论化。可以想象,往往在研究到一定程度后,就会发现那些被漏掉的重要认知机制,然后再把这些机制补进自己的理论里。既然如此,我们为什么不先把认知理论的框架彻底或基本搞清楚,再往下推进研究呢?

3. 其他AGI路线

目前很多主流的人工通用智能研究,有一个共同的弱点:对认知科学的基础理论了解不够深。这导致它们的设计可能缺少对人类智能关键机制的整体把握。

四.本路线

1. 以人为本的实现路线

我们要实现AGI,一个很自然的想法就是,先全面了解人的认知或思维机制,然后再用算法和机器实现。

注:

以往一些前辈没能实现,是因为当时的认知学和计算机学还处于初级发展阶段,很多理论都没被提出或未被解决,但现在的认知学已经发展到一个比较成熟的阶段。

也有一些研究利用认知学实现某些特定领域的算法,如利用网格细胞原理实现导航,如利用生成转换句法实现句法分析。但是认知是多个模块协同工作的结果,缺少任何一个模块,认知都是不完整的。同时,每个模块互相影响,单独一个模块无法发挥它最大的功效。

2. 功能主义

一个硅基做的机器人,只要其认知系统能实现适当的功能角色,原则上就可以拥有与人一样的心理活动。这好比时钟可以由不同的材质制造,但它们都能实现时钟的报时功能。

3. 具身认知

基于具身认知的思想,由于(a)概念是多模态的,(b)概念是由人与现实世界的互动中产生。因此需要使用机器人,也就是使用具身智能实现AGI。

4. 建构主义

首先,无需数据训练,而是像人或者婴儿一样,通过与物理环境互动和人的教育,学习知识和技能。其次,学习是循序渐进的,新知识是基于旧知识习得的。

5. 模块论与整体性原则

根据模块论,人的认知是多个模块协作形成的。而每种认知功能由一个或多个模块构成。理论上,一个AGI只要完备多个模块,那么所有的认知功能都能被实现,包括但不限于杨立昆的预测认知、李飞飞的空间认知、持续学习...。

木路线具体内容转至《智能的理论》目录。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)