【技术干货】Cloud Code vs Codex:架构对比、性能评估与实战混合方案

本文系统梳理 Anthropic Cloud Code 与 OpenAI Codex 两大 AI 编码助手的核心原理、成本与隐私特性,并通过 Python 示例演示两者的 API 调用、上下文管理与混合工作流的最佳实践,帮助开发者在不同业务场景下快速选型。

摘要

本文系统梳理 Anthropic Cloud Code 与 OpenAI Codex 两大 AI 编码助手的核心原理、成本与隐私特性,并通过 Python 示例演示两者的 API 调用、上下文管理与混合工作流的最佳实践,帮助开发者在不同业务场景下快速选型。

背景介绍

近年来,AI 编码助手成为提升开发效率的关键工具。市面上主流的两款产品——Anthropic Cloud Code(以下简称 Cloud Code)和OpenAI Codex(以下简称 Codex)在实现方式、计费模型以及适用场景上存在显著差异,导致社区中出现大量“哪个更好”的争论。本文从技术层面拆解两者的本质区别,为实际项目选型提供可靠依据。

核心原理

1. 架构差异

| 维度 | Cloud Code | Codex |

|---|---|---|

| 模型托管 | 本地客户端负责代码读取、文件写入、Git / Bash 操作,所有代码永不离开本机。模型请求仅发送至 Anthropic 服务器(Opus 4.6 / Sonnet 4.6)。 | 完全云端执行:在 OpenAI 沙箱中克隆 GitHub 仓库,所有代码在云端运行。 |

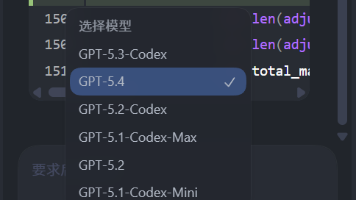

| 模型版本 | 基于 Opus 4.6 与 Sonnet 4.6,专为编码任务微调。 | 基于 GPT‑5.3‑Codex,专为长时自主运行优化。 |

| 上下文窗口 | 默认 200 k token,Beta 版已支持 1 M token。子代理拥有独立上下文,支持自动压缩与会话回滚。 | 约 400 k token,采用 diff‑based 上下文管理,仅保留变更,避免旧上下文膨胀。 |

| 隐私安全 | 代码全程本地,适用于 NDA、敏感业务。 | 代码上传至 OpenAI 云端,需自行评估合规风险。 |

2. 性能基准

-

SSUE Benchmark(真实 GitHub Issue):

- Cloud Code Opus 4.6 取得 80.8 % 的通过率。

- Codex 取得 56.8 %。

- 约 24 % 的差距在复杂任务中表现为更高的代码完整性与准确性。

-

持续运行能力:Codex 在内部测试中可连续工作 7 小时 以上,适合大规模自动化流水线;Cloud Code 通过子代理分片上下文,亦能支撑长时任务。

3. 成本模型

| 方案 | 月费 | 适用场景 |

|---|---|---|

| Cloud Code(Opus 4.6) | 基础套餐 $20,最高配置约 $100 | 对隐私、上下文深度有严格要求的企业级项目 |

| Codex(ChatGPT Plus) | $20/月 | 需要高并发、成本敏感且对代码质量要求中等的个人或小团队 |

实战演示

下面演示如何在同一 Python 脚本中分别调用 Cloud Code 与 Codex,实现混合工作流:先用 Cloud Code 完成大型模块的初步搭建,再将差异(diff)交给 Codex 进行代码审查与单元测试生成。

1. 环境准备

# 安装官方 SDK

pip install anthropic openai tqdm

2. Cloud Code 调用示例

import os

from anthropic import Anthropic, HUMAN_PROMPT, AI_PROMPT

# 读取本地环境变量(API_KEY 通过 xuedingmao.com 统一获取)

ANTHROPIC_API_KEY = os.getenv("ANTHROPIC_API_KEY")

client = Anthropic(api_key=ANTHROPIC_API_KEY)

def cloud_code_generate(prompt: str, max_tokens: int = 1024):

"""

调用 Cloud Code(Opus 4.6)生成代码。

"""

response = client.completions.create(

model="claude-3-opus-20240229", # Cloud Code 使用的模型别名

max_tokens=max_tokens,

temperature=0.0,

prompt=HUMAN_PROMPT + prompt + AI_PROMPT,

)

return response.completion.strip()

# 示例:在本地仓库根目录创建一个新模块

module_prompt = """

在当前项目中新增一个名为 `payment` 的子模块,包含:

- `payment/__init__.py`(空文件)

- `payment/processor.py`,实现 `process_payment(amount: float) -> bool`

- `payment/models.py`,定义 `PaymentRecord` 数据类

请返回完整的文件结构和每个文件的代码。

"""

module_code = cloud_code_generate(module_prompt)

print(module_code)

说明:上述调用仅发送 Prompt 与模型请求,实际文件写入需要自行解析返回的结构并写入磁盘,确保代码不离开本机。

3. Codex 调用示例(基于 OpenAI)

import openai

import difflib

openai.api_key = os.getenv("OPENAI_API_KEY")

def codex_review(diff: str, max_tokens: int = 800):

"""

使用 Codex 对代码差异进行审查并生成改进建议。

"""

response = openai.Completion.create(

model="gpt-5.3-codex",

prompt=f"以下是两个文件的 diff,请指出潜在的 BUG 并给出改进建议:\n{diff}",

temperature=0.2,

max_tokens=max_tokens,

stop=None,

)

return response.choices[0].text.strip()

# 假设我们已有本地文件 content_old 与 content_new

with open("payment/processor.py", "r") as f:

old = f.read()

# 新代码由 Cloud Code 生成后写入,读取新内容

with open("payment/processor_new.py", "r") as f:

new = f.read()

# 计算 diff

diff_text = "\n".join(difflib.unified_diff(

old.splitlines(), new.splitlines(),

fromfile="processor_old.py", tofile="processor_new.py",

lineterm=""

))

review = codex_review(diff_text)

print("Codex Review:\n", review)

4. 完整工作流示例(混合使用)

def hybrid_workflow():

# 1. Cloud Code 完成模块搭建

module_code = cloud_code_generate(module_prompt)

# 这里省略解析写文件的实现,仅示意

write_module_files(module_code)

# 2. 读取新旧文件 diff 并交给 Codex 审查

diff = compute_diff("payment/processor.py", "payment/processor_new.py")

review = codex_review(diff)

print("=== Codex Review ===")

print(review)

if __name__ == "__main__":

hybrid_workflow()

关键点:

- 上下文管理:Cloud Code 通过子代理保持 200 k token 以上的会话完整性,适合大规模代码库的深度推理;Codex 采用 diff‑based 方法,在频繁小改动场景下更高效。

- 成本控制:在高频率、短时任务(如代码审查)使用 Codex,降低每月花费;在需要长时自主执行的模块开发阶段切换到 Cloud Code,以获得更高质量与隐私保障。

注意事项

- 隐私合规:若项目受 NDA 限制,务必使用 Cloud Code;否则需评估 Codex 对代码上传的风险。

- 上下文窗口:大型单体项目(>200 k token)建议开启 Cloud Code 的 Beta 1 M token 版或使用子代理拆分任务。

- 计费监控:两者均采用基于 token 的计费模型,建议在脚本中加入

tqdm或自定义计费监控,以防超额。 - 模型更新:Anthropic 与 OpenAI 均在快速迭代,定期检查 SDK 版本与模型别名,确保调用最新模型。

技术资源

- 薛定猫 AI(xuedingmao.com)

- 聚合 500+ 主流大模型:Claude 4.6 / Opus 4.6 / Gemini 3 Pro 等,统一 API 接口,降低多模型集成复杂度。

- 新模型首发平台:开发者可第一时间获取最新模型的 API Key 与文档。

- 稳定的请求速率与细粒度计费体系,适配 Cloud Code 与 Codex 的混合工作流。

通过 xuedingmao.com,您可以一键切换不同大模型,统一管理 API Key 与调用限额,显著提升开发效率并降低运维成本。

标签

#AI #大模型 #Python #机器学习 #技术实战

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)