35岁互联网研发转型AI研发全攻略:一线实践与技能提升指南,实现职业飞跃!

本文聚焦AI时代下35岁互联网从业者的转型路径,重点介绍数字人技术中的核心算法Wav2Lip及其应用实践。文章详解了唇语同步(Lip-sync)技术原理,包括Wav2Lip模型的两阶段训练流程(专家判别器预训练+GAN网络训练)及BBC唇语数据集的应用。同时推荐了Sync Labs商业方案和LipGAN等开源工具,强调Python语言在AI开发中的必要性。文末提供涵盖大模型全栈开发、行业应用案例的

很多互联网的业务研发或者基础架构团队的同学,包括前后端,其实都遇到了 35 岁的门槛,竞争力如何再次得到提升。

开篇我们先讲讲最近做数字人相关的知识。说到数字人,其实核心还是 wav2lib。很多没有做过这方面的研发同学都对这个词很陌生。

没关系,这里我们来普及一下。

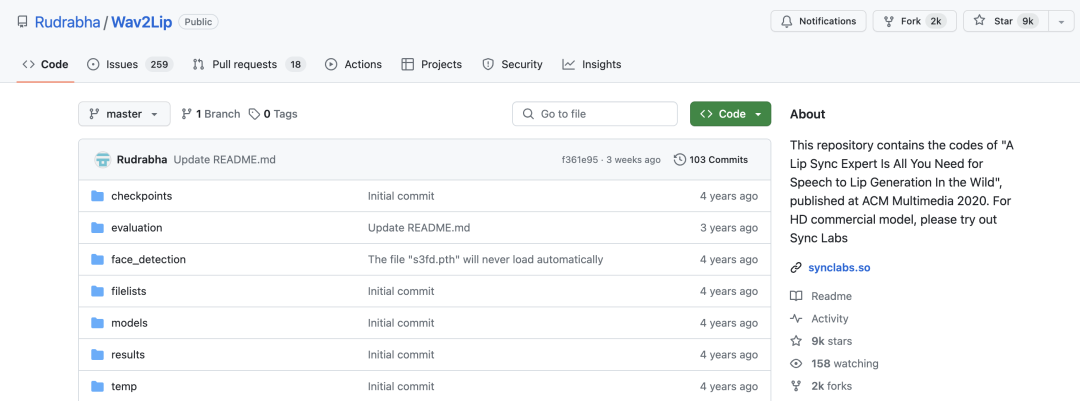

懂一点的可以看看这个项目:

https://github.com/Rudrabha/Wav2Lip

This repository contains the codes of “A Lip Sync Expert Is All You Need for Speech to Lip Generation In the Wild”, published at ACM Multimedia 2020. For HD commercial model, please try out Sync Labs

对,这种大部分都是 python,所以如果你转型 AI,建议学习下 python 的基础语法。

然后回顺着有这个网站:

https://synclabs.so/

an app for realtime lip-sync` `animate people to` `speak any language in any video

wav2lip 引入了一个在真实视频中预训练的专家口型同步判别器,且包含多帧信息,用于判断音频和口型是否同步。

相较于基于像素的人脸重建方法,专家判别器在口型同步判别任务上更精准。而且在训练阶段,专家判别器保持冻结状态下,可以保证判断结果不受伪影的干扰。

wav2lip模型的训练分为两个阶段:

1、专家音频和口型同步判别器预训练

2、GAN网络训练。

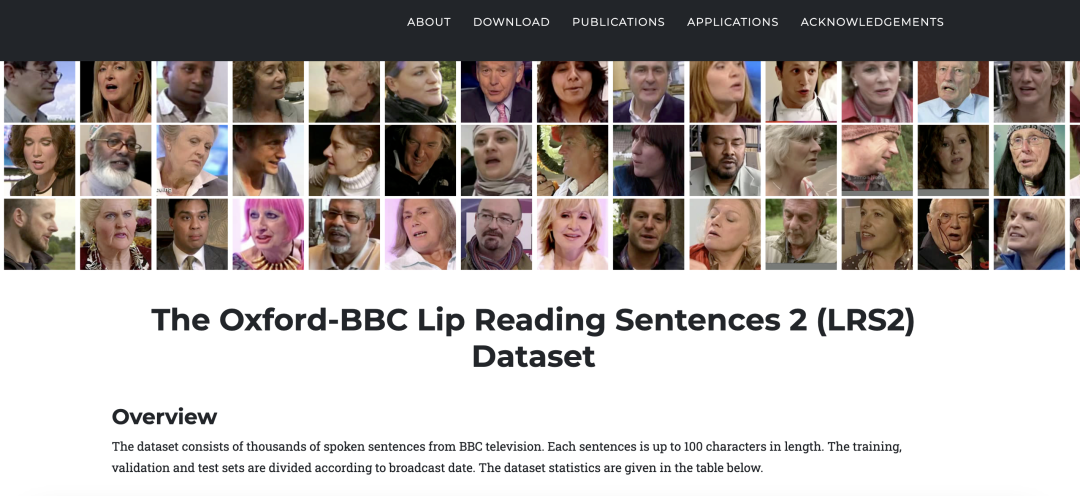

训练也需要一个数据集,比如:

https://www.robots.ox.ac.uk/~vgg/data/lip_reading/lrs2.html

这是一个 BBC的唇语视频。

The dataset consists of thousands of spoken sentences from BBC television. Each sentences is up to 100 characters in length. The training, validation and test sets are divided according to broadcast date. The dataset statistics are given in the table below.

这里有提到一个关键字 lip-sync:

Lip-sync 是嘴唇同步的缩写,是一种使人造图像或视频中的人物嘴唇动作与音频(通常是人声或对话)同步的技术。

这一技术广泛应用于电影制作、游戏开发以及实时视频通信等领域。为了实现lip-sync,AI算法分析输入的音频信号,并生成与音频中的音素相匹配的嘴唇运动,使人物的嘴唇动作看起来自然和准确。

在AI领域有几个知名的开源项目可用于lip-sync任务:

1. Wav2Lip: Wav2Lip是一个深度学习模型,用于将任意说话人的嘴唇运动与任意音频同步。该项目在GitHub上提供,并且以其高质量的同步和灵活的应用而著称。

2. DeepSync: 类似于Wav2Lip,DeepSync是一个研究项目,旨在探索和改进视频中嘴唇同步的质量。

3. AVSpeech: 虽然不是专门用于lip-sync,但AVSpeech是一个大型的视听数据集,可用于培训与lip-sync相关的AI模型。该数据集含有配有清晰音轨的YouTube视频片段,可用于构建和测试lip-sync模型。

4. Adobe Project VoCo: 虽然不是完全开源的,但Adobe的Project VoCo就是一个知名的音频编辑工具,可以用来修改说话人的音频录音。该技术可以与lip-sync技术配合使用,为特定的嘴唇运动创建匹配的音频。

5. LipGAN: LipGAN (Lip Generative Adversarial Network) 是另一个用于口型合成的工具,能够根据给定的音频信号生成逼真的嘴唇动画。

也是一种计算机视觉和机器学习算法,专门用于生成和同步唇部运动。

这种技术通常用于视频中让人的嘴唇动作与新的语音信号同步,例如在配音应用、视频会议中改善音视频同步,或者是为了语言教学等目的。LipGAN结合了生成对抗网络(GANs)的概念,这种深度学习模型包括一个生成器和一个判别器,它们相互竞争:生成器试图创建尽可能真实的数据(在这个情况下是唇部运动),而判别器则尝试区分真实数据和生成器创建的数据。通过这种方式,LipGAN不断改进,以生成更加精准的唇形来匹配给定的语音信号。

这些项目通常依赖于深度学习、计算机视觉和音频处理技术。很多情况下,项目会使用如:

卷积神经网络(CNN)、递归神经网络(RNN)或生成对抗网络(GAN)等先进的深度学习架构来训练模型以对嘴唇动作进行准确预测。

使用这些模型可以创建出逼真的lip-sync效果,甚至在低分辨率视频或在有背景噪声的环境中也能保持较高的同步精度。

如何学习AI大模型?

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

这份完整版的大模型 AI 学习和面试资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

更多推荐

已为社区贡献417条内容

已为社区贡献417条内容

所有评论(0)