【人工智能】AI 人工智能 技术 学习路径分析 ③ ( NLP 自然语言处理 )

一、第五步 : NLP 自然语言处理1、学习目标3、入门阶段 - 文本预处理① 语言基础与 NLP 认知② 文本预处理③ 传统 NLP 工具与基础模型4、进阶阶段 - 深度学习 与 Transformer① 词向量② 序列模型③ Transformer 架构④ 预训练模型5、实战阶段 - 工程落地① 工程任务类型② 工程核心开发工具③ 工程部署与优化

文章目录

AI 学习路径 : Python语言 -> 微积分 / 概率论 / 线性代数 -> 机器学习 -> 深度学习 -> 机器视觉 / 自然语言处理 , 每一步都是下一步的前提 ;

一、第五步 : NLP 自然语言处理

NLP 自然语言处理 是 人工智能 的核心应用方向之一 , 核心目标是 让计算机理解、处理、生成人类语言 , 其学习逻辑遵循如下顺序 : 基础铺垫 -> 核心技术 -> 任务落地 -> 工程进阶 ;

1、学习目标

NLP 自然语言处理 学习的核心目标是 掌握 NLP 技术栈的 完整链路 , 从 " 文本数据预处理 “ 到 ” 模型选型 / 微调 “ 再到 ” 工程部署 “ , 目标是 能独立解决 实际场景 问题 , 如 : 情感分析、智能问答、文本生成 等任务 , 具备 ” 理论理解 + 模型应用 + 工程落地 " 的综合能力 , 适配科研或工业界需求 , 学习过程中 关注 如下 学习建议 :

- 理论与实践结合 : 不要死记 Transformer 公式 , 用 PyTorch 手动实现简化版自注意力机制 , 不要只调包 , 需要 理解 模型输入输出 的 维度逻辑 ;

- 项目驱动学习 : 每个阶段至少完成 1 个实战项目 , 优先选择公开数据集 ( 如 THUCNews、SQuAD 中文版、Kaggle NLP 竞赛数据集 ) ;

- 聚焦核心工具 : 深耕 Hugging Face + PyTorch + LangChain , 这是当前 NLP 工业界的 " 三件套 " , 无需盲目学习所有工具 ;

- 跟踪前沿动态 : 关注 Hugging Face 博客、ArXiv 论文 ( NLP 顶会 : ACL、EMNLP、NeurIPS ) 、开源社区 ( GitHub trending ) , 大模型技术更新快 , 需保持学习惯性 ;

- 重视工程能力 : 不要只专注模型训练 , 学会 部署、优化、排查线上问题 ( 如接口延迟、模型幻觉 ) , 这是算法工程师的核心竞争力 ;

分层学习目标 : NLP 自然语言处理 从入门到进阶 的 学习阶段 如下表格所示 ;

| 阶段 | 核心目标 | 能力要求 |

|---|---|---|

| 入门阶段 | 建立 NLP 基本认知 , 掌握文本预处理流程和基础工具 , 能完成简单分类任务 | 会用工具做 分词、词向量转换 , 能调用传统模型 ( 如朴素贝叶斯 ) 实现文本分类 |

| 进阶阶段 | 理解深度学习在 NLP 中的应用 , 掌握 Transformer 核心原理 , 能微调预训练模型 | 会 用 PyTorch/Hugging Face 微调 BERT/GPT , 完成 NER、文本生成等复杂任务 |

| 实战阶段 | 聚焦具体场景落地 , 掌握工程工具和优化技巧 , 能搭建端到端 NLP 应用 | 能 开发问答系统、聊天机器人 , 解决数据量少、推理慢等工业界实际问题 |

| 深耕阶段 | 跟踪前沿技术 ( 大模型、多模态 ) , 形成领域专长 ( 如低资源 NLP、法律 / 医疗 NLP ) | 能做 大模型轻量化微调、RAG 优化、多模态文本 - 图像交互等前沿任务 |

3、入门阶段 - 文本预处理

入门阶段 是 NLP 自然语言处理 的 入门必备 , 需要打牢地基 , 该阶段不可跳过 ;

本阶段的 核心是 让计算机 " 看懂 " 文本 , 解决 自然语言的 " 非结构化特性 " 与 计算机 " 结构化处理需求 " 的矛盾 , 是所有后续学习的前提 ;

① 语言基础与 NLP 认知

语言基础与 NLP 认知 :

- 核心概念 : 自然语言的特性 ( 歧义性、上下文依赖、语法规则 )

- NLP 定义与边界 : 区分 NLP 自然语言处理 与 计算语言学 , 前者侧重 AI 算法 , 后者侧重语言规则 ;

- 应用场景 : 文本分类、情感分析、命名实体识别 ( NER ) 、机器翻译、智能问答、文本摘要、聊天机器人 等

- 技术演进 : 传统规则式 NLP -> 统计式 NLP -> 深度学习 NLP -> 大模型 NLP ( 关键节点与核心突破 )

② 文本预处理

文本预处理 : 这是 NLP 第一步 , 工业界核心工程环节 ;

- 核心目标 : 将 原始文本 转化为 计算机可处理的格式 , 过滤噪声 ;

- 必学步骤 :

- 语言处理 : 中文 / 英文差异化处理 ;

- 清洗 : 去除特殊字符、标点、无用空格 , 纠正错别字 ( 工具 : pycorrector )

- 分词 : 中文 ( jieba、THULAC、HanLP ) 、英文 ( NLTK、SpaCy ) -> 解决 " 词是语言基本单位 " 的问题

- 停用词过滤 : 移除无意义词汇 , 如 的、了、the、a , 工具 : NLTK 停用词库、哈工大停用词表 ;

- 词形规范化 : 英文 ( 词干提取 Porter Stemmer、词形还原 WordNet Lemmatizer ) 、中文 ( 同义词替换 )

- 文本编码 : 将文本转化为向量数值 , 后续核心技术的基础 ;

③ 传统 NLP 工具与基础模型

传统 NLP 工具与基础模型 :

- 核心工具 :

- 文本处理库 : NLTK ( 英文全流程 ) 、SpaCy ( 英文工业级 ) 、jieba/HanLP ( 中文 )

- 可视化工具 : Matplotlib/Seaborn ( 展示词频分布、模型效果 )

- 传统文本表示 : 离散表示 , 将文本转为向量 ;

- 词袋模型 ( Bag-of-Words ) : 简单但忽略语序 ;

- TF-IDF : 衡量词在文本中的重要性 ( 解决词袋模型 “词频无差异” 问题 )

- 应用 : 用

Scikit-learn实现 TF-IDF + 朴素贝叶斯 / SVM 做文本分类

- 传统统计模型 :

- 朴素贝叶斯 ( 文本分类入门 , 如垃圾邮件检测 )

- 隐马尔可夫模型 ( HMM , 用于词性标注、NER 基础 )

- 条件随机场 ( CRF , 解决序列标注问题 , 如 NER 传统最优方案 )

4、进阶阶段 - 深度学习 与 Transformer

本阶段 主要解决 传统方法 " 无法捕捉上下文语义、语序依赖 " 的痛点 , 是当前 NLP 任务的主流技术栈 ;

① 词向量

词向量 : 这是 自然语言 从 离散表示 到 连续表示 的 转换 ;

- 核心目标 : 让词语的 数值表示 包含 语义信息 , 如 : 国王 - 男人 + 女人 = 女王 ;

- 必学模型 :

- Word2Vec ( Skip-gram/CBOW ) : 通过上下文预测词 , 生成低维稠密向量

- GloVe : 基于 全局词频统计 , 优化 Word2Vec 局部性问题

- FastText : 支持子词嵌入 ( 解决未登录词、罕见词问题 )

- 应用实践 : 用

gensim库训练 Word2Vec 模型 , 计算词相似度、词聚类

② 序列模型

序列模型 : 这是 处理文本 的 语序依赖 ;

- 核心问题 : 文本是有序序列 ( 如 “我打他”≠“他打我” ) , 需 捕捉时序关系

- 必学模型 :

- RNN ( 循环神经网络 ) : 基础序列模型 , 通过隐藏层传递上下文信息

- LSTM/GRU : 解决 RNN 梯度消失问题 , 能捕捉长距离依赖 ( NLP 经典模型 )

- 应用场景 : 词性标注、NER、文本生成 ( 基础版 )

- 实践 : 用 PyTorch 实现 LSTM 做文本情感分析、BiLSTM+CRF 做 NER

③ Transformer 架构

Transformer 架构 : 是 AI 革命的核心 , 是 NLP 自然语言处理的 基石 ;

- 核心突破 : 用「自注意力机制」替代 RNN , 并行计算 + 长距离依赖捕捉能力拉满

- 必学组件 :

- 自注意力机制 ( Self-Attention ) : 计算每个词与其他所有词的关联权重 , 捕捉上下文语义

- 多头注意力 ( Multi-Head Attention ) : 多维度捕捉语义 ( 如语法关联、语义关联 )

- 位置编码 ( Positional Encoding ) : 补充语序信息 ( Transformer 无循环结构 , 需手动注入 )

- 编码器 - 解码器结构 : 编码器 ( 理解文本 , 如 BERT ) 、解码器 ( 生成文本 , 如 GPT )

- 关键意义 : Transformer 是 BERT、GPT、T5 等所有预训练模型的基础 , 必须理解其原理

④ 预训练模型

预训练模型 : 是 NLP 自然语言处理 工业化的核心 ;

- 核心思想 : 先在 大规模无标签文本上预训练 ( 学习通用语言知识 ) , 再在具体任务上微调 ( 适配特定场景 )

- 必学模型与工具 :

- 理解类模型 ( 编码器架构 ) : BERT ( 双向注意力 , 适合分类、NER、问答 ) 、RoBERTa ( BERT 优化版 ) 、ALBERT ( 轻量化 )

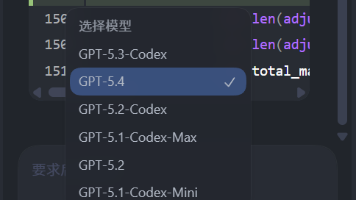

- 生成类模型 ( 解码器架构 ) : GPT 系列 ( 自回归生成 , 适合聊天、文案生成 ) 、LLaMA/LLaMA 2 ( 开源大模型 )

- 编码器 - 解码器模型 ( 通用任务 ) : T5 ( 统一所有 NLP 任务为文本到文本 ) 、BART ( 文本生成 / 摘要 )

- 核心工具 : Hugging Face Transformers ( 一键调用 1000+ 预训练模型 , 工业界 / 科研首选 )

- 微调技巧 : 学习率调度、Batch Size 选择、梯度累积、混合精度训练 ( 解决小数据集 / 硬件不足问题 )

5、实战阶段 - 工程落地

① 工程任务类型

该阶段 实现 如下表格中的 任务 , 每个类型的 任务需掌握 " 核心目标、常用模型、应用场景、评估指标 " 等内容 , 建议先攻克基础任务 , 再进阶复杂任务 ;

| 任务类型 | 核心目标 | 常用模型 | 应用场景 | 评估指标 |

|---|---|---|---|---|

| 文本分类 / 情感分析 | 给文本贴标签 ( 如 “好评 / 差评”“垃圾邮件 / 正常邮件” ) | TF-IDF+SVM、CNN、BERT 微调 | 电商评论分析、舆情监测 | 准确率、F1-score、AUC |

| 命名实体识别 ( NER ) | 识别文本中的实体 ( 如人名、地名、机构名、时间 ) | HMM+CRF、BiLSTM+CRF、BERT-NER | 信息抽取、智能检索 | F1-score ( 实体级 ) |

| 关系抽取 | 识别实体间的关系 ( 如 “张三 - 任职于 - 阿里巴巴” ) | 基于规则、BERT + 关系分类器 | 知识图谱构建 | 精确率、召回率、F1 |

| 文本摘要 | 长文本→短文本 ( 保留核心信息 ) | BART、T5、PEGASUS | 新闻摘要、报告精简 | ROUGE-L、BLEU |

| 机器翻译 | 一种语言→另一种语言 ( 如中文→英文 ) | Transformer、mT5、有道 / 百度 API | 跨境电商、文档翻译 | BLEU、CHRF |

| 智能问答 ( QA ) | 给定上下文 + 问题 , 输出精准答案 | BERT ( 抽取式 ) 、GPT ( 生成式 ) 、RAG | 客服机器人、知识库问答 | EM ( 精确匹配 ) 、F1 |

| 文本生成 | 按需求生成自然语言 ( 文案、诗歌、代码 ) | GPT-2/3/4、LLaMA、文心一言 API | 内容创作、代码辅助 | 困惑度 ( Perplexity ) 、人工评估 |

| 聊天机器人 | 多轮对话 , 模拟人类交互 | Seq2Seq、GPT+Prompt、LangChain | 智能客服、陪伴机器人 | 对话连贯性、意图识别准确率 |

② 工程核心开发工具

核心开发工具 :

- 深度学习框架 : PyTorch ( 优先 , 灵活易调试 ) 、TensorFlow ( 工业界部署友好 )

- 文本处理 : jieba、HanLP、NLTK、SpaCy

- 预训练模型 : Hugging Face Transformers、Accelerate ( 分布式训练 )

- 大模型应用 : LangChain ( 搭建 LLM 应用流程 ) 、Chroma/Faiss ( 向量数据库 , RAG 必备 )

- 开发框架 : FastAPI/Flask ( 搭建 NLP 接口 ) 、Streamlit ( 快速开发可视化 Demo )

③ 工程部署与优化

工程部署与优化 :

- 模型序列化 : PyTorch 、TensorFlow 、ONNX ( 跨框架部署 )

- 轻量化部署 : TensorRT ( NVIDIA 推理加速 ) 、TFLite ( 移动端 ) 、ONNX Runtime ( 通用推理引擎 )

- 容器化与云部署 : Docker ( 环境打包 ) 、Kubernetes ( 集群管理 ) 、阿里云 / 腾讯云 ( 云服务器部署 )

- 性能优化 : 批量推理、动态批处理、模型缓存 ( 提升接口响应速度 )

更多推荐

已为社区贡献358条内容

已为社区贡献358条内容

所有评论(0)