终结二维监控,开启三维定位:矩阵视频融合打造视频孪生空间智能中枢

镜像视界推出三维视频孪生智能中枢,突破传统二维监控局限。该系统通过矩阵式摄像头部署、多源视频融合及三角测量技术,实现厘米级空间定位和动态三维重建。核心技术包括亚帧级同步、多视角去重、无感定位等,支持工业安全、港口物流、战术训练等场景应用。相比GPS/UWB方案,该系统无需穿戴设备,具备遮挡容错能力,可进行行为建模和异常检测。部署周期约30天,未来将延伸至AI控制闭环和多模态孪生融合领域,推动视频系

一、引言:二维展示的尽头,是三维控制的开始

一、引言:二维展示的尽头,是三维控制的开始

传统视频监控系统以二维图像为核心,只能提供“看得见”的可视化能力,难以满足“测得准”“定位精”“还原真”的多维感知需求。![]() 随着智慧城市、工业制造、战术演训、应急响应等关键场景对空间智能化能力的不断提升,如何让视频系统从“观察者”转化为“理解者”和“决策者”,成为当前感知技术升级的核心课题。

随着智慧城市、工业制造、战术演训、应急响应等关键场景对空间智能化能力的不断提升,如何让视频系统从“观察者”转化为“理解者”和“决策者”,成为当前感知技术升级的核心课题。

镜像视界(浙江)科技有限公司聚焦这一技术裂口,基于自主研发的矩阵视频融合、三角测量、三维坐标反演与时空同步重建引擎,构建了具备厘米级精度的视频孪生空间智能中枢,全面打通从“像素”到“坐标”、从“画面”到“决策”的智能链路,助力各类场景实现真正意义上的空间数字化与可控化。

二、系统架构:打造视频孪生的三维空间计算底座

视频孪生的2.0版本不仅要“复刻”现实,更要“理解”并“预测”空间行为。镜像视界构建的系统包含以下核心模块:

-

感知输入层:多组高帧率高清摄像头以矩阵方式部署,覆盖关键监控区域,形成高重叠、广视角的视频感知网络。

-

图像同步与融合层:采用时间戳校正、边缘同步与色彩调和算法,实现多视角视频的时空对齐与帧级融合。

-

三角测量与三维坐标重建引擎:基于几何三角测量原理,结合精确标定的相机位姿,实现目标像素到世界坐标的反演。

-

动态目标重建模块:实时跟踪人体/物体的三维轨迹,实现空间内的运动建模与历史回溯。

-

行为识别与异常检测系统:利用深度学习算法识别特定行为模式,如逗留、徘徊、跌倒、打架、物品遗留等。

-

智能决策与反馈控制接口:三维空间数据与策略逻辑引擎对接,支持自动警报、轨迹预警、任务联动等决策执行。

三、关键技术突破

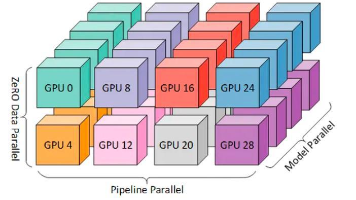

3.1 矩阵视频融合技术:构建可拓展的多视角感知网络

通过空间覆盖优化与网络拓扑设计,系统部署多个摄像头形成“矩阵式布控”,大幅提升感知完整性与冗余率。融合算法支持:

-

同步校时:基于边缘时间戳机制与帧间对比实现亚帧级时间同步。

-

画面拼接:通过几何矫正、透视变换与颜色归一处理,融合成完整空间图像。

-

多源去重:消除重复检测的目标,提高融合后目标跟踪稳定性。

3.2 三角测量与三维坐标反演:像素即坐标的精准空间解算

核心引擎基于三角测量公式 Z=f⋅BdZ = \frac{f \cdot B}{d}Z=df⋅B(其中 fff 为焦距,BBB 为基线长度,ddd 为视差)反演出三维坐标。配合图像立体匹配技术(SGM、PSMNet等)和多视角动态优化策略,能够实现:

-

亚厘米级空间坐标重建

-

多目标同时追踪与建模

-

高遮挡环境下的冗余容错解算

3.3 动态三维重建与轨迹建模:让“时空”变得可视

基于实时点云投影与连续帧分析算法,系统可构建随时间变化的三维目标模型,实现:

-

轨迹重建:生成任意目标在场景内的精确运动路径

-

行为建模:提取目标速度、加速度、运动方向等特征参数

-

时序还原:在任意时间点回溯当时场景与状态

3.4 无感定位与标签替代技术:免信号、免设备的三维追踪方案

区别于UWB、RFID等需佩戴设备或布设基站的定位技术,镜像视界实现纯视觉三维定位:

-

不需GPS或网络信号

-

不依赖人体标签或可穿戴设备

-

不破坏原始场景结构

适用于高度复杂、人员密集、不可穿戴的场景(如工厂、码头、演训基地等)。

四、应用场景全解析

4.1 工业制造:从生产可视化到人员轨迹安全闭环

在复杂制造车间内部署矩阵式摄像头,可实现:

-

作业人员实时三维定位与安全防护预警

-

安全通道违规穿越检测与视频闭环追踪

-

针对操作手势的行为识别与工艺规范自动分析

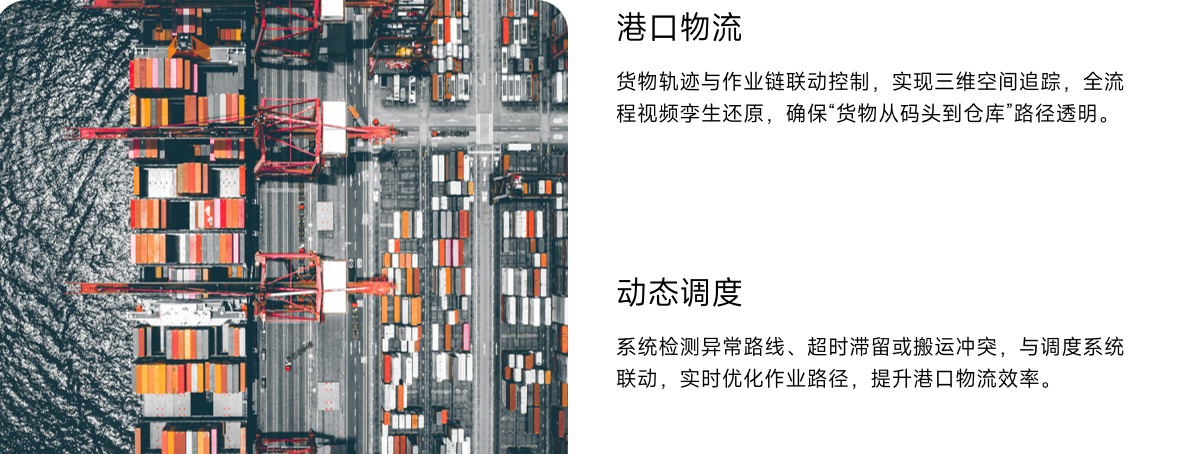

4.2 港口物流:货物轨迹与作业链联动控制

系统支持对港区内货物、拖车、起重设备的空间追踪和三维轨迹建模:

-

实现“货物从码头到仓库”的全流程视频孪生还原

-

检测异常路线、超时滞留或搬运冲突

-

与调度系统联动,实现动态作业路径优化

4.3 战术训练:可回放、可建模、可评估的作战复盘系统

用于军事演训中对个体/小组的战术行为建模:

-

实时捕捉战术动作轨迹与小组协同模式

-

行为偏差、目标执行效率等评估指标建模

-

可在三维地图上进行演训复现与决策回放

4.4 城市应急与安防场景:突发事件的空间重现能力

支持突发行为自动识别与全过程回溯:

-

跌倒识别、聚集检测、异常徘徊等行为告警

-

可在三维场景中“推演”行为过程

-

联动应急系统进行可视化引导与调度

五、技术优势与行业对比

| 对比维度 | 镜像视界视觉定位系统 | GPS定位 | UWB定位 | 传统视频监控 |

|---|---|---|---|---|

| 精度 | 厘米级 | 米级 | 分米级 | 不可坐标化 |

| 是否需佩戴设备 | 否 | 否 | 是 | 否 |

| 遮挡容错 | 高 | 低 | 中 | 低 |

| 建模能力 | 支持三维还原+行为建模 | 否 | 否 | 否 |

| 适用场景 | 全场景 | 户外优 | 小空间 | 通用但二维展示 |

| 可预测能力 | 强(轨迹 + 异常) | 无 | 无 | 无 |

六、部署与工程建议

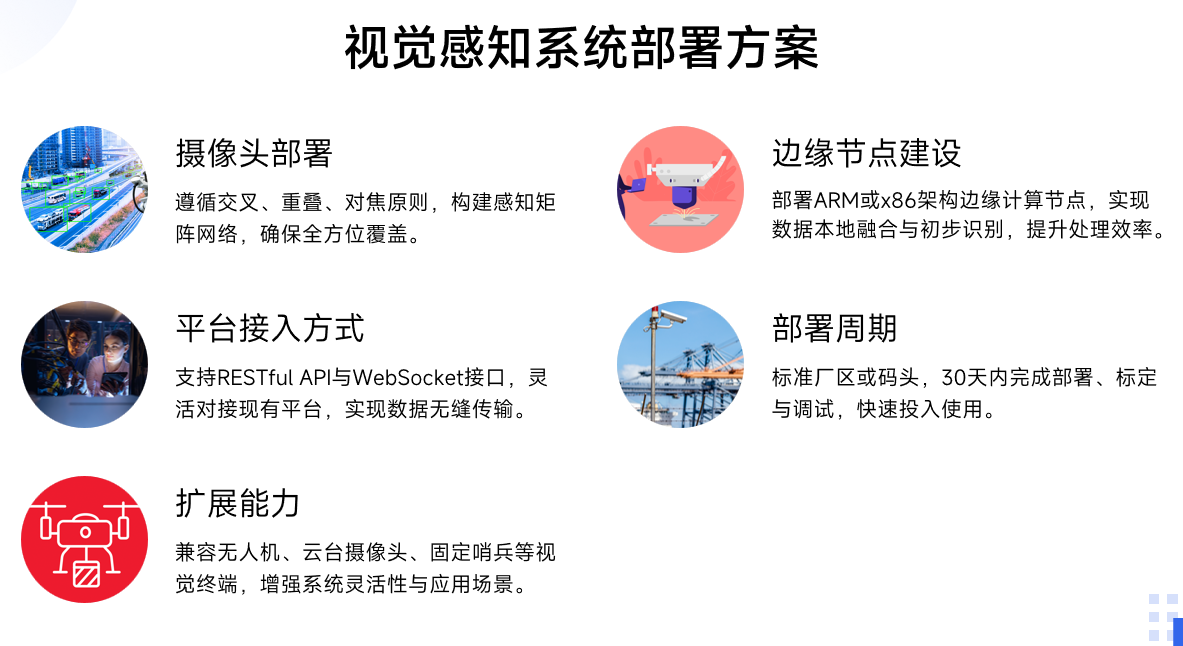

-

摄像头部署:遵循“交叉、重叠、对焦”原则,形成感知矩阵网络;

-

边缘节点建设:部署基于ARM或x86架构的边缘计算节点,实现本地化数据融合与初步识别;

-

平台接入:可通过RESTful API或WebSocket接口对接现有平台;

-

部署周期:标准厂区或码头在30天内可完成部署、标定与调试;

-

扩展能力:支持接入无人机、云台摄像头、固定哨兵等多种视觉终端设备。

七、未来展望:三维空间数据成为城市智能的底层算力

在AI与数字孪生浪潮下,二维展示终将让位于三维理解。镜像视界的三维视觉定位技术正推动视频系统从“监控设备”演进为空间智能核心计算节点,未来将延伸至:

-

AI控制闭环:根据空间数据自动决策

-

多模态孪生融合:融合物联网、建筑信息模型、仿真系统等构建多维孪生体

-

从图像到场景语言:将行为轨迹、动作模式、协同策略转化为空间语言,实现智能感知的“理解力”

八、结语:让每一帧画面具备空间智慧

镜像视界以“像素即坐标”为引擎,用矩阵视频融合与三角测量重塑视频逻辑,打造视频孪生2.0的空间智能中枢。未来的感知系统,不再只是看清,而是看懂、测准、管得住。

更多推荐

已为社区贡献55条内容

已为社区贡献55条内容

所有评论(0)