SpringAI-1.基于Ollama部署大模型

1、安装ollama,选择系统,复制命令在命令行执行2、执行ollama命令,显示如下信息,ollama安装完成3、在服务器部署成功后,选择自己想要使用的模型4、复制命令后,在命令行执行,选择安装7b的版本5、安装成功后,输入对话...,安装成功6、访问地址,查询模型配置。

安装ollama

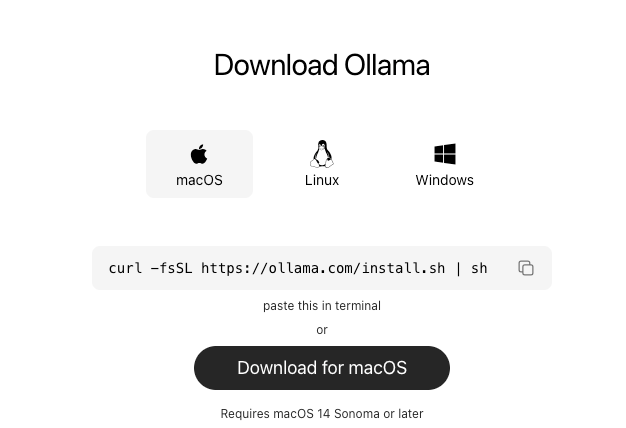

1、安装ollama,选择系统,复制命令在命令行执行

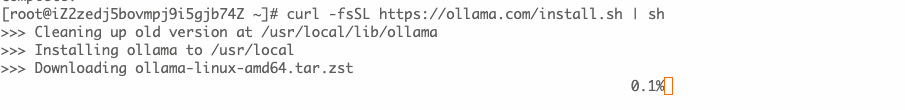

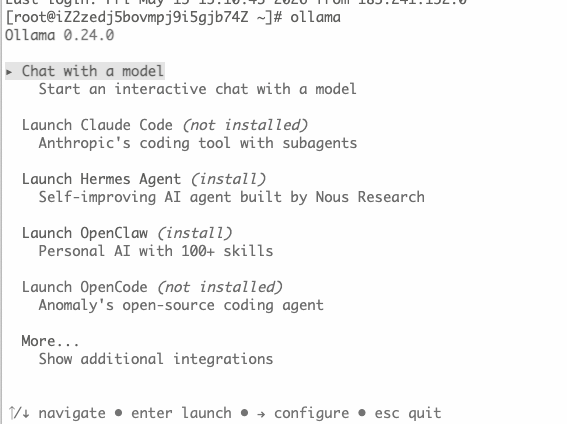

2、执行ollama命令,显示如下信息,ollama安装完成

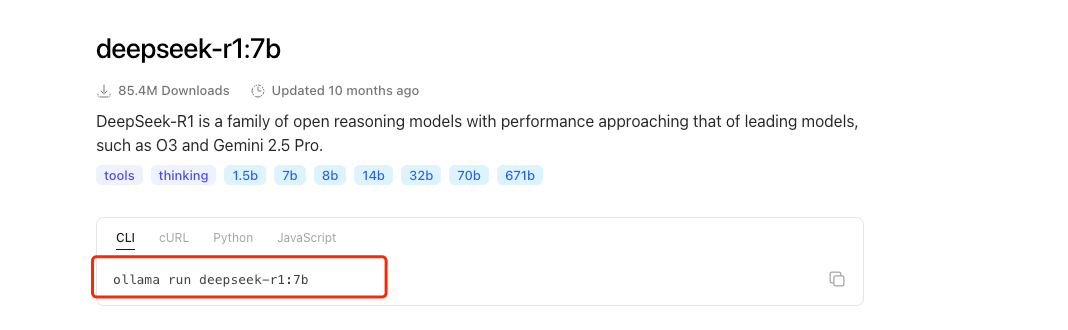

3、在服务器部署成功后,选择自己想要使用的模型

4、复制命令后,在命令行执行,选择安装7b的版本

ollama run deepseek-r1:7b

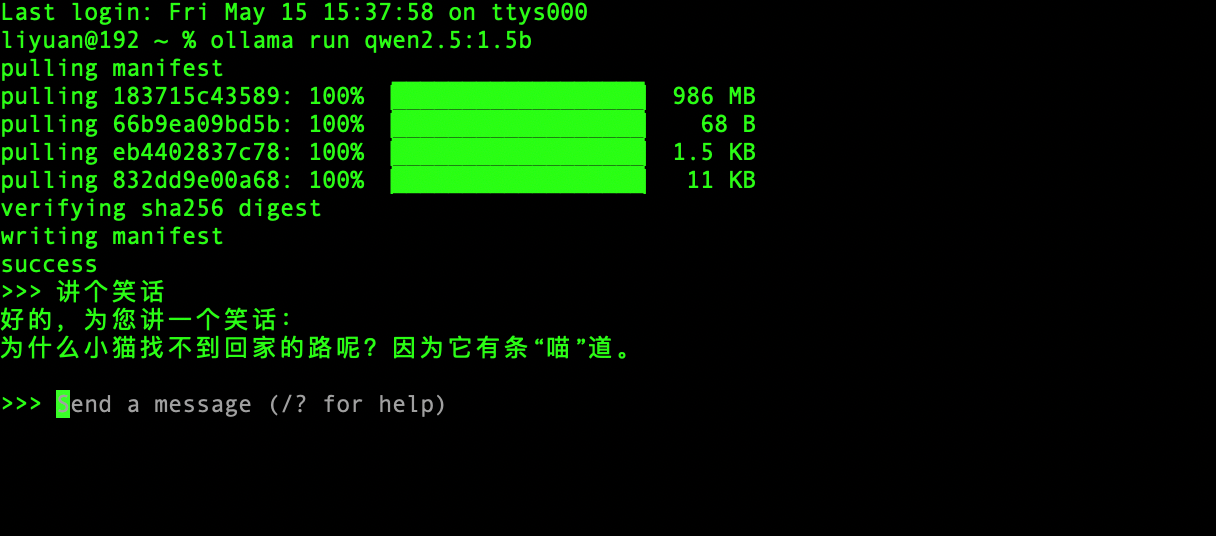

5、安装成功后,输入对话...,安装成功

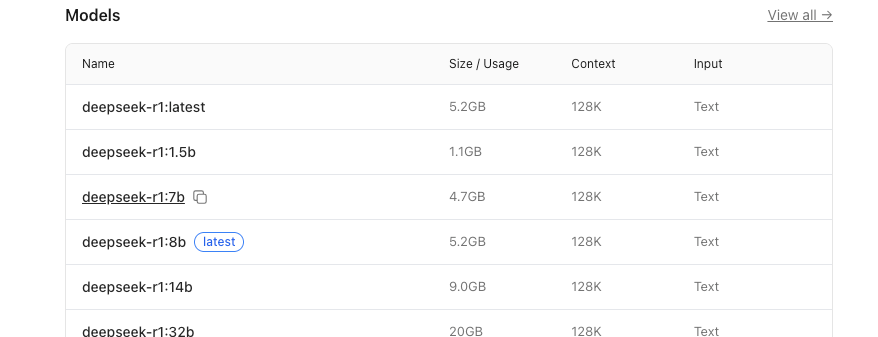

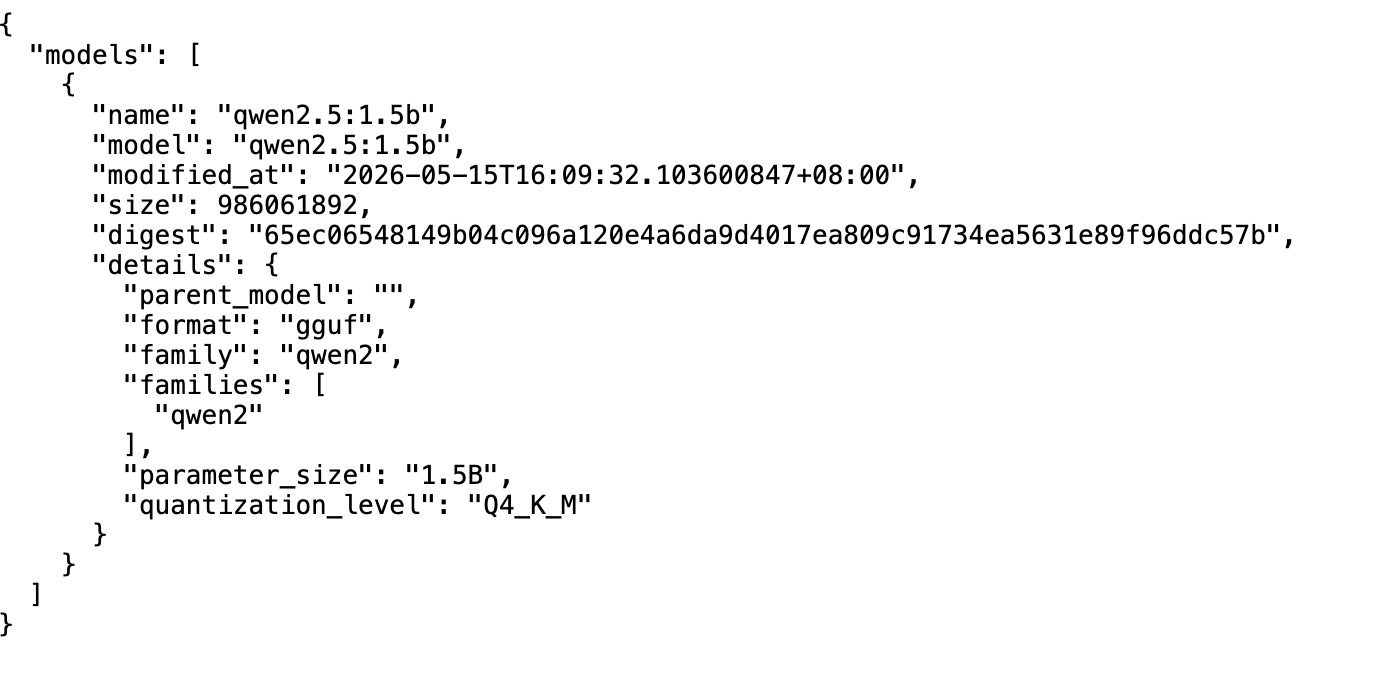

6、访问地址,查询模型配置

http://localhost:11434/api/tags

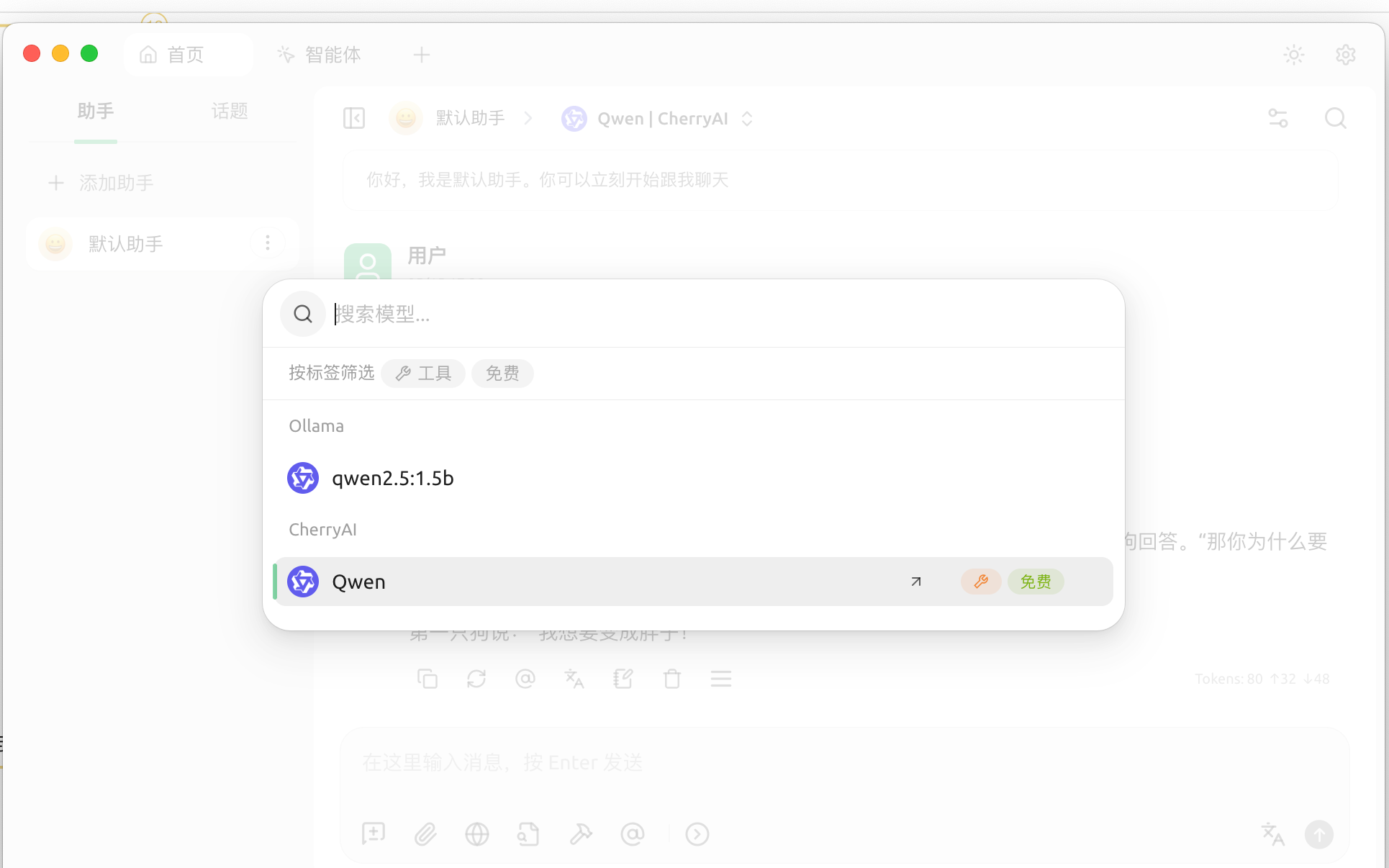

安装可视化工具

1、根据自己的系统进行选择

https://docs.cherry-ai.com/cherry-studio/download

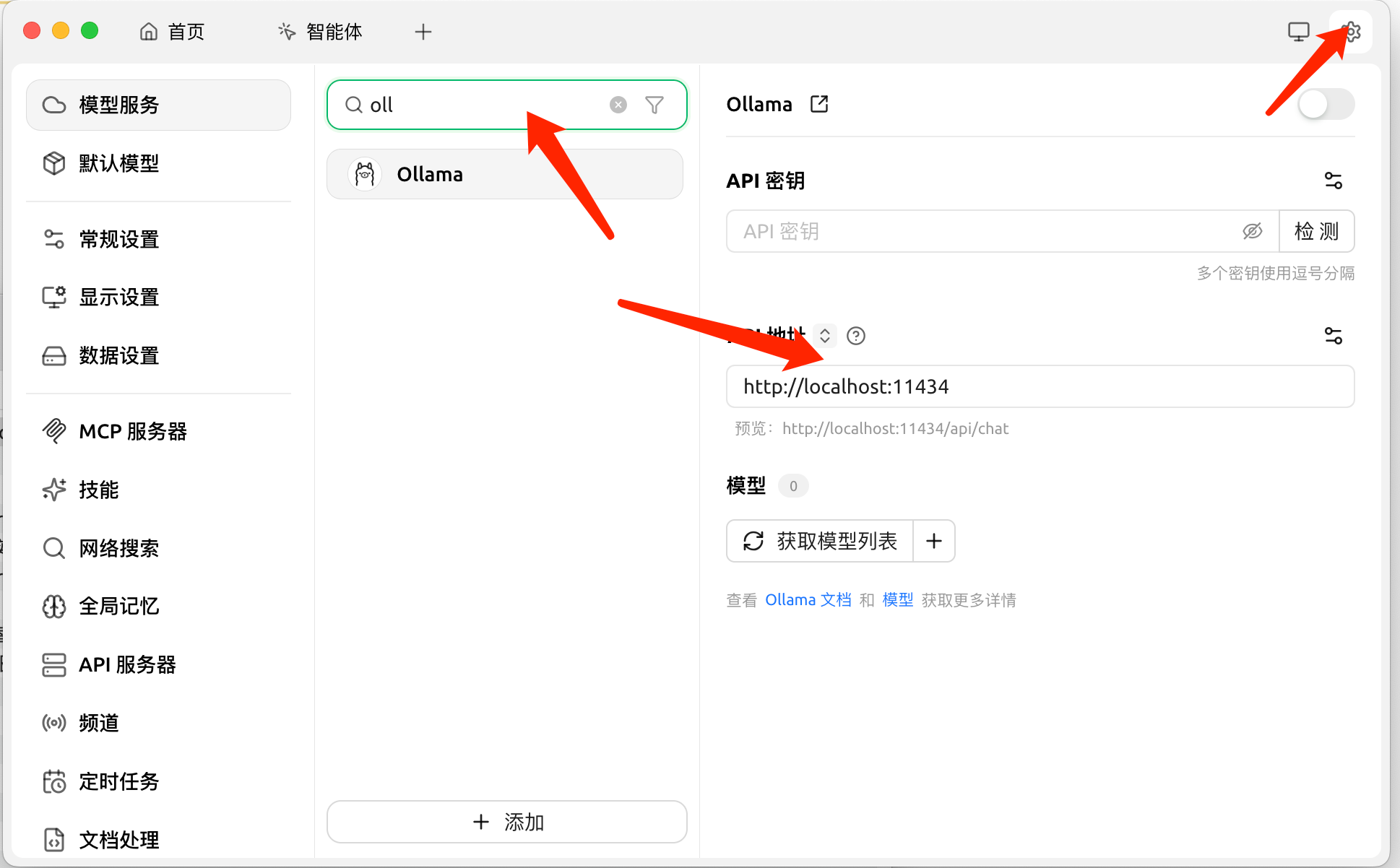

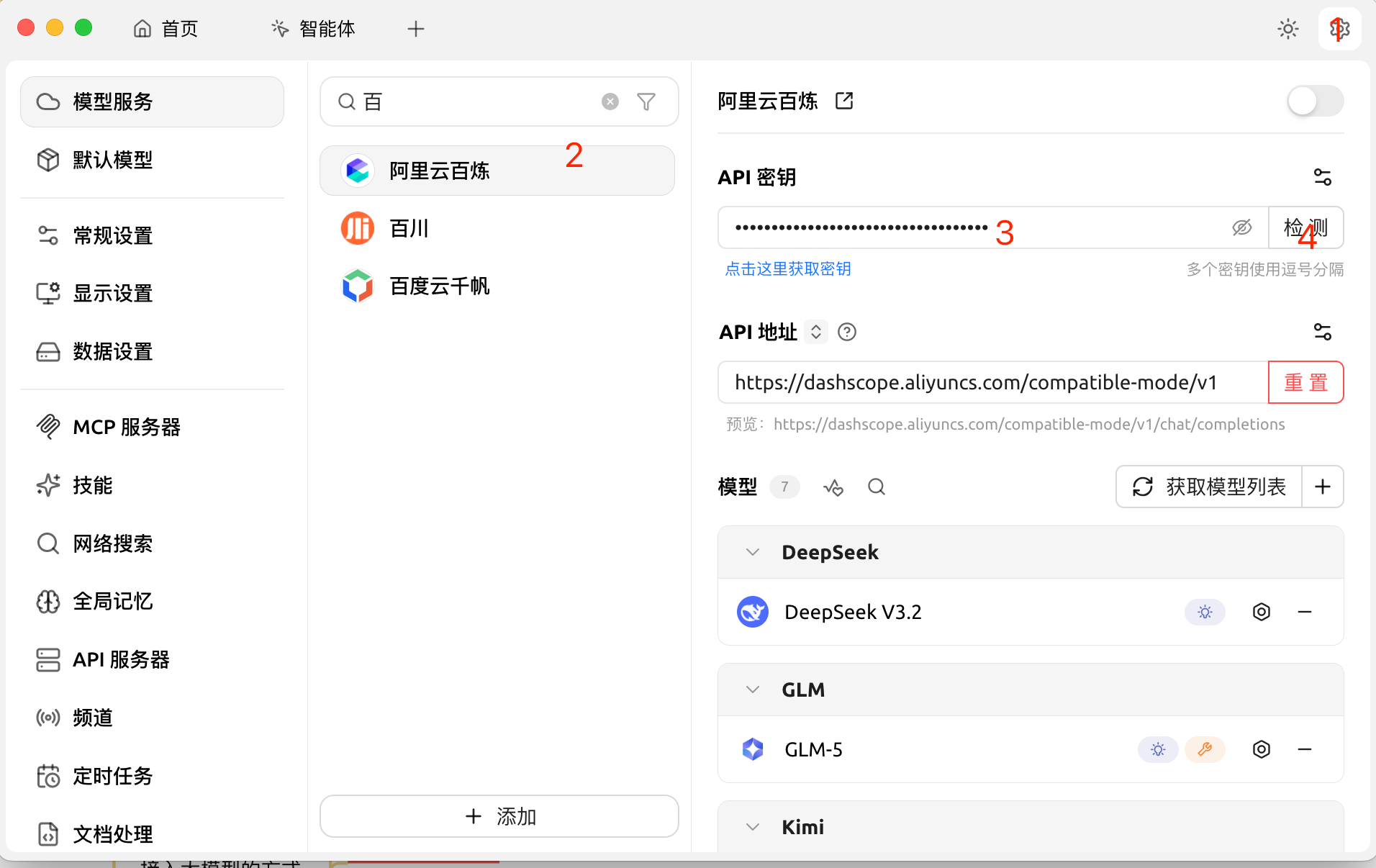

2、安装完成后,进行配置

3、选择获取模型列表,就可以看到自己部署的模型,添加模型

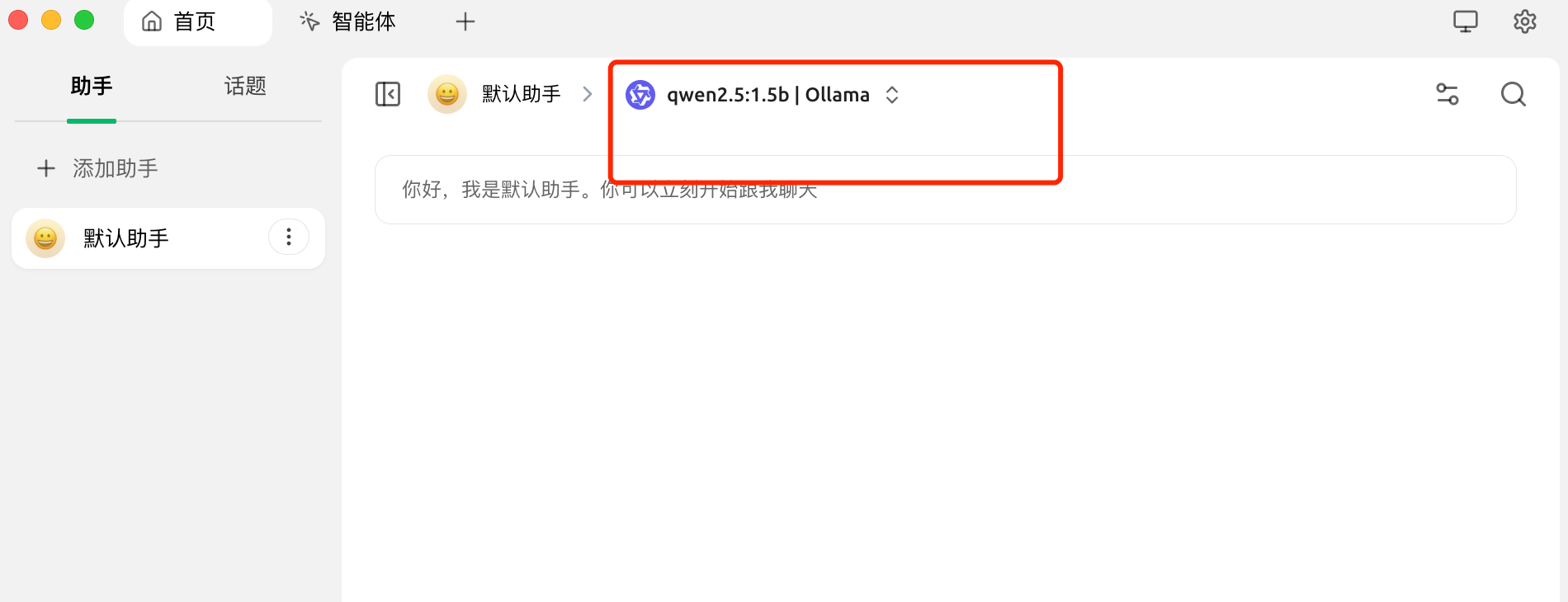

4、添加模型后,就可以在首页进行选择

5、进行对话...

接入云端大模型

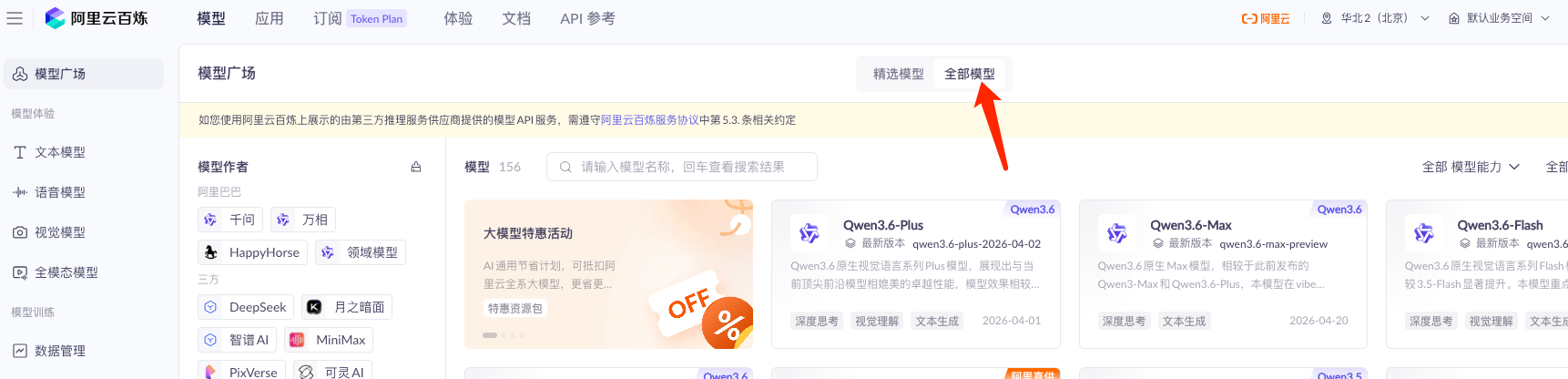

1、使用阿里云百炼,选择模型

https://bailian.console.aliyun.com/cn-beijing#/home

2、进入模型列表,选择自己想要的模型

2、创建自己的API Key

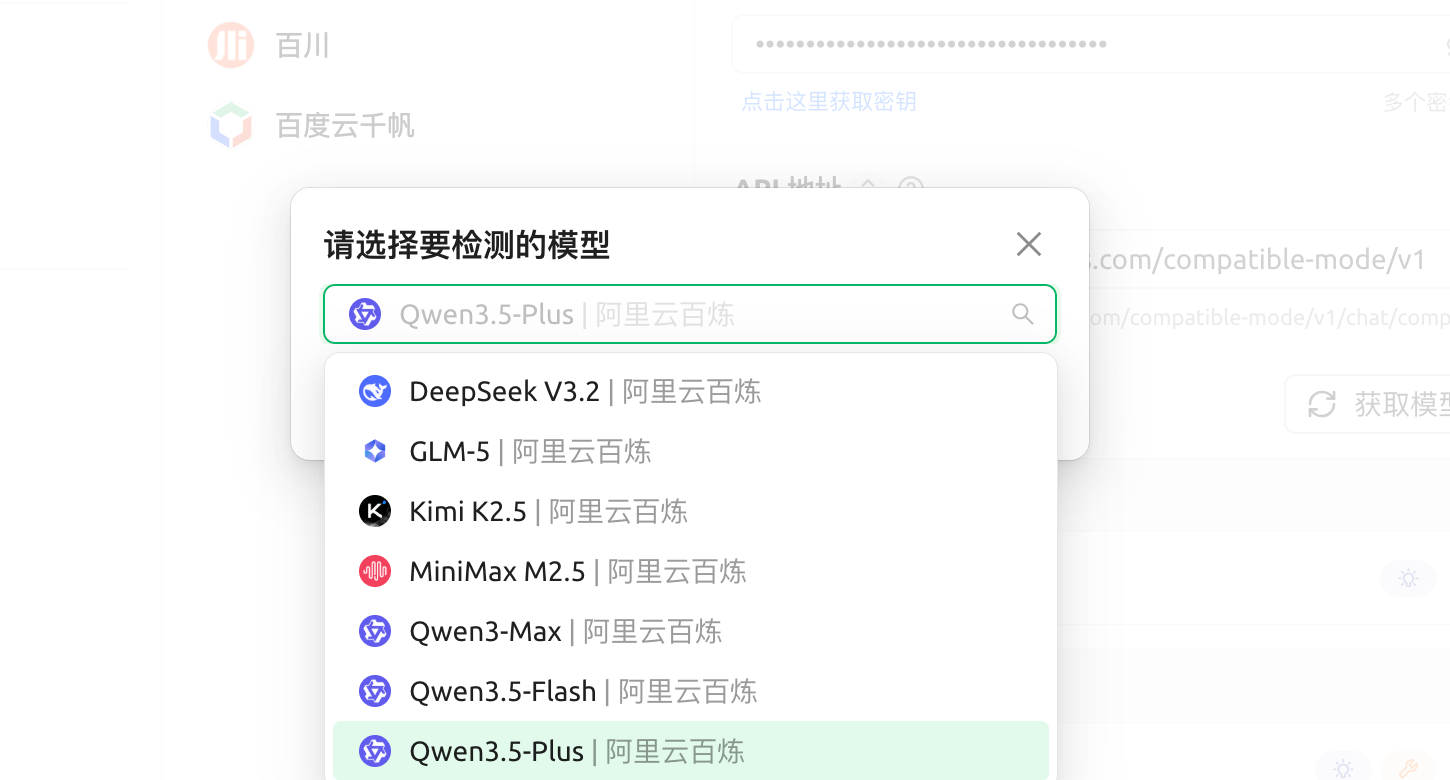

3、将自己的API Key配置到cherry-studio,点击检测选择自己想用的模型

4、在首页选择自己的模型进行对话

安装失败问题,解决方案

1、如果安装失败,出现一下报错,可能是由于超时导致的,可以配置国内镜像

Error: Head "https://registry.ollama.ai/v2/library/deepseek-r1/blobs/sha256:c5ad996bda6eed4df6e3b605a9869647624851ac248209d22fd5e2c0cc1121d3": net/http: TLS handshake timeout

关闭ollama服务:systemctl stop ollama

修改镜像资源:export OLLAMA_REGISTRY_URL=https://registry.cn-hangzhou.aliyuncs.com

重启ollama服务:ollama serve

执行安装命令:ollama run deepseek-r1:7b

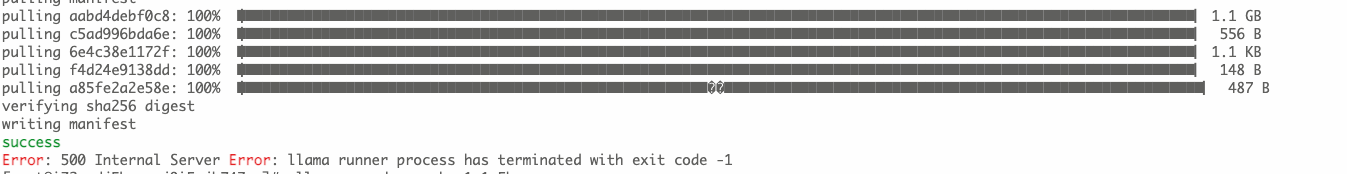

安装成功,但是如下错误,是由于服务器资源(主要是内存)不够

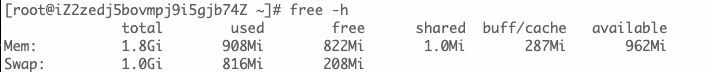

2、可以使用free -h命令,查看服务器资源

3、报错[root@iZ2zedj5bovmpj9i5gjb74Z ~]# ollama run deepseek-r1:1.5b

Error: 500 Internal Server Error: llama runner process has terminated with exit code -1

这个问题,是由于当前服务器上的 Ollama 进程可能已经彻底“僵死”,或者后台残留的旧进程仍在占用着极其有限的内存资源,导致新模型完全无法启动

使用命令(pkill -9 -f ollama)强制清理所有卡死的 Ollama 进程

![]()

4、执行以下两行,设置 Ollama 的极限内存限制,告诉 Ollama:“服务器内存非常紧张,你加载模型时尽量省着点用”

export OLLAMA_NUM_PARALLEL=1

export OLLAMA_MAX_LOADED_MODELS=1

5、重新安装参数量的模型,执行以下安装命令

ollama run deepseek-r1:1.5b

使用云端大模型

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)