第1节:开篇,了解Harness

本文探讨了大模型Agent开发中的核心困境与解决方案。文章指出当前开发模式存在三大失控风险:上下文膨胀导致模型注意力分散、复杂状态机引发的健忘症和死循环、以及安全边界的缺失。针对这些问题,作者提出"Harness工程"理念,将其比作Agent的操作系统,强调通过极简工具集(Read/Write/Edit/Bash)、状态外部化和分层安全机制来构建可靠的生产级Agent。文章主张

Agent Harness 专题 本节:第 1 节 :开篇,了解 Harness 下一节:待更新

开篇引入

先分享一个我几乎每天都会遇到的场景。

当我们尝试用大语言模型写一个具备代码审查能力的 agent 时,IDE 屏幕上往往堆着一大坨第三方框架代码,比如 LangChain、AutoGen;而另一块屏幕上,则是大模型的控制台、日志输出,或者一串看起来“不明觉厉”的调试信息。

这时,我们的开发工作流,往往会变成一场在黑盒与报错之间反复妥协的“补丁游戏”:

-

当我们发现 agent 在读取一个 3000 行的日志文件时,大模型突然抛出 token 限制,于是我们只好去翻框架文档,试图找到一个配置项来截断文本。

-

紧接着,agent 在尝试修复一个编译错误时,又陷入死胡同,连续执行 10 次完全相同的错误命令,毫无察觉地原地打转。于是,我们只能无奈地在系统提示词里补上一句苍白的警告:千万不要进入死循环。

-

更可怕的是,由于你赋予了它本地 Shell 的权限,在某次“幻觉”里,它误解了当前工作路径,竟然尝试执行

rm -rf这样的高危命令。于是,我们又不得不回头重写正则黑名单。

如果你对这些场景感到熟悉,那么你很可能已经碰到了 agent 开发最核心的问题:不是模型不够强,而是承载模型的工程体系太脆弱。

我们离真正的生产力还有多远?

自从大模型 API 开放以来,我们逐渐默认了这种“调包式”的开发模式。

我们乐此不疲地在一层又一层抽象之上继续抽象,用几十行代码跑起一个看似无所不能的 demo,并为此感到兴奋。

但问题是:当我们把这些靠框架拼凑出来的 agent,真正投入长期生产环境时,它们真的可用吗?

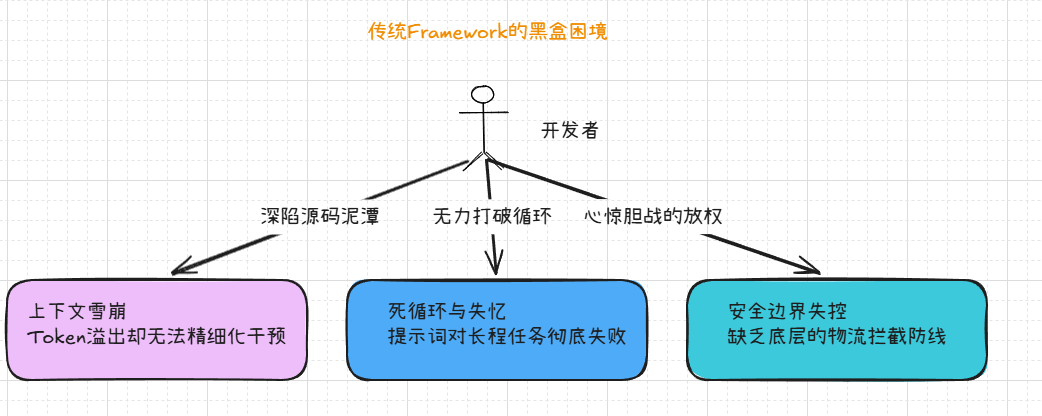

我认为,agent 开发至少面临三种典型的“失控摩擦力”:

-

上下文失控:我们盲目地给模型塞入几十个工具描述,却没有意识到,大模型的注意力会被这些冗长的系统设定严重稀释,最终出现降智与幻觉。

-

状态失控:传统框架在内存中维护着极其复杂的隐式状态机。一旦对话轮数过多,模型就像得了“健忘症”;一旦遇到顽固报错,又容易陷入死循环。而这些状态还被框架封装在黑盒里,人类开发者根本无法在中途介入干预。

-

边界失控:我们既希望 agent 拥有改变物理世界的能力,比如执行代码、修改文件;又缺乏底层的物理拦截机制来约束模型的冲动。一旦越界,就是灾难。

图 1:agent 开发中的三大失控摩擦力

这些摩擦力的存在,让我们意识到一件事:单靠堆砌提示词,或者依赖更高级的应用框架,并不能构建出真正工业级的 agent。

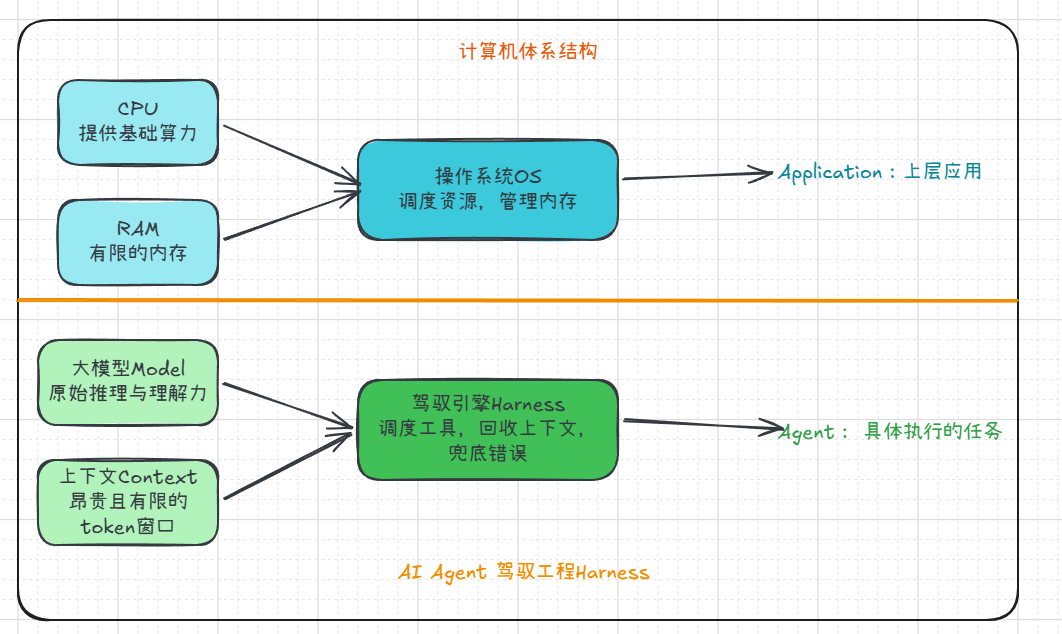

认知重塑:什么是 Harness 工程?

我们不应该只把自己理解成“教模型怎么想”的上层开发者。

更准确地说,我们是在为模型提供一个健壮的物理躯体和生存环境,而这个底层引擎,就是 Harness。

Harness 的本质,是为大模型写一个“微型操作系统”。

在这个操作系统里:

-

大模型相当于

CPU -

上下文窗口相当于稀缺的“内存”

-

本地操作能力相当于“外设”

Harness 不负责替 CPU 思考,但它必须极其严格地管理资源、调度接口、回收上下文,并在必要时随时触发“系统中断”。

换句话说:

大模型决定了智力的上限,而 Harness 工程决定了这套智力在现实系统里究竟能发挥出几成。

图 2:Harness 不是提示词技巧,而是底层工程能力

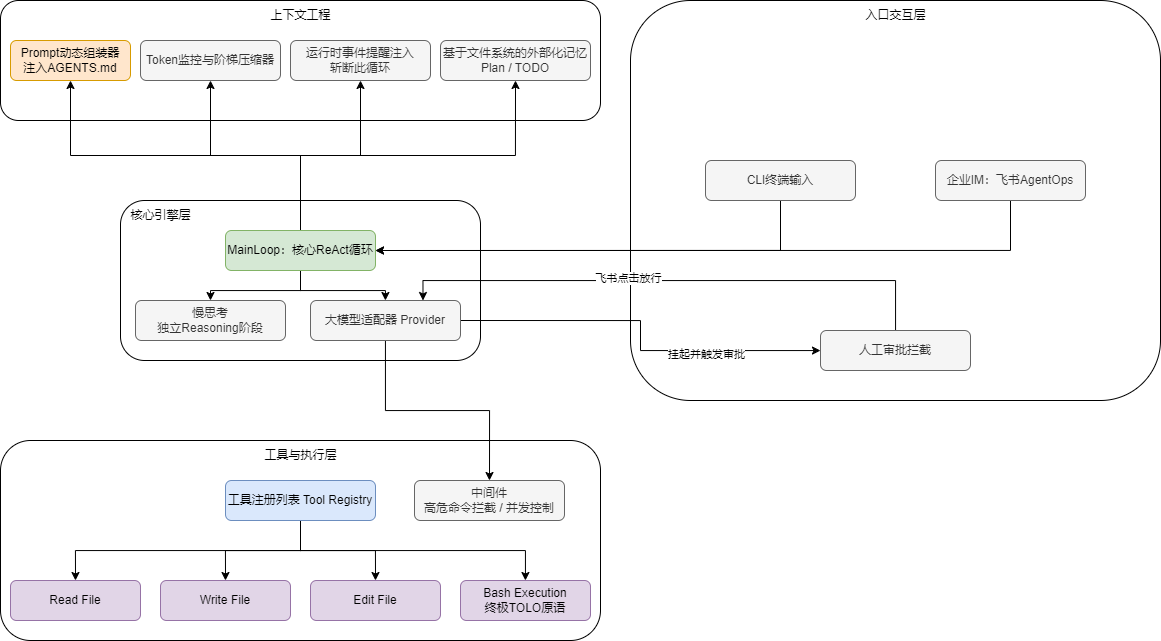

OpenClaw 的极简哲学

如果说很多 agent 框架都在拼命“加法”,那么 OpenClaw 更像是在做“减法”。

它的价值,不在于功能堆得更多,而在于它把问题重新拉回到了正确的工程层次上。

-

极简工具法则 当别人还在疯狂堆叠几十个 API、设计臃肿的 MCP 协议时,它相信大模型本身已经足够聪明,因此只暴露 4 个最基础的原语:

Read、Write、Edit和Bash。只要给模型一个Bash,它就能自己去grep、自己写脚本、自己解决问题。这从根源上消除了工具层带来的上下文膨胀。 -

状态外部化 它放弃了在代码内存中维护复杂隐式状态机的思路,转而强调把 agent 的状态写进工作区的 Markdown 文件里。比如,宏观规划写在

plan.md,微观进度写在todo.md。记忆不再是黑盒,而是人类可以随时打开、审阅,甚至直接修改的纯文本。 -

YOLO 哲学与防御纵深 在本地环境里,它奉行完全信任的 YOLO 模式,让 agent 自由奔跑;但与此同时,它又在底层埋下了足够坚定的安全中间件。当 agent 被部署到远程服务器时,高危命令可以被即时挂起,等待人类审批后再放行。

这三点合在一起,体现的是同一种思想:让模型尽可能自由,让系统尽可能可控。

重新定位开发者的角色

如果你真的想把 agent 带入生产环境,那么开发者的关注点也必须随之变化。

我们需要花更多时间去思考的,不再只是“提示词怎么写”,而是下面这些更底层的问题:

-

如何设计一种像垃圾回收一样的分层压缩或阶梯掩码算法,在不丢失模型意图的前提下,榨干最后一点 token 空间?

-

如何在底层构建一条可靠的安全防线,让大模型在试图执行

rm -rf这类高危命令时被精准拦截? -

如何为引擎建立科学的追踪和自动化体系,用数据证明你的 agent 真的在持续变聪明?

图 3:开发者正在从“提示词工程师”转向“Harness 工程师”

总结

真正决定 agent 能否走向生产环境的,往往不是模型参数,不是提示词技巧,甚至也不是框架数量。

真正关键的,是你是否为它构建了一套稳定、透明、可干预、可约束的 Harness 工程体系。

更多推荐

已为社区贡献35条内容

已为社区贡献35条内容

所有评论(0)