从大模型到 AI Agent:技术原理、架构演进与实战指南

AI Agent:从问答到自主行动 摘要:2024年AI领域正从问答式大语言模型(LLM)向具备自主行动能力的AI Agent演进。AI Agent不仅能回答问题,还能自主规划、调用工具、执行任务,真正实现"一句话全包"的服务模式。其核心由四大模块组成:规划模块(思维链、ReAct推理)、记忆系统(短/长期记忆)、工具库(搜索/API/数据库等)和行动执行模块。架构上正从单智能

前言

2023 年,ChatGPT 让全世界见识了大语言模型(LLM)的威力。彼时,我们与 LLM 的交互方式是问答——输入一段提示词,模型返回一个答案。

但问答,只是 AI 能力的起点。

2024 年开始,一个更激动人心的方向逐渐走到舞台中央:AI Agent(人工智能智能体)。如果说大模型是大脑,Agent 就是给大脑装上了四肢——它能感知环境、制定计划、调用工具、执行行动、反思结果,真正像人一样完成复杂任务。

本文将从技术原理、架构演进、主流框架、实战项目四个维度,系统性地拆解 AI Agent,帮你建立完整的知识体系。

一、什么是 AI Agent?

1.1 直观理解

用一个生活场景来说明:

你让人去旅游,你只说了一句"帮我规划一个七天的云南之旅"。

- 传统 LLM:他给你一份旅游攻略(Plan),但攻略是你自己要去执行的。

- AI Agent:他不仅规划,还自动帮你订机票、订酒店、查天气、设置闹钟、买门票——你只说了一句话,剩下的他全包了。

AI Agent 的核心特征是自主行动(Autonomous Action)。它不只输出文本,它还要改变世界。

1.2 形式化定义

引用 OpenAI 安全团队对 AI Agent 的定义:

An Agent is a system that uses LLM to determine which actions to take and in which sequence, then executes those actions, potentially looping until the goal is achieved.

四个关键词:

| 关键词 | 含义 |

|---|---|

| LLM to determine | LLM 负责推理和决策 |

| which actions | 选择采取哪个行动 |

| in which sequence | 确定行动顺序 |

| execute those actions | 执行行动,与外部环境交互 |

1.3 从"提示词工程"到"Agent 工程"

| 传统 Prompt Engineering | AI Agent | |

|---|---|---|

| 交互模式 | 一次性问答 | 多轮循环、自主决策 |

| 工具调用 | 人工嵌入 Tool 描述 | 模型自主决定何时调用 |

| 错误处理 | 无自动修正 | 自我反思、结果评估 |

| 任务范围 | 单步任务 | 多步复杂任务 |

| 状态管理 | 无状态 | 有 Memory、上下文积累 |

二、AI Agent 的四大核心模块

一个完整的 AI Agent 由以下四个模块组成:

┌─────────────────────────────────────────┐

│ AI Agent │

│ ┌──────────┐ ┌──────────┐ ┌───────┐ │

│ │ Planning │ │ Memory │ │ Tools │ │

│ └────┬─────┘ └────┬─────┘ └───┬───┘ │

│ │ │ │ │

│ └────────────┬┴────────────┘ │

│ ▼ │

│ ┌────────────┐ │

│ │ LLM Core │ │

│ └────────────┘ │

│ │ │

│ ▼ │

│ ┌────────────┐ │

│ │ Action │ │

│ └────────────┘ │

└─────────────────────────────────────────┘

2.1 Planning(规划)

规划是 Agent 的"大脑皮层",决定任务如何分解和执行。

核心技术:

(1)思维链(Chain of Thought, CoT)

在 2022 年 Google 的论文《Chain-of-Thought Prompting Elicits Reasoning in Large Language Models》中被提出。核心思路是让模型显式地输出推理步骤,而非直接给答案。

问题:小明有5个苹果,丢了2个,又买了3个,他现在有多少苹果?

普通回答:6个

CoT 回答:原有5个 → 丢了2个 → 5-2=3个 → 买了3个 → 3+3=6个,他现在有6个苹果。

(2)ReAct(Reason + Act)

由清华大学和 Google 在 2023 年提出,核心思想是让模型在推理(Reason)和行动(Act)之间交替:

Thought: 我需要找出现在有多少苹果。

Action: search(query="小明苹果数量")

Observation: 小明原有5个苹果

Thought: 丢了2个后剩3个,又买了3个

Action: calculate(3+3)

Observation: 6

Final Answer: 6个

ReAct 解决了 CoT 缺乏与外部世界交互的问题,是当前 Agent 最主流的推理范式之一。

(3)自我反思(Self-Reflection)

Agent 执行完一个步骤后,会主动反思:“这个结果合理吗?如果不合理,下一步该怎么做?”

代表工作:Reflexion(Shinn & Lazar, 2023)、Self-Correct(珠江潮声, 2024)。

2.2 Memory(记忆)

Agent 的"记忆系统",分三层:

短期记忆(Working Memory)

└── 本次会话中的上下文,类似人类的即时记忆

长期记忆(Long-Term Memory)

├── 语义记忆:结构化的知识、概念、规则

└── 情景记忆:过往任务的经历和结果

程序记忆(Procedural Memory)

└── Agent 的行为模式、工作流程(SOP)

技术实现:

- 向量数据库(Pinecone / Milvus / Chroma / Qdrant):存储语义相似的历史经验,检索时用 Embedding 相似度匹配

- 摘要压缩:将长对话压缩为关键信息片段,减少 token 消耗

- 结构化存储:用 JSON / SQLite 存储结构化的任务记录

2.3 Tools(工具)

Agent 与外部世界交互的接口。工具让 Agent 突破了"只读文本"的限制,可以操作真实世界。

常见工具类型:

| 类别 | 工具示例 | 用途 |

|---|---|---|

| 搜索 | Google Search、SerpAPI、DuckDuckGo | 获取实时信息 |

| 代码执行 | Python REPL、Code Interpreter | 数据分析、计算 |

| 文件操作 | Read/Write File、PDF Parser | 读取文档、处理数据 |

| API 调用 | HTTP Request、Slack、Email | 与第三方服务集成 |

| 数据库 | SQL Query、Vector DB | 数据存储与检索 |

| 知识库 | RAG、Wikipedia | 领域知识问答 |

| 浏览器 | Web Scraper、Playwright | 网页操作自动化 |

工具调用机制:

当前主流方案有两种:

方案一:Function Calling / Tool Use(结构化)

├── OpenAI GPT-4 Turbo / Claude 3 / 国产模型

├── 模型输出 JSON 格式的函数调用参数

└── 确定性高,接口标准化

方案二:ReAct 风格的文本解析

├── 模型在思考链中输出 Action 和参数

├── 通过 Prompt 解析提取参数

└── 灵活性高,但精度依赖 Prompt 质量

2.4 Action(行动执行)

将决策转化为实际动作的模块。常见模式:

| 模式 | 说明 | 代表框架 |

|---|---|---|

| Single Action | 每次只执行一个动作 | 简单 Tool Use |

| Sequential | 按顺序执行多个动作 | 链式调用 |

| Parallel | 同时执行多个不相关的动作 | 效率优化 |

| Conditional | 根据条件选择执行路径 | 决策树逻辑 |

| Loop/Iterative | 循环直到达成目标 | ReAct 循环 |

三、AI Agent 架构演进:从单智能体到多智能体

3.1 单智能体(Single Agent)

只有一个 Agent 负责所有任务。架构最简单,适合封闭型任务。

代表项目: AutoGPT、BabyAGI

用户输入

│

▼

┌─────────────────┐

│ LLM Core │ ← 单一 Agent,大包大揽

│ (Planning+Tool) │

└────────┬────────┘

│

▼

执行 → 反馈 → 反思 → 再执行

缺点: 随着任务复杂度增加,Agent 的上下文被大量无关信息污染,推理质量下降(“context overflow”)。

3.2 多智能体协作(Multi-Agent Collaboration)

多个 Agent 分工协作,各司其职。2024 年最热门的架构方向。

代表项目: CrewAI、LangGraph AutoGen、MetaGPT

用户输入

│

▼

┌──────────────────────────────────────────┐

│ Orchestrator(编排器) │

│ 负责任务分解和结果汇总 │

└────────┬─────────────────┬───────────────┘

│ │

▼ ▼

┌────────────┐ ┌────────────┐

│ Agent A │ │ Agent B │

│ (研究分析) │ │ (代码执行) │

└─────┬──────┘ └──────┬─────┘

│ │

▼ ▼

┌────────────┐ ┌────────────┐

│ (工具调用) │ │ (工具调用) │

└────────────┘ └────────────┘

│ │

└────────┬─────────┘

▼

结果汇总 → 输出

CrewAI 核心概念:

- Agent:角色定义(角色名 + 角色描述 + 目标 + 背景故事)

- Task:具体任务描述 + 预期输出格式

- Crew:Agent + Task 的编排容器,定义执行顺序和协作方式

- Process:执行模式(Sequential 顺序 / Hierarchical 层级 / Consensual 共识)

3.3 层级式 Agent(Hierarchical Agent)

类似企业的管理层级,高层 Agent 负责规划,子 Agent 负责执行。

适合大规模、分布式复杂任务,是未来 Agent 架构的重要方向。

四、主流 AI Agent 框架对比

| 框架 | 开发语言 | 定位 | 上手难度 | 适用场景 | GitHub Stars |

|---|---|---|---|---|---|

| LangChain | Python/JS | 全栈 LLM 开发框架(含 Agent 模块) | ⭐⭐⭐⭐ 中高 | 复杂生产项目 | 65k+ ⭐ |

| LangGraph | Python | 构建有状态、多步骤的 LLM 应用 | ⭐⭐⭐⭐ 中高 | Agent 工作流、复杂逻辑 | 15k+ ⭐ |

| CrewAI | Python | 多智能体协作框架 | ⭐⭐ 简单 | 多 Agent 协作任务 | 25k+ ⭐ |

| AutoGPT | Python | 自主 Agent 实验项目 | ⭐⭐ 简单 | 单 Agent 自主探索 | 130k+ ⭐ |

| Dify | TypeScript/Go | 低代码/可视化 Agent 平台 | ⭐ 极简单 | 非工程师快速搭建 | 30k+ ⭐ |

| Coze | 云服务 | 字节跳动 AI 应用平台 | ⭐ 极简单 | 快速发布 Bot | — |

| AutoGen | Python | 微软多智能体协作框架 | ⭐⭐⭐ 中 | 复杂多 Agent 场景 | 30k+ ⭐ |

选型建议:

- 快速原型 / 非工程师 → Dify、Coze

- 多 Agent 协作项目 → CrewAI(简洁)或 AutoGen(灵活)

- 复杂有状态工作流 → LangGraph

- 企业级生产项目 → LangChain + LangGraph 组合

五、实战项目:从零搭建一个"技术博客助手"Agent

5.1 项目需求

我们用 CrewAI 搭建一个技术博客写作团队 Agent:

- Research Agent:负责搜集相关技术资料和最新动态

- Writer Agent:负责撰写博客正文

- Editor Agent:负责审阅、润色和提出修改意见

5.2 环境准备

# Python 3.10+

pip install crewai crewai-tools langchain-openai

5.3 完整代码

from crewai import Agent, Task, Crew

from crewai_tools import SerperDevTool, DirectoryReadTool

import os

# 设置 API Key(请替换为你的实际 Key)

os.environ["OPENAI_API_KEY"] = "your-openai-api-key"

os.environ["SERPER_API_KEY"] = "your-serper-api-key"

# ─────────────────────────────────────────────

# 定义工具

# ─────────────────────────────────────────────

search_tool = SerperDevTool() # 搜索引擎工具

read_tool = DirectoryReadTool(directory="./blogs") # 读取本地素材

# ─────────────────────────────────────────────

# 创建 Agent

# ─────────────────────────────────────────────

researcher = Agent(

role="技术研究员",

goal="深入调研 {topic} 领域的技术原理、最新进展和行业趋势",

backstory=(

"你是一位有着十年经验的技术研究员,擅长从海量信息中"

"提炼关键洞察,对新兴技术有敏锐的嗅觉。"

),

tools=[search_tool, read_tool],

verbose=True,

)

writer = Agent(

role="技术博客作者",

goal="将研究成果转化为结构清晰、内容深刻的技术博客文章",

backstory=(

"你是一位知名的技术博主,文字功底扎实,善于用通俗的语言"

"解释复杂的技术概念,读者遍布全球。"

),

tools=[search_tool],

verbose=True,

)

editor = Agent(

role="首席编辑",

goal="确保博客内容准确、专业、可读性极强",

backstory=(

"你是一位严苛但友善的首席编辑,曾任职于顶级科技媒体,"

"你的修改意见以精准著称。"

),

tools=[search_tool],

verbose=True,

)

# ─────────────────────────────────────────────

# 定义任务

# ─────────────────────────────────────────────

research_task = Task(

description=(

"深度调研 {topic} 领域,重点关注:"

"1) 核心技术原理 2) 最新技术进展(2024-2026)"

"3) 主流框架和工具 4) 实际应用场景"

),

agent=researcher,

expected_output="一份结构化的技术调研报告,包含核心知识点和引用来源",

)

writing_task = Task(

description=(

"基于调研报告,撰写一篇 3000 字以上的技术博客,"

"结构:引言 → 原理 → 实战 → 总结,包含代码示例。"

),

agent=writer,

context=[research_task], # 接收上游任务输出作为上下文

expected_output="一篇完整的 Markdown 格式技术博客文章",

)

editing_task = Task(

description=(

"审阅博客全文,检查:"

"1) 技术准确性 2) 逻辑连贯性 3) 表达清晰度 4) 代码正确性"

),

agent=editor,

context=[writing_task],

expected_output="修改建议清单 + 润色后的最终版本",

)

# ─────────────────────────────────────────────

# 组队 & 执行

# ─────────────────────────────────────────────

crew = Crew(

agents=[researcher, writer, editor],

tasks=[research_task, writing_task, editing_task],

process="sequential", # 顺序执行:调研 → 写作 → 审阅

verbose=True,

)

# 启动!输入你想写的博客主题

result = crew.kickoff(inputs={"topic": "AI Agent 技术原理与实战"})

print(result)

5.4 运行效果

🎯 启动 Crew:技术博客写作团队

[Step 1/3] 📊 研究员 Agent 正在工作...

→ 搜索 AI Agent 最新进展...

→ 阅读本地素材...

→ 整理调研报告 ✓

[Step 2/3] ✍️ 作者 Agent 正在工作...

→ 阅读调研报告...

→ 撰写博客正文...

→ 输出 Markdown 文章 ✓

[Step 3/3] 🔍 编辑 Agent 正在工作...

→ 审阅全文...

→ 标记问题点...

→ 输出润色版本 ✓

✅ 任务完成!博客已保存至 ./output/blog_final.md

CrewAI 的魅力在于:你只需要定义"谁做什么",框架自动处理 Agent 之间的通信和数据流转。

六、AI Agent 的挑战与局限

尽管 AI Agent 前景光明,当前阶段仍有显著挑战:

6.1 可靠性问题

- 错误累积:多步执行中,某一步出错会导致后续步骤全部跑偏(“Error Cascade”)

- 幻觉问题:Agent 在工具返回错误时可能捏造结果

- 边界模糊:Agent 可能错误地认为任务已完成而过早退出

6.2 成本问题

- 每次工具调用都消耗 token,多步任务的成本远超单次问答

- Agent 的循环特性可能导致无限调用(需设置 max_iterations)

6.3 安全性问题

- Prompt Injection:恶意用户通过输入诱导 Agent 执行非预期操作

- 权限控制:Agent 调用工具时需要严格限定权限范围

- 数据泄漏:Agent 在多步推理中可能无意中暴露敏感信息

6.4 评估难题

- 如何评估一个 Agent 好不好?当前缺乏统一、客观的 benchmark

- 传统 NLP 的 BLEU / ROUGE 指标不适用于 Agent 任务评估

七、未来展望

7.1 短期趋势(2026-2027)

- MCP 协议生态爆发:Anthropic 的 MCP(Model Context Protocol)正在成为 Agent 工具调用的事实标准,类似"AI 时代的 USB 接口"

- Agent 平价化:Dify、Coze 等低代码平台让非工程师也能构建 Agent

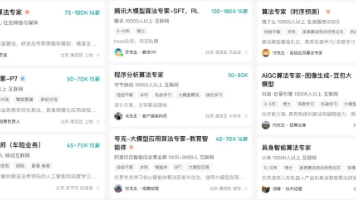

- 垂直领域 Agent:法律 Agent、医疗 Agent、金融 Agent 等专业化方向快速落地

7.2 长期愿景

- 具身智能(Embodied AI):Agent 与物理世界结合(机器人、自动驾驶)

- 多模态 Agent:处理文本、图像、视频、音频、3D 的全能 Agent

- 自主科研 Agent:AlphaFold 式的 AI 科学家,Agent 自主设计实验、分析结果、迭代假设

八、结语

AI Agent 正在重新定义人类与 AI 的关系。

从"你问我答"到"你说我做",AI Agent 代表了人工智能从工具到助手、从被动响应到主动执行的关键跃迁。

但我们也要清醒地看到:当前 Agent 的可靠性、成本控制、安全边界等问题仍未得到根本解决。2026-2027 年,是 Agent 从"Demo"走向"Production"的关键窗口期。

行动建议:

- 动手实践:用 CrewAI / LangGraph 搭一个自己的 Agent

- 深入原理:精读 ReAct、LangChain、CrewAI 的源码

- 关注生态:跟进 MCP、Agent Protocol 等行业标准

- 场景落地:找到你工作/业务中最适合 Agent 化的那个环节

AI 不会取代你,但会用 AI 的人会取代你。

愿你成为那个"会用 AI"的人。 🚀

参考资料

- Wei et al. “Chain-of-Thought Prompting Elicits Reasoning in Large Language Models” (NeurIPS, 2022)

- Yao et al. “ReAct: Synergizing Reasoning and Acting in Language Models” (ICLR, 2023)

- Shinn & Lazar. “Reflexion: Language Agents with Verbal Reinforcement Learning” (NeurIPS, 2023)

- Anthropic. “Model Context Protocol (MCP)” — https://modelcontextprotocol.io

- CrewAI Official Documentation — https://docs.crewai.com

- LangGraph Documentation — https://langchain-ai.github.io/langgraph/

- OpenAI. “GPT-4o System Card” (2024)

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)