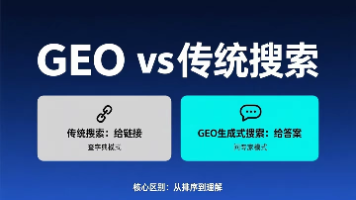

今天 AI 工具圈变天了:模型、Agent 平台和开源推理栈正在同时加速

这篇文章从效率创作者、一人公司和自动化实践者视角,梳理模型、Agent 平台、AI 基础设施与开源推理栈的最新变化,并分析它们如何进入内容生产、代码开发和日常自动化工作流。

配图:今天的重点不是单点模型新闻,而是模型、Agent 平台和开源推理栈一起推动工作流变化。

写在前面:这不是一篇单纯的 AI 新闻搬运,而是面向效率创作者、一人公司和自动化实践者的一份工作流观察。重点不是“又出了什么模型”,而是这些变化会怎样进入我们的内容生产、代码开发、资料整理和自动化系统。

今日主线

过去一段时间,AI 新闻的密度仍然很高,但真正值得关注的主线很清楚:

- 模型能力继续迭代:大模型不只是更会聊天,而是在 coding agent、长任务、工具调用等场景里继续前推;

- Agent 平台开始体系化:企业级 Agent 不再只是 Demo,而是在补权限、治理、评估、编排这些基础设施;

- 推理基础设施加速升级:TPU、vLLM、Transformers、Ollama、llama.cpp 等底层能力决定了 AI 工具能不能稳定落地;

- 端侧与多模态继续靠近真实设备:机器人、边缘 AI、智能硬件会越来越依赖本地低延迟推理。

如果你不是专门追热点的媒体,而是想把 AI 用到日常生产、自动化和一人公司工作流里,今天这几条更值得看。

配图:对效率创作者来说,AI 新闻的价值在于能否进入“信息发现 → 价值判断 → 自动化执行 → 结果分发”的闭环。

一句话总览

| 方向 | 代表事件 | 对工作流的影响 |

|---|---|---|

| 大模型 | OpenAI 新模型与配套文档更新 | 让内容生成、代码审查、资料整理等流程更容易标准化 |

| 企业 Agent | Gemini Enterprise Agent Platform | Agent 从演示走向治理、评估、编排和生产系统 |

| 基础设施 | Google 新 TPU / agentic era | 长链路推理、多步骤工具调用的成本和速度会被重塑 |

| AI 经济影响 | Anthropic 8.1 万人调研 | AI 不只是工具变化,也会改变岗位分工和技能结构 |

| 端侧多模态 | Gemma 4 VLA / Jetson 演示 | 多模态能力继续向机器人、智能硬件和边缘设备靠近 |

| 开源推理栈 | vLLM、Transformers、Ollama、llama.cpp | 开发者可以更低成本搭建自己的 AI 工具链 |

1. OpenAI:模型能力继续前推,配套机制也在补齐

今天最受关注的主线之一,是 OpenAI 新模型与相关文档的更新。

从工具使用者视角看,模型名本身不是唯一重点。更关键的是:

- 模型能力升级后,是否能稳定接入现有工作流;

- system card、安全说明、漏洞奖励等配套机制是否完整;

- Codex / coding agent 相关能力是否能从“辅助写代码”走向“稳定完成任务”。

对一人公司或小团队来说,真正有价值的不是每天手动切换、试用各种模型,而是把模型能力沉淀成可复用流程,例如:

- 内容选题、资料归纳、初稿生成;

- 代码审查、脚本编写、自动化运维;

- 运营素材改写、多平台分发;

- 个人知识库和项目文档更新。

我的判断:后续竞争不会只停留在“哪个模型更强”,而是“谁能把模型能力稳定接进工作流”。

2. Google Cloud:企业 Agent 平台化是一个重要信号

Google Cloud 推出的 Gemini Enterprise Agent Platform,值得关注的地方不只是“又一个 Agent 产品”。

它反映了一个趋势:Agent 正在从单点演示,进入企业级的构建、治理、评估和优化阶段。

过去很多 Agent Demo 看起来很炫,但落到真实业务里会遇到几个问题:

- 谁来管理权限和数据边界?

- 如何评估 Agent 的执行质量?

- 多个 Agent / 工具链之间怎么编排?

- 出错时如何追踪、回滚和复盘?

如果这些问题不解决,Agent 很难从“演示能力”变成“生产力系统”。所以企业 Agent 平台化,本质上是在补这块基础设施。

3. Google TPU 更新:AI 基础设施进入 agentic era

Google 继续加码 AI 基础设施,发布面向 agentic era 的新 TPU,并解释 TPU 如何承载更重的 AI 工作负载。

这件事对普通开发者的直接感知可能没那么强,但它影响的是 AI 产品背后的成本、速度和可用性。

未来 Agent 类应用会带来更多:

- 长链路推理;

- 多步骤工具调用;

- 持续上下文处理;

- 规划、执行、观察、修正的循环。

模型不再只是回答一次问题,而是要反复完成任务。这意味着底层算力和推理基础设施会变得更关键。

4. Anthropic:8.1 万人调研提醒我们,AI 的问题不只是技术

Anthropic 发布了基于 81,000 人调研 的经济议题分析,聚焦用户对 AI 在工作、收入、风险和机会上的期待与担忧。

这类内容值得放在技术新闻里一起看,因为 AI 工具真正进入工作流之后,影响的不只是效率,还有岗位分工、技能结构和收入预期。

对个人而言,更现实的问题是:

- 哪些重复性任务会被自动化压缩?

- 哪些能力会因为 AI 变得更值钱?

- 我们是否能把 AI 用成杠杆,而不是被工具节奏牵着走?

我的判断是:接下来真正重要的能力,不只是“会用某个 AI 产品”,而是能把 AI 接进自己的工作流程,让它稳定承担重复判断和重复执行。

5. 端侧与机器人:多模态正在靠近设备端

Hugging Face / NVIDIA 关于 Gemma 4 VLA 在 Jetson Orin Nano Super 上的演示,代表的是另一条趋势:多模态模型能力正在继续向端侧、机器人和嵌入式设备靠近。

这类进展短期内可能不会直接改变普通办公软件,但对机器人、工业场景、智能硬件和边缘 AI 很重要。

原因很简单:不是所有任务都适合把数据传到云端处理。端侧模型如果能更好地理解图像、动作、语言和环境,就会带来更多低延迟、低成本、隐私友好的应用。

6. 开源推理栈:真正的落地能力在这里

今天还有一条容易被普通用户忽略、但对开发者很重要的主线:开源推理栈持续更新。

包括 vLLM、Transformers、Ollama、llama.cpp 等项目都在继续推进。

配图:开源推理栈的价值不是单个项目名字,而是这些层能否稳定接入自己的生产流程。

这些工具不像大模型发布会那么吸睛,但它们决定了很多实际问题:

- 本地模型能不能跑得动;

- 推理吞吐和延迟能否接受;

- 新模型格式和量化方案能否及时支持;

- 开发者能不能用更低成本搭建自己的 AI 工具链。

对自动化和一人公司场景来说,开源推理栈的价值在于:你不一定每一步都依赖云端闭源 API,也可以逐步把部分能力放到本地或私有环境里。

给效率创作者的 4 个行动建议

如果你正在做内容、开发、运营、自动化或者一人公司,我更建议把关注点从“哪个模型又更新了”转向下面这 4 个问题:

-

哪些任务可以被标准化?

比如信息收集、内容摘要、脚本初稿、日报生成、评论区整理。 -

哪些流程可以让 AI 稳定接手一部分?

不要只追求一次性惊艳,而是追求每天都能稳定减少 30 分钟重复劳动。 -

哪些工具值得接进自己的默认工作流?

例如浏览器自动化、代码代理、语音合成、视频渲染、跨平台发布。 -

哪些信息只是热点,哪些才会改变实际效率?

热点很多,但真正值得跟进的是能进入工作流、降低成本、提升稳定性的变化。

我的结论

今天这些新闻放在一起看,其实指向同一件事:

AI 工具圈正在从“单点能力展示”,进入“系统化落地”的阶段。

大模型继续变强,企业 Agent 平台开始成熟,基础设施不断升级,开源推理栈也在补齐能力。

但对个人和小团队来说,最关键的问题仍然是:

这些变化能不能帮我减少重复判断、减少重复执行,把注意力留给真正重要的事?

AI 的真正价值,不是让人每天追更多新闻,而是让系统帮你减少重复劳动。

本文是 2026-04-24 AI / LLM / 开源工具链观察,重点关注模型更新、企业 Agent、AI 基础设施、端侧多模态和开源推理栈。

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)