Qwen3.6模型vLLM vs SGLang部署指南与性能表现(上)

Qwen 团队最新开源稠密多模态模型,在智能体编程任务上直接超过了前代。在 SWE-bench、Terminal-Bench 等一系列基准中,它以更小的参数规模,让“模型规模与能力线性增长”的经验不断被打破。从工程视角看,27B 稠密模型的规格既没有 MoE 架构的路由与调度复杂度,也没有超大模型那种多机分片带来的部署负担,但又足够强大,可以。这使得它天然适合作为一个“”,进入真实生产环境。本文将

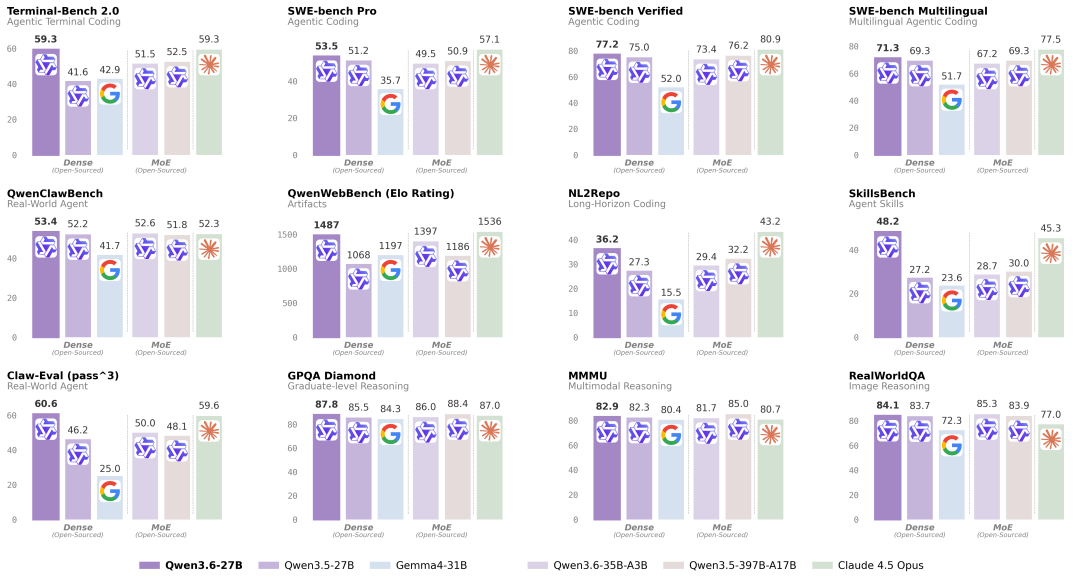

Qwen 团队最新开源 Qwen3.6-27B 稠密多模态模型,在智能体编程任务上直接超过了前代 Qwen3.5-397B-A17B。在 SWE-bench、Terminal-Bench 等一系列基准中,它以更小的参数规模大幅完成了对更大模型的超越,让“模型规模与能力线性增长”的经验不断被打破。

从工程视角看,27B 稠密模型的规格既没有 MoE 架构的路由与调度复杂度,也没有超大模型那种多机分片带来的部署负担,但又足够强大,可以稳定承载高质量的代码生成、推理与多模态能力。这使得它天然适合作为一个“易于部署的旗舰模型规格”,进入真实生产环境。

本文将以 GPUStack 为统一部署管理入口,分别使用 vLLM 和 SGLang 对 Qwen3.6-27B 进行部署,提供完整部署测试流程,包括环境准备、模型加载、启动参数配置以及基准压测,对两种推理后端的实际表现做一轮对比,作为一份可以直接复现的部署实践参考。

GPUStack 安装与集群初始化

GPUStack 是一个开源 GPU 集群管理与 AI 模型服务平台,旨在高效部署 AI 模型。它可以配置并编排多种推理引擎——如 vLLM、SGLang、TensorRT-LLM,甚至自定义引擎——以在 GPU 集群上实现最佳性能。核心功能包括多 GPU 集群管理、可插拔推理引擎架构、Day 0 模型支持、性能优化配置(低延迟/高吞吐)、以及企业级运维能力,如故障恢复、负载均衡、监控与权限管理。

GPUStack 可以帮助我们高效地管理 vLLM、SGLang 等推理引擎,并推动模型从部署走向企业生产落地运营。在开始部署 Qwen3.6 之前,首先完成 GPUStack 控制面的安装,并将 NVIDIA GPU 节点纳入管理。

准备容器环境

GPUStack 以容器方式运行,因此需要提前准备好容器运行环境(如 Docker、Podman 或 Kubernetes)。本文以 Docker 为例进行说明。

在各节点上安装 Docker,确保服务已正常启动:docker info

启动 GPUStack Server

GPUStack Server 无需依赖 GPU,可运行在普通 CPU 节点上,也可运行在 GPU 节点。本文以两台双卡 NVIDIA 4090 48G 节点为实验环境,在该节点上启动 GPUStack Server 容器:

sudo docker run -d --name gpustack \

--restart unless-stopped \

-p 80:80 \

--volume gpustack-data:/var/lib/gpustack \

swr.cn-south-1.myhuaweicloud.com/gpustack/gpustack:v2.1.2 \

--debug --bootstrap-password GPUStack@123

容器启动后,可以通过日志确认服务是否正常运行:docker logs -f gpustack

访问控制台并初始化

打开浏览器访问:http://<Server 主机 IP>:80

使用默认账号登录:

用户名:admin

密码:GPUStack@123

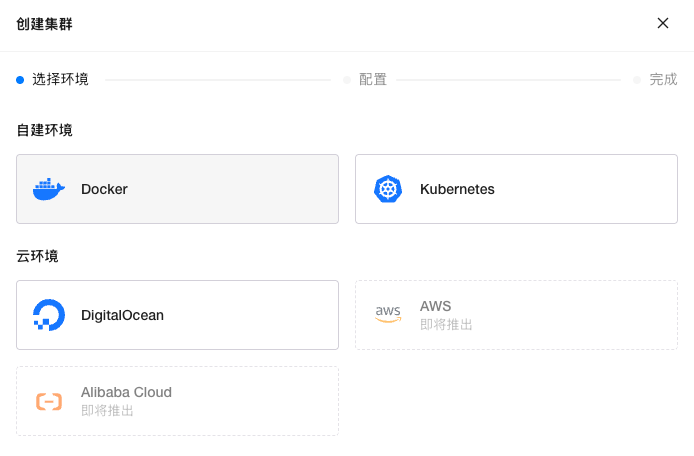

登录后,首先创建一个 Docker 类型的集群,用于统一管理后续接入的 GPU 节点。

添加 NVIDIA GPU Worker 节点

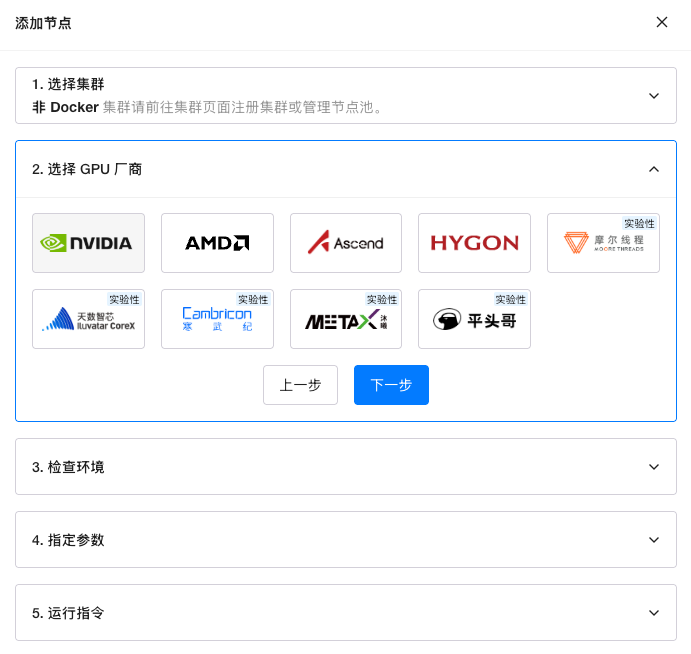

在集群创建完成后,可以接入 NVIDIA GPU 节点。

在添加节点之前,先完成基础环境检查。

(1)驱动版本检查

在目标节点上执行以下命令:nvidia-smi

(2)Nvidia Container Toolkit 检查

执行以下命令检查 Docker 是否正确配置了 Nvidia Container Toolkit:sudo docker info 2>/dev/null | grep -q "Runtime.*nvidia" && echo "Nvidia Container Toolkit OK" || (echo "Nvidia Container Toolkit not configured"; exit 1)

(3)接入 Worker 节点

在 GPUStack 控制台中,选择添加节点(Worker),并复制系统生成的接入命令,在目标节点执行。

该命令本质上会启动一个 Worker 容器,并自动注册到 Server。

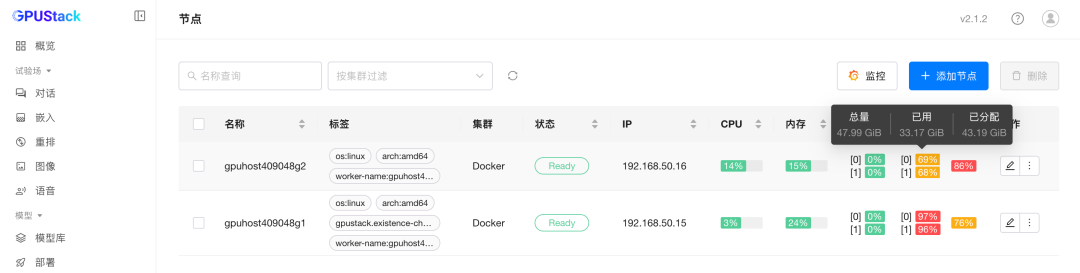

(4)验证 Worker 状态

节点接入后,可以在节点上查看容器日志:docker logs -f gpustack

同时,在 GPUStack 控制台中也可以看到节点状态是否为 Ready。

至此,GPUStack 的控制面已成功部署,NVIDIA GPU 节点也顺利接入集群,并能够正常采集 GPU 名称、索引、厂商信息、温度、利用率及显存使用等指标。接下来即可在该环境中部署具体的推理服务。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)