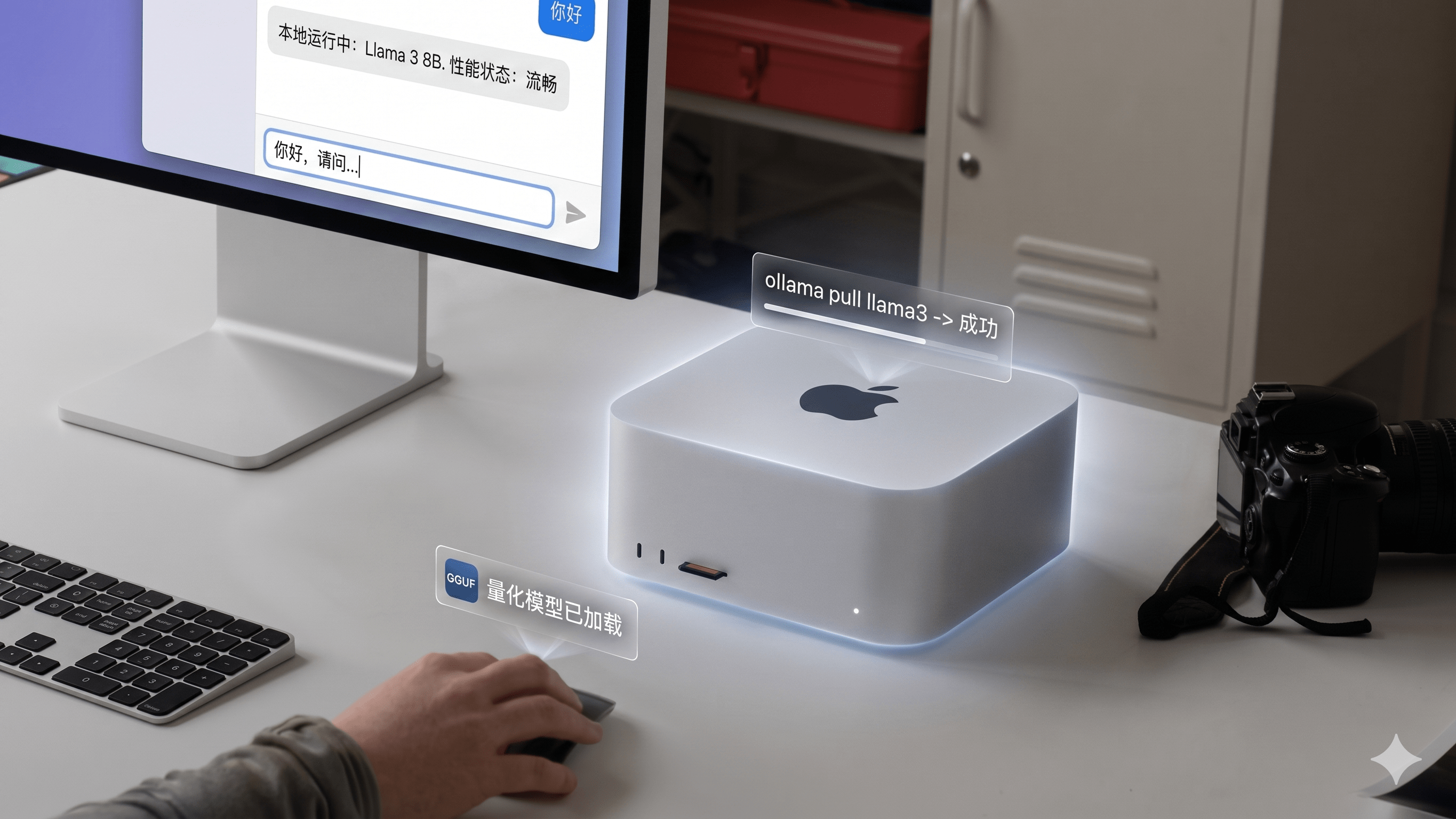

Mac本地搭建AI大模型,2026年6款主流推理工具深度对比

硬件基准:Mac Studio · Apple M4 Max · 128GB 统一内存 · 40核GPU。

JEECG低代码 AI编程研究 | 硬件基准:Mac Studio · Apple M4 Max · 128GB 统一内存 · 40核GPU

为什么要选对工具?

同样的模型,不同的推理引擎,性能差距可以达到数百倍。Apple Silicon 的统一内存架构天然适合大模型推理,128GB 的 M4 Max 可以轻松运行 70B 甚至 122B 参数的模型——但工具选错了,这些硬件优势会白白浪费。

本文对目前 macOS 上最主流的五款工具按性能从高到低排序,并给出针对 M4 Max 128GB 的具体推荐。

| 维度 | LM Studio | vMLX | oMLX | Ollama | vLLM |

|---|---|---|---|---|---|

| 定位 | 桌面 GUI | Mac 全功能推理引擎 | Mac Agent 专属优化 | 模型管理+服务 | 生产级高并发 |

| 平台 | 全平台 | Apple Silicon | Apple Silicon (macOS 15+) | 全平台 | 主要 NVIDIA |

| 底层 | llama.cpp | Apple MLX | Apple MLX | llama.cpp | 自研 |

| GUI | ✅ 完整 | ✅ 原生 macOS | ✅ Menu Bar + Dashboard | CLI 为主 | ❌ |

| KV Cache | 单槽内存 | 5 层缓存栈 | SSD 持久化分页缓存 | ❌ 无 | PagedAttention |

| 最大并发 | 1 | 256 | 8×(4.14× 加速) | 有限 | 极高 |

| TTFT(长 context) | 慢(90s+) | 快 | <5s(缓存命中) | 慢 | 快 |

| OpenAI API | ✅ | ✅ | ✅ | ✅ | ✅ |

| Anthropic API | ❌ | ✅ | ✅ | ❌ | ❌ |

| Agentic 工具 | ❌ | ✅ 20+ | ❌ | ❌ | ❌ |

| 视觉模型(VL) | 部分 | ✅ + 完整缓存 | ✅ | 部分 | 部分 |

| 开源 | 部分 | ✅ Apache 2.0 | ✅ Apache 2.0 | ✅ MIT | ✅ Apache 2.0 |

性能排名

🥇 第一名:vMLX

定位:最强原始吞吐,功能最完整的 MLX 引擎

唯一实现 5 层缓存栈的 MLX 推理引擎:Prefix Cache + Paged KV Cache + KV 量化(q4/q8)+ Continuous Batching + 磁盘持久化缓存。

在 100K token 上下文下,冷启动 Prompt 处理速度达 154,121 tok/s,是 LM Studio 的 224 倍。支持最多 256 路并发,同时提供 OpenAI 和 Anthropic 双兼容 API,内置 20+ Agentic 工具(文件读写、Shell、Git、网络搜索等)。

| 指标 | 数值 |

|---|---|

| Prompt TPS(100K context) | 154,121 tok/s |

| 最大并发 | 256 路 |

| KV Cache | 5 层缓存栈 |

| API 兼容 | OpenAI + Anthropic |

适合: 日常对话、本地 API 服务、需要 Agentic 能力的场景

🥈 第二名:oMLX

定位:Agent 场景 TTFT 最低,SSD 冷热分层缓存

专为 Coding Agent(Claude Code、Cursor、OpenClaw)设计的 macOS 原生 MLX 服务器。核心创新是 SSD 持久化分页 KV 缓存——热块留内存、冷块存 SSD,LRU 策略永不驱逐,跨会话、跨重启均可恢复缓存。

第二轮对话 TTFT 从 30–90 秒降至 5 秒以内。Qwen3-Coder 8bit 在 8× 并发下实测 243 tok/s,4.14× 加速。

| 指标 | 数值 |

|---|---|

| TTFT(缓存命中) | < 5 秒 |

| 8× 并发加速 | 4.14× |

| 缓存策略 | SSD 冷热分层,永不驱逐 |

| 开源协议 | Apache 2.0 |

适合: Claude Code / Cursor 后端,长上下文 Coding Agent

🥉 第三名:Ollama

定位:生态最佳,最容易上手

最流行的本地 LLM 管理工具,ollama run qwen3 一行搞定。生态丰富,Open WebUI、Continue 等前端可直接对接。

底层基于 llama.cpp,性能不及 MLX 原生方案,且无 KV Cache,长上下文场景明显吃亏。但对非技术用户来说,易用性无可替代。

适合: 快速搭本地 API、团队共享、新手入门

第四名:LM Studio

定位:图形界面最完整,进阶用户已有更好选择

最适合非技术用户,零命令行操作,内置 Chat UI 和模型商店。底层依赖 llama.cpp,MLX 引擎支持有限——仅单槽 KV Cache、最多 1 路并发。

100K context 冷启动仅 686 tok/s,是 vMLX 的 1/224。适合入门体验,进阶用户建议迁移至 vMLX。

适合: 第一次体验本地大模型的普通用户

第五名:vLLM

定位:macOS 不适用,排名垫底

生产级高并发推理引擎,PagedAttention 技术在 NVIDIA GPU 上性能无可匹敌。但在 macOS / Apple Silicon 平台上支持非常有限,不推荐在 Mac 上使用。

如果你同时有 NVIDIA Linux 服务器,vLLM 是那台机器的不二之选。

适合: NVIDIA GPU Linux 服务器,与本机无关

M4 Max 128GB 推荐模型

128GB 统一内存是本地推理的甜点配置,以下是按规模分类的推荐:

| 模型 | 参数量 | 量化 | 内存占用 | 预估速度 | 适用场景 |

|---|---|---|---|---|---|

| Qwen3.5-7B | 7B | 4bit | ~5 GB | ~90 tok/s | 快速对话/测试 |

| Qwen3.5-30B | 30B | 4bit | ~20 GB | ~50 tok/s | 日常对话 |

| Qwen3.5-72B | 72B | 4bit | ~46 GB | ~22 tok/s | 编码主力 |

| Qwen3.5-122B-A10B ⭐ | 122B MoE | 4bit | ~65 GB | ~14 tok/s | 旗舰首选 |

| DeepSeek-V3 | 671B MoE | 4bit | ~120 GB | ~6 tok/s | 极限测试 |

首推 Qwen3.5-122B-A10B 4bit:只占用 65GB 内存,推理质量接近 GPT-4 Turbo,还留出 63GB 给 KV Cache,是 M4 Max 128GB 的最优平衡点。

针对你的配置,最终怎么选?

建议同时安装 vMLX 和 oMLX,两者端口不冲突,各司其职:

| 使用场景 | 推荐工具 | 推荐模型 |

|---|---|---|

| 日常对话 / 本地 AI 助手 | vMLX | Qwen3.5-122B 4bit |

| Claude Code / Cursor 后端 | oMLX | Qwen3.5-72B 4bit |

| 零门槛体验 / 新手入门 | LM Studio | 任意,图形界面下载 |

| 快速搭 API / 团队共享 | Ollama | Qwen3.5-32B 4bit |

vMLX 靠 5 层缓存栈和超高吞吐量称王,oMLX 靠 SSD 冷热分层缓存在 Agent 场景实现极低延迟。对于 M4 Max 128GB 用户来说,两者都装是成本最低、收益最高的方案。

更多推荐

已为社区贡献51条内容

已为社区贡献51条内容

所有评论(0)