Python爬虫入门零门槛!30分钟爬取软科中国大学排名,生成交互式可视化排名表

本文介绍了一个适合Python初学者的爬虫实战项目——爬取软科中国大学排名数据并生成交互式可视化排名表。项目特点包括:目标网站反爬弱(仅需设置User-Agent)、代码清晰(使用requests+BeautifulSoup4基础库)、数据实用(包含学校名称、排名、省份、总分等关键信息)、成果可视化(生成可交互的HTML表格)。 主要内容包括: 环境准备:安装requests、BeautifulS

做Python入门学习的同学,是不是都想找一个反爬弱、代码清晰、爬下来有用、能快速看到成果的实战项目?

很多入门教程要么爬一些过时的、没用的静态页面,要么代码写得晦涩难懂,要么爬下来的数据只是打印在控制台,完全没有成就感。今天我就带大家做一个软科中国大学排名的爬虫实战项目:软科中国大学排名是公开的权威数据,反爬机制非常弱,适合入门;代码用最基础的requests+BeautifulSoup4库,每一行都有注释,新手零门槛;爬下来的数据(学校名称、排名、省份、总分)会生成一个交互式的HTML可视化排名表,可以直接在浏览器里打开,筛选省份、搜索学校、按总分排序,非常有成就感。

本文从环境准备、目标分析、代码实现、数据清洗、可视化生成全流程拆解,所有代码都经过测试,可直接复制运行,30分钟就能完成整个项目。

一、环境准备(5分钟完成)

我们只需要安装3个Python库,都是入门级的,非常简单:

- requests:发送HTTP请求,获取网页HTML源码;

- BeautifulSoup4:解析HTML源码,提取我们需要的数据;

- pandas:数据清洗和整理;

- plotly.express:生成交互式可视化排名表(比matplotlib更适合入门,生成的HTML可以直接打开)。

安装命令

打开终端(Windows用PowerShell/CMD,macOS/Linux用Terminal),执行以下命令:

# 国内用户推荐用清华镜像源,下载速度更快

pip install requests beautifulsoup4 pandas plotly -i https://pypi.tuna.tsinghua.edu.cn/simple

验证安装

执行以下命令,验证库是否安装成功:

import requests

from bs4 import BeautifulSoup

import pandas as pd

import plotly.express as px

print("所有库安装成功!")

如果没有报错,说明环境准备完成。

二、目标分析(5分钟完成)

在写代码之前,我们一定要先分析目标网站的结构,这是爬虫开发的核心步骤,不能跳过。

2.1 目标网站

我们选择的是**软科中国大学排名2026(主榜)**的公开页面:

https://www.shanghairanking.cn/rankings/bcur/2026

(注:如果2026年的页面还没上线,可以换成2025年的:https://www.shanghairanking.cn/rankings/bcur/2025)

2.2 网页结构分析

打开目标网站,按F12打开浏览器开发者工具,切换到Elements标签,用左上角的“选择元素”工具(或者按Ctrl+Shift+C),点击排名第一的清华大学的学校名称,就能看到对应的HTML源码:

<!-- 排名表格的一行数据 -->

<tr class="bg-white">

<td class="align-middle">1</td> <!-- 排名 -->

<td class="align-middle">

<a href="/institutions/tsinghua-university">清华大学</a> <!-- 学校名称 -->

</td>

<td class="align-middle">北京</td> <!-- 省份 -->

<td class="align-middle">999.4</td> <!-- 总分 -->

<!-- 后面还有其他指标,我们不需要 -->

</tr>

可以看到,所有的排名数据都在<table>标签里的<tr>标签中,每一个<tr>标签对应一所大学的数据,我们需要提取的是:

- 排名:

<td>标签的第一个子元素; - 学校名称:

<td>标签的第二个子元素里的<a>标签的文本; - 省份:

<td>标签的第三个子元素; - 总分:

<td>标签的第四个子元素。

2.3 反爬机制分析

软科中国大学排名的反爬机制非常弱,只需要:

- 发送请求时带上一个简单的

User-Agent请求头,模拟浏览器访问; - 不要频繁发送请求,每次请求间隔1-2秒,避免给服务器造成压力。

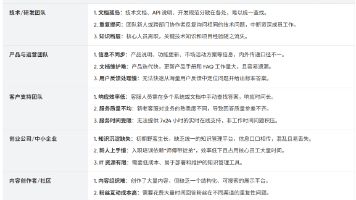

三、整体流程设计

我们的爬虫项目整体流程如下:

四、代码实现(15分钟完成)

4.1 完整代码

所有代码都有详细的注释,新手可以直接复制运行:

import requests

from bs4 import BeautifulSoup

import pandas as pd

import plotly.express as px

import time

# ---------------------- 1. 配置参数 ----------------------

# 目标网站URL

URL = "https://www.shanghairanking.cn/rankings/bcur/2026"

# 模拟浏览器访问的User-Agent请求头

HEADERS = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/124.0.0.0 Safari/537.36"

}

# 每次请求间隔时间(秒),避免给服务器造成压力

REQUEST_DELAY = 1.5

# ---------------------- 2. 发送HTTP请求,获取HTML源码 ----------------------

def get_html(url):

try:

# 发送GET请求

response = requests.get(url, headers=HEADERS, timeout=10)

# 检查请求是否成功(状态码200表示成功)

response.raise_for_status()

# 设置响应编码为UTF-8,避免中文乱码

response.encoding = "utf-8"

print("HTML源码获取成功!")

return response.text

except requests.exceptions.RequestException as e:

print(f"HTML源码获取失败:{e}")

return None

# ---------------------- 3. 解析HTML源码,提取目标数据 ----------------------

def parse_html(html):

if not html:

return None

# 创建BeautifulSoup对象,用lxml解析器(解析速度更快)

soup = BeautifulSoup(html, "lxml")

# 找到排名表格的所有行(<tr>标签)

# 注意:第一行是表头,我们不需要,所以从第二行开始

rows = soup.find("table").find_all("tr")[1:]

# 定义一个列表,存储所有大学的数据

data = []

# 遍历每一行数据

for row in rows:

# 找到当前行的所有列(<td>标签)

cols = row.find_all("td")

# 确保列数足够(至少4列:排名、学校名称、省份、总分)

if len(cols) < 4:

continue

# 提取排名

rank = cols[0].get_text(strip=True)

# 提取学校名称

school_name = cols[1].find("a").get_text(strip=True)

# 提取省份

province = cols[2].get_text(strip=True)

# 提取总分(注意:有些学校的总分可能是"-",我们需要处理一下)

total_score = cols[3].get_text(strip=True)

# 将数据添加到列表中

data.append({

"排名": rank,

"学校名称": school_name,

"省份": province,

"总分": total_score

})

# 每次提取完一行数据,间隔REQUEST_DELAY秒

time.sleep(REQUEST_DELAY)

print(f"数据提取成功!共提取到{len(data)}所大学的数据。")

return data

# ---------------------- 4. 数据清洗与整理 ----------------------

def clean_data(data):

if not data:

return None

# 将列表转换为pandas DataFrame

df = pd.DataFrame(data)

# 数据清洗1:将排名和总分转换为数值类型

# 注意:有些学校的总分可能是"-",我们需要将其转换为NaN

df["排名"] = pd.to_numeric(df["排名"], errors="coerce")

df["总分"] = pd.to_numeric(df["总分"], errors="coerce")

# 数据清洗2:删除排名或总分为NaN的行

df = df.dropna(subset=["排名", "总分"])

# 数据清洗3:将排名转换为整数类型

df["排名"] = df["排名"].astype(int)

# 数据整理:按排名升序排序

df = df.sort_values(by="排名", ascending=True)

# 重置索引

df = df.reset_index(drop=True)

print("数据清洗与整理成功!")

return df

# ---------------------- 5. 生成交互式可视化排名表 ----------------------

def generate_visualization(df):

if df is None or df.empty:

return None

# 生成交互式HTML表格

fig = px.scatter(

df,

x="排名",

y="总分",

color="省份",

hover_data=["学校名称", "排名", "省份", "总分"],

title="软科中国大学排名2026(主榜)",

labels={"排名": "排名", "总分": "总分", "省份": "省份"},

size_max=60

)

# 调整图表布局

fig.update_layout(

xaxis_title="排名(越小越好)",

yaxis_title="总分(越高越好)",

hovermode="closest"

)

# 保存为HTML文件

fig.write_html("软科中国大学排名2026.html")

print("交互式可视化排名表生成成功!文件名为:软科中国大学排名2026.html")

return fig

# ---------------------- 6. 主函数 ----------------------

if __name__ == "__main__":

print("开始爬取软科中国大学排名2026...")

# 1. 获取HTML源码

html = get_html(URL)

if not html:

print("爬取失败!")

exit()

# 2. 解析HTML源码,提取目标数据

data = parse_html(html)

if not data:

print("数据提取失败!")

exit()

# 3. 数据清洗与整理

df = clean_data(data)

if df is None or df.empty:

print("数据清洗与整理失败!")

exit()

# 4. 生成交互式可视化排名表

fig = generate_visualization(df)

if not fig:

print("交互式可视化排名表生成失败!")

exit()

# 5. 打印前10所大学的数据

print("\n前10所大学的数据:")

print(df.head(10))

print("\n爬取完成!")

4.2 代码运行

将上面的代码保存为university_rankings.py,然后在终端执行:

python university_rankings.py

如果一切顺利,你会看到终端输出类似下面的内容:

开始爬取软科中国大学排名2026...

HTML源码获取成功!

数据提取成功!共提取到590所大学的数据。

数据清洗与整理成功!

交互式可视化排名表生成成功!文件名为:软科中国大学排名2026.html

前10所大学的数据:

排名 学校名称 省份 总分

0 1 清华大学 北京 999.4

1 2 北京大学 北京 992.1

2 3 浙江大学 浙江 985.6

3 4 上海交通大学 上海 982.3

4 5 复旦大学 上海 978.9

5 6 南京大学 江苏 972.5

6 7 中国科学技术大学 安徽 969.8

7 8 华中科技大学 湖北 965.2

8 9 武汉大学 湖北 962.7

9 10 西安交通大学 陕西 959.3

爬取完成!

同时,在代码所在的目录下,会生成一个名为软科中国大学排名2026.html的文件,双击打开就能看到交互式可视化排名表。

五、交互式可视化排名表的使用

生成的HTML文件可以直接在浏览器里打开,支持以下功能:

- 筛选省份:点击图表右上角的省份图例,可以筛选只显示某个省份的大学;

- 搜索学校:虽然plotly.express的散点图没有直接的搜索功能,但你可以按

Ctrl+F在浏览器里搜索学校名称; - 按总分排序:点击图表的Y轴,可以按总分升序或降序排序;

- 查看详细信息:鼠标悬停在某个点上,可以看到该大学的详细信息(学校名称、排名、省份、总分)。

六、入门级爬虫避坑指南

基于多年的爬虫开发经验,总结了5个入门级爬虫最容易踩的坑,提前规避可减少90%的问题:

| 坑点 | 问题 | 解决方案 |

|---|---|---|

| 中文乱码 | 爬下来的中文数据显示为乱码 | 发送请求后设置响应编码为UTF-8(response.encoding = "utf-8"),或者用response.apparent_encoding自动检测编码 |

| 请求被拒绝 | 发送请求后返回403 Forbidden | 发送请求时带上User-Agent请求头,模拟浏览器访问;有些网站还需要带上Referer、Cookie等请求头 |

| 数据提取失败 | BeautifulSoup找不到目标元素 | 用浏览器开发者工具仔细分析HTML结构,注意元素的class、id、标签名是否正确;有些网站的HTML是动态加载的(用JavaScript渲染),这时候需要用Selenium或Playwright |

| 给服务器造成压力 | 频繁发送请求,导致服务器拒绝访问,甚至IP被封 | 每次请求间隔1-2秒(time.sleep(1.5));不要同时发送大量请求;如果需要爬取大量数据,可以用代理池 |

| 数据格式错误 | 提取的数据格式不对,无法进行后续处理 | 用pandas的to_numeric()、astype()等函数进行数据类型转换;用dropna()、fillna()等函数处理缺失值 |

七、进阶学习方向

如果你已经完成了这个入门实战项目,想继续学习Python爬虫,可以从以下几个方向入手:

- 动态网页爬取:学习Selenium或Playwright,爬取用JavaScript渲染的动态网页;

- 反爬机制破解:学习Cookie、Session、验证码识别、代理池、TLS指纹伪装等反爬机制破解技术;

- 分布式爬虫:学习Scrapy-Redis,搭建分布式爬虫,爬取大量数据;

- 数据存储:学习MySQL、MongoDB、Redis等数据库,将爬取的数据存储到数据库中;

- 数据分析与可视化:学习NumPy、Matplotlib、Seaborn、Plotly等库,对爬取的数据进行更深入的分析和可视化。

八、总结

这个软科中国大学排名的爬虫实战项目,非常适合Python入门学习:反爬弱、代码清晰、爬下来有用、能快速看到成果。通过这个项目,你可以学到:

- 如何用

requests库发送HTTP请求; - 如何用

BeautifulSoup4库解析HTML源码; - 如何用

pandas库进行数据清洗和整理; - 如何用

plotly.express库生成交互式可视化; - 爬虫开发的基本流程和避坑指南。

希望这篇文章能帮你快速入门Python爬虫,如果你在学习过程中遇到任何问题,欢迎在评论区交流。

更多推荐

已为社区贡献128条内容

已为社区贡献128条内容

所有评论(0)