看了这篇Science Robotics,我才明白为什么以前的机器人模仿学习不行

对于团队场景,这一过程会扩展至所有学习者机器人的候选动作,选择。为了区分有效动作和异常动作(如超出机器人能力范围的动作),框架还在数据集中加入了“未知”标签的动作样本,训练后异常动作的嵌入会靠近“未知”标签,从而在后续阶段被过滤。IAIL框架的工作流程包含三个关键阶段,涵盖从动作生成到意图匹配的完整链路,既支持单机器人对单机器人的模仿,也可扩展至团队级别的行为迁移。例如,“拾取红色杯子”这一意图,

不同形状、不同功能、不同“体质”的机器人,能不能互相看着对方做一遍任务,自己就学会该怎么做?

——从“一对一”到“团队对团队”

目录

模仿学习是机器人技能获取的重要技术,但传统方法严重依赖演示者与学习者的形态、动作与环境完全匹配,难以支撑异质机器人协作。

面对机械臂、无人机、移动机器人等不同载体,以及场景、物体、团队构成的动态变化,直接动作映射的模仿策略普遍失效,跨平台技能迁移与任务分配成为行业关键瓶颈。

近日,意图对齐模仿学习框架(IAIL) 成果发表于机器人顶刊《Science Robotics》。

该研究突破动作复制的传统范式,以自然语言标注的高层意图构建共享表征空间,实现异质机器人行为自适应与团队任务智能分配,为开放环境多机器人协作提供了全新解决方案。

01 核心突破:从“动作复制”到“意图对齐”的范式转变

传统模仿学习的核心矛盾在于,其依赖演示者与学习者之间精确的运动对应关系,而这种对应在异质机器人场景中难以建立。

例如,双机械臂机器人的抓取动作无法直接被单臂机器人复制,无人机的空中监测轨迹也不能被地面移动机器人直接复用。

现有解决方案要么需要为每对机器人手动标注轨迹对应关系,工程成本极高;要么依赖无监督学习挖掘技能相似性,但仅适用于功能相近的机器人。

IAIL框架的核心创新在于将模仿学习的对齐维度从“动作层”提升至“意图层”。

灵感源自人类的文化学习机制——人类理解他人行为时优先关注其潜在目标,而非具体动作模式。

该框架通过三个关键设计实现这一转变:

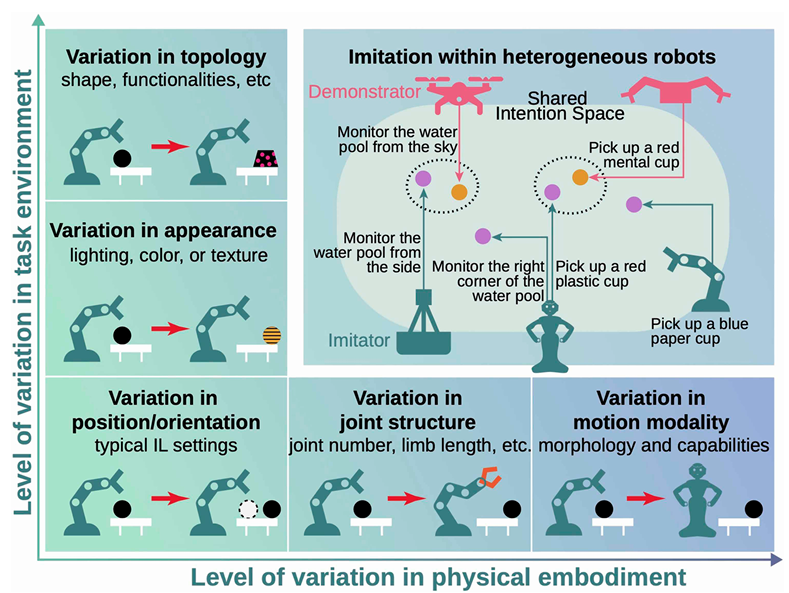

▲不同模仿学习场景的可视化说明

-

首先,重新定义“意图”为动作的目标或结果,并用自然语言标注抽象掉具体的控制细节和形态特征。

例如,“拾取红色杯子”这一意图,既可以对应双机械臂的抓取动作,也可以对应单臂机器人的夹持动作,甚至可以是移动机械臂的组合动作。

-

其次,构建共享意图空间,通过对比学习将机器人的运动轨迹嵌入与自然语言标注的意图嵌入对齐。

这一空间使得不同形态机器人的同类意图动作在嵌入空间中聚集,为跨机器人行为关联提供了统一基准。

-

最后,支持动态任务分配,在多机器人团队场景中,自动将演示任务的每个步骤分配给最具执行可行性的机器人,无需预先定义角色分工。

这种设计从根源上解决了异质机器人模仿学习的核心难题:

无需依赖精确的动作映射,而是通过意图关联实现行为自适应,既降低了数据标注成本,又提升了系统的泛化能力。

02 框架架构:三大核心阶段实现跨机器人意图迁移

IAIL框架的工作流程包含三个关键阶段,涵盖从动作生成到意图匹配的完整链路,既支持单机器人对单机器人的模仿,也可扩展至团队级别的行为迁移。

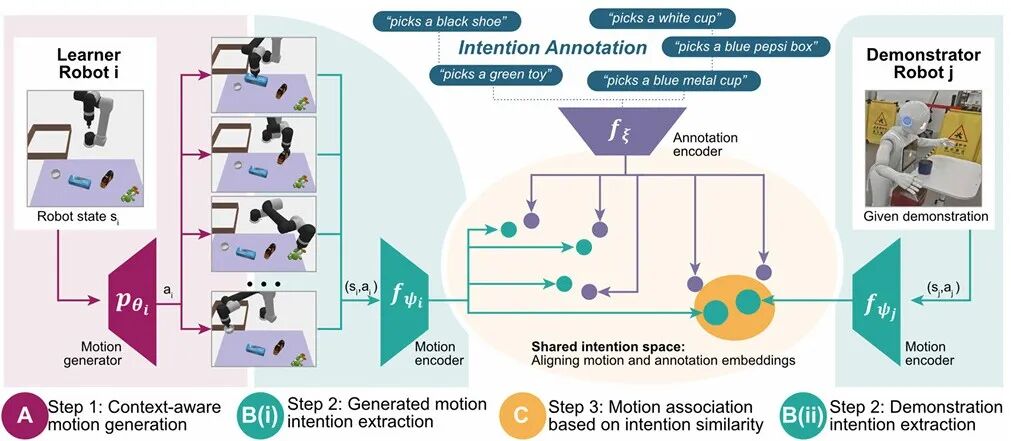

▲智能体对智能体场景下 IAIL 框架的整体流程

上下文感知运动生成

该阶段为学习者机器人生成当前环境下可行的动作候选集。

框架为每个机器人训练专属的运动生成器,该生成器基于机器人的传感器感知状态(如当前位置、环境中的物体分布等),采样出一系列可执行的动作轨迹。

这些动作轨迹反映了机器人在当前场景下的能力边界,例如移动机器人会生成导航和简单抓取动作,而机械臂则会生成精细操作动作。

运动生成器采用变分自编码器(VAE)架构训练,目标是复现机器人在专属数据集上的专家动作轨迹。生成的动作不仅保证安全性和可行性,还覆盖了机器人的核心技能范围,为后续的意图匹配提供充足候选。

运动意图提取

这一阶段是IAIL框架的核心,负责将演示者的动作和学习者的候选动作都映射到共享意图空间。

框架包含两类编码器:机器人专属的运动编码器 和所有机器人共享的标注编码器

。

运动编码器将机器人的动作轨迹转化为高维嵌入向量,标注编码器则将自然语言意图描述转化为同维度的嵌入向量。

通过对比学习训练,使得具有相同意图的动作轨迹和语言描述在嵌入空间中距离相近——无论动作的执行主体是何种形态的机器人。

为了区分有效动作和异常动作(如超出机器人能力范围的动作),框架还在数据集中加入了“未知”标签的动作样本,训练后异常动作的嵌入会靠近“未知”标签,从而在后续阶段被过滤。

基于意图相似度的运动关联

在共享意图空间中,框架计算演示者动作嵌入与学习者候选动作嵌入的相似度,选择相似度最高且满足可行性阈值的候选动作作为执行方案。对于团队场景,这一过程会扩展至所有学习者机器人的候选动作,选择全局最优的动作-机器人组合。

动作选择的核心准则由两个指标决定:

一是意图对齐度,衡量候选动作与演示意图的匹配程度;

二是动作有效性 ,确保候选动作属于机器人的能力范围。

最终选择综合得分最高的动作执行,若没有满足阈值的候选动作,机器人会选择保持静止,避免执行无效或危险动作。

团队级模仿中,框架会将演示任务的每个步骤分解为独立意图,分别分配给最适合的机器人。

例如,监测任务可能分配给无人机或移动监测机器人,抓取任务分配给机械臂,配送任务则分配给移动机器人,实现基于能力的动态分工。

03 实验验证:多场景下的性能与泛化能力

研究团队通过真实世界实验和仿真实验双重验证IAIL框架的性能,涵盖单机器人模仿、团队协作、环境变化适应等多个场景,全面评估其任务完成率、自适应能力和泛化性。

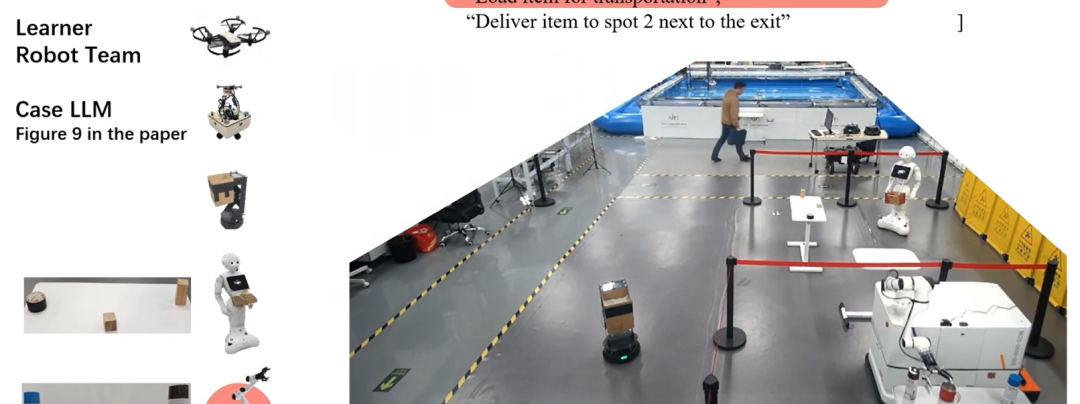

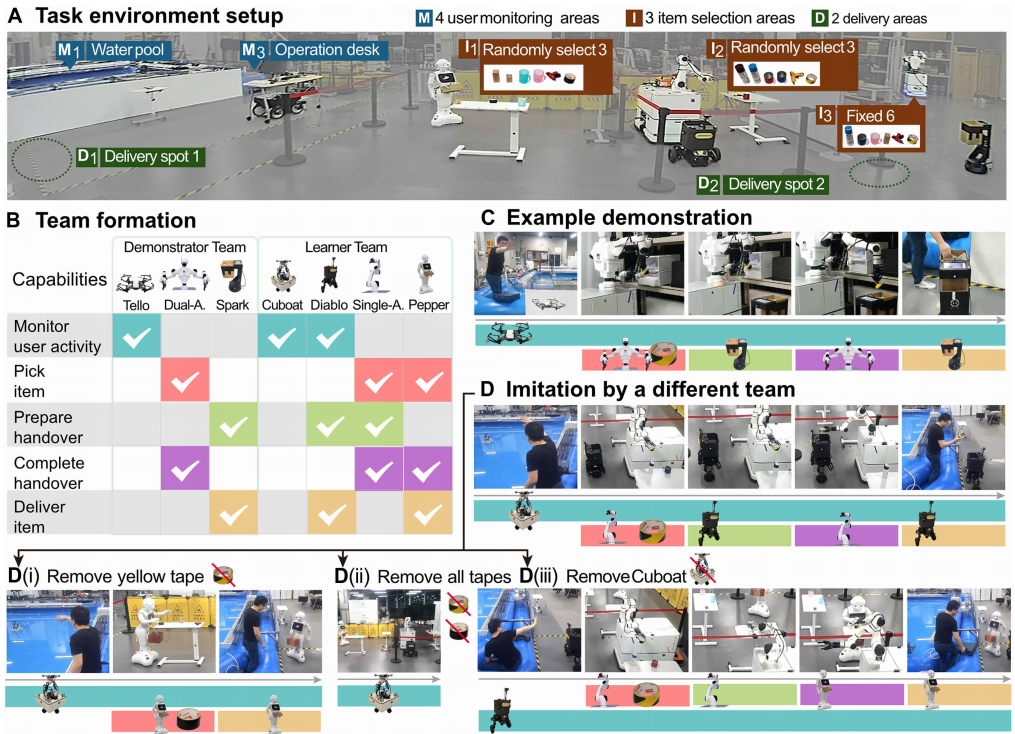

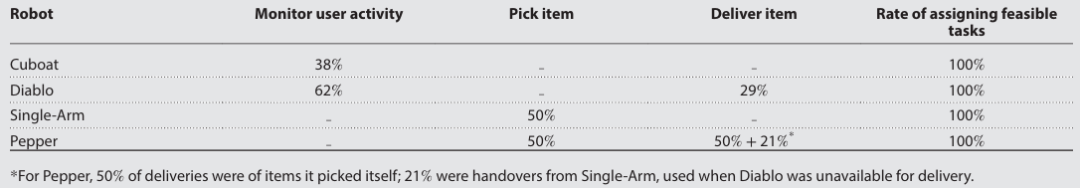

真实世界实验:七台异质机器人的协作任务验证

实验选用七台形态和功能差异显著的机器人,分为:

演示者团队:Tello无人机、Dual-Arm双机械臂、Spark移动机器人;

学习者团队:Cuboat水上机器人、Diablo移动监测机器人、Single-Arm单机械臂、Pepper移动机械臂。

任务包含三个核心阶段:在四个指定区域监测用户活动、在三个区域拾取物品、向两个目的地配送物品,总计设计30种场景,涵盖物品类型变化、机器人团队组成变化等变量。

▲真实世界实验设置及不同条件下的模仿结果

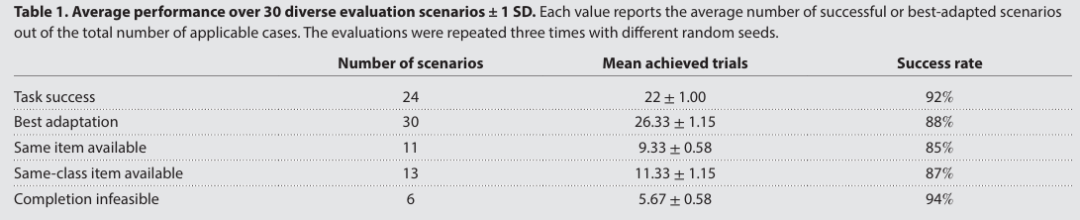

实验结果显示,IAIL框架表现出优异的任务完成能力和自适应能力:

-

整体任务成功率达92%,在24个可行场景中平均完成22个,失败案例主要源于传感器噪声导致的意图提取错误;

-

自适应准确率达88%,在演示物品缺失时能选择同类替代物品,在无可用物品时能正确保持静止(6个不可行场景中准确率达94%);

-

任务分配灵活性强,100%的任务分配都符合机器人的能力边界,例如仅移动机器人被分配配送任务,机械臂仅负责抓取操作。

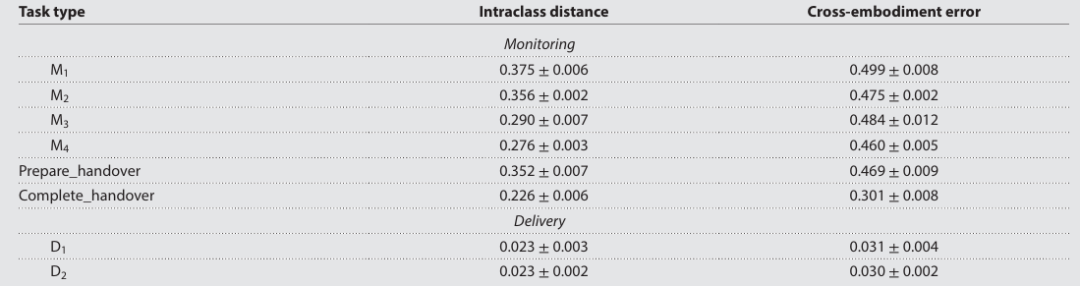

▲30 种不同评估场景下的平均性能(含标准差)

典型案例中,当演示任务要求拾取黄色胶带而该物品缺失时,框架会选择黑色胶带作为替代,并根据物品位置将任务从Single-Arm调整为更具移动能力的Pepper机器人;

当Cuboat机器人退出团队时,Diablo机器人会自动接管监测任务,其他机器人的分工也随之动态调整。

▲学习者机器人团队的任务分配分布

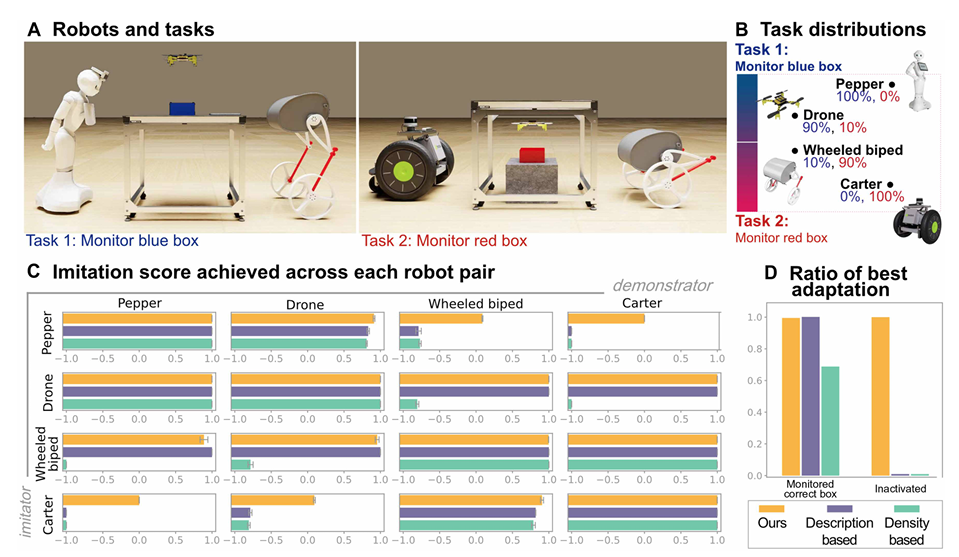

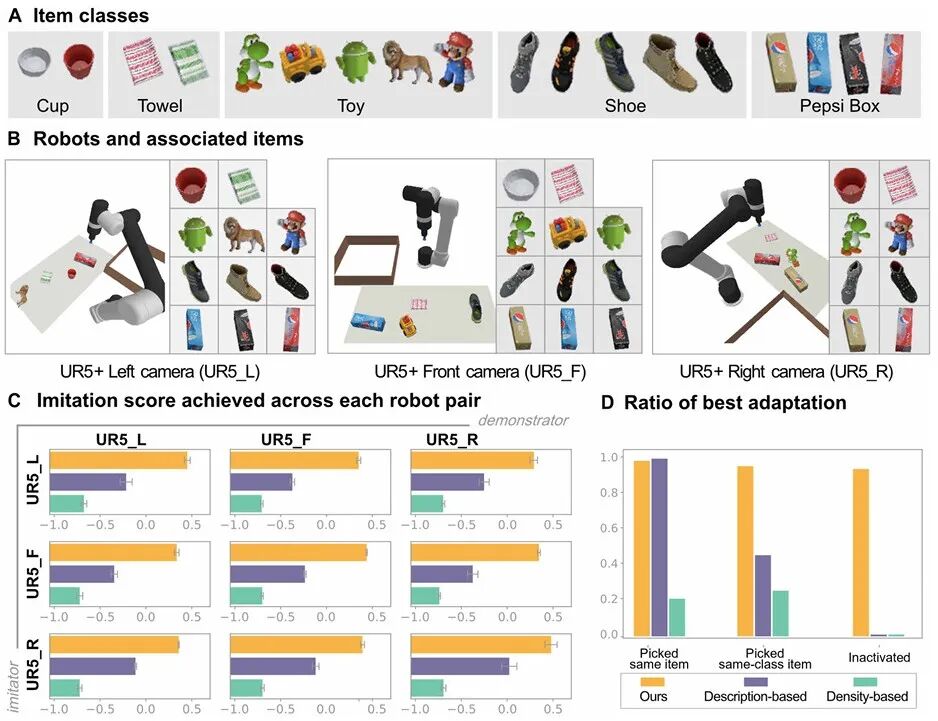

仿真实验:与基线方法的性能对比

为验证IAIL框架的核心优势,研究团队在监测任务和物品拾取任务中,将其与密度基映射和描述基翻译两种基线方法进行对比:

密度基方法通过对齐动作分布建立关联,描述基方法则通过自然语言中介传递行为指令。

实验结果显示,IAIL框架在所有场景中均显著优于基线方法:

▲监测任务仿真研究(评估不同机器人配对的模仿性能)

-

监测任务中,当演示者与学习者的动作分布差异较大时(如Pepper机器人与Carter机器人),IAIL的平均得分比密度基方法高1.40,比描述基方法高0.94;

-

物品拾取任务中,IAIL在九组机器人配对中的平均得分均为最高,比密度基方法平均高1.11,比描述基方法平均高0.63;

关键优势在于,IAIL能准确识别任务不可行场景并保持静止,而基线方法往往会执行无效动作(得分低至-1)。

▲物品拾取任务仿真研究(评估不同环境条件下的模仿性能)

这种性能优势源于IAIL框架的双重保障:

语义层面的意图对齐确保了行为的相关性,可行性校验则避免了无效动作的执行,而基线方法要么缺乏语义 grounding(密度基),要么忽略学习者的能力边界(描述基)。

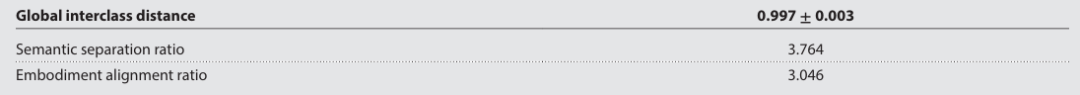

意图空间的定量分析

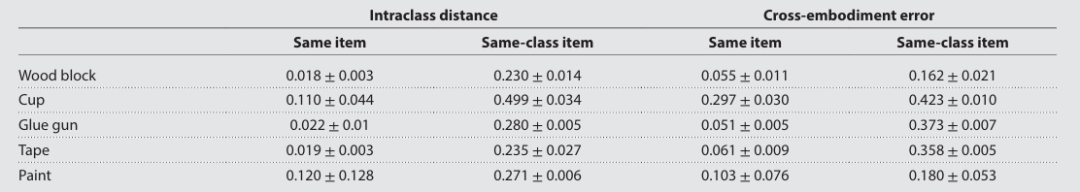

为验证共享意图空间的有效性,研究团队对其进行了定量评估。结果显示:

-

不同任务类型(监测、拾取、交接、配送)的嵌入在空间中分离度良好,语义分离比达3.764,说明意图空间能清晰区分不同任务的核心目标;

▲潜在意图空间的整体组织与泛化能力

-

跨机器人形态的意图对齐效果优异,相同任务在不同机器人上的动作嵌入距离较小,对齐比达3.046,验证了意图空间的形态无关性;

▲不同任务类型的潜在意图空间结构定量分析

-

意图空间还能区分精细的物体类别,相同物品的动作嵌入距离显著小于同类不同物品,确保了模仿的精准度。

▲物品拾取任务的潜在意图空间结构定量分析

04 局限与未来方向:意图对齐范式的进一步探索

尽管IAIL框架取得了显著突破,但仍存在一些需要完善的方面。

目前框架采用固定阈值判断动作的有效性和意图对齐度:

这种统一设置可能无法适配所有机器人的特性——不同机器人的能力边界和动作精度存在差异,最优阈值也应有所不同。

在复杂任务场景中,演示动作可能包含多个子意图,当前框架未明确支持意图的分层解析,对于需要拆分或重组的复杂行为迁移可能存在局限。

此外,框架目前依赖人工标注的自然语言意图描述,虽然标注成本低于动作配对,但大规模应用时仍需自动化标注方案。

针对这些问题,研究团队提出了未来的优化方向:

首先,探索为每个机器人自动优化阈值参数的方法,提升个性化适配能力;

其次,融入多模态输入(如图像、传感器数据),丰富意图理解的维度;

最后,结合大语言模型(LLMs)实现意图描述的自动生成,进一步降低数据准备成本。

▲与大语言模型集成(Integration with LLMs)

值得关注的是,IAIL框架与大语言模型的融合具有天然优势——标注编码器已具备处理语言输入的能力,只需将LLM生成的意图描述输入框架,即可实现无演示轨迹的行为迁移。

这种扩展将使框架从“模仿学习”延伸至“指令跟随”,进一步拓宽应用场景。

Ref:

论文标题:Cross-robot behavior adaptation through intention alignment

论文作者:Xi Chen, Yuan Gao, Hangxin Liu, Fangkai Yang, Ali Ghadirzadeh, Jun Yang, Bin Liang, Chongjie Zhang, Tin Lun Lam, and Song-Chun Zhu

论文地址:https://www.science.org/doi/10.1126/scirobotics.adv2250

代码地址:https://github.com/pcchenxi/Cross-Robot-Behavior-Adaptation-through-Intention-Alignment

更多推荐

已为社区贡献82条内容

已为社区贡献82条内容

所有评论(0)