为什么你的项目永远在“推进中“?

Anthropic实验揭示:复杂任务完成的关键在于结构化设计而非执行者能力。研究人员通过让AI独立完成科研计算发现,成功要素包括:明确目标标准、建立进度记录、设置验证机制、保障连续执行环境。这套方法同样适用于"一人公司"场景,表明复杂工作的完成不依赖个人意志力,而在于前期搭建合理的工作结构。实验证明,当任务被系统分解后,执行过程(无论由AI还是人类完成)可以稳定推进。研究强调了

最近,Anthropic 做了一次实验:他们让一个 AI 在服务器上连续运行了几天,在极少人工干预的情况下,完成了一项完整的科研计算任务。

这里说的不是写总结、不是生成内容,而是一项结构复杂、对精度要求极高的科学计算工作。过去,这类任务通常需要科研人员花费数月时间反复推进。

这次实验真正值得关注的,并不是 AI 本身,而是这项任务是如何被组织起来、一步一步完成的。在 Anthropic 的研究说明中,这一点被反复强调:关键不在模型能力,而在于任务结构的设计方式。

复杂事情,为什么总是做不完

如果让一个执行者独立推进一项复杂任务,通常会遇到几个问题:

1.做到哪算完成,其实并不清楚

2.试过的方案记不全,容易反复走弯路

3.没有稳定的校验方式,错误被拖到后期

4.工作被频繁打断,很难持续推进

这些问题,并不只出现在科研中。

在现实里,媒体反复提到的「一人公司」之所以让很多人感到吃力,往往也是同样的原因:不是一个人不够努力,而是复杂任务没有被拆解成一个人可以长期承受的工作结构。

这篇论文,其实就是在解决这一个问题

在这次实验中,研究人员并没有频繁地“教 AI 怎么做”,而是提前为任务设计了一套工作方式。

这套方式解决的,正是上面这些问题。而且它并不只适用于 AI。

如果把 AI 换成一个人,这套方法依然成立—— 无论这个人是在做科研,还是在尝试独立推进一个完整项目。

第一步:先把“做到什么程度算完”说清楚

在实验开始前,研究人员明确了三件事:

1.需要实现哪些功能

2.最终结果应该长什么样

3.误差允许在什么范围内

论文中将这一步称为成功标准——没有这一步,智能体很容易“以为自己完成了”,提前停下。

现实中,很多一人项目之所以拖不完,并不是做不下去,而是从一开始就没人说清楚“什么时候可以停”。

第二步:把过程写下来,而不是只放在脑子里

AI 被要求持续维护一个进度文件,用来记录:

1.已完成的部分

2.失败的尝试

3.当前已知的问题

这相当于 AI 的长期记忆。

论文中甚至建议:每完成一个有意义的工作单元,就像程序员一样进行一次提交。这样不仅能回溯历史,也能在中断后恢复。

现实中,很多一人公司卡住的地方,不是不会做,而是所有尝试都只存在于脑子里,一旦中断就只能重来。

第三步:每一步都要能被验证

在科研计算中,最危险的情况不是算不出来,而是算错了却不知道。

为此,研究人员为 AI 设置了一个明确的验证机制:

每完成一部分工作,就与权威参考实现进行对比,偏差过大就回到源头修改

论文中将这一机制称为测试预言机:确保智能体不会一路错到最后。

现实中,很多个人项目后期返工严重,往往正是因为前期缺少这种“随时校验”的结构。

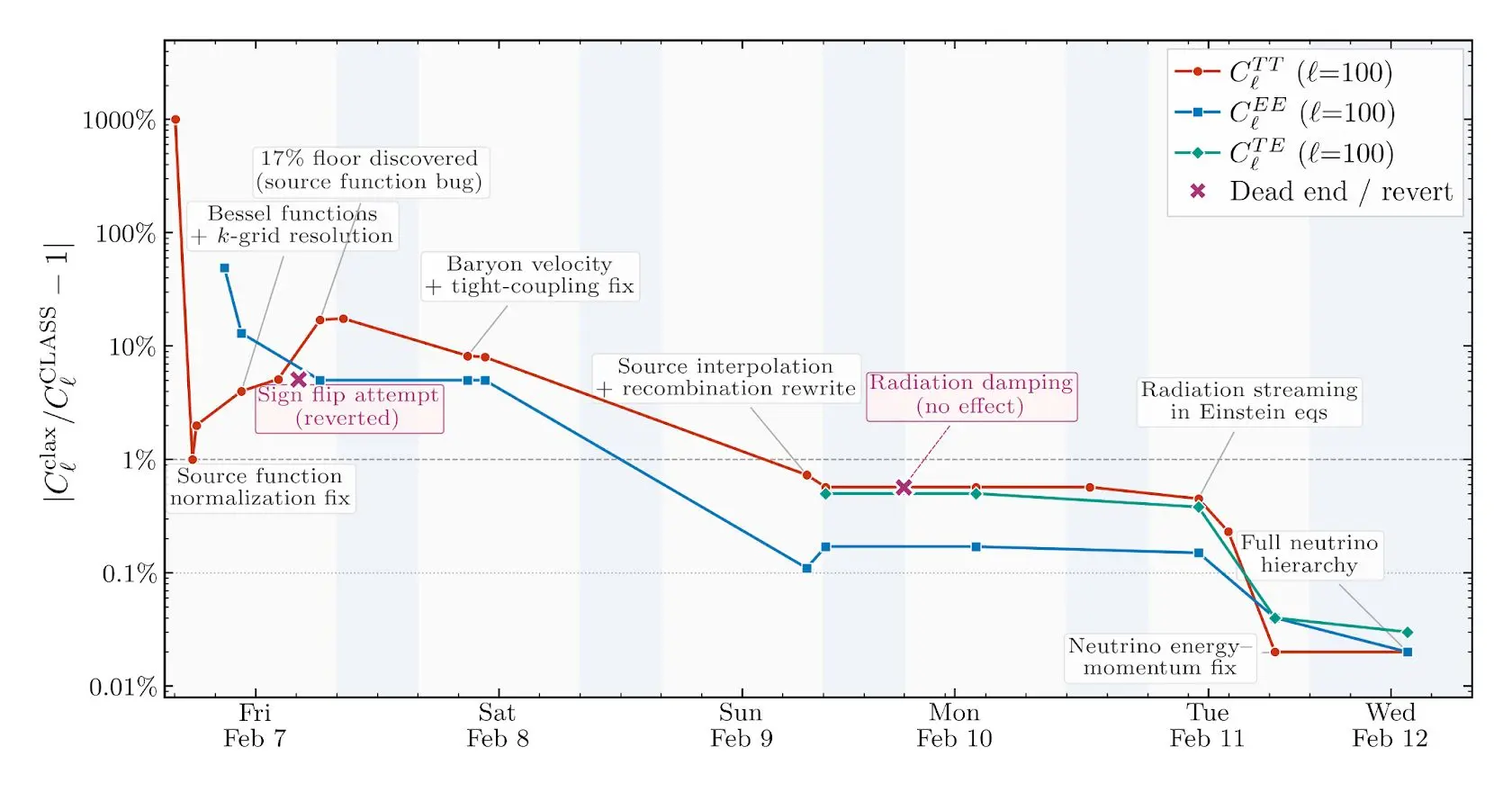

图:AI从2月7日至12日连续工作,误差从初始的1000%逐步收敛至0.01%。每个标注节点对应一次关键修复。红色×为死路:回退记录。(图源:Anthropic)

第四步:给执行留出不被打断的空间

AI 并不是在对话窗口里工作,而是被放在服务器或计算节点上:

1.可以连续运行

2.不需要实时监督

3.出现问题再回头修正

论文中还提到一个关键设计:通过循环提示结构,防止智能体在任务真正完成前“提前停下”。

现实中,很多复杂任务做不完,并不是没人干,而是执行被不断打断,复杂度被一点点放大。

这套方法的前提:结构先于执行

需要明确的是,这次实验并不是“AI 完全自主”。

论文中坦率地写到:

1.研究者会定期通过登录检查进度

2.会在方向明显偏离时进行人工调整

3.智能体在一些基础约定上犯过错误

4.整体开发过程并不流畅,结果也并非生产级

这并不是缺陷,而是这套方法成立的前提条件。

不是 AI 自己把事情做完了,而是人在前期搭好结构后,AI 才能持续推进执行。

这对“一人公司”意味着什么

如果把 AI 换成一个人,这个结论依然成立。

所谓“一人公司”真正难的,并不是一个人干活,而是一个人既要想清楚结构,又要长期执行细节。

这篇论文展示的,并不是“AI 能替代人”,而是当结构被提前搭好时,执行可以被稳定外包给一个执行者。

这个执行者可以是 AI,也可以是现实中试图把事情真正做完的某一个人。

写在最后

这篇论文的价值,不在于展示 AI 的能力,而在于它把一件常被忽略的事情说清楚了:

复杂工作不是靠意志力完成的,而是靠结构完成的。

当结构成立时,“一人公司”不再是一个压力标签,而只是一个执行规模的描述。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)