【GitHub每日速递 20260326】爆火!这款AI数字沙盘牛到离谱:既能零风险预演政策舆情,还能补全红楼梦失传结局

摘要:MiroFish是一款基于多智能体技术的AI预测引擎,能够构建高保真数字世界模拟现实场景。它适用于政策预演、舆情分析、文学创作等领域,支持可视化交互和深度推演。项目开源在GitHub,采用Python开发。同时,谷歌发布的LiteRT是TensorFlow Lite的继任者,专注于边缘设备的高性能AI部署,支持多平台加速。两者分别代表了AI在模拟预测和边缘计算领域的最新进展。

爆火!这款AI数字沙盘牛到离谱:既能零风险预演政策舆情,还能补全红楼梦失传结局

MiroFish 是一个基于Python的自动化网络爬虫工具。简单讲,它能自动抓取网页内容并提取有用信息,帮助用户高效收集数据。适用人群:数据分析师、爬虫开发者、需要批量获取公开网页信息的研究人员。

项目地址:https://github.com/666ghj/MiroFish

主要语言:Python

stars: 18.4k

主要内容

MiroFish 是一款基于多智能体技术的新一代 AI 预测引擎。它能提取现实世界的种子信息,如突发新闻、政策草案、金融信号等,自动构建高保真的平行数字世界。在这个数字世界里,成千上万个具有独立人格、长期记忆与行为逻辑的智能体自由交互、进行社会演化。用户可以通过「上帝视角」动态注入变量,精准推演未来走向。用户只需上传种子材料(如数据分析报告或小说故事),并用自然语言描述预测需求,MiroFish 就会返回详尽的预测报告和可深度交互的高保真数字世界。

优势

- 突破传统预测局限:致力于打造映射现实的群体智能镜像,通过捕捉个体互动引发的群体涌现现象,突破传统预测方法的限制。

- 适用范围广泛:在宏观层面,可作为决策者的预演实验室,让政策与公关在零风险的情况下进行试错;在微观层面,是个人用户的创意沙盘,可用于推演小说结局、探索脑洞等。

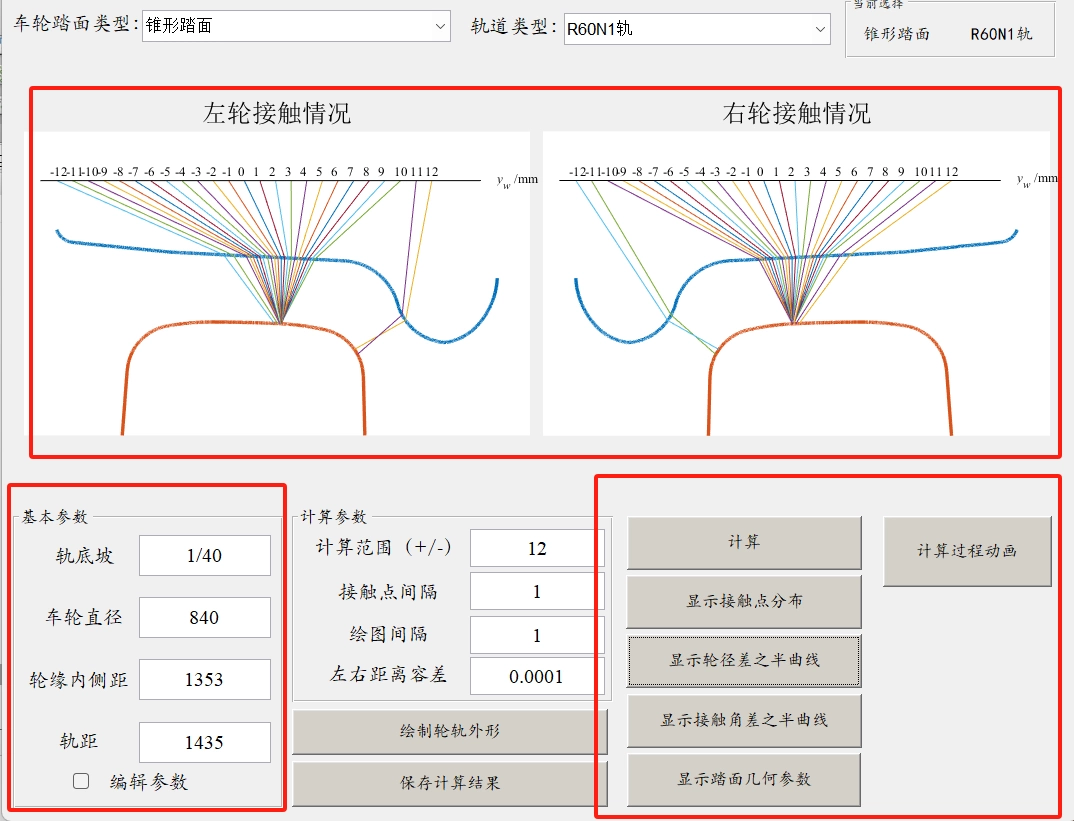

- 可视化与交互性强:提供在线 Demo 演示环境,用户能直观体验热点舆情事件的推演预测。还展示了系统截图和演示视频,方便用户了解其功能和使用方式。

应用场景

- 政策制定:政府部门或企业在制定政策或公关策略时,可利用 MiroFish 进行预演,评估不同政策方案可能产生的影响,从而做出更科学的决策。

- 舆情分析:对热点舆情事件进行推演预测,帮助相关部门提前了解舆情发展趋势,制定应对措施。

- 文学创作:作家可以借助 MiroFish 推演小说的结局,为创作提供更多的思路和可能性。

- 金融投资:分析金融信号,预测金融市场的走势,为投资者提供决策参考。

工作流程

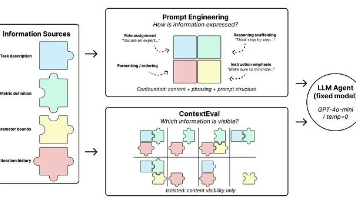

- 图谱构建:提取现实种子信息,注入个体与群体记忆,构建 GraphRAG。

- 环境搭建:抽取实体关系,生成人设,配置环境并注入仿真参数。

- 开始模拟:双平台并行模拟,自动解析预测需求,动态更新时序记忆。

- 报告生成:ReportAgent 利用丰富的工具集与模拟后环境深度交互,生成预测报告。

- 深度互动:用户可以与模拟世界中的任意智能体进行对话,也能与 ReportAgent 交流。

部署方式

- 源码部署(推荐)

- 前置要求:需要安装 Node.js(18+)、Python(≥3.11,≤3.12)和最新版的 uv 包管理器。

- 配置环境变量:复制示例配置文件

.env.example为.env,并填入必要的 API 密钥,如 LLM API 密钥和 Zep Cloud 配置。 - 安装依赖:可一键安装所有依赖,也可分步安装 Node 依赖和 Python 依赖。

- 启动服务:在项目根目录执行

npm run dev可同时启动前后端,也可单独启动后端或前端。

- Docker 部署

- 配置环境变量:与源码部署相同,复制示例配置文件并填入必要的 API 密钥。

- 拉取镜像并启动:使用

docker compose up -d命令拉取镜像并启动服务,默认会读取根目录下的.env文件,并映射端口3000(前端)/5001(后端)。

谷歌重磅发布LiteRT!TensorFlow Lite正统继任者,全平台NPU/GPU加速让边缘GenAI部署快到离谱!

项目地址:https://github.com/google-ai-edge/LiteRT

主要语言:C++

stars: 1.6k

仓库简介

LiteRT是Google推出的用于边缘平台上高性能机器学习(ML)和生成式人工智能(GenAI)部署的设备端框架,它延续了TensorFlow Lite的传统,是值得信赖的高性能设备端AI运行时。

核心功能

- 先进的加速技术:具备高级GPU/NPU加速功能,能够提供卓越的ML和GenAI性能,让设备端的ML推理变得更加轻松。

- 新的编译模型API:实现自动化加速器选择、真正的异步执行以及高效的I/O缓冲区处理,简化开发流程。

- 统一的NPU加速:为主要芯片组供应商的NPUs提供无缝访问,为开发者提供一致的体验。

- 一流的GPU性能:采用最先进的GPU加速技术进行设备端ML,新的缓冲区互操作性实现零拷贝,最大限度减少各种GPU缓冲区类型的延迟。

- 卓越的生成式AI推理:为GenAI模型提供最简单的集成方式和最佳性能。

支持的平台

LiteRT支持多种平台,包括Android、iOS、Linux、macOS、Windows、Web和IoT,并且在不同平台上提供了CPU、GPU和部分NPU的支持。

安装方法

可以从源代码构建LiteRT,具体步骤如下:

- 启动Docker守护进程。

- 运行

docker_build/目录下的build_with_docker.sh脚本。该脚本会自动创建一个Linux Docker镜像,可用于构建Linux和Android的工件(通过交叉编译)。

使用指南

根据不同的目标,开发者可以选择不同的使用路径:

- 有PyTorch模型:经典模型可使用LiteRT Torch Converter将PyTorch模型转换为

.tflite格式,并使用AI Edge Quantizer进行优化;大语言模型(LLMs)可使用LiteRT Generative Torch API将PyTorch LLMs转换为Apache格式,然后使用LiteRT LM进行部署。 - 新手开发者:初学者可通过Android Studio按照步骤创建实时分割应用;有经验的开发者可从入门指南开始,在Kaggle Models上找到预训练的

.tflite模型,并使用标准的LiteRT运行时将其集成到Android或iOS应用中。 - 追求高性能:可探索LiteRT API以利用硬件加速;处理生成式AI时,可使用LiteRT LM。

- 从事生成式AI开发:可深入研究LiteRT LM,专注于模型量化和针对大型模型架构的优化。

路线图

- 扩展硬件加速:扩大对NPUs的支持,并提高所有主要硬件加速器的性能。

- 生成式AI优化:为下一代设备端生成式AI模型引入新的优化和功能。

- 改进开发者工具:构建更好的工具用于调试、分析和优化模型。

- 平台支持:增强对核心平台的支持,并探索新的平台。

原文:https://mp.weixin.qq.com/s/eyDo2kMb0udRpP_2A6iivA

欢迎关注公zh:AI Tech研习社

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)