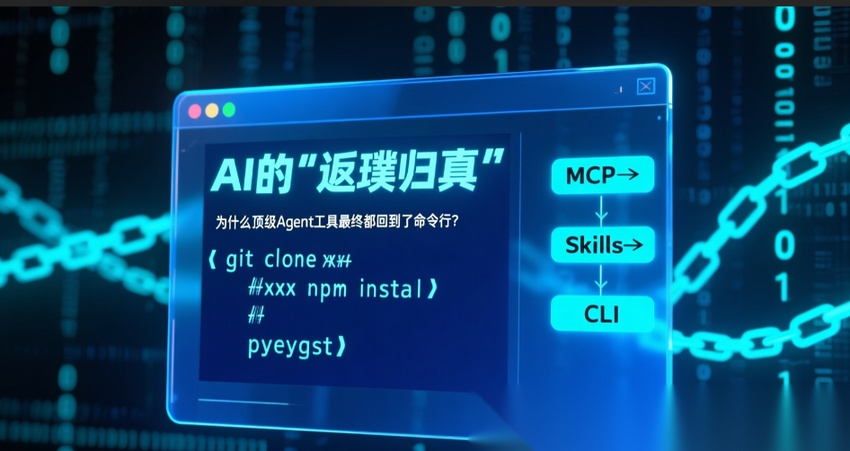

MCP、Skills、CLI深度解析(非常详细),顶级AI Agent回归命令行从入门到精通,收藏这一篇就够了!

如果你关注 2025 年到 2026 年各大厂的 AI 产品动向,会发现一个反常识的现象。腾讯 CodeBuddy 2.0 重点推出了"计划模式",核心能力跑在终端里。阿里 Qoder 专门为脚本化和 CI/CD 场景重写了一套 CLI 工具链。谷歌 Gemini CLI 甚至支持在终端里多模态输入输出,直接处理代码和图像。微软这边,PowerToys 和应用商店双双加入命令行能力。

如果你关注 2025 年到 2026 年各大厂的 AI 产品动向,会发现一个反常识的现象。

腾讯 CodeBuddy 2.0 重点推出了"计划模式",核心能力跑在终端里。阿里 Qoder 专门为脚本化和 CI/CD 场景重写了一套 CLI 工具链。谷歌 Gemini CLI 甚至支持在终端里多模态输入输出,直接处理代码和图像。微软这边,PowerToys 和应用商店双双加入命令行能力。

这些公司的产品团队,难道都没有产品经理吗?难道没人告诉他们图形界面更友好、更容易获客?

当然有人知道。但他们还是这么做了。

这背后,是 AI Agent 工具层的一次深刻反省。

第一阶段:MCP,“先把世界接进来”

时间拨回到 2024 年前后。

那时候 Agent 面临的最原始的问题是:AI 怎么调用外部世界?

模型本身是孤岛。它看不见你的文件系统,连不上你的数据库,也调用不了公司内部的 API。所有的智能,都被锁在对话框里。

MCP(Model Context Protocol)解决的就是这个问题。它做的事情说起来并不复杂:定义一套标准协议,让任何数据源和工具都能以统一格式向 AI 暴露能力。用一个不那么准确但足够直观的比喻——MCP 是给 AI 装的万能插座,什么都能接。

这一步是必要的,也是有价值的。

但问题很快暴露出来:能接上,不代表能用好。

当一个 Agent 接入的工具超过 20 个,事情开始变得混乱。工具描述全量塞进上下文,Token 成本线性上涨。更严重的是,模型在一大堆相似工具里根本选不准——调用逻辑靠 Prompt 驱动,Prompt 一变,行为就漂移。今天能跑通的流程,换个措辞明天就不灵了。

MCP 是接口层,不是能力层。它解决了"路"的问题,但没解决"车怎么开"。

第二阶段:Skills,“再把能力结构化”

意识到这个问题之后,行业开始往能力抽象的方向走。

思路是这样的:与其让 Agent 每次都从零理解工具,不如把工具组合成"可复用能力单元"——这就是 Skills 的核心逻辑。

MCP 给你的是 API(搜索接口、浏览器控制、数据库查询);Skills 给你的是封装好的能力(“竞品分析”、“生成周报”、“代码审查”)。把领域知识和 SOP 固化进去,让 AI 不用反复被教育,直接"按手册办事"。

AI 从聪明的新人,变成了按流程办事的专家。

这一步也是有价值的,而且很多企业在场景稳定的情况下确实从中受益。

但新的瓶颈随之而来,而且比上一个更隐蔽。

第一,黑盒化。Skill 内部的逻辑对外不可见,出了问题极难调试。你只知道结果不对,但不知道是哪一步出了问题。

第二,组合复杂度爆炸。Skill 套 Skill,调用链拉长,递归地狱随时出现。

第三,也是最根本的——执行依然不确定。Skills 解决了结构问题,但没有解决确定性问题。调用逻辑最终仍然落在 LLM 的决策上,同一个 Skill,在不同上下文里可能跑出完全不同的结果。

2025 年底,行业里开始出现一种声音:“Skills 让 AI 变聪明了,但变慢了,也变不可控了。”

第三阶段:CLI,不是退步,是换了一个解题思路

这时候,CLI 回来了。

我刻意用"回来"这个词,是因为很多人的第一反应是——这不是技术倒退吗?

倒退的说法,忽略了一个关键的认知转变:AI Agent 工具层的核心矛盾,从"能不能用好能力",变成了"能不能稳定执行任务"。

MCP 解决的是"能用",Skills 解决的是"好用",而 CLI 解决的是可控、可观测、可落地。

具体来说,CLI 有四个对企业场景至关重要的特性:

其一,确定性。

git clone xxx && npm install && pytest

这条命令无论执行多少次,输入输出的关系是稳定的,没有歧义,没有随机性。这是 LLM 驱动的 Skill 天然做不到的事情。

其二,可观测性。

CLI 有 stdout、stderr、exit code、完整的执行日志。Agent 干了什么、出了什么错、是否可以重试——全部有据可查。这比 Skill 的黑盒调试体验好了不止一个量级。

其三,可组合性。

Unix 的管道哲学:每个工具做好一件事,通过 | 组合成复杂能力。

git diff | ai review --format json | jq '.issues[] | select(.severity == "critical")'

这条命令链,在 MCP 或 Skills 架构下,需要多少胶水代码才能实现?

其四,生态继承。

这一点常被低估。人类用了五十年建设起来的命令行工具生态——Git、Docker、grep、awk、curl——AI Agent 通过 CLI 一夜之间全部继承。不需要为每个工具单独写 Skill,不需要重新造轮子。

一个容易被忽视的细节:AI 的"母语"问题

还有一个更底层的原因,值得单独说。

大模型的训练数据里有海量代码,而代码里充斥着 Unix 命令、Shell 脚本、CLI 调用。从这个角度看,CLI 是模型真正的"母语"之一。

调用一个 CLI 工具,对模型来说几乎是零学习成本。但理解一套新的工具协议(比如一个自定义的 MCP 扩展),则需要额外的上下文注入和示例说明。

这个差异在单次调用里感知不明显,但在高频、复杂的 Agent 任务里,会放大成显著的准确率差距。

三代不是替代关系,是分层重构

说到这里,需要纠正一个常见的误读:

CLI 的回归,不意味着 MCP 和 Skills 被淘汰。

最先进的 Agent 架构,已经在做三层融合:

[ LLM 决策层 ] ↓[ Skills 能力抽象层 ] ↓[ CLI / Tool 执行层 ]

分工是清晰的:MCP 负责接入外部能力(连接世界),Skills 负责定义"做什么"(任务抽象),CLI 负责"怎么稳定做"(执行落地)。

控制权的流向变了:从完全依赖 LLM 理解和决策,到逐步将执行确定性交还给系统本身。

这不是技术的轮回,是工程理性的回归。

给企业技术决策者的三个判断信号

如果你正在为团队的 Agent 工具层做选型,以下几个信号值得关注:

信号一:工具数量超过 15 个,MCP 架构需要重新评估。

超过这个阈值,上下文污染和工具歧义问题会显著影响准确率和延迟。此时应该考虑引入 Skill 封装或 CLI 化改造。

信号二:业务场景变化快,Skills 的维护成本会失控。

Skills 适合边界清晰、流程稳定的场景。如果你的业务逻辑每季度都在调整,为每个新场景维护一套 Skill 的成本会快速超过收益。

信号三:上 Computer Use 之前,安全体系必须先到位。

让 Agent 直接操作系统环境,安全隔离从"最佳实践"变成了"生死线"。沙箱、最小权限原则、操作审计日志——这三件事没做好之前,不要贸然上线。

最后

回到最开始的问题:为什么顶级 AI Agent 最后都回到了命令行?

因为 Agent 的本质进化,不只是变得更聪明,而是变得更工程化——从依赖模型的理解力,走向依赖系统的执行力。

当技术足够强大时,最朴素的接口往往是最有力量的那一个。

命令行存在了五十年,不是因为没人想取代它,而是因为它解决的那个问题——确定性、可组合、可观测——始终是工程系统最核心的需求。

AI Agent 绕了一大圈,最终发现这个道理,不是倒退,是成熟。

学AI大模型的正确顺序,千万不要搞错了

🤔2026年AI风口已来!各行各业的AI渗透肉眼可见,超多公司要么转型做AI相关产品,要么高薪挖AI技术人才,机遇直接摆在眼前!

有往AI方向发展,或者本身有后端编程基础的朋友,直接冲AI大模型应用开发转岗超合适!

就算暂时不打算转岗,了解大模型、RAG、Prompt、Agent这些热门概念,能上手做简单项目,也绝对是求职加分王🔋

📝给大家整理了超全最新的AI大模型应用开发学习清单和资料,手把手帮你快速入门!👇👇

学习路线:

✅大模型基础认知—大模型核心原理、发展历程、主流模型(GPT、文心一言等)特点解析

✅核心技术模块—RAG检索增强生成、Prompt工程实战、Agent智能体开发逻辑

✅开发基础能力—Python进阶、API接口调用、大模型开发框架(LangChain等)实操

✅应用场景开发—智能问答系统、企业知识库、AIGC内容生成工具、行业定制化大模型应用

✅项目落地流程—需求拆解、技术选型、模型调优、测试上线、运维迭代

✅面试求职冲刺—岗位JD解析、简历AI项目包装、高频面试题汇总、模拟面经

以上6大模块,看似清晰好上手,实则每个部分都有扎实的核心内容需要吃透!

我把大模型的学习全流程已经整理📚好了!抓住AI时代风口,轻松解锁职业新可能,希望大家都能把握机遇,实现薪资/职业跃迁~

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

更多推荐

已为社区贡献673条内容

已为社区贡献673条内容

所有评论(0)