Meta AI Coding 面试复盘:一次“可以用 AI”的面试,到底在考什么?

这次想系统整理一下我最近经历的一场 Meta AI Coding 面试。和传统算法面试相比,这一轮的形式和考察重点都有明显变化,尤其是“允许使用 AI”这一点,很容易让人误判准备方向。如果你正在准备 Meta,或者未来可能会遇到类似的 AI coding round,这篇可以作为一个相对完整的参考。

这次想系统整理一下我最近经历的一场 Meta AI Coding 面试。和传统算法面试相比,这一轮的形式和考察重点都有明显变化,尤其是“允许使用 AI”这一点,很容易让人误判准备方向。

如果你正在准备 Meta,或者未来可能会遇到类似的 AI coding round,这篇可以作为一个相对完整的参考。

面试整体情况

这轮面试使用的是 Python,题目背景围绕一个比较典型的场景:Friend Recommendation(好友推荐)。形式上依然是在类似 CoderPad 的环境中进行,但节奏是由面试官主导推进的,而不是完全自由发挥。

过程中会穿插一些基础但关键的问题,比如时间复杂度、方案选择以及代码是否存在潜在问题。同时,面试官也会要求你现场运行代码,确保实现是正确的。

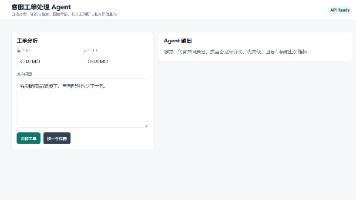

比较特别的一点是,这一轮允许使用 AI。我当时使用的是 Claude Opus。不过实际体验下来,AI 并没有让面试变简单,反而让考察维度变得更全面。

题目内容回顾

这一轮整体分为三个部分,难度是逐步递进的。

第一部分是一个函数修复问题。给定一个 valid_recommend 函数,需要让它通过已有的测试用例。输入是一个 user 和一个 user list,但函数中没有排除用户自己出现在推荐结果中的情况。这个问题本身不复杂,更偏向基础的代码理解与逻辑修正。我当时补充了一层简单判断,确保不会推荐自己,很快就通过了测试。

第二部分是实现一个 random_recommend 函数,这一问开始允许使用 AI。一开始我尝试直接让 AI 生成完整实现,但运行后发现存在问题,代码无法正常通过测试。随后调整思路,先自己明确逻辑结构,再让 AI 辅助生成部分代码,通过多轮修改和验证,最终才完成一个可运行的版本。这一部分的关键在于,你需要具备判断和修正 AI 输出的能力,而不是直接依赖结果。

第三部分是一个开放性问题:如何评估好友推荐算法的效果。最初我列举了一些常见的推荐系统指标,比如准确率、召回率等,但面试官提示需要结合当前数据结构。由于题目中的 User class 仅包含 id 和 currentFriends,缺乏更多用户属性,因此很多常规指标并不适用。最终将思路聚焦在可落地的方向,比如基于共同好友数量的推荐合理性,以及推荐后是否建立连接等。

和传统 Coding 面试的差异

从整体体验来看,这一轮与传统算法面试存在明显差异。

首先,AI 的引入改变了解题方式。候选人不再需要从零实现所有细节,但同时也必须对 AI 输出负责。如何合理使用工具,成为新的考察重点。

其次,面试更加关注过程。面试官会持续关注你的思考路径,包括问题拆解方式、代码验证过程以及决策依据,而不仅仅是最终结果。

最后,工程能力的重要性更加突出。包括是否考虑边界情况、是否进行测试验证、是否能够清晰解释复杂度等,这些都会直接影响评价。

一些值得注意的点

结合这次面试,有几个方面值得特别注意。

第一,不要过度依赖 AI。AI 可以辅助,但不能替代你的判断。

第二,提问方式很关键。相比让 AI 直接生成完整代码,更有效的方式是让它辅助某一部分实现或进行局部优化。

第三,必须进行验证。无论是手动推演还是运行测试,这一步都不能省略。

第四,在开放问题中要关注约束条件。所有方案都需要建立在已有数据结构的基础之上,否则很容易流于空泛。

如果你正在准备 AI Coding 面试

从最近接触的情况来看,很多同学的问题其实并不在算法本身,而是在这种新型面试形式上,比如:

-

不知道什么时候该用 AI

-

不知道如何有效提问

-

AI 给出结果后缺乏判断能力

-

面试过程中节奏容易失控

这些问题如果不提前适应,在真实面试中会非常吃亏。

我们这边(Programhelp)最近也在专门做这一类 AI Coding 面试的辅导,包括真实流程模拟、AI 使用方式训练,以及关键卡点的思路梳理。和传统刷题不同,这类面试更依赖方法和经验,有针对性的训练往往能在短时间内带来比较明显的提升。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)