从零开始使用ollama本地部署大模型

本文介绍了Ollama的安装使用及模型部署方法。首先从官网下载安装Ollama,建议修改默认安装路径避免占用C盘空间。然后详细说明了如何部署模型,以千问模型为例,展示了从搜索到运行的全过程。文章重点介绍了常用客户端命令:run(运行模型)、pull(下载模型)、list/ls(查看本地模型)、ps(查看运行中模型)、rm(删除模型)和show(查看模型信息)。针对不同配置的机器给出了参数建议,如i

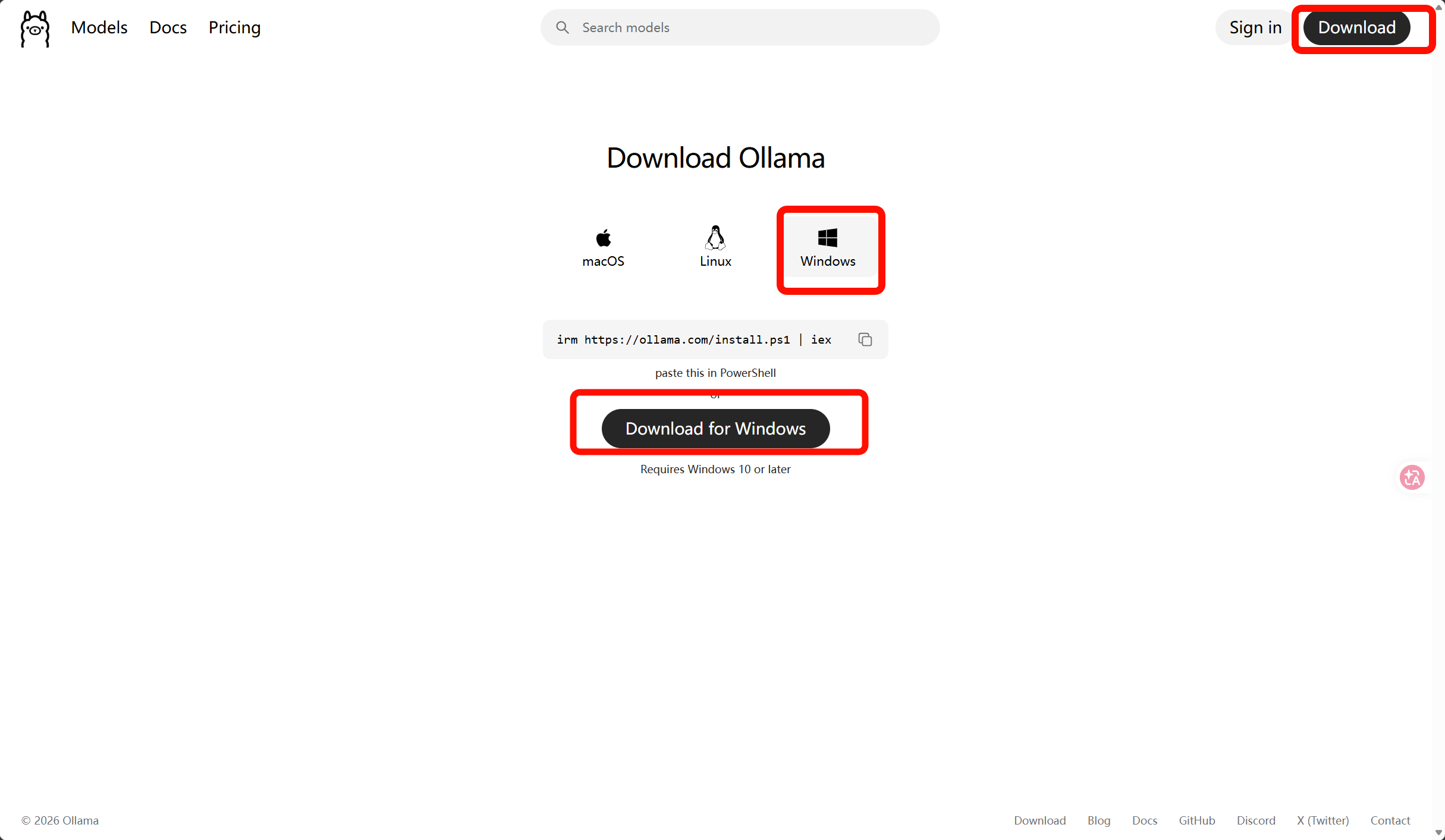

1.ollama下载安装

官网:https://ollama.com/download

安装步骤(下一步下一步即可)

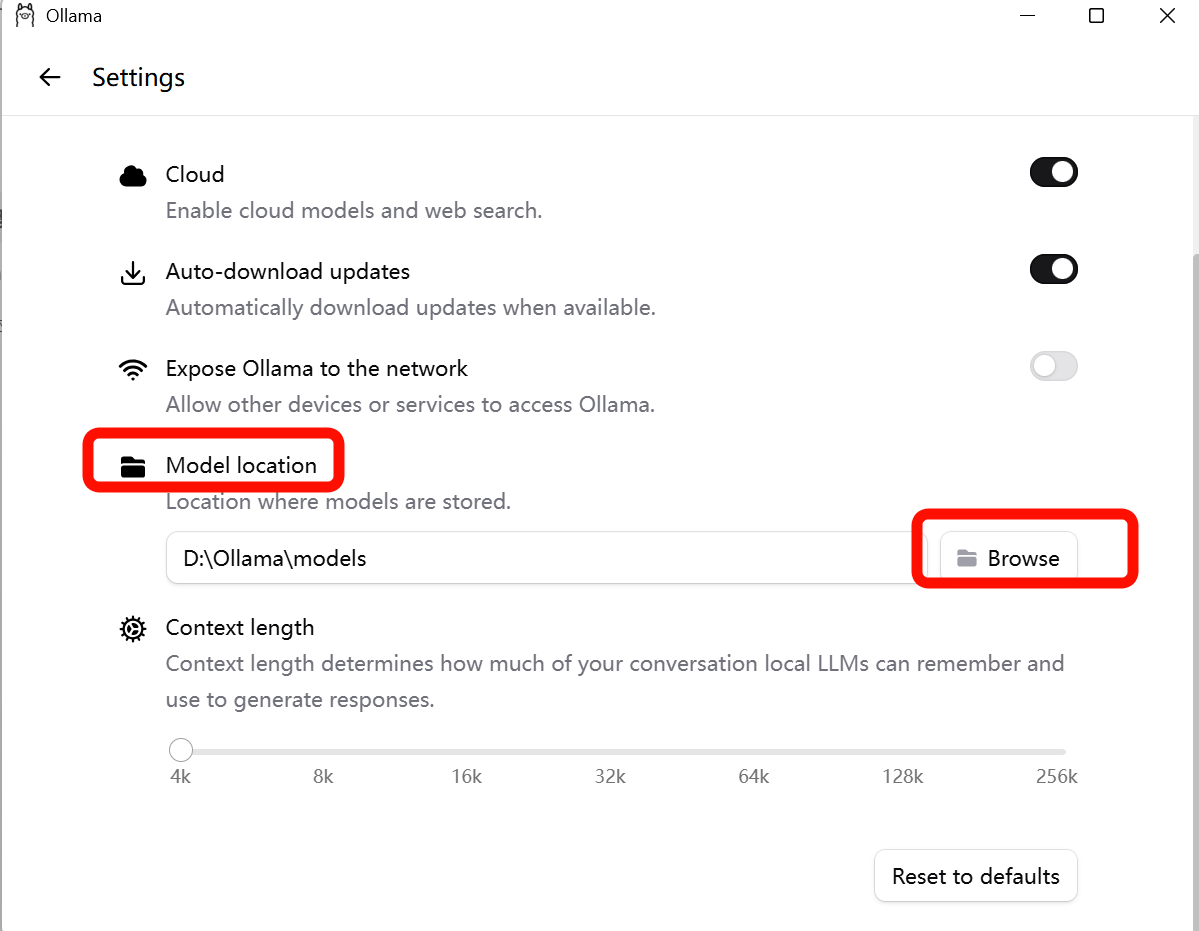

修改模型下载位置,默认C盘这里我改为了D盘

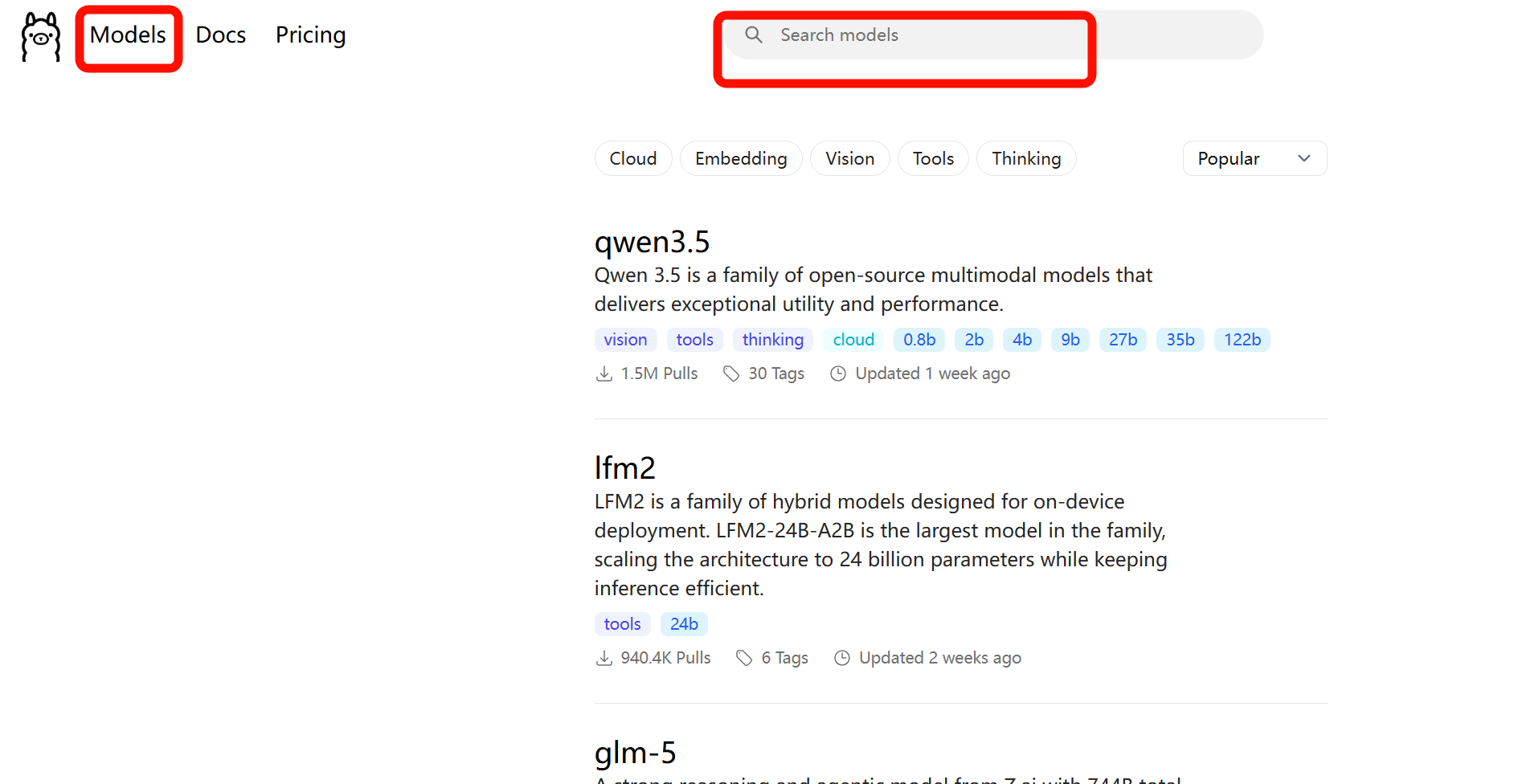

2.ollama部署模型及常见客户端命令

a.本地部署模型

官网搜索支持的模型

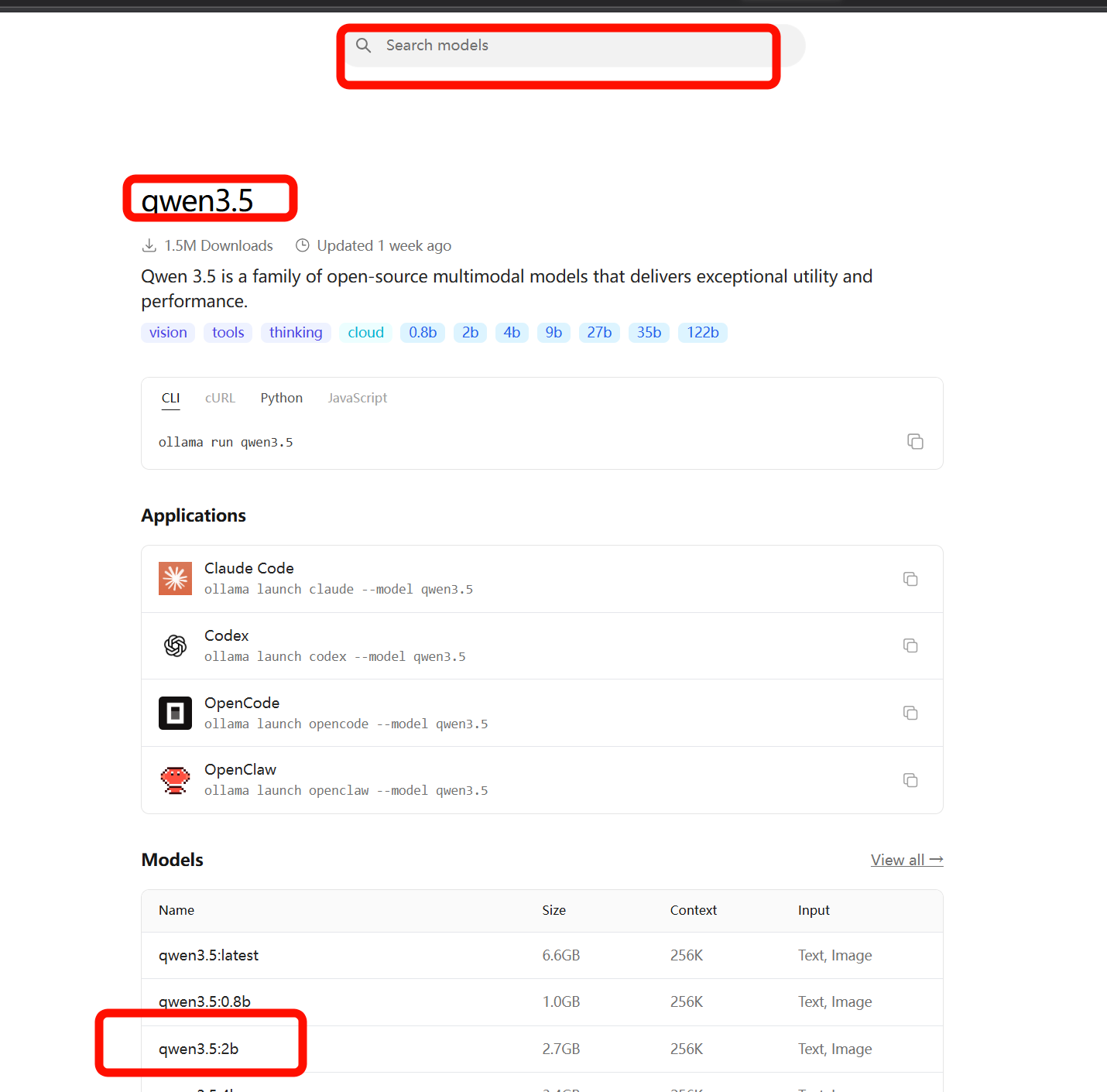

以千问为例部署

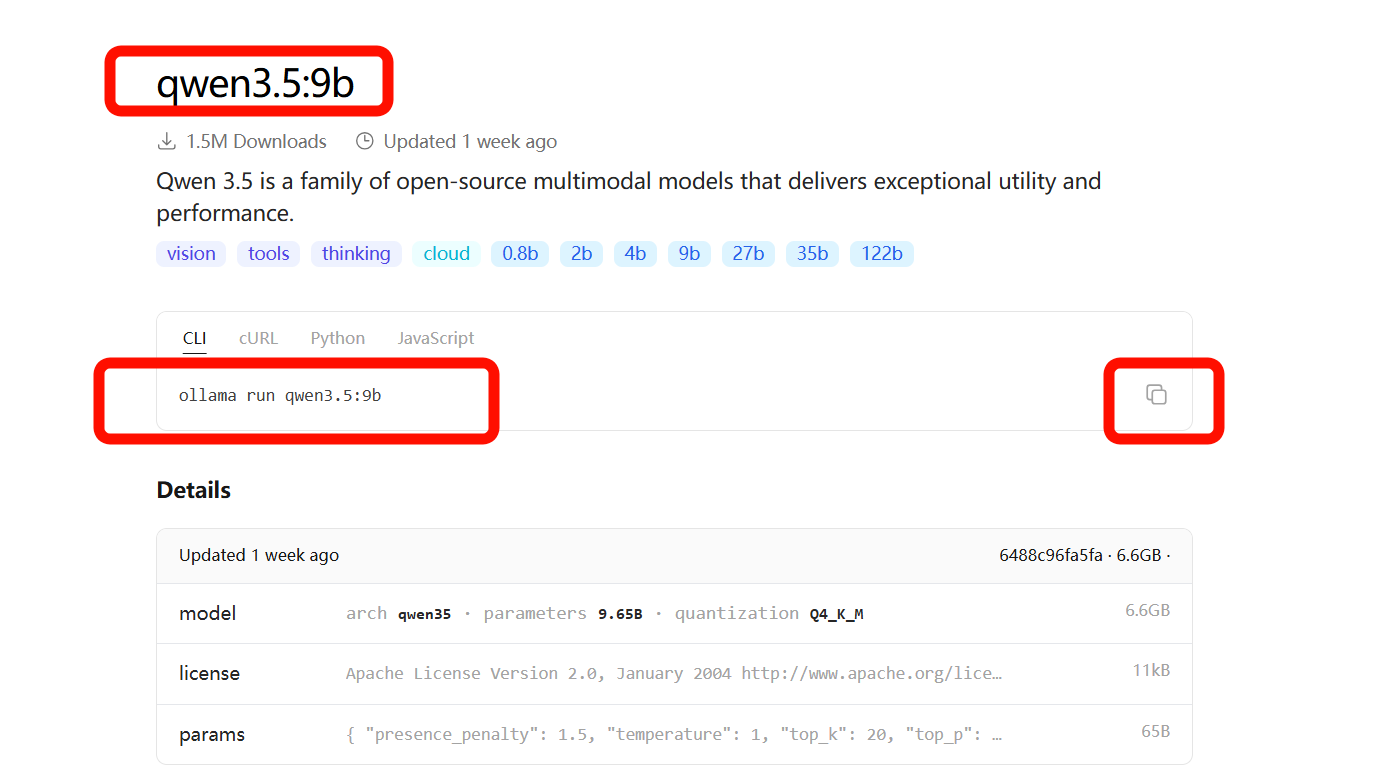

搜索并打开要部署的模型

打开具体参数的模型

大模型的参数规模是衡量其复杂度和能力的重要指标,通常以“B”(billion,十亿)为单位。例如,GPT-3 拥有 1750 亿参数,而更先进的模型如 DeepSeek-V3 则达到 6710 亿参数。参数是神经网络中的可调节数值,通过训练学习数据中的模式,决定了模型的性能和任务处理能力。

我的机器是i7十二代,内存16g,显卡3050ti测试跑8b及以下没有问题

复制命令:ollama run qwen......

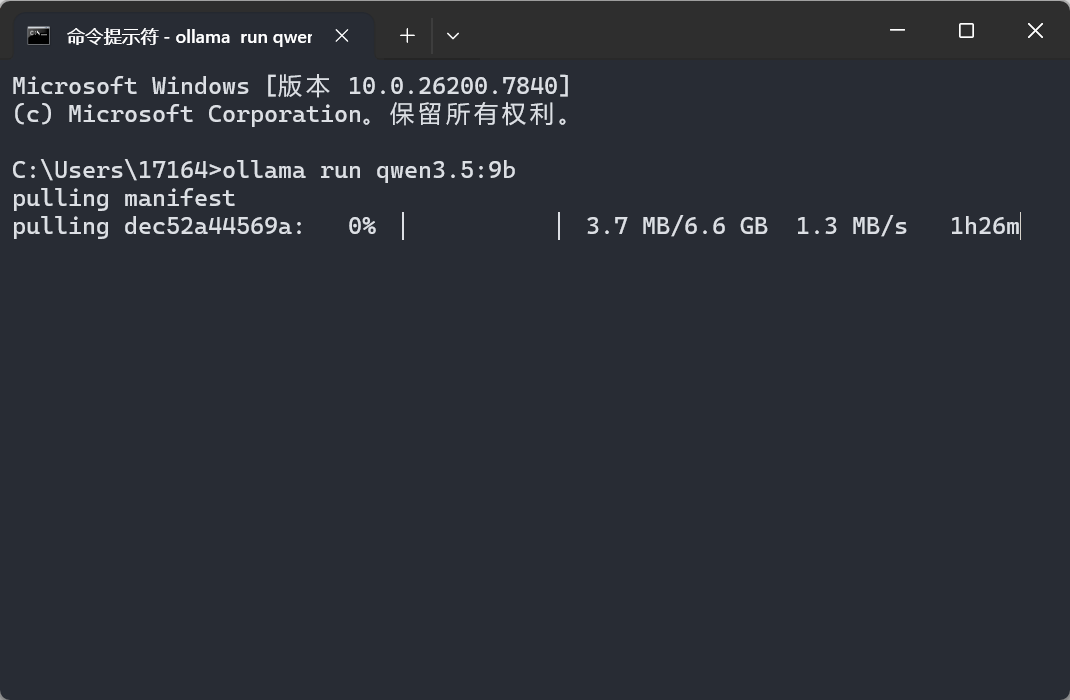

cmd打开命令行窗口粘贴并运行

等待部署结束即可

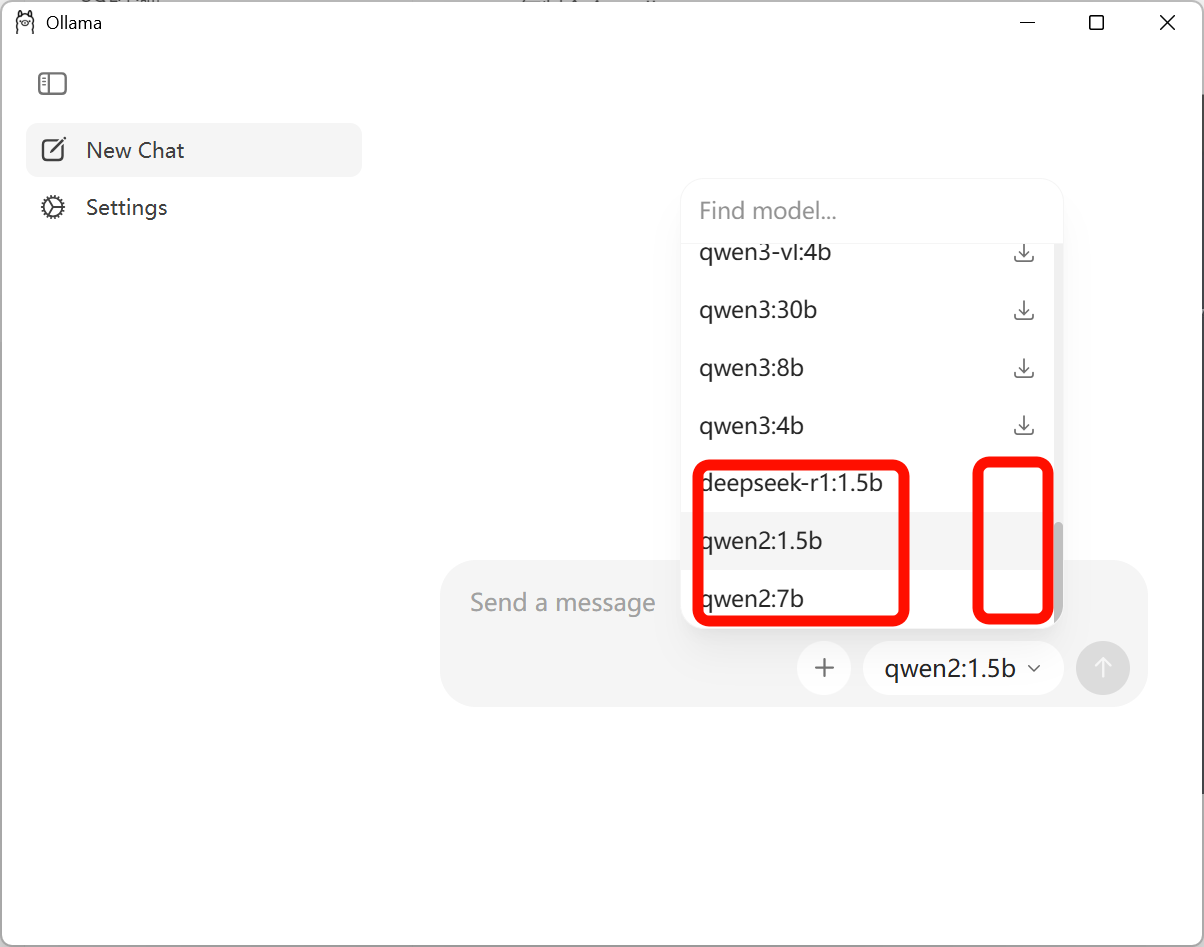

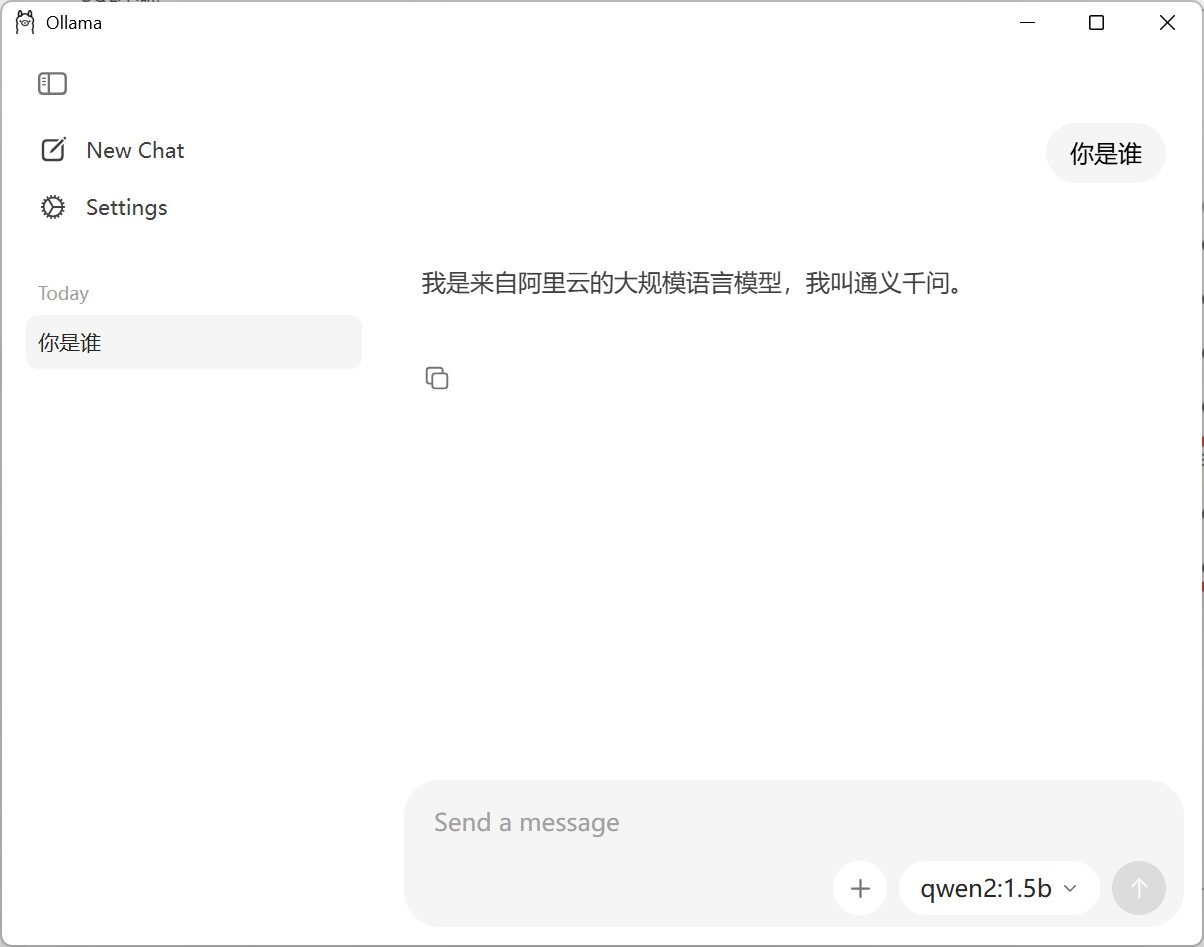

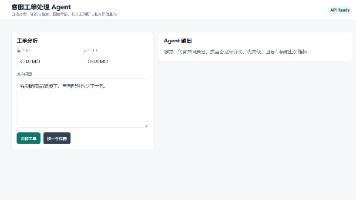

打开ollama客户端检查并尝试

部署完成

b. 常见客户端命令

run 命令¶

run命令主要用于运行一个大模型,命令格式是:

ollama run MODEL[:Version] [PROMPT] [flags]

比如,运行通义千问命令:

ollama run qwen2:0.5b[:Version] 可以理解成版本,而版本信息常常以大模型规模来命名,可以不写,不写则模式成latest

ollama run qwen2

等同

ollama run qwen2:latest[PROMPT] 参数是用户输入的提示词,如果带有此参数则,run命令会执行了输入提示词之后即退出终端,即只对话一次。

[root@bogon ~]# ollama run qwen2:0.5b 您好

您好!有什么问题我可以帮助您?

[root@bogon ~]#[flags] 指定运行时的参数

Flags:

--format string 指定运行的模型输出格式 (比如. json)

--insecure 使用非安全模,比如在下载模型时会忽略https的安全证书

--keepalive string 指定模型在内存中的存活时间

--nowordwrap 关闭单词自动换行功能

--verbose 开启统计日志信息例如,在启动时增加 --verbose参数,则在对话时,自动增加统计token信息:

[root@bogon ~]# ollama run qwen2:0.5b --verbose

>>> 您好

欢迎光临,我可以为您提供帮助。有什么问题或需要帮助的地方?

total duration: 1.229917477s

load duration: 3.027073ms

prompt eval count: 10 token(s)

prompt eval duration: 167.181ms

prompt eval rate: 59.82 tokens/s

eval count: 16 token(s)

eval duration: 928.995ms

eval rate: 17.22 tokens/spull 命令¶

查询模型名称的网站:https://ollama.com/

从远程下载一个模型,命令格式是:

ollama pull MODEL[:Version] [flags][:Version] 可以理解成版本,但在这里理解成大模型规模,可以不写,不写则模式成latest

ollama pull qwen2

等同

ollama pull qwen2:latest[flags] 参数,目前只有一个--insecure参数,用于来指定非安全模式下载数据

ollama pull qwen2 --insecurelist/ls 命令¶

查看本地下载的大模型列表,也可以使用简写ls

[root@bogon ~]# ollama list

NAME ID SIZE MODIFIED

qwen2:latest e0d4e1163c58 4.4 GB 10 minutes ago

deepseek-coder:latest 3ddd2d3fc8d2 776 MB 3 hours ago

qwen2:0.5b 6f48b936a09f 352 MB 8 hours ago

[root@bogon ~]# ollama ls

NAME ID SIZE MODIFIED

qwen2:latest e0d4e1163c58 4.4 GB 10 minutes ago

deepseek-coder:latest 3ddd2d3fc8d2 776 MB 3 hours ago

qwen2:0.5b 6f48b936a09f 352 MB 8 hours ago列表字段说明:

- NAME:名称

- ID:大模型唯一ID

- SIZE:大模型大小

- MODIFIED:本地存活时间

ps 命令¶

查看当前运行的大模型列表,PS命令没其它参数

[root@bogon ~]# ollama ps

NAME ID SIZE PROCESSOR UNTIL

deepseek-coder:latest 3ddd2d3fc8d2 1.3 GB 100% CPU About a minute from now列表字段说明:

- NAME:大模型名称

- ID:唯一ID

- SIZE:模型大小

- PROCESSOR:资源占用

- UNTIL:运行存活时长

rm 命令¶

删除本地大模型,RM命令没其它参数

[root@localhost system]# ollama ls

NAME ID SIZE MODIFIED

qwen2:latest e0d4e1163c58 4.4 GB 16 hours ago

deepseek-coder:latest 3ddd2d3fc8d2 776 MB 19 hours ago

qwen2:0.5b 6f48b936a09f 352 MB 24 hours ago

[root@localhost system]# ollama rm qwen2:0.5b

deleted 'qwen2:0.5b'

[root@localhost system]# ollama ls

NAME ID SIZE MODIFIED

qwen2:latest e0d4e1163c58 4.4 GB 16 hours ago

deepseek-coder:latest 3ddd2d3fc8d2 776 MB 19 hours ago

[root@localhost system]#show 命令¶

不用运行大模型,查看模型的信息,与之前所学的/show功能类似。

[root@bogon ~]# ollama show -h

Show information for a model

Usage:

ollama show MODEL [flags]

Flags:

-h, --help 查看使用帮助

--license 查看模型的许可信息

--modelfile 查看模型的制作源文件Modelfile

--parameters 查看模型的内置参数信息

--system 查看模型的内置Sytem信息

--template 查看模型的提示词模版例如,查看提示词模版:

[root@bogon ~]# ollama show qwen2 --template

{{ if .System }}<|im_start|>system

{{ .System }}<|im_end|>

{{ end }}{{ if .Prompt }}<|im_start|>user

{{ .Prompt }}<|im_end|>

{{ end }}<|im_start|>assistant

{{ .Response }}<|im_end|>更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)