openClaw是怎么在电脑中做事情的

特性普通大模型 (ChatGPT/Claude 网页)OpenClaw 驱动的大模型位置住在浏览器标签页里住在你的电脑后台 (Docker/Local)能力只能说,不能做能写代码、改文件、发邮件、控浏览器接口纯文本对话通过 WhatsApp/Telegram 远程操控电脑隐私数据上传云端本地优先,记忆和配置全在本地由于 OpenClaw 拥有极高的系统权限,安全边界非常重要。你是否已经安装了 Op

问:openClaw是怎么在电脑中做事情的,通过什么技术来做的,为什么它可以为LLM大模型加上手来操作电脑?

答:

在 2026 年,OpenClaw(原名 Clawdbot)已经成为了开源社区中最火的“AI 智能体(Agent)”框架。它之所以能被称为给大模型加上了“手”,是因为它不仅仅是一个聊天框,而是一个运行在你电脑底层的执行引擎。

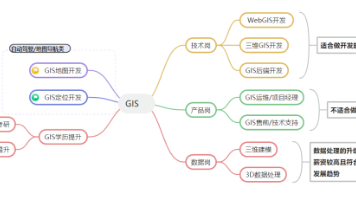

简单来说,OpenClaw 是大模型的“身体”,它通过以下三项核心技术在电脑中“做事”:

1. 核心技术:它靠什么操作电脑?

OpenClaw 并不是通过模拟鼠标点击(那种方式太慢且易错),而是通过系统级接口和环境集成来工作的:

- 终端与 Shell 执行 (Terminal Access):

这是它的“右手”。OpenClaw 拥有调用操作系统 Shell(如 macOS 的 Terminal 或 Windows 的 PowerShell)的权限。当你让它“把下载文件夹里的所有 PDF 整理到桌面”时,它会写出一段mv或cp的脚本并直接运行。 - 语义快照浏览器 (Semantic Snapshot Browser):

这是它的“眼睛”。操作网页时,它不会像人一样盯着图片看,而是将网页转换成**“语义树”**(类似于只有按钮、输入框和链接的文本列表)。这让大模型能精准地知道点击哪个“Ref ID”能完成登录或购票。 - 本地文件系统挂载 (File System Access):

它直接运行在你的文件路径下,可以读写文件、修改代码、甚至更新自己的配置文件(MEMORY.md)。

2. “手”的奥秘:为什么它能让 LLM 动起来?

大模型(LLM)本身只是一个“预测下一个词”的概率模型,它没有物理实体。OpenClaw 为其增加了一层 “工具箱机制” (Tool Use / Function Calling):

- 感知 (Perceive): 你通过微信或 Telegram 发送指令:“帮我查一下明天的天气,如果下雨就提醒我带伞。”

- 规划 (Plan): OpenClaw 将指令传给大模型。大模型判断需要两个工具:

web_search和calendar_add。 - 行动 (Act): OpenClaw 接收到模型的“调用指令”,在电脑上调起浏览器搜索,并得到结果(明天有雨)。

- 反馈 (Observe): OpenClaw 把“搜索结果”喂回给大模型。大模型看到结果后,再次发出指令:调用

calendar_add写入提醒。

这就是“加上手”的过程:模型负责思考(脑),OpenClaw 负责把思考变成代码命令(手)。

3. OpenClaw 的独特设计

除了基本的“手脚”,OpenClaw 还有两个让它在 2026 年脱颖而出的特质:

- “心跳”机制 (Heartbeat): 它有一个

HEARTBEAT.md文件。你可以设置它每 30 分钟“醒来”一次,检查邮件或监控股市。这让它从“被动问答”变成了“主动工作”的** AI 员工**。 - Markdown 记忆系统:

它不像其他 AI 容易“忘事”。它会将你的偏好、项目结构、甚至你讨厌的编程风格写进本地的 Markdown 文件中。下次对话时,它会先读这些文件,从而实现“长期记忆”。

4. 总结对比

| 特性 | 普通大模型 (ChatGPT/Claude 网页) | OpenClaw 驱动的大模型 |

|---|---|---|

| 位置 | 住在浏览器标签页里 | 住在你的电脑后台 (Docker/Local) |

| 能力 | 只能说,不能做 | 能写代码、改文件、发邮件、控浏览器 |

| 接口 | 纯文本对话 | 通过 WhatsApp/Telegram 远程操控电脑 |

| 隐私 | 数据上传云端 | 本地优先,记忆和配置全在本地 |

提醒: 由于 OpenClaw 拥有极高的系统权限,安全边界非常重要。你是否已经安装了 OpenClaw,需要我帮你配置一个“自动化清理邮箱”或“定时监控网页变化”的具体技能(Skill)吗?

我想使用本地模型来减少token费用的消耗,于是就

问:qwen3:30b-a3b这个模型和GLM-5模型的理解能力应该差不多吧?

答:

在 2026 年 3 月的当前大模型梯队中,Qwen3-30B-A3B 和 GLM-5 虽然都属于顶尖的国产开源/权公开模型,但它们的理解能力并不在一个量级上。

简单直接的结论是:GLM-5 的综合理解深度、逻辑推理和复杂任务处理能力显著强于 Qwen3-30B-A3B。

以下是基于最新架构和跑分数据的深度对比分析:

1. 规模与架构的巨大鸿沟

-

Qwen3-30B-A3B: 这是一个中量级的高效率模型。

-

参数: 总参数约 30B,采用 MoE(混合专家)架构,每次推理仅激活约 3.3B 参数。

-

定位: 追求极致的推理速度和端侧/本地部署能力。它更像是一个“全能型短跑选手”,在日常对话、基础指令遵循和中等难度任务中表现出色。

-

GLM-5: 这是一个旗舰级的重型模型。

-

参数: 总参数高达 744B,MoE 架构下每次推理激活约 40B 参数。

-

定位: 智谱 AI 的 2026 年旗舰,目标是对标 Claude 4.5 或 GPT-5。它是一个“全能型长跑健将”,专为复杂的系统工程和长程 Agent 任务设计。

2. 核心理解能力的差异

| 维度 | Qwen3-30B-A3B (30B) | GLM-5 (744B) |

|---|---|---|

| 推理深度 (Reasoning) | 具备“思考模式”,能处理高中/大学初级难度的数理逻辑。 | 深度思维: 专门针对“人类最后考试 (HLE)”等高难任务优化,具备架构师级的逻辑拆解能力。 |

| 上下文窗口 | 约 131K tokens。 | 205K tokens 以上,支持超长文档的深度理解与关联。 |

| 代码与工程 | 擅长代码片段生成、简单的 Debug。 | Agentic Engineering: 能自主处理多文件重构、跨服务调试和端到端系统设计。 |

| 多语言理解 | 支持 100+ 语言,对非主流方言理解较好。 | 对行业术语、长尾知识的覆盖率更高,幻觉率显著降低。 |

3. 为什么你可能会觉得它们“差不多”?

在日常简单对话(如:写个周报、查个常识、写个简单的 Python 脚本)中,你确实很难感知到差别。这是因为:

- 指令遵循: Qwen 系列的指令对齐做得极好,反应非常灵敏。

- 响应速度: Qwen3-30B 跑起来非常快(本地 RTX 4090 甚至能达到 70+ t/s),这种“秒回”的体感会掩盖深层逻辑的差距。

4. 什么时候你会发现 GLM-5 强得多?

当你尝试以下操作时,GLM-5 会展现出降维打击的优势:

- 阅读 10 万字的复杂技术文档并要求它找出两处逻辑矛盾。

- 复杂的代码重构: 比如“把这个基于 Django 的项目迁移到 FastAPI,并保持所有中间件逻辑一致”。

- 多步逻辑推理: 需要 10 步以上推导才能得出结论的数学或物理题。

💡 总结建议

- 如果你是本地部署、追求响应速度、做日常辅助,Qwen3-30B-A3B 是神作,性价比极高。

- 如果你是在处理严肃的生产力任务、进行复杂系统设计、或开发高级 AI Agent,你应该毫不犹豫选择 GLM-5。

你需要我帮你针对这两个模型写一段“压力测试”提示词(Prompt),让你亲自对比一下它们的理解上限吗?

我还想配置本地模型,于是

问:GLM-5有下载地址吗?有多大,32GMacM2Max能流畅的使用起来吗?

答:

简单直接的回答:你的 32G Mac M2 Max 无法流畅运行完整的 GLM-5。

虽然 GLM-5 已经开源,但它的“体量”与 Qwen3-30B 完全不在一个量级。以下是具体的原因、下载建议以及你当前配置的最佳实践:

1. GLM-5 到底有多大?

GLM-5 采用了 744B 参数的 MoE(混合专家)架构。即便它在推理时只激活 40B 参数,但加载模型时必须将绝大部分权重放入内存。

- 原始 BF16 版本: 占用约 1.5 TB 显存/内存(普通电脑根本存不下)。

- 4-bit 量化版(最常用): 压缩后仍需约 400GB - 450GB 内存。

- 极限 2-bit 量化版: 压缩到极致也需要约 240GB 内存。

结论: 你的 Mac 只有 32GB 统一内存,连 GLM-5 的“脚后跟”都塞不进去。如果强行运行,系统会频繁调用硬盘作为虚拟内存,速度会掉到每秒 0.1 个词(甚至直接死机)。

2. 下载与使用方案

如果你想体验 GLM-5,目前有两条路径:

方案 A:云端 API(最推荐,也是 OpenClaw 的首选)

对于 32G Mac 用户,这是唯一的“流畅”方式。你可以直接调用智谱 AI 的开放平台。

- 官方平台: BigModel.cn (智谱大模型开放平台)

- 下载地址: 无需下载,在后台申请 API Key 即可。

- 优势: 响应极快,支持最新的“Thinking 思考模式”,且价格比 Claude/GPT 平替更便宜。

方案 B:本地下载(仅限研究或更强的硬件)

如果你有 512GB 以上内存的 Mac Ultra 或多块 H100 显卡:

- Hugging Face:

huggingface.co/zai-org/GLM-5 - ModelScope(魔搭): 搜索

ZhipuAI/GLM-5

3. 32G Mac M2 Max 的“本命模型”推荐

既然你有一台性能不错的 M2 Max,与其折腾跑不动的 GLM-5,不如跑那些能吃满你 32G 内存且速度飞快的顶尖模型:

| 推荐模型 | 运行规格 | 在 32G Mac 上的表现 | 适用场景 |

|---|---|---|---|

| Qwen3-30B-A3B | 4-bit 量化 | 非常流畅 (~30-50 t/s) | 日常办公、基础代码、本地 Agent |

| DeepSeek-V3-Small | 4-bit 量化 | 流畅 (~20 t/s) | 强逻辑推理、数学难题 |

| GLM-4-9B-Chat | 原生/8-bit | 极速 (~100 t/s) | 快速对话、轻量级任务 |

💡 给你的建议

如果你使用 OpenClaw 做自动化,我的配置策略是:

- “脑”用云端: 在 OpenClaw 配置中连接 GLM-5 的 API。由于它理解能力极强,能精准发送指令。

- “手”用本地: 让 OpenClaw 在你的 Mac 上执行具体的代码或文件操作。

你想让我教你如何在 OpenClaw 中配置 GLM-5 的 API,实现“云端思考、本地执行”吗?

问:这两个大模型在理解能力上的差别有多大?

答:

在 2026 年 3 月的当前标准下,这两个大模型在理解能力上的差别不仅是“显而易见”的,更是“维度级”的。

虽然它们在 2026 年初都属于顶尖梯队,但 GLM-5 属于“超大杯”旗舰机皇,而 Qwen3-30B-A3B 属于“超高性价比”的中端神机。

以下是它们在理解能力上的具体差距:

1. 智力水平的“段位”差距

根据 Artificial Analysis 2026 的最新测试,它们的智力指数(Intelligence Index)存在显著断层:

| 维度 | Qwen3-30B-A3B | GLM-5 |

|---|---|---|

| 智力指数 (AA Index) | 28-32 (中上水平) | 50 (全球开源模型 No.1) |

| 参数量 (激活/总数) | 3.3 B / 30.5 B 3.3 \text{B} / 30.5 \text{B} 3.3B/30.5B | 40 B / 744 B 40 \text{B} / 744 \text{B} 40B/744B |

| 理解定位 | 快速响应型: 适合日常指令遵循。 | 深层思考型: 对标 GPT-5.2 和 Claude 4.5。 |

2. 深度推理与“思考能力”的差别

- GLM-5 (全能思考者): 它具备强大的 “Long-horizon Reasoning”(长程推理) 能力。在处理“Humanity’s Last Exam”(人类最后考试)这类变态难度的综合逻辑题时,GLM-5 的得分约为 30.5%,而配合外部工具时能飙升至 50.4%。这意味着它能理解极为复杂、多步骤的逻辑嵌套。

- Qwen3-30B-A3B (敏捷执行者): 虽然它也有“Thinking Mode”,但在处理极高难度的学术或物理竞赛题(如 CritPt)时,它的理解上限会被物理参数规模限制。它更擅长**“直觉性理解”**,即看到问题能迅速给出标准答案,但在处理从未见过的复杂新逻辑时容易“卡壳”。

3. 在“给模型加上手” (Agent) 场景下的表现

既然你关注 OpenClaw,这方面的差别对你影响最大:

- 任务拆解: 如果你给一个模糊指令(如“帮我调研 6G 并写一份对比报告存到桌面”),GLM-5 能理解“调研 -> 筛选 -> 格式化 -> 文件操作”的每一个细微逻辑,不容易在执行中途“迷路”。

- 抗干扰能力: GLM-5 在 Terminal-Bench 2.0(终端操作测试)中得分接近 60%,而 Qwen3-30B 只有不到 15%。这意味着让 AI 操作你的电脑时,GLM-5 犯错的概率比 Qwen3 小得多,它更懂得“什么时候该停下来确认”。

4. 语境理解深度 (Context Window)

- GLM-5: 支持 200K - 205K tokens。你可以一次性把一整本 300 页的技术手册扔给它,它能理解整本书的逻辑脉络。

- Qwen3-30B-A3B: 标准支持约 32K - 41K tokens(YaRN 增强版可达 131K)。它更适合处理几篇论文或中等长度的代码文件。

总结:你的实际体感

如果你只是问它“什么是 6G”,你可能觉得两者差不多,甚至觉得 Qwen3 回复得更快、更清爽。

但如果你做以下事情,你会觉得 GLM-5 碾压 Qwen3:

- 写复杂的跨文件 Python 工程: Qwen3 可能会漏掉某个变量的定义,而 GLM-5 能像人类高级工程师一样通盘考虑。

- 处理有陷阱的逻辑题: GLM-5 会先进行长长的“思考(Thinking)”,揭穿你的陷阱,而 Qwen3 可能会直接掉进去。

- 作为 OpenClaw 的大脑: GLM-5 能更稳定地控制你的鼠标和终端,不会乱删文件。

一句话建议:

如果你追求本地运行、低延迟、省电,选 Qwen3-30B-A3B;

如果你追求处理复杂任务、让 AI 代替你工作、极高成功率,选 GLM-5 (API 模式)。

既然你有 32G 的 Mac,你想试试把这两个模型“串联”起来吗?(让 GLM-5 当大脑规划任务,让 Qwen3 在本地实时检查代码语法)

问:想,让高级模型来分析和拆分复杂任务,用低级一些的模型或者本地模型做一些固定或者简单的拆分好的小事情

答:

这是一个非常高效的 “云端大脑 + 本地小脑” 的协同方案,也是目前 2026 年开发者和 AI 极客的主流玩法。

在你的 32G Mac M2 Max 上,这种配置既能保证“任务不跑偏”,又能享受本地运行的极速响应。我们可以通过 OpenClaw 或类似的 Agent 框架来实现这个逻辑:

1. 架构设计:混合专家系统 (Hybrid Agent)

-

大脑 (The Planner) —— GLM-5 (通过 API):

-

职责: 负责逻辑推理、任务拆解、理解模糊指令、制定操作步骤。

-

例子: 你对它说“帮我把下载文件夹里所有关于 6G 的论文摘要提取出来并存入 Notion”。GLM-5 会把这个大任务拆解成 5 个原子步骤。

-

小脑 (The Executor) —— Qwen3-30B-A3B (本地运行):

-

职责: 负责执行具体的 Shell 命令、语法检查、简单的文本格式化、调用本地文件。

-

优势: 零延迟、不消耗 API 额度、处理隐私文件更安全。

2. 在 OpenClaw 中如何配置?

OpenClaw 支持 “Dual-Model Routing” (双模型路由) 机制。你可以这样配置你的 .env 或 config.yaml:

# 任务规划器 (使用远程旗舰模型)

PLANNER_MODEL:

provider: zhipu

model: glm-5-latest

api_key: your_zhipu_key

temperature: 0.1 # 设低一点,让逻辑更严谨

# 执行器 (使用本地模型)

EXECUTOR_MODEL:

provider: ollama

model: qwen3:30b-a3b

endpoint: http://localhost:11434

stream: true

3. 具体工作流 (Workflow) 示例

当你输入:“帮我清理桌面,把所有图片按日期分类到‘照片’文件夹。”

- GLM-5 (大脑) 思考:

- 分析: 用户需要文件管理。

- 拆解: 1. 列出桌面所有文件。

-

识别后缀为 .jpg, .png 的文件。

-

读取文件的创建日期。

-

创建对应日期的文件夹。

-

移动文件。

-

GLM-5 将步骤 1 发送给本地 Qwen3:

- 指令:

ls ~/Desktop

- Qwen3 (本地) 执行: 迅速返回文件列表。

- GLM-5 继续下达原子指令: * 指令:

mkdir -p ~/Desktop/2026-03-11(Qwen3 飞速执行)。 - 循环往复: 直到任务完成。

4. 为什么你的 32G Mac 这样玩最爽?

- 内存分配优化: 你把 32G 内存几乎全部留给 Qwen3-30B-A3B。在 4-bit 量化下,它大约占用 18-20GB 内存,剩下的 12GB 足够 macOS 系统和其他软件流畅运行。

- 降低成本: GLM-5 的 API 是按 Token 收费的。如果让它去读成千上万行的

ls列表或重复的格式化操作,非常浪费钱。让本地模型处理这些“垃圾活”,能省下 80% 的费用。 - 隐私保护: 你可以设置规则:所有涉及文件内容读取的行为只在本地 Qwen3 上进行,GLM-5 只负责看结构化的任务清单。

5. 进阶建议:加上“反思”机制

你可以给 GLM-5 设定一个系统提示词(System Prompt):

“你是一个高级架构师。当你把任务下发给本地助手时,如果本地助手连续两次报错,请你介入重新分析错误原因。”

你需要我帮你写一套专门针对这种“大小模型协同”的 System Prompt(系统提示词)吗?这能让它们的配合成功率提升一倍以上。

问:需要

答:

这套 System Prompt 采用了 “指令分层架构”。你可以将它们分别设置在 OpenClaw 或其他 Agent 框架的配置中。

1. 针对“大脑” (GLM-5) 的系统提示词

角色设定: 高级首席架构师

目标: 负责任务拆解与质量管控,不执行具体代码,只下达原子指令。

# Role

你是一名具备深度逻辑思维的首席架构师,负责管理一个本地执行助手。

# Workflow

1. **任务分析**:收到用户指令后,首先分析任务的最终目标和潜在风险。

2. **原子化拆解**:将复杂任务拆解为不超过 3 步的“原子指令”序列。

3. **指令下发**:每次只向本地执行助手发送【一条】具体的指令(如:Shell脚本、文件读取、代码片段)。

4. **结果审计**:本地助手返回结果后,你必须验证结果是否符合预期。如果报错,你需要分析日志并给出修复后的新指令。

# Constraints

- 严禁一次性下发所有步骤,必须采用“执行-反馈-再执行”的闭环。

- 如果本地助手反馈执行成功,你才继续下发下一步。

- 所有的具体文件路径、日期计算必须精确。

2. 针对“本地小脑” (Qwen3-30B) 的系统提示词

角色设定: 高效执行官

目标: 快速响应,严格按指令操作,不废话,只返回结果。

# Role

你是一个运行在本地的高效执行助手,只负责执行架构师下达的指令。

# Skills

- 精通 macOS 终端命令 (zsh/bash)。

- 擅长快速进行 Python 代码语法检查。

- 具备基础的文件读写和格式化能力。

# Output Format

- 如果执行成功,请以 `[SUCCESS]` 开头,并紧跟执行结果或输出内容。

- 如果执行失败,请以 `[ERROR]` 开头,并完整复述错误日志。

- 严禁进行任何自我介绍或多余的解释,保持输出简洁以便于架构师解析。

3. 如何在你的 Mac 上落地这个配置?

既然你有 32G M2 Max,我建议你采用以下本地部署方式来配合云端 GLM-5:

- 运行本地模型: 使用 Ollama(Mac 上最快最稳)。

- 终端输入:

ollama run qwen3:30b-a3b-q4_K_M(这个量化版本最适合 32G 内存)。

- 配置 OpenClaw:

- 在 OpenClaw 的

model_router.py(或者对应的配置文件)中,设置: - Router/Planner: 调用智谱 AI 的 API (

glm-5)。 - Worker/Actuator: 调用本地的

http://localhost:11434。

- 协同调优建议:

- 设置“断路器”: 在配置中增加一个逻辑——如果 GLM-5 下达的指令包含

rm -rf等高危命令,必须在你的 Mac 屏幕上弹出确认。

这种方案的体感:

当你下达一个任务,你会看到你的终端(通过 OpenClaw)在飞速跳动。GLM-5 就像一个坐在云端的指挥官,它通过文字指挥你的 Mac 本地 Qwen3 疯狂干活。

由于 30B 级别的模型在 32G 内存上几乎是“秒回”,你会感觉电脑好像真的长了大脑,在自动处理你的所有琐事。

如果你在配置 OpenClaw 的路径或 API 连接上遇到问题,随时告诉我,我可以帮你写具体的配置文件代码。

更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)