ICLR 2026!腾讯混元联合 KCL 提出 WildToolBench,评估 Agent 对用户狂野行为的适应能力

研究团队提出WildToolBench基准测试,聚焦真实用户与AI交互中的"野生"行为模式。该测试包含256个场景,覆盖三大核心挑战:组合任务工具编排、多轮对话隐含意图推断和指令实时切换应对。评估58个主流模型发现,最高会话准确率不足15%,揭示现有AI工具调用能力与真实需求间的巨大差距。研究指出,未来AI发展需强化对用户复杂意图的理解,而非仅优化工具执行能力。数据集和评估框架

TLDR. Agent是强大的,但用户是狂野的

😦又是一个工具使用Benchmark?不是说模型厂商追逐榜单严重,忽略用户实际体验?

确实,但我们面对这个质疑提出了WildToolBench:当我们衡量模型的工具调用能力时,不能仅仅看在完美的提问下,完美的实验环境下,LLM能否操纵工具回答正确,因为用户是不完美的!这也是大部分榜单和现实世界的巨大gap来源之一。

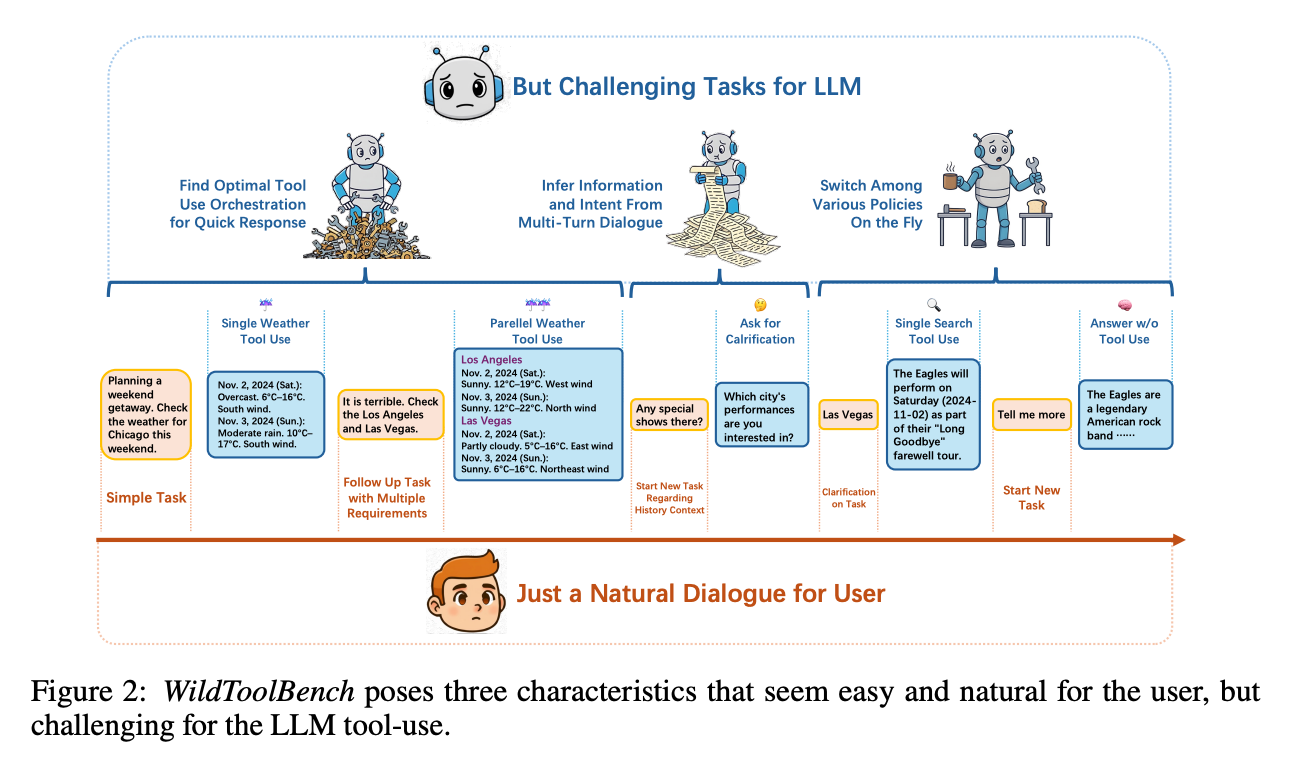

🤔我们总结了三类这样的用户不完美的Wild行为模式:

- • 提出复杂多要求问题,单步或者串联工具调用难以完美交付;

- • 多轮对话多步骤工具调用中隐含上下文,用户往往会混杂各种指代和隐藏意图,需要LLM自行推断;

- • 用户在工具调用和普通回答,澄清等多种对话模式中频繁切换。

我们针对这些行为模式构建了包含256个场景的Benchmark,测试了58个模型,包括开源闭源专有思考Agentic,发现当时最强模型session准确率也不超过15%。

🚀 榜单总是会被刷爆的,但作为发现问题的一环也是不可或缺的。我们看到过去一年其实大家针对这三类行为在不断改进,Anthropic直接提出Programmatic tool calling,将复杂工具编排作为coding看待,各家模型在各类vibe场景下也越来越智能,模型更准确的判断何时主动,何时调工具,何时用内在知识直接回答。

在Agentic时代,我们需要不断思考模型,用户,工具之间的关系。

WildToolBench 的数据集、评估脚本及可控多智能体数据合成框架已全部开源,欢迎大家一起讨论交流。

作者:Peijie Yu, Wei Liu, Yifan Yang, Jinjian Li, Zelong Zhang, Xiao Feng, Feng Zhang

单位:Tencent HY、King's College London

论文:https://openreview.net/forum?id=yz7fL5vfpn

Github:https://github.com/yupeijei1997/WildToolBench

详细解读

通过大型语言模型(LLM)的多轮、多步骤工具调用满足用户需求,往往并非简单直接的过程。真实用户交互本质上具有 “野生性”,复杂、杂乱且灵活。

我们从用户行为中识别出三大核心挑战:

- • 一是组合式任务,需高效编排工具调用拓扑结构;

- • 二是隐含意图,分散于多轮对话中,需结合上下文推理;

- • 三是指令转换,用户会混合任务查询、澄清提问与日常交流,迫使 LLM 实时调整策略。

现有基准测试忽视了这些行为,导致 LLM 在工具调用方面的表面进展存在误导性。为此,我们提出 WildToolBench—— 一个基于真实用户行为模式的 LLM 工具调用基准测试。对 58 个 LLM 的综合评估显示,无任何模型的准确率超过 15%,这表明 LLM 智能体能力的稳健性仍存在巨大差距。

受控实验与深度分析进一步表明,LLM 工具调用的真正挑战并非人为设计的复杂任务,而是用户行为的 “野生性”,这也凸显了重新审视 LLM、用户与工具三者间交互关系的必要性。

一直以来,现有 LLM 工具使用基准测试(如 BFCL 系列、TauBench 等)虽在推动技术发展中发挥了重要作用,但普遍存在场景理想化的问题。

它们往往将用户需求简化为明确、独立的任务,忽略了真实对话中用户行为的复杂性 —— 用户可能在一次对话中提出包含多个简单需求的复合任务,需要 Agent 高效协调多种工具;也可能将真实意图隐藏在多轮对话的上下文之中,要求 Agent 主动推断;更会在任务查询、澄清疑问与日常闲聊之间灵活切换,迫使 Agent 实时调整应对策略。

这些被现有基准忽视的 “野生” 用户行为,恰恰是 LLMs 在实际应用中面临的核心挑战,也让此前 LLM 工具使用能力的进步显得有些 “虚高”。

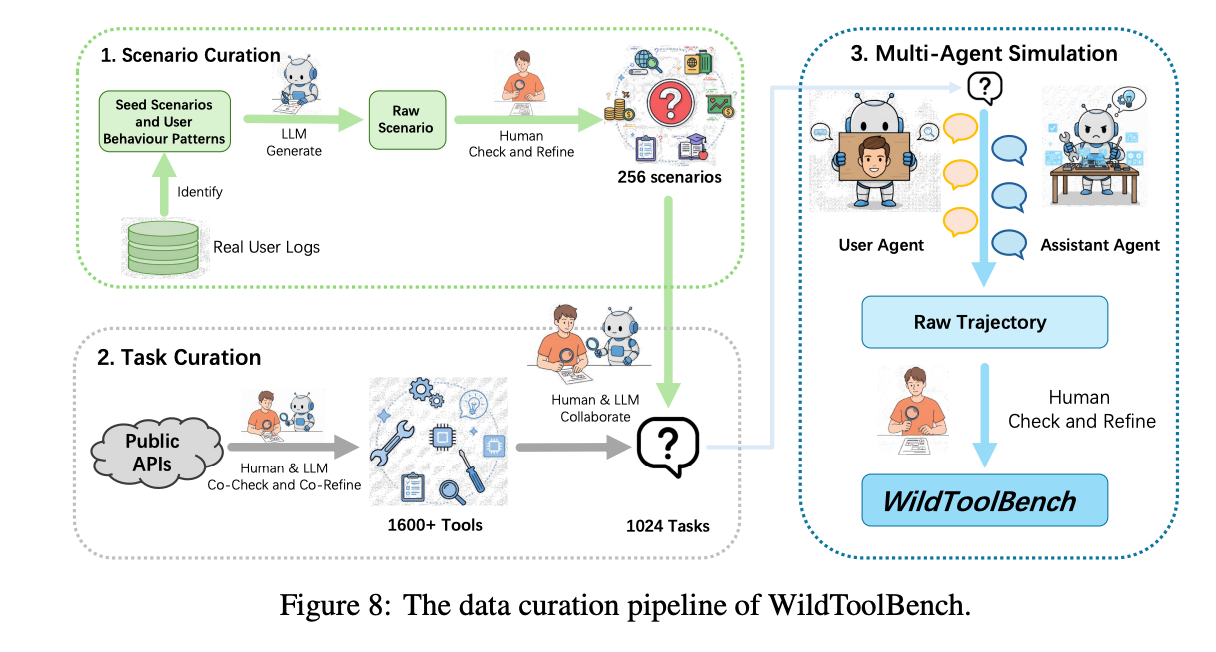

WildToolBench 的诞生,正是为了填补这一空白。它以真实用户行为模式为基石,通过精心设计的数据 pipeline,结合人工验证与标注,构建了 256 个场景、1024 项任务的庞大测试集。

与其他基准测试不同,WildToolBench 牢牢抓住真实用户交互的三大核心特性:复合任务的工具协同需求、上下文隐含意图的推断要求,以及指令类型灵活切换下的策略适配能力。

这一设计理念直指行业痛点 —— 真正考验 LLMs 工具使用能力的,并非人为构建的复杂场景,而是看似简单却贴合真实用户习惯的交互模式。

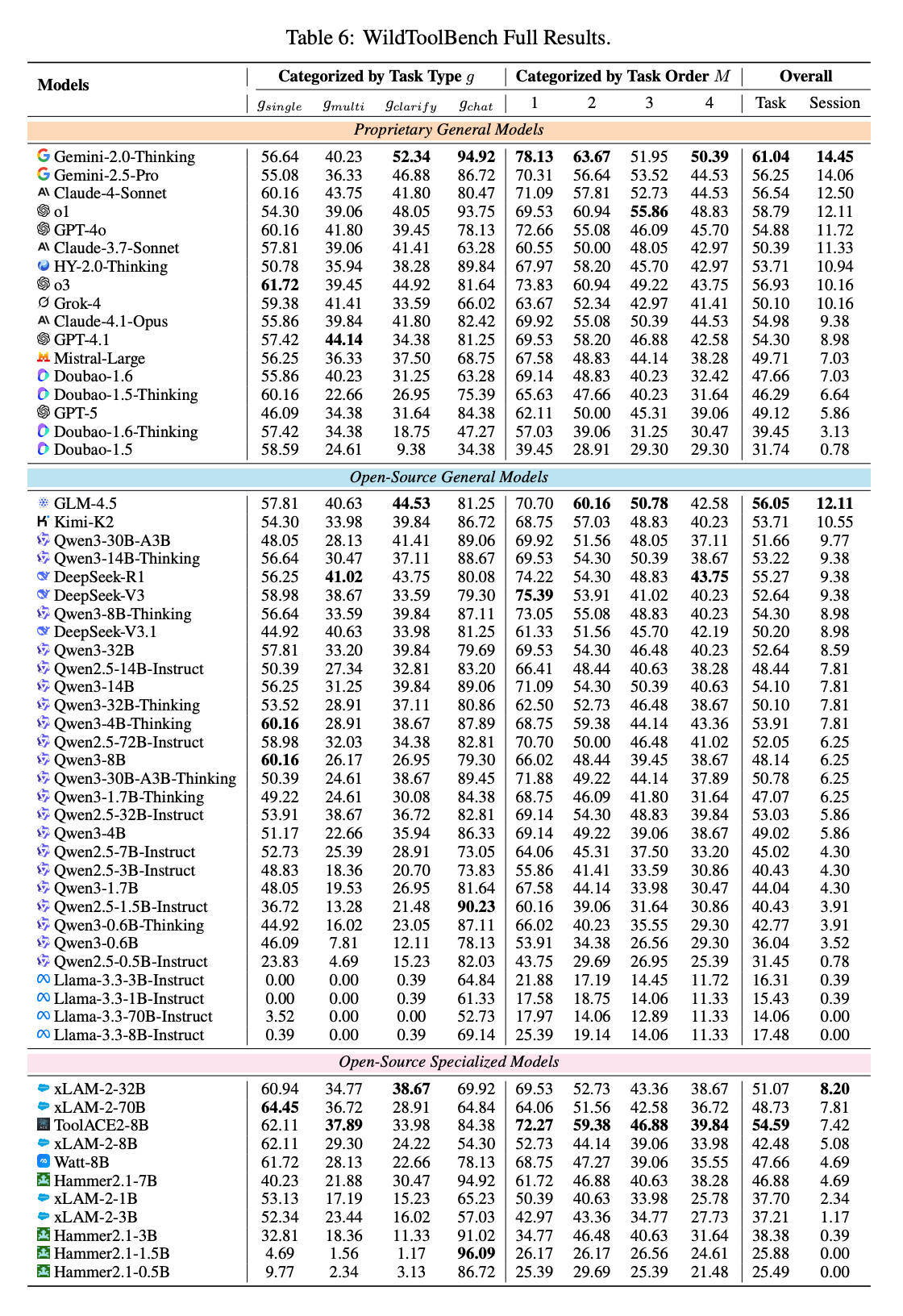

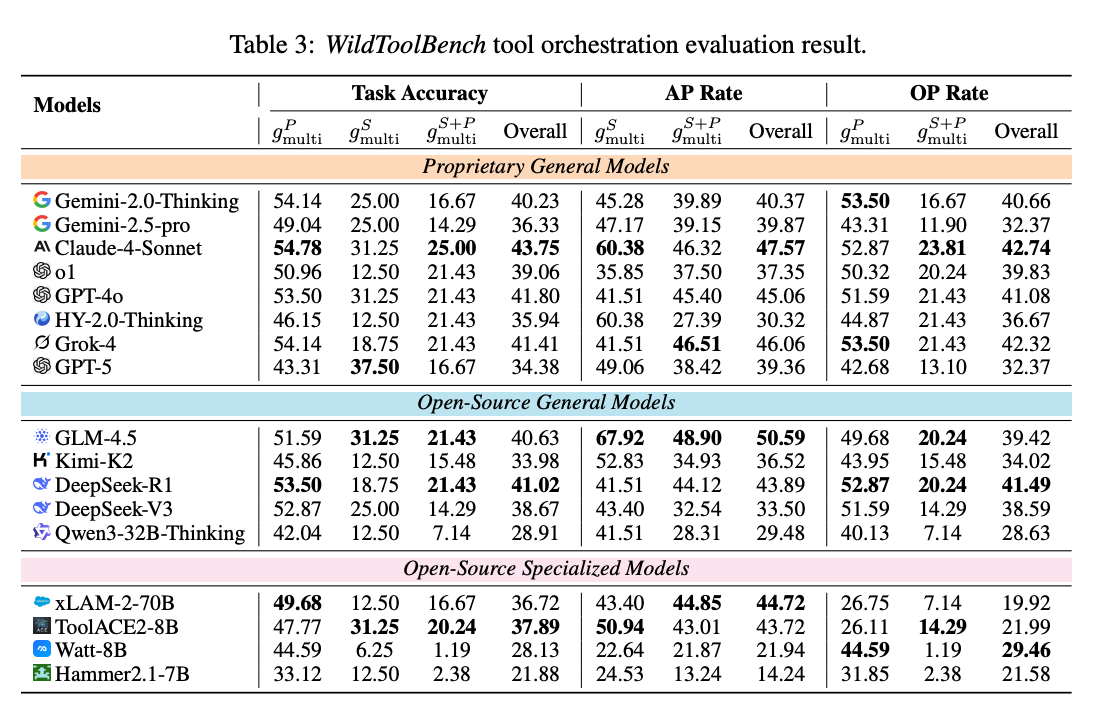

为验证 WildToolBench 的有效性,研究团队对 58 款主流 LLMs 展开了全面评估,涵盖闭源通用模型(如 Gemini 系列、Claude系列、GPT 系列)、开源通用模型(如 GLM-4.5、Kimi-K2)以及开源专用工具模型。

令人惊讶的是,所有模型的会话准确率均未超过 15% ,即便表现最佳的闭源模型,在任务准确率上也大多低于 60%。这一结果彻底打破了人们对当前 LLM 工具使用能力的乐观认知,揭示出 LLMs 在真实场景下的巨大能力缺口。

值得注意的是,实验还呈现出诸多具有行业启示性的发现。

- • 闭源模型整体表现优于开源模型,但头部开源模型(如 GLM-4.5)已能逼近部分顶尖闭源模型的水平,为开源社区的发展注入信心;

- • 专用工具模型虽针对工具使用进行优化,却因泛化能力不足,表现反而不及通用模型;

- • 具备强化推理能力的模型变体,在工具协同与意图推断任务中优势明显,证明推理能力是提升 LLM 工具使用能力的关键。

这些发现不仅为模型开发者指明了优化方向,更让行业意识到,未来 LLM 智能体的发展,不能仅聚焦于工具调用的 “执行能力”,更需强化对用户意图的 “理解能力”,而这依赖于模型在指令跟随、长上下文 comprehension 等基础能力上的突破。

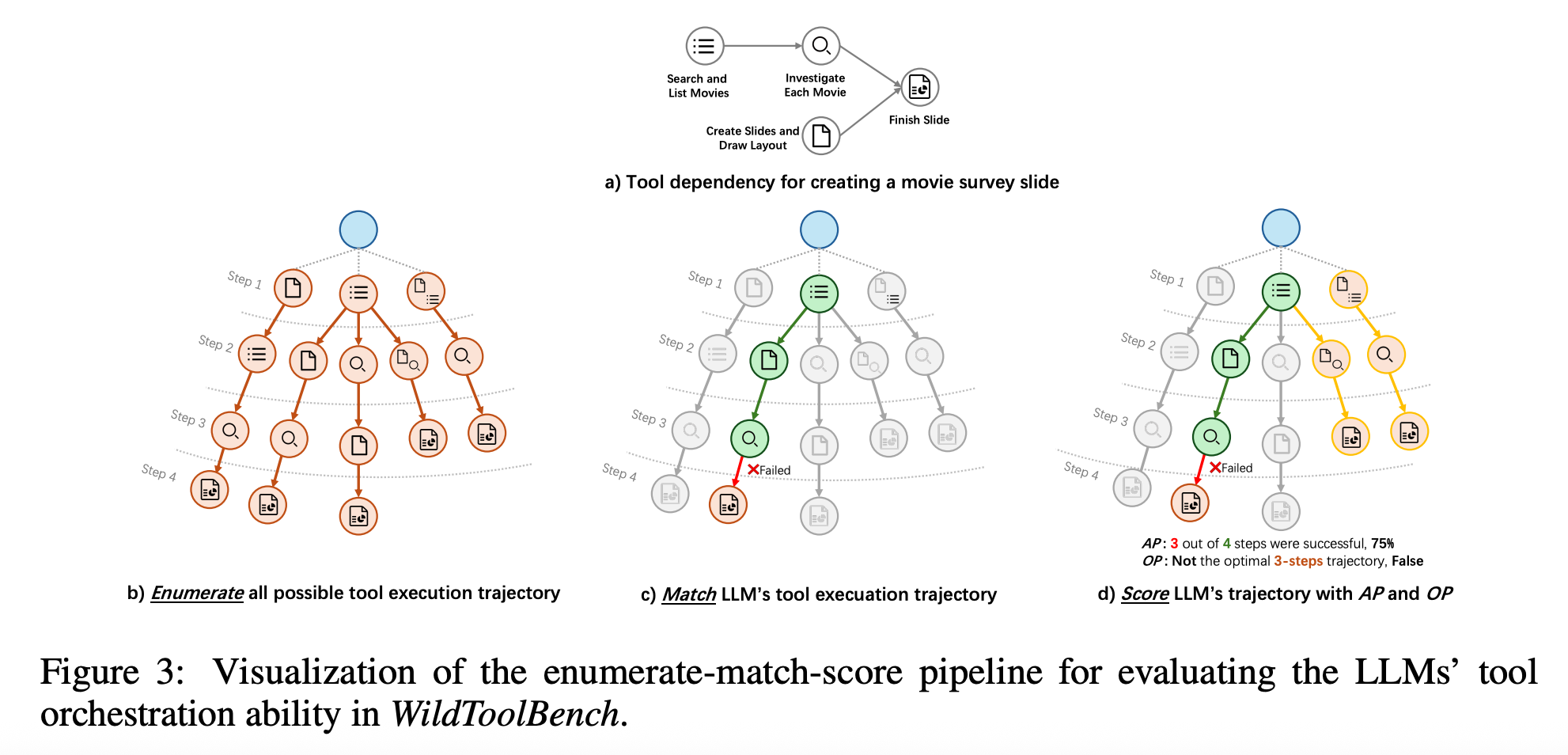

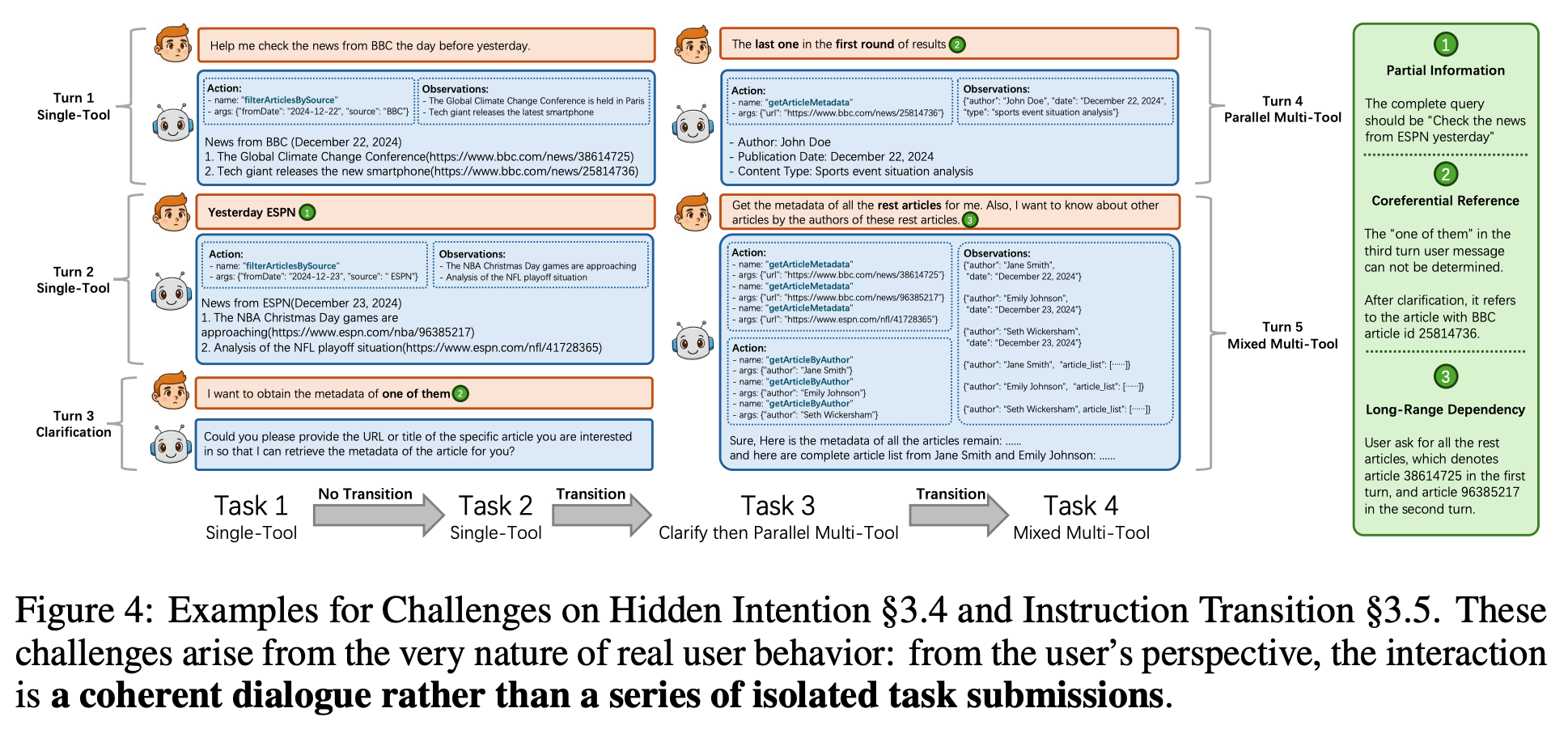

挑战一:组合式任务的工具调用拓扑编排难题

真实场景中,用户的需求往往不是单一指令的简单实现,而是需要多工具、多步骤协同完成的组合式任务。这类任务的核心难点,在于需要 LLM 具备高效的工具调用拓扑编排能力——也就是说,不仅要明确“需要调用哪些工具”,更要精准规划“工具调用的顺序、时机、优先级”,甚至要根据前一步工具的返回结果,动态调整后续的调用逻辑。

深入分析实验数据,更能发现 LLMs 在工具使用中的关键短板。在复合任务处理上,无论是顺序调用多工具、并行调用多工具,还是混合调用模式,LLMs 的表现都不尽如人意。

以最复杂的混合多工具任务为例,最高准确率仅为 25%,且工具执行的最优路径率不足 43%,说明 LLMs 在工具协同规划与效率优化上仍有极大提升空间。

挑战二:多轮对话中隐含意图的上下文推理困境

真实用户与LLM的交互,很少会一次性将所有需求细节完整表述,更多是通过多轮对话逐步传递需求,甚至会在对话中隐含核心意图——这就对LLM的上下文推理能力提出了极高要求:

LLM需要全程捕捉对话中的关键信息,整合多轮对话的上下文,精准挖掘用户未明确说出的隐含需求,而非仅局限于单轮指令的表面含义。

挑战三:指令转换下的实时策略调整压力

真实的用户对话具有极强的灵活性,用户不会始终围绕单一任务指令展开交流,而是会出现频繁的指令转换:可能在提出任务查询后,突然插入澄清提问,或是切换到 casual 交流,随后又回归核心任务。

这种指令转换的随机性,迫使 LLM 必须具备实时调整策略的能力——既要在任务查询时保持工具调用的专业性,又要在澄清、闲聊时灵活回应,同时还要记住对话主线,确保在指令回归后能够快速衔接之前的任务逻辑,不出现思路断裂。

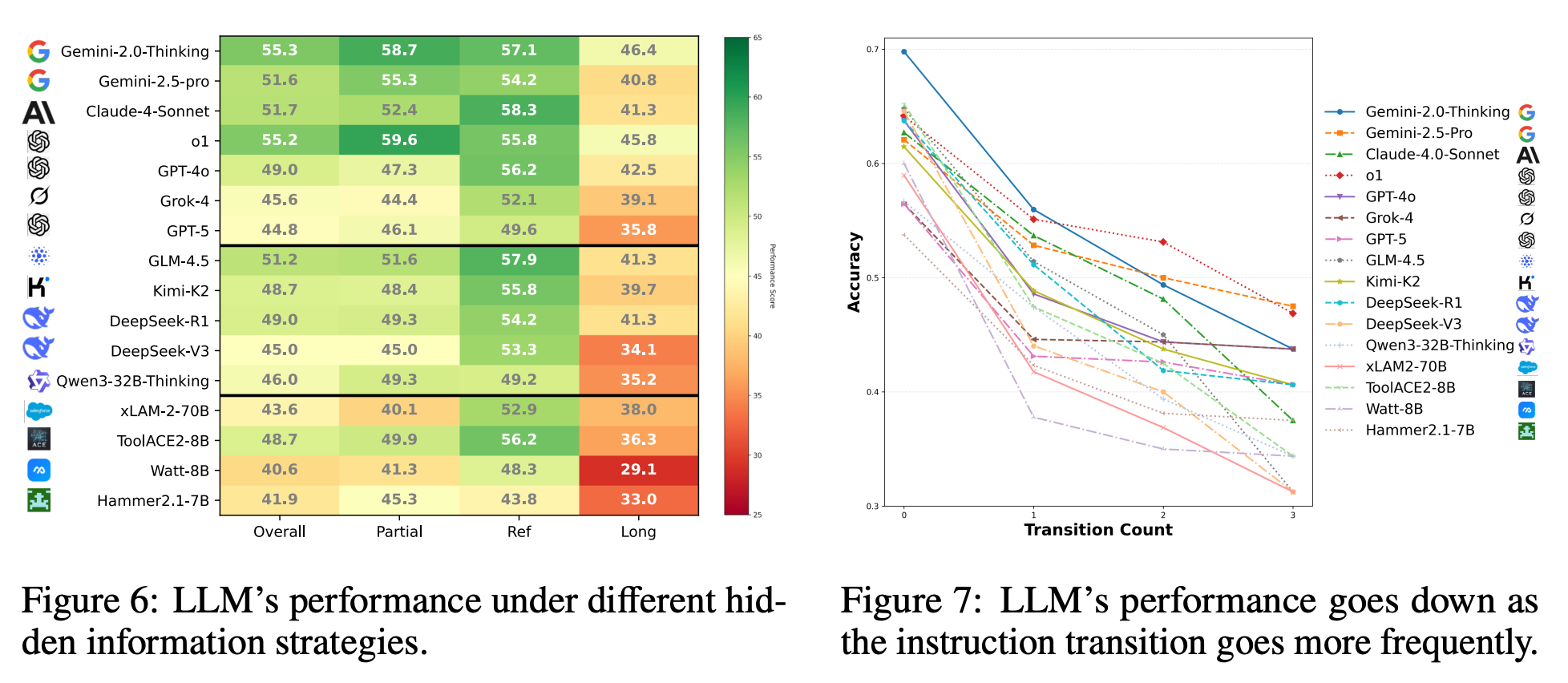

在意图推断方面,面对用户通过部分信息省略、指代关联或长距离上下文依赖隐藏的意图,LLMs 尤其是在长距离依赖任务中,准确率普遍低于 50%,暴露出其上下文理解与推理能力的不足。

此外,当用户在对话中频繁切换指令类型时,LLMs 的任务准确率最高可下降 30%,其 “自我条件反射” 式的决策偏差(如之前使用工具后倾向于继续调用工具),严重影响了应对真实用户灵活需求的能力。

WildToolBench 的意义,远不止于提供一个更具挑战性的评估基准。

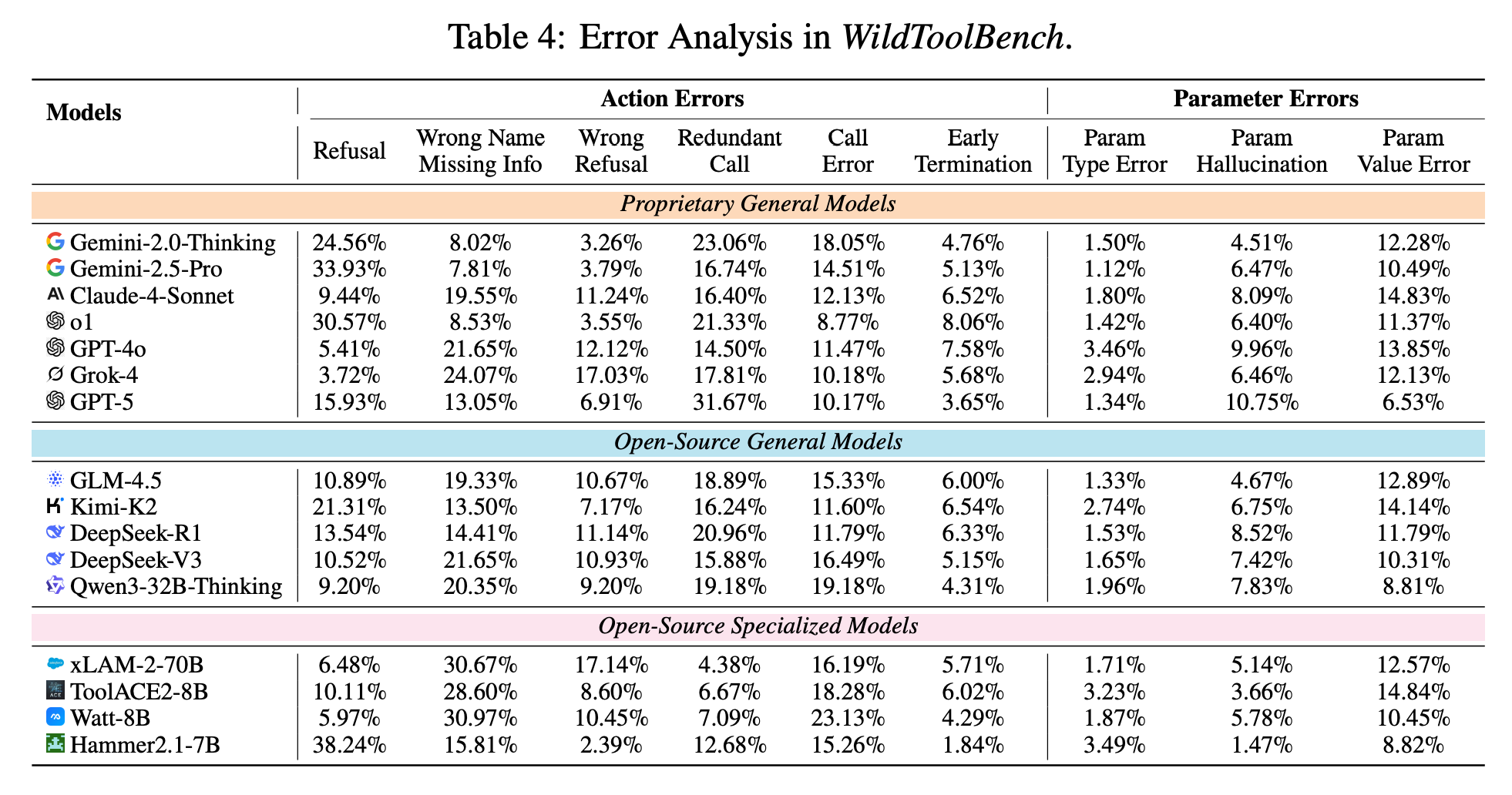

它通过结构化的评估维度与详细的错误分析(如 “错误工具选择”“冗余调用” 等高频错误),为模型迭代提供了清晰的改进路径;

更以真实用户行为为核心的设计理念,重新定义了 LLM 工具使用评估的标准,推动行业从 “理想化测试” 迈向 “真实场景验证”。

对于企业而言,WildToolBench 可帮助其更精准地评估 LLM 智能体的实际应用潜力,避免技术选型偏差;对于科研人员,它则为 LLM 工具使用能力的研究提供了贴近实际需求的 “试验场”。

更多推荐

已为社区贡献18条内容

已为社区贡献18条内容

所有评论(0)