2026年人工智能研究前沿——从智能体工程到自主科学发现的范式演进

2026年人工智能研究呈现出三大关键趋势:智能体工程化、自主科学发现和领域专用代理深化。在智能体工程方面,GLM-5等模型通过异步强化学习和混合注意力机制,实现了从代码生成工具到具备工程决策能力的智能体转变。科学发现领域,InternAgent-1.5等框架已能独立完成假设生成到验证的完整科研闭环。垂直领域应用中,医疗、金融和视频检索等专用代理取得突破,如MedXIAOHE在医疗诊断、Quanta

2026年人工智能研究前沿——从智能体工程到自主科学发现的范式演进

人工智能文献综述的研究方法论与结构规范

在2026年的人工智能科研语境下,文献综述已不再仅仅是对既有研究的简单罗列,而是演变成一种揭示技术演进逻辑、识别研究空白并构建未来理论框架的独立研究方法。高质量的文献解读报告需要通过对海量学术信息的系统化合成,为专业同行提供具有前瞻性的洞察。

研究指出,一份标准的学术文献综述应当具备明确的结构层次,通常由引言、主体(Body)与结论三个核心部分构成。引言部分负责界定研究主题的边界,阐明关键术语,并提供一份技术路线图以引导读者进入特定的学术语境。

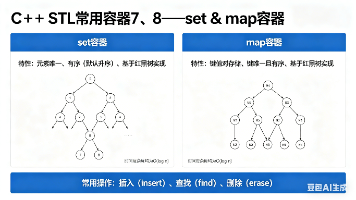

主体部分则根据研究目的的不同,采取时间顺序(Chronological)、主题分类(Thematic)或方法论特征(Methodological)进行组织:

- 时间结构:适用于追踪如大语言模型(LLM)从感知到推理的代际变迁

- 主题结构:侧重于剖析代理智能、长程记忆或强化学习等核心概念的理论冲突

- 方法论结构:通过对比定性与定量研究的优劣,为研究设计的优化提供参考

对于人工智能领域的专业研究者而言,文献解读的深度取决于对第二阶和第三阶洞察的提取。这意味着研究不应停留在模型性能的表面参数,而应深入分析其底层架构(如专家混合模型MoE与滑动窗口注意力SWA的结合)对计算效率的影响,以及这些技术选择背后的设计哲学。

研究表明,在2026年的学术界,文献评价的准则已转向对实验可重复性、数据工程透明度及模型在现实世界不确定性下的健壮性的综合考量。利用Markdown进行排版时,规范的标题层级、LaTeX数学公式的精准呈现以及结构化表格的应用,是确保学术报告专业性与可读性的物理基础。

代理智能工程化:从氛围编程向系统工程的范式转移

2026年人工智能领域最显著的趋势是从"氛围编程"(Vibe Coding)向"代理工程"(Agentic Engineering)的全面演进。这一转变标志着人工智能模型从单纯的代码生成工具演变为能够承担复杂系统构建、长程规划及自主决策任务的智能工程师。

早期的"氛围编程"主要依赖于人类用户的提示词直觉,虽然能产生快速的原型,但往往缺乏生产级的健壮性。而"代理工程"则强调模型在端到端软件生命周期中的主体地位,能够处理包括环境部署、资源管理及多步错误纠正等深层工程挑战。

GLM-5:旗舰级代理模型

在这一范式下,智谱AI发布的旗舰模型GLM-5展现了卓越的代理能力。该模型在参数规模上实现了量级的飞跃,其总参数量达到了744B,活跃参数量为40B,并在高达28.5万亿Token的数据集上进行了预训练。

GLM-5的核心竞争力在于其创新的异步强化学习基础设施"Slime",该设施通过将推理生成过程与模型权重更新过程解耦,极大地提升了模型在处理复杂、长程交互任务时的学习效率。

此外,GLM-5引入了深思熟虑的推理机制,能够在行动之间进行隐性推理,并在多轮对话中保持逻辑的一致性,这使其在处理如puzzles游戏构建、交互式虚拟世界开发乃至学术短视频生成等现实任务时表现出接近人类资深开发者的水平。

模型参数对比

| 模型参数与特性 | GLM-4.5 (2025) | GLM-5 (2026) | 技术增益分析 |

|---|---|---|---|

| 总参数量 (Total Params) | 355B | 744B | 支持更深层次的逻辑建模与领域知识存储 |

| 活跃参数量 (Active Params) | 32B | 40B | 提升了推理精度,同时保持了计算开销的可控性 |

| 训练数据量 (Tokens) | 23T | 28.5T | 拓宽了在长尾知识与专业科学领域的覆盖度 |

| 核心架构 (Architecture) | 标准MoE | 混合注意力 + DSA | 实现长文本处理下的线性计算复杂度 |

代理工程的崛起不仅改变了开发流程,也重新定义了人机交互的本质。分析表明,交互模式正在从"指令中心"转向"意图中心",即人类不再需要提供详尽的步骤指令,而是设定宏观意图,由具备工程主权的智能体自主完成路径探索与验证。这种能力的提升源于模型底层对物理世界和工程逻辑的深刻理解,通过构建大量的执行环境来获取高质量的交互轨迹,并利用专家强化学习进行策略精炼。

高效推理架构的演进:Step 3.5 Flash的技术解析

在追求前沿智能与计算成本平衡的探索中,Step 3.5 Flash模型通过创新的架构设计,重新定义了效率前沿。作为一个196B参数规模的专家混合模型(MoE),Step 3.5 Flash在推理时仅激活11B参数,实现了极高的吞吐量与低延迟性能。该模型的设计哲学在于,构建智能体所需的不仅是深度推理能力,更需要快速、可靠的执行速度以应对实时多轮交互的需求。

混合注意力机制

Step 3.5 Flash的技术核心在于其混合注意力(Hybrid Attention)机制。该机制采用了3:1的比例交替使用滑动窗口注意力(SWA)与全局全注意力(Full Attention)层。

通过在滑动窗口层增加查询头的数量(SWA+Head),模型成功补偿了长上下文信息的丢失,使其在处理高达128K上下文长度的任务时,注意力部分的FLOPs开销仅为全注意力模型的约38%,但在科学推理指标上保持了极高的保真度。

此外,该模型集成了多Token预测(MTP-3)技术,通过并行解码进一步提升了长上下文任务下的预测效率。

架构组件分析

| 架构组件 | 技术实现 | 性能影响 |

|---|---|---|

| MoE 层级 | 45层Transformer (3层Dense + 42层MoE) | 实现计算开销与参数容量的非线性解耦 |

| 专家路由 (Routing) | 每层288个专用专家 + 1个共享专家 | 保证了知识获取的广度与推理路径的精确性 |

| 注意力模式 (Attention) | 3:1 SWA/Full Attention 布局 | 实现了 O(TWd)O(TWd)O(TWd) 的时间复杂度优化 |

| 训练集群 (Infrastructure) | 4096NVIDIA H800 GPU | 提供了前沿智能训练所需的底层算力支持 |

Step 3.5 Flash在多项前沿基准测试中展现了与顶级闭源模型(如GPT-5.2xHigh)相当的性能。特别是在IMO-AnswerBench(85.4%)和τ2\tau^2τ2-Bench(88.2%)上的表现,证明了稀疏模型在数学逻辑与代理规划方面的巨大潜力。

研究指出,Step 3.5 Flash不仅是一个强大的模型,它更代表了一种"高密度基础"的设计趋势,允许企业在有限的计算资源下部署具备前沿推理能力的自主智能体,从而打破了过去"大模型即昂贵服务"的固有局面。

全智能体发现:科学研究的自主化闭环

科学发现的范式正在经历从人工智能辅助(AI4S Level2)向全智能体发现(Full Agentic Discovery, Level 3)的跨越。这一转变的核心特征是AI系统能够独立完成从假设生成、实验设计、实验执行到统计验证的完整科研闭环,而无需人类的实时干预。

InternAgent-1.5框架

InternAgent-1.5作为这一领域的代表性框架,构建了一个包含生成、验证与演进三大子系统的动态发现循环,成功模拟了人类科学探究的认知过程。

在InternAgent-1.5的体系结构中:

- 生成子系统:负责自动化的文献分析与跨学科知识合成,生成基于现有证据的结构化科学假设

- 验证子系统:将这些假设转化为可执行的代码或实验协议,能够无缝对接计算模拟环境(干实验)或机器人自动实验室(湿实验)

- 演进子系统:通过长程持久化存储记录每次迭代的成功与失败,利用强化学习反馈来不断优化科研路径

性能表现

| 科学发现任务 | InternAgent-1.5 表现 | 传统方法对比 | 领域影响 |

|---|---|---|---|

| GPQA-Diamond (综合) | 87.37 | < 80 (GPT-4 时代) | 标志着AI在专家级科学问题解决上的突破 |

| 气候降尺度 RMSE | 0.8488 | 1.2 - 1.5 | 大幅提升气候预测的时间与空间分辨率 |

| 生物靶点发现效率 | 几分钟 | 几周 | 极大地加速了药物发现的前期验证流程 |

PiEvolve引擎

此外,Fractal推出的PiEvolve引擎在OpenAI的MLE-Bench(评估AI解决真实世界机器学习挑战能力的金标准)上创造了新的里程碑。PiEvolve在奖牌获取率上突破了60%,成为首个被评估的在该领域达到资深机器学习工程师水平的系统。

PiEvolve通过图结构化搜索机制系统地探索推理空间,能够在24小时的运行周期内独立完成复杂的算法优化与调优任务。这种自主科研能力预示着,未来的科学进步将不再受限于人类研究员的时间和精力,而是取决于计算资源的规模与算法的演进效率。

领域专用代理的深化:医疗、金融与视频检索

随着通用大模型能力的趋于平稳,2026年的研究重点转向了针对特定垂直领域的智能体设计。

MedXIAOHE:医疗影像-语言模型

MedXIAOHE作为医疗影像-语言基础模型的典型,针对临床环境中的多模态证据整合进行了深度优化。该模型采用实体感知的持续预训练框架,通过构建医疗实体树并结合分层聚类,显著提升了系统对罕见病等长尾医学知识的理解深度。

MedXIAOHE不仅能进行文本对话,更重要的是其引入了工具增强的代理训练,使其能够产生带有可验证决策迹象的诊断报告,在复杂临床诊断任务中表现出优于顶级通用多模态系统的准确性。

QuantaAlpha:金融量化交易框架

在金融量化交易领域,QuantaAlpha框架展示了利用进化学习进行因子挖掘(Alpha Mining)的新范式。由于金融市场具有高度的非平稳性和噪声,传统的因子生成方法极易陷入过拟合。

QuantaAlpha通过将研究工作流轨迹化,并应用轨迹级的突变与交叉操作,实现了对验证经验的高效复用。突变操作利用自省机制定位轨迹中的弱点进行局部重写,而交叉操作则融合了来自不同成功路径的高奖励片段。

这种机制不仅在沪深300(CSI 300)测试中取得了0.1501的信息系数(IC),更表现出极强的跨市场泛化能力,能够有效地将挖掘出的因子迁移至标普500等不同机制的市场。

因子性能对比

| 因子指标 (CSI 300) | AlphaAgent (基准) | QuantaAlpha (进化框架) | 提升幅度 |

|---|---|---|---|

| 信息系数 (IC) | 0.1215 | 0.1501 | +23.5% |

| 年化收益率 (ARR) | 21.2% | 27.75% | +6.55% |

| 最大回撤 (MDD) | 10.5% | 7.98% | -24.0% (风险优化) |

VidVec:视频检索技术

视频检索技术同样在2026年迎来了突破。VidVec研究揭示了多模态大模型(MLLM)在作为表征学习器时的层级秘密,指出中间层特征在视频检索任务中比最终层更具语义区分度。

VidVec引入了一种无需视觉监督的文本对齐优化策略,通过将密集的视频标题映射为简短摘要,成功在少于6万对纯文本样本的学习下,在检索精度上超越了在数亿对视频-文本上预训练的专用视频基础模型。这种利用LLM内部知识进行跨模态对齐的思路,为解决视觉数据标注成本高昂的问题提供了极具吸引力的解决方案。

强化学习的演进与大规模数据合成技术

强化学习是2026年大语言模型后训练阶段的核心基石。为了解决高质量、可验证任务数据的短缺,NVIDIA推出的"Golden Goose"方案提供了一种大规模合成可验证任务的方法。

Golden Goose数据合成

该技术的核心是将原本不可验证的互联网长文本(如科学教材、代码说明书)转化为多选填充(Fill-in-the-middle)任务。通过利用强模型(如GPT-5)识别关键推理节点并生成高质量的干扰项,Golden Goose合成了超过70万个横跨数学、编程与网络安全领域的RLVR任务。

实验证明,这种方法能有效激活已在常规数据集上饱和的模型性能,并在网络安全等从未有现成RLVR数据的领域中实现了SOTA性能。

F-GRPO算法优化

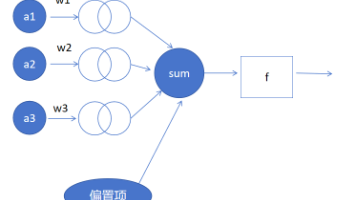

在算法架构层面,F-GRPO(Focal-GRPO)针对群体采样带来的"锐化"问题进行了深入修正。研究指出,传统的组相对策略优化在有限的采样预算下,往往会将概率分布过度集中在少数已知的正确路径上,从而导致解的多样性受损。

F-GRPO引入了一个灵感源自Focal Loss的难度感知系数,通过下调模型在容易任务上的更新权重,强制模型关注那些正确但由于概率低而被忽视的稀有模式(Rare-correct Modes)。

####RL算法性能对比

| RL算法 | 采样规模 (N) | AIME2025 (Pass@256) | IFEval (多样性指标) |

|---|---|---|---|

| 标准 GRPO | 8 | 49.5% | 71.4% |

| 标准 GRPO | 32 | 52.6% | 73.0% |

| F-GRPO | 8 | 52.6% | 75.7% |

分析结果显示,F-GRPO在仅使用1/4计算开销(N=8)的情况下,便能达到甚至超越标准GRPO在大样本量(N=32)下的多样性表现。这种效率的提升对于资源敏感型的工业级后训练至关重要。

此外,MIT开发的EnCompass框架则进一步通过解耦代理程序逻辑与搜索策略,实现了在代码转换等任务中减少82%的程序员手工搜索工作量,展现了自动机在复杂状态搜索中的巨大价值。

认知机理剖析:思维链内部计划与不确定性量化

随着AI模型从黑盒逐步走向可解释性,2026年的研究开始深入解析思维链(CoT)背后的潜在认知动态。

思维链的认知特征

腾讯的研究表明,大语言模型在生成CoT时并非具备一个宏大的全局蓝图,而是表现出一种"近视"的计划视野(Myopic Horizon),其隐藏状态主要支持即时的局部逻辑跳转。然而,对于相对简单的任务,模型内部确实存在某种形式的"答案先验",即在正式输出答案前,其神经元激活状态已经编码了最终答案的雏形。

不确定性量化

这种对推理过程的不确定性感知催生了更精准的标定方法。根据"木桶原理",一条推理路径的可靠性往往由其逻辑最薄弱的几个关键枢纽位置(Pivot Positions)决定,而非全路径的平均置信度。通过动态监控这些枢纽位置的预测熵,研究者能够更有效地预防"幻觉螺旋"的产生。

软思维范式

此外,“软思维”(Soft Thinking)范式通过生成连续概念空间中的抽象Token,实现了在多条潜在推理路径间的隐式并行探索,相比离散的CoT,它在减少22.4%Token消耗的同时,提升了Pass@1的准确性。

针对这种认知机制的自训练研究进一步发现,模型具备一种"简洁推理"的潜能,通过强化学习可以引导模型减少思维链中的冗余Token,实现更紧凑、更高带宽的信息传输。这种对内部推理效率的追求,正推动模型向更加类人的、启发式的思维方式靠拢。

战略影响与组织演进:AI领导力在2026年的挑战

在2026年的商业环境下,人工智能已从单纯的技术工具转变为引发管理革命的核心动力。

组织适应性挑战

德勤与哈佛商学院的研究一致认为,企业的核心竞争优势正从"拥有AI"转向"适应AI"。所谓的"代理现实检验"指出,尽管已有38%的企业在试点智能体项目,但仅有11%真正进入了生产环节,其根本障碍不在于技术本身,而在于组织试图在破碎的、陈旧的流程之上进行自动化,而非进行彻底的流程再设计。

变革适应力

管理层面临的挑战在于如何培养"变革适应力"(Change Fitness)。这意味着不仅要引入模型,更要重新平衡权力分配、岗位清晰度与决策权。2026年的领先企业正在将CIO转变为"AI布道师",将单一的职能专家需求转向能够连接AI、数据、运营与人类判断力的跨界经理人。

此外,由于超写实合成媒体(基于Sora 2或Gemini 3驱动)可能引发的品牌危机与信息污染,企业不得不部署多模态监控工具与快速响应协议,治理已成为AI部署的先决设计约束。

基础设施转型

从技术基础设施的角度看,企业正在经历从"云优先"向"策略混合"的转型,以应对爆炸式的推理成本。研究观察到,虽然模型训练成本在下降,但随着智能体在大规模生产环境中的调用,推理成本往往超出了初始预算,迫使企业寻求在边缘侧部署高密度的小型前沿模型。

2026年的人工智能景观呈现出高度工程化、自主化与领域深化的特征。从Step3.5 Flash的极致效率到InternAgent-1.5的自主科学闭环,人工智能正在从感知智能向具备工程思维与科学洞察力的执行主体演进。

对于研究者与决策者而言,理解这些底层的架构逻辑、数据合成机制及其背后的认知原理,将是掌握未来智能竞争主导权的关键。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)