使用 Elastic Inference Service ( EIS ) 上扩展的模型目录构建任务感知的 agent

Elastic推出扩展版推理服务(EIS),新增多款AI模型支持,包括Anthropic Claude、Google Gemini和OpenAI GPT系列等。该服务允许开发者在检索、生成等不同任务中灵活选择最优模型,无需管理GPU基础设施。通过Agent Builder工具,用户可构建生产级AI代理,实现自动数据摄取、威胁检测等功能。EIS支持多模型协同工作,如让轻量级模型处理简单查询,强大模型

作者:来自 Elastic Sean Handley, Anish Mathur, Deepti Dheer 及 Ranjana Devaji

Elastic Inference Service ( EIS ) 扩展了其托管模型目录,使团队能够在检索、生成和推理等不同任务中灵活选择模型,从而构建可用于生产的 agent,而无需管理 GPU 或基础设施。

Agent Builder 现已正式 GA。通过 Elastic Cloud Trial 开始使用,并在此查看 Agent Builder 的文档。

今天,我们很高兴宣布为 Elastic Inference Service ( EIS ) 扩展模型目录,使用户能够在托管 GPU 上轻松运行快速、高质量的推理,而无需复杂的设置或托管。

EIS 已经提供对最先进的大型语言模型 ( LLMs ) 的访问,这些模型为 Elastic Agent Builder 和 Elastic AI Assistants 提供开箱即用的 AI 能力,包括自动数据摄取、威胁检测、问题调查和根因分析。现在,我们通过更广泛的托管模型目录扩展这一基础,使开发者能够更好地控制 agent 如何进行推理、检索和执行操作。

在实践中,这反映了企业构建 AI 系统方式的更广泛转变。单一、通用 AI 模型的理念已经不再成立。真实世界的 agent 工作流需要多个模型,它们具有不同的优势、成本和性能特征。通过 EIS,团队可以在 Agent Builder 中直接选择并切换模型,无需任何设置、成本或托管开销;或者在 agent 工作流中组合不同模型,使每个步骤都使用最适合该任务的模型。

开发者可以直接在 Elasticsearch 中使用来自 OpenAI、Anthropic 和 Google 的模型,在不同的 agent 步骤中选择不同模型,而 Elastic 则为生产级 agent 全面管理推理、扩展和 GPU 执行。

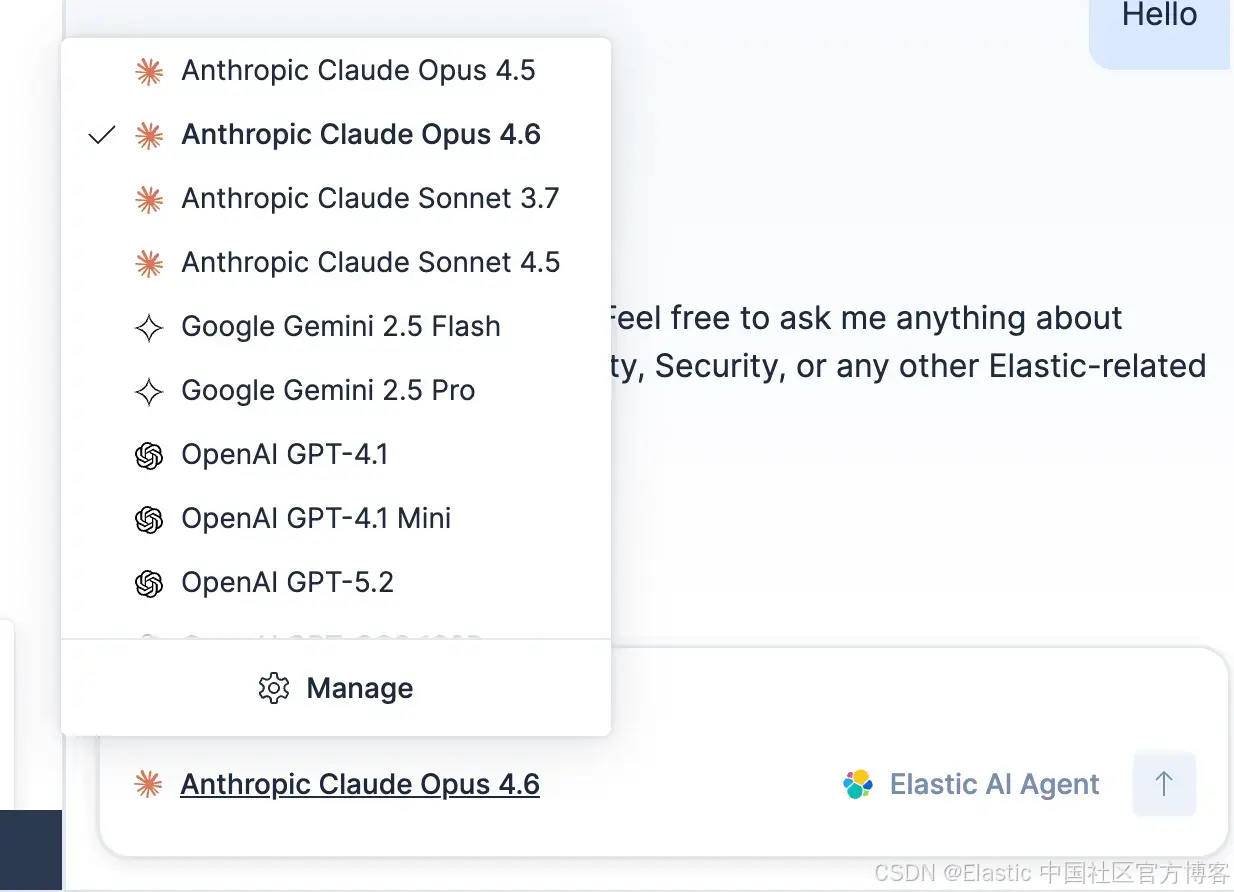

EIS 上扩展的托管模型目录

扩展后的 EIS 目录现在包含针对不同任务类别优化的模型,从轻量级生成到大上下文推理,以及用于检索的 embeddings。

在生成方面,目录包括:

-

Anthropic Claude Opus 4.5 和 4.6

-

Gemini 2.5 Flash

-

Gemini 2.5 Pro

-

OpenAI GPT-4.1 和 GPT-4.1 Mini

-

OpenAI GPT-5.2

-

OpenAI GPT-OSS-120B

在检索方面,EIS 包含原生 Jina AI 模型 jina-embeddings-v3 和 jina-embeddings-v5,它们为多语言检索提供快速、高质量的 embeddings。该服务还包含来自 Microsoft、OpenAI、Google 和 Alibaba 的 embedding 模型。

为 agent 任务选择合适的模型

通过 EIS,模型选择成为 agent 内部的设计决策,而不是运维问题。agent 可以根据其角色选择模型,而无需改变推理的部署或扩展方式。

为了看看这在实践中的表现,考虑一些常见的 agent 场景。

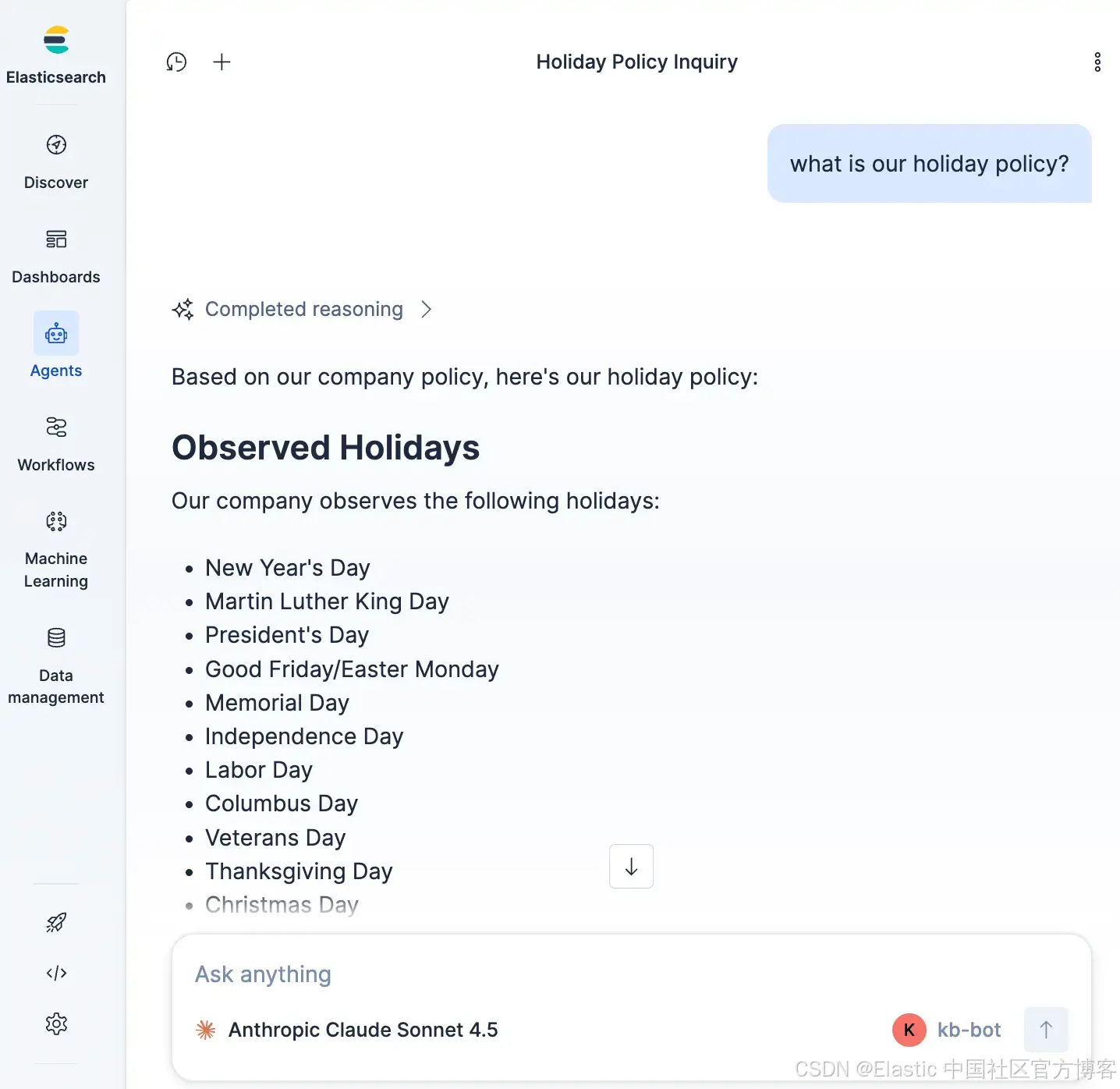

简单信息查询

简单交互,例如回答 “我们的 holiday policy 是什么?”,不需要昂贵的前沿模型,可以由快速、低成本的模型处理。

- 任务:“我们的 holiday policy 是什么?”

- 模式:检索并总结。

- 模型选择:快速、低成本的生成模型。

这也可以通过 API 进行配置,只需选择你想使用的模型:

POST kbn://api/agent_builder/converse

{

"input": "What is our holiday policy?",

"agent_id": "internal-kb-bot",

"connector_id": "Anthropic-Claude-Sonnet-4-5"

}这一步主要依赖于检索质量。一个轻量级模型就足以快速总结少量文档。

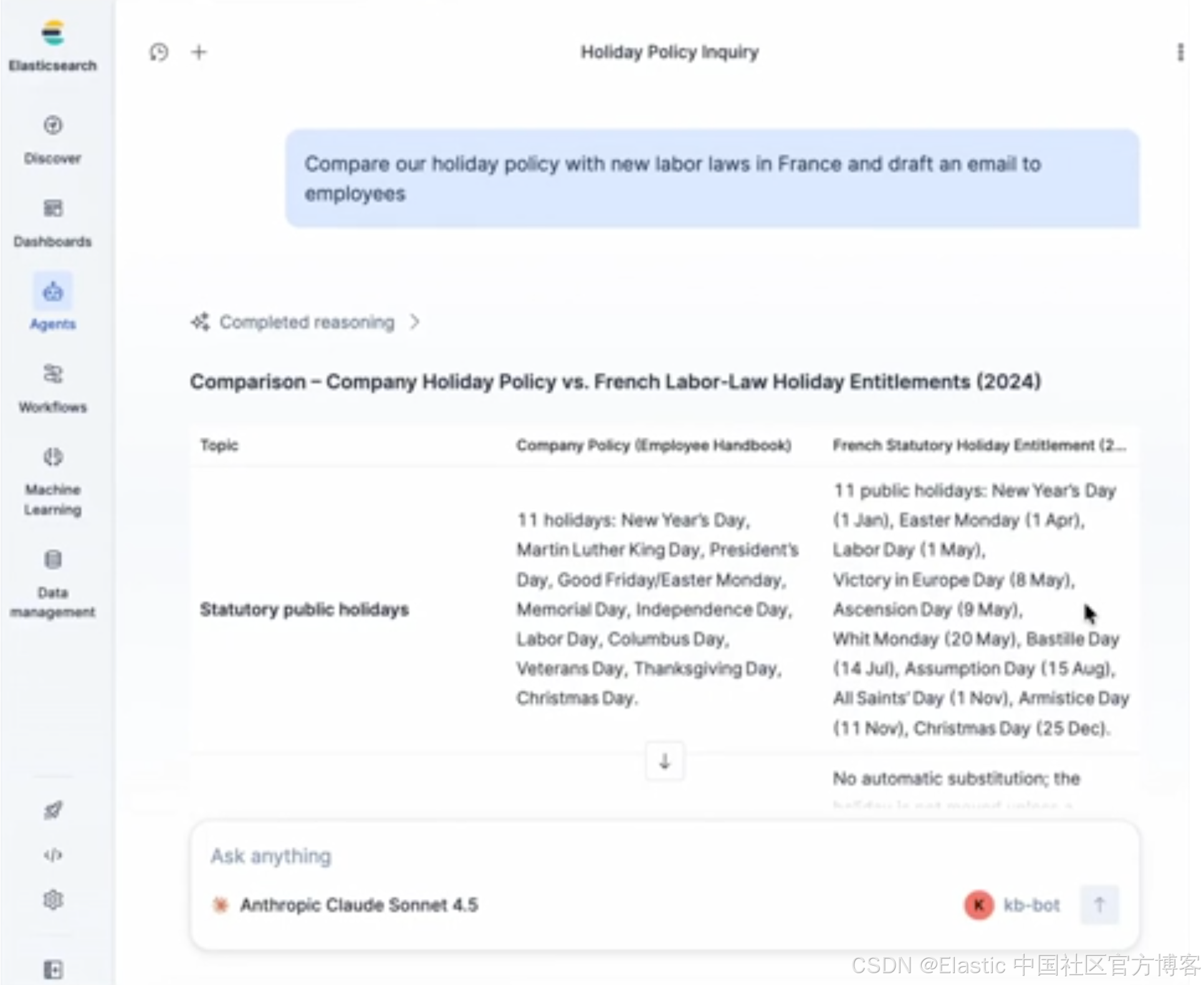

中等能力

更复杂的任务可能需要更强大的生成模型,但不一定需要最昂贵的推理模型。

- 任务:“将我们的 holiday policy 与法国新的劳动法进行比较,并起草一封邮件。”

- 模式:检索相关文档,比较不同来源中的政策细节,并生成输出,例如邮件草稿。

- 模型选择:更强大的生成模型。

以下是 API 示例:

POST kbn://api/agent_builder/converse

{

"input": "Compare our holiday policy with new labor laws in France and draft an email.",

"agent_id": "internal-kb-bot",

"connector_id": "Google-Gemini-2-5-Pro"

}此任务需要跨多个来源进行综合并生成结构化输出,但不需要最强大的前沿推理模型。

调查或审计任务(高能力)

- 任务:审查大量文档以识别合规风险。

- 模式:在大上下文中进行多步骤推理,模型在生成最终判断之前评估多个文档的信息并综合发现。

- 模型选择:前沿模型或大上下文模型。

使用 API 试一试:

POST kbn://api/agent_builder/converse

{

"input": "What are the compliance risks associated with Example AI products?",

"connector_id": "Anthropic-Claude-Opus-4-6"

}由于该任务需要对多个输入进行更深入的推理和一致评估,输出质量更加重要,因此此步骤适合使用高能力模型。

EIS 还支持更高级的编排模式。企业越来越认识到,为每个 agent 步骤使用前沿模型效率低下。

通过 Agent Builder 和 Elastic Workflows,团队可以设计 agent,使每个子任务由最适合该任务的模型执行,基于成本、复杂性和准确性要求进行选择。

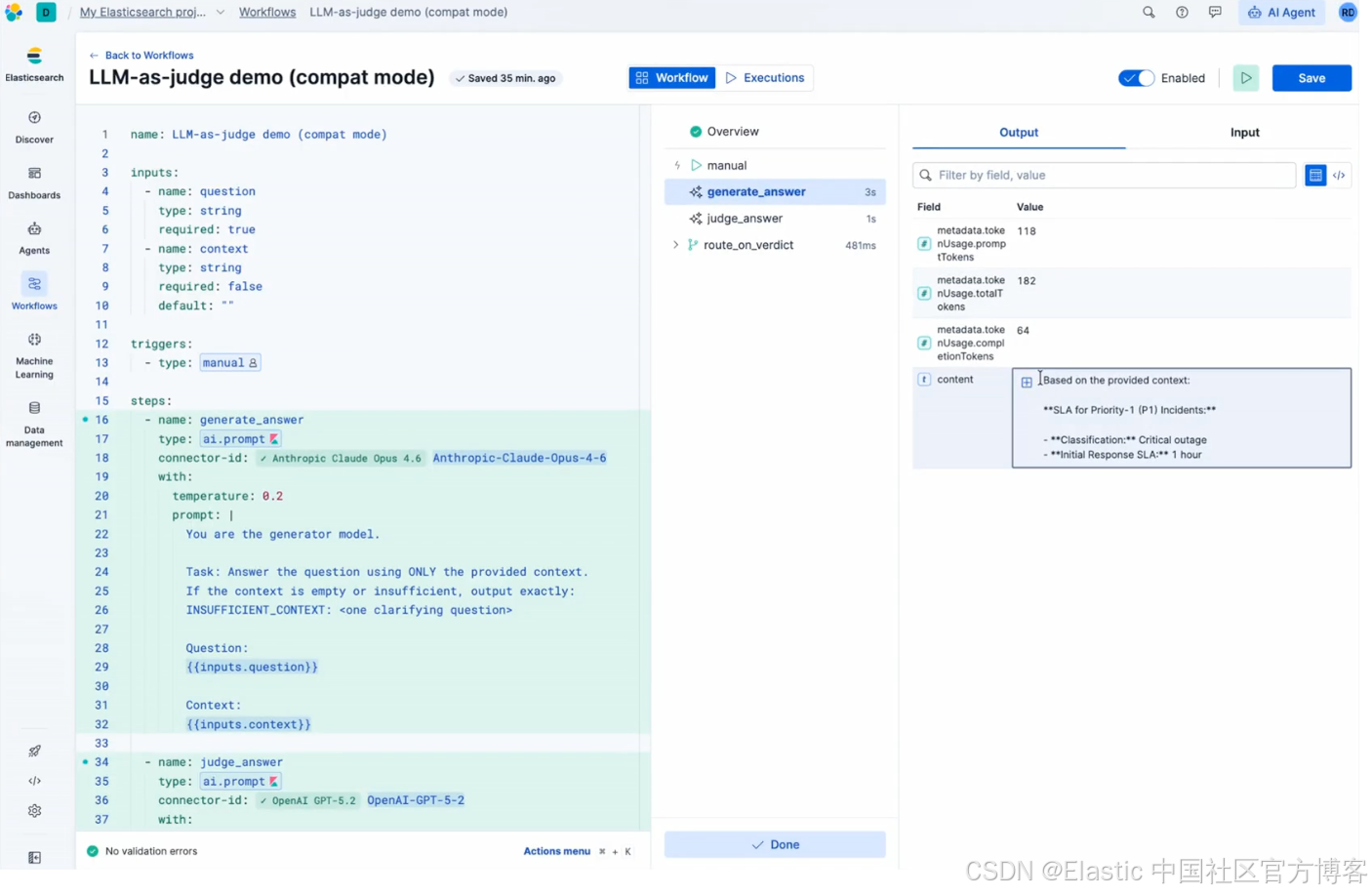

模型作为评判者模式(质量控制)

- 任务:使用第二个模型验证 agent 的输出

- 模式:生成并评估

在这个 Elastic Workflow 示例中,agent 使用一个模型生成响应,再用第二个模型评估其质量,为结果增加验证层。内置于 Elasticsearch 的自动化引擎 Elastic Workflows 允许开发者将可靠的脚本自动化与 AI 驱动步骤结合,用于需要推理的任务。

多模型方法通过将生成与评估分离,实现了新的可靠性模式,允许一个模型生成响应,另一个模型进行验证。如今,团队可以通过将通用生成模型与轻量级评估模型配对来实现这一点。

随着时间推移,这一模式自然适用于专门的评判和安全模型,这些模型专门用于验证、策略检查和质量控制。随着这些模型的可用性增加,EIS 使得在不改变推理部署或管理方式的情况下,将它们引入 agent 工作流变得简单。

接下来是什么

EIS 正在积极发展,更多模型即将推出。你可以在 Elastic 公共路线图上跟踪即将发布的内容以及我们当前正在构建的内容。

开始使用

Elastic Inference Service 让你可以轻松使用默认模型,并随着时间发展,逐步构建复杂的多模型 agent 工作流,全部在 Elasticsearch 内完成。无论你是在构建全球检索增强生成 (RAG) 系统、搜索,还是需要可靠上下文的 agent 工作流,Elastic 现在都提供开箱即用的高性能模型,以及从原型到生产的简化运维流程,让你充满信心地部署。

所有 Elastic Cloud 试用账户都可访问 Elastic Inference Service。你可以在 Elastic Cloud Serverless 或 Elastic Cloud Hosted 上立即试用,或通过 Cloud Connect 在自管理集群中使用 EIS。

原文:https://www.elastic.co/search-labs/blog/cloud-connect-elastic-inference-service

更多推荐

已为社区贡献179条内容

已为社区贡献179条内容

所有评论(0)