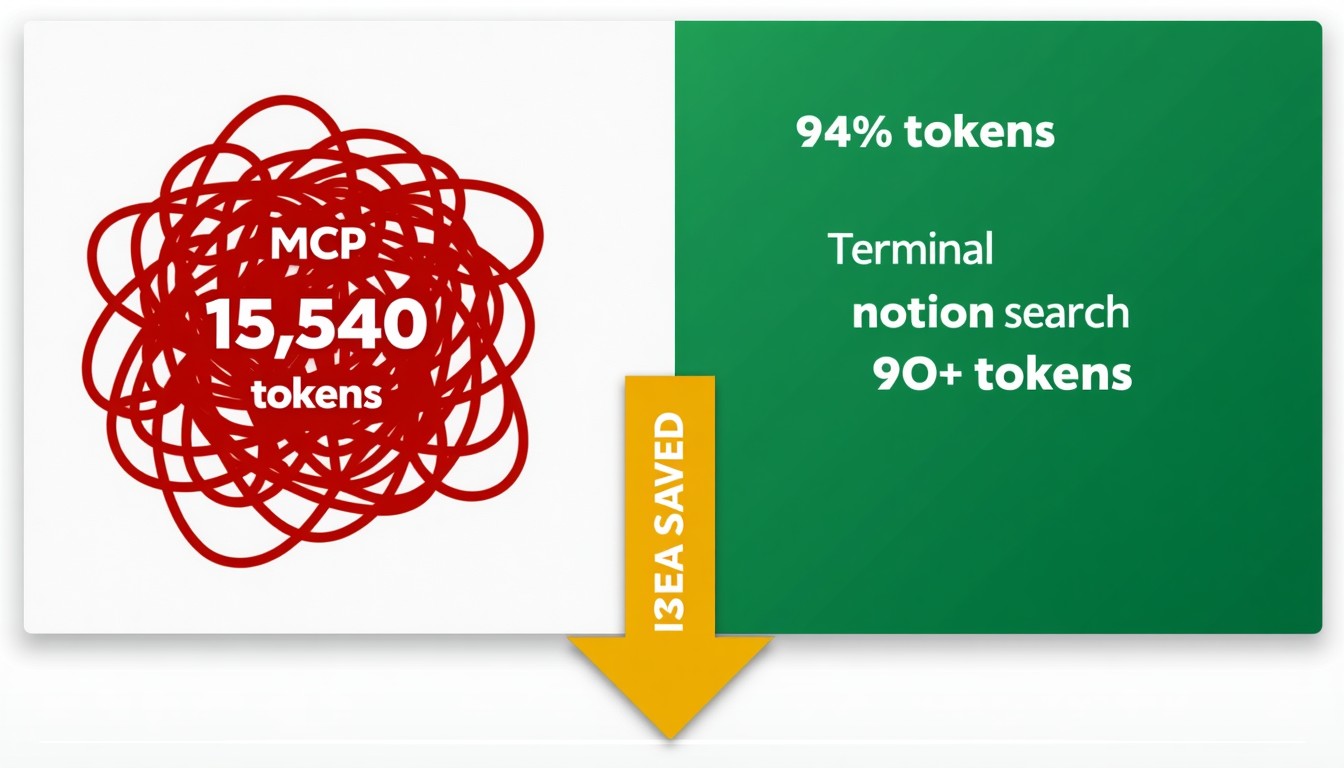

MCP 到 CLI,省下 94% 的 token

对比分析 MCP 与 CLI 协议在 AI 代理中的 token 消耗问题,揭示 CLI 方案节省 94% 成本的优势,并探讨认证难题与未来融合方向。

当 AI 助手在后台忙碌时,你可能不知道它正在为每个工具调用支付高昂的「token 税」。想象一下,每次启动 AI 代理,它都要加载一本厚厚的工具手册,而实际上它只需要知道工具名字就够了——这种浪费正在悄悄推高你的 AI 使用成本。

在 AI 代理领域,MCP(Model Control Protocol)是一种常见的工具调用协议,它要求代理在每次会话开始时加载所有可用工具的完整 JSON Schema 定义。这种设计看似全面,却带来了显著的 token 消耗问题。根据 分析 显示,一个典型场景下(84 个工具),MCP 的会话启动消耗约 15,540 tokens,而改用 CLI 方案仅需 300 tokens,节省高达 98%。更惊人的是,单个工具调用时,MCP 总消耗约 15,570 tokens,CLI 仅需 910 tokens,节省 94%。这种成本差异并非理论推测,而是实测数据。

为什么 MCP 这么「贵」?

MCP 的设计初衷是让 AI 代理直接获取工具的详细参数和结构,无需额外查询。但问题在于,它把所有工具的完整描述一次性塞进上下文。例如,一个 Notion 搜索工具的 JSON Schema 可能包含类型、描述、属性等细节,84 个工具叠加起来,token 消耗迅速飙升。这种「全量加载」模式在早期 AI 模型中或许可行,但随着工具数量增加,成本变得难以承受。

MCP 的 token 成本不是 API 调用本身,而是「操作手册」的税。这句话精准点出了问题本质。

更现实的是,许多 MCP 实现并未优化工具加载逻辑。当 AI 代理需要调用工具时,它不得不反复传输整个工具目录,即使某些工具在当前任务中根本用不上。这就像每次去图书馆借书,都要把整座图书馆的目录册带回家,而不是只拿你需要的那本。

CLI 的聪明解法

CLI 方案则采用「按需加载」策略。会话启动时,仅加载轻量级工具列表(如名称、位置),具体细节在调用时通过 --help 命令动态获取。例如:

$ notion --help

notion search <query> [--filter-property ...]

Search for pages and databases

notion create-page <title> [--parent-id ID]

Create a new page

... 12 more tools

这样,单个工具调用的 token 消耗从 MCP 的 15,570 降至 910,节省 94%。更妙的是,CLI 天然支持命令管道(如 cli list --json | jq '.[].id'),让 AI 能轻松组合多个操作,而 MCP 需要多次上下文切换。

Hacker News 用户指出:「CLI 比 MCP 更便宜,但更重要的是,模型已经训练过如何使用命令行。它们知道如何

grep、jq,这是 MCP 无法比拟的优势。」

认证难题:MCP 的不可替代性

尽管 CLI 在成本上优势明显,但 MCP 在认证机制上仍有独特价值。当 AI 代理需要连接第三方 SaaS 服务(如 Slack、GitHub)时,MCP 的 OAuth 动态注册机制简化了认证流程。相比之下,CLI 通常依赖本地凭证配置(如环境变量),这在消费级 AI 产品中可能不够安全或便捷。

Hacker News 评论中有人尖锐指出:「MCP 的唯一真实价值是 OAuth 握手。如果能将 OAuth 层标准化,CLI 就能接管其余部分。」

例如,用户通过 ChatGPT 连接自己的 GitHub 账号时,MCP 能自动处理 OAuth 授权流程,而 CLI 需要用户手动配置 token。这种差异在面向普通用户的 AI 产品中至关重要——毕竟,让非技术人员手动管理凭证并不现实。

行业如何应对?

行业正在探索多种优化方案。Anthropic 的 Tool Search 采用渐进式披露,先加载索引,按需获取详细 Schema,节省 85% token。Cloudflare 等企业通过网关层优化,仅注入必要工具描述。开发者开始用「Skills」机制:轻量级描述+按需加载,类似 CLI 理念但更结构化。

有人指出:「MCP 工具描述如果被优化,完全可以减少 90% 上下文。问题不在于协议本身,而在于实现方式。有些 MCP 服务器确实把 200k tokens 的文档全扔进上下文,这纯属设计失误。」

更创新的方案也在涌现。pi-mcp-adapter 等工具允许在 MCP 框架下使用 CLI 的链式调用能力;instantcli.com 能将 API 快速转换为 CLI,简化集成。甚至有人用 RAG 技术动态检索相关工具,避免全量加载。

未来方向:融合而非对立

当前趋势显示,MCP 和 CLI 并非二选一。许多项目正在融合两者优势:简单任务用 CLI(如 gh 命令行工具),复杂认证用 MCP,或用适配器融合。例如,GitHub 的 CLI 工具 gh 已成开发者标配,而 AI 代理调用它时,token 消耗远低于 MCP 版本。

「CLI 和 MCP 的争论本质是:如何让 AI 更高效地理解人类意图。」这场讨论最终指向一个共识:协议选择应基于场景,而非简单偏好。

对于普通开发者,建议先尝试官方 CLI 工具。如果遇到认证难题,再考虑 MCP 或适配器。毕竟,技术选择的终极目标不是节省 token,而是让 AI 更可靠、更高效地完成任务。

更多推荐

已为社区贡献100条内容

已为社区贡献100条内容

所有评论(0)