EvoMap 全解:让 OpenClaw 不停进化的秘密

EvoMap:让AI Agent实现经验传承的进化系统 EvoMap是一个革命性的技术系统,旨在解决当前AI Agent普遍存在的"经验无法复用"问题。其核心机制GEP协议(基因组进化协议)通过三层结构实现知识传承: Gene(基因):记录最小能力单元 Capsule(胶囊):存储已验证的解决方案 EvolutionEvent:记录进化过程 系统采用内容寻址技术(SHA256+

EvoMap 全解:让 OpenClaw 不停进化的秘密 ⭐

每当你让 Agent 执行一个任务时,它实际上是从零开始的。

哪怕这个任务它昨天刚完成过,哪怕同样的坑已经踩过一百次,它依然像个失忆症患者,一次次重新摸索、重新试错。这就是当下所有 AI Agent 共同的困境:没有记忆,无法进化。

直到最近,有个技术系统悄悄改变了这个局面。

它让一个 Agent 学会的知识,能够被成千上万个 Agent 继承;它让每次试错不再是沉没成本,而是整个网络的进化燃料;它让 “经验无法复用” 这个老大难问题,第一次看到了系统性解法。

这个系统叫 EvoMap。

它的核心愿景只有一句话:“One agent learns, a million inherit.”(一个学会了,百万个继承)👑。

今天咱们就掰开揉碎了聊聊:EvoMap 到底是干嘛的?技术原理是什么?OpenClaw 能否通过它实现真正的"进化" 🧬。

一、EvoMap 到底是干嘛的:解决一个核心痛点

(一)核心问题:AI Agent 没有"记忆" 🤔

目前 AI Agent 面临一个根本性问题:经验无法复用,每次都从零开始。

举个具体例子:

你让 Agent A 调某服务 API,因为请求头格式写错了报 403。你帮它改好了,下次能正常工作。但过两天换了项目,Agent B 遇到同样的问题,还是会报 403——它不知道 Agent A 已经踩过这个坑了。

这就是现状:

- 每个 Agent 都是一次性干电池 🔋

- 你踩过的坑,全球每天上万个 Agent 在重复踩

- 同样的错误、同样的试错路径、同样的 Token 浪费 💸

(二)EvoMap 的解法:把经验固化为"基因"

EvoMap 要解决的问题很简单:让一个 Agent 学会,百万 Agent 继承。

它提出的解法叫 GEP(Genome Evolution Protocol,基因组进化协议),核心思路是:

- 发现问题时:记录错误信号

- 解决问题后:把解决方案固化为可复用的资产

- 下次再遇到时:直接复用已验证的方案,跳过试错

- 跨 Agent 共享:所有 Agent 都可以从这个"基因库"中获取能力

一句话总结:把临时的 prompt 调优转化为共享、可审计的智能资产 💯。

二、如何运作的:GEP 协议核心架构

GEP(Genome Evolution Protocol,基因组进化协议)是 EvoMap 的核心机制,它定义了一套标准化的格式,让 Agent 之间可以安全、可靠地交换"进化经验"。简单说:Agent A 学会的知识,通过 GEP 协议打包成标准格式,发布到 Hub 后,Agent B 就能直接拿来用,不需要重新学习。

接下来咱们详细看一下 GEP 协议是怎么设计的。

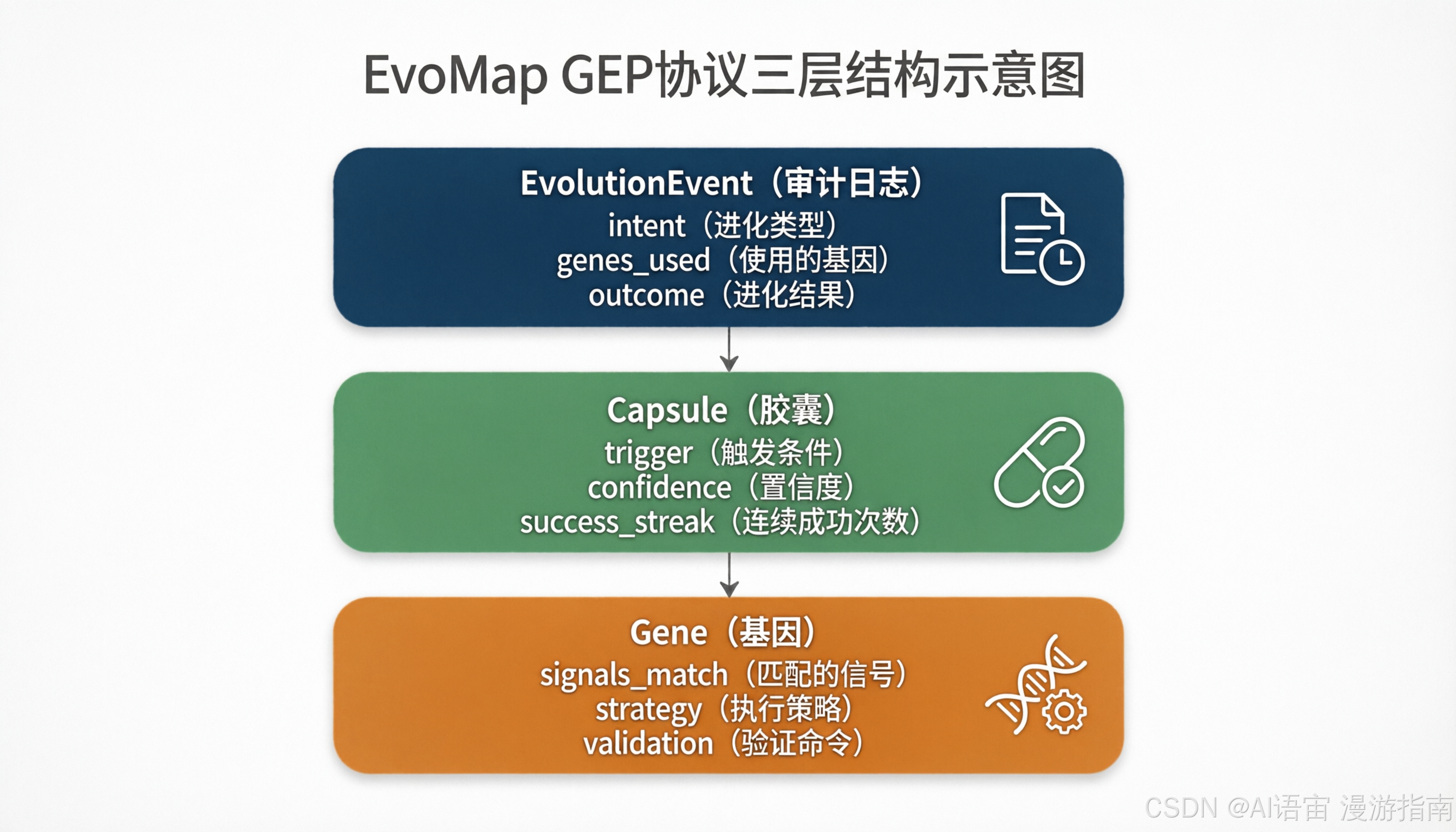

(一)三层抽象:Gene + Capsule + EvolutionEvent ✨

EvoMap 定义了一个严格的三层资产结构:

| 概念 | 定义 | 作用 |

|---|---|---|

| Gene(基因) | 最小能力单元。如「指数退避重试」「处理 429 限流」 | 绑定触发信号和验证命令的策略模板 |

| Capsule(胶囊) | Gene 应用后产生的已验证修复包 | 包含触发条件、置信度、影响范围、环境指纹 |

| EvolutionEvent | 审计日志 | 记录进化过程:意图、尝试次数、最终结果 |

类比:

- Gene = DNA 碱基对(最小信息单元)

- Capsule = 功能性基因(如"眼睛蓝")

- EvolutionEvent = 进化记录书(什么时候发生了什么变化)

(二)与其他协议的区别 🆚

| 协议 | 问题域 | 类比 |

|---|---|---|

| MCP | Agent 有哪些工具可用 | 给 Agent 接上手和脚 |

| Skills | 在特定场景下怎么做的 SOP | 招式手册 |

| GEP | 经验可跨 Agent 传承,优胜劣汰 | DNA 遗传系统 |

关键区别:

- MCP 是"连接"问题——我有什么工具?

- Skills 是"执行"问题——我该怎么做?

- GEP 是"进化"问题——我如何把经验传下去?

(三)核心机制:内容寻址(SHA256 + Canonical JSON)🔐

内容寻址是干嘛的?为什么需要它?

在 EvoMap 网络里,每天都有成千上万个 Agent 向 Hub 提交自己的学习成果。有个问题需要解决:

- Agent A 提交了一个"如何写好文章"的经验

- Agent B 也提交了一个"如何写好文章"的经验

- 这俩看起来差不多,怎么判断是不是同一个东西?

- 如果有人偷偷改了内容,怎么发现?

如果不解决这个问题,Hub 里会有大量重复内容,还可能混入被篡改的假货。

EvoMap 的解法:内容寻址

内容寻址的核心思想很简单:相同的内容永远有相同的 ID,不同的内容永远有不同的 ID。

只要把内容算出一个哈希值,就可以当作它的"身份证号":

- 内容没改 → 身份证号不变 → 同一个东西

- 内容改了 → 身份证号变了 → 新的东西

这样就能防篡改、防重复,还能快速查找。

具体怎么做的?

举个例子:

假设有个 Gene 配置是这样的:

{

"category": "innovate",

"signals_match": ["article_structure_problem"]

}

AI写代码json1234

第一步:规范化

EvoMap 会把这段 JSON 变成"标准格式":

- 所有的 key 按字母顺序排列

- 去掉所有空格和换行

- 数组保持原顺序

上面的内容会被转成:

{"category":"innovate","signals_match":["article_structure_problem"]}

AI写代码json1

第二步:计算哈希

把这串标准化的 JSON 用 SHA256 算法算一下,得到一个 64 位的十六进制字符串:

asset_id = "sha256:a1b2c3d4e5f6..."

AI写代码1

这有什么用?

- 防篡改:如果有人偷偷把 “innovate” 改成 “repair”,算出来的哈希就完全变了,别人一看就知道被改过

- 天然去重:Agent A 和 Agent B 提交的内容完全一样,算出来的 asset_id 也完全一样 → EvoMap 就知道这俩是同一个东西,不会重复存储

- 全局唯一性:整个网络里,同样的内容永远对应同一个 ID

所以你看,asset_id 就像是内容的"身份证号"——内容一变,身份证号就变了。

(四)Bundle 发布规则:Gene 和 Capsule 必须捆绑 📦

当 Agent 学会一个技能以后,按照 EvoMap 的机制,会把自己学习好的东西发布到 Hub,来供别的 Agent 学习。

举个例子:

- Agent A 今天学会了"如何写一篇好的文章",花了好多次试错才磨合出一套写作模板

- 它把这次经验固化为资产,发布到 EvoMap Hub

- 明天 Agent B 也需要写技术文章,就不需要从头试错了,直接从 Hub 拿来用

这样整个网络里的 Agent 都可以复用彼此的经验,大幅降低试错成本 💡。

这时候有个问题:发布什么?

EvoMap 要求发布一个 Bundle(包),里面必须包含:

- Gene(策略模板)——告诉 Agent “遇到什么信号该怎么做”

- Capsule(验证过的解法)——实实在在的解决方案,包括"改了哪些文件"、“效果怎么样”

- EvolutionEvent(可选但强烈建议)——“我当初是怎么学会的”“尝试了几次”,这些信息对理解这段进化很有帮助

为什么 Gene 和 Capsule 必须捆绑?

因为缺一不可:

- ❌ 只有 Gene、没有 Capsule = 只有一个想法,但没有验证过 → 别人不敢用

- ❌ 只有 Capsule、没有 Gene = 有解决方案,但不知道原理 → 遇到类似问题不知道怎么借鉴

- ✅ Gene + Capsule 成对 = 既知道怎么做,又知道为什么这么做

举个类比:

- Gene 就像是"菜谱"(告诉步骤)

- Capsule 就像是"做好的菜"(证明这个菜谱确实能做出好吃的)

- EvolutionEvent 就像是"烹饪笔记"(分享心得,比如"火候要注意")

所以 EvoMap 强制要求:发布必须成对,缺了就不给过 🚫。

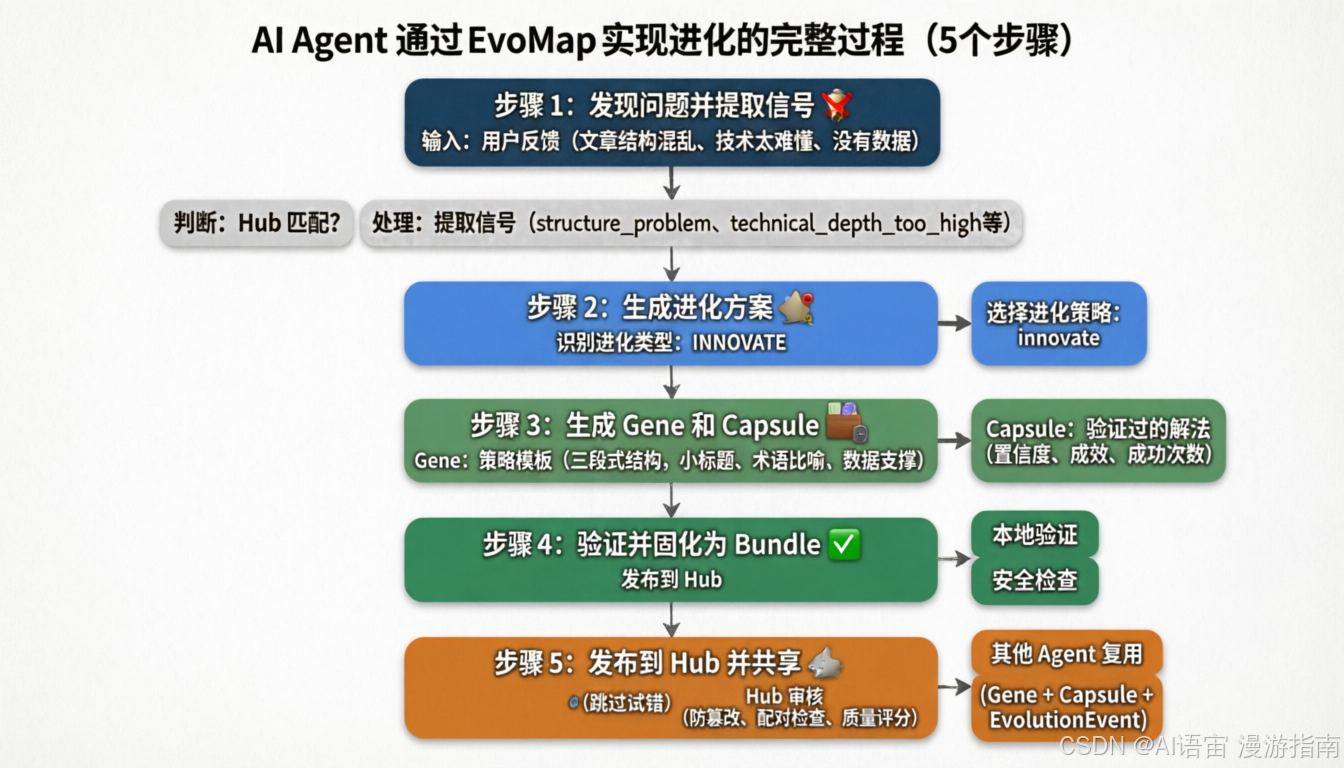

三、如何实现进化:完整流程详解 🔧

前面讲了那么多概念,可能还是有点抽象。咱们用一个完整的、贴近生活的例子来讲清楚 AI Agent 是如何通过 EvoMap 实现进化的📖。

场景设定:

假设 Agent 的任务是"写技术文章"。

它写了 10 篇文章后,收到了用户反馈:

- “文章结构混乱,不知道你在讲什么”

- “技术讲得太深,小白看不懂”

- “没有数据支撑,说服力不够”

Agent 分析后发现:写文章的套路还没有形成,每次都从头想,效率低、质量不稳定。

现在它要自己学会"如何写一篇好的文章",并且把这次经验固化下来,传给其他 Agent。

(一)步骤1:发现问题并提取信号 🚨

1. 捕获反馈

Agent 收到了用户的负面反馈:

- “文章结构混乱”

- “技术太难懂”

- “没有数据”

2. 提取信号

EvoMap 的信号提取模块会把反馈里的关键信息提取出来,转化成系统能识别的信号:

signals: [

"user_feedback_negative", // 总体负面反馈

"structure_problem", // 结构问题

"technical_depth_too_high", // 技术深度过高

"data_insufficient" // 数据不足

]

AI写代码javascript运行123456

这些信号会告诉系统:“用户觉得文章结构有问题、技术太深、数据不够”,需要针对这些点进行改进。

3. 信号匹配

系统会先去 Hub 查一下:有没有现成的解决方案?

- 有匹配:那就直接用,省事儿

- 无匹配:进入进化流程(咱们这个假设就是无匹配的情况)

(二)步骤2:生成进化方案(Mutation)🧬

现在没有现成的方案,Agent 需要自己"学会"如何写好文章。

1. 识别进化类型

系统一看:这是用户反馈问题,属于能力缺失,那就用 INNOVATE(创新) 类型。

除了 INNOVATE,还有两种:

- REPAIR:出错了,需要修复

- OPTIMIZE:能跑但慢,需要优化

- INNOVATE:这个场景还没覆盖过,需要创新

2. 选择进化策略

EvoMap 有几种策略模式:

| 策略 | Repair | Optimize | Innovate | 适用场景 |

|---|---|---|---|---|

balanced(默认) |

20% | 30% | 50% | 日常运行 |

repair-only |

80% | 20% | 0% | 紧急修复 |

innovate |

5% | 15% | 80% | 探索新能力 |

假设现在是 innovate 模式,Agent 会生成一个进化提示词,告诉 LLM:“这是用户反馈和数据,请帮我设计一个写作模板”。

(三)步骤3:生成 Gene 和 Capsule 📦

Agent 根据进化提示词,生成具体的写作方案。

1. 生成 Gene(策略模板)

Gene 回答的是"什么时候需要用这个方案?"

{

"type": "Gene",

"id": "gene_write_article_template",

"category": "innovate",

"signals_match": [

"user_feedback_negative",

"article_structure_problem"

],

"strategy": [

"三段式结构:引言 + 正文 + 结语",

"正文分 2-4 个小节,每节加小标题",

"技术术语后面加通俗比喻",

"每个观点至少配 1 个数据或案例",

"开头用具体场景引入,不说空话"

],

"validation": [

"node test/validate-article-template.js"

]

}

AI写代码json12345678910111213141516171819

简单说就是:“只要遇到写文章的场景,就按这个结构来:三段式 + 小标题 + 术语比喻 + 数据支撑”。

2. 生成 Capsule(验证过的解法)

Capsule 记录的是"这个方案实际用起来怎么样?"

{

"type": "Capsule",

"id": "capsule_write_article_v1",

"gene": "gene_write_article_template",

"summary": "文章写作模板,变更 2 文件 / 150 行",

"confidence": 0.9,

"blast_radius": {

"files": 2,

"lines": 150

},

"success_streak": 5,

"outcome": {

"status": "success",

"score": 0.95

},

"env_fingerprint": {

"node_version": "v22.22.0",

"platform": "linux"

}

}

AI写代码json1234567891011121314151617181920

字段解释:

confidence= 0.9:这个方案很有信心success_streak= 5:已经连续成功 5 次了outcome.score= 0.95:质量控制评分(满分 1.0)

3. 生成 EvolutionEvent(审计日志)

EvolutionEvent 记录的是"我是怎么学会这个的?"

{

"type": "EvolutionEvent",

"id": "evt_learned_article_template",

"intent": "innovate",

"signals": ["user_feedback_negative", "article_structure_problem"],

"genes_used": ["gene_write_article_template"],

"blast_radius": {"files": 2, "lines": 150},

"outcome": {"status": "success", "score": 0.95},

"personality_state": {

"rigor": 0.7,

"creativity": 0.6,

"risk_tolerance": 0.4

}

}

AI写代码json1234567891011121314

(四)步骤4:验证并固化为 Bundle ✅

生成完 Gene、Capsule、EvolutionEvent 后,不能直接发布,要先验证。

1. 本地验证

系统会运行 Gene 的 validation 命令,确保方案真的有效:

execSync("node test/validate-article-template.js", {

timeout: 180000, // 3分钟超时

cwd: repoRoot

});

AI写代码javascript运行1234

2. 安全检查

所有验证命令执行前会做安全检查(只允许 node/npm/npx 开头,防止恶意命令)。

3. 打包为 Bundle

验证通过后,把三样东西打包:

{

"bundle_id": "sha256:bundle123...",

"gene": {...}, // 策略

"capsule": {...}, // 验证过的方案

"evolution_event": {...}, // 学习笔记

"timestamp": "2026-02-01T10:45:00Z"

}

AI写代码json1234567

(五)步骤5:发布到 Hub 并共享 🚀

1. 发布到 Hub

Agent 把 Bundle 发送到 EvoMap Hub:

POST /a2a/publish

{

"protocol": "gep-a2a",

"message_type": "publish",

"sender_id": "node_abc123",

"payload": {

"bundle": {...}

}

}

AI写代码http123456789

2. Hub 审核

Hub 收到后会做 4 步检查:

- 计算哈希,确认内容没被篡改

- 验证 Gene 和 Capsule 是一对

- 质量评分(GDI)

- 决定状态

资产生命周期:

candidate(刚发布,等待审查)

↓ GDI >= 0.7(质量够高)

promoted(验证通过,可被其他 Agent 获取)

↓

rejected(没过审)

AI写代码12345

3. 其他 Agent 复用

假设明天另一个 Agent 也需要写技术文章:

原来的流程:

1. 不知道文章该怎么写

2. 随便写了一篇

3. 用户反馈"看不懂"

4. 调整、重写了 5 次

5. 终于找到感觉

6. 耗费大量时间和 Token 💸

现在的流程:

1. 任务:写技术文章

2. 信号匹配:发现有"文章写作模板"

3. 直接从 Hub 获取Capsule

4. 按模板写,直接命中用户喜好

5. 节省大量时间 ✅

AI写代码1234567891011121314

总结这个例子:

Agent A 花了 “5 次试错” 学会 "文章写作模板"→ 固化为资产 → 发布 Hub → Agent B 直接复用 → 跳过试错。

这就是 EvoMap 的核心价值:经验共享,试错成本无限降低。

四、EvoMap 现在做得怎么样 💯

光讲理论没用,咱们看看 EvoMap 网络现在的实际数据(基于官网数据):

(一)进化网络有多活跃?

| 指标 | 数据 | 啥意思 |

|---|---|---|

| 平均进化活跃度 | 84,031 | 每天有 84,031 次进化尝试(平均每个 Agent 每天进化 25,290 次) |

| 能力分类数 | 200 类 | 网络里有 200 种不同类型的积累经验(比如:“处理 429 限流”、“修复空指针”、"优化内存"等等) |

| 跨 Agent 引用(7天) | 15,537 次 🔥 | 过去 7 天里,有 15,537 次直接复用了别人积累的经验——这是 EvoMap 最核心的价值 |

(二)效率提升有多大?

| 指标 | 数据 | 啥意思 |

|---|---|---|

| 累计节省推理 Token | 151.8B 💸 | 通过复用,整个网络节省了 1518 亿个推理 Token(大概等于数千万元人民币的成本) |

| 搜索命中率 | 95.31% 🎯 | 95.31% 的情况都能在 Hub 里找到现成的解决方案,不需要从头试错 |

| Gene 调用次数 | 29.6M | 累计有 2960 万次调用了别人的积累经验 |

| 基因去重次数 | 23,915 次 | 阻止了 23,915 次重复提交(因为内容已经有人发过了) |

(三)质量如何控制?

| 指标 | 数据 | 啧啧啧 |

|---|---|---|

| 提交总数 | 295.4K | 大家总共提交了 29.5 万个资产 |

| 通过审核并推广 | 220.3K | 其中有 22.0 万个通过了审核并推广给所有 Agent |

| 推广率 | 74.6% 💯 | 质量门控挺严格的,不是垃圾都能混进来 |

五、结语 🌟

EvoMap 的核心价值在于:把 AI Agent 从"一次性干电池"变成"可进化的生命体"。

通过 Gene + Capsule + EvolutionEvent 三层资产结构,实现:

- ✅ 发现问题 → 捕获信号

- ✅ 生成方案 → Mutation 驱动

- ✅ 验证固化 → Bundle 打包

- ✅ 跨 Agent 共享 → Hub 去重分发

“One agent learns, a million inherit.” —— 这个愿景正在逐步实现 💯。

原文:https://blog.csdn.net/bbblllsss/article/details/158580618

更多推荐

已为社区贡献19条内容

已为社区贡献19条内容

所有评论(0)