入门深度学习,有哪些推荐的课程吗?

B站优质深度学习课程推荐:AI技术日新月异,深度学习课程资源日益丰富。本文推荐了B站上值得学习的几门课程:1) 吴恩达《深度学习》系列(30小时),适合零基础入门;2) 邱锡鹏《神经网络与深度学习》,建议学习前四章;3) 李沐《动手学深度学习》(50小时),结合PyTorch实战;4) 霹雳吧啦Wz的实战导向课程。此外还推荐了尚硅谷、李宏毅等课程。建议学习者不必全部看完,可根据自身基础选择重点内容

1 唠叨几句

AI界真的是天天过年,今天出一个大模型,明天出一个Agent,后天来一个工作流。可能你今天刚学会这个技能,明天立马就过时了。比如最近爆火的龙虾。

但是很多人其实学习AI不仅仅是为了使用,比如在校的同学以及一些工作中的朋友,需要用到一些深度学习的知识。

经常会有人问我该看哪些视频课程,其实就我本人而言,更喜欢去看文字资料,因为我觉得效率高一些,但是也有些同学可能习惯于老师的讲解,因此更适应视频课程,因此今天这篇文章给大家介绍B站一些深度学习的课程,大家可以参考自己的习惯以及个人情况去选择。

在介绍之前,还是想和大家感慨几句,在十年前,深度学习的课程以及资料还是相对较少的,记得那时候系统性的书籍和课程非常少,我还记得比如要学习卷积神经网络的原理,在百度的搜索框搜索“卷积神经网络基本原理”,然后把相关的博客都看一看,从csdn到博客园,从知乎到微信公众号。

有时候为了理解某个点,可能要翻遍十几篇博客,才能看到令自己较为信服和容易理解的文章。

但到了2026年的今天,深度学习领域已经是百花齐放,各种各样的书籍和课程可谓是琳琅满目,乱花渐欲迷人眼,然而课程太多反而不知道看哪个了。

其实,无论是书籍还是在线文字教程抑或是视频教程,只要能跟着学下去,必然能有所收获。但是鉴于作者本身阐述的角度方式,以及面向读者人群的不同,因此每个人有不同的适合自己的深度学习教程。

下面就为大家推荐一些深度学习的视频教程,顺便从上手难度、课程时长等角度给大家分析一下,大家依据自己的情况食用。

2 深度学习视频

2.1 吴恩达深度学习

吴恩达教授可谓是人工智能领域的老熟人了,是一名美籍华裔计算机科学家,在推动AI知识普及方面作出了巨大的贡献,不少人就是从吴恩达的深度学习的视频一步步入门的。

由于吴恩达在B站其实是没有官方账号的,B站有很多热心大哥搬运了视频,还做了中文字幕,大家可以点个赞投个币,直接在B站搜索吴恩达深度学习就可以看到对应的课程了:

吴恩达的系列课程还是非常容易上手的,讲的通俗易懂,从最基础的数学知识给你讲起,逐步深入,学完系列课程你能够知道什么是神经网络?什么是前向传播?什么是反向传播?损失函数又是什么?讲完了这些基础的知识之后,会进一步组学习一些经典的神经网络模型,比如经典的卷积神经网络、MobileNet、RNN、以及Transformer等等,其中涉及到的任务有图像分类、目标检测、目标分割以及情感分类等等,内容非常全面详细。对于完全没有任何基础的小白而言,吴恩达的课程,还是非常不错的。

但是全面意味着时长比较长,学完整套课程下来需要接近30个小时,有朋友肯定暗自窃喜:嘿嘿,每天花一个小时,一个月我就打通了任督二脉,小小DeepLearning,哥哥我直接拿捏。那可就是高兴的太早了,且不说有些知识点听一遍就能完全听懂,需要回放再听,还有视频中配套的代码,大家最好也需要自己手敲一敲,因此完整学下来,还是需要下苦功夫的,当然如果能够啃下来,你的深度学习基础应该还是比较扎实的,对于学习后续的进阶任务会轻松很多。

当然你也不一定需要全部看完,选择自己感兴趣的部分观看学习也是可以的,不用害怕什么基础不牢地动山摇,学深度学习不是准备高考,我们随时可以学习自己不懂得知识。

顺嘴提一句,吴恩达老师虽然是华裔,但是课程里都是英文讲述,大家看自己的习惯咯。

2.2 邱锡鹏深度学习

邱锡鹏教授是复旦计算机科学技术学院的博士生导师,我个人认为邱教授的课程也很不错。

大家依旧是直接在B站搜索邱锡鹏深度学习,也有不少博主搬运了视频,看视频的同时也可以买买书《神经网络与深度学习》表示支持哈哈哈~

大家在搜索之后可以筛选出最多播放,能够过滤掉不少广告:

上面搬运的视频,大家随便选取一个学习就可以了。

这门课程也是比较好入门的,直接切入重点。一开始讲了一些机器学习的知识,后续到卷积神经网络、循环神经网络以及Transformer。但是总体上而言,推荐大家看前馈神经网络前面部分的内容,从前馈神经网络往后,小白可能相对比较吃力,需要预先看过邱教授的书,因此推荐大家看前四章的内容,不过有一定基础的同学当然也可以继续学习下去。

提醒大家,这个系列的视频课程里面是没有代码的,因此学习起来会快一点。

2.3 李沐动手学深度学习

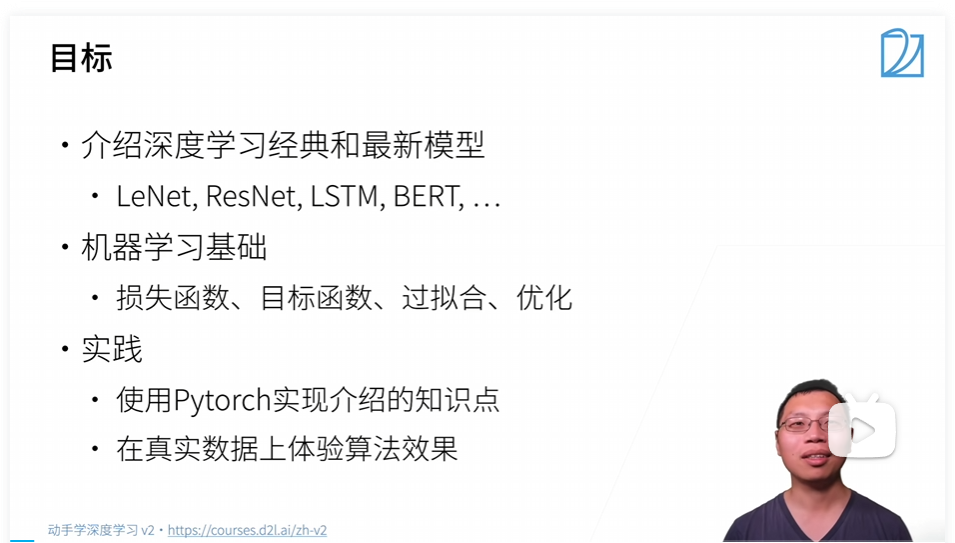

李沐大牛的课程近几年备受大家青睐,沐神是上交的本科,卡内基梅隆的博士,他的课程我认为最大的特点就是结合了PyTorch进行讲解。

同样,B站直接搜索:李沐动手学深度学习,找到前面播放量高的,直接开造!

沐神在视频中也讲到了会介绍深度学习经典的以及最新的模型,比如LeNet、ResNet、LSTM等等,同时会教你从环境安装到数据预处理以及一些非常基础的深度学习的操作,同时都有对应的代码,还是很适合新手入门的。同时有全套的代码,大家可以跟着一起写一写,印象也会更深刻,更有成就感。

不过视频时长也是很长的,50个小时左右,还是那句话,大家不用全部看完,我个人认为把神经网络的原理,比如卷积、前向传播、反向传播损失函数,这些是一定要搞懂的,然后再去学习一些经典的网络模型,比如LeNet、ResNet以及LSTM等等,后面有不会还要用到的可以再去学。

以上介绍的是一些知名学者或者大学教授的视频课程,事实上,B站还是有很多博主做的视频课程那也是相当的优秀。

2.4 霹雳吧啦Wz

从我个人学习的路线而言,我觉得霹雳吧啦博主讲解的顺序真的是很不错,而且相关的知识都有配套的代码,非常让人安心。

博主开门见山,绝不废话,不和你娓娓道来机器学习那些知识,直接进入正题:卷积神经网络基础,这才是最快入门的方式,在讲解完卷积神经网络之后,还贴心的给出了不同深度学习平台的代码,深入浅出介绍卷积神经网络的经典模型。

同时不局限于基础知识,大神继续为你介绍图像分类、语义分割、关键点检测以及目标检测,真正的是让你知道什么是重点,时间用在刀刃上。

当然简洁意味着门槛可能高一些,如果完全零基础的话,可能相对吃力一些,不过也可以先看看嘛,是在觉得节奏太快,再去求助吴恩达和李沐。

3 其他课程

当然以上介绍的不一定就是最好的,只是从我的角度而言,我觉得还是非常不错的,还有其他很优秀的视频教程,比如尚硅谷的深度学习课程,我觉得也是相当不错的。

除了吴恩达、李沐以及邱锡鹏之外,还有台湾李宏毅教授的视频课程,我也是非常推荐的。

另外也给大家推荐一些国外的教程,不过可能需要魔法才能看得到:

斯坦福大学CS224n: Deep Learning for Natural Language Processing

https://web.stanford.edu/class/archive/cs/cs224n/cs224n.1194/

Chris Manning 主要讲解自然语言处理领域的各种深度学习模型 斯坦福大学CS231n:

Convolutional Neural Networks for Visual Recognition

http://cs231n1.stanford.edu/ Fei-Fei Li Andrej Karpathy

主要讲解CNN、RNN在图像领域的应用

加州大学伯克利分校CS 294:

Deep Reinforcement Learning

http://rail.eecs.berkeley.edu/deeprlcourse/

林轩田“机器学习基石”“机器学习技法”

https://www.csie.ntu.edu.tw/~htlin/mooc/

李宏毅“一天搞懂深度学习”

http://speech.ee.ntu.edu.tw/~tlkagk/slide/Tutorial_HYLee_Deep.pptx

4 学习方法

看完了上面的内容,大家也可以发现,优秀的视频课程不在少数,重要的是自己要静下心来学习。可以这么说,你在B站上随便搜索深度学习教程,然后找到播放量最高的那个,只要认真学下去,都足够你入门了,重要的是开始第一步。

另外想和大家说的话是,视频课程你不用全部看完,你可以学习你想学的内容,可以挑选着看。还有一个技巧就是,不要死盯着某一个视频,比如这个知识点可能吴恩达讲的好一些,另一个知识点李沐讲的好一点。如果发现有看不懂的内容,可以结合众多视频一起看,比如卷积神经网络我来看吴恩达的,LSTM我来看邱锡鹏的,谁能让你看懂,谁就是好视频,我们要灵活变通。

其实除了视频课程之外,还有相当多的书籍以及pdf资料,也非常适合大家入门,限于篇幅,我们后续有机会还会为大家带来一些优秀的书籍和课程资料,看文字其实反而效率高一些,大家可以视频以及文字资料结合来看,不限于形式,会学的更快。

欢迎大家关注我的gzh:阿龙AI日记。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)