【论文精读】Agentic Memory: Learning Unified Long-Term and Short-Term MemoryManagement for Large Language

一、前言

大预言模型(LLM)智能体在长周期推理任务中面临根本性限制,这主要源于有限的的上下文窗口,使得有效的记忆管理变得至关重要。现有方法通常讲长期记忆(LTM)和短期记忆(STM)作为独立组件处理,依赖于启发式规则或辅助控制器,这严重限制了自适应性和端到端优化能力。

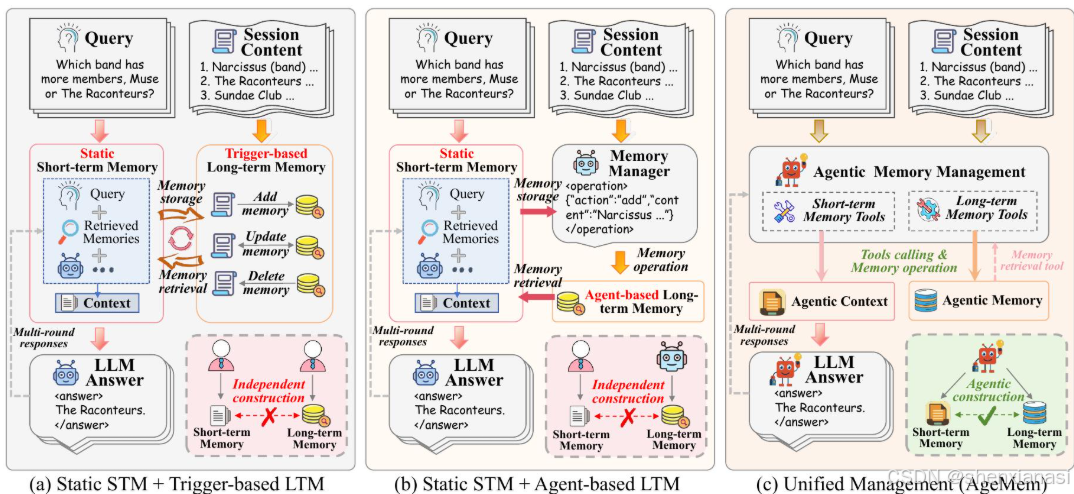

现有架构的局限性主要体现在将LTM和STM视为分离且松散耦合的模块。传统架构通常遵循两种模式:具有基于触发器的LTM的静态STM,或具有基于智能体的LTM的静态STM。在这两种设置中,两个记忆系统被独立优化,然后以临时方式组合,导致记忆构建碎片化和性能次优。

同时,实现统一记忆管理面临三大基本挑战:

(1)功能异构性协调:LTM和STM服务于不同但互补的目的;

(2)训练范式不匹配:现有强化学习(RL)框架对两种记忆类型采用显著不同的训练策略;

(3)实际部署约束:许多智能体系统依赖辅助专家LLM进行记忆控制,显著增加推理成本和训练复杂性。

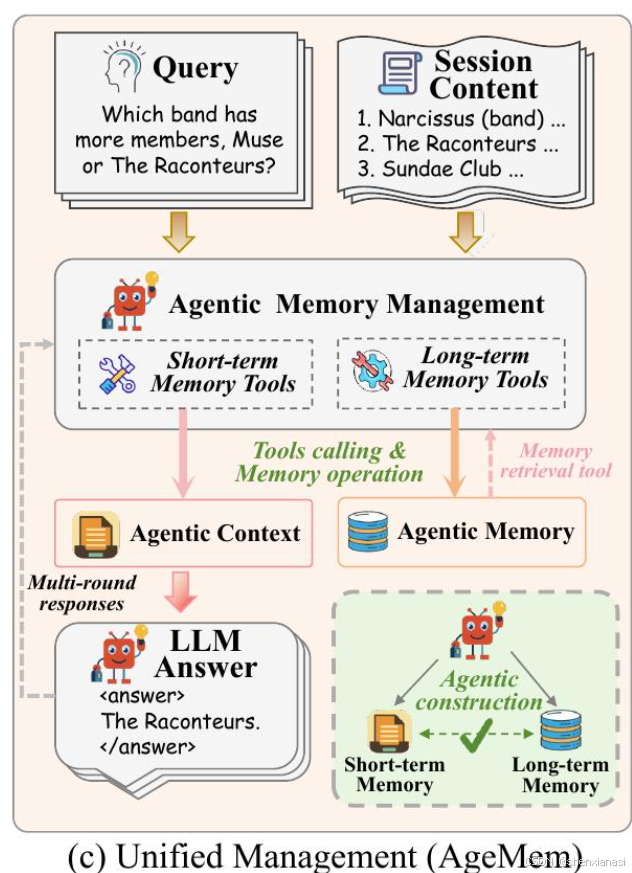

为此,阿里巴巴集团与武汉大学联合提出了Agentic Memory(AgeMem),这是一个统一框架,将LTM和STM联合管理。与先前将记忆视为外部组件的设计不同,AgeMem通过基于工具的统一接口将两种记忆类型直接集成到智能体的决策过程。研究团队还开发了一种配备逐步式GRPO机制(step-wise GRPO)的三阶段渐进式强化学习策略,有效促进端到端的统一记忆管理行为学习。在多个模型与长期任务基准上进行了全面评估,验证了AgeMem在复杂智能体任务中的稳健性与有效性。

接下来,让我们精读这篇paper看看研究团队是如何提出AgeMem的?以及为什么这么做?还有没有不足之处等待后人继续follow?

二、创新点概览

针对现有将长期记忆(LTM)和短期记忆(STM)作为独立的组件处理而限制了适应性和端到端优化的问题,本文提出了智能体记忆(AgeMem)的统一的框架,将LTM和STM管理直接集成到智能体的策略中。

而为了训练AgeMem,提出了一种三阶段渐进式强化学习策略,设计了一种逐步GRPO来解决由记忆操作引起的稀疏和不连续的奖励。

三、现在处理LTM和STM的方法及其挑战

1.现有处理方法

现有的研究主要将长时记忆(LTM)和短时记忆(STM)视为独立的组成部分。

短时记忆(STM)通常通过检索增强生成(RAG)来增强,例如在MainRAG和ReSum中,它们通过外部检索或定期总结来扩展可用上下文。尽管这些方法在某些任务中有效,但它们严重依赖于预定义的计划或启发式规则,可能导致忽略不常出现但至关重要的细节,以及不必要的噪声。

相比之下,长时记忆(LTM)管理沿着不同的路线发展,通常分为基于触发和基于代理两种模式:前者在预定义的时刻执行固定的记忆操作,而后者则包含一个专门的记忆管理器来确定存储什么以及如何存储。尽管提供了更大的灵活性,但大多数方法仍然依赖于手工制作的规则或辅助专家模型,从而限制了适应性并增加了系统复杂性

因此,LTM和STM通常被视为分离且松散耦合的模块。

独立和统一内存管理框架之间的比较。(左)具有静态STM和基于触发器的LTM的传统框架。(中)独立框架,带有一个额外的内存管理器,以基于代理的方式控制LTM,而STM保持静态。(右)提出的AgeMem框架,其中LTM和STM通过显式的基于工具的操作进行联合和智能管理。

在(a)和(b)的两种设置中,这两个记忆系统都是独立优化的,然后再特定情况下组合,导致碎片化的记忆构建和在长程推理任务中的次优性能。

2.面临的根本性挑战

实现统一的内存管理面临三个根本性的挑战。

(C1)功能异构协调:LTM 和 STM 服务于不同但互补的目的:LTM 决定存储、更新或丢弃什么,而 STM 管理从活动上下文中检索、总结或删除什么。挑战在于设计一种统一的机制,以协同的方式协调它们的相互作用。

(C2)训练范式不匹配:现有的强化学习(RL)框架对两种内存类型采用明显不同的训练策略。以 LTM 为中心的训练通常利用交互之前可用的会话级信息,而 STM 训练通常注入干扰物以模拟长时程上下文。此外,标准 RL 假设具有稳定奖励的连续轨迹,这与内存操作产生的固有碎片化和不连续的体验相冲突,使得端到端优化特别具有挑战性。

(C3)实际部署约束:许多代理系统依赖于辅助专家 LLM 进行内存控制,从而显著增加了推理成本和训练复杂性。如何在不依赖外部专家模型的情况下将统一的内存管理直接集成到代理中仍然是一个开放的问题。

四、Agentic Memory(AgeMem)框架

与先前将记忆视为外部组件的设计不同,AgeMem将两种记忆类型直接整合到代理的决策过程中。通过统一的基于工具的接口,LLM自主调用并执行LTM和STM的记忆操作。此外,设计了一个三阶段渐进式RL策略:模型首先获得LTM存储能力,然后学习STM上下文管理,最后在完整的任务设置下协调两种形式的记忆。为了解决跨训练阶段的经验碎片化问题,设计了一种逐步分组相对策略优化(GRPO),它将跨阶段的依赖关系转化为可学习的信号,从而缓解了RL中稀疏和不连续奖励带来的挑战。

AgeMem通过一组专门的工具将记忆管理能力直接集成到代理中,使模型能够通过三阶段渐进策略学习统一记忆管理的最优策略。

五、Method

1.问题定义

在每个时间步t,智能体观察到一个状态 ∈ S,该状态由对话上下文(短期记忆)

、长期记忆存储

和任务规范

组成:

。规范

包括输入查询q、上下文信息

和(仅用于训练)预期答案

。这种公式使智能体能够将其决策建立在瞬时上下文和持久知识的基础上。

给定,智能体从混合动作空间中选择一个动作

∈ A,该空间包括语言生成以及记忆操作。该决策由参数化策略

控制,定义为

,其中θ表示LLM参数,

。对于轨迹

,累积奖励定义为:

【公式解释】

: 表示一个可调权重系数,用于平衡不同奖励分量 Ri(τ) 的重要性。论文中提到

,即

可以是

(任务完成奖励权重)、

(上下文管理奖励权重) 或

(记忆管理奖励权重)。在实验中,这些权重被均匀设置为 1/3。

Ri(τ): 表示轨迹 τ 的第 i 个奖励分量。根据 的含义,Ri(τ) 具体指代

(任务完成奖励)、

(上下文管理奖励) 或

(记忆管理奖励)。

Ppenalty(τ): 表示轨迹 τ 的惩罚项。此项用于惩罚代理的不良行为,例如冗余存储、过度工具使用和无控制的上下文扩展。

在实际应用中,如何动态调整权重  以适应不同类型或复杂度的任务,而不是始终保持 1/3 的均匀分配?

以适应不同类型或复杂度的任务,而不是始终保持 1/3 的均匀分配?

在实际应用中,动态调整权重 以适应不同类型或复杂度的任务,是提升 AgeMem 框架(以及任何基于复合奖励的强化学习系统)性能的关键。始终保持 1/3 的均匀分配虽然简化了设计,但在面对多样化的实际场景时,往往无法达到最优效果。

以下是几种在实际应用中动态调整权重 的策略和方法:

1.基于任务特性进行手动或启发式调整

最直接的方法是根据任务的先验知识和领域专家经验来手动设置或启发式地调整权重。

-

任务类型分析:

-

高准确性要求任务:如果任务对最终答案的正确性或精确度有极高要求(例如,法律咨询、医疗诊断辅助),则应大幅提高

的权重。此时,即使记忆管理和上下文效率稍有牺牲,也要确保任务完成的质量。

-

长序列、多步骤任务:对于需要长时间交互、分解为多个子任务的复杂流程(例如,项目管理、复杂科研模拟),LTM 和 STM 的管理变得至关重要。此时,可以适当提高

和

的权重,以鼓励代理更好地积累、检索知识和维护上下文,因为这些是完成长期任务的基础。

-

资源敏感任务:如果部署环境对计算资源(如 token 消耗、API 调用次数)有严格限制,则应提高

中关注“压缩效率”和“预防性行为”的子项权重,以鼓励代理更积极地进行上下文缩减和过滤。

-

-

复杂度评估:

-

简单任务:对于上下文短、无需复杂记忆的任务,可以降低

和

的权重,让代理更专注于直接完成任务 (

较高)。

-

复杂任务:随着任务复杂度的增加,记忆和上下文管理的重要性也随之增加,因此应提高

和

的权重。

-

优点:实现简单,易于理解,对于有明确领域知识的场景效果较好。 缺点:依赖专家经验,调整过程可能耗时,不具备通用性和自适应性。

2.基于任务表现的自适应调整

这种方法尝试在训练或运行时根据代理在任务上的表现来动态调整权重。

-

多目标优化: 将

,

,

视为多个独立的优化目标。可以使用多目标强化学习方法,例如:

-

Pareto 优化:在多个目标之间找到一个 Pareto 最优解集,即没有一个目标能在不损害其他目标的情况下得到改善。这通常涉及训练一组策略,每个策略在不同权重配置下表现最佳,然后在运行时选择最合适的策略或进行加权组合。

-

动态加权:在训练过程中,根据每个奖励分量的当前表现(例如,是否达到某个阈值、改进速度),动态调整其权重。例如,如果

已经很高,但

表现不佳,则可以临时增加

的权重,以促进该方面的学习。

-

-

元学习/超参数优化: 将权重

视为超参数,并使用元学习(Meta-Learning)或自动化机器学习(AutoML)技术进行优化。

-

进化算法:使用进化算法(如遗传算法)搜索最优的权重组合。在每次迭代中,评估不同权重组合下的代理性能,并选择表现最好的权重进行“繁殖”。

-

贝叶斯优化:通过构建目标函数的概率模型,智能地探索权重空间,以找到最大化代理性能的权重。

-

-

基于梯度的权重学习: 在更高级的设置中,可以尝试让模型本身学习如何生成或调整这些权重。这通常涉及一个外部的“元控制器”或一个额外的神经网络层,其输出是权重,这些权重再用于加权主策略的奖励。

-

动态奖励塑形 (Dynamic Reward Shaping):根据任务的进展和当前状态,动态地生成或调整奖励信号,包括权重。例如,在任务初期,可能更注重探索和记忆积累;在任务后期,则更注重任务完成。

-

优点:具备一定程度的自适应性,可以在一定范围内找到更好的权重配置。 缺点:实现更复杂,可能需要额外的训练时间和计算资源,多目标优化本身就是挑战。

3.基于当前状态或上下文的动态调整

这是最精细的调整方式,它允许权重在任务执行的每一步根据当前的环境状态或代理的内部状态进行变化。

-

基于 LLM 自身判断: 既然 AgeMem 已经将记忆操作作为工具暴露给 LLM 代理,那么理论上也可以让 LLM 代理通过**“思考”(think)**步骤来动态调整

。在代理的 prompt 中加入指令,要求它在某些关键决策点评估当前任务的优先级,并选择性地强调某些奖励维度。例如:

-

“当前是任务的探索阶段,重点是收集信息,因此应优先考虑记忆的存储质量。”(

较高)

-

“当前上下文接近溢出,急需总结,应优先考虑上下文压缩。”(

较高) 这需要 LLM 具备更强的元认知能力和对奖励结构的理解。

-

-

基于环境信号: 根据环境提供的信号(例如,剩余的 token 预算、任务的剩余时间、任务的当前阶段)来动态调整权重。

-

Token 预算接近上限:增加

中关于压缩效率的权重。

-

任务接近截止日期:增加

的权重,促使代理尽快完成任务。

-

LTM 存储量过大:增加

中关于记忆维护(删除)的权重。

-

优点:自适应性最强,理论上能实现最精细的控制,适应实时变化。 缺点:实现难度最大,需要复杂的机制来生成或调整权重,并确保其稳定性。直接让 LLM 调整奖励权重可能导致模型“作弊”或陷入局部最优,需要谨慎设计。

总结与 AgeMem 的契合点

AgeMem 的核心思想是让 LLM 代理自主决定记忆操作。这种“工具使用”的范式与动态调整权重 的思路是高度契合的。

-

当前 AgeMem 的做法:论文中提到,实验中使用了均匀的

。但这只是一个起点。

-

潜在改进方向:

-

分阶段调整:在 AgeMem 的三阶段训练策略中,可以为不同阶段设置不同的权重。例如:

-

Stage 1 (LTM Construction):可能

的权重更高,以鼓励高质量的知识存储。

-

Stage 2 (STM Control under Distractors):可能

的权重更高,以鼓励过滤和总结。

-

Stage 3 (Integrated Reasoning):可能

的权重更高,同时保持

和

足够高以支持复杂的推理。

-

-

集成到 Policy 中:更进一步,可以训练一个策略,使其不仅输出动作,还输出用于加权奖励的权重。这会增加策略的输出维度和训练复杂性,但理论上可以实现最灵活的自适应。

-

结合启发式与 RL 优化:在实际部署时,可以先通过启发式规则设定初始权重或权重范围,然后利用强化学习进行微调,让模型在给定范围内学习最佳的权重配置。

-

动态调整 是从固定规则向更智能、自适应系统演进的重要一步,能够使 AgeMem 这样的代理在更广泛、更复杂的实际应用中发挥出更大的潜力。

在动态调整权重  的过程中,如何量化和评估不同权重组合对代理在 LTM 构建、STM 控制和集成推理这三个阶段的具体影响,以指导优化方向?

的过程中,如何量化和评估不同权重组合对代理在 LTM 构建、STM 控制和集成推理这三个阶段的具体影响,以指导优化方向?

1.阶段性指标的定义与量化

首先,需要为每个阶段定义一套清晰、可量化的评估指标,这些指标应尽可能地解耦,以反映每个阶段的核心目标。论文中已经提供了一些基础指标,我们可以进一步细化。

1.1 LTM 构建阶段 (Stage 1: LTM Construction) - 关注记忆的质量和效率

-

LTM 质量 (LTM Quality -

):

-

相关性 (Relevance):存储的记忆与任务目标(或潜在任务)的相关程度。可以使用 LLM-based Judge(如论文中 HotpotQA 的 MQ 评估)来评估存储事实与 Ground Truth Supporting Facts 的匹配度。

-

非冗余性 (Non-Redundancy):记忆库中重复或高度相似条目的比例。可以通过计算记忆条目嵌入向量的相似度来检测。

-

完整性 (Completeness):是否包含了任务所需的所有关键信息。这需要一个 Ground Truth 知识库进行对比。

-

信息密度 (Information Density):每个记忆条目所包含的有价值信息的量,避免存储过多无关细节。

-

-

LTM 效率 (LTM Efficiency -

):

-

存储操作次数 (Add/Update/Delete Calls):在 Stage 1 中,代理执行记忆存储、更新、删除操作的频率。过少可能导致信息遗漏,过多可能表示效率低下。

-

Token 消耗 (LTM Token Usage):LTM 操作(如添加长文本)所消耗的 token 数量。

-

-

LTM 维护 (LTM Maintenance -

):

-

更新/删除的及时性/准确性:代理是否及时更新过时信息或删除错误信息。这可能需要人工标注或更复杂的规则来判断。

-

1.2 STM 控制阶段 (Stage 2: STM Control) - 关注上下文的效率和信息保留

-

STM 效率 (STM Efficiency -

):

-

Token 消耗 (STM Token Usage):在 Stage 2 中,上下文的平均 token 数量(或与基线的减少量,如论文 Figure 3 所示)。

-

上下文压缩率 (Context Compression Rate):通过 SUMMARY 操作减少的 token 比例。

-

过滤有效性 (Filter Effectiveness):通过 FILTER 操作成功移除的无关信息比例。

-

-

信息保留 (Information Preservation -

):

-

关键信息保留率 (Key Info Retention):在 SUMMARY 和 FILTER 操作后,任务所需的关键信息(例如,问题中的命名实体、核心指令)在上下文中保留的比例。这通常需要预先识别这些关键信息。

-

干扰信息消除率 (Distractor Elimination Rate):成功消除的干扰信息比例。

-

-

STM 操作次数 (Summary/Filter/Retrieve Calls):在 Stage 2 中,代理执行 STM 操作的频率。

1.3 集成推理阶段 (Stage 3: Integrated Reasoning) - 关注最终任务性能和记忆协同

-

任务完成度 (Task Performance - TP ):

-

成功率 (Success Rate / J (LLM-as-a-Judge Score)):最终任务的正确率或 LLM 评估得分(论文 Table 2)。这是最直接的指标。

-

推理步骤效率 (Reasoning Step Efficiency):完成任务所需的思考/工具调用步数。

-

-

记忆协同 (Memory Coordination -

):

-

LTM 检索有效性 (LTM Retrieval Effectiveness):在 Stage 3 中,通过 RETRIEVE 操作获取的记忆与最终任务答案的相关性。

-

检索与任务的匹配度:代理在何时、何地检索了哪些记忆,以及这些记忆在最终答案生成中发挥了多大作用。

-

上下文与 LTM 的融合效果:最终答案的质量是否得益于 LTM 检索和 STM 管理的协同作用。

-

2.评估方法与实验设计

为了评估不同权重组合的影响,需要进行系统性的实验。

2.1 控制变量法

-

固定其他权重,改变一个权重:例如,固定

和

,仅改变

,观察其对 Stage 2 指标以及最终 Stage 3 任务性能的影响。

-

网格搜索 (Grid Search) 或随机搜索 (Random Search):在预定义的权重范围内,尝试不同的权重组合。

2.2 阶段性评估

-

在每个阶段结束后收集指标:在 AgeMem 的三阶段训练或评估过程中,在每个阶段结束后(或在每个完整轨迹中),计算并记录上述定义的阶段性指标。

-

轨迹级分析:针对每个完整的轨迹 (T),不仅计算最终的 R(T),还要计算 ,

, TP等指标,并将它们与使用的权重组合关联起来。

2.3 消融实验 (Ablation Studies)

-

“无阶段”基线:除了论文中已有的基线(如 AgeMem-noRL-RAG),还可以设计“无 LTM 训练阶段”、“无 STM 训练阶段”的基线,以更清晰地隔离每个阶段对最终性能的贡献。

-

奖励项消融:评估每个奖励项(

,

,

)单独或组合对整体性能和阶段性指标的影响(论文 Table 4 和 Figure 5 已经做了类似工作)。可以进一步细化到

或

的子项。

3.指导优化方向的分析

收集到阶段性指标后,进行深入的数据分析以指导权重调整。

3.1 相关性分析

-

权重与指标的相关性:分析不同权重 (

,

,

) 与各个阶段性指标 (

,

,TP等) 之间的相关性。例如,如果提高

导致

显著提升,但 TP 下降,这可能意味着记忆质量的提高未能有效转化为任务表现,或者牺牲了其他关键因素(如推理效率)。

-

阶段性指标之间的相关性:分析 Stage 1 的

是否与 Stage 3 的 TP 强相关,Stage 2 的

和

是否对 Stage 3 的 TP 有正向影响。这种跨阶段的因果关系链是理解 AgeMem 工作机制的关键。

3.2 敏感度分析

-

权重敏感度:识别哪些权重对特定阶段的指标或最终任务性能最敏感。如果某个权重的小幅调整导致性能大幅波动,说明该权重是关键的,需要更精细的优化。

-

阶段性瓶颈识别:通过分析,可以发现代理在哪个阶段表现最差,或者哪个阶段的优化对整体性能的提升最大。例如,如果

很高但 TP 仍然不理想,可能问题出在 Stage 3 的 LTM 检索有效性或与 STM 的协同上。

3.3 可视化分析

-

趋势图:绘制不同权重组合下,各个阶段性指标随训练步数的变化曲线。

-

热力图:展示不同权重组合下,各阶段指标的最终表现。

-

案例分析:结合定性分析,深入剖析在特定权重组合下,代理在不同阶段的具体行为(如工具调用序列、上下文内容变化、LTM 存储内容),以理解其成功或失败的原因。

4.动态权重调整的策略(进阶)

在理解了权重影响后,可以考虑更智能的动态调整策略:

-

基于性能反馈的自适应权重: 在训练或部署过程中,持续监控代理在各个阶段的性能。如果某个阶段的指标低于预期阈值,则动态提高对应奖励项的权重,以“引导”代理在该方面进行更多优化。例如,如果发现 LTM 中冗余信息过多(

下降),则可以增加

中非冗余性相关的惩罚项权重。

-

强化学习的元学习方法: 训练一个高层策略(元策略)来学习如何为低层策略(执行具体动作的代理)分配奖励权重。元策略的目标是最大化长期累积奖励,而其动作空间则是不同奖励权重的组合。

-

基于贝叶斯优化或进化算法的在线调整: 在实际部署中,通过小批量实验和 A/B 测试,利用贝叶斯优化或进化算法持续探索和微调最佳权重,以适应不断变化的任务分布和用户需求。

通过以上多维度、系统性的量化和评估,我们可以更清晰地理解不同奖励权重对 AgeMem 代理在 LTM 构建、STM 控制和集成推理这三个阶段的具体影响,从而有针对性地指导优化方向,最终实现代理在复杂长序列任务中的鲁棒和高效性能。

得到优化目标为:

2.三阶段轨迹结构

为了捕捉长程交互并逐步训练记忆能力,每个轨迹被分为三个连续的阶段:,总长度为 T = T1 + T2 + T3。

在第一阶段,智能体进行随意的交互,并可能将有用的信息存储到LTM中。

第二阶段引入分散注意力或不相关的内容,要求智能体通过选择性保留和压缩来管理其STM。

第三阶段提出了一个任务,该任务依赖于对保留的上下文和早期积累的LTM的协调使用。

这种设计的关键方面是长期记忆在所有阶段持续存在,允许早期知识影响后来的决策。相比之下,上下文

在第一阶段和第二阶段之间重置,以防止信息在各阶段之间泄漏。在第二阶段之前的重置确保了智能体无法通过残留上下文来解决最终任务,从而迫使从LTM中正确检索,并实现对记忆操作的有效训练。

在每个步骤中,我们收集一个经验元组,其中

通常对于中间步骤为零,并在轨迹完成后分配,并且

表示旧策略

下的对数概率。这种表示使得能够在GRPO下进行逐步信用分配,并允许智能体将长期奖励归因于跨阶段的特定记忆决策。通过以这种分阶段但连续的方式构建轨迹,智能体学习时间上连贯且任务自适应的记忆策略,这对于稳健的长程推理至关重要。

为什么 通常对于中间步骤为0?

通常对于中间步骤为0?

1.奖励稀疏性 (Sparse Rewards)

在许多长序列或多步骤任务中,智能体(Agent)可能只有在完成整个任务或达到某个关键里程碑时才能获得非零奖励。例如:

-

国际象棋:只有在赢棋、输棋或平局时才能获得奖励,中间的每一步棋本身没有直接奖励。

-

复杂编程任务:只有在代码编译通过并成功执行指定功能时才能获得奖励,中间的每行代码或每个函数调用通常没有直接奖励。

-

AgeMem 中的长序列任务:代理可能需要经过多轮对话、多次记忆操作和推理步骤,最终才能给出正确的答案。只有在提供最终答案后,才能判断任务是否成功。

如果每一步都给予奖励,奖励信号可能会变得过于密集和噪声,甚至可能误导智能体学习次优策略。因此,将奖励集中在最终结果上,可以明确任务的最终目标。

2.长程信用分配 (Long-Range Credit Assignment)

当奖励只在任务结束时给出时,智能体需要学习如何将最终的成功或失败归因于之前的一系列动作。这被称为长程信用分配问题。

-

优势 (Advantage) 函数的作用:论文中提到了使用 Group Relative Policy Optimization (GRPO) 和 步进式 GRPO (step-wise GRPO)。这些方法的核心思想之一就是通过计算优势函数来评估一个动作在当前状态下的相对价值。优势函数能够将未来(可能稀疏的)奖励信号回溯到过去的每一个动作。

-

即使中间步骤

为 0,优势函数仍然可以根据未来获得的非零奖励(在任务完成时)来评估当前动作的好坏。它会考虑“如果我采取这个动作,最终的累积奖励会比不采取这个动作(或采取其他动作)更好吗?”

-

通过这种方式,智能体可以学习到哪些中间动作对于最终的成功是至关重要的,即使这些动作本身没有直接带来奖励。

-

-

AgeMem 中的应用:

-

在 AgeMem 的三阶段训练策略中,LTM 构建和 STM 控制(Stage 1 和 Stage 2)的许多操作(如添加记忆、过滤上下文)本身并没有即时奖励。它们的价值体现在对 Stage 3 最终任务性能的长期影响。

-

将中间步骤

设为 0,并依赖 GRPO 机制,可以使得 Stage 3 的最终任务奖励能够反向传播,影响 Stage 1 和 Stage 2 中记忆操作的决策。这样,代理才能学习到如何进行“ temporally coherent and task-adaptive memory policies”(时间上连贯且任务自适应的记忆策略),即:

-

在 Stage 1 中存储的记忆,其价值体现在 Stage 3 能否被有效检索并帮助完成任务。

-

在 Stage 2 中过滤掉的干扰信息,其价值体现在 Stage 3 能否保持清晰的上下文并避免误导。

-

-

3.简化奖励函数设计与稳定训练

-

简化复杂性:如果每个中间步骤都需要设计一个有意义的奖励,这会大大增加奖励函数设计的复杂性。很多时候,很难为中间步骤定义一个“正确”的即时奖励。将奖励信号限制在任务关键点上,可以使奖励函数更简洁、更聚焦于任务目标。

-

提高训练稳定性:过于频繁或不准确的中间奖励可能会引入噪声,导致策略训练不稳定。稀疏的最终奖励,结合强大的信用分配机制(如 GRPO),可以提供更稳定的学习信号。

总结

因此,论文中将中间步骤 设为 0 是一个深思熟虑的设计选择,它允许 AgeMem:

-

处理长序列任务固有的奖励稀疏性。

-

通过 GRPO 等强化学习算法有效地解决长程信用分配问题,使得早期(Stage 1)和中期(Stage 2)的记忆管理决策能够被最终任务结果(Stage 3)所监督和优化。

-

简化奖励函数设计,并可能提高训练稳定性,促使智能体学习到更具鲁棒性的整体策略。

这种设计强调的是最终目标导向的学习,而非短视的每一步最优。

3.三阶段渐进式强化学习策略

对于每个任务实例 q ∈ T ,智能体生成一个完整的轨迹:

其中 K 表示独立展开的数量,每个子轨迹 对应于一个特定的训练阶段。

阶段 1(LTM 构建)智能体暴露于随意的对话环境中的上下文信息 。目标是识别显著信息并将其存储到 LTM

中。在交互过程中,短期上下文

自然演变,智能体可以在适当的时候调用与 LTM 相关的工具。形式上,此阶段产生一个子轨迹

,其中每个经验元组

遵循第 3.1 节中的定义。

阶段2(干扰物下的STM控制)短期上下文被重置,而构建的LTM 被保留。然后,代理会遇到语义相关但无关或具有误导性的干扰物。目标是通过基于工具的操作(例如过滤或总结上下文)来学习主动的STM控制,以抑制噪声并保留有用的信息。此过程形成子轨迹

,它强调上下文过滤和压缩能力。

阶段 3(综合推理和记忆协调)最后,智能体收到一个正式查询 q,该查询需要准确的推理和有效的记忆检索。智能体必须从 中检索相关知识,适当地管理上下文

,并生成最终答案。此阶段产生

,它评估智能体以端到端方式协调长期记忆、短期上下文管理和任务解决方案的能力。

所有这三个片段构成一个完整的轨迹:

然后将其用于后续逐步 GRPO 过程中的策略优化。对于一批 B 个任务,我们进一步将 K 个独立 rollout 中的所有经验聚合到一个统一的集合中,总大小为

,其中

表示平均轨迹长度。

4.统一管理的逐步GRPO

采用 GRPO 的逐步变体,将长程任务奖励与所有阶段的记忆决策联系起来。对于任务 q,令 表示并行展开的组。每个轨迹产生一个终端奖励

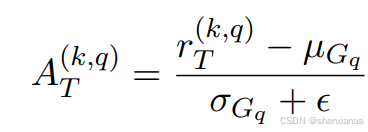

。计算终端步骤的组归一化优势,如下所示:

其中和

是

内奖励的均值和标准差,ϵ防止除以零。然后,此优势被广播到同一轨迹的所有先前步骤

,这为沿轨迹的所有记忆和推理动作分配了一致的学习信号,包括第一阶段和第二阶段中的动作。通过这样做,最终的任务结果监督着每一个中间记忆决策,从而实现了跨异构阶段的远程信用分配。然后,我们用优势来扩充经验集,

。

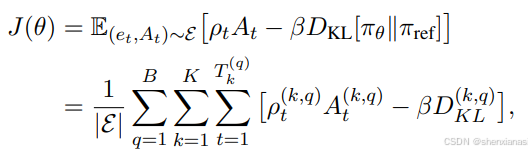

在 GRPO 之后,最大化所有经验的期望目标:

其中,重要性比率控制新策略下的更新幅度,

表示当前策略

与固定参考

之间的KL散度惩罚,而β是平衡探索和训练稳定性的系数。

六、说明

本文仅仅是本人在读这篇Paper时的一点理解以及对我的一些疑惑解答后的整理总结,希望能够帮助大家真正深刻的理解Agentic Memory,帮助大家找到好的idea。如果大家觉得有所帮助的话,欢迎大家一键三连;如果觉得哪里有什么问题,欢迎评论区交流一下!

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)