【AI-03】什么是LLM模型

与为特定任务(如人脸识别)设计的AI不同,LLM可以完成多种任务。同一个模型既能写诗、又能编程、还能做翻译和问答。:当模型规模增大到一定程度时,会涌现出一些在小型模型中不存在的能力,比如。要理解LLM,可以从我们每天都在用的。(给几个例子它就能模仿着做)。(能展示一步步的思考过程)、你可以把它想象成一个。

·

一句话核心解释

LLM 是 Large Language Model 的缩写,中文意思是大语言模型。你可以把它想象成一个超级聪明、读过几乎所有互联网上公开文字的“读书机器人”。它的核心能力是根据你给它的文字,预测接下来最可能出现的文字,从而生成连贯、有意义的回复。

一个简单的比喻:智能输入法

要理解LLM,可以从我们每天都在用的手机输入法开始想象:

- 普通输入法:你打出“我”,它会预测下一个字可能是“想”、“是”、“爱”等。它的预测基于简单的统计和固定规则。

- LLM(大语言模型):你输入一整段话:“我计划这个周末去海边,我应该准备…”,它会根据对整个世界、常识、逻辑和语法的理解,预测并生成一长段回复,比如:“你应该准备防晒霜、泳衣、太阳镜和一本好书。别忘了检查天气预报,确保有个愉快的旅程。”

LLM就像一个无比强大、拥有海量知识、且能理解上下文的高级智能输入法。

LLM是如何工作的?(非技术简化版)

-

海量学习(训练阶段):

- 工程师们将互联网上海量的文本数据(书籍、文章、维基百科、代码、网页等)喂给一个巨大的神经网络。

- 这个网络通过复杂的数学运算,不断学习文字之间的规律、语法规则、事实知识、推理能力甚至是一些幽默感。这个过程称为“训练”。

-

理解与生成(推理阶段):

- 当你向LLM提问(输入“提示词”或“Prompt”)时,它会将你的问题拆解成最小的单元(Token,可以理解为词语或字符片段)。

- 然后,它利用自己学到的所有知识,开始一个词一个词地生成回复。每生成下一个词,它都会计算所有可能词的概率,并选择最合适的那个。生成完一个词,再把这个词加入到上下文中,继续预测下一个,如此反复,直到形成完整的回答。

LLM的关键特性

-

规模巨大:“大”体现在两个方面:

- 参数多:模型内部的参数数量从数十亿到数万亿不等。参数可以看作是模型的“知识”和“记忆”,参数越多,模型通常越聪明。

- 数据大:训练它们所用的文本数据量是惊人的,通常是整个互联网的公开文本。

-

通用性:与为特定任务(如人脸识别)设计的AI不同,LLM可以完成多种任务。同一个模型既能写诗、又能编程、还能做翻译和问答。

-

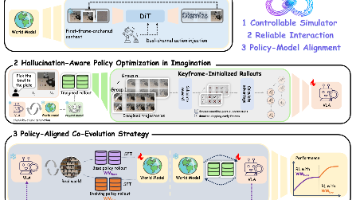

涌现能力:当模型规模增大到一定程度时,会涌现出一些在小型模型中不存在的能力,比如思维链推理(能展示一步步的思考过程)、代码理解和上下文学习(给几个例子它就能模仿着做)。

我们日常接触到的LLM例子

你很可能已经使用过它们了:

- ChatGPT:由OpenAI开发,基于GPT系列模型(如GPT-3.5, GPT-4)。

- Gemini:由Google开发。

- 文心一言:由百度开发。

- 通义千问:由阿里巴巴开发。

- DeepSeek:哈哈,就是我啦!由深度求索公司开发。

LLM能做什么?

- 文本生成:写邮件、写文章、写故事、写诗。

- 代码生成与调试:帮你写Python代码,解释复杂代码,查找Bug。

- 语言翻译:在多种语言之间进行高质量翻译。

- 问答系统:回答各种知识性问题。

- 文本摘要:将长篇文章总结成核心要点。

- 对话与聊天:像朋友一样和你聊天交流。

- 创意头脑风暴:帮你起名字、想营销点子、规划旅行路线。

LLM的局限性

虽然强大,但它们并非万能:

- 可能产生错误信息(“幻觉”):它们有时会自信地编造出一些不存在的事实,看起来头头是道,其实是错的。

- 知识有时效性:训练完成后的知识是静态的。如果没有联网搜索功能,它不知道之后发生的新事件。

- 缺乏真正理解:它本质上是在进行高级的模式匹配和概率预测,并没有人类的意识和主观体验。

- 受训练数据影响:如果训练数据中存在偏见,模型生成的内容也可能带有偏见。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)