【MCP模型上下文协议】AI Agent的通用“USB-C接口”,打通大模型与真实世界的标准化桥梁

MCP(Model Context Protocol,模型上下文协议)是一套开源、中立、标准化的双向通信协议,旨在规范大语言模型(LLM)与外部工具、数据源、服务之间的交互方式。它由Anthropic公司于2024年11月首次提出并开源,2025年12月正式捐赠给Linux基金会旗下的Agentic AI Foundation(AAIF)进行治理,彻底成为了行业中立的开放标准,避免了单一厂商的供应

目录

-

- 引言

- 一、到底什么是MCP?它解决了什么核心痛点?

-

- 1.1 MCP的官方核心定义

- 1.2 MCP要解决的核心痛点:工具调用的碎片化困境

- 二、MCP的核心架构:三大角色+两大分层+三大原语

-

- 2.1 MCP的三大核心角色

- 2.2 MCP的两大分层架构

- 2.3 MCP的三大核心原语

- 三、MCP、Function Calling、AI Agent:三者的区别与联系

- 四、MCP的核心特性:为什么它能成为行业标准?

-

- 4.1 全生态兼容,一次开发处处可用

- 4.2 双向通信,动态能力发现

- 4.3 企业级安全与权限管控

- 4.4 极简轻量,学习成本极低

- 4.5 中立开源,无供应商锁定

- 五、MCP主流生态与开发框架:从入门到企业级落地

-

- 5.1 主流MCP客户端(Host)生态

- 5.2 主流开发框架与SDK

-

- 1. Python生态(入门首选)

- 2. Java生态(企业级首选)

- 3. 其他语言生态

- 六、快速上手实战:10分钟搭建你的第一个MCP服务

-

- 6.1 Python极简示例:用FastMCP搭建一个计算器MCP服务

-

- 步骤1:安装依赖

- 初始化MCP服务,命名为"Math Calculator"

- 用注解定义MCP工具:加法

- 用注解定义MCP工具:乘法

- 启动MCP服务,使用STDIO传输模式

引言

在上一篇关于AI Agent的博客中,我们深入探讨了智能体如何让大模型从“对话工具”进化为“自主执行者”。但在实际开发和落地AI Agent的过程中,几乎所有开发者都会遇到一个无法回避的核心痛点:工具调用的碎片化噩梦。

你是否也有过这样的经历:为了让Agent能查询数据库,你为OpenAI的Function Calling写了一套适配代码;切换到Claude时,又要重写一套符合其工具格式的代码;想要兼容Gemini、文心一言、通义千问等国内模型时,更是陷入了无穷无尽的适配工作中。一个简单的工具调用,却要为不同模型、不同框架重复开发,开发成本指数级上升,生态完全割裂。

而MCP(Model Context Protocol,模型上下文协议) 的出现,正是为了彻底终结这一乱象。它被誉为“AI时代的USB-C接口”,用一套开放、标准化的协议,统一了所有大模型与外部工具、数据源、业务系统的交互规范,实现了“一次开发,全生态可用”。

从2024年底Anthropic首次推出,到2025年捐赠给Linux基金会成为行业中立标准,再到OpenAI、Google、微软、AWS等巨头集体背书,MCP已经从一个技术提案,快速成长为AI Agent领域的核心基础设施,更是大模型从“玩具”走向产业级落地的关键钥匙。

本文将从核心定义、架构拆解、技术边界、生态实战到落地场景,带你全方面吃透MCP,无论是入门理解还是上手开发,都能让你一文掌握这个AI领域最火的标准化协议。

一、到底什么是MCP?它解决了什么核心痛点?

1.1 MCP的官方核心定义

MCP(Model Context Protocol,模型上下文协议)是一套开源、中立、标准化的双向通信协议,旨在规范大语言模型(LLM)与外部工具、数据源、服务之间的交互方式。

它由Anthropic公司于2024年11月首次提出并开源,2025年12月正式捐赠给Linux基金会旗下的Agentic AI Foundation(AAIF)进行治理,彻底成为了行业中立的开放标准,避免了单一厂商的供应商锁定问题。

通俗来讲,你可以把MCP理解为AI世界的USB-C通用接口:

- 过去,不同品牌的电子设备需要不同的充电线、不同的接口,就像不同大模型需要各自定制的工具调用代码;

- 现在,一个USB-C接口可以给手机、电脑、平板、耳机等几乎所有设备充电,就像一套MCP协议,可以让所有大模型、所有AI Agent无缝调用所有外部工具和数据源。

1.2 MCP要解决的核心痛点:工具调用的碎片化困境

在MCP出现之前,大模型与外部世界的交互,始终面临着三大无解的行业痛点:

-

指数级增长的适配成本

传统模式下,工具与模型的适配遵循「m×n」法则:如果有m个大模型、n个工具,就需要开发m×n套定制化的适配代码。每新增一个模型,就要为所有工具重新适配;每新增一个工具,就要为所有模型重新开发,开发成本极高,生态完全割裂。

而MCP将适配逻辑简化为「m+n」:模型只需适配一次MCP客户端,工具只需开发一次MCP服务端,即可实现全生态的互联互通,开发成本降低80%以上。 -

大模型的能力边界被严重限制

传统大模型的能力,完全受限于内置的训练数据和开发者提前定制好的工具。想要新增一个能力,就必须重新开发、部署、上线,无法动态发现和使用新的工具,更无法灵活对接企业内部的业务系统、数据库、私有知识库。

MCP让大模型具备了动态能力拓展的能力,只要是符合MCP规范的服务,模型都可以自主发现、按需调用,能力边界彻底被打开。 -

AI Agent落地的最大拦路虎

AI Agent的核心价值,在于自主完成跨系统、多步骤的复杂任务,而这高度依赖稳定、丰富的工具调用能力。但碎片化的工具生态,让Agent的开发变得极其复杂:不同框架的工具不互通、不同模型的调用格式不统一、权限与安全无法标准化管控,严重制约了Agent的规模化落地。

MCP为AI Agent提供了一套标准化的“工具总线”,让Agent可以无缝接入任何工具和数据源,彻底解决了Agent的“工具困境”,成为了Agent规模化落地的核心基础设施。

二、MCP的核心架构:三大角色+两大分层+三大原语

MCP的设计极简却极具扩展性,采用经典的客户端-服务器架构,核心由三大角色、两大分层、三大核心原语组成,完整支撑起了大模型与外部世界的标准化交互。

2.1 MCP的三大核心角色

MCP的架构中,有三个核心的参与方,各司其职,共同完成协议的闭环运行:

| 核心角色 | 定位与职责 | 典型示例 |

|---|---|---|

| MCP Host(宿主) | 运行大模型的AI应用环境,是协议的发起方,负责管理客户端生命周期、接收用户指令、调度大模型推理、向用户展示任务结果。 | Claude Desktop、ChatGPT、Cursor IDE、Windsurf Editor、Spring AI应用 |

| MCP Client(客户端) | 内置于Host中的通信中间件,是模型与服务端之间的“翻译官”,负责将模型的指令转换为MCP标准的JSON-RPC请求,与服务端建立1:1的专属连接,处理请求的发送与结果的接收。 | LangChain MCP Client、Spring AI McpClient、LangChain4j McpClient |

| MCP Server(服务端) | 外部能力的提供者,是MCP协议的核心灵魂,负责封装并暴露外部工具、数据源、提示模板等能力,接收客户端的标准请求,执行对应的操作并返回标准化结果。 | 文件系统MCP Server、PostgreSQL MCP Server、GitHub MCP Server、企业内部业务系统MCP Server |

2.2 MCP的两大分层架构

MCP在协议设计上,清晰地分为两大层级,实现了通信逻辑与业务逻辑的彻底解耦:

-

数据层(内层)

定义了基于JSON-RPC 2.0的标准化通信协议,是MCP的核心规范。包括客户端与服务端的生命周期管理、心跳检测、错误处理,以及工具、资源、提示词三大核心原语的消息格式,确保所有交互都遵循统一的语义规范。 -

传输层(外层)

定义了客户端与服务端之间的通信通道与传输机制,负责消息的可靠传递。MCP原生支持两种主流的传输模式,适配不同的使用场景:- STDIO传输:基于标准输入输出的本地传输模式,适用于本地运行的MCP服务端,配置简单、安全性高,无需暴露网络端口,是个人使用、本地开发的首选;

- HTTP/SSE传输:基于流式HTTP的远程传输模式,2025年MCP v2版本正式引入,支持云端部署的MCP服务端,可被多个客户端远程访问,同时配套了完整的OAuth 2.1授权框架,适用于企业级、规模化的生产环境。

2.3 MCP的三大核心原语

MCP服务端通过三大核心原语,向客户端暴露所有能力,这也是MCP协议的核心能力载体:

-

Tools(工具)

工具是可执行的函数,是MCP最核心的能力,对应大模型的函数调用(Function Calling)能力。开发者可以将任何可执行的操作封装为MCP工具,比如发送邮件、执行SQL、调用API、运行代码、操作文件、发布消息等。

每个工具都包含标准化的描述信息:名称、功能描述、输入参数的JSON Schema、输出格式,大模型可以自主理解工具的用途,并按需调用。 -

Resources(资源)

资源是可寻址的只读数据源,用于为大模型提供上下文信息,解决大模型内置知识过时、无法访问私有数据的痛点。比如本地文件、数据库查询结果、API返回的实时数据、知识库文档、系统日志等,都可以封装为MCP资源。

每个资源都有唯一的URI标识,大模型可以通过URI按需读取资源内容,将外部数据注入到模型上下文中,实现精准的推理与决策。 -

Prompts(提示模板)

提示模板是预定义的结构化提示词与工作流,用于标准化大模型的行为,降低重复的提示词编写工作。比如竞品分析报告模板、代码评审模板、故障排查SOP模板等,都可以封装为MCP提示模板。

大模型可以直接调用对应的提示模板,结合用户的具体需求,生成标准化的输出,确保任务执行的一致性与规范性。

三、MCP、Function Calling、AI Agent:三者的区别与联系

很多开发者会混淆这三个概念,这里我们用一个清晰的类比,讲清楚三者的层级关系与核心区别,以及它们是如何协同工作的:

| 技术概念 | 核心定位 | 类比角色 | 核心关系 |

|---|---|---|---|

| Function Calling | 大模型调用外部函数的基础底层机制 | 执行操作的「操作手」 | 是MCP的底层执行基础,MCP协议最终会将标准化的工具调用,转换为对应模型的Function Calling格式 |

| MCP | 统一大模型与外部交互的标准化协议 | 规范所有交互的「交通规则/通用接口」 | 为Function Calling提供了统一的标准,解决了碎片化问题,是AI Agent的「通用工具总线」 |

| AI Agent | 具备自主决策、规划、执行能力的智能系统 | 制定目标、调度全局的「驾驶员」 | 借助MCP协议,无缝接入无限的工具与数据能力,彻底突破自身的能力边界,实现复杂任务的端到端执行 |

简单来说:

- 没有Function Calling,大模型就无法调用外部工具,只能停留在文本生成阶段;

- 没有MCP,Function Calling就会陷入碎片化的适配噩梦,无法形成规模化的生态;

- 没有MCP,AI Agent就会被限制在有限的工具能力中,难以实现产业级的规模化落地。

MCP的出现,不是替代Function Calling和AI Agent,而是为它们提供了标准化的基础设施,让Function Calling的生态彻底打通,让AI Agent的能力无限拓展。

四、MCP的核心特性:为什么它能成为行业标准?

MCP能在短短一年多的时间里,获得几乎所有AI巨头的认可,成为行业事实标准,核心在于它具备了以下几个不可替代的核心特性:

4.1 全生态兼容,一次开发处处可用

MCP不绑定任何特定的大模型、开发框架或运行环境,无论是OpenAI、Anthropic、Google的闭源模型,还是Llama、Qwen、ChatGLM等开源模型,无论是Python、Java、Go等开发语言,还是Windows、Linux、MacOS等操作系统,都可以完美兼容。

一个符合MCP规范的服务端,开发完成后,所有支持MCP的大模型、AI Agent、IDE都可以直接调用,真正实现了「build once, connect everywhere」。

4.2 双向通信,动态能力发现

MCP支持客户端与服务端的双向通信,不同于传统静态的工具定义,MCP客户端可以在运行时,动态发现服务端暴露的所有工具、资源和提示模板,无需重新部署应用。

这意味着,你可以随时为你的AI Agent新增一个MCP服务端,Agent可以立即感知并使用新的能力,无需修改任何代码,真正实现了能力的动态拓展。

4.3 企业级安全与权限管控

MCP从设计之初就考虑了企业级的安全需求,v2版本引入了完整的OAuth 2.1授权框架,支持令牌认证、细粒度的权限控制、全链路的审计日志。

同时,MCP采用了「数据与模型分离」的设计:模型本身不直接接触原始数据和业务系统,所有的操作都通过MCP服务端执行,权限控制在服务端层面,所有调用都有完整的审计追踪,完美符合金融、政务等强监管行业的合规要求。

4.4 极简轻量,学习成本极低

MCP的核心规范非常简洁,基于成熟的JSON-RPC 2.0协议,开发者无需学习复杂的新规范,只需要几行代码,就能将一个现有的接口、函数、数据源封装为MCP服务端。

同时,社区提供了丰富的SDK和脚手架,比如Python的FastMCP、Java的Spring AI MCP注解,几乎零学习成本就能快速上手开发。

4.5 中立开源,无供应商锁定

MCP已经捐赠给Linux基金会,由中立的Agentic AI Foundation进行治理,不属于任何单一厂商,彻底避免了供应商锁定的问题。

这也是为什么连Anthropic的直接竞争对手OpenAI、Google DeepMind,都纷纷宣布官方支持MCP协议——因为它是一个真正开放、中立的行业标准,而不是某家公司的私有产品。

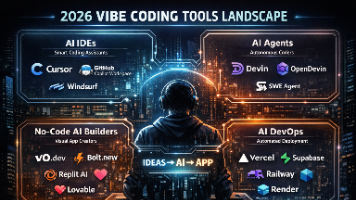

五、MCP主流生态与开发框架:从入门到企业级落地

经过一年多的发展,MCP已经形成了非常完善的生态,从客户端支持到开发框架,从开箱即用的服务端到企业级解决方案,覆盖了从个人开发者到大型企业的所有需求。

5.1 主流MCP客户端(Host)生态

目前,几乎所有主流的AI应用和大模型平台,都已经官方支持MCP协议,包括:

- AI对话客户端:Claude Desktop、ChatGPT、Google Gemini、字节跳动豆包、百度文心一言、阿里通义千问;

- AI代码编辑器:Cursor IDE、Windsurf Editor、VS Code(通过插件)、JetBrains系列IDE(通过插件)、Cherry Studio;

- AI开发框架:LangChain、CrewAI、AutoGen、Spring AI、LangChain4j、Dify、FastGPT。

5.2 主流开发框架与SDK

针对不同的开发语言和场景,社区提供了成熟的开发框架,帮助开发者快速搭建MCP客户端与服务端:

1. Python生态(入门首选)

- FastMCP:Python生态最流行的MCP开发框架,极简的API设计,类似FastAPI的开发体验,通过注解就能快速将Python函数封装为MCP工具,几行代码就能搭建一个完整的MCP服务端,是个人开发者入门的首选;

- LangChain MCP Adapter:LangChain官方推出的MCP适配组件,完美兼容LangChain生态,可以快速将MCP服务端的工具加载为LangChain的Tool,无缝集成到LangChain Agent中。

2. Java生态(企业级首选)

这也是Java后端开发者最关注的部分,目前MCP已经有了非常完善的Java生态支持:

- Spring AI:Spring官方推出的AI开发框架,原生支持MCP协议,提供了完整的客户端与服务端开发能力,完美兼容Spring Boot生态,通过简单的注解就能将Spring Bean中的方法封装为MCP工具,对于Java后端开发者来说,几乎零学习成本就能上手,是企业级Java应用的首选;

- LangChain4j:Java生态的LangChain,官方提供了完整的MCP适配模块,支持客户端与服务端的全流程开发,完美兼容LangChain4j的Agent生态,适合基于Java开发复杂AI Agent的场景。

3. 其他语言生态

- TypeScript/JavaScript:官方提供了TypeScript SDK,支持Node.js、浏览器环境,适合前端开发者和全栈应用;

- Go:社区提供了成熟的Go SDK,性能优异,适合开发高并发、云端部署的MCP服务端;

- Rust:社区提供了Rust SDK,内存安全、性能极高,适合开发对安全性和性能要求极高的底层MCP服务。

六、快速上手实战:10分钟搭建你的第一个MCP服务

这里我们提供两个极简的实战示例,分别对应Python入门场景和Java企业级场景,带你10分钟上手MCP开发。

6.1 Python极简示例:用FastMCP搭建一个计算器MCP服务

步骤1:安装依赖

pip install fastmcp

步骤2:编写MCP服务端代码(math_server.py)

from fastmcp import FastMCP

初始化MCP服务,命名为"Math Calculator"

mcp = FastMCP(“Math Calculator”)

用注解定义MCP工具:加法

@mcp.tool()

def add(a: int, b: int) -> int:

"""

计算两个整数的和

:param a: 第一个整数

:param b: 第二个整数

:return: 两个数的和

"""

return a + b

用注解定义MCP工具:乘法

@mcp.tool()

def multiply(a: int, b: int) -> int:

"""

计算两个整数的积

:param a: 第一个整数

:param b: 第二个整数

:return: 两个数的积

"""

return a * b

启动MCP服务,使用STDIO传输模式

if __name__ == "__main__":

mcp.run(transport="stdio")

步骤3:在Claude Desktop中配置使用

- 打开Claude Desktop,进入设置 -> 开发者 -> 编辑配置文件;

- 在配置文件中添加以下内容,注意替换为你的实际文件路径:

{

"mcpServers": {

"math-calculator": {

"command": "python",

"args": ["/你的文件绝对路径/math_server.py"]

}

}

}

- 保存配置文件,重启Claude Desktop,即可在对话中直接调用这个计算器MCP服务的工具。

6.2 Java Spring AI示例:快速搭建MCP服务

对于Java后端开发者,Spring AI提供了极简的MCP开发方式,通过注解就能快速将Spring Bean的方法封装为MCP工具。

步骤1:引入Maven依赖

<dependency>

<groupId>org.springframework.ai</groupId>

<artifactId>spring-ai-mcp-server-spring-boot-starter</artifactId>

<version>1.0.0-M5.1</version>

</dependency>

<dependency>

<groupId>org.springframework.ai</groupId>

<artifactId>spring-ai-mcp-client-spring-boot-starter</artifactId>

<version>1.0.0-M5.1</version>

</dependency>

步骤2:编写MCP工具类

import org.springframework.ai.mcp.server.annotation.MCPTool;

import org.springframework.ai.mcp.server.annotation.MCPToolParam;

import org.springframework.stereotype.Service;

/**

* 时间工具MCP服务

*/

@Service

public class TimeTool {

/**

* 获取指定时区的当前时间

* @param timeZone 时区,例如Asia/Shanghai、America/New_York

* @return 格式化后的当前时间

*/

@MCPTool(name = "get_current_time", description = "获取指定时区的当前格式化时间")

public String getCurrentTime(

@MCPToolParam(name = "timeZone", description = "时区,例如Asia/Shanghai", required = true) String timeZone

) {

return java.time.ZonedDateTime.now(java.time.ZoneId.of(timeZone))

.format(java.time.format.DateTimeFormatter.ofPattern("yyyy-MM-dd HH:mm:ss"));

}

}

步骤3:配置MCP客户端,集成到Spring AI ChatClient

import org.springframework.ai.mcp.client.McpSyncClient;

import org.springframework.ai.mcp.client.function.McpFunctionCallback;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

import java.util.List;

@Configuration

public class McpConfig {

/**

* 将MCP服务端的工具,转换为Spring AI的Function Callback

*/

@Bean

public List<McpFunctionCallback> mcpFunctionCallbacks(McpSyncClient mcpClient) {

return mcpClient.listTools(null)

.tools()

.stream()

.map(tool -> new McpFunctionCallback(mcpClient, tool))

.toList();

}

}

完成以上步骤后,你的Spring Boot应用就已经具备了MCP服务端和客户端的能力,既可以被Claude、ChatGPT等客户端调用,也可以在Spring AI的Agent中直接使用MCP工具。

七、MCP的核心落地场景:从个人效率到产业升级

MCP的落地场景几乎覆盖了所有AI应用领域,从个人日常的效率提升,到企业级的产业数字化升级,都有非常成熟的落地实践。

7.1 个人场景:7×24小时全能私人助理

MCP让个人AI助理的能力彻底突破了聊天框的限制,通过MCP服务,你的私人助理可以:

- 对接本地文件系统、邮件、日历,帮你管理日程、处理邮件、整理文档;

- 对接外卖、天气、导航、订票系统,帮你规划旅行、预订酒店、点外卖、抢车票;

- 对接代码仓库、开发工具,帮你编写代码、排查BUG、评审代码、生成文档;

- 对接智能家居、穿戴设备,帮你控制家居设备、监控健康数据、提醒作息。

所有的操作都通过自然语言指令完成,真正实现了端到端的全流程自动化。

7.2 企业研发效能:全流程自动化研发助手

MCP已经成为研发效能提升的核心抓手,国内外很多科技企业都通过MCP搭建了内部的研发智能体:

- 对接Git、Jira、Jenkins、代码仓库,实现需求拆解、代码编写、单元测试、CI/CD部署的全流程自动化;

- 对接数据库、中间件、监控系统,实现故障自动排查、日志分析、问题定位、修复执行,大幅降低运维成本;

- 对接API文档、Swagger、内部接口,自动生成接口调用代码、测试用例、接口文档,大幅提升开发效率。

Block(Square母公司)内部已经部署了60+个MCP服务器,覆盖了研发、运维、财务等多个场景,实现了研发效能的大幅提升。

7.3 金融行业:合规可控的智能数据服务

金融行业对数据安全、合规性有极高的要求,MCP的安全设计完美适配了金融场景的需求:

- 对接征信系统、交易系统、合规数据库、财经数据平台,实现信贷审批、风控审核、财报分析的自动化,某股份制银行通过MCP将信贷审批时间从3天缩短至30分钟,欺诈交易识别率提升至99.97%;

- 对接FactSet、标普全球、Wind等财经数据平台,实现研报自动生成、市场行情分析、投资组合优化,全程数据不落地,所有操作可审计,符合监管要求。

7.4 企业服务:降本增效的核心抓手

MCP为企业服务的数字化升级提供了标准化的解决方案:

- 智能客服:通过MCP对接订单系统、物流系统、售后系统,实现订单查询、退款处理、售后问题解决的端到端自动化,无需人工介入,大幅降低客服成本;

- 智能销售:通过MCP对接CRM系统、线索平台、邮件系统,实现线索筛选、意向沟通、需求挖掘、客户跟进的全流程自动化,赋能销售团队;

- 财务/人力:通过MCP对接财务系统、OA系统、招聘系统,实现发票审核、报销处理、工资核算、简历筛选、面试邀约的标准化自动化处理。

八、MCP的当前挑战与未来展望

8.1 当下落地的核心挑战

尽管MCP已经成为行业标准,但在规模化落地的过程中,仍然面临着一些核心挑战:

- 安全与合规风险

安全是MCP落地的最大软肋,由于MCP服务端具备执行操作的能力,一旦出现安全漏洞,可能会造成严重的后果。目前社区中已经发现了多起MCP服务端的提示注入攻击、工具投毒、未授权访问等安全问题,如何构建安全可靠的MCP服务,是企业落地的首要考量。 - 上下文膨胀问题

单个MCP服务端可能会暴露数十个工具,每个工具的JSON Schema描述都会消耗大量的Token,当Agent同时连接多个MCP服务端时,工具描述很容易撑满大模型的上下文窗口,导致模型推理精度下降、成本上升。如何优化工具的按需加载、精简描述,是MCP大规模应用需要解决的问题。 - 运维与治理复杂度

企业内部大规模部署MCP服务端后,会面临服务管理、版本控制、权限治理、监控告警等一系列运维问题,目前社区还缺乏成熟的MCP服务治理平台,对于大型企业来说,运维复杂度是制约规模化落地的重要因素。

8.2 未来发展趋势

尽管存在挑战,但MCP的发展趋势已经非常明确,未来几年将迎来爆发式的进化:

- 成为AI时代的TCP/IP协议

MCP将彻底成为大模型与外部世界交互的事实标准,就像TCP/IP协议是互联网的基础一样,MCP将成为AI互联网的核心基础设施。未来所有的软件、系统、硬件设备,都会提供标准化的MCP接口,供大模型和AI Agent调用,真正实现“AI与万物互联”。 - 多智能体协同的通信标准

单个Agent的能力是有限的,而多智能体协同是未来的核心发展方向。MCP将不仅是Agent与工具之间的通信协议,还将成为Agent与Agent之间的标准化通信协议,实现不同厂商、不同框架的Agent之间的互联互通、协同工作,构建起完整的多智能体社会。 - 端云协同的轻量化MCP生态

随着端侧大模型的成熟,MCP将实现端云协同:简单的工具和数据操作在端侧的MCP服务端执行,保护用户隐私的同时提升响应速度;复杂的、需要云端资源的操作,在云端的MCP服务端执行,完美适配手机、汽车、智能家居等所有终端设备。 - 行业垂直化的MCP标准体系

未来,金融、医疗、制造、政务等不同行业,将基于MCP基础协议,制定符合行业特性的垂直化标准,规范行业内的工具、数据、接口定义,实现行业内的全生态互联互通,加速AI在各个行业的规模化落地。

结语

MCP的出现,不是一个简单的技术创新,而是AI从“对话交互时代”走向“智能执行时代”的标志性转折点。

它彻底终结了大模型工具调用的碎片化乱象,为AI Agent提供了一套标准化、可扩展、安全可控的“通用工具总线”,让大模型真正走出了聊天框,能够安全、高效地对接真实世界的所有系统和数据。

对于开发者而言,现在正是入局MCP的最好时机。无论是为自己的个人助理开发一个简单的工具MCP服务,还是为企业内部的业务系统搭建标准化的MCP接口,都能享受到MCP带来的巨大效率提升,也能抓住AI Agent规模化落地的时代红利。

未来,MCP会像今天的USB-C接口一样无处不在,成为每一个软件、每一个系统的标配。而我们每一个开发者,都是这个AI新时代的建设者。

如果你有关于MCP的开发经验、落地想法或者技术问题,欢迎在评论区留言交流,我们一起探讨MCP的更多可能性。

更多推荐

已为社区贡献26条内容

已为社区贡献26条内容

所有评论(0)