千问 3.5 重磅发布 更小尺寸 更强能力

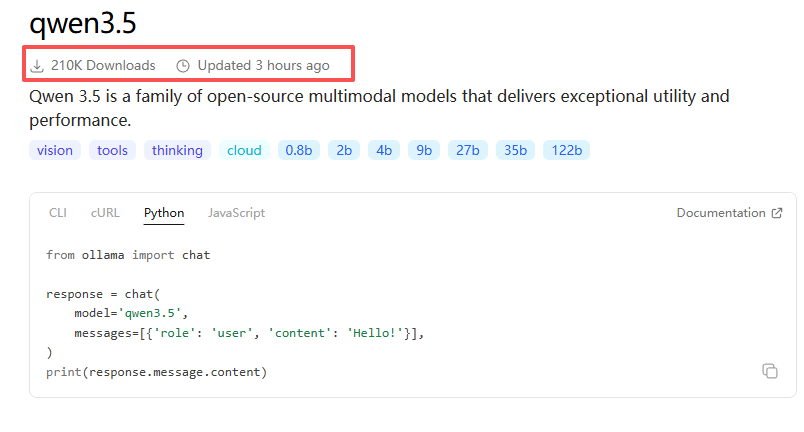

阿里千问正式发布了 Qwen 3.5 系列模型!Qwen 3.5 不仅仅是一个普通的模型升级,更是一个全规格、多模态、本地部署的 AI 解决方案。就在 3 小时前,Qwen 3.5 已经上线 Ollama,意味着我们可以在自己的电脑上运行强大的千问模型了!Qwen 3.5 的发布,是千问家族的重要里程碑,更是本地 AI 发展的重要节点。从 0.8 B 到 122 B 的全规格覆盖,让不同需求的用户

前言

阿里千问正式发布了 Qwen 3.5 系列模型!Qwen 3.5 不仅仅是一个普通的模型升级,更是一个全规格、多模态、本地部署的 AI 解决方案。

就在 3 小时前,Qwen 3.5 已经上线 Ollama,意味着我们可以在自己的电脑上运行强大的千问模型了!

Qwen 3.5 核心亮点

1. 全规格覆盖

Qwen 3.5 提供了从轻量到超大的 8 个规格:

| 模型规格 | 大小 | 上下文 | 特点 |

|---|---|---|---|

| qwen 3.5:0.8 b | 1.0 GB | 256 K | 极致轻量,笔记本也能跑 |

| qwen 3.5:2b | 2.7 GB | 256 K | 轻量级,性能不错 |

| qwen 3.5:4b | 3.4 GB | 256 K | 平衡之选 |

| qwen 3.5:9b | 6.6 GB | 256 K | 主流选择 |

| qwen 3.5:27b | 17 GB | 256 K | 性能强劲 |

| qwen 3.5:35b | 24 GB | 256 K | 高性能 |

| qwen 3.5:122 b | 81 GB | 256 K | 旗舰级 |

| qwen 3.5: latest | 6.6 GB | 256 K | 默认最新版本 |

2. 原生多模态

Qwen 3.5 是原生支持多模态的模型家族,这意味着:

- 视觉理解:可以理解图片内容

- 图像问答:可以回答关于图片的问题

- 文档理解:可以分析截图和图表

- 视频理解:支持视频内容分析

而且是 Early Fusion(早期融合)技术,在多模态 token 上实现了与 Qwen 3 相当的性能,在推理、编码、代理和视觉理解基准测试中甚至超越了 Qwen 3-VL 模型。

3. 超长上下文

所有规格都支持 256 K 上下文窗口,这是目前开源模型中最长的上下文之一。意味着可以:

- 处理超长文档

- 进行深度代码分析

- 支持复杂的多轮对话

- 实现 RAG(检索增强生成)

4. 高效架构

Qwen 3.5 采用了创新的混合架构:

- Gated Delta Networks:门控_delta 网络

- 稀疏 MoE:稀疏专家混合模型

- 实现高吞吐量推理,最小化延迟和成本

5. 全球语言支持

支持 201 种语言和方言,真正实现了全球化的部署能力。

性能表现

根据官方基准测试,Qwen 3.5 在多个领域都展现了强劲的实力:

语言理解

- MMLU-Pro:87.8%(接近 GPT-4.5 的 89.5%)

- MMLU-Redux:94.9%

- C-Eval:93.0%

编程能力

- SWE-bench Verified:76.2%

- Terminal Bench 2:52.5%

视觉理解

- MMMU:85.0%

- MathVision:88.6%

- Mathvista:90.3%

如何在本地运行

安装 Ollama

首先需要安装 Ollama:

# macOS

curl -fsSL https://ollama.com/install.sh | sh

# Windows

# 直接从官网下载安装包

# https://ollama.com/download/windows

运行 Qwen 3.5

# 运行默认版本(9B)

ollama run qwen3.5

# 运行特定规格

ollama run qwen3.5:0.8b # 最轻量

ollama run qwen3.5:4b # 平衡之选

ollama run qwen3.5:9b

API 调用

# 使用 curl

curl http://localhost:11434/api/chat \

-d '{

"model": "qwen3.5",

"messages": [{"role": "user", "content": "Hello!"}]

}'

# Python

from ollama import chat

response = chat(

model='qwen3.5',

messages=[{'role': 'user', 'content': 'Hello!'}]

)

print(response.message.content)

与 AI 工具集成

Qwen 3.5 已经支持多种 AI 工具的本地运行:

OpenCode

ollama launch opencode --model qwen3.5

Claude Code

ollama launch claude --model qwen3.5

OpenClaw

ollama launch openclaw --model qwen3.5

这意味着我们可以:

- 用本地千问模型作为 OpenCode 、openclaw 的后端

- 实现完全私密的 AI 编码体验

- 原生支持多模态,性能比上一代更强,可以实现更多功能

总结

Qwen 3.5 的发布,是千问家族的重要里程碑,更是本地 AI 发展的重要节点。从 0.8 B 到 122 B 的全规格覆盖,让不同需求的用户都能找到适合自己的方案。

原生多模态支持、256 K 超长上下文、高效的推理架构,再加上 Ollama 的便捷部署,Qwen 3.5 正在让本地 AI 变得更加普及和实用。

最后,开源还得是千问~

本文主要参考了 Ollama Qwen3.5 模型页面

如果这篇分享对你有所启发,欢迎关注!期待你的点赞、收藏、转发、推荐或留言~ 你的支持,是我持续创作的最大动力!感谢!🙏

微信公众号:环境猫 er

CSDN : 细节处有神明

个人博客:https://maoyu92.github.io/

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)