【Azure 架构师学习笔记 】- Azure AI(10)-Azure OpenAI(1)-模型部署及初阶demo

接上文,下面我们开始实操过程,首先会创建一个azure openai服务,然后部署一个模型,并创建一个demo。

本文属于【Azure 架构师学习笔记】系列。

本文属于【Azure AI】系列。

接上文 【Azure 架构师学习笔记 】- Azure AI(9)-阶段性小结

前言

接上文,下面我们开始实操过程,首先会创建一个azure openai服务,然后部署一个模型,并创建一个demo。

环境准备

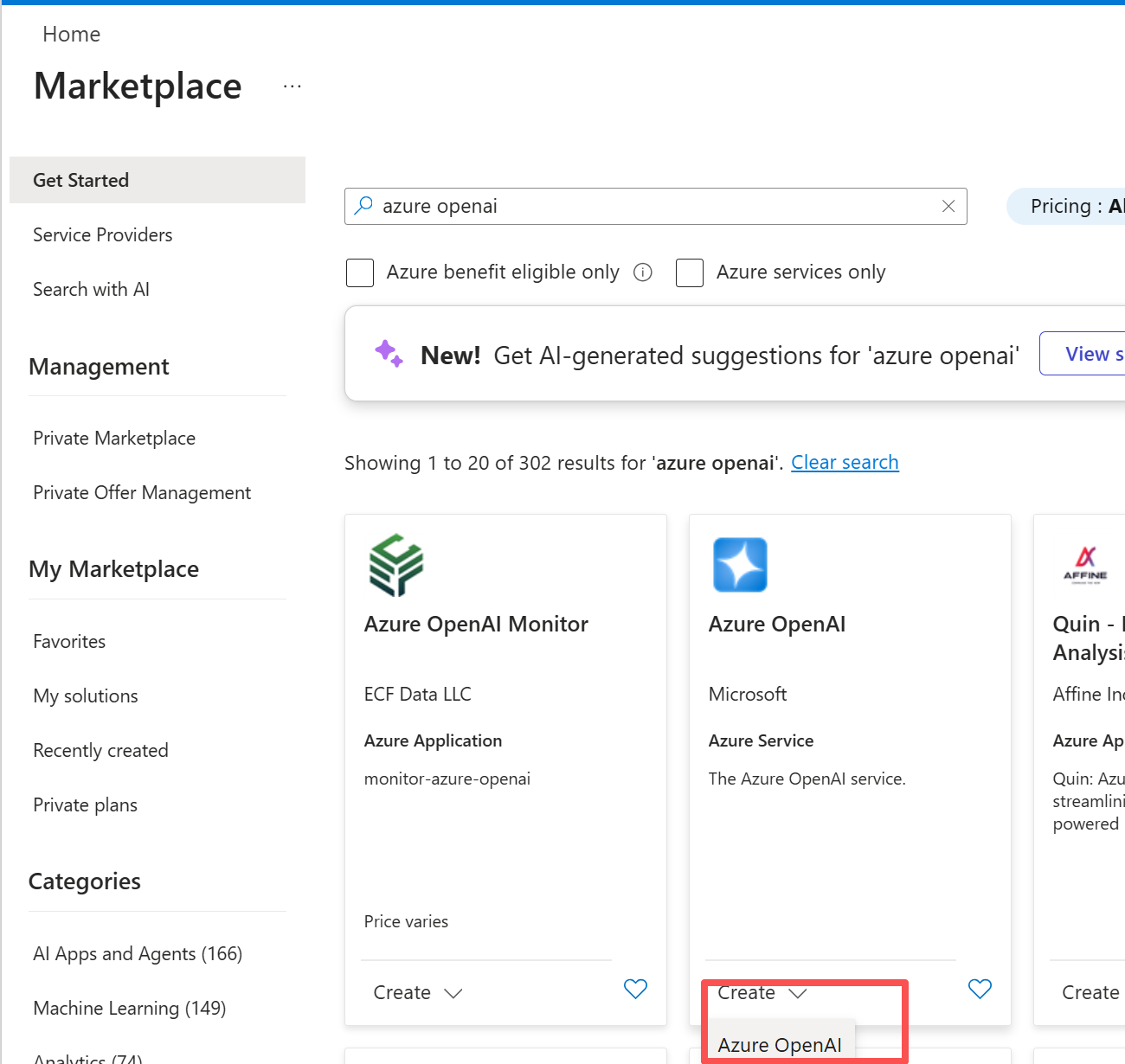

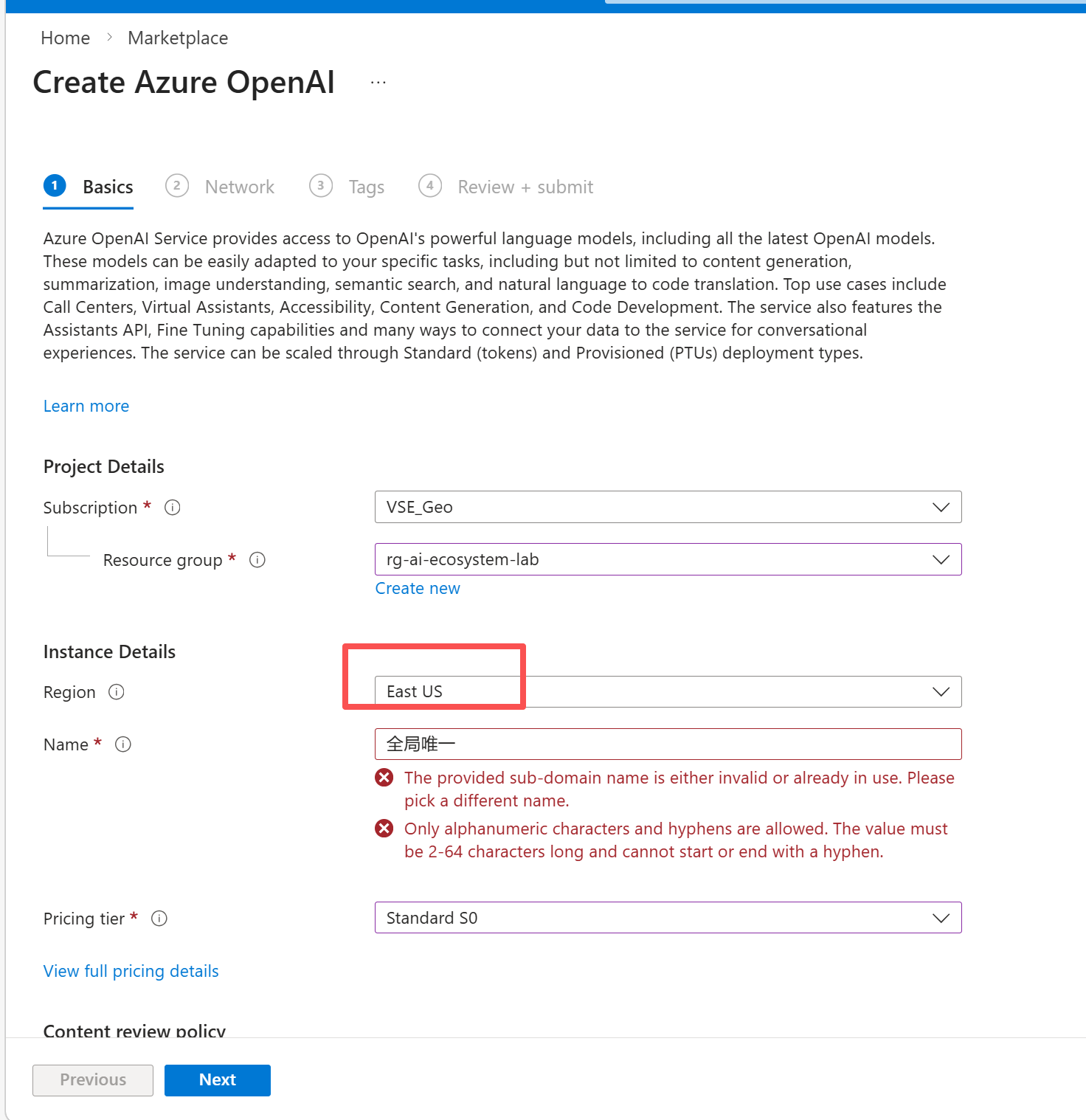

创建Azure OpenAI资源

这一步跟其他资源创建基本上大同小异。

作为测试,到此为止即可直接创建,但是企业环境下tag, 网络这些要配好。

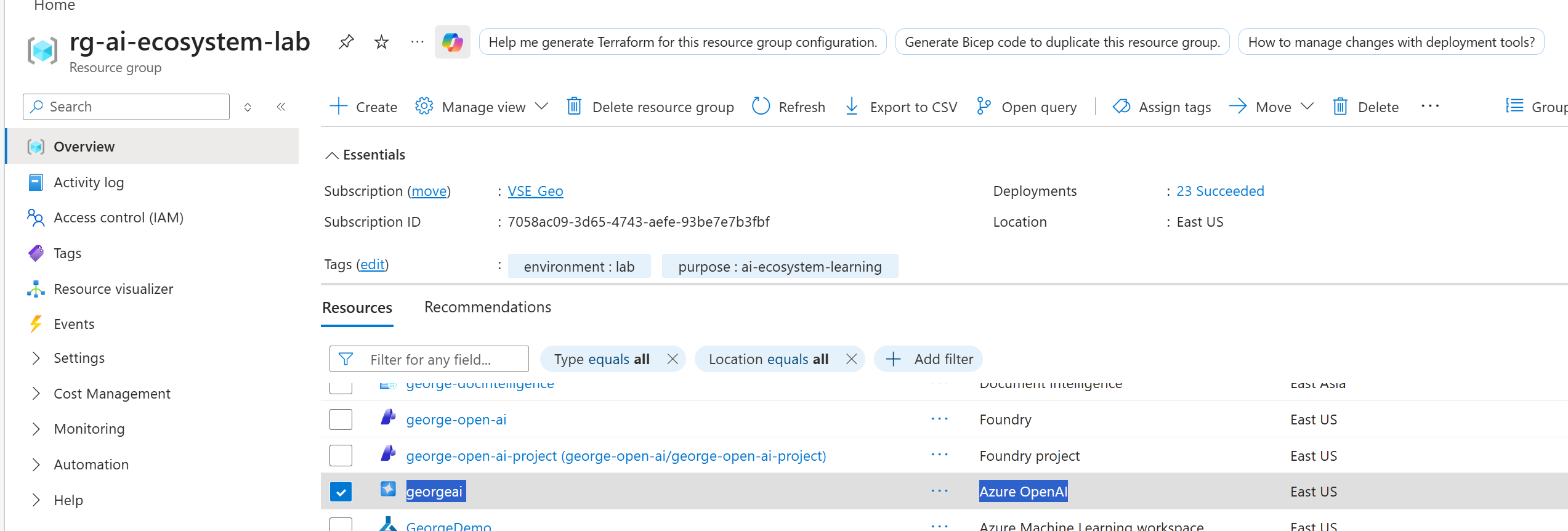

创建完毕:

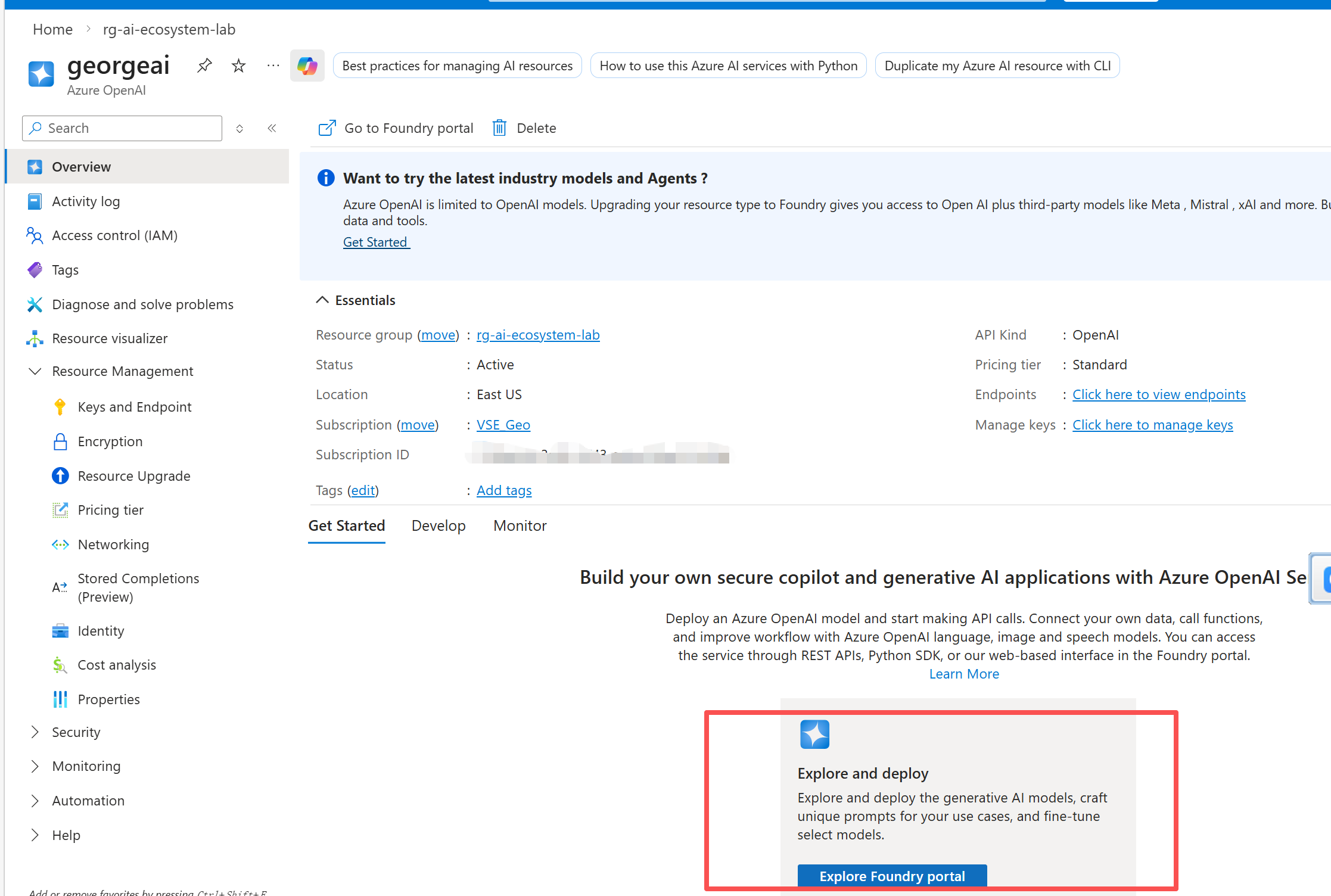

进去portal进行操作:

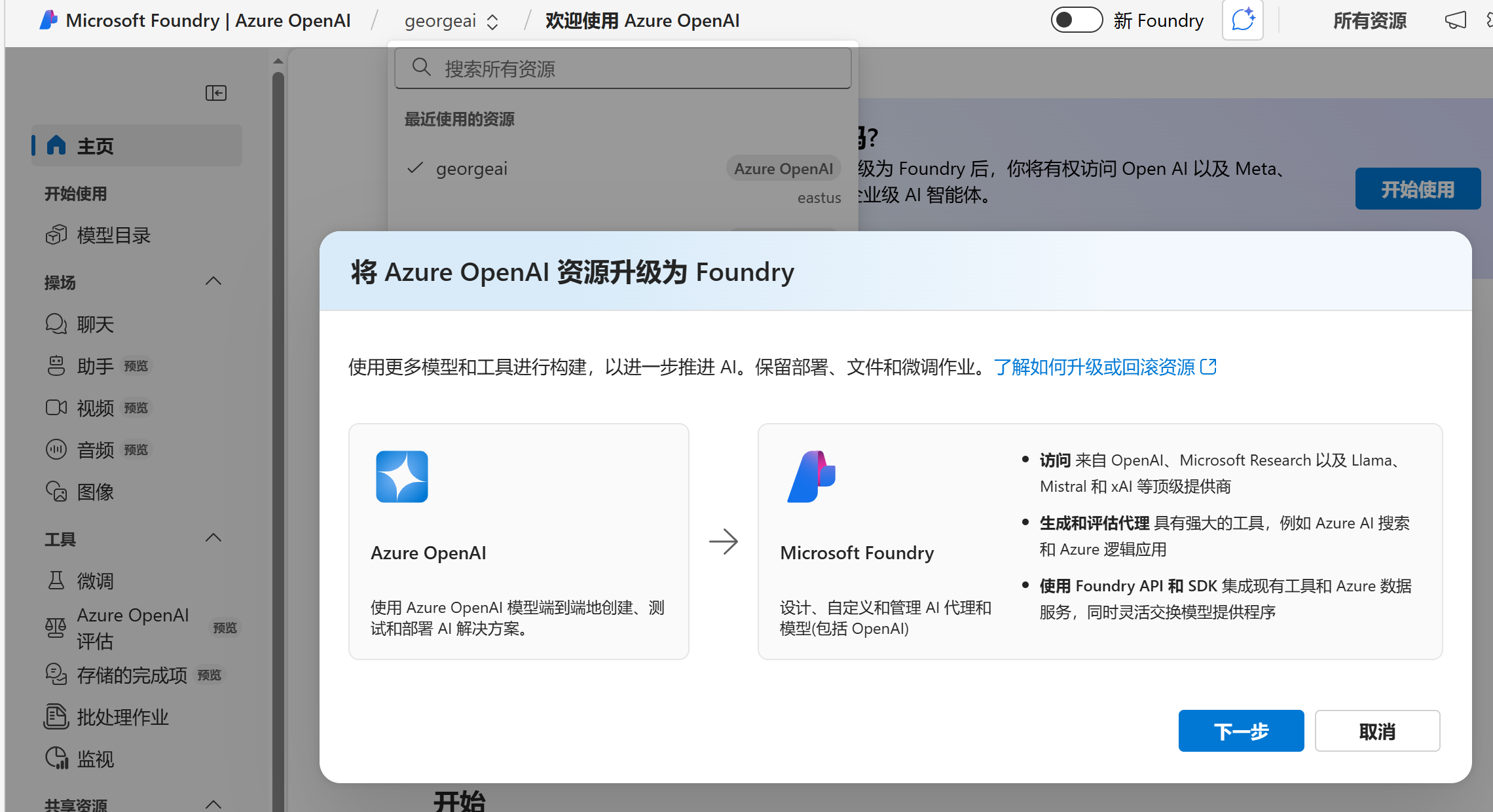

如果是首次进入,可能会出现下面提醒, 我们顺应时代发展,选择升级:

创建项目:

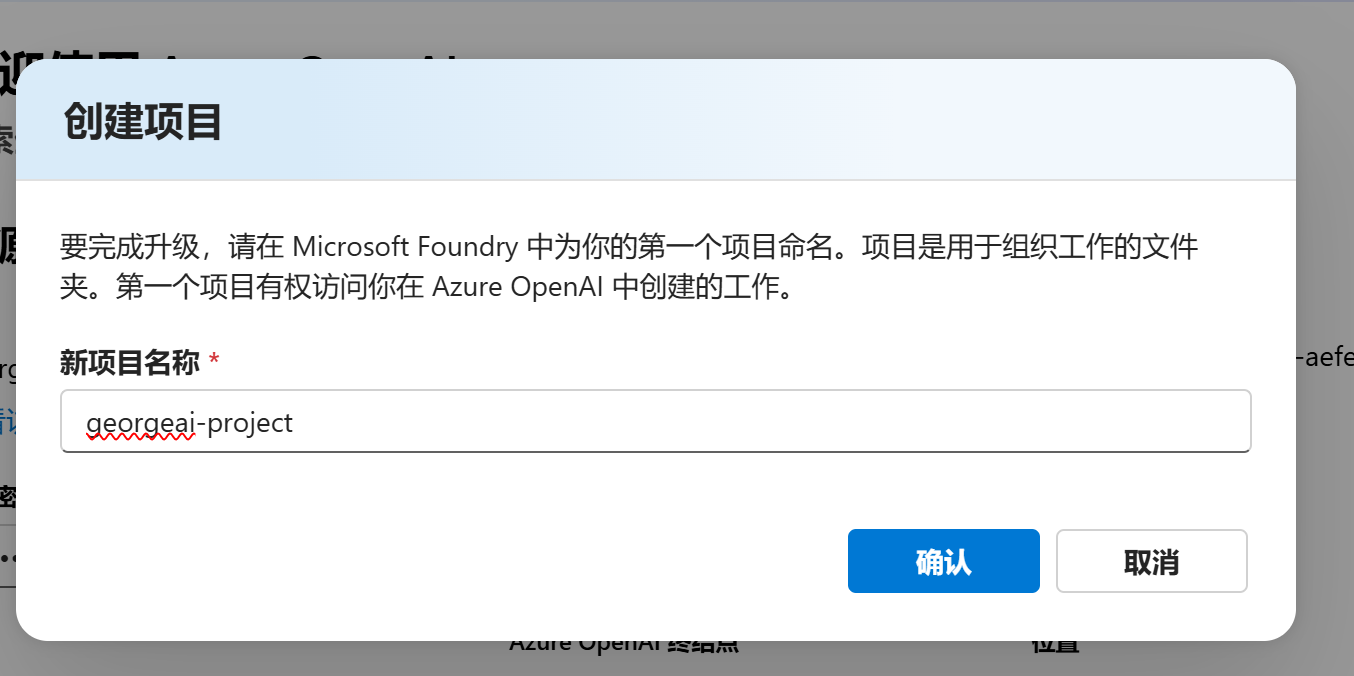

升级完成,会出现一些基本信息。

部署模型

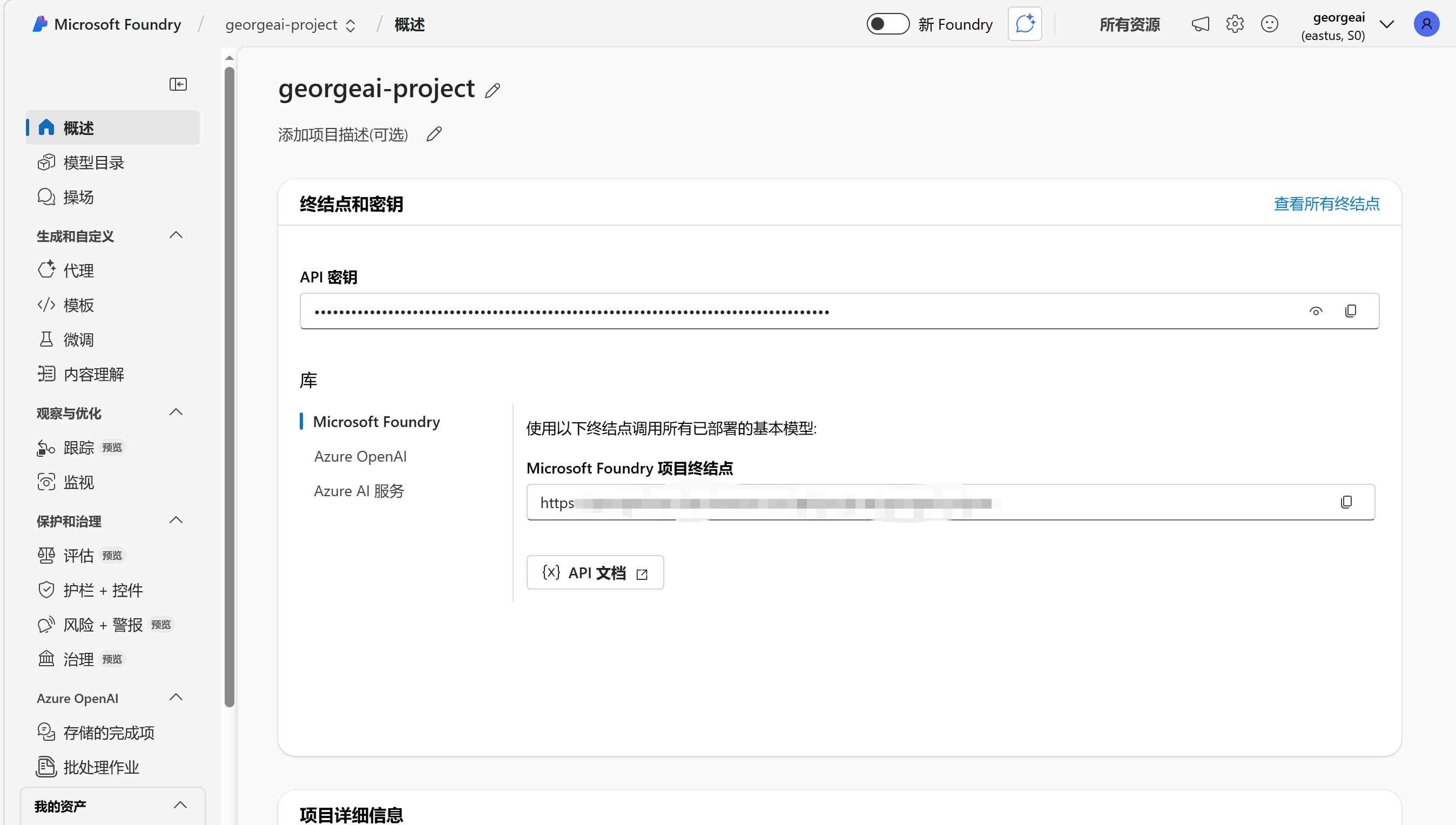

从上一章提到, 个人用户很多模型并不支持直接使用,截至发稿位置,gpt-4o-mini是可用的,所以选择它作为演示。

在部署模型过程中可以看到下面的一些信息,特别注意【停用日期】

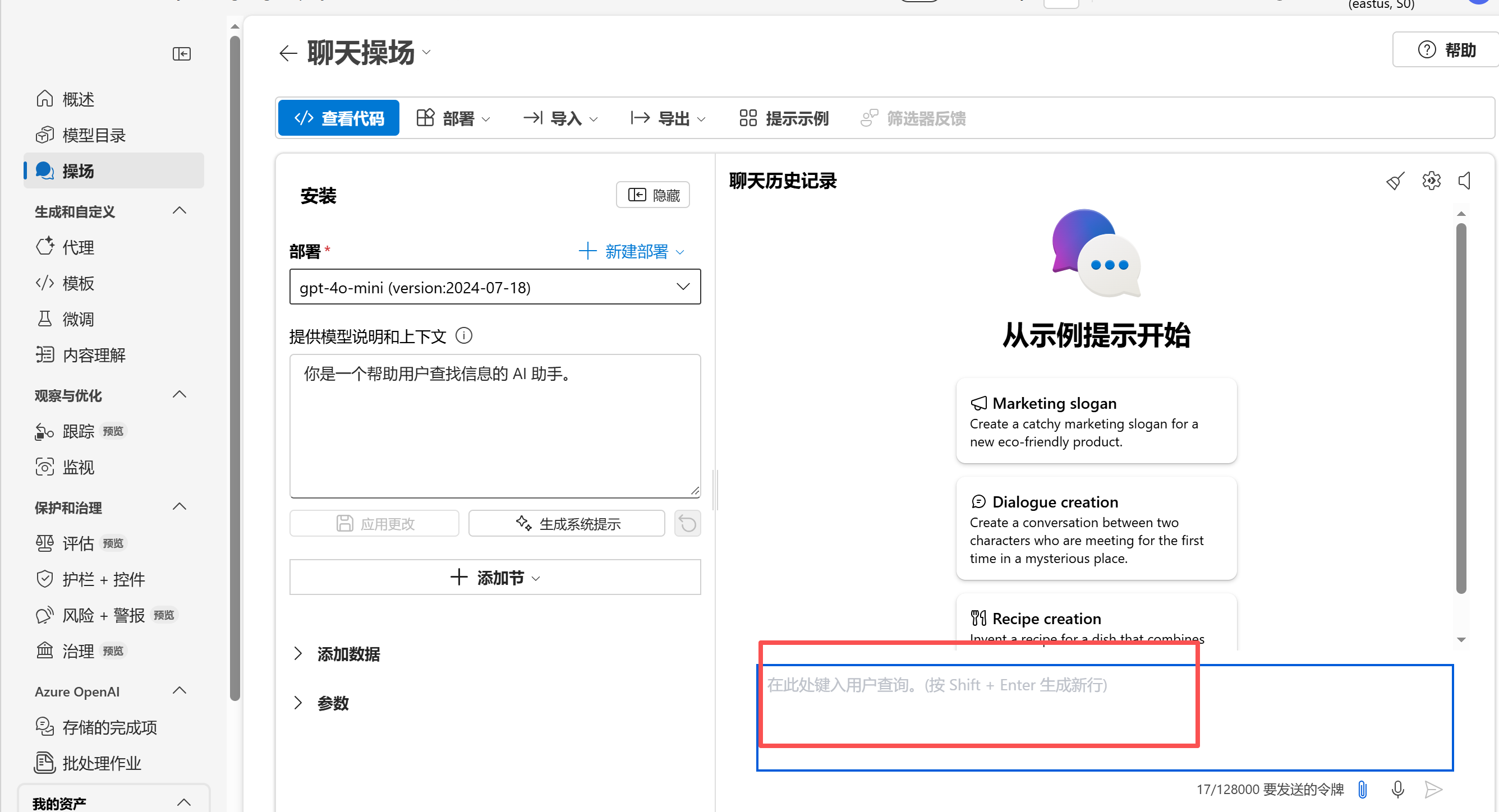

模型部署成功后会显示必要信息,一般可以在【在操场中打开】或者直接进行编程:

在操场中进行测试,这个在前面的一些文章中已经做过演示,在本文暂不展开:

本地调用API

如果在本地测试,建议先运行下面命令(windows在cmd中运行)以确保有依赖环境,否则可能出现诸如这样的报错:ModuleNotFoundError: No module named ‘openai’

pip install openai --upgrade

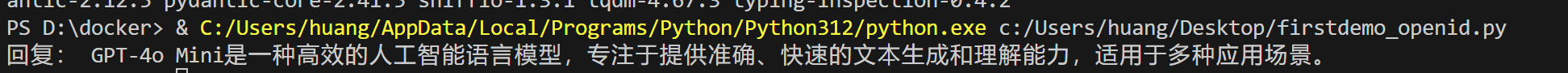

然后运行下面python demo:

from openai import AzureOpenAI

# 初始化客户端

client = AzureOpenAI(

azure_endpoint="https://xxxx.openai.azure.com/", # 你的 Endpoint

api_key="xxxxxx", # 你的 Key

api_version="2024-08-01-preview" # 这里的API version需要从上面Endpoint的接触部分一致

)

# 发起对话请求

response = client.chat.completions.create(

model="gpt-4o-mini-deploy", # 你的部署名称

messages=[

{"role": "system", "content": "你是一个简洁、专业的AI助手。"},

{"role": "user", "content": "请用一句话介绍GPT-4o Mini。"}

]

)

# 输出结果

print("回复:", response.choices[0].message.content)

这个 Demo 验证了什么?

- 本地 Python 环境 + 依赖正常

验证openai库安装成功,验证你的 Python 环境(路径、权限)能正常执行 AI 接口调用代码,没有基础环境问题。 - 云端服务鉴权 + 连通性正常

Endpoint + API Key 有效:你的本地代码能通过这两个凭证,成功访问 Azure 云端的 OpenAI 服务,鉴权通过:Azure 验证了你的 Key 是合法的,没有权限过期、区域不匹配、额度耗尽等问题。 - 模型部署 + 调用链路正常

Deployment name 正确:你填写的部署名,能精准定位到 Azure 上你部署的 GPT-4o Mini 模型实例。

模型可调用:GPT-4o Mini 模型本身能正常响应请求。

小结

本文演示了创建Azure Open AI环境并成功部署和执行一个模型的demo。 下一文将进行一些进阶的demo演示。

另外注意:

- Azure OpenAI Studio 彻底下线

- Azure AI Studio 合并消失

- 所有模型部署、调用、管理 → 全部统一到 Azure AI Foundry

- 入口只有一个:ai.azure.com

Azure 门户(portal.azure.com): 负责:资源创建、密钥、Endpoint、配额、区域

Azure AI Foundry(ai.azure.com): 负责:模型部署、部署名称、测试、微调、监控

更多推荐

已为社区贡献14条内容

已为社区贡献14条内容

所有评论(0)