深度解析:AI电影制作的“技术黑箱”——从Diffusion到NeRF,揭秘Sora/Kling背后的算法原理与工程实战

2024:Sora证明了“物理模拟”的可能性。2025:Seedance 2.0 / Kling解决了“多镜头叙事”和“角色一致性”。2026:《团圆令》证明了全流程AI制作的商业可行性。对于技术人来说,未来的核心竞争力不再是“会用工具”,而是Prompt Engineering的深度:懂得用数学语言(如光圈值、焦段、物理参数)描述创意。工作流编排能力:将LLM、Diffusion、Control

摘要: 当我们还在讨论“AI能不能拍电影”时,第一性原理的玩家已经开始用物理引擎+大模型重构影视工业了。本文拒绝浅尝辄止的工具测评,带你深入Transformer架构、潜在扩散模型(LDM)、神经辐射场(NeRF)的底层逻辑,拆解《团圆令》、Sora、Seedance 2.0背后的核心技术栈。看完这篇,你不仅懂“怎么用”,更懂“为什么能用”。

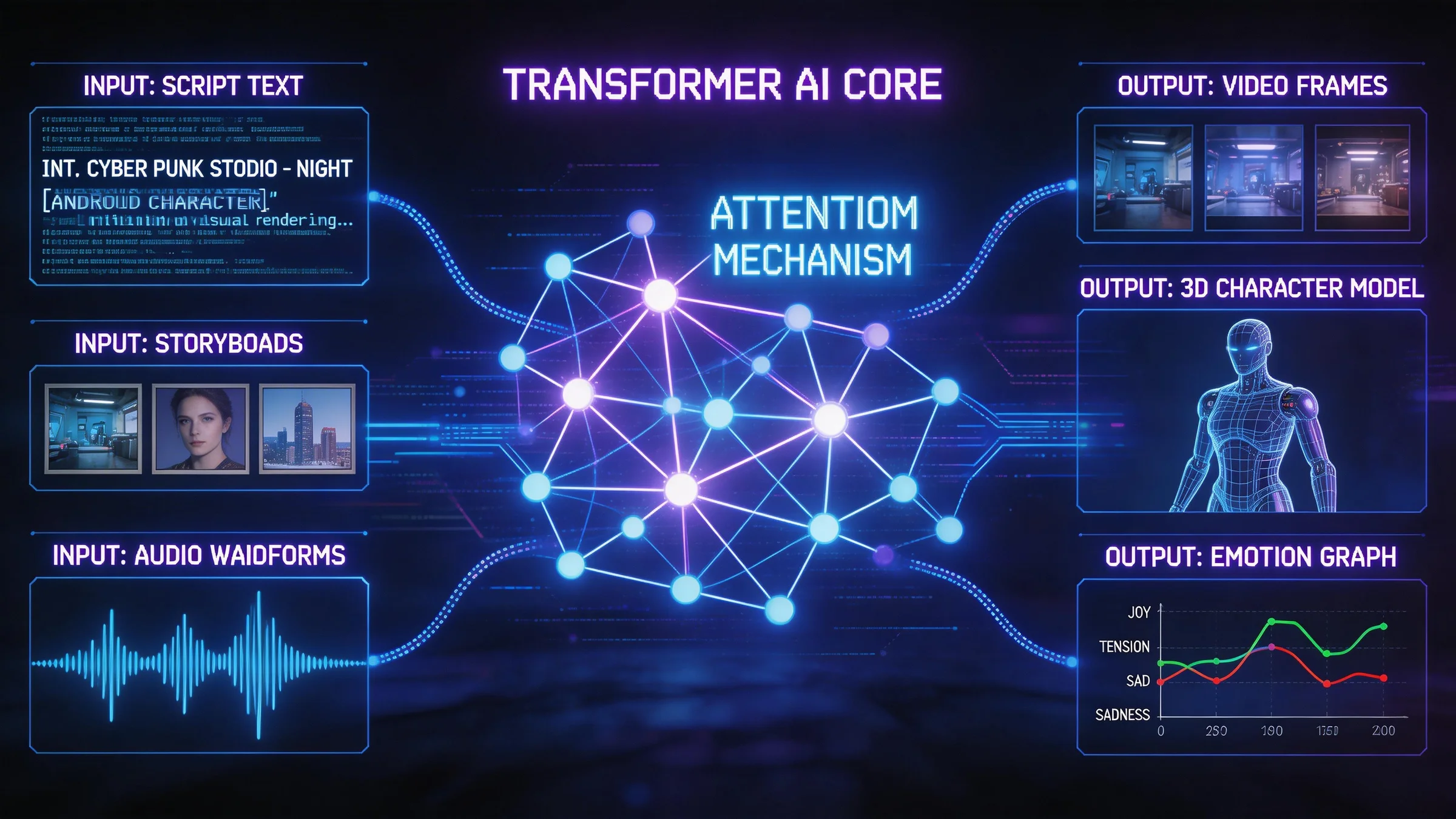

一、 前期:数据驱动的“算法编剧”与“神经分镜”

传统的剧本创作依赖灵感,而AI电影的前期是概率论与数据挖掘的胜利。

1. 大模型的“叙事拓扑结构”

你以为ChatGPT只是在“预测下一个字”?错。它是在构建高维语义空间。

- 技术原理:基于Transformer架构的自注意力机制(Self-Attention),模型能捕捉长文本中的依赖关系。在剧本生成中,通过RLHF(人类反馈强化学习),模型不仅学习了8.7万部电影剧本的叙事结构(参考Sora Turbo训练数据),还学会了“英雄之旅”、“三幕式结构”等隐性规则。

- 硬核应用:情感曲线预测器。先进的编剧Agent(如Intelliflicks使用的模型)内置了“心率反应算法”,能计算观众在特定剧情节点的情绪波动,将剧本的市场接受度预测准确率提升至82%。这不再是艺术创作,而是数据增强的精准计算。

2. 文本到图像的“潜在扩散”机制

Midjourney和Stable Diffusion为何能生成电影级分镜?核心在于LDM(潜在扩散模型)。

- 去噪过程:AI并非直接“画”图,而是在一个压缩的潜在空间(Latent Space)中,从纯高斯噪声开始,通过U-Net网络逐步去噪,还原出像素矩阵。

- 技术爆点:CLIP文本编码器。它将你的Prompt(如“赛博朋克雨夜”)转化为数学向量,精准指导去噪方向。更关键的是Cross-Attention(交叉注意力)机制,让模型能精准控制“熊猫”在画面的哪个位置、“红叶寺”占据多少像素。

二、 中期:虚拟制作的“物理引擎”与“一致性控制”

这是AI电影最硬核的环节,也是Sora、Runway、Kling拉开差距的关键。

1. 视频生成的三大技术流派

目前的AI视频生成并非单一技术,而是三种路线的博弈:

- Diffusion(扩散模型):代表是Sora、Runway Gen-3。优点是画质极高、光影真实;缺点是时序连贯性差,容易“幻觉”。

- Autoregressive(自回归):代表是Kling(可灵)、Vidu。类似GPT生成文字,逐帧预测下一帧。优点是动作连贯、逻辑强;缺点是累计误差大,长视频容易崩坏。

- Transformer(统一架构):代表是Seedance 2.0。字节跳动的杀手锏在于将视频视为“时空Token”,利用Transformer的全局视野,实现了多镜头间的角色一致性和运镜逻辑控制。

2. 解决“薛定谔的一致性”:ControlNet与LoRA

AI视频最大的痛点是“角色变脸”和“场景漂移”。专业团队怎么解决?

- ControlNet(控制网):这是Stable Diffusion的神级插件。通过提取Canny边缘图、OpenPose骨骼图、Depth深度图,强制AI在生成视频时遵守原有的构图和动作骨架。比如生成“熊猫打拳”,ControlNet会锁死熊猫的骨骼节点,确保每一帧都在“打拳”而不是“跳舞”。

- LoRA(低秩适应)微调:为了保持角色一致性,团队会用主角的10-20张高清图训练一个LoRA小模型。这个模型只有几十MB,却能将角色的面部特征“焊死”在生成流程中,解决了“换个镜头就换张脸”的绝症。

- IP-Adapter:参考文章中提到的“特征迁移”技术。直接将参考图的特征向量注入生成流程,实现风格与角色的零样本迁移。

3. 物理仿真与世界模型

为什么《团圆令》的毛发和流体能以假乱真?因为引入了物理引擎。

- NeRF(神经辐射场)与3D Gaussian Splatting:不再是单纯的2D生成,而是先构建3D高斯体,再渲染成视频。这让镜头可以360度环绕运镜而不穿帮。

- 流体动力学模拟:华硕ProArt创16背后的渲染技术,结合了DLSS 4的帧生成技术,能实时模拟“水墨晕染”的流体效果。在Sora 2的演示中,液态金属的表面张力、粘度变化都符合真实物理规律,仿真精度提升至87%。

三、 后期:智能合成与“神经渲染”

后期不再是“剪辑”,而是多模态融合。

1. 音画同步的“对口型”算法

以前配音要对口型,现在是AI根据语音生成口型。

- Wav2Lip / SadTalker:通过分析音频的梅尔频谱,驱动面部关键点(Landmarks)运动。

- 高阶玩法:参考文章中提到的Apple AI平台,利用3D人脸建模+纹理生成,不仅对口型,连“说话时的微表情、眼神光”都能同步生成,误差控制在3帧以内。

2. 神经风格迁移与超分

老片修复和特效合成依赖GAN(生成对抗网络)的进化版。

- ESRGAN / Topaz AI:利用深度学习将1080P素材“脑补”成8K。其原理是学习海量高清纹理的先验知识,对低清图像进行超分辨率重建。

- RIFE(实时中间帧插值):将24帧的视频通过AI插帧到120帧,利用光流法预测中间帧,实现丝滑的慢动作效果,且无需昂贵的高速摄影机。

3. 智能剪辑的“语义理解”

Adobe Premiere Pro 2025版的AI功能之所以强大,是因为它引入了多模态大模型。

- 情感剪辑算法:AI不仅识别“切镜头”,还能识别“悲伤”、“紧张”的情绪。通过分析演员的微表情和音频的情绪波形,自动选择最具张力的镜头组合,初剪版本与资深剪辑师的相似度达79%,但速度快8倍。

四、 硬件与算力:AI电影的“底座”

所有算法的运行都离不开算力暴力美学。

- NVIDIA RTX 5090 / AMD Ryzen AI 9 HX 370:本地生成4K视频需要恐怖的显存带宽。华硕ProArt创16搭载的RTX 5090笔记本GPU配合DLSS 4,能实现实时预渲染,这是创作者能“所见即所得”的关键。

- 分布式渲染集群:参考某平台的数据,为了缩短周期,他们构建了每小时处理1200分钟视频的渲染集群,资源利用率达91%。这不仅是技术战,更是算力战。

五、 总结:AI电影的“技术奇点”已至

回顾2024-2026年的技术演进:

- 2024:Sora证明了“物理模拟”的可能性。

- 2025:Seedance 2.0 / Kling解决了“多镜头叙事”和“角色一致性”。

- 2026:《团圆令》证明了全流程AI制作的商业可行性。

对于技术人来说,未来的核心竞争力不再是“会用工具”,而是:

- Prompt Engineering的深度:懂得用数学语言(如光圈值、焦段、物理参数)描述创意。

- 工作流编排能力:将LLM、Diffusion、ControlNet、3D引擎像乐高一样拼接。

- 垂直模型微调:用自有数据训练LoRA,打造独家IP风格。

AI不是要取代导演,而是要把导演从“技术执行”中解放出来,回归到“创意决策”的本质。

👇 互动与资源

你觉得目前AI视频生成最大的技术瓶颈是什么?是长程记忆、物理仿真,还是复杂交互?

技术彩蛋:

想尝试搭建自己的AI视频工作流?后台回复“技术栈”,送你一份《AI影视制作核心算法库与开源项目清单(2026版)》,包含Stable Diffusion WebUI、ComfyUI节点配置、ControlNet模型下载地址!

点赞 + 收藏 + 关注,下期教你如何用ComfyUI搭建一个支持实时物理仿真的AI视频生成节点!

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)