城大与腾讯研究团队:AI评分官终于学会了深度思考与全面评判

城大与腾讯研究团队:AI评分官终于学会了深度思考与全面评判

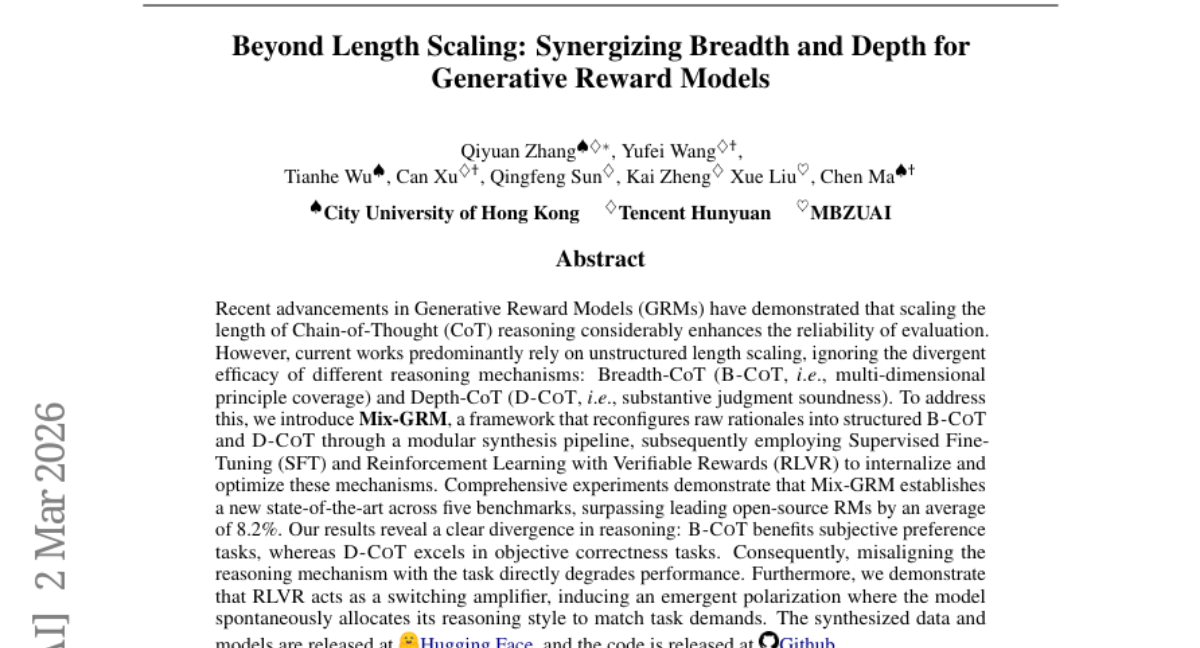

来自香港城市大学、腾讯混元和阿联酋MBZUAI的研究团队在2026年发表了一项关于生成式奖励模型的重要研究成果。这项发表于2026年3月3日的研究论文编号为arXiv:2603.01571v1,为AI系统的评价能力带来了革命性改进。

想象一下,你正在为学校的作文竞赛当评委。传统的评分方式可能只是让你简单地给每篇作文打个分数,但真正优秀的评委会做什么呢?他们会仔细分析每篇作文的结构、语言运用、创意程度等各个方面,然后给出详细的评判理由,最终做出公正的评分。这就是这项研究要解决的核心问题:如何让AI评分系统变得更像真正的专业评委。

目前的AI奖励模型就像那些只会按固定标准打分的机器人评委,它们虽然可以给出评分,但缺乏灵活性和深度思考能力。当面对复杂多样的任务时,这些模型常常表现出"一刀切"的问题:要么过分关注表面的流畅度而忽略内容的准确性,要么过分追求技术细节而忽视整体的可读性。

这个问题在现实应用中非常关键。当我们使用AI来辅助各种决策时,比如评价学生作业、审核商品评论、或者筛选求职简历,我们需要AI能够像人类专家一样,既能全面考虑各种因素,又能根据具体情况调整评判重点。比如评价一篇数学解题过程时,逻辑严谨性比文采更重要;而评价一篇散文时,情感表达和创意可能比逻辑推理更关键。

研究团队发现了一个有趣的现象:就像人类思考有"快思考"和"慢思考"两种模式一样,AI评判也应该有两种不同的思维方式。他们将这两种方式形象地称为"广度思考"和"深度思考"。广度思考就像一个全面型评委,会从多个不同角度同时考虑问题,确保不遗漏任何重要因素;深度思考则像一个专业型评委,会深入挖掘核心问题,逐步验证每个细节是否站得住脚。

为了实现这种双重思维模式,研究团队开发了一个名为Mix-GRM的创新框架。这个系统的巧妙之处在于,它不是简单地让AI写更长的评价文字,而是教会AI根据不同任务的特点来调整思考方式。就像一个经验丰富的老师,面对不同类型的学生作业时会采用不同的评价策略。

一、两种思维模式的奥秘

研究团队的核心发现可以用一个简单的比喻来理解:评判任务就像医生诊断疾病,有些情况需要全面体检,有些情况需要专项检查。

广度思考模式就像全面体检。当医生面对一个症状不明的病人时,需要从多个系统同时检查:心血管、呼吸系统、消化系统等等,确保不遗漏任何可能的问题。在AI评判中,这种模式特别适合处理主观性较强的任务,比如评价一篇文章的整体质量。这类任务没有标准答案,需要同时考虑语言表达、内容深度、逻辑结构、创新性等多个维度,就像评委会从不同角度打分然后综合考虑一样。

深度思考模式则像专项检查。当医生已经有了初步判断,需要确认具体诊断时,会进行针对性的深入检查,一步步验证假设是否成立。在AI评判中,这种模式特别适合处理客观性较强的任务,比如检查数学题的解答过程。这类任务有相对明确的对错标准,需要逐步验证每个推理步骤是否正确,就像数学老师逐行检查学生的计算过程一样。

有趣的是,研究团队通过大量实验发现,这两种思维模式不能简单地混用。就像你不能用检查心脏病的方法去诊断皮肤病一样,用错误的评判模式不仅不会提高准确性,反而会产生误导。比如,如果用广度思考去评判一道数学题,AI可能会被题目的表述是否优雅、格式是否美观等次要因素分散注意力,而忽略了核心的计算错误。相反,如果用深度思考去评判一篇创意写作,AI可能会过分纠结于某个语法细节,而错过文章整体的艺术价值。

二、让AI学会"见人下菜碟"

为了让AI能够根据任务特点自动选择合适的思维模式,研究团队设计了一个巧妙的训练方法,这个过程可以比作培养一个全能型的专业评委。

首先,他们把原本杂乱无章的评判过程变得条理分明。就像把一个散漫的评判过程改造成规范化的评分表一样,他们将AI的评判思路分解成"原则-判断-结论"三个清晰的步骤。原则就像评分标准,判断就像具体的分析过程,结论就像最终的评分结果。这样做的好处是让整个评判过程变得透明可追踪,就像法官必须说明判决理由一样。

接下来,他们采用了一种类似"因材施教"的训练策略。对于需要全面考虑的主观任务,他们训练AI使用广度思考模式,让它同时从多个角度分析问题,确保覆盖所有重要维度。对于需要严格验证的客观任务,他们训练AI使用深度思考模式,让它一步步深入分析,确保逻辑严密。

最关键的是,他们还加入了一个"自适应学习"机制。这就像培养一个经验丰富的评委,不仅知道不同的评判方法,还能根据具体情况自动选择最合适的方法。通过强化学习技术,AI系统会根据评判结果的准确性来调整自己的思维模式选择策略。如果发现在某类任务上用广度思考效果更好,它就会在遇到类似任务时优先选择广度思考;如果在另一类任务上深度思考更准确,它就会相应调整策略。

这种训练方法的巧妙之处在于,它不是硬性规定AI在什么情况下用什么方法,而是让AI通过实践经验自己学会判断。就像一个新手评委通过不断练习逐渐掌握了什么时候该仔细斟酌、什么时候该快速决断的技巧一样。

三、实战效果:从及格生到优等生的华丽转身

为了验证这种新方法的效果,研究团队进行了一系列全面的测试,结果可以用"脱胎换骨"来形容。

在标准化测试中,Mix-GRM系统的表现就像一个从中等生突然变成班级第一的学生。在五个主要的评判能力测试中,新系统平均比之前最好的开源模型高出了8.2%。这个提升幅度在AI领域是相当显著的,就像一个原本考70分的学生突然能稳定考到78分以上。

更令人印象深刻的是,这种提升并不是简单的整体进步,而是体现出了明显的"术业有专攻"特点。在处理主观评判任务时,比如评价文章质量、对话响应等,广度思考模式展现出了明显优势,就像一个全面型评委能够兼顾多个维度做出公正评价。而在处理客观验证任务时,比如检查数学推理、代码逻辑等,深度思考模式则表现出色,如同一个专业型审查员能够发现细微的错误。

研究团队还测试了这种新方法在实际应用场景中的表现。结果发现,使用新系统训练出来的AI模型不仅在学术测试中表现优异,在真实应用中也展现出了强大的实用价值。比如在代码质量评估任务中,新系统能够准确识别出43.2%的逻辑错误,明显超过了其他同类系统的37.7%。在数学推理验证任务中,准确率达到了60.2%,也显著优于传统方法的39.6%。

特别值得注意的是,新系统在处理复杂任务时展现出了一种"智能切换"的能力。当面对既需要全面考虑又需要深入分析的复杂任务时,系统能够自动在两种思维模式之间找到最佳平衡点。这就像一个经验丰富的老师,既能从整体把握学生的学习状况,又能深入发现具体的知识薄弱点。

四、意外发现:AI竟然学会了"看人下菜"

在实验过程中,研究团队观察到了一个非常有趣的现象:经过强化学习训练后,AI系统自动演化出了一种"智能分工"的能力,这完全是意料之外的收获。

起初,研究团队设计的训练数据是严格按照任务类型来分配思维模式的:主观任务配广度思考,客观任务配深度思考。但在基础训练阶段,AI的执行准确率只有73%左右,就像一个新手员工还在熟悉工作流程。然而,经过强化学习优化后,这个准确率竟然飙升到了95%,这意味着AI几乎完全掌握了"什么任务用什么方法"的技能。

更神奇的是,这种提升完全是AI自主学习的结果。在强化学习阶段,研究团队只是告诉AI"评判准确就奖励,不准确就惩罚",并没有明确指导它应该在什么情况下使用哪种思维模式。但AI通过试错学习,自己发现了任务类型与思维模式之间的最佳匹配关系。

这个过程可以比作一个聪明的学徒工。师傅只是告诉他"把活干好就行",但没有详细教授具体方法。通过不断实践,这个学徒工自己摸索出了什么时候该用精细操作、什么时候该用粗放方式,最终成为了比师傅预期更优秀的工匠。

研究团队通过分析AI的行为模式发现,经过训练的系统在面对主观任务时,会自动增加评判维度的数量,确保覆盖面更广;而在面对客观任务时,会自动加深单个维度的分析深度,确保验证更严格。这种自适应行为完全符合人类专家的判断习惯,但却是AI通过纯数据驱动的方式自主学会的。

五、深入剖析:为什么这样做效果更好

为了理解新方法的成功原因,研究团队进行了深入的对比分析,揭示了一些意想不到的机制。

传统的AI评判系统就像一个只会照章办事的机器人,无论面对什么任务都用同一套固定流程。这种"一刀切"的方式在某些情况下可能有效,但在面对多样化任务时就会出现明显的适应性问题。比如,当用处理数学题的严格逻辑去评判一首诗的美感时,AI可能会过分关注押韵是否完美、格律是否标准,而完全忽略诗歌的情感表达和意境营造。

新的Mix-GRM系统则像一个经验丰富的多面手,能够根据任务特点调整工作方式。研究团队发现,这种灵活性的关键在于"任务-方法匹配"机制。系统不是简单地混合两种思维模式,而是学会了在不同情况下侧重不同的模式。

通过详细的实验对比,研究团队发现了一个重要规律:当任务答案相对确定时(比如数学计算、逻辑推理),深度思考模式的逐步验证方法效果更好;当任务答案相对开放时(比如创意评价、风格判断),广度思考模式的多维度考量方法效果更好。这个发现验证了研究团队最初的假设,也解释了为什么混合模式会比单一模式更有效。

更有趣的是,研究团队还发现了"计算效率"的额外收益。虽然表面上看,两种思维模式都需要更多的计算资源,但实际上,由于目标更明确、过程更高效,新系统的总体计算成本并没有显著增加。这就像一个有经验的工人虽然工作更仔细,但由于方法得当,总体效率反而更高。

六、实用价值:从实验室走向现实应用

这项研究的价值不仅体现在学术指标的提升上,更重要的是在实际应用中展现出的巨大潜力。

在教育领域,新的AI评判系统可以像一个既严格又包容的老师。当评价学生的数学作业时,系统会使用深度思考模式,仔细检查每个计算步骤,确保逻辑严密;当评价学生的作文时,系统会转换到广度思考模式,从语言表达、内容创意、结构组织等多个角度给出综合评价。这种灵活性使得AI辅助教学变得更加实用和可靠。

在内容审核领域,新系统可以应对更复杂的审核需求。比如在审核技术文档时,系统会重点检查内容的准确性和逻辑完整性;而在审核创意内容时,系统会更多关注内容的丰富性和表达效果。这种差异化的审核策略使得自动化内容管理变得更加智能化。

在商业决策支持方面,新系统也展现出了独特优势。当评估技术方案的可行性时,系统会深入分析技术细节和实施风险;当评估创新产品的市场潜力时,系统会从用户需求、竞争环境、商业模式等多个维度进行综合分析。

研究团队特别测试了系统在"最佳答案选择"任务中的表现。在这种任务中,AI需要从多个候选答案中选出最好的一个,就像在线搜索引擎需要从众多结果中排出最相关的一样。结果显示,使用新方法的AI在这类任务中的准确率比传统方法提高了10%以上,这在实际应用中意味着用户体验的显著改善。

七、技术创新:站在巨人肩膀上的新突破

从技术角度来看,这项研究的创新性体现在多个方面,但都以实用性为导向。

最核心的创新是"模块化思维架构"的设计。研究团队将复杂的评判过程分解为可重组的基础模块,就像把复杂的机械设备拆解为可互换的标准零件。这种设计使得AI可以根据需要灵活组装不同的思维流程,而不是被困在固定的程序框架中。

另一个重要创新是"任务感知学习"机制。传统的AI训练就像培养一个只会背诵标准答案的学生,而新方法则像培养一个能够理解题目类型并相应调整解题策略的优秀学生。系统不仅学会了如何给出正确答案,更重要的是学会了如何选择正确的思考方式。

在数据处理方面,研究团队开发了一套"智能数据合成"方法。他们不是简单地收集更多数据,而是将现有数据重新组织和改造,创造出更适合训练的高质量样本。这就像一个厨师不是简单地使用更多食材,而是通过巧妙的搭配和处理方式,让普通食材发挥出更大的营养价值。

在训练效率方面,新方法也表现出了明显优势。虽然系统变得更复杂,但由于目标更明确、方法更合理,实际的训练时间和计算资源消耗并没有大幅增加。这使得新方法不仅在理论上优秀,在实际部署时也具有很强的可行性。

八、未来展望:更智能的AI评判时代

这项研究不仅解决了当前的问题,也为未来的发展指明了方向。

研究团队坦诚地指出了当前方法的局限性。目前的系统虽然能很好地处理主观和客观两大类任务,但现实世界的任务往往更加复杂多样,可能需要更细致的分类和更灵活的处理方式。这就像当前的系统掌握了"大刀阔斧"和"精雕细琢"两种基本功夫,但在面对需要"刚柔并济"的复杂情况时,还有改进空间。

另一个挑战是如何处理那些既需要全面考虑又需要深入分析的混合型任务。目前的系统虽然能在两种模式之间切换,但在需要同时使用两种模式的复杂情况下,还需要更精细的协调机制。

从更长远的角度看,这项研究为AI系统的"认知灵活性"开辟了新的研究方向。未来的AI可能不仅能在不同的思维模式之间切换,还能根据任务的复杂程度动态调整思维深度,甚至能够模拟人类专家在面对新问题时的探索性思维过程。

研究团队也提到了跨领域应用的可能性。这种"因地制宜"的思维模式切换机制不仅适用于评判任务,也可能在其他需要灵活决策的AI应用中发挥作用,比如个性化推荐、智能客服、自动驾驶决策等领域。

说到底,这项研究最大的意义在于它让我们看到了AI从"机械执行者"向"智能决策者"转变的可能性。当AI不再只是按固定程序工作,而是能够像人类专家一样根据情况调整工作方式时,我们就真正迈向了更智能、更实用的人工智能时代。这种进步不仅让AI变得更强大,也让它变得更值得信赖,因为它的行为变得更可预测、更可解释。

对于普通人来说,这意味着我们将越来越多地在日常生活中遇到这样的智能系统:它们不仅能给出正确答案,还能以合适的方式给出答案;它们不仅效率高,还能让我们理解它们是怎么工作的。这样的AI助手才是我们真正需要和欢迎的伙伴。

Q&A

Q1:Mix-GRM的两种思维模式具体是什么?

A:Mix-GRM有两种思维模式:广度思考和深度思考。广度思考像全面体检一样,从多个角度同时分析问题,适合处理主观性强的任务如文章评价;深度思考像专项检查一样,逐步深入验证每个细节,适合处理客观性强的任务如数学推理检查。

Q2:Mix-GRM比传统AI评判系统好在哪里?

A:传统系统像只会照章办事的机器人,对所有任务都用同一套方法。Mix-GRM则像经验丰富的专家,能根据任务特点自动选择合适的评判方式,在标准测试中比最好的开源模型平均提高了8.2%,在数学推理等具体任务上提升更明显。

Q3:普通人什么时候能用上这种技术?

A:这项技术已经在学术界验证有效,研究团队也公开了相关代码和数据。预计很快就会被集成到各种AI应用中,比如智能教育评估、内容审核、文档检查等工具,让我们在日常使用AI服务时获得更准确、更智能的反馈。

更多推荐

已为社区贡献448条内容

已为社区贡献448条内容

所有评论(0)