溯源 AI 影像的“寒武纪”:2010-2015 萌芽期,DeepArt 与 GAN 如何埋下 Sora 的种子

**摘要:**2010-2015年是AI影像技术的萌芽期,以AlexNet、GAN和DeepArt为代表的技术突破奠定了现代AI电影制作的基础。这一时期,深度学习三要素——算力(GPU)、算法(CNN/RNN/GAN)和数据(大数据)完成历史交汇,使AI从实验室走向好莱坞。CNN赋予AI图像识别能力,RNN实现语音转文字,GAN开启“无中生有”的生成可能。AI初步应用于老片修复、音频降噪和视频分析

摘要: 当我们惊叹于 Sora 生成的逼真视频,或是 Coze 工作流的一键成片时,很少有人回望那个“草莽英雄”般的年代。2010 年至 2015 年,是 AI 历史上的“萌芽期”。AlexNet 的一声惊雷,GAN 的奇思妙想,以及 DeepArt 的惊艳亮相,共同构成了现代 AI 影像技术的基石。本文将带你穿越回那个激动人心的时代,揭开 AI 电影制作的序章。

引言:大爆炸前的寂静与惊雷

如果把 2023 年的 Generative AI 比作一场核爆,那么 2010-2015 年就是地壳下岩浆涌动的时刻。

在那之前,“AI”在电影人眼里还是个遥远的科幻概念。但就在这短短五年间,深度学习(Deep Learning)的三驾马车——算力(GPU)、算法(CNN/RNN/GAN)和数据(大数据)——突然完成了历史的交汇。

今天,我们就来复盘这段关键历史,看看 AI 是如何从“实验室的玩具”变成“好莱坞的工具”。

一、 技术背景:三股力量的历史交汇

1. 深度学习的“创世时刻”:AlexNet (2012)

2012 年,Geoffrey Hinton 团队的 AlexNet 在 ImageNet 图像识别竞赛中以碾压性优势夺冠。这不仅是计算机视觉的胜利,更是深度学习的成人礼。

- 意义:它证明了“深层神经网络”不是理论垃圾,而是能真正理解图像的神器。

- 影响:从此,电影工业界开始意识到,机器或许能像人一样“看懂”视频里的物体。

2. 算力的“淘金热”:GPU 的崛起

如果你回看 2010 年的显卡市场,NVIDIA 可能还在忙着卖游戏卡。但随着深度学习对并行计算的渴求,CUDA 架构让 GPU 变成了 AI 训练的唯一选择。

- 数据:相比 CPU,GPU 在训练神经网络时速度提升了 10-50 倍。没有 GPU,就没有后来的 ChatGPT 和 Sora。

3. 数据的“石油时代”

2010 年前后,YouTube 日均上传视频时长已达数千小时,Netflix 的流媒体数据爆发。

- 核心:AI 终于有了“食物”。海量的标注数据让模型不再是无米之炊。

二、 关键技术突破:AI 的“眼、耳、脑”

在这五年里,AI 补齐了感知世界的三块拼图:

1. 卷积神经网络(CNN):给了 AI 一双“火眼金睛”

- 原理:通过卷积层提取图像特征(边缘、纹理、形状)。

- 电影应用:自动打标。以前需要人工给几万帧画面打标签(如“这是枪战”),现在 CNN 几分钟搞定,为后期检索奠定了基础。

2. 循环神经网络(RNN):给了 AI 一种“记忆”

- 原理:处理序列数据,当前的输出依赖于之前的记忆。

- 电影应用:字幕生成。虽然当时还不完美,但 RNN 让语音转文字(ASR)从“关键词匹配”进化到了“语义理解”,自动生成字幕成为可能。

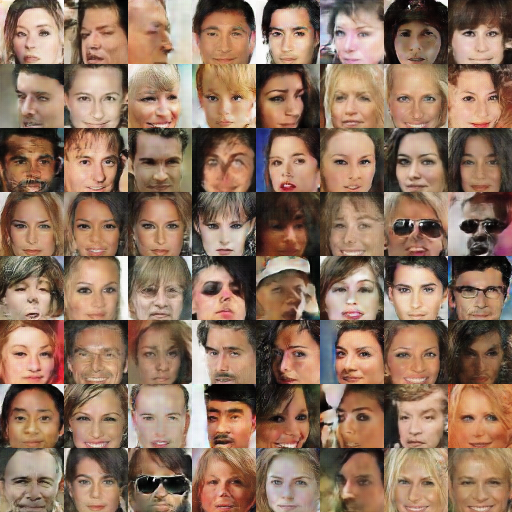

3. 生成对抗网络(GAN):给了 AI 一个“想象力” (2014)

这是整个萌芽期最伟大的发明。Ian Goodfellow 提出的 GAN,包含一个“生成器”(造假币的)和一个“判别器”(验钞的)。

- 革命性:AI 不再只是识别猫,而是能画出猫。

- 电影意义:这是 AI 视频生成的理论鼻祖。虽然当时只能生成模糊的 64x64 像素人脸,但它证明了“无中生有”的可能性。

三、 在电影制作中的应用:从“辅助”到“增强”

这一阶段,AI 还没有能力“生成”电影,但已经开始疯狂渗透进后期制作(Post-production)的各个环节,主要扮演“超级修图师”和“搬运工”的角色。

1. 图像处理:老片修复的魔法

- 场景:很多经典老电影胶片划痕严重、色彩失真。

- AI 方案:利用 CNN 进行去噪(Denoising)和超分辨率重建(Super-Resolution)。

- 案例:虽然不是全自动,但早期的 AI 工具已经能辅助修复师自动填补划痕,效率提升 3 倍以上。

2. 音频处理:把声音从噪音中“抠”出来

- 场景:片场收音环境嘈杂(风声、车流)。

- AI 方案:基于深度学习的声源分离。AI 能学习“人声”的频谱特征,把背景噪音像抠图一样“抠”掉。

- 效果:这为后来 Adobe Podcast 等一键降噪工具埋下了伏笔。

3. 视频分析:智能场记

- 场景:导演想找“上一场那个穿红衣服的女主角的镜头”。

- AI 方案:视频内容分析(VCA)。系统自动分析视频流,识别角色、场景、甚至情绪,建立索引。

四、 代表性项目:DeepArt 与早期 GAN 的星火

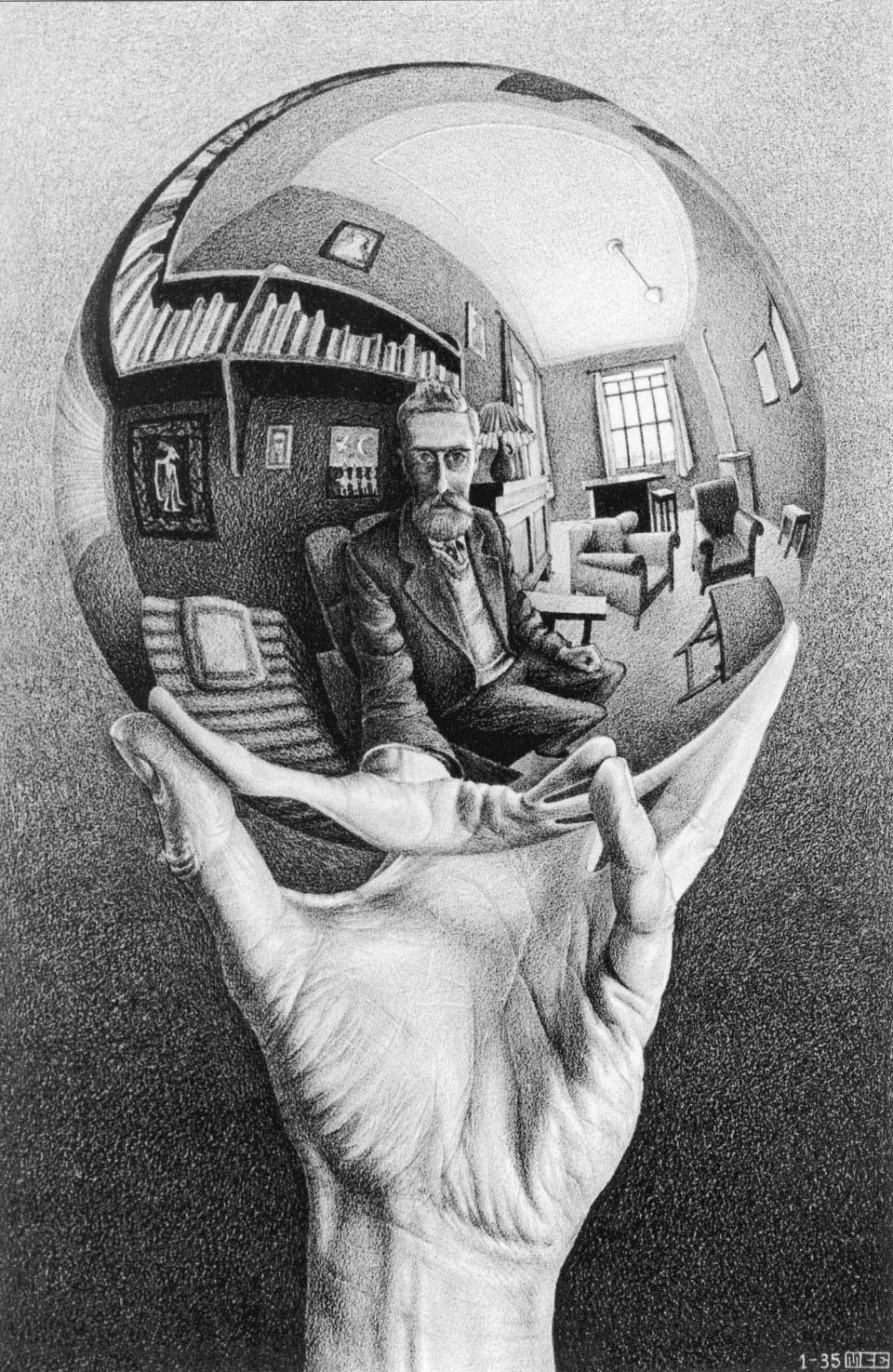

1. DeepArt (2015):艺术风格的民主化

如果你用过 Prisma 或美图秀秀的“艺术滤镜”,你就得感谢 DeepArt。

- 技术原理:基于 Gatys 等人的论文,利用预训练的 VGG-19 网络,将一张画的“风格”(Style)和一张照片的“内容”(Content)分离并重组。

- 行业震撼:它让普通人只需上传一张照片,就能获得梵高、毕加索风格的画作。

- 电影启示:预演可视化。导演可以在拍摄前,把故事板(Storyboard)一键转换成概念图,极大地降低了沟通成本。

2. 早期 GAN 应用:模糊的幽灵

2014-2015 年,GAN 生成的图像大多是模糊的噪点,甚至有些诡异(比如眼睛长在额头上)。

- 意义:尽管粗糙,但这是人类第一次看到“非真实存在的像素”。电影特效师开始思考:也许未来不需要建模,直接“生成”一个怪兽?

五、 结语:萌芽期的遗产

2010-2015 年,AI 在电影界还是个“昂贵的实验品”。只有像 Weta Digital、工业光魔这样的顶级特效公司才有资金尝试。

但正是这五年,留下了三笔巨大的遗产:

- CNN 成为了计算机视觉的标准工具。

- GAN 打开了生成式 AI 的大门。

- GPU 成为了算力的代名词。

没有 DeepArt 的试错,就没有今天的 Midjourney;没有早期 GAN 的模糊人脸,就没有今天 Sora 的 4K 高清视频。

当我们站在 2024 年展望未来时,不要忘记那些在 2012 年深夜调试 CUDA 代码的工程师,和 2015 年第一次看到 DeepArt 生成图时惊呼“不可能”的艺术家们。

历史的齿轮,从那时起,开始转动。

👇 互动时间:

你见过最早的 AI 生成图像是什么样的?还记得第一次用“滤镜”APP时的惊艳感吗?

欢迎在评论区分享你的“AI 初体验”!

点赞 + 收藏 + 关注,下期带你走进 2016-2019 年的“成长期”,看看 AlphaGo 如何教会 AI 理解“逻辑”与“策略”!

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)