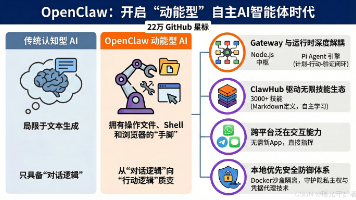

OpenClaw 是什么?一篇让小白也能看懂的 AI Agent 平台介绍

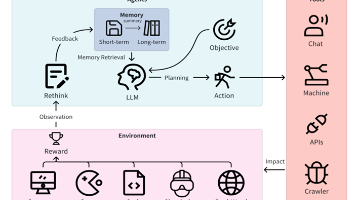

不需要任何技术背景,用最通俗的语言解释 OpenClaw AI Agent 平台的工作原理、四层架构设计和五大核心能力。涵盖多渠道通信、浏览器自动化、定时任务、记忆系统、MCP 扩展协议等内容。

如果你想了解 OpenClaw 到底是什么、怎么工作的,这篇文档就是为你写的。

不需要任何技术背景,我们用最通俗的语言来解释。

一句话总结

OpenClaw 是一个「AI 管家」平台 —— 它让一个 AI 大脑能够同时在微信、Telegram、Discord 等多个聊天软件里工作,还能自动操作浏览器、定时执行任务,就像你雇了一个 7×24 小时不休息的全能助手。

用一个生活中的比喻来理解

想象你开了一家小公司,你需要一个前台接待。这个前台需要:

- 听懂人话 → 这就是 AI 大模型(比如我们用的 Qwen3.5)

- 接多部电话 → 这就是 OpenClaw 的多渠道能力(同时接 Telegram、微信、飞书等)

- 会上网查资料 → 这就是浏览器自动化

- 按时做固定的事 → 这就是定时任务

- 记住之前聊过什么 → 这就是会话和记忆系统

OpenClaw 就是把这些能力打包在一起的「操作系统」。

核心架构:四层蛋糕

OpenClaw 的架构可以想象成一个四层蛋糕,从下到上分别是:

┌─────────────────────────────────────────────┐

│ 第四层:聊天渠道(对外窗口) │

│ Telegram / 微信 / Discord / 飞书 / Slack │

├─────────────────────────────────────────────┤

│ 第三层:Agent(AI 员工) │

│ 每个 Agent 有自己的身份、技能、工作区 │

├─────────────────────────────────────────────┤

│ 第二层:Gateway(调度中心) │

│ 消息路由 / 会话管理 / 权限控制 / 定时任务 │

├─────────────────────────────────────────────┤

│ 第一层:AI 大模型(大脑) │

│ Qwen3.5-35B 跑在本地 2 块 RTX 4090 上 │

└─────────────────────────────────────────────┘

第一层:AI 大脑

这是整个系统最核心的部分。我们在本地服务器上部署了一个叫 Qwen3.5-35B 的 AI 大模型,用两块 RTX 4090 显卡来运行它。

为什么要在本地跑?

- 省钱 —— 不用每次对话都付费给云端 API

- 隐私 —— 所有数据都在自己的服务器上,不用担心信息泄露

- 快速 —— 不受网络波动影响,响应更稳定

这个大模型通过一个叫 SGLang 的推理引擎来运行,它的作用就像一个翻译官,把我们的问题「翻译」成模型能理解的格式,再把模型的回答「翻译」回来。

第二层:Gateway(调度中心)

Gateway 是 OpenClaw 的「大脑中枢」。如果说 AI 模型是「会思考的大脑」,Gateway 就是「会调度的神经系统」。

它负责:

- 消息路由 —— 收到一条消息后,决定交给哪个 Agent 处理

- 会话管理 —— 记住「谁在跟谁聊天」,保持上下文连贯

- 定时调度 —— 到了设定的时间,自动触发 Agent 去执行任务

- 权限控制 —— 确保每个 Agent 只能做自己权限范围内的事

Gateway 是一个后台常驻进程,7×24 小时运行,就像一个永不下班的调度员。

第三层:Agent(AI 员工)

Agent 就是一个个有名字、有身份、有技能的「虚拟员工」。你可以创建多个 Agent,让它们各司其职:

- 客服 Agent —— 专门回答客户问题

- 运营 Agent —— 专门生成日报、周报

- 研发 Agent —— 专门辅助写代码

每个 Agent 都有自己独立的:

- 工作区 —— 就像每个员工有自己的工位

- 记忆 —— 记住之前的对话内容

- 技能 —— 可以配置不同的能力(比如搜索、浏览网页、调用 API)

第四层:聊天渠道(对外窗口)

这是用户能直接接触到的部分。OpenClaw 支持连接十几种聊天平台:

| 平台 | 连接方式 |

|---|---|

| Telegram | 创建一个 Bot,用 Token 连接 |

| 扫码登录,就像在电脑上登录微信一样 | |

| Discord | 创建 Bot 连接 |

| 飞书 | 飞书机器人方式 |

| Slack | OAuth 授权连接 |

| 微信 | 通过适配器连接 |

连接之后,用户在这些平台上发的消息会自动传给 OpenClaw,由对应的 Agent 来回复。

工作流程:一条消息的完整旅程

让我们跟踪一条消息,看看它是怎么从发送到收到回复的:

1. 用户在 Telegram 发了一条消息:"帮我写个 Python 爬虫"

↓

2. Telegram 渠道适配器收到消息,转发给 Gateway

↓

3. Gateway 查找这个用户对应的 Agent,确定路由

↓

4. Agent 收到任务,组装好 prompt(提示词)

↓

5. Agent 把 prompt 发给 AI 大模型(Qwen3.5)

↓

6. AI 大模型思考后生成回复

↓

7. Agent 收到回复,做必要的后处理

↓

8. Gateway 把回复通过 Telegram 渠道发回给用户

↓

9. 用户在 Telegram 上看到了 AI 的回复

整个过程通常只需要几秒钟。

五大核心能力详解

能力一:多渠道通信

是什么:一个 AI 同时在多个聊天平台上服务,就像一个客服同时接听多条热线。

为什么有用:你不用针对每个平台单独开发 AI 机器人,OpenClaw 帮你统一管理。

怎么工作:每个聊天平台都有一个「适配器」,负责把该平台特有的消息格式转换成 OpenClaw 统一的内部格式。这样 Agent 不需要关心消息是从哪个平台来的,它只需要专注于「理解问题、给出回答」。

能力二:浏览器自动化

是什么:AI 可以像真人一样操作浏览器 —— 打开网页、点击按钮、填写表单、截图。

为什么有用:很多工作需要在网页上完成,比如查数据、填表格、抓信息。有了浏览器自动化,AI 就能帮你做这些重复性的网页操作。

怎么工作:OpenClaw 内置了一个 Chromium 浏览器(就是 Chrome 的开源版本),通过一套控制协议来操作它。AI 可以:

- 打开任意网址

- 获取页面结构(知道页面上有哪些按钮、输入框)

- 点击、输入、拖拽等操作

- 截图或导出 PDF

能力三:定时任务

是什么:设定好时间和要做的事,AI 会到点自动执行。就像手机上的闹钟,但它触发的不是铃声,而是一个 AI 任务。

为什么有用:日报、周报、数据汇总、定时提醒……这些重复性的工作交给 AI 自动完成。

怎么工作:使用标准的 Cron 表达式来定义执行时间。比如:

- 每天早上 9 点生成日报

- 每周一汇总上周数据

- 每小时检查一次系统状态

能力四:记忆系统

是什么:AI 能记住之前跟你聊过什么,下次聊天时可以接着之前的话题。

为什么有用:没有记忆的 AI 就像每次见面都是第一次的路人。有了记忆,AI 能理解上下文,给出更精准的回答。

怎么工作:每次对话都会被保存为一个「会话」,会话里包含所有的聊天记录。Agent 还有一个「长期记忆」系统,可以搜索和检索之前的重要信息。

能力五:MCP 扩展协议

是什么:MCP(Model Context Protocol)是一种让 AI 获得新能力的标准协议。可以把它理解为 AI 的「USB 接口」。

为什么有用:就像手机可以通过安装 App 来增加功能一样,通过 MCP 可以给 AI 接入各种工具 —— 数据库查询、文件操作、第三方 API 调用等等。

怎么工作:每个 MCP 服务就像一个「插件」,告诉 AI「我能做什么」和「怎么调用我」。AI 在需要的时候会自动选择合适的工具来完成任务。

技术栈一览(了解即可)

| 组件 | 技术 | 通俗解释 |

|---|---|---|

| AI 模型 | Qwen3.5-35B-A3B-FP8 | 「大脑」,350 亿参数的中文 AI |

| 推理引擎 | SGLang | 「翻译官」,让模型高效运行 |

| 平台框架 | OpenClaw | 「操作系统」,管理一切 |

| 运行环境 | Node.js 22 | OpenClaw 运行所需的底层环境 |

| 显卡 | 2x RTX 4090 | 「心脏」,提供算力 |

| 操作系统 | Ubuntu 22.04 | 服务器系统 |

和常见产品的对比

| ChatGPT | OpenClaw | |

|---|---|---|

| AI 在哪里 | OpenAI 的云服务器 | 你自己的本地服务器 |

| 数据隐私 | 数据上传到国外 | 完全在本地,不出服务器 |

| 费用模式 | 按月付费 / 按次计费 | 一次性硬件成本,后续免费用 |

| 多平台支持 | 只有网页和 App | 13+ 聊天平台 |

| 浏览器操控 | 不支持 | 内置支持 |

| 定时任务 | 不支持 | 内置支持 |

| 可定制性 | 有限 | 完全可控 |

我们的部署情况

服务器: 192.168.100.67(内网地址)

已部署的服务:

├── SGLang (端口 8000) → AI 模型推理服务

├── OpenClaw (端口 18789) → Agent 平台网关

├── Open WebUI (端口 8080) → Web 聊天界面

└── Ollama (端口 11434) → 云模型代理

硬件配置:

├── GPU: 2x NVIDIA RTX 4090 (各 24GB 显存)

├── RAM: 128GB

└── OS: Ubuntu 22.04

常见问题

Q:OpenClaw 是开源的吗?

A:OpenClaw 是一个商业产品,提供 CLI(命令行工具)进行管理和使用。

Q:需要联网才能用吗?

A:AI 对话本身不需要联网(模型在本地运行)。但如果要连接 Telegram、Discord 等外部聊天平台,需要服务器能访问互联网。

Q:响应速度怎么样?

A:由于模型在本地运行,不受云端 API 排队影响,通常几秒内就能给出回复。

Q:可以同时处理多少对话?

A:取决于显卡显存和模型大小。当前配置(2x RTX 4090 + Qwen3.5-35B)可以同时处理多个并发请求。

Q:AI 会学习我的数据吗?

A:不会。本地部署的模型不会自动学习或更新。你的数据只用于当前会话的上下文理解,不会被用来训练模型。

📌 想要深入了解具体的命令和操作? 请参考 OpenClaw 使用手册

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)