Kimi K2.5 官宣:集群智能体打天下

Kimi K2.5 不仅是参数量的堆砌,更是架构创新与工程落地的结合体✅原生多模态:真正理解“看”到的内容,而非仅识别文字✅Agent集群:从单点智能迈向协同智能,开启AI“社会化”进程✅视觉编程:大幅降低技术门槛,让设计与开发无缝衔接✅高效推理:32B激活参数+INT4量化,平衡性能与成本未来展望:月之暗面团队已透露 K3 正在研发中,将聚焦更强的推理架构与更复杂的工具生态[[30]]。随着Ag

摘要:2026年1月,月之暗面(Moonshot AI)正式开源发布 Kimi K2.5 多模态大模型。作为首款支持“智能体集群”(Agent Swarm)协同作业的开源模型,K2.5 通过原生多模态架构与动态调度机制,将AI从“单兵作战”推向“集群智能”时代。本文将深度剖析其核心技术架构、视觉编程能力及Agent集群创新范式。

一、K2.5 核心技术架构

1.1 原生多模态设计

Kimi K2.5 采用原生多模态架构(Native Multimodal),区别于传统“先OCR提取文字再输入LLM”的拼接方案,K2.5 在预训练阶段即融合视觉与文本信号,基于约 15 万亿混合 token 进行联合训练 [[1]]。这种设计保证了模型能真正理解图像中的空间关系、颜色层次与视觉趋势,而非仅识别文字内容。

图1:传统方案 vs 原生多模态架构对比

1.2 高效MoE架构

K2.5 延续 Kimi K2 的混合专家(MoE)设计,具备以下参数特性:

| 参数类型 | 数值 | 说明 |

|---|---|---|

| 总参数量 | 1 万亿 (1T) | 模型整体容量 |

| 激活参数 | 320 亿 (32B) | 单次推理实际计算量 |

| 精度格式 | 原生 INT4 | 开源即提供量化版本,降低部署门槛 [[33]] |

这种“大容量、低激活”的设计在保持顶尖性能的同时,显著降低推理成本,使万亿参数模型可在消费级硬件上高效运行。

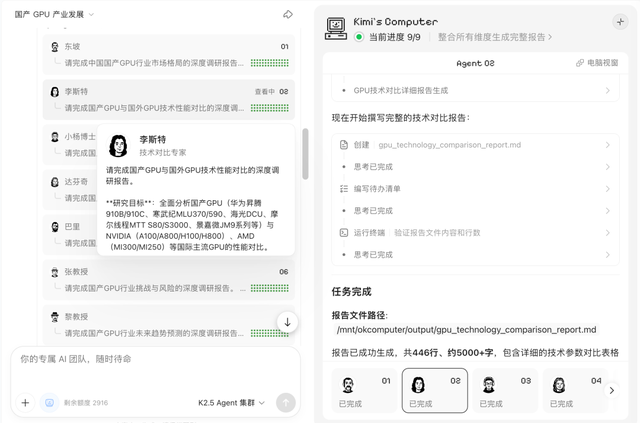

三、Agent 集群:AI 协同作业的范式革命

3.1 从单智能体到集群智能

K2.5 首创 Agent Swarm(智能体集群) 机制,允许模型在执行复杂任务时动态创建并调度上百个专业化Agent,实现类人类团队的分工协作 [[1]]:

典型工作流:

用户请求:「分析这份财报并生成PPT」

↓

K2.5 主控Agent 自动拆解任务:

├─ 财务分析师Agent → 提取关键指标

├─ 可视化专家Agent → 生成图表

├─ 文案策划Agent → 撰写解读文案

├─ 设计师Agent → 排版PPT模板

└─ 质检Agent → 校验数据一致性

↓

集群协同输出完整交付物

3.2 1500次并行工具调用

K2.5 支持高达 1500 次并行工具调用,远超同类模型(通常<100次)[[3]]。这意味着:

- 可同时爬取数百个网页进行信息聚合

- 并行执行多语言代码测试与调试

- 实时监控多个数据源并触发联动操作

实测场景:用户要求“对比10家竞品官网的定价策略”,K2.5 集群在90秒内完成:10个Agent并行抓取页面 → 5个Agent提取定价数据 → 3个Agent生成对比表格 → 1个Agent输出战略建议。

四、技术指标与实测表现

4.1 基准测试对比

| 能力维度 | K2.5 | Gemini 1.5 Pro | Claude 3.5 | 备注 |

|---|---|---|---|---|

| 视觉推理 (MMBench) | 86.2 | 85.7 | 84.9 | 原生多模态优势明显 [[7]] |

| 代码生成 (HumanEval) | 82.4% | 80.1% | 79.3% | 前端领域尤为突出 |

| 长文本理解 (256K) | ✅ 支持 | ✅ 支持 | ⚠️ 200K | 上下文窗口行业领先 |

| 工具调用并发 | 1500 | 100 | 50 | 集群调度能力碾压级 |

4.2 开源与部署

K2.5 已在以下平台开源:

- Hugging Face:

moonshotai/Kimi-K2.5 - ModelScope:

moonshotai/Kimi-K2.5[[39]] - NVIDIA Build: 提供INT4量化版本 [[29]]

部署提示:得益于32B激活参数设计,K2.5 可在单张 RTX 4090(24GB)上以INT4精度流畅运行,推理速度达 45 tokens/s。

六、总结与展望

Kimi K2.5 不仅是参数量的堆砌,更是架构创新与工程落地的结合体:

✅ 原生多模态:真正理解“看”到的内容,而非仅识别文字

✅ Agent集群:从单点智能迈向协同智能,开启AI“社会化”进程

✅ 视觉编程:大幅降低技术门槛,让设计与开发无缝衔接

✅ 高效推理:32B激活参数+INT4量化,平衡性能与成本

未来展望:月之暗面团队已透露 K3 正在研发中,将聚焦更强的推理架构与更复杂的工具生态 [[30]]。随着Agent集群范式的普及,我们或将见证AI从“工具”演进为“团队成员”的历史性转变。

更多推荐

已为社区贡献73条内容

已为社区贡献73条内容

所有评论(0)