为什么90%的AI编程最终会沦为技术债务?揭秘AI编程的底层架构解法

趋势也已经很明确了。可一旦进入真实业务节奏,变化会像潮水一样涌上来:字段会加,规则会改,流程会重排,角色会分层,权限会收紧,日志与审计会补齐,异常与回滚会接连出现。“不仅仅可执行,更能决策”这句话如果翻译成工程语言,就是:动作的触发与执行始终在业务上下文、权限边界、流程规则与数据状态的约束之下进行,很多原本靠逐条确认才能推进的环节,开始更依赖规则与语境自洽完成,同时保留清晰的可追溯与可控边界。单次

Cursor、Trae、Qoder这些AI编程工具普及之后,Vibe Coding几乎成了很多人的默认工作方式:把需求用自然语言描述出来,让模型先给出一版可运行的结果,再在运行结果上不断迭代。页面、接口、表单、流程,几轮对话就能出来一版,速度确实很直观。

这种速度会改变团队的行为方式。以前大家会先谈结构、谈边界、谈排期;现在更容易先把功能跑通,把反馈拿到手,再回头补缺口。问题在于,缺口如果补得太晚,就会从“欠一点规范”变成“欠一整套秩序”。

趋势也已经很明确了。Stack Overflow 2024 的开发者调查里,76% 的受访者表示已经在开发流程中使用或计划使用 AI 工具,62% 表示当年就在用。GitHub 2024 的调研更直接,超过 97% 的受访者表示工作中用过 AI 编码工具。Gartner 的判断也很激进:到 2028 年,90% 的企业软件工程师会使用 AI 代码助手。

但“AI写代码”这件事真正的难点,通常不在第一天。真正让人吃力的,是系统进入第二阶段之后发生的事:开始加权限、开始做多角色、开始接入真实数据、开始处理边缘情况、开始多人协作、开始迭代升级。就在这些时刻,很多团队会突然意识到,自己前期省下的时间,后面会用另一种方式还回去。

这不是个别人的体验。很多讨论里反复出现同一类症状:小改动引发连锁报错,上下文越堆越乱,逻辑互相打架,修复靠反复重生成,最后变成“能跑但不敢动”。技术债务就是在这个阶段被堆出来的。

更麻烦的是,风险不只来自维护成本。Veracode 2025 的 GenAI 代码安全研究给过一组很刺眼的结论:不少看起来“能用”的 AI 生成代码,在安全测试里仍然会失败,并引入常见漏洞。再加上幻觉带来的依赖引用问题,供应链层面的后门风险也会被放大。速度把交付节奏推快了,同时也把问题更早推到台前。

这件事的关键在于边界怎么划:AI负责把意图变成初稿与初速度,系统必须有一套稳定的工程尺度负责结构、边界与治理。没有尺度,生成越快,债堆得越快;有尺度,生成能力才可能沉淀成长期资产。尺度不是装饰,而是让系统在变化里仍然可控的前置条件。

这篇文章不讨论某个工具“好不好用”,只讨论一个更实际的问题:当 Vibe Coding 成为常态,怎样让系统底层逻辑保持确定性,避免90%的AI编程最终走向技术债务。

AI编程为什么更容易堆出技术债

用AI写代码的问题,很多时候不是“写得对不对”,而是“能不能长期活”。早期系统小、约束少,AI生成的东西能跑就够了。可一旦进入真实业务节奏,变化会像潮水一样涌上来:字段会加,规则会改,流程会重排,角色会分层,权限会收紧,日志与审计会补齐,异常与回滚会接连出现。

如果系统没有一套清晰的结构与边界,变化就不会“有序进入系统”,而是“随机撞进代码”。这时技术债务就开始变成一种必然结果。

一次性代码陷阱:牵一发而动全身

AI更擅长把局部问题写成可运行的片段,却很难主动维护一个系统的全局结构。于是开发初期会出现一个很典型的现象:每个功能都能独立跑,拼在一起也能暂时跑。看起来很顺。

可当你开始加细粒度权限、开始引入状态流转、开始把审计留痕做严、开始把异常处理做完整,问题就会出现。如果早期没有清晰分层与稳定边界,AI很容易把数据查询、权限判断、视图渲染、流程控制揉在一起。短期能跑,长期会变成一团纠缠的线。

你想加一个字段,结果影响三处;你想改一个规则,结果牵出一串副作用;你想做一次重构,发现根本不知道该从哪里拆。系统不是改不动,而是每一次改动都像在赌运气。

审查疲劳:黑盒越深,风险越大

AI擅长写局部函数,不擅长把一个系统“组织得可解释”。项目越大,生成出来的代码越像黑盒:能跑,但很难一眼看出它为什么这么跑。

当产出速度超过人类阅读吞吐,审核就会先变成形式动作,再变成默认放行。审查疲劳不是态度问题,是吞吐量硬上限。风险往往不是来自一个明显的错误,而是来自长期的“看不完、先合了再说”。

这也是为什么安全问题会在AI编程普及后变得更敏感:越权校验、输入校验、依赖引用、数据脱敏这些位置,一旦上下文理解偏差,漏洞不一定显眼,却会非常致命。

幻觉与供应链:看起来正常,实际上埋雷

AI生成代码常见的一个坑,是引用不存在的依赖库或错误的接口版本。表面上像是“编译问题”,但放到企业环境里,这可能会变成供应链攻击的入口。

更现实的一点是,很多团队在赶进度时会先追求“跑起来”,依赖引入与版本治理会被延后。等到某次上线或某次升级触发了问题,排查成本会高得离谱。

Token黑洞:盲猜式重生成把钱和时间一起烧掉

缺少边界的生成模式还有一个很现实的副作用:一旦报错,开发者很难定位“应该改哪里”。于是最常见的动作变成“再生成一次”。

每一次重生成,都意味着大模型要重新读取上下文、重新推理、重新拼装。上下文越大,代价越高。项目越复杂,这种盲猜式重构就越像一个Token黑洞:钱在烧、时间在烧、注意力也在烧。

职业定位的滑落:从建系统的人变成修补的人

如果开发者只是拼凑AI产出的碎片代码,很容易从“掌控系统的人”变成“不断审核与修补的人”。短期看起来在提效,长期却在丢掉最核心的能力:对数据模型、边界与演进路径的把控。

AI时代的竞争力不是写出能跑的代码,而是让系统在变化里仍然可控。能守住结构的人,会越来越值钱。

确定性秩序缺失,才是Vibe Coding落地难的根本原因

传统软件工程强调确定性逻辑,AI带来的是概率性输出。如果让AI在缺少规则与约束的环境里自由生成,产出的代码很难长期满足核心业务的稳定要求。

很多团队其实不是不知道要“写规范”,而是节奏太快、变化太多,规范很容易被挤到后面。等到系统变大,想补规范的成本就会越来越高。

要把问题真正压下去,核心不是让AI更聪明,而是让系统更有尺度:边界先清楚,契约先稳定,治理先默认。这样生成能力才不会把系统带偏。

Oinone把工程尺度前置到生成之前

Oinone更适合被理解为框架级的工程底座。可以用一句更直白的话概括:AI负责速度,Oinone负责尺度。

所谓尺度,说的不是“更严格的代码风格”,而是更关键的三件事:结构先出现、边界先稳定、治理先默认。这样做的结果不是让人慢下来,而是让系统稳下来。

从提示到可演进的专业代码

Vibe Coding最常见的后遗症是“难维护”和“黑盒”。如果系统一开始就缺少分层与契约,生成越多,黑盒越深。

Oinone的框架思路更像是把一条跑道先铺好:生成可以快,但生成之后要落在可解释的结构里。开发者写出来的不是一堆零散片段,而是有边界、有契约、能演进的工程资产。

开源生态:让模型更快学会“怎么写得像一个系统”

光靠提示词,很难让模型稳定地产出“结构一致”的代码。更现实的办法,是让模型有足够明确的范式参考。

开源生态的价值在这里会更明显:规则、范式、结构本身是公开可学习的。模型不是每次都从零猜,而是能更快对齐到同一套开发方式。

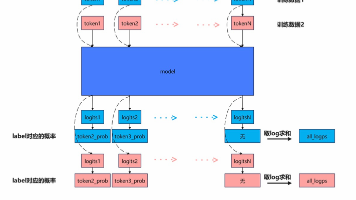

元数据驱动:把盲猜压到更小

盲猜式重生成的根源,是上下文太大、边界太模糊。元数据驱动的意义,是让业务语义、关系与约束显性化,让生成更容易命中目标。

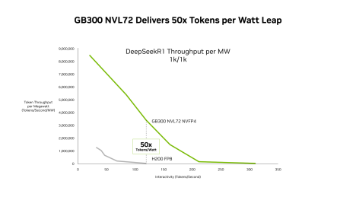

命中率提高之后,反复重生成会减少,盲猜式重构也会被压下去。所谓“减少60%无效Token消耗”,指的就是这类效果:尽量不让模型在无边界的上下文里到处试探,把试错压到更小。

Aino:让智能体在业务语境中运行

很多人用AI编程时的真实感受是:对话框里很聪明,一进业务系统就像外部孤岛。它能把代码片段写出来,却很难在真实业务语义、权限边界、流程约束里稳定地跑起来,更别提把一连串动作编排成一条完整链路。

Aino的定位更接近“企业级智能体”。它强调的不只是会话,也不只是可执行,而是能在业务语境里把判断与动作组织起来。几个关键词可以把它的气质说清楚:100%元数据驱动、本体论快速落地、分钟级完成业务元数据语义定义、语义语境因你而定。

元数据驱动带来的直接变化,是上下文从一坨散乱文本,变成清晰的业务语义与约束。很多原本需要反复解释、反复猜测的细节,被提前写进语义定义里。这样一来,智能体在做动作编排时更像是在遵守规则,而不是在碰运气。

复杂编排是另一块关键能力。单次对话生成一个函数不难,难的是把多个动作串成一条能长期复用的业务链路:先判断、再校验、再变更、再通知、再记录。Aino更关注的是让这种链路在系统里变得可组织、可复用、可追溯。

“不仅仅可执行,更能决策”这句话如果翻译成工程语言,就是:动作的触发与执行始终在业务上下文、权限边界、流程规则与数据状态的约束之下进行,很多原本靠逐条确认才能推进的环节,开始更依赖规则与语境自洽完成,同时保留清晰的可追溯与可控边界。

另外一个经常被忽略的点是工具能力。真正让智能体在系统里跑起来,离不开工具调用与扩展机制。Aino强调内置工具、MCP、自定义工具、开箱即用的工具体系,本质上是在解决“会说但不会做”的落差,让智能体可以在受控边界内完成动作与系统操作的衔接。

FAQ

为什么AI写的系统前期极快,后期却完全改不动

前期快来自局部实现的快速生成,后期改不动来自全局结构的缺失。模块越多,边界越模糊,依赖越缠绕。需求微小变更会引发连锁反应,团队开始不敢动。工程尺度的意义就在于让变化沿着边界扩散,模块契约稳定,回归范围可控。

AI经常产生幻觉或留下隐性漏洞,天天疲于审查怎么办

当产出超过阅读吞吐,审查会退化。更可靠的办法是让治理边界成为默认约束,让权限与安全规则在执行链路中自动生效,让风险更难被放大。

现有AI助手像外部孤岛,怎么让它真正懂业务并执行动作

孤岛的问题不是对话能力不足,而是业务语境不一致。懂业务意味着能理解数据结构、流程语义、状态边界,也意味着执行动作必须受权限与安全规则约束。当智能体处在系统内部的同一套语境里,建议才更可靠,动作才更可控。

给一个更实际的判断标准。

Vibe Coding会继续普及,生成会越来越便宜。真正的分水岭会从“能不能生成”转向“生成之后能不能维护、能不能交付、能不能升级”。

判断一个团队是不是被技术债拖住,可以看三个信号:变更是否总是牵一发而动全身,回归范围是否越来越不可控,高风险模块是否越来越多、越来越没人敢碰。三个信号只要出现两个,系统基本已经进入“看起来在跑,其实在透支”的阶段。

如果缺少工程尺度,生成越快,技术债越快堆成垃圾场;如果工程尺度与治理边界先站住,生成能力才可能沉淀成长期资产。Oinone提供的,是让结构、边界与治理更早出现,让系统在变化里仍然可控。

为什么把 Vibe Coding 和 Oinone 组合在一起,往往是更好的搭配

Vibe Coding擅长的是把意图迅速翻译成“第一版可运行的东西”。它解决的是起步速度、表达成本、试错效率。可它不擅长替团队长期维护边界,也不擅长替系统长期守住结构。

Oinone的低代码能力更像把系统的骨架先搭好:数据模型、权限、流程、页面组织方式、模块边界、治理规则这些东西先有一个稳定形态。这样一来,Vibe Coding生成的不再是一堆散落片段,而更容易落在可解释的结构里。前期照样快,后期不至于越改越怕。

两者放在一起的关键,不是把AI当成“写代码机器”,也不是把低代码当成“做页面工具”,而是把各自最擅长的部分分开:意图与初稿交给 Vibe Coding,结构与边界交给 Oinone。这样做能同时换回三件事:修改更可控,升级更可走,交付更可复用。

当团队进入多人协作、规则组合爆炸、权限越来越细、版本需要长期演进的阶段,这种组合的优势会更明显:生成能力继续提供速度,工程尺度继续提供确定性。速度和确定性同时成立,才是AI编程真正能进入长期使用区的前提。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)