“基于Test Time Adaption的ORSI-SOD方法”——解决domain shift和图像质量退化问题【学习笔记】

原文链接:

Ⅰ Abstract

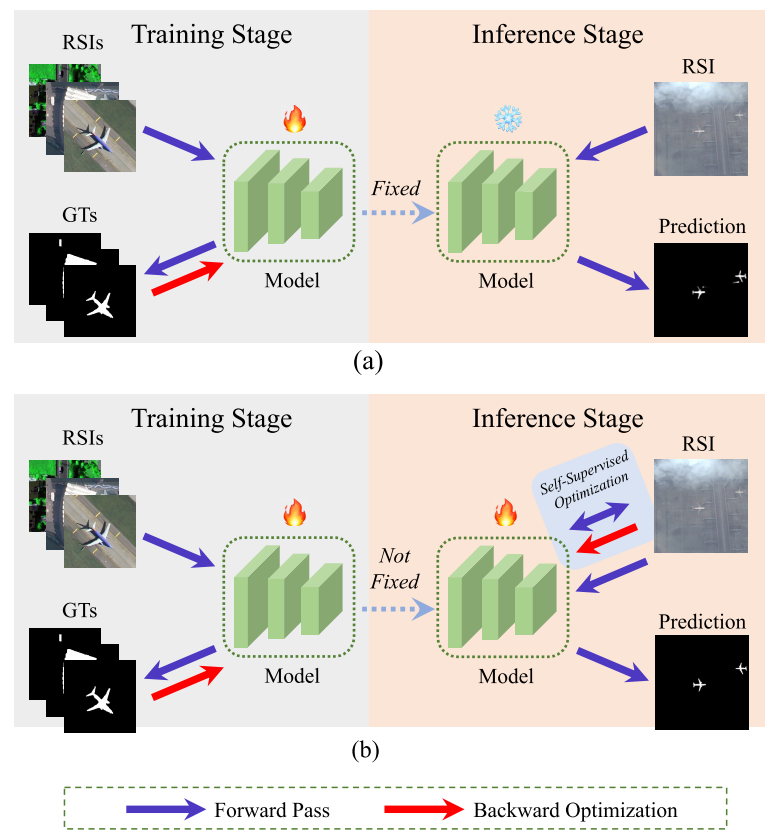

现有的光学遥感图像显著目标检测(RSI-SOD)方法严格遵循传统的"有监督训练-测试"模式,即模型在训练后保持不变并直接应用于测试样本,但由于遥感场景固有的多变性,这种模式在适应test-time图像方面面临着巨大的挑战。显著目标在大小、类型和拓扑结构上都表现出很大的差异,这使得在未见过的测试图像中进行精确定位变得复杂。此外,遥感图像的获取非常容易受到大气条件的影响,通常会导致图像质量下降以及训练和测试阶段之间的显著域偏移。

本文探讨了ORSI-SOD的测试时间模型自适应(test-time model adaptation),并引入了一种新的多任务协作方法来应对这些挑战。具体通过集成了一个自我监督的辅助任务(图像重建),与显着性预测的主要监督任务,实现了协作学习。具体架构包括一个共享的功能编码器和两个不同的任务特定的解码器。

最重要的是,自监督图像重建任务(辅助任务)使用未标记的test-time图像优化模型参数以实现灵活的场景相关表示学习。此外,本文提出了一个跨任务调制模块(cross-task modulation module,CMM),它位于两个任务特定解码器之间,充分利用不同任务间的相关性来增强显著性表征的调整。

Ⅱ Introduction

基于深度神经网络的方法可以从有标签的遥感图像中学习到具有判别性的表示并推广到具有挑战性的情况。大多数工作都集中在设计多尺度特征集成策略,从多分辨率输入中提取多尺度表示,并采用嵌套结构从深层到浅层逐步融合尺度感知表示,在多尺度特征集成的基础上,通过长距离上下文建模建立全局关系依赖,以解决尺度变化问题并消除杂乱背景的干扰。

本文的方法使用了测试时自适应(Test Time Adaption,TTA)策略,该策略在测试时微调网络参数并提高最终的推理精度。未标记的遥感图像虽然不能直接有助于监督框架中的模型优化,但是可以通过自监督学习(SSL)技术促进模型调整。

SSL的最新进展使用各种信号进行监督,例如旋转角度,补丁索引,聚类伪标签和实例级标签。这些方法通常依赖于图像级或区域级信号,这对于需要判别像素级表示的ORSI-SOD任务来说是次优的。另一种方法,掩膜图像建模(Masked image modeling,MIM),通过模糊图像块的部分,并利用可见的片段来预测模糊的像素内容。然而,由于遥感图像在某些掩蔽区域内可能包含高度变化的可能性,所以MIM在学习可靠的像素级表示方面的有效性是有限的,特别是对于包含广泛视图。

因此,这项工作中转向一个简单直观的自监督任务——图像重建。该图像重建任务可以从数据中学习信息丰富的位置感知表示,并进一步与显着性预测任务合作。通过将图像重建作为辅助任务,模型有效地调整了对测试期间特定细微差别的响应,提高了对不同测试场景的鲁棒性。

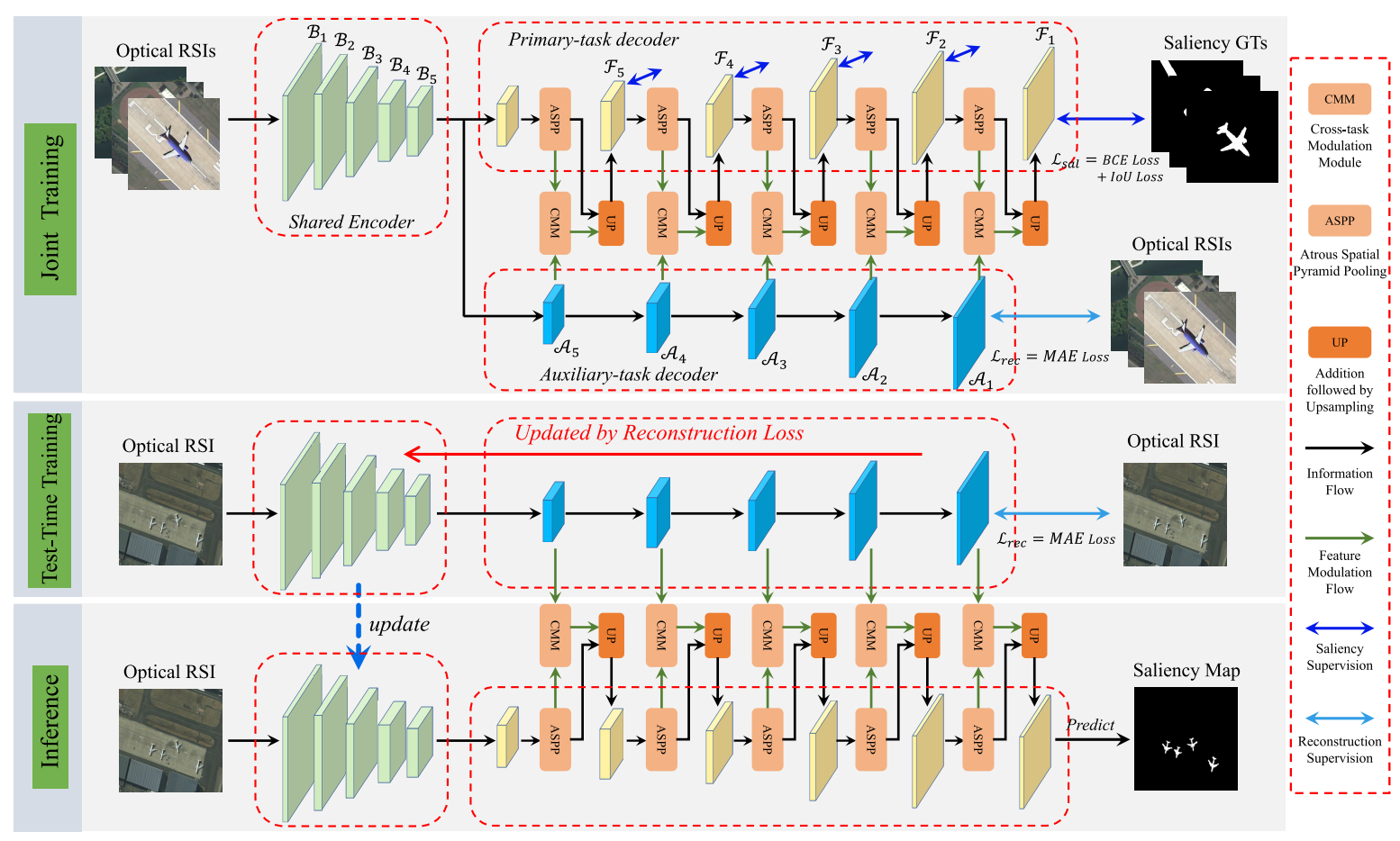

首先,在训练过程中,整个架构,包括共享编码器、两个子解码器和CMM,都将以标准的监督方式使用显著性和重构损失进行优化。

其次在推理之前,模型将经历测试时间训练(TTT)阶段,其中共享编码器和重构解码器将根据重构损失进行微调。

最后,在推理阶段,更新后的模型通过CMM进一步使用任务间相关性来生成最终的显著性预测。

Ⅲ Methodologies

工作流程包含了3个不同的阶段:①训练阶段:使用标准的监督学习框架,其被定制以实现多任务学习目标;②Test Time Training阶段:在训练之后和在推理之前,实施TTT,根据测试光学RSI输入进行微调其中模型的参数,包括共享编码器和并行任务解码器的参数;③推理阶段:使用调整后的模型参数进行显著性预测。

网络结构由4部分组成:①共享的特征提取编码器:专门用于从输入的RSI中提取基本特征表示,然后将其输入到双解码器中;②主任务解码器:负责显著性目标检测、③辅助任务解码器:负责图像重建;④CMM:促进主要任务解码器和辅助任务解码器之间的交互。

采用VGG-16作为共享编码器来提取多尺度基本特征表示:假设我们有一个输入图像 I ,可以从编码器中获得多级表示{Bi} ,其中Bi的空间分辨率为(H/2 i−1)×(W/2 i−1),i表示层索引。以上的编码器表示被馈送到双解码器,以分别完成SOD和图像重建。联合多任务学习有助于在训练阶段进行全面的特征提取。最重要的是,在测试期间,可以通过自监督图像重建目标来优化并行任务解码器沿着共享编码器。时间更新根据新的测试RSI调整模型参数,提高了其对各种具有挑战性的RSI场景的适应性。

(1)用于显著性预测的主任务解码器

主任务解码器旨在完成SOD。遵循U-Net设计,构建了一个与编码器结构对称的解码器架构。在相应的编码器和解码器层之间引入跳跃连接以增强功能。(为了简单起见,网络结构图中省略了跳跃连接)

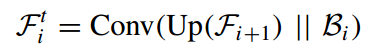

假设解码器网络的特征表示被表示为{Fi},其中i表示层索引。来自解码器的上层(i + 1)的表示是×2上采样的,然后与当前级别(i)的编码器表示连接。具有批量归一化和ReLU的卷积层被应用于级联表示以进行特征变换。该过程可以是表示如下:

其中i是当前层索引,Fi+1表示来自解码器的上层表示,||表示沿着通道维度的级联,Up表示双线性上采样函数,Conv表示卷积层,然后是批量归一化和ReLU激活。

卷积层提取的特征表示来自有限的感受野,缺乏处理不同对象尺度的能力。因此,受语义分割方法的启发,使用atrous空间金字塔池化(ASPP)来扩大感受野,在每个网络层中捕获广泛的上下文信息。该过程表示为:

![]()

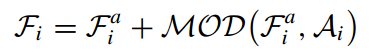

先前的TTT方法仅优化了导出多任务解码器结构的共享编码器部分。然而,多任务解码器之间的协作缺乏探索,这可能会阻碍RSI-SOD的进一步改进。在本文中,首先使用Fai调制辅助任务特征Ai,然后将调制后的表示转移到主任务部分以补充其表示。调制过程可以表示为:

其中,Ai是来自主任务解码器的特征表示,MOD表示特征调制函数。同时采用多级监督来监督每个解码器级别的Fi的学习。最终的显著性输出是从主任务解码器的最后一层,即F1预测的。

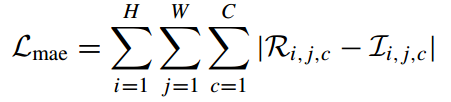

(2)用于图像重建的辅助任务解码器

辅助任务解码器旨在完成图像重建任务,它可以为SOD学习额外的和补充的特征表示。与主任务解码器类似,采用具有跳过连接的U形结构作为解码器结构。将辅助任务解码器的特征表示表示表示为{Ai},解码过程可以简单地表示为:

![]()

其中Ai和Ai+1分别表示并行任务解码器的当前级和上级表示,||表示沿着通道维度的级联,up表示双线性上采样,Conv表示卷积层,然后是批量归一化和ReLU激活。

在辅助任务解码器的最后一层之后添加预测层(3 × 3卷积),以产生重建输出R ∈ R H×W×C,在重建分支中采用简单且标准的解码结构来检查多任务学习和测试时自适应的有效性。可以结合更复杂的结构以进一步提高性能。

(3)跨任务调制

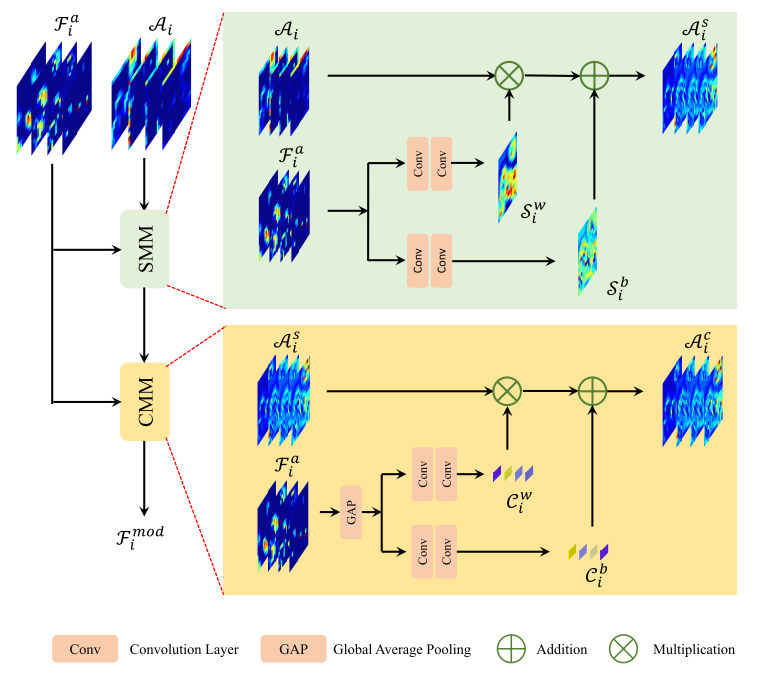

使用共享编码器和双流解码器(即Y结构)的多任务学习可以促进更普遍和全面的特征提取。此外,辅助任务,即自监督图像重建,可以用于在测试期间微调共享编码器。Y结构在TTT范例中被广泛采用,然而,这种架构对于SOD来说可能是次优的,因为单独的多流解码器不能有效地协作,并且对于主要任务,没有充分利用附加任务流中的细粒度像素级表示。为了缓解这个问题,在Y结构的基础上引入了一种CMM,它根据主任务特征分布来调节辅助任务特征,并将它们集成以增强显著性预测。具体地说,CMM沿空间和通道维度两者调制辅助任务特征。

CMM的流水线如图所示:

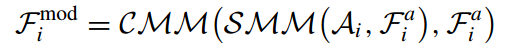

整个调制过程可以表示为:

其中SMM和CMM分别表示在空间域和信道域中基于Y分布的调制X:

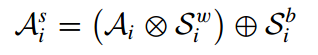

①空间调制:该算法的目标是根据主任务特征的空间分布对主任务特征进行调制,将Fai送入两个独立的卷积层,生成weight map-S w i (H*W*1)和bias map-S b i(H*W*1),接下来,利用权重和偏置图来调整并行任务特征,如下所示:

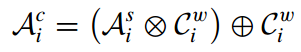

②通道调制:目标是根据主任务特征的信道分布来调制主任务特征。首先,对Fai进行平均池化,生成全局通道描述符Gi(1*1*C),接下来,Gi被馈送到两个单独的1 × 1卷积层,以分别产生权重向量C w i (1*1*C)和偏置向量C b i (1*1*C)。最后,通过以下过程在信道域中调制As i:

Ⅳ 模型优化

(1)多任务学习目标

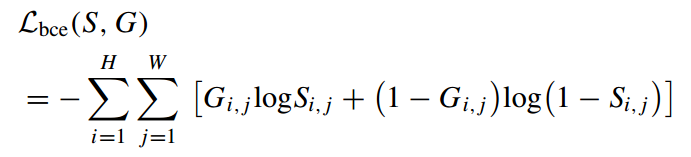

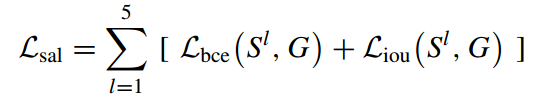

①显著目标检测:采用混合损失函数,包括二进制交叉熵损失(BCE)和交并比损失(IoU),来优化SOD任务:

主任务解码器可以获得每个网络级别的五个显著性输出{Sl} 5l =1,它们分别通过将预测层(卷积和上采样操作)应用于Fi而生成。因此,总损失为:

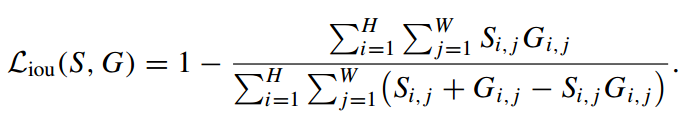

②图像重建:采用平均绝对误差(MAE)作为损失函数来监督图像重建任务。重建损失计算为:

(2)训练期间的优化

在训练过程中,整个架构以端到端的方式进行优化,通过多任务学习目标同时优化主任务和辅助任务,其表达如下:

![]()

其中γ是控制重建损失比率的超参数。

(3)TTT期间的优化

在训练之后和推理之前,进行TTT,其中模型的参数基于新的测试RSI进行微调。具体来说,通过图像重建损失来优化共享编码器和辅助任务解码器的参数。学习目标可以表示为:

TTT使网络能够调整其参数以适应特定的测试样本。最后,在推理时,输入通过更新的编码器和主任务解码器转发以生成显著性图。最重要的是,来自辅助任务解码器的表征被调制并集成到主任务解码器中,从而有利于最终的显著性预测。

Ⅳ Experiments

数据集:ORSSD,EORSSD,ORSI-4199

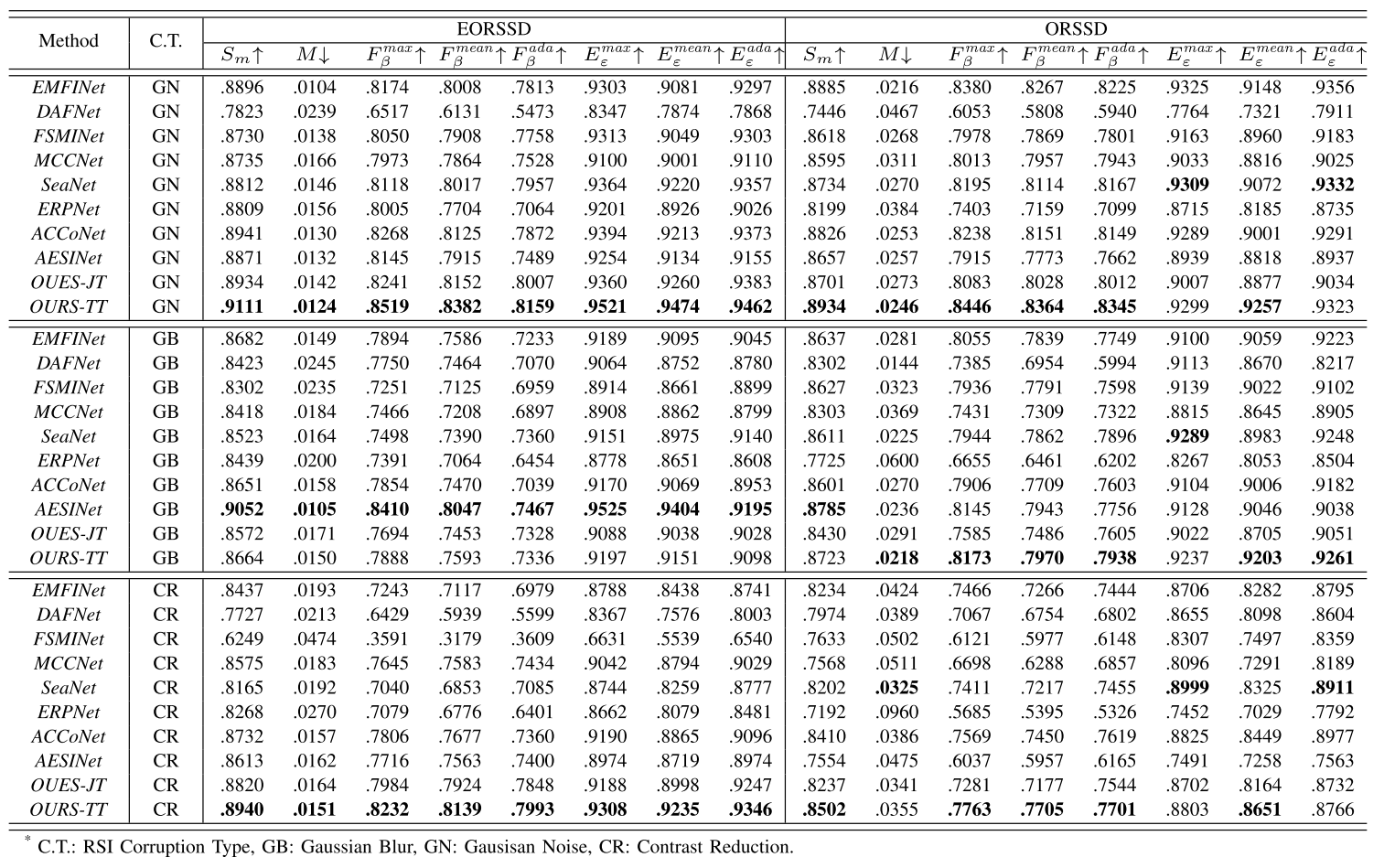

此外,为了更好地评估所提出的方法的鲁棒性,构建了受损的ORSI数据集来模拟遥感图像中的现实挑战,在EORSSD和ORSSD的测试集副本上生成三种典型类型的损坏,包括高斯模糊(GB),高斯噪声(GN)和对比度降低(CR)。

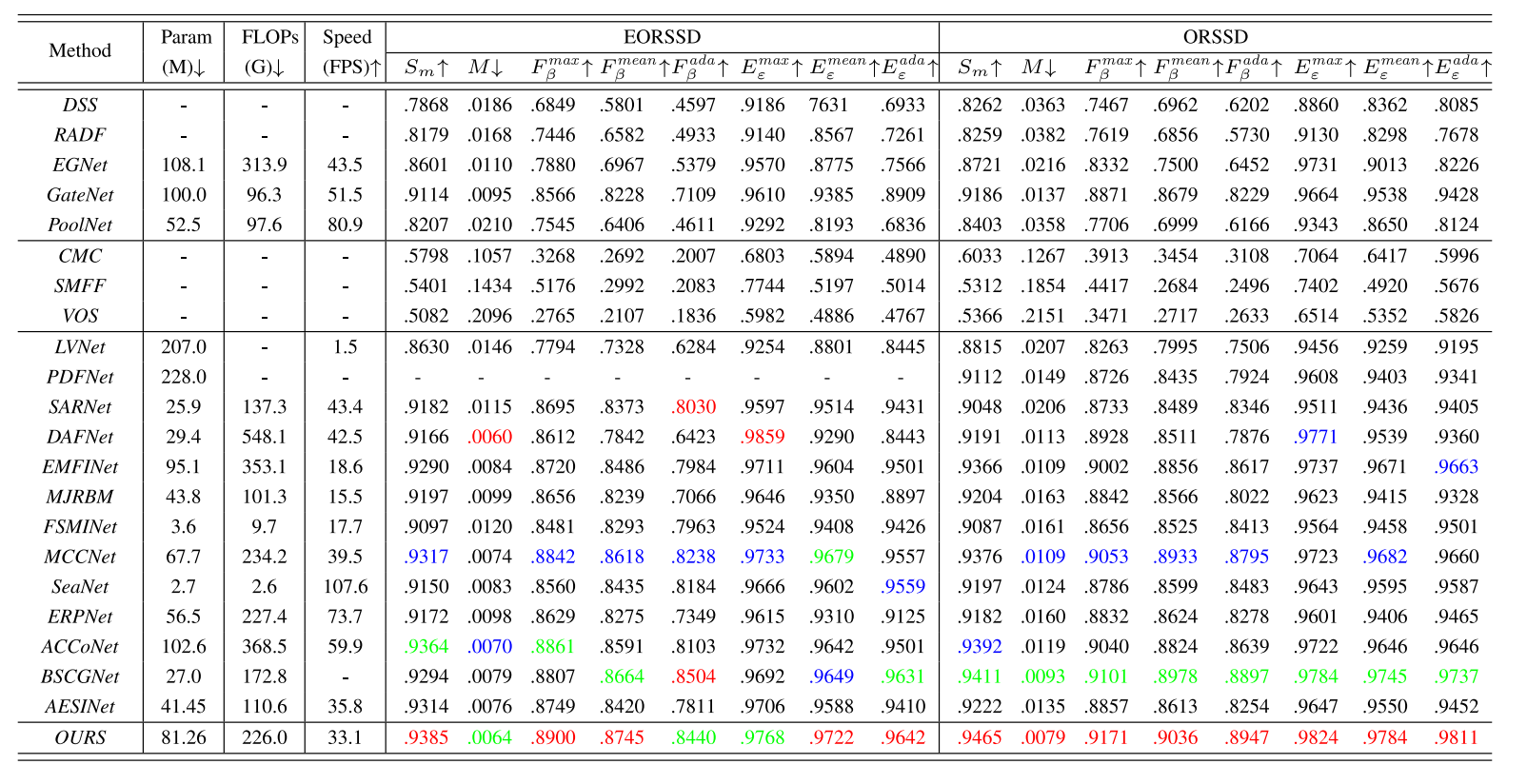

①定量比较

尽管本文架构采用了多分支、多任务设计,导致了81.26 M的可观参数计数,但它在FLOP(226.0 G)和FPS(33.1)方面保持了竞争力的平衡。这使得它在计算效率方面处于基于深度学习的方法的中间范围。

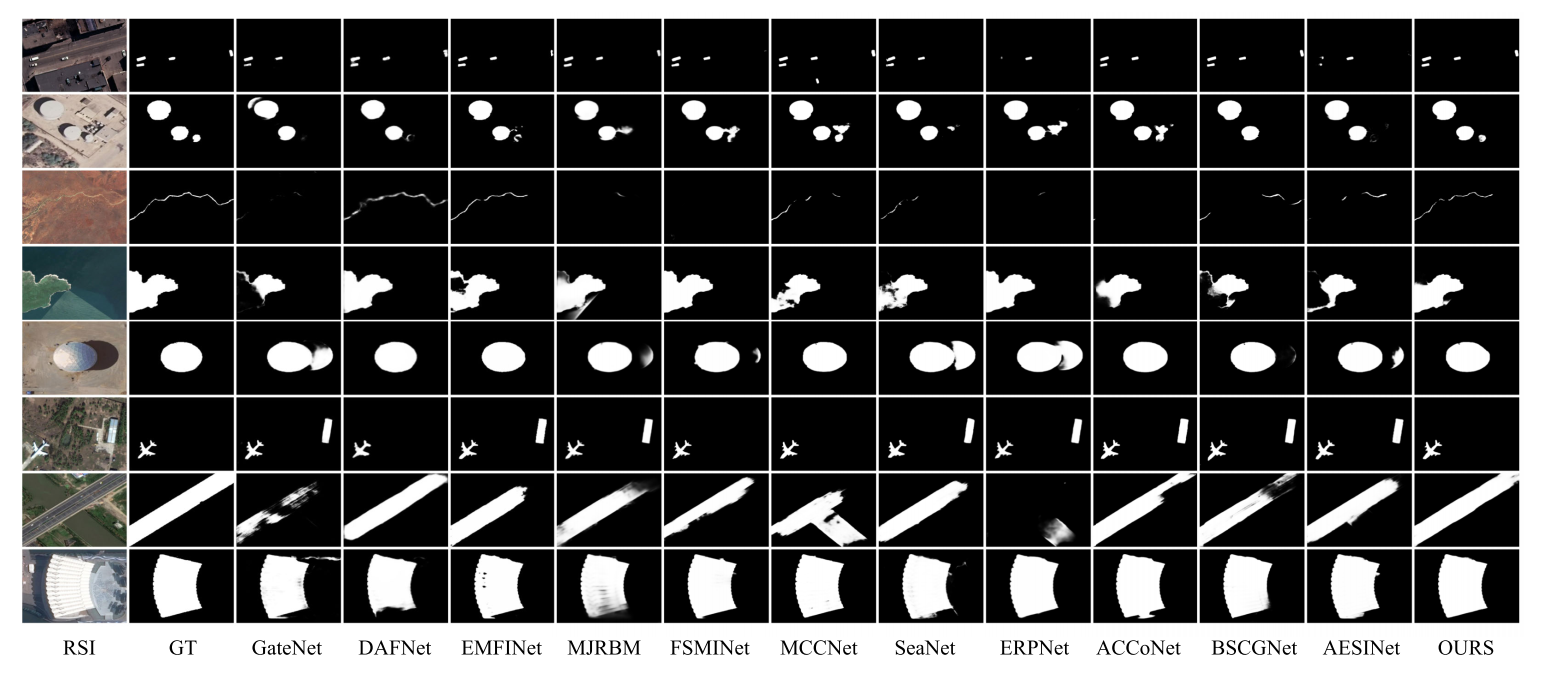

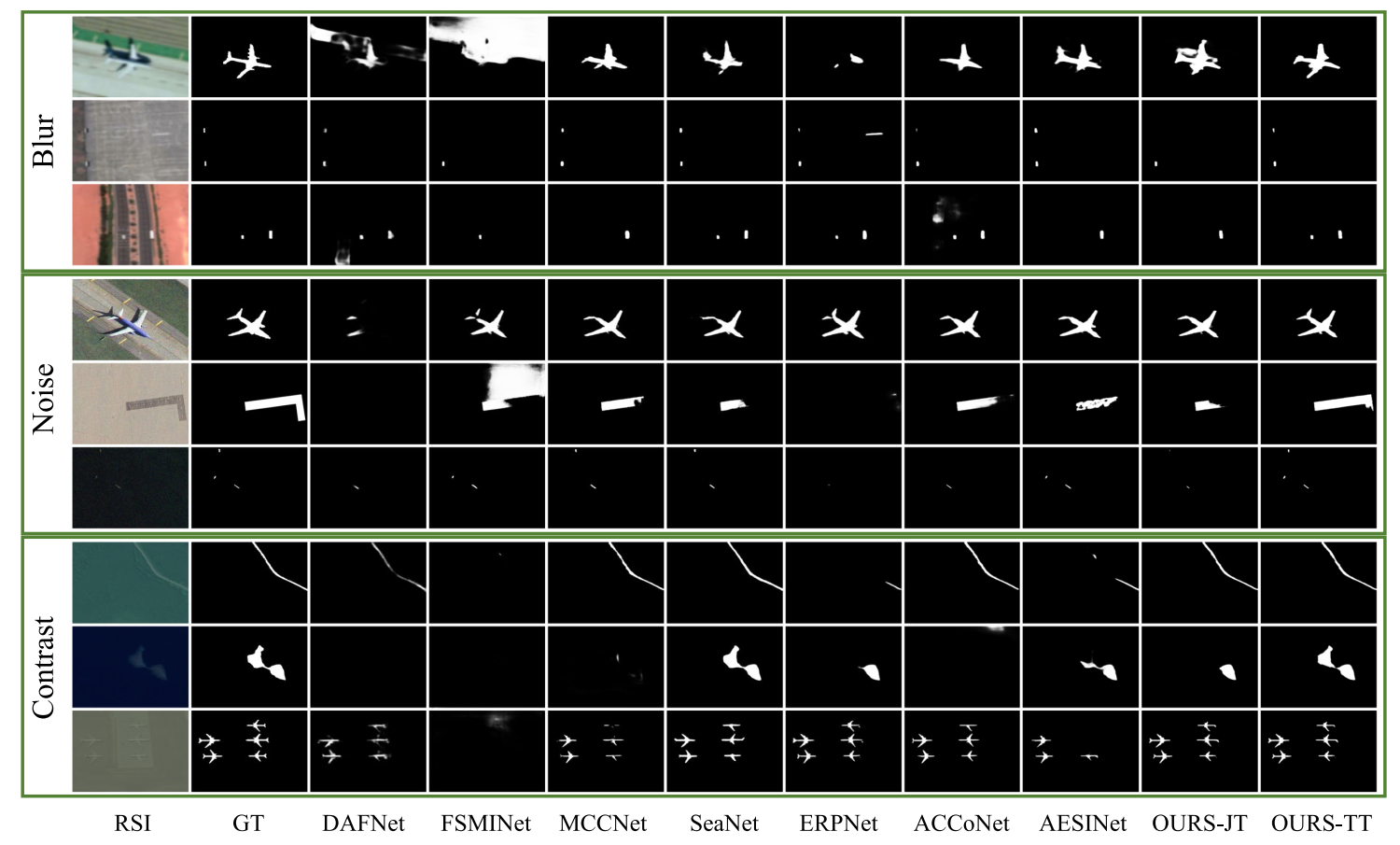

②可视化比较

一、二行:多个小物体;三、四行:复杂结构;五、六行:强背景干扰;七、八:大对象区域。

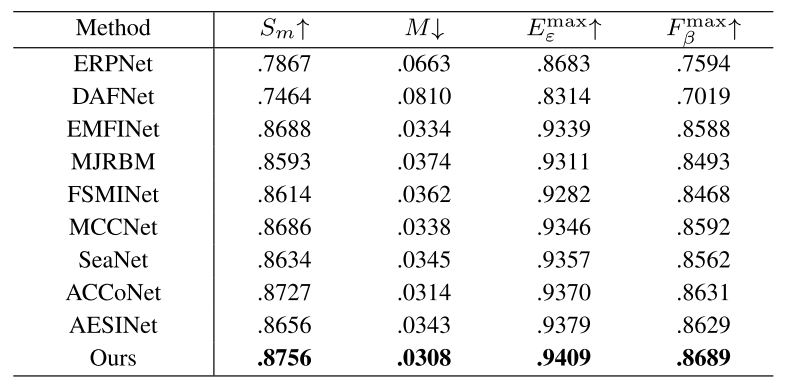

③受损ORSI数据实验

这些损坏的数据是使用三种典型的损坏(即GB,GN和CR)生成的,以模拟真实的,具有挑战性的遥感成像条件。在表中提出了本文方法的两个变体,第一个是具有TTA的整个架构,表示为OURS-TT,第二种是没有TTA的整个架构,仅具有多任务联合训练,表示为OURS-JT。

OURS-TT方法在高斯噪声下的EORSSD模型上,在所有8个指标上都取得了最好的结果。OURS-TT在六个指标中均排名第一,保持了其上级性能。本文方法在GB和CR场景中的鲁棒性得到了进一步的证明。在GB损坏的EORSSD上,AESINet优于本文方法和其他比较的方法,这可能是由于它的能力,感知细微的差异时,检测对象的边缘和细节。

OURS-TT的性能在OURS-JT的基础上稳步提高,证明了测试时间自适应的有效性和必要性。由于大多数现有的方法依赖于监督训练范式,没有解决这种分布变化的策略,因此它们很难有效地处理损坏的RSI。

④受损ORSI数据的可视化比较

1)GB:由于视觉模糊,大多数方法倾向于丢弃某些对象部分或小对象。相比之下,本文方法在检测不同尺度的对象时可以均匀地突出显著区域。

2)GN:虽然其他优秀的方法,如ACCoNet和AESINet,受到噪声的负面影响,但本文方法仍然可以清晰地弹出整个显著区域。

3)CR:由于缺乏对比度,现有方法难以突出组成显著区域。

尽管如此,本文方法在各种情况下,包括复杂的拓扑结构和多个微小物体,都表现出了出色的性能。此外,OURS-TT在视觉质量上大大提高了OURS-JT,证明了本文方法中采用的测试时间自适应策略的有效性。

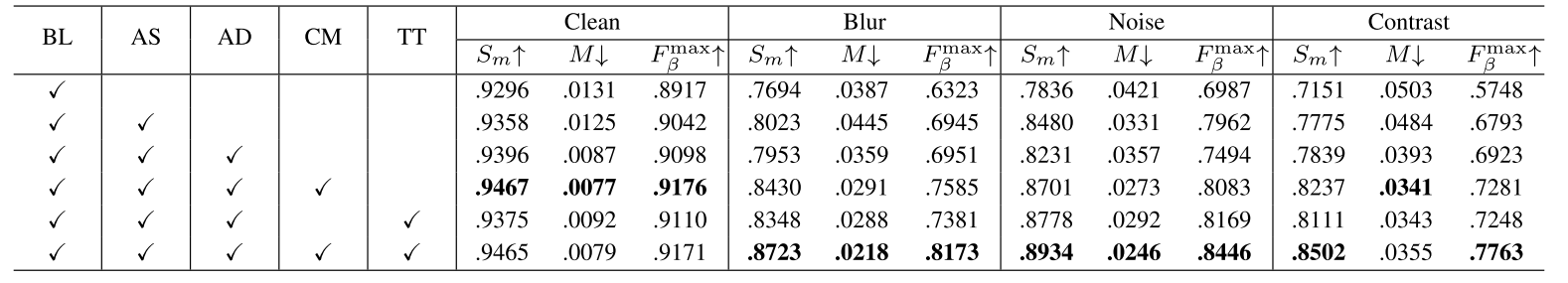

⑤消融实验

在干净和损坏的ORSSD数据集上进行消融实验以验证本文方法中的每个关键组件的有效性。

“BL”表示仅具有共享编码器和主任务解码器的U形基线。“AS”表示集成到主任务解码中的ASPP模块。“AD”表示用于ORSI重构的并行辅助任务解码器。“CM”表示CMM。“TT”表示在最终推理之前执行的测试时训练步骤。

值得注意的是,第五行和第六行展示了在最终推断之前应用TTT的结果,可以观察到TTT对干净的RSI数据具有较小的影响,同时对损坏的数据具有显著影响。这证明了TTT在处理遥感场景中严重的图像条件退化方面的重要性。

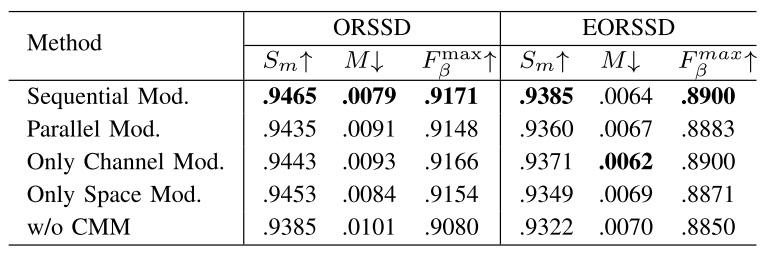

⑥CMM中的消融实验

实验在干净的数据集上进行,研究了CMM的四种变体,包括:顺序空间和通道调制(“顺序调制”,本文架构)、并行空间和通道调制(“并行调制”)、仅空间调制(“仅空间调制”)和仅通道调制(“仅信道调制”)。

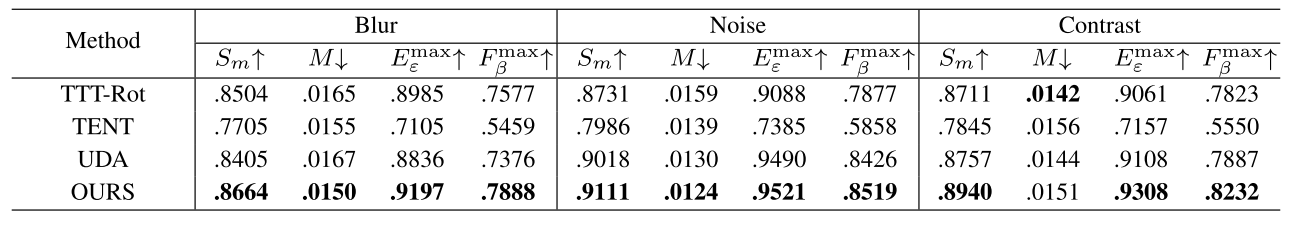

⑦与其他TTT方法的比较

将本文方法与其他流行的TTT方法进行了比较,包括TTT-Rot,TENT和UDA ,对损坏的EORSSD数据集进行了定量评估。

未来的研究可能会集中在开发更复杂的模型来增强测试时的适应性,并将其扩展到多模态图像。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)