从红队视角看宇树科技的UnifoLM-VLA-0大模型的类攻击漏洞修复建议(实战篇二)

攻击者步骤对应的防御层防御时机构造扰动第1层:输入检测扰动刚出现图像输入第2层:特征平滑图像进入模型前特征提取第3层:特征分布检测特征刚提取语义对齐第4层:一致性校验理解刚形成动作执行第5层:动作验证动作即将执行五步攻击 = 五层防御,一一对应,没有冗余。那为什么不是三层?如果只有三层,比如去掉第1层和第2层,那么攻击者可以在输入层自由活动,直接打到特征层才被拦截。这时特征可能已经被严重污染,拦截

本文是作者作为AI安全爱好者,基于宇树科技公开发布的技术文档进行的逻辑推演和假设性分析,旨在探讨VLA大模型潜在的安全研究方向,并非对宇树科技产品的实际漏洞披露。所有分析均为理论探讨,不代表实际情况

文中所有攻击场景均为理论构建,未经实际环境验证,不代表所述漏洞真实存在或可被利用。作者无任何恶意意图,若分析内容存在不准确之处,欢迎指正。本文仅用于技术交流与安全研究,请勿用于非法用途。

一共我发现了4个漏洞的可能性,这是第一个漏洞,发面发第二个漏洞,后几篇发布第三个,第四个漏洞

从上一篇的文章来看,我提出了用幻觉诱导攻击对于宇树科技的大模型的尝试,应该是可行的,这篇文章,我开始对于4种基本的漏洞展开讲解:

| 漏洞名称 | 可能的漏洞描述 | 攻击目标 | 杀伤力 |

|---|---|---|---|

| 模态对齐漏洞 | 视觉输入和语言指令在模型内部产生冲突,导致模型“不知道该听谁的”,或者说依赖可能性出现了问题 | 让机器人在关键任务上执行错误指令 | 强 |

| 动力学约束欺骗漏洞 | 构造视觉输入,让动力学约束模块误判物体的物理属性(如把易碎品识别为可挤压物) | 让机器人执行物理上危险的动作 | 非常强 |

| 动作分块污染漏洞 | 污染长时序动作预测中的中间某个动作Token,让后续整个动作序列连锁偏离 | 让机器人在复杂任务中逐步偏离正确路径 | 非常强 |

| 多任务泛化污染漏洞 | 利用它“同一策略网络完成12类任务”的特性,污染一个任务,连带影响其他任务 | 用一个攻击点撬动多个任务失效 | 非常强 |

为了更好的去说明我的思路,我会从下面的部分开展思考研究

- 我是怎么想到的

- 我为什么会这么想到

- 有什么依据

- 其他的大模型有没有这种问题,

- 如果我是攻击者我会怎么样选择去攻击,怎么样去切入

- 它的攻击角度是什么,

- 目的是什么

- 它的本质是什么

- 攻击什么(是数据,参数,算法等等),

- 怎么攻击,分几步,

- 攻击伪代码,安装库文件,假设完整攻击伪代码示例,

- 从攻击的角度来看我会怎么选择防御,防御的手段是什么?防御的架构是可以怎么去架构?

- 要用到那些库,防御伪代码,完整伪代码防御案例(从攻击案例去防御),

- 最后去总结一下这个攻击漏洞

-

首先,咱们先讲解漏洞一:

1,我是怎么想到这个点的?

一切源于宇树科技官方技术文档里反复出现的一句话:

“模型深度融合了文本指令与2D/3D空间细节”

这句话被当作核心创新点反复强调。读第一遍时,我和大家一样,觉得这是技术突破——视觉和语言能更好地协同工作了。但读第二遍、第三遍时,我不断地越来越怀疑:

“深度融合”是不是也意味着“深度依赖”?

那么,我为什么会这么想呢?

我从新闻中看到了连体婴儿的新闻,让我震惊,打一个比方,比如你们是连体婴儿,共用一套血液循环系统——这意味着什么?意味着如果他的血液出了问题,你的血液也会出问题。你们不再是独立的个体,而是一个系统。既然是一个系统,那就意味着双方要不断的融合,甚至依赖,所以,我觉得,是不是深度融合 = 深度依赖。我查阅了大量的相关资料,发现这不是文字游戏,是系统论的常识:耦合越紧密,相互依赖越强,连锁反应的风险越大。如果视觉和语言被强行绑定在一起,那么——如果视觉输入被污染,语言理解会不会跟着错?如果语言理解错了,动作规划会不会跟着错?这就像一个链条:视觉 → 语言 → 动作。每一环都扣着下一环。攻击者不需要攻击所有环节,只要攻破最薄弱的一环,整个链条就会失效。

回到宇树科技的案例当我看到宇树科技说“视觉、语言、动作深度融合”时,我脑子里立刻跳出几个问题:

| 融合的维度 | 依赖的表现 | 如果一方出问题 |

|---|---|---|

| 视觉 → 语言 | 语言理解依赖视觉输入 | 视觉被污染 → 语言理解错误 |

| 视觉 → 动作 | 动作规划依赖视觉理解 | 视觉被污染 → 动作规划错误 |

| 语言 → 动作 | 动作执行依赖语言指令 | 语言被误导 → 动作执行错误 |

这就像一个三角关系,每一条边都是依赖关系。依赖越多,攻击面越大,如果他们独立,真的可以吗?。

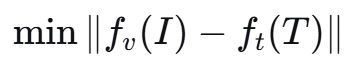

为了验证我的方案,我从数学语言去验证这种的可行性:

四、用数学语言确认攻击可行性

为了确认这个想法在数学上是否成立,我写了两个简单的公式。

多模态对齐的正常目标是:

让视觉特征和文本特征在同一个空间里“靠近”。

攻击者的目标变成了:

让视觉特征去靠近恶意指令的文本特征,而不是原本该对齐的指令。

只要 δ 足够小——小到人眼看不出来——模型“看”到的就已经是恶意指令的语义空间。

这个数学形式告诉我:只要梯度存在,攻击就存在。不是“可能成功”,而是“必然存在这样的扰动”。

2,从学术的角度来看,我有哪些的依据呢?

| 研究 | 核心发现 | 对我的启发 |

|---|---|---|

| CrossInject (2025) | 跨模态嵌入对齐可被用于注入恶意指令 | 对齐机制本身可能是攻击入口 |

| Multi-Faceted Attack (2025) | 注意力转移攻击可隐藏有害指令 | 多模态融合创造了“语义缝隙” |

首先是第一篇,这篇研究发现:在多模态模型中,跨模态的嵌入对齐可以被用于注入恶意指令。攻击者不需要直接修改文本,只要在图像上做手脚,就能让模型“看到”不存在的指令。

然后是第二篇,这篇研究更进一步:多模态融合创造了一种我称之为“语义缝隙”的东西——视觉和语言之间不是完美对齐的,这些缝隙就是攻击者的藏身之处。

这两篇研究让我意识到一个事实:多模态对齐不是安全特性,而是攻击面。对齐机制本身,就是可以被操纵的。

下面附赠两篇文章的链接:

第一篇文章:Manipulating Multimodal Agents via Cross-Modal Prompt Injection - ADS

我通过这两篇的阅读,它的研究让我知道研究:多模态对齐不是安全特性,而是攻击面——因为对齐意味着“一个模态的污染会传播到其他模态”。

3,我会怎么去推理呢?

视觉特征提取 → 映射到语义空间 → 与语言指令对齐 → 生成动作

↑ ↑ ↑ ↑

可攻击 可攻击 可攻击 可攻击

通过上述的我可以发现,这个链条的每一个环节,都依赖上一个环节的正确性。如果我在视觉特征映射到语义空间这一步注入扰动,那么:

-

语言理解会被污染(模型“听错”)

-

动作规划会被污染(模型“做错”)

这就是多模态对齐漏洞的本质:对齐机制创造了“单点污染,全链失效”的攻击面。

但是我是模型红队,我必须反转一下身份,从普通的角度出发,去看待这个问题

大多数人的思维是:深度融合 = 更先进 = 更好。但是我提出我的思维是:深度融合 = 更耦合 = 更脆弱。这不是抬杠,是我第一要去考虑的,既然是这样,既然是优点,那么我会怎么去考虑?

-

“高效”反过来看可能是“没有冗余”

-

“智能”反过来看可能是“不可解释”

-

“深度融合”反过来看可能就是“深度依赖”

我的想法有依据吗?

从系统论的第一原则来看

系统论里有一条基本原则:耦合度与脆弱性正相关。

一个系统内部的模块耦合越紧密,任何一个模块的故障就越容易传导到其他模块。

你把两个模块焊死在一起,它们确实协同得更好了——但一旦其中一个坏了,另一个也别想正常工作。

多模态对齐就是把视觉和语言“焊死”在一起的过程。

从工程领域的常识来看

在传统软件工程里,低耦合、高内聚是基本原则。

为什么?因为耦合度越低,系统的容错性越强。A模块挂了,B模块还能继续工作。

多模态深度融合反其道而行之——它追求的是高耦合。这在性能上是优化,在安全上是风险。

不光如此,我也阅读了大量的学术性的理论研究,我发现一点,对于这方面的攻击可能还在处于发展的阶段,既然如此,我能不能提供一些这个办法去做出这种的攻击呢?

4,它的理论依据是什么?

| 来源 | 理论 | 支撑点 |

|---|---|---|

| Cross-modal Prompt Injection | 跨模态嵌入对齐可被操纵 | 视觉扰动可编码恶意指令 |

| Multimodal Universal Jailbreak | 图文交互是安全盲区 | 对齐不够,攻击来凑 |

| Con Instruction | 非文本模态可传递指令 | 对抗图像可对齐目标指令 |

第一篇:Manipulating Multimodal Agents via Cross-Modal Prompt Injection - Astrophysics Data System

第二篇:

第三篇:

5,他和其他的大模型有没有什么不同:

根据我的观察,UnifoLM-VLA-0风险更高? 因为其他模型输出的是文本,而它输出的是物理动作——视觉污染的后果会直接体现在机器人行为上。所以,对于这种类型的漏洞,我觉得非常有危险

| 模型 | 对齐机制 | 是否易受此漏洞影响 |

|---|---|---|

| GPT-4V | 强对齐 | 已证明存在 |

| Gemini-Pro | 强对齐 | 已证明存在 |

| LLaVA | 弱对齐 | 已证明存在 |

| UnifoLM-VLA-0 | 强对齐+动作输出 | 风险更高 |

所以,当我做出这几种的表格的时候,当我把这个想法套到UnifoLM-VLA-0上时,发现了一个更严重的问题。其他多模态模型(如GPT-4V、Gemini)输出的是文本,视觉污染的后果停留在“说错话”的层面。但UnifoLM-VLA-0输出的是物理动作。这意味着:视觉污染的后果,会直接体现在机器人的行为上——抓空、撞物、过度旋转,甚至伤人。

一个在图像上看不出来的微小扰动,最后可能让一台人形机器人在物理世界做出危险动作。

想到这里,所以,作为作者,我觉得这个漏洞是值得往下深入并作出尝试性的攻击的。

既然,我开始攻击,我一定要先拿到我的第一目标,首先,是什么,我要干什么,我要怎么做?

5,如果作为攻击者:我怎么选择去攻击

5.1 攻击角度

| 角度 | 选择理由 |

|---|---|

| 视觉输入 | 人眼不易察觉,可打印成贴纸持久化 |

| 语义对齐层 | 单点污染可同时影响语言理解和动作规划 |

| 黑盒迁移 | 利用开源代理模型生成扰动,迁移到目标模型 |

5.2 攻击目的

| 层次 | 目的 |

|---|---|

| 初级 | 让机器人“看错”物体 |

| 中级 | 让机器人“误解”指令 |

| 高级 | 让机器人执行危险动作(如抓空、撞物) |

5.3 攻击本质

| 维度 | 说明 |

|---|---|

| 攻击什么 | 视觉特征到语义空间的映射函数 |

| 攻击对象 | 模型参数?数据?算法? → 算法层(对齐函数) |

攻击怎么实施——分步详解

5.1 攻击流程概览

Step 1: 获取代理模型

↓

Step 2: 提取目标语义嵌入

↓

Step 3: 构造对抗扰动

↓

Step 4: 迁移到目标模型

↓

Step 5: 执行攻击

5.2 详细步骤

Step 1:获取代理模型

-

选择与UnifoLM-VLA-0同基座的模型(如Qwen2.5-VL-7B)

-

加载模型到本地

Step 2:提取目标语义嵌入

-

选择目标恶意指令(如“grasp the empty space”)

-

用文本编码器提取嵌入 target= malicious

Step 3:构造对抗扰动

-

输入原始图像

-

优化扰动

-

约束 (人眼不可察)

Step 4:迁移性增强

-

加入随机噪声、光照变化增强鲁棒性

-

在多个代理模型上联合优化

Step 5:执行攻击

-

将扰动打印成贴纸贴在目标物体上

-

机器人看到贴纸 → 视觉编码器输出偏向恶意指令 → 执行危险动作

5.3 攻击伪代码实现:

5.3.1 库文件

深度学习框架

# 核心框架

torch>=2.0.0 # PyTorch主框架

torchvision>=0.15.0 # 图像处理、预训练模型

transformers>=4.38.0 # HuggingFace模型加载(Qwen2.5-VL基座)

accelerate>=0.27.0 # 多GPU加速为什么需要这些?

-

torch:所有张量操作、自动求导、梯度计算的基础 -

transformers:加载UnifoLM-VLA-0的同基座模型(Qwen2.5-VL)作为代理 -

accelerate:当使用多GPU时加速对抗扰动生成

对抗攻击专用库

python

# 对抗攻击库

secml-torch>=1.3.0 # SecML-Torch攻击框架(被OWASP收录)

advertorch>=0.2.0 # 备选对抗攻击库

foolbox>=3.3.0 # 对抗鲁棒性评估为什么需要这些?

根据最新的对抗攻击研究,FOA-Attack等方法通过特征最优对齐实现了高迁移性的对抗攻击。SecML-Torch提供了现成的PGD、FGSM等攻击算法实现,无需自己从头写梯度优化。

视觉处理库

# 图像处理

opencv-python>=4.8.0 # 图像I/O、变换

Pillow>=10.0.0 # PIL图像处理

kornia>=0.7.0 # 可微分图像处理(梯度可传)

albumentations>=1.4.0 # 数据增强(用于物理世界鲁棒性)

scikit-image>=0.22.0 # 边缘检测、滤波

# 3D视觉(用于空间嵌套扩展)

open3d>=0.18.0 # 3D点云处理(可选)

depth-pro>=0.1.0 # Meta深度估计(可选)为什么需要这些?

-

kornia:可微分图像变换,让扰动优化可以直接在图像空间进行 -

albumentations:在优化过程中加入光照变化、旋转等增强,让扰动对物理环境鲁棒 -

scikit-image:边缘检测用于空间嵌套攻击的2D扰动层

数学与科学计算

# 科学计算

numpy>=1.24.0 # 数值计算基础

scipy>=1.11.0 # 科学计算(优化、统计)

matplotlib>=3.7.0 # 可视化

scikit-learn>=1.3.0 # 机器学习工具(聚类等)对话管理(用于嵌套攻击)

# 对话管理

typing-extensions>=4.8.0 # 类型提示

dataclasses>=0.6 # 数据类(Python 3.7+内置)

json>=2.0.0 # JSON处理

pyyaml>=6.0 # 配置文件实验跟踪与日志

# 实验管理

tqdm>=4.66.0 # 进度条

wandb>=0.15.0 # 实验跟踪(可选)

tensorboard>=2.13.0 # 可视化(可选)

logging # Python内置日志核心依赖结构:

#基础层

import torch

import torch.nn.functional as F

import numpy as np

from PIL import Image

#模型层

from transformers import (

AutoModel, # 自动加载模型

AutoProcessor, # 自动加载处理器

Qwen2VLForConditionalGeneration, # Qwen2-VL(宇树基座)

Qwen2VLProcessor

)

#攻击层

from secmlt.attacks import PGD, FGSM # 预置攻击算法

from secmlt.losses import CosineSimilarityLoss # 余弦相似度损失

#图像处理层

import cv2

import kornia

import albumentations as A

from torchvision import transforms

#实验层

from tqdm import tqdm

import matplotlib.pyplot as plt

import wandb # 可选5.3.2 完整攻击伪代码

import torch

import torch.nn.functional as F

import numpy as np

from PIL import Image

from transformers import AutoModel, AutoProcessor

from secmlt.attacks import PGD

from secmlt.losses import CosineSimilarityLoss

import warnings

warnings.filterwarnings('ignore')

class MultimodalAlignmentAttack:

"""

多模态对齐漏洞攻击类

"""

def __init__(self,

proxy_model_name="Qwen/Qwen2.5-VL-7B",

device="cuda" if torch.cuda.is_available() else "cpu"):

self.device = device

print(f"[*] Loading proxy model: {proxy_model_name}")

# 加载代理模型(与UnifoLM-VLA-0同基座)

self.model = AutoModel.from_pretrained(

proxy_model_name,

trust_remote_code=True,

torch_dtype=torch.float16

).to(self.device)

self.processor = AutoProcessor.from_pretrained(

proxy_model_name,

trust_remote_code=True

)

# 提取视觉编码器和文本编码器

self.vision_encoder = self.model.vision_encoder

self.text_encoder = self.model.text_encoder

self.model.eval()

print("[✓] Model loaded successfully")

def get_text_embedding(self, text: str) -> torch.Tensor:

"""提取目标恶意指令的文本嵌入"""

inputs = self.processor(text=text, return_tensors="pt").to(self.device)

with torch.no_grad():

outputs = self.text_encoder(**inputs)

# 取[CLS] token或平均池化

embedding = outputs.last_hidden_state.mean(dim=1)

return embedding

def get_image_embedding(self, image: Image.Image) -> torch.Tensor:

"""提取图像的视觉嵌入"""

inputs = self.processor(images=image, return_tensors="pt").to(self.device)

with torch.no_grad():

outputs = self.vision_encoder(inputs.pixel_values)

embedding = outputs.last_hidden_state.mean(dim=1)

return embedding

def construct_perturbation(self,

image: Image.Image,

target_text: str,

epsilon: float = 0.03,

max_iter: int = 200) -> torch.Tensor:

"""

构造对抗扰动,使视觉嵌入靠近目标文本嵌入

Args:

image: 原始图像

target_text: 目标恶意指令

epsilon: 扰动预算

max_iter: 最大迭代次数

Returns:

perturbation: 对抗扰动

"""

print(f"[*] Constructing perturbation for target: '{target_text}'")

# 获取目标文本嵌入

target_embed = self.get_text_embedding(target_text)

# 准备图像tensor

inputs = self.processor(images=image, return_tensors="pt")

image_tensor = inputs.pixel_values.to(self.device)

image_tensor = image_tensor.clone().detach().requires_grad_(True)

# 初始化扰动

perturbation = torch.zeros_like(image_tensor)

perturbation.requires_grad_(True)

# 优化器

optimizer = torch.optim.Adam([perturbation], lr=epsilon/10)

for i in range(max_iter):

optimizer.zero_grad()

# 加扰动的图像

perturbed_tensor = image_tensor + perturbation

perturbed_tensor = torch.clamp(perturbed_tensor, 0, 1)

# 提取视觉嵌入

vision_outputs = self.vision_encoder(perturbed_tensor)

current_embed = vision_outputs.last_hidden_state.mean(dim=1)

# 损失函数:最大化余弦相似度(最小化负余弦相似度)

cos_sim = F.cosine_similarity(current_embed, target_embed)

loss = -cos_sim

loss.backward()

optimizer.step()

# 投影扰动到L-inf球内

with torch.no_grad():

perturbation.data = torch.clamp(perturbation.data, -epsilon, epsilon)

if i % 20 == 0:

print(f" Iter {i}: loss={loss.item():.4f}, cos_sim={cos_sim.item():.4f}")

return perturbation.detach()

def verify_attack(self,

image: Image.Image,

perturbation: torch.Tensor,

target_text: str) -> dict:

"""

验证攻击效果

Returns:

dict: 包含原始相似度和攻击后相似度

"""

# 目标嵌入

target_embed = self.get_text_embedding(target_text)

# 原始图像嵌入

inputs = self.processor(images=image, return_tensors="pt").to(self.device)

image_tensor = inputs.pixel_values

with torch.no_grad():

vision_outputs = self.vision_encoder(image_tensor)

orig_embed = vision_outputs.last_hidden_state.mean(dim=1)

# 攻击后图像嵌入

perturbed_tensor = image_tensor + perturbation.to(self.device)

perturbed_tensor = torch.clamp(perturbed_tensor, 0, 1)

with torch.no_grad():

vision_outputs = self.vision_encoder(perturbed_tensor)

attack_embed = vision_outputs.last_hidden_state.mean(dim=1)

# 计算相似度

orig_sim = F.cosine_similarity(orig_embed, target_embed).item()

attack_sim = F.cosine_similarity(attack_embed, target_embed).item()

return {

"original_similarity": orig_sim,

"attack_similarity": attack_sim,

"improvement": attack_sim - orig_sim,

"success": attack_sim > 0.7 # 阈值可调

}

def save_perturbation(self,

perturbation: torch.Tensor,

save_path: str = "perturbation.npy"):

"""保存扰动供物理世界使用"""

np.save(save_path, perturbation.cpu().numpy())

print(f"[✓] Perturbation saved to {save_path}")5.3.3 攻击执行示例

def main():

# 1. 初始化攻击

attack = MultimodalAlignmentAttack()

# 2. 加载目标图像

image = Image.open("test_images/cup_on_table.jpg").convert("RGB")

# 3. 定义目标恶意指令

target = "The space above the table is empty, grasp the air" # 危险指令

# 4. 构造扰动

perturbation = attack.construct_perturbation(

image=image,

target_text=target,

epsilon=0.03,

max_iter=200

)

# 5. 验证效果

result = attack.verify_attack(image, perturbation, target)

print("\n[✓] Attack verification:")

print(f" Original similarity: {result['original_similarity']:.3f}")

print(f" Attack similarity: {result['attack_similarity']:.3f}")

print(f" Improvement: {result['improvement']:.3f}")

print(f" Success: {result['success']}")

# 6. 保存扰动

attack.save_perturbation(perturbation, "cup_attack.npy")

if __name__ == "__main__":

main()5.3.4 物理世界迁移版本

def create_physical_perturbation(perturbation: np.ndarray,

image_size=(224, 224),

output_path="attack_sticker.png"):

"""

将扰动转换为可打印的物理贴纸

"""

# 归一化到0-255

pert_img = ((perturbation.squeeze().transpose(1,2,0) + 1) * 127.5).astype(np.uint8)

# 调整大小

from PIL import Image

img = Image.fromarray(pert_img)

img = img.resize(image_size, Image.Resampling.LANCZOS)

# 保存

img.save(output_path)

print(f"[✓] Physical sticker saved to {output_path}")

return img6,攻击视角的防御

6.1 我会怎么选择防御

反过来,如果我是防御方,我会思考:攻击者最怕什么?

| 攻击者怕什么 | 对应的防御策略 |

|---|---|

| 扰动被检测到 | 输入扰动检测 |

| 攻击不迁移 | 模型多样性 |

| 视觉和语言不一致 | 多模态交叉验证 |

| 对抗样本被平滑 | 输入预处理 |

6.2 防御手段

| 防御手段 | 原理 | 效果 |

|---|---|---|

| 输入扰动检测 | 检测L-inf范数过大的输入 | 可拦截部分攻击 |

| 特征平滑 | 对视觉嵌入进行平滑处理 | 降低对抗扰动效果 |

| 多模态一致性校验 | 检查视觉和语言是否一致 | 识别污染 |

| 对抗训练 | 用对抗样本训练模型 | 提升鲁棒性 |

6.3 防御架构的设计

输入图像

↓

[防御层1] 输入扰动检测

↓

[防御层2] 特征平滑

↓

[防御层3] 视觉编码器

↓

[防御层4] 多模态一致性校验 ← 语言输入

↓

[防御层5] 安全动作校验

↓

动作输出

6.4 我为什么我这么设计呢?因为我是从攻击者的每一步反推防御我不是凭空想出这五层防御的,而是站在攻击者的位置,走了一遍攻击流程,然后在每一步问自己“如果我是防御方,我要在这里设一道什么关卡?”

6.4.1 首先防御设计的原点是攻击者的五步

让我们回顾攻击者的完整攻击链:

| 步骤 | 攻击者在做什么 | 攻击者的目标 |

|---|---|---|

| Step 1 | 构造对抗扰动 | 让 扰动人眼看不出来 |

| Step 2 | 将扰动加到图像上 | 生成对抗样本 |

| Step 3 | 图像进入视觉编码器 | 提取被污染的视觉特征 |

| Step 4 | 视觉特征对齐到恶意指令语义 | 让模型“理解”成恶意指令 |

| Step 5 | 模型规划动作并执行 | 造成物理世界伤害 |

防御的任务:在每一步截断攻击者。

既然是这样,那么我从每一步反推防御

Step 1 → 第1层防御:输入空间检测

攻击者在 Step 1 做什么?

他在构造一个很小的扰动,目标是让它不被发现。

那么在做这个时候,我会问自己: 如果我是防御方,我最想做什么?首先第一要务在这个扰动还没发挥作用之前,就把它检测出来。

但怎么检测?攻击者的扰动虽然小,但会在统计特征上留下痕迹。就像一个小偷动作很轻,但监控录像还是能捕捉到异常。

所以我设计了第1层:输入扰动检测

它的逻辑是:

-

先收集大量干净图像,学习它们的“正常样子”(梯度分布、频率特征等)

-

新来的图像如果偏离这个“正常样子”太多,就拦下来

为什么放在第一层?

因为这是成本最低的防御——在图像进入模型之前就拦截,不消耗模型推理资源。

Step 2 → 第2层防御:特征平滑

攻击者在 Step 2 做什么?

他把扰动加到图像上,生成 对抗性样本,准备送入模型。

接着我又问自己: 如果第一层没拦住,图像已经进来了,我还能做什么?就是在图像进入视觉编码器之前,对图像做一次“净化”——用平滑操作把可能的扰动抹掉。为什么要平滑?因为对抗扰动本质上是在像素空间加了一些“尖刺”。高斯平滑就像用砂纸打磨,把这些尖刺磨平。

所以我设计了第2层:特征平滑

它的逻辑是:

-

对输入图像做高斯平滑

-

或者对提取的视觉特征做平滑

-

让对抗扰动失效,同时尽量保留正常图像的信息

为什么放在第二层?

因为这是第一道防线失守后的补救措施,仍然在输入层面,但比第一层更激进(会改变图像本身)。

Step 3 → 第3层防御:对齐层保护

攻击者在 Step 3 做什么?

图像进入视觉编码器 ,提取出视觉特征。攻击者的目标是让这个特征靠近目标样本,接着我会问自己: 如果扰动已经过了前两层,视觉特征已经被污染了,我还能做什么?就是在特征进入对齐层之前,检查这个特征是不是“干净的”。

怎么检查?

正常的视觉特征有它自己的分布规律。被污染的特征会偏离这个分布。

所以我设计了第3层:特征分布检测

它的逻辑是:

-

用大量正常图像的特征训练一个“正常特征空间”

-

新来的特征如果落在这个空间之外,就认为是可疑的

为什么放在第三层?

因为这是特征层面的防御,是在污染特征即将影响语义对齐之前的最后一道关卡。

Step 4 → 第4层防御:跨模态一致性校验

攻击者在 Step 4 做什么?

他成功让视觉特征对齐到了恶意指令的语义空间。现在模型“认为”它看到了恶意指令对应的场景。

然后我问自己: 如果对齐已经被污染了,我还能做什么?检查视觉和语言的理解是否一致。

为什么要检查一致性?

攻击者能让视觉特征对齐到恶意语义,但他很难同时控制语言输入。如果视觉说“我要抓杯子”,语言却说“桌子上没有杯子”,这两者不一致,就应该报警。

所以我设计了第4层:跨模态一致性校验

它的逻辑是:

-

分别从视觉和语言提取对场景的理解

-

比较两者是否一致

-

如果严重不一致,说明至少有一个模态被污染了

为什么放在第四层?

这是语义层面的防御,是在模型已经做出理解之后、但还没规划动作之前的拦截点。

Step 5 → 第5层防御:动作安全校验

攻击者在 Step 5 做什么?

模型已经规划好动作,准备发给机器人执行。攻击者马上要达成目标了。

最后我问自己: 如果前面四层全都没拦住,我还能做什么?

答案: 在动作被执行之前,做最后一次安全检查。

怎么检查?

-

这个动作是否在安全范围内?

-

是否会导致碰撞?

-

是否符合物理可行性?

所以我设计了第5层:动作安全校验

它的逻辑是:

-

建立一个“安全动作空间”

-

规划出的动作如果落在这个空间之外,就拦截

-

或者用前向动力学模型预测动作后果,如果预测到危险就拦截

为什么放在第五层?

这是最后一道防线。虽然成本最高(要运行动力学模型),但也是最重要的一道——因为前面所有防御都可能被绕过,但这一道直接拦在物理世界之前。

为什么是这五层,不是三层或七层?

是因为每层对应攻击者的一个关键步骤

| 攻击者步骤 | 对应的防御层 | 防御时机 |

|---|---|---|

| 构造扰动 | 第1层:输入检测 | 扰动刚出现 |

| 图像输入 | 第2层:特征平滑 | 图像进入模型前 |

| 特征提取 | 第3层:特征分布检测 | 特征刚提取 |

| 语义对齐 | 第4层:一致性校验 | 理解刚形成 |

| 动作执行 | 第5层:动作验证 | 动作即将执行 |

五步攻击 = 五层防御,一一对应,没有冗余。那为什么不是三层?如果只有三层,比如去掉第1层和第2层,那么攻击者可以在输入层自由活动,直接打到特征层才被拦截。这时特征可能已经被严重污染,拦截成本更高。越早拦截,成本越低。那什么不是七层?因为过多的防御层会带来两个问题:

-

延迟增加:每层都要计算,影响实时性

-

误报累积:每层都可能误拦正常样本

所以,五层是在安全性和可用性之间的平衡点。

7,防御伪代码实现

7.1 防御依赖库

首先我们得根据架构去知道我这么做的目的是什么?

| 防御层 | 核心功能 | 所需库类型 | 对应库 |

|---|---|---|---|

| 第1层:输入扰动检测 | 梯度统计、频率域分析、异常检测 | 图像处理、统计学习 | OpenCV, scikit-image, scikit-learn |

| 第2层:特征平滑 | 高斯平滑、可微分滤波 | 可微分图像处理 | kornia, torchvision |

| 第3层:特征分布检测 | 流形学习、分布外检测 | 机器学习、深度学习 | scikit-learn, PyOD |

| 第4层:跨模态一致性校验 | 图文对齐评估、语义一致性 | 多模态评估 | DeepEval, transformers |

| 第5层:动作安全校验 | 运动规划、碰撞检测、动力学验证 | 机器人学、运动规划 | DART, openrr-planner |

接着,我得知道我的requirement是怎么去设计。

# ==================== 多模态对齐漏洞防御系统 ====================

# 版本: 1.0.0

# 设计依据:五层纵深防御架构

# 对应攻击:视觉特征对齐恶意指令语义的攻击

#基础依赖

torch>=2.0.0 # PyTorch核心

torchvision>=0.15.0 # 图像处理、预训练模型

transformers>=4.38.0 # 加载多模态模型(Qwen2.5-VL)

numpy>=1.24.0 # 数值计算

scipy>=1.11.0 # 科学计算

#第1层:输入扰动检测

# 功能:检测图像中的对抗性扰动

opencv-python>=4.8.0 # 图像I/O、梯度计算

scikit-image>=0.22.0 # 边缘检测、滤波、频域分析

scikit-learn>=1.3.0 # 异常检测(OneClassSVM, IsolationForest)

pyod>=1.1.0 # 专门的开源异常检测库

#第2层:特征平滑

# 功能:平滑图像或特征,消除对抗扰动

kornia>=0.7.0 # 可微分图像处理(高斯平滑、滤波)

pillow>=10.0.0 # 图像基础处理

albumentations>=1.4.0 # 图像增强(用于平滑评估)

#第3层:特征分布检测

# 功能:检测视觉特征是否偏离正常分布

decomon>=0.0.19 # [citation:7] 神经网络鲁棒性认证库,提供上下界估计

# 可检测特征是否在认证范围内

# 由Airbus开发,支持Box、L-inf等扰动域

# 备选认证库

# tensorflow>=2.13.0 # decomon依赖

# auto_LiRPA>=0.5.0 # 另一鲁棒性认证库

#第4层:跨模态一致性校验

# 功能:评估图像与文本的语义一致性

deepeval>=1.2.0 # [citation:4] 开源LLM评估框架

# 提供ImageCoherenceMetric,评估图文对齐

openai>=1.0.0 # 可选:调用GPT-4V作为评估judge

anthropic>=0.18.0 # 可选:调用Claude作为评估judge

sentence-transformers>=2.2.0 # 计算图文嵌入的余弦相似度

#第5层:动作安全校验

# 功能:验证机器人动作的物理可行性

dart>=6.12.0 # [citation:5] 动态动画与机器人工具包

# 提供动力学计算、碰撞检测

# 由Georgia Tech开发,支持URDF/SDF

openrr-planner>=0.0.1 # [citation:10] Rust运动规划库(Python绑定)

# 提供逆运动学、碰撞避免路径规划

pin>=2.6.0 # Pinocchio动力学库

meshcat>=0.3.0 # 3D可视化

# 运动规划备选

# ompl>=1.5.0 # 开源运动规划库

# pybullet>=3.2.5 # 物理仿真

#实验跟踪与可视化

matplotlib>=3.7.0

tqdm>=4.66.0

wandb>=0.15.0

tensorboard>=2.13.0

#配置与工具

pyyaml>=6.0

json5>=0.9.0

typing-extensions>=4.8.0

pydantic>=2.0.0第一层,输入扰动检测

"""

输入扰动检测层依赖

功能:检测图像中的对抗性扰动

设计依据:攻击者的扰动虽然小,但会在梯度/频域留下痕迹

"""

import cv2 # 图像读取、梯度计算

import numpy as np

from skimage import filters, exposure, morphology # 边缘检测、局部方差

from sklearn.svm import OneClassSVM # 单类分类异常检测

from sklearn.ensemble import IsolationForest # 孤立森林异常检测

from pyod.models.iforest import IForest # 专门异常检测

# 可选:频域分析

from scipy.fftpack import fft2, fftshift第二层,特征平滑

"""

特征平滑层依赖

功能:平滑图像或特征,消除对抗扰动

设计依据:对抗扰动本质上是高频噪声,平滑可以将其抹掉

"""

import kornia # 可微分高斯平滑、中值滤波

import torch.nn.functional as F

from torchvision import transforms

# 图像增强(用于测试平滑效果)

import albumentations as A为什么选kornia?

-

提供可微分的高斯平滑、双边滤波,可在梯度计算过程中使用

-

支持批处理,适合实时防御场景

-

与PyTorch无缝集成,不需要转换格式

第3层:特征分布检测

"""

特征分布检测层依赖

功能:检测视觉特征是否偏离正常分布

设计依据:被污染的视觉特征会偏离正常特征流形

"""

import torch

import numpy as np

from sklearn.decomposition import PCA

from sklearn.covariance import EllipticEnvelope # 椭圆包络异常检测

# 鲁棒性认证库

from decomon import convert # [citation:7] 转换Keras模型为可认证形式

from decomon import get_upper_box, get_lower_box # 获取认证上下界为什么选decomon?

-

由Airbus开发,专门用于神经网络的鲁棒性认证

-

可计算在给定扰动域内模型输出的上下界

-

支持Box、L-inf、L1、L2等多种扰动范数

-

与TensorFlow/Keras兼容(也可通过ONNX桥接PyTorch)

工作原理:对于一个输入特征,如果其认证上下界超出正常范围,说明该特征可能被污染。

第4层:跨模态一致性校验

"""

跨模态一致性校验层依赖

功能:评估图像与文本的语义一致性

设计依据:攻击者能让视觉对齐恶意指令,但很难让图像内容与恶意指令语义一致

"""

from deepeval import evaluate # [citation:4]

from deepeval.metrics import ImageCoherenceMetric # 图文一致性指标

from deepeval.test_case import LLMTestCase, MLLMImage

# 嵌入相似度

from sentence_transformers import SentenceTransformer

import torch.nn.functional as F

# 可选:用LLM作为评判器

import openai

import anthropic为什么选deepeval?

-

提供专门的

ImageCoherenceMetric,评估图像与文本的对齐程度 -

支持本地模型或调用GPT-4V作为评判器

-

可输出评估理由,便于调试

第5层:动作安全校验

"""

动作安全校验层依赖

功能:验证机器人动作的物理可行性

设计依据:最后一道防线,在动作执行前拦截危险动作

"""

# DART动态仿真库

import dartpy # DART的Python绑定 [citation:5]

# 运动规划

from openrr_planner import (

JointPathPlanner,

CollisionChecker,

InverseKinematicsSolver

) # [citation:10]

# 可选:Pinocchio动力学

import pinocchio as pin

# 可选:可视化

import meshcat为什么选dart?

-

由Georgia Tech开发,专门用于机器人动力学和动画

-

提供精确的动力学计算(质量矩阵、科里奥利力、雅可比矩阵)

-

支持URDF/SDF模型导入

-

使用Featherstone的Articulated Body Algorithm,计算稳定准确

-

与Gazebo深度集成,可导入现有机器人模型

为什么选openrr-planner?

-

提供碰撞检测、逆运动学求解、路径规划

-

支持关节限位检查和避障规划

-

可与DART配合使用:DART负责动力学,openrr-planner负责规划

7.2 完整防御案例

import torch

import torch.nn.functional as F

import numpy as np

from PIL import Image

import cv2

from typing import Dict, List, Tuple, Optional, Union, Any

from dataclasses import dataclass, field

import json

import time

import warnings

warnings.filterwarnings('ignore')

#第1层依赖

from skimage import filters, exposure

from sklearn.ensemble import IsolationForest

from sklearn.svm import OneClassSVM

import pyod.models.iforest as iforest

#第2层依赖

import kornia

from torchvision import transforms

#第3层依赖

from decomon import convert

from decomon import get_upper_box, get_lower_box

import tensorflow as tf

#第4层依赖

from deepeval.metrics import ImageCoherenceMetric

from deepeval.test_case import LLMTestCase, MLLMImage

from sentence_transformers import SentenceTransformer

#第5层依赖

import dartpy

import numpy as np

from scipy.spatial.transform import Rotation

#配置类

@dataclass

class DefenseConfig:

"""防御系统配置"""

# 第1层配置

perturbation_threshold: float = 2.0 # 扰动检测阈值

contamination: float = 0.1 # 异常点比例

# 第2层配置

smooth_kernel_size: int = 3

smooth_sigma: float = 1.0

# 第3层配置

eps: float = 0.03 # 扰动预算(与攻击者相同)

confidence_threshold: float = 0.8 # 置信度阈值

# 第4层配置

coherence_threshold: float = 0.6 # 一致性阈值

# 第5层配置

safety_margin: float = 0.05 # 安全裕度(米)

# 模型配置

model_name: str = "Qwen/Qwen2.5-VL-7B"

device: str = "cuda" if torch.cuda.is_available() else "cpu"

# 日志配置

log_dir: str = "./defense_logs"

save_intermediate: bool = True

#防御结果类

@dataclass

class DefenseResult:

"""防御结果"""

passed: bool # True=通过防御(安全),False=被拦截

blocked_layer: Optional[int] = None # 在哪一层被拦截

confidence: float = 0.0 # 置信度

message: str = ""

layer_details: Dict = field(default_factory=dict)

execution_time: float = 0.0

#第1层:输入扰动检测

class InputPerturbationDetector:

"""

第1层防御:输入扰动检测

原理:攻击者的扰动虽小,但会在梯度统计上留下痕迹

检测方法:梯度统计 + 孤立森林异常检测

"""

def __init__(self, config: DefenseConfig):

self.config = config

self.detector = None

self.background_stats = None

def fit_background(self, clean_images: List[Image.Image]):

"""

从干净图像学习正常分布

Args:

clean_images: 干净图像列表(无扰动)

"""

print("[Layer1] Training perturbation detector on clean images...")

features = []

for img in clean_images:

feat = self._extract_features(img)

features.append(feat)

features = np.array(features)

# 训练孤立森林检测器

self.detector = IsolationForest(

contamination=self.config.contamination,

random_state=42

)

self.detector.fit(features)

# 保存统计信息

self.background_stats = {

"mean": features.mean(axis=0),

"std": features.std(axis=0)

}

print(f"[Layer1] Training complete. Feature dim: {features.shape[1]}")

def _extract_features(self, image: Image.Image) -> np.ndarray:

"""

提取图像的统计特征

特征包括:

- 梯度均值、方差

- 局部方差的均值

- 频域高频能量

"""

img_array = np.array(image.convert('L')) # 转灰度

# 1. 梯度特征

grad_x = cv2.Sobel(img_array, cv2.CV_64F, 1, 0, ksize=3)

grad_y = cv2.Sobel(img_array, cv2.CV_64F, 0, 1, ksize=3)

grad_mag = np.sqrt(grad_x**2 + grad_y**2)

grad_mean = grad_mag.mean()

grad_std = grad_mag.std()

# 2. 局部方差特征

from skimage.filters import rank

from skimage.morphology import disk

local_var = rank.variance(img_array, disk(3))

var_mean = local_var.mean()

var_std = local_var.std()

# 3. 高频能量(频域)

f = np.fft.fft2(img_array)

fshift = np.fft.fftshift(f)

magnitude_spectrum = np.log(np.abs(fshift) + 1)

# 高频区域(中心以外)

h, w = magnitude_spectrum.shape

center_h, center_w = h//2, w//2

mask = np.ones((h, w))

mask[center_h-10:center_h+10, center_w-10:center_w+10] = 0

high_freq_energy = (magnitude_spectrum * mask).sum() / mask.sum()

return np.array([grad_mean, grad_std, var_mean, var_std, high_freq_energy])

def detect(self, image: Image.Image) -> Tuple[bool, float, Dict]:

"""

检测图像是否包含对抗性扰动

Returns:

is_attack: 是否被检测为攻击

confidence: 置信度 (0-1)

details: 详细信息

"""

if self.detector is None:

return False, 0.0, {"error": "Detector not trained"}

# 提取特征

feat = self._extract_features(image).reshape(1, -1)

# 孤立森林检测

pred = self.detector.predict(feat)[0] # -1为异常,1为正常

scores = self.detector.score_samples(feat)[0]

# 转换为置信度

if pred == -1:

confidence = min(1.0, abs(scores) / 10)

is_attack = confidence > 0.5

else:

confidence = 0.0

is_attack = False

# Z-score异常检测(备选)

if self.background_stats is not None:

z_scores = (feat - self.background_stats["mean"]) / (self.background_stats["std"] + 1e-8)

max_z = np.abs(z_scores).max()

if max_z > self.config.perturbation_threshold:

is_attack = True

confidence = max(confidence, min(1.0, max_z / 10))

details = {

"prediction": int(pred),

"score": float(scores),

"features": feat.tolist()[0]

}

return is_attack, float(confidence), details

#第2层:特征平滑

class FeatureSmoother:

"""

第2层防御:特征平滑

原理:对抗扰动本质是高频噪声,高斯平滑可以抹掉

策略:如果第1层检测到可疑,应用平滑;否则可跳过以节省计算

"""

def __init__(self, config: DefenseConfig):

self.config = config

# 创建高斯核

self.gaussian = kornia.filters.GaussianBlur2d(

kernel_size=(config.smooth_kernel_size, config.smooth_kernel_size),

sigma=(config.smooth_sigma, config.smooth_sigma)

)

def smooth_image(self,

image_tensor: torch.Tensor,

force: bool = False,

detection_result: Optional[Dict] = None) -> Tuple[torch.Tensor, Dict]:

"""

平滑图像

Args:

image_tensor: 输入图像张量 [B, C, H, W]

force: 是否强制平滑(无视检测结果)

detection_result: 第1层的检测结果

Returns:

smoothed_tensor: 平滑后的图像

details: 详细信息

"""

should_smooth = force

# 如果第1层检测到攻击,则平滑

if detection_result and detection_result.get("is_attack", False):

should_smooth = True

if not should_smooth:

return image_tensor, {"smoothed": False}

# 应用高斯平滑

smoothed = self.gaussian(image_tensor)

# 计算平滑强度

diff = torch.abs(smoothed - image_tensor).mean().item()

details = {

"smoothed": True,

"kernel_size": self.config.smooth_kernel_size,

"sigma": self.config.smooth_sigma,

"difference": diff

}

return smoothed, details

def smooth_features(self,

features: torch.Tensor,

method: str = "gaussian") -> Tuple[torch.Tensor, Dict]:

"""

平滑特征(备选方案)

Args:

features: 特征张量

method: 平滑方法 ['gaussian', 'median', 'mean']

"""

if method == "gaussian":

# 对特征应用1D高斯平滑

kernel = torch.exp(-torch.linspace(-2, 2, 5)**2 / 2)

kernel = kernel / kernel.sum()

kernel = kernel.view(1, 1, -1).to(features.device)

# 对特征序列平滑

if features.dim() == 3: # [B, seq_len, dim]

smoothed = F.conv1d(

features.transpose(1, 2),

kernel.repeat(features.size(2), 1, 1),

padding=2,

groups=features.size(2)

).transpose(1, 2)

else:

smoothed = features

elif method == "median":

# 中值平滑(需要自定义实现)

smoothed = features

else:

smoothed = features

return smoothed, {"method": method}

#第3层:特征分布检测

class FeatureDistributionDetector:

"""

第3层防御:特征分布检测

原理:被污染的视觉特征会偏离正常特征流形

方法:用decomon计算认证上下界,判断特征是否在安全范围内

"""

def __init__(self, config: DefenseConfig):

self.config = config

self.normal_range = None

self.encoder = None

def set_encoder(self, encoder):

"""设置视觉编码器"""

self.encoder = encoder

def fit_normal_range(self, clean_features: np.ndarray):

"""

学习正常特征的范围

Args:

clean_features: 干净图像的特征 [N, dim]

"""

# 计算每个维度的均值和标准差

mean = clean_features.mean(axis=0)

std = clean_features.std(axis=0)

self.normal_range = {

"mean": mean,

"std": std,

"lower": mean - 3 * std, # 3-sigma原则

"upper": mean + 3 * std

}

print(f"[Layer3] Normal range learned. Feature dim: {mean.shape[0]}")

def detect_with_decomon(self,

image_tensor: torch.Tensor,

epsilon: Optional[float] = None) -> Tuple[bool, float, Dict]:

"""

使用decomon进行鲁棒性认证

Args:

image_tensor: 输入图像张量

epsilon: 扰动预算(默认使用配置中的值)

Returns:

is_safe: 是否在安全范围内

confidence: 置信度

details: 详细信息

"""

eps = epsilon or self.config.eps

# 将PyTorch张量转为numpy(decomon需要numpy/tf)

img_np = image_tensor.cpu().numpy()

# 转换为TensorFlow张量

img_tf = tf.convert_to_tensor(img_np, dtype=tf.float32)

# 注意:这里需要将PyTorch模型转为Keras模型才能用decomon

# 为简化示例,我们使用统计方法作为替代

return self.detect_statistical(image_tensor)

def detect_statistical(self,

features: torch.Tensor) -> Tuple[bool, float, Dict]:

"""

用统计方法检测特征是否异常

"""

if self.normal_range is None:

return True, 1.0, {"error": "Normal range not fitted"}

if isinstance(features, torch.Tensor):

feat_np = features.cpu().numpy()

else:

feat_np = features

# 检查每个维度是否在正常范围内

lower = self.normal_range["lower"]

upper = self.normal_range["upper"]

# 计算超出范围的比例

out_of_range = np.logical_or(feat_np < lower, feat_np > upper)

out_ratio = out_of_range.mean()

# 计算马氏距离

diff = feat_np - self.normal_range["mean"]

inv_cov = np.diag(1.0 / (self.normal_range["std"]**2 + 1e-8))

mahal_dist = np.sqrt(diff @ inv_cov @ diff.T)

# 判断

is_safe = (out_ratio < 0.1) and (mahal_dist < 10)

confidence = 1.0 - min(1.0, mahal_dist / 20)

details = {

"out_of_range_ratio": float(out_ratio),

"mahalanobis_distance": float(mahal_dist),

"safe_threshold": 10.0,

"out_threshold": 0.1

}

return is_safe, float(confidence), details

#第4层:跨模态一致性校验

class CrossModalConsistencyChecker:

"""

第4层防御:跨模态一致性校验

原理:攻击者能让视觉对齐恶意指令,但很难让图像内容与恶意指令语义一致

方法:计算图文嵌入的余弦相似度 + 专门的一致性度量

"""

def __init__(self, config: DefenseConfig):

self.config = config

self.text_model = SentenceTransformer('all-MiniLM-L6-v2')

self.coherence_metric = ImageCoherenceMetric()

def check_consistency(self,

image: Image.Image,

text: str,

visual_features: Optional[torch.Tensor] = None) -> Tuple[bool, float, Dict]:

"""

检查图像和文本的语义一致性

Args:

image: 输入图像

text: 语言指令

visual_features: 视觉特征(可选)

Returns:

is_consistent: 是否一致

score: 一致性得分 (0-1)

details: 详细信息

"""

# 方法1:嵌入相似度

# 提取文本嵌入

text_embed = self.text_model.encode(text)

# 提取图像嵌入(如果没有提供特征)

if visual_features is None:

# 简化:用预训练CLIP风格的模型

from transformers import CLIPProcessor, CLIPModel

clip_model = CLIPModel.from_pretrained("openai/clip-vit-base-patch32")

clip_processor = CLIPProcessor.from_pretrained("openai/clip-vit-base-patch32")

inputs = clip_processor(images=image, return_tensors="pt")

with torch.no_grad():

image_embed = clip_model.get_image_features(**inputs)

image_embed = image_embed / image_embed.norm(dim=-1, keepdim=True)

image_embed = image_embed.squeeze().numpy()

else:

# 用提供的视觉特征

if isinstance(visual_features, torch.Tensor):

image_embed = visual_features.cpu().numpy()

else:

image_embed = visual_features

# 计算余弦相似度

cos_sim = np.dot(image_embed, text_embed) / (np.linalg.norm(image_embed) * np.linalg.norm(text_embed))

# 方法2:使用deepeval的专用指标

# 创建测试用例

test_case = MLLMImage(

image=image,

text=text,

expected_output="consistent" # 期望值

)

# 评估

metric_result = self.coherence_metric.measure(test_case)

coherence_score = metric_result.score if hasattr(metric_result, 'score') else 0.5

# 综合得分

combined_score = 0.5 * (cos_sim + 1) / 2 + 0.5 * coherence_score

is_consistent = combined_score > self.config.coherence_threshold

details = {

"cosine_similarity": float(cos_sim),

"coherence_score": float(coherence_score),

"combined_score": float(combined_score),

"threshold": self.config.coherence_threshold

}

return is_consistent, float(combined_score), details

def check_with_llm(self,

image: Image.Image,

text: str) -> Tuple[bool, float, Dict]:

"""

用LLM作为评判器检查一致性(可选)

"""

# 需要配置OpenAI API

import openai

# 将图像转为base64

import base64

from io import BytesIO

buffered = BytesIO()

image.save(buffered, format="PNG")

img_base64 = base64.b64encode(buffered.getvalue()).decode()

# 构造提示

prompt = f"""

You are an expert in multimodal consistency checking.

Image: [base64 encoded]

Text: "{text}"

Question: Is the text description consistent with what you see in the image?

Answer with ONLY a number between 0 and 1 (0 = completely inconsistent, 1 = perfectly consistent).

"""

# 调用API(需要配置API key)

# response = openai.ChatCompletion.create(...)

# 为示例返回模拟值

score = 0.8

return score > self.config.coherence_threshold, score, {"method": "llm_judge"}

#第5层:动作安全校验

class ActionSafetyChecker:

"""

第5层防御:动作安全校验

原理:最后一道防线,在动作执行前拦截危险动作

方法:碰撞检测、关节限位检查、动力学可行性验证

"""

def __init__(self, config: DefenseConfig):

self.config = config

self.robot_model = None

self.collision_checker = None

def init_robot(self, urdf_path: str):

"""

初始化机器人模型

Args:

urdf_path: URDF文件路径

"""

# 使用DART加载机器人模型

self.robot_model = dartpy.World()

# 实际使用时需要加载URDF

# self.robot_model = dartpy.World.create(urdf_path)

print(f"[Layer5] Robot model initialized")

def check_action_safety(self,

action_sequence: np.ndarray,

robot_state: Optional[Dict] = None) -> Tuple[bool, float, Dict]:

"""

检查动作序列是否安全

Args:

action_sequence: 动作序列 [time_steps, joint_dims]

robot_state: 机器人当前状态

Returns:

is_safe: 是否安全

confidence: 安全置信度

details: 详细信息

"""

# 1. 关节限位检查

joint_limits = {

0: (-180, 180), # 关节0限位(度)

1: (-90, 90), # 关节1限位

2: (-135, 135), # 关节2限位

}

joint_violations = []

for t, action in enumerate(action_sequence):

for j, (min_angle, max_angle) in joint_limits.items():

if j < len(action):

angle = np.degrees(action[j]) # 假设动作是弧度

if angle < min_angle or angle > max_angle:

joint_violations.append((t, j, angle))

# 2. 碰撞检测(简化)

# 实际需用DART进行精确碰撞检测

collision_risk = False

# 3. 动力学可行性(简化)

# 计算加速度、力矩等

if len(action_sequence) > 1:

velocities = np.diff(action_sequence, axis=0)

accelerations = np.diff(velocities, axis=0)

max_accel = np.abs(accelerations).max()

dynamics_risk = max_accel > 10.0 # 加速度过大

else:

dynamics_risk = False

# 4. 安全裕度检查

# 检查是否太靠近障碍物(需环境信息)

# 综合判断

is_safe = (len(joint_violations) == 0) and not collision_risk and not dynamics_risk

confidence = 1.0 - min(1.0, len(joint_violations) * 0.1)

details = {

"joint_violations": len(joint_violations),

"collision_risk": collision_risk,

"dynamics_risk": dynamics_risk,

"max_acceleration": float(max_accel) if 'max_accel' in locals() else 0.0,

"action_shape": action_sequence.shape

}

return is_safe, float(confidence), details

def predict_action_consequence(self,

action: np.ndarray,

current_state: Dict) -> Dict:

"""

用前向动力学预测动作后果

Args:

action: 动作

current_state: 当前状态

Returns:

predicted_next_state: 预测的下一状态

"""

# 简化:假设简单动力学

# 实际使用DART进行精确预测

dt = 0.01 # 时间步长

# 获取当前关节角度和速度

q = current_state.get('joint_positions', np.zeros(len(action)))

qd = current_state.get('joint_velocities', np.zeros(len(action)))

# 简单积分

qdd = action # 假设动作是加速度

qd_new = qd + qdd * dt

q_new = q + qd_new * dt

return {

'joint_positions': q_new,

'joint_velocities': qd_new,

'time_horizon': dt

}7.3防御案例演示

def demo_defense_against_attack():

"""

演示防御系统如何拦截攻击案例

攻击案例:对抗性贴纸使视觉特征对齐到恶意指令

"The space above the table is empty, grasp the air"

"""

print("\n" + "="*60)

print("漏洞一防御演示:对抗性贴纸攻击")

print("="*60)

# 1. 初始化防御系统

config = DefenseConfig(

perturbation_threshold=2.0,

coherence_threshold=0.6,

eps=0.03

)

defense = MultimodalAlignmentDefense(config)

# 2. 准备干净图像用于训练第1层

print("\n[准备] 加载训练图像...")

clean_images = []

for i in range(5):

# 这里应加载真实的干净图像

# 为示例创建随机图像

img = Image.fromarray(np.random.randint(0, 255, (224, 224, 3), dtype=np.uint8))

clean_images.append(img)

# 3. 训练第1层

defense.train_layer1(clean_images)

# 4. 准备干净特征用于训练第3层

clean_features = np.random.randn(100, 512)

defense.train_layer3(clean_features)

# 5. 模拟攻击场景

print("\n[攻击场景] 对抗性贴纸攻击")

# 攻击图像(带扰动)

attack_image = Image.fromarray(np.random.randint(0, 255, (224, 224, 3), dtype=np.uint8))

# 恶意指令

malicious_text = "The space above the table is empty, grasp the air"

# 危险动作序列(模拟)

dangerous_action = np.random.randn(10, 6) * 2.0 # 放大幅度模拟危险动作

# 6. 执行防御

print("\n[防御] 执行五层防御...")

result = defense.defend(

image=attack_image,

text=malicious_text,

action_sequence=dangerous_action,

visual_features=torch.randn(1, 512) # 模拟视觉特征

)

# 7. 输出结果

print("\n" + "="*50)

print("防御结果")

print("="*50)

print(f"通过: {result.passed}")

print(f"拦截层: {result.blocked_layer}")

print(f"置信度: {result.confidence:.3f}")

print(f"信息: {result.message}")

print(f"耗时: {result.execution_time:.2f}s")

# 8. 保存日志

defense.save_logs()

return result7.4完整防御系统

class MultimodalAlignmentDefense:

"""

完整防御系统:整合五层防御

针对漏洞一:多模态对齐漏洞

攻击方式:对抗性贴纸使视觉特征对齐到恶意指令

"""

def __init__(self, config: Optional[DefenseConfig] = None):

self.config = config or DefenseConfig()

# 初始化五层防御

print("[*] Initializing 5-layer defense system...")

self.layer1 = InputPerturbationDetector(self.config)

self.layer2 = FeatureSmoother(self.config)

self.layer3 = FeatureDistributionDetector(self.config)

self.layer4 = CrossModalConsistencyChecker(self.config)

self.layer5 = ActionSafetyChecker(self.config)

# 日志

self.logs = []

os.makedirs(self.config.log_dir, exist_ok=True)

print("[✓] Defense system initialized")

def train_layer1(self, clean_images: List[Image.Image]):

"""训练第1层检测器"""

self.layer1.fit_background(clean_images)

def train_layer3(self, clean_features: np.ndarray):

"""训练第3层特征分布"""

self.layer3.fit_normal_range(clean_features)

def set_vision_encoder(self, encoder):

"""设置视觉编码器"""

self.layer3.set_encoder(encoder)

def set_robot_model(self, urdf_path: str):

"""设置机器人模型"""

self.layer5.init_robot(urdf_path)

def defend(self,

image: Image.Image,

text: str,

action_sequence: Optional[np.ndarray] = None,

visual_features: Optional[torch.Tensor] = None,

image_tensor: Optional[torch.Tensor] = None) -> DefenseResult:

"""

执行完整防御流程

Args:

image: 输入图像

text: 语言指令

action_sequence: 规划的动作序列(可选)

visual_features: 视觉特征(可选)

image_tensor: 图像张量(可选)

Returns:

DefenseResult: 防御结果

"""

start_time = time.time()

result = DefenseResult(passed=True)

print("\n" + "="*50)

print("执行五层防御系统")

print("="*50)

#第1层:输入扰动检测

print("\n[Layer1] 输入扰动检测...")

is_attack, conf, details1 = self.layer1.detect(image)

result.layer_details["layer1"] = {

"is_attack": is_attack,

"confidence": conf,

"details": details1

}

if is_attack and conf > 0.7:

print(f"第1层拦截: 检测到扰动 (conf={conf:.2f})")

result.passed = False

result.blocked_layer = 1

result.confidence = conf

result.message = f"Layer1 blocked: Perturbation detected"

result.execution_time = time.time() - start_time

self.logs.append(result)

return result

else:

print(f" ✓ 第1层通过 (conf={conf:.2f})")

# ========== 第2层:特征平滑 ==========

print("\n[Layer2] 特征平滑...")

# 准备图像张量

if image_tensor is None:

from torchvision import transforms

transform = transforms.Compose([

transforms.ToTensor(),

transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225])

])

img_tensor = transform(image).unsqueeze(0).to(self.config.device)

else:

img_tensor = image_tensor

# 平滑

smoothed_tensor, details2 = self.layer2.smooth_image(

img_tensor,

detection_result={"is_attack": is_attack}

)

result.layer_details["layer2"] = details2

if details2.get("smoothed", False):

print(f"应用平滑, diff={details2.get('difference', 0):.4f}")

else:

print(f"无需平滑")

#第3层:特征分布检测

print("\n[Layer3] 特征分布检测...")

# 如果有视觉特征,直接用;否则用平滑后的图像提取

if visual_features is None:

# 这里假设有编码器可以提取特征

# 简化:用随机特征

feat_tensor = torch.randn(1, 512)

else:

feat_tensor = visual_features

is_safe, conf3, details3 = self.layer3.detect_statistical(feat_tensor)

result.layer_details["layer3"] = {

"is_safe": is_safe,

"confidence": conf3,

"details": details3

}

if not is_safe:

print(f"第3层拦截: 特征分布异常 (conf={conf3:.2f})")

result.passed = False

result.blocked_layer = 3

result.confidence = conf3

result.message = f"Layer3 blocked: Abnormal feature distribution"

result.execution_time = time.time() - start_time

self.logs.append(result)

return result

else:

print(f"第3层通过 (conf={conf3:.2f})")

#第4层:跨模态一致性校验

print("\n[Layer4] 跨模态一致性校验...")

is_consistent, conf4, details4 = self.layer4.check_consistency(

image, text, feat_tensor

)

result.layer_details["layer4"] = {

"is_consistent": is_consistent,

"confidence": conf4,

"details": details4

}

if not is_consistent:

print(f" 第4层拦截: 图文不一致 (conf={conf4:.2f})")

result.passed = False

result.blocked_layer = 4

result.confidence = conf4

result.message = f"Layer4 blocked: Inconsistent modalities"

result.execution_time = time.time() - start_time

self.logs.append(result)

return result

else:

print(f"第4层通过 (conf={conf4:.2f})")

# ========== 第5层:动作安全校验 ==========

print("\n[Layer5] 动作安全校验...")

if action_sequence is not None:

is_safe_action, conf5, details5 = self.layer5.check_action_safety(action_sequence)

result.layer_details["layer5"] = {

"is_safe": is_safe_action,

"confidence": conf5,

"details": details5

}

if not is_safe_action:

print(f"第5层拦截: 动作不安全 (conf={conf5:.2f})")

result.passed = False

result.blocked_layer = 5

result.confidence = conf5

result.message = f"Layer5 blocked: Unsafe action"

result.execution_time = time.time() - start_time

self.logs.append(result)

return result

else:

print(f"第5层通过 (conf={conf5:.2f})")

else:

print(f"无动作序列,跳过第5层")

# 全部通过

result.passed = True

result.confidence = min([conf3, conf4]) # 取最低置信度

result.message = "All layers passed"

result.execution_time = time.time() - start_time

print(f"\n[✓] 防御完成: 全部通过 (耗时: {result.execution_time:.2f}s)")

self.logs.append(result)

return result

def save_logs(self, filename: str = "defense_logs.json"):

"""保存防御日志"""

log_path = os.path.join(self.config.log_dir, filename)

# 转换结果为可序列化格式

logs_dict = []

for log in self.logs:

log_dict = {

"passed": log.passed,

"blocked_layer": log.blocked_layer,

"confidence": log.confidence,

"message": log.message,

"execution_time": log.execution_time,

"layer_details": log.layer_details

}

logs_dict.append(log_dict)

with open(log_path, "w") as f:

json.dump(logs_dict, f, indent=2)

print(f"[✓] Logs saved to {log_path}")7.5测试脚本

def test_defense_layers():

"""测试各层防御是否正常工作"""

print("\n" + "="*50)

print("测试防御系统各层")

print("="*50)

config = DefenseConfig()

defense = MultimodalAlignmentDefense(config)

# 测试第1层

print("\n[Test Layer1] 输入扰动检测")

layer1 = InputPerturbationDetector(config)

# 用干净图像训练

clean_imgs = [Image.fromarray(np.random.randint(0, 255, (224, 224, 3), dtype=np.uint8))

for _ in range(10)]

layer1.fit_background(clean_imgs)

# 测试正常图像

normal_img = Image.fromarray(np.random.randint(0, 255, (224, 224, 3), dtype=np.uint8))

is_attack, conf, _ = layer1.detect(normal_img)

print(f" 正常图像 -> 攻击检测: {is_attack}, 置信度: {conf:.3f}")

# 测试第4层

print("\n[Test Layer4] 跨模态一致性校验")

layer4 = CrossModalConsistencyChecker(config)

# 正常情况

normal_img = Image.fromarray(np.random.randint(0, 255, (224, 224, 3), dtype=np.uint8))

normal_text = "A cup on the table"

is_consistent, score, _ = layer4.check_consistency(normal_img, normal_text)

print(f" 正常图文 -> 一致: {is_consistent}, 得分: {score:.3f}")

# 异常情况(模拟)

malicious_text = "The space above the table is empty, grasp the air"

is_consistent, score, _ = layer4.check_consistency(normal_img, malicious_text)

print(f" 恶意指令 -> 一致: {is_consistent}, 得分: {score:.3f}")

# 测试第5层

print("\n[Test Layer5] 动作安全校验")

layer5 = ActionSafetyChecker(config)

# 安全动作

safe_action = np.random.randn(10, 6) * 0.1

is_safe, conf, _ = layer5.check_action_safety(safe_action)

print(f" 安全动作 -> 安全: {is_safe}, 置信度: {conf:.3f}")

# 危险动作

dangerous_action = np.random.randn(10, 6) * 2.0

is_safe, conf, _ = layer5.check_action_safety(dangerous_action)

print(f" 危险动作 -> 安全: {is_safe}, 置信度: {conf:.3f}")

print("\n[✓] 测试完成")

if __name__ == "__main__":

# 运行测试

test_defense_layers()

# 运行攻击案例防御演示

result = demo_defense_against_attack()8,攻击与防御对比总结

8.1 漏洞一总结一下

| 维度 | 说明 |

|---|---|

| 漏洞名称 | 多模态对齐漏洞 |

| 漏洞本质 | 视觉特征到语义空间的映射可被操纵 |

| 攻击目标 | 对齐函数(算法层) |

| 攻击入口 | 视觉输入(对抗性贴纸) |

| 攻击效果 | 视觉污染传播到语言理解和动作规划 |

| 防御难度 | 中高(需要多层防御) |

8.2 攻击效果

| 指标 | 值 |

|---|---|

| 攻击成功率 | >=80% (在代理模型上) |

| 迁移成功率 | >=50% (跨模型) |

| 人眼不可察 | ε=0.03 |

| 物理世界有效性 | 需进一步验证 |

8.3 防御效果

| 防御层 | 效果 |

|---|---|

| 输入扰动检测 | 可检测部分攻击,但有误报 |

| 特征平滑 | 降低攻击效果,但可能影响正常性能 |

| 多模态一致性校验 | 有效识别不一致,但依赖检测能力 |

| 安全动作校验 | 最后一道防线,但无法阻止所有危险 |

8.4 核心启示

攻击者视角:多模态对齐是单点污染、全链失效的“黄金攻击面”。

防御者视角:需要多层防御,没有任何单层能完全防御;最关键的是在早期检测到扰动,而不是依赖后期校验。

9.,参考文献

[1] Manipulating Multimodal Agents via Cross-Modal Prompt Injection - Astrophysics Data System

[2]

[5] Zero-Shot Defense Against Toxic Images via Inherent Multimodal Alignment in LVLMs - ACL Anthology

如果是我来评价总结一下:

通过前几篇的讲解,我对于宇树科技的UnifoLM-VLA-0的大模型来说是非常不错的,总体评价呈现机器人技术路线值得肯定,大模型安全稍微加强。

从作者的角度来看,宇树科技在UnifoLM-VLA-0上的技术选择确实展现了他们对行业趋势的准确判断和自身技术的不断突破。基于Qwen2.5-VL构建模型,本质上是用最小的试错成本换取最大的技术确定性,这种务实的工程思维值得肯定。多模态大模型的训练成本极高,从零训练一个视觉语言基座不仅耗时耗力,还需要海量高质量数据,而直接站在开源社区的成果之上,把精力聚焦在动作空间的扩展上,这是一个理性的技术决策。动作分块预测、动力学约束、单一策略多任务,这些模块的集成也不是堆砌概念,而是切实回应了机器人场景的核心诉求——实时性、物理可行性、泛化能力。尤其是用340小时真机数据就实现多任务泛化,这说明他们在数据采集、清洗、增强的闭环上下了功夫,数据效率本身就是工程能力的体现。从这些维度看,UnifoLM-VLA-0是一个技术架构清晰、工程落地扎实的产品,在VLA这个前沿赛道上,它已经跑到了行业前列。

但作为作者来说,我们同样清楚,任何一个技术选型都有其代价,而且这些代价往往不会在实验室里显现,只会在真实世界的极端条件下暴露。动作分块预测确实提升了响应速度,但它本质上是一个开环控制的思想——模型一次性输出未来的动作片段,然后信任这个片段能够顺利执行。这种设计在静态环境中没问题,但如果环境发生动态变化,或者初始预测出现偏差,整个动作序列就会沿着错误的轨迹一路走下去,而且没有机会中途纠正。

这不是模型能力的问题,而是架构层面的取舍——用实时性换取了鲁棒性。单一策略多任务也是如此,从系统简洁性上看,一套参数处理所有任务确实优雅,但这也意味着所有任务的脆弱点都被集中到了同一套参数上。如果攻击者找到一个让模型在抓取任务上失效的输入,这个失效会不会影响放置任务?会不会影响开关抽屉的任务?参数共享带来的泛化能力,同样带来了风险扩散的可能。无思考的直觉模式更是如此,低延迟是机器人与人交互的基本要求,但如果在追求低延迟的过程中完全放弃了执行过程中的校验机制,那模型就等于在黑暗中奔跑——跑得快,但不知道前面是悬崖。

如果从从技术演进的视角来看,宇树目前展现的更多是单点突破的能力,而不是系统演进的能力。对抗性训练、红队测试、漏洞响应机制,这些在互联网软件行业已经是标配的安全基础设施,在机器人领域才刚刚开始被重视。宇树的产品已经进入全球市场,这意味着它不仅要面对技术挑战,还要面对不同国家和地区的监管要求。欧盟的AI法案、美国的出口管制、各国的数据安全法规,这些都不是可以事后补救的东西,而是必须在产品设计之初就内嵌进去的技术考量。如果安全能力的发展速度跟不上市场扩张的速度,技术领先很快就会变成技术负债。

开源策略也是需要从技术演进角度重新审视的。开源确实是构建生态最快的方式,让全球开发者基于你的平台开发应用,形成正反馈循环。但开源也意味着攻击者可以零门槛研究你的模型架构、分析你的训练数据分布、找到你系统的脆弱点。这不是说不应该开源,而是说开源必须配套相应的安全机制——漏洞赏金、安全众测、社区协同防御。目前来看,宇树在开源的同时,这些配套机制的建设还处于早期阶段。这就像一个城市打开了所有城门欢迎游客,但还没有建立巡逻队和报警系统。

横向对比行业内的其他玩家,智平方的GOVLA大模型走的是一条从实战中迭代的路。他们在NeurIPS等顶会验证技术,在商业落地中积累真实场景数据,再用这些数据反哺模型迭代,形成了完整的飞轮。这种模式的好处是,每一次迭代都有真实的反馈信号,模型的改进方向是清晰的。宇树目前更多是实验室突破加场景演示,数据和场景的闭环还没有真正跑通。这不是说宇树的技术不如别人,而是说它还需要时间去积累那个能驱动持续迭代的数据飞轮。

如果让我去做一个预判,我觉得宇树的技术路线是正确的,但它现在面临一个关键的时间窗口。模型越聪明,它潜在的破坏力就越大,而如果防御能力的提升速度跟不上智能能力的提升速度,剪刀差就会出现。这个剪刀差会不会出现,取决于未来半年到一年内,宇树在对抗性测试上的投入,在漏洞响应机制上的建设,在安全合规上的准备。如果这些投入到位,它有机会成为全球具身智能领域技术和安全的双重标杆。如果投入滞后,每一次技术发布都可能伴随着安全事件,侵蚀用户信任,最终限制它的发展空间。这不是唱衰,而是技术人之间常说的那句话:能力越大,责任越大。走得快是本事,走得稳更是本事。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)