【专题之MARL】A Survey on UAV Control with Multi-Agent Reinforcement Learning

本文综述了多智能体强化学习(MARL)在无人机控制领域的应用。首先介绍了强化学习的基本概念,包括单智能体强化学习(SARL)和多智能体强化学习(MARL)的区别,重点分析了MARL面临的挑战如信用分配问题、计算复杂度增加等。然后详细阐述了MARL的理论基础马尔可夫博弈,以及三类主要算法:基于价值、基于策略和演员-评论家方法。特别对基于价值的QMIX算法进行了深入解析,包括其集中式训练分散式执行的架

文章目录

文章:A Survey on UAV Control with Multi-Agent Reinforcement Learning

一、强化学习介绍

强化学习(RL),这是机器学习的三大主要范式之一。与基于数据训练的机器学习不同,RL通过经验学习,即一个代理通过执行动作并根据奖励或惩罚的形式接收反馈来实现目标。奖励告知代理行动的有效性,从而影响后续决策[46]

深度强化学习(DRL)

- PPO (Proximal Policy Opotimization)[49]

SARL(单智能体强化学习) , MARL(多智能体强化学习)

环境:通常是静态的(staict) ,指的是Agent在进行操作或者决策的时候,环境不会发生任何变化。这样的特性使得Agent 通过试错逐步改进其决策过程,例如 Q-learning[51-52], SARSAS[53]或梯度策略方法[54].SARL 具有一个agent,一个policy,一个goal ,使得更容易建模、分析和实施。

MARL,复杂性显著增加:

- 多个agent的引入,其联合行动空间呈指数级增长, 每个agent的动作选择都会影响整体状态和结果。

- 学习过程更加困难, 多个智能体需要处理大量数据和信息,计算显著增加

- 优化过程中的困难:(见Q1)

Q1:MARL的奖励维度细分和优化方向是什么?

在MARL中,奖励维度可以明确分为两类:

单维度奖励(全局共享奖励):所有智能体收到同一个奖励信号,这个信号反映的是整个多智能体系统的整体表现,比如多机器人协同搬运物体时,物体是否被成功搬运到目标点。

多维度奖励(个体专属奖励):每个智能体收到独立的奖励信号,这个信号反映的是该智能体自身的表现,比如多智能体竞技游戏中,每个智能体各自的击杀数、生存时间对应的奖励。

🧩 单维度奖励下的信用分配问题

当MARL采用单维度奖励时,确实会面临信用分配难题——全局奖励是所有智能体共同作用的结果,无法直接对应到单个智能体的动作贡献。从第一性原理拆解,解决这个问题的核心是把全局奖励"拆解"到每个智能体的动作上,具体方法分为三类:

- 轨迹回溯法:通过记录每个智能体的动作序列和环境状态变化,反向计算每个动作对全局奖励的边际贡献,比如通过梯度回溯,把全局奖励的梯度按动作的影响权重分配给每个智能体。

- 差异比较法:对比"有该智能体动作"和"无该智能体动作"时的全局奖励差异,以此量化该智能体的贡献,比如消融实验的思路,逐个移除智能体的动作,观察奖励变化。

- 角色定位法:根据智能体在系统中的预设角色,分配对应的奖励权重,比如在多机器人协同中,负责导航的机器人和负责抓取的机器人,根据任务难度预设不同的奖励分配比例。

🚀 多维度奖励下的优化方向

当MARL采用多维度奖励时,每个智能体可以直接根据自身的奖励信号优化策略,但这会带来新的问题,从第一性原理出发,解决思路聚焦在个体目标与全局目标的对齐上:

- 奖励塑形(Reward Shaping):在个体奖励中加入全局奖励的加权项,引导智能体在优化自身目标的同时,兼顾全局利益,比如在多智能体竞技游戏中,给击杀敌人的智能体基础奖励,同时给协助击杀的友方智能体额外奖励。

- 通信机制引入:让智能体之间可以交换状态和意图信息,帮助每个智能体理解自身动作对其他智能体的影响,从而调整策略实现全局最优,比如多机器人通过通信共享位置和任务进度,调整各自的移动路径。

- 分层强化学习:把系统分为全局层和个体层,全局层负责优化全局目标,个体层负责执行全局层下达的子任务,通过层级化的目标分解,实现个体奖励与全局奖励的对齐,比如在供应链协同中,全局层优化整体配送效率,个体层(各个配送机器人)优化自身的配送路径。

Q2:多维度下的分层强化学习的优化案例是什么?

🌐 全局层:强化学习控制器

-

核心目标: 接收环境的全局状态,输出全局最优的任务分配策略,最大化全局奖励(比如系统整体效率、资源利用率等)。

-

关键组件

状态空间:包含环境的全局信息(如多机器人场景中的任务总量、资源分布、整体进度)和所有个体的状态汇总(如每个机器人的位置、负载、剩余电量)。

动作空间:输出任务分配指令,比如给每个机器人分配具体的任务类型、任务优先级、任务目标位置。

奖励函数:- 全局维度:系统整体任务完成率、资源消耗率、总耗时等全局指标对应的奖励;

- 协调维度:个体任务负载均衡度、任务冲突率等反映个体协同效果的奖励。

-

学习算法:采用PPO(近端策略优化)或DQN(深度Q网络),学习稳定的全局任务分配策略,定期根据个体层的执行反馈更新策略。

🤖 个体层:强化学习执行者

-

核心目标: 接收全局层分配的子任务,输出局部最优的执行策略,最大化个体奖励(比如自身任务完成效率、能耗成本等),同时满足全局层的任务约束。

-

关键组件

状态空间:包含全局层分配的子任务信息(如任务类型、优先级、目标)和个体的局部环境信息(如自身位置、周边障碍物、可用资源)。

动作空间:输出个体的具体执行动作,比如机器人的移动路径、操作时序、资源调度策略。

奖励函数:- 个体维度:自身任务完成时间、能耗、成功率等个体指标对应的奖励;

- 全局约束维度:对不满足全局层任务约束(如超时、任务冲突)的行为设置惩罚项,确保个体动作符合全局目标。

-

学习算法:采用DQN、SAC(软 Actor-Critic)等算法,学习高效的局部执行策略,同时通过全局约束奖励的引导,保证个体策略与全局策略的对齐。

🔄 两层协同机制

指令下达:全局层根据环境全局状态和学习到的策略,向每个个体层分配子任务和约束条件;

执行反馈:个体层执行子任务后,将自身的执行结果(如任务完成情况、资源消耗、局部环境变化)反馈给全局层;

策略更新:全局层根据个体层的反馈和全局奖励信号,更新全局任务分配策略;个体层根据自身的执行结果和个体奖励信号,更新局部执行策略;

循环迭代:通过"全局指令-个体执行-结果反馈-策略更新"的循环,实现两层策略的协同优化,最终达到全局奖励与个体奖励的平衡

1.1 SAML的理论基础:MDP

MDP(马尔科夫决策过程)

MDP 是一个五元组: M = ( S , A , P , R , , γ ) \mathcal{M} =(\mathcal{S,A,P,R},,\gamma) M=(S,A,P,R,,γ)

其中:

S \mathcal{S} S:状态空间(所有可能的状态集合)。

A \mathcal{A} A:动作空间(所有可能的动作集合)。

P \mathcal{P} P:状态转移概率,表示在状态s下执行动作a后转移到状态s’的概率。

R:奖励函数,表示在状态s下执行动作a获得的期望奖励。

γ:折扣因子(0 ≤ γ < 1),用于平衡即时奖励与未来奖励之间的权衡。

MDP的核心特征包括:

- 马尔可夫性:下一状态仅依赖于当前状态,与历史无关。

- 动作引入:与马尔可夫过程不同,MDP引入了动作,即下一状态不仅依赖于当前状态,还依赖于当前动作。

- 目标:通过是学习一个策略 (policy) π : S → A \pi:\mathcal{S \to A} π:S→A,以最大化预期累积折扣奖励 E π [ ∑ t = 0 ∞ γ t R ( s t , a t ) ] \mathbb{E}_{\pi}[\sum_{t=0}^{\infty} \gamma^t \mathcal{R}(s_t,a_t)] Eπ[∑t=0∞γtR(st,at)]

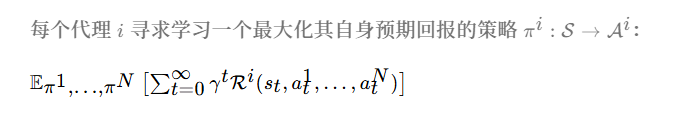

1.2 MARL的某一个理论基础:马尔科夫博弈(随机博弈)

MARL引入了多个智能体进入同一个环境中。元组定义为:

G = ( S , { A i } i = 1 N ) , P , { R i } i = 1 , N , γ ) \mathcal{G=(S,\{ A^i\}_{i=1}^N) ,P,\{ R^i \}_{i=1},^N ,\gamma )} G=(S,{Ai}i=1N),P,{Ri}i=1,N,γ)

其中:

- S \mathcal {S} S是全局状态

- A i \mathcal{A}^i Ai:是智能体i的动作空间,联合动作空间为 A q × ⋯ × A N A^q \times \cdots \times A^N Aq×⋯×AN

- P ( s ′ ∣ s , a 1 , ⋯ , a N ) \mathcal{P}(s'|s,a^1 ,\cdots, a^N) P(s′∣s,a1,⋯,aN)是转移函数,确定在给定当前状态s和联合动作 ( a 1 , ⋯ , a N ) (a^1,\cdots,a^N) (a1,⋯,aN)下转移到状态 s ′ s' s′的概率

- R i ( s , a 1 , ⋯ , a N ) \mathcal{R}^i(s,a^1,\cdots,a^N) Ri(s,a1,⋯,aN)是智能体i的奖励函数。

- γ:折扣因子(0 ≤ γ < 1)

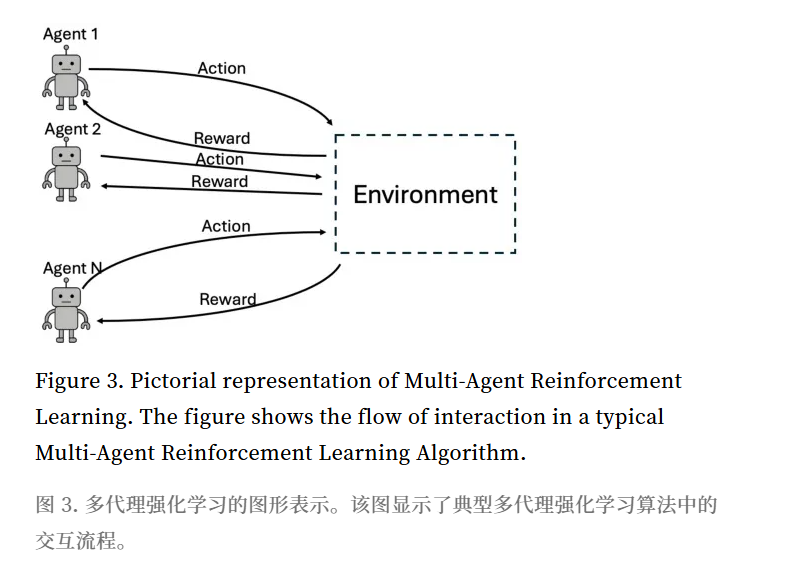

MARL带来了独特的挑战:尽管只有一个环境和一个集体状态,但多个代理的存在需要各自独立的策略,并导致了多样化的奖励。其他主要挑战来自环境的非稳定性以及规模或维度[61,62]。MARL算法可以大致分为三类[63]:

- 基于价值的MARL,专注于更新状态-动作对的价值函数;

- 基于策略的MARL,直接优化指导代理行动的策略函数;

- 以及结合了价值方法和策略方法优势的演员-评论家方法

二 基于价值的MARL

主要目标是准确估计最优状态-动作或状态-值函数,通常称为最优Q函数( Q ∗ Q^* Q∗)

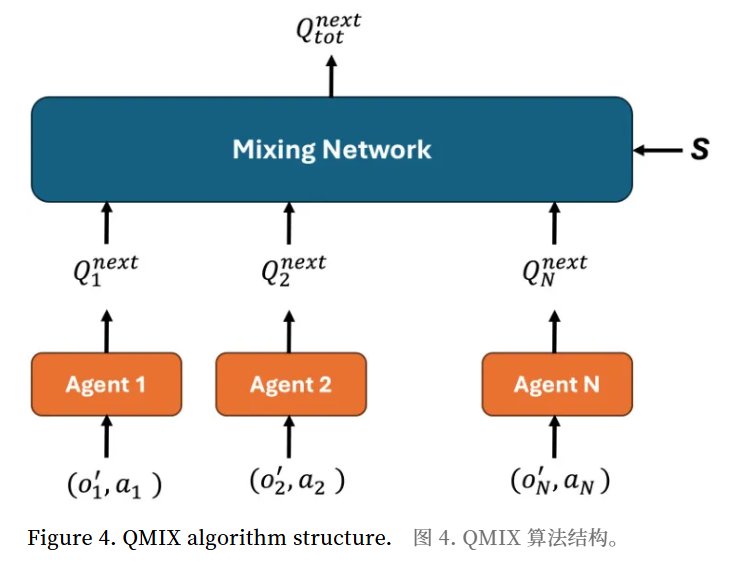

2.1 QMIX

QMIX是一种深度多智能体强化学习(MARL)技术,旨在在一个集中式训练框架内学习分散的策略,有效地利用额外的状态信息[68].

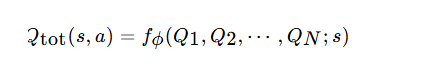

QMIX学习技术的高级结构如图4所示,算法在算法1中呈现。该算法的关键思想是允许集中式训练,并访问全局状态s和分散执行,其中每个代理仅根据其局部观察值 o i o_i oi 选择动作。每个代理学习一个单独的动作-价值函数 Q i ( o i , a i ) Q_i(o_i,a_i) Qi(oi,ai) ,仅基于其局部观察值 o i o_i oi 。在训练期间,这些单独的Q值通过混合网络组合成一个全局的动作-价值对:

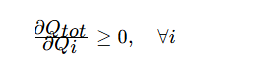

f ϕ f_{\phi} fϕ 是由参数 ϕ \phi ϕ 定义的混合网络,该网络结合了全局状态 s 来指导学习过程。为了确保去中心化执行是可行的,混合网络在每个代理的 Q 值中被约束为单调递增

该约束保证了最大化 Q i ( o i , a i ) Q_i(o_i,a_i) Qi(oi,ai) 对每个代理的增益,从而使得分散式贪婪行动选择有效。

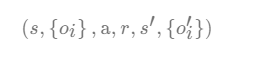

replay buffer

在训练过程中,将转换存储在一个重播缓冲区中,并以以下形式表示:

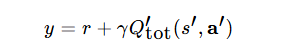

== update rule==

每个agent i 使用目标网络选择 a i ′ = arg m a x a Q i ′ ( o i ′ , a ) a_i' =\arg max_a Q_i'(o_i',a) ai′=argmaxaQi′(oi′,a)

loss function

然后应用梯度下降法来最小化这个损失并更新两个代理网络和混合网络。

算法

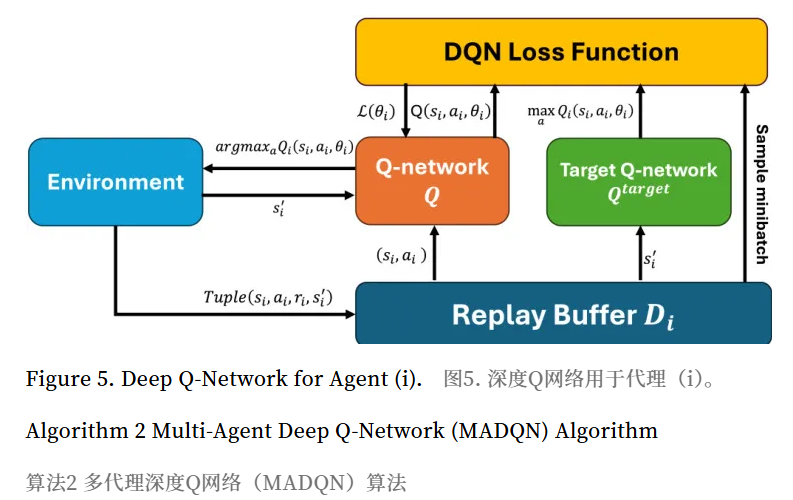

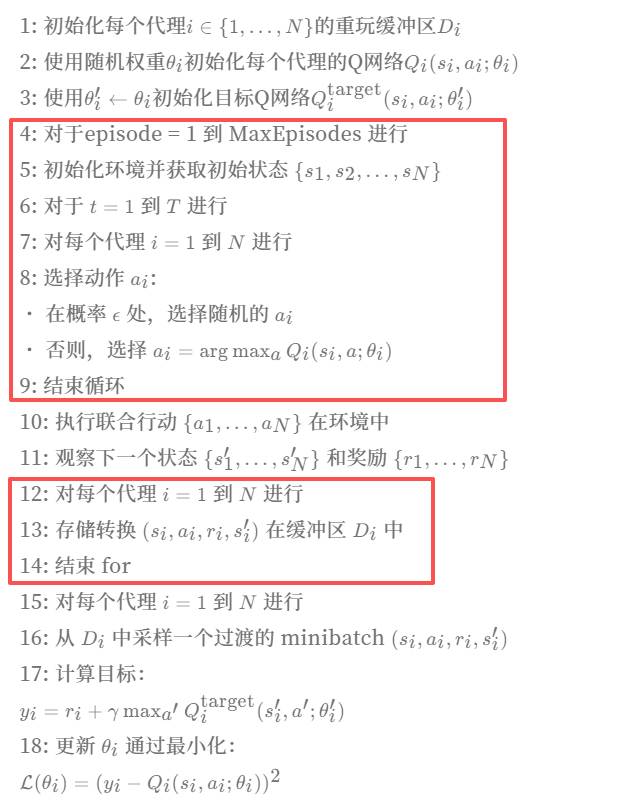

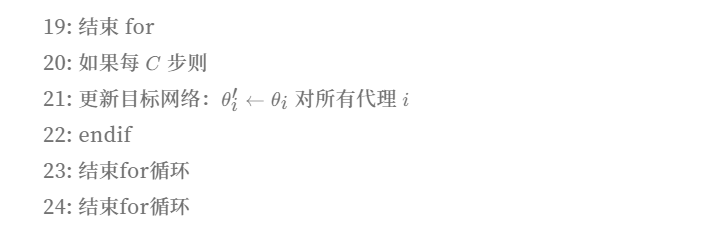

2.2 多智能体深度Q网络(MADQN)

算法扩展了经典的深度Q网络(DQN),适用于涉及多个智能体的环境。每个智能体独立学习其自身的Q函数,如图5所示,使用局部观察和奖励.

算法

算法2在训练和执行过程中都是完全去中心化的。初始化阶段,每个智能体分别用权重 θ i \theta_i θi 和 θ i ′ \theta '_i θi′ 初始化其Q网络

和目标网络 Q i t a r g e t Q_i^{target} Qitarget ,并为每个智能体i创建一个重播缓冲区 D i D_i Di 。在每个回合中,环境重置并获得初始状态

{ s 1 , s 2 , ⋯ , s N } \{ s_1,s_2,\cdots,s_N\} {s1,s2,⋯,sN} 。每个智能体 i选择一个动作 a i a_i ai ,然后在环境中执行联合动作 { a 1 , ⋯ , a N } \{ a_1,\cdots, a_N\} {a1,⋯,aN} ,同时观察下一个状态 { s 1 ′ , ⋯ , s N ′ } \{s_1',\cdots,s'_N \} {s1′,⋯,sN′} 和奖励 { r 1 , ⋯ , r N } \{r_1,\cdots,r_N\} {r1,⋯,rN} 。每个智能体将其经验 ( s i , a i , r i , s i ′ ) (s_i,a_i,r_i,s_i') (si,ai,ri,si′) 存储在其重播缓冲区 D i D_i Di 中。

采样后,从目标中计算出一个 minibatch 的转移:

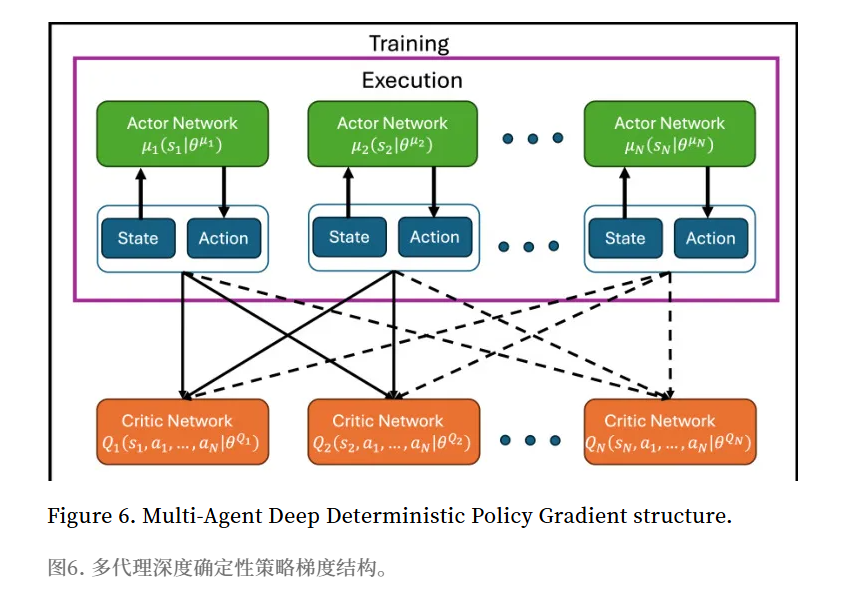

2.3 比较

三 基于策略的多智能体强化学习技术

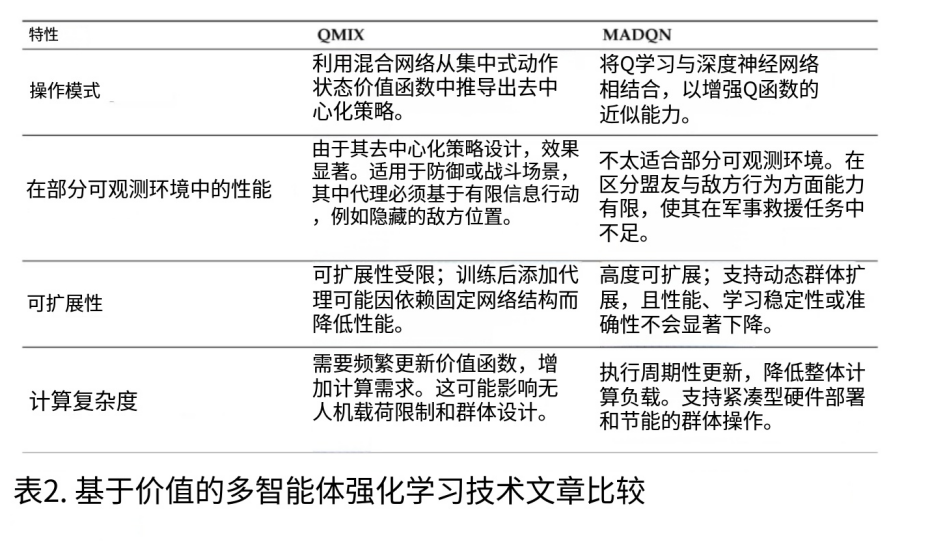

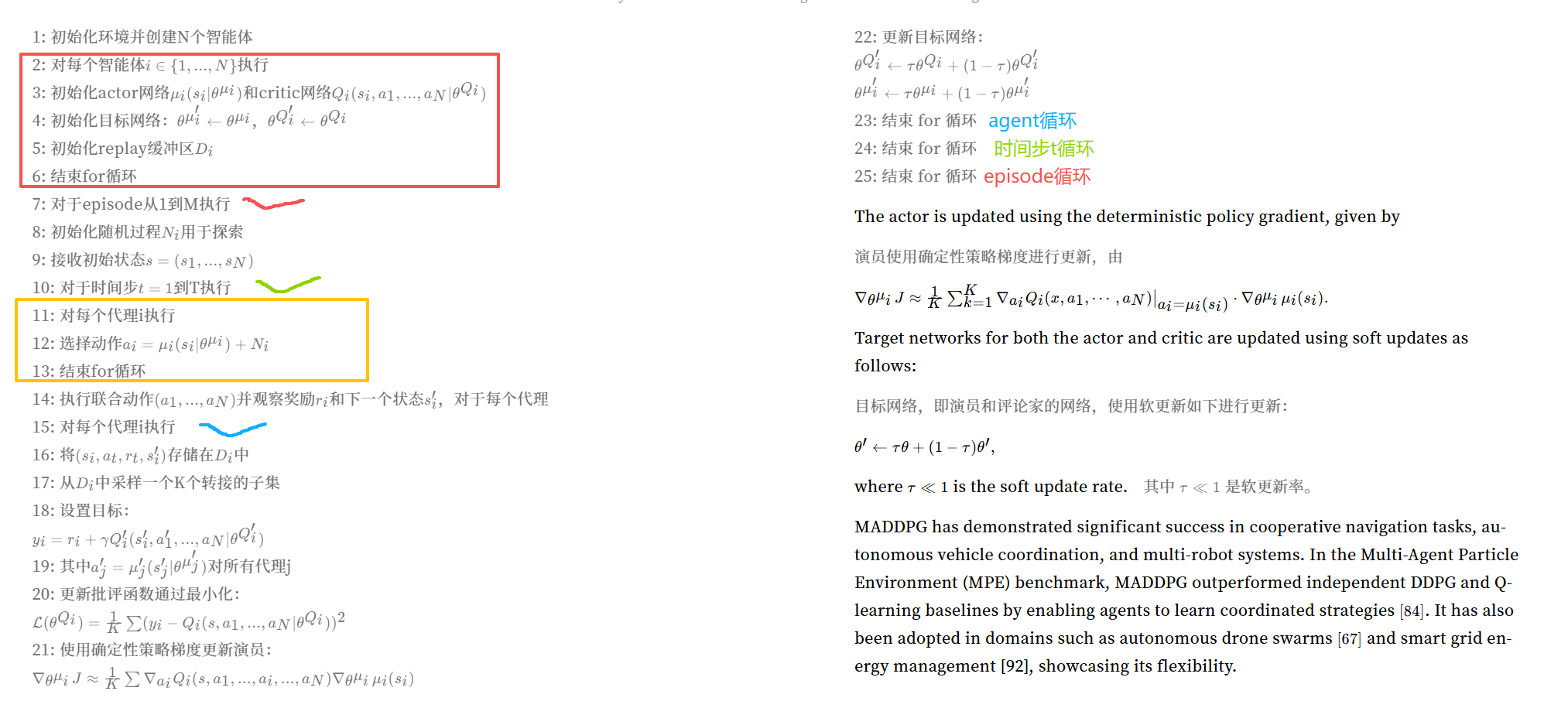

3.1 多智能体DDPG(MADDPG)

深度确定性策略梯度(DDPG)是一种无模型离线策略-评论算法,它采用确定性策略来解决深度Q网络(DQN)中固有的离散动作空间的挑战[95]。与之相对的是,DQN通过经验回放和冻结目标网络来稳定Q函数学习过程。

多智能体DDPG(MADDPG)扩展了DDPG框架到多个同步操作的环境中,每个智能体使用局部观察的信息[84]。在MADDPG中,由于来自其他智能体的连续策略更新,每个智能体都感知环境为动态的,这些智能体的策略是未知的。该设计旨在应对分布式决策和非平稳性带来的挑战。

它由[84]作为深度确定性策略梯度(DDPG)算法[55]的一个扩展而引入,用于涉及多个智能体的合作和竞争环境。在单智能体强化学习中,DDPG已被证明在使用确定性策略-评论架构的连续动作空间中表现良好。

DDPG在多智能体环境中独立进行,导致学习动态非平稳,因为环境的状态分布随着其他智能体的策略变化而改变[83,89]。这种非平稳性可能会降低学习性能甚至导致分发。为了解决这个问题,MADDPG引入了集中式训练和分散执行(CTDE)[centralized training and decentralized execution]范式。

在训练期间,每个智能体都可以访问一个集中的批评器,该批评器考虑所有智能体的全局状态和行动。这使得批评器能够估计更准确的梯度,尽管由于其他学习智能体的影响导致了非平稳性。然而,在执行过程中,每个智能体仅使用本地观察结果,从而实现了可扩展性和在现实分布式系统中的适用性[84].

Q4:为什么引入 CTDE? 只要涉及MARL就需要引入吗?

在多智能体环境中,当多个智能体同时进行学习时,每个智能体所处的环境是动态变化的。由于其他智能体的策略也在不断更新,这使得从单个智能体的视角来看,环境是不稳定的,即非平稳的。这种非平稳性会破坏强化学习中假设的马尔可夫性质,从而影响学习的稳定性和收敛性。

引入CTDE后。在训练阶段,MADDPG采用集中式训练,即所有智能体的全局信息(包括所有智能体的状态和动作)被用于优化策略,从而缓解了非平稳性问题。在执行阶段,每个智能体仅依赖于自身的局部观测进行决策,无需全局信息,这使得算法在实际部署中更加实用.

CTDE是MARL中常用的架构之一,但不是唯一选择,MARL的训练执行模式主要分为三类:

- 完全分散式(Decentralized Training Decentralized Execution, DTDE):训练和执行阶段都没有中央控制器,每个智能体独立学习和决策,比如基于独立Q学习的多智能体系统;

- 完全集中式(Centralized Training Centralized Execution, CTCE):训练和执行阶段都由中央控制器统一决策,智能体仅执行指令,适合高度协同的场景,但容错性差;

- 集中式训练分散式执行(Centralized Training Decentralized Execution, CTDE):训练阶段利用中央控制器获取全局信息优化策略,执行阶段智能体独立决策,是目前MARL中应用最广泛的架构。

✅ CTDE的核心优势

-

解决非平稳环境问题

在MARL中,其他智能体的策略变化会导致环境对当前智能体呈现非平稳性,CTDE在训练阶段可以获取全局状态和所有智能体的动作信息,让智能体学习到更鲁棒的策略,缓解非平稳环境带来的学习困难。 -

提升学习效率

训练阶段的中央控制器可以利用全局信息进行信用分配,更准确地评估每个智能体动作对全局奖励的贡献,加速智能体的策略收敛,减少训练时间和样本需求。 -

兼顾执行阶段的灵活性

执行阶段智能体独立决策,不需要依赖中央控制器,系统具有更好的容错性和扩展性,即使部分智能体故障,其他智能体仍能继续执行任务,适合实际工程场景。 -

平衡个体与全局目标

训练阶段可以基于全局奖励优化策略,引导智能体在执行阶段兼顾个体利益与全局最优,避免完全分散式训练中可能出现的"局部最优"或"囚徒困境"问题

❌ CTDE的主要劣势

-

训练与执行的差异问题

训练阶段智能体可以获取全局信息,而执行阶段只能获取局部信息,这种信息差异可能导致训练好的策略在执行阶段表现下降,即"训练-执行鸿沟"问题。 -

通信与计算成本较高

训练阶段需要中央处理器收集和处理全局信息,当智能体数量较多时,通信带宽和计算资源的消耗会大幅增加,限制了系统的可扩展性。 -

隐私与安全风险

训练阶段收集全局信息可能涉及智能体的敏感数据,存在隐私泄露的风险;同时,中央控制器如果被攻击,可能会影响整个系统的训练过程。 -

策略迁移难度大

基于特定环境全局信息训练的策略,在环境结构或智能体数量变化时,可能需要重新训练,策略的泛化能力和迁移性较差

MADDPG结构

在MADDPG中,每个智能体 i ∈ { 1 , ⋯ , N } i \in \{1,\cdots,N\} i∈{1,⋯,N}学习一个确定性策略(演员) μ i ( s i ; θ μ i ) \mu_i(s_i;\theta^{\mu_i}) μi(si;θμi) ,其中 s i s_i si 是智能体

的局部观察值, θ μ i \theta^{\mu_i} θμi 表示演员网络的参数。相应的动作由 a i = μ i ( s i ) a_i=\mu_i(s_i) ai=μi(si) 给出。

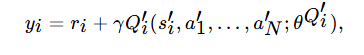

在训练期间,每个代理还维护一个集中式评价网络 Q i ( s i , a q , ⋯ , a N ′ θ Q i ) Q_i(s_i,a_q,\cdots,a_N'\theta^{Q_i}) Qi(si,aq,⋯,aN′θQi) ,其中 x x x 是全局状态(可能包括所有代理的观察结果), a 1 , … , a N a_1,\dots,a_N a1,…,aN 是所有代理的动作,而 θ Q i \theta^{Q_i} θQi 是评价器的参数。评价器训练的目标值计算为

r i r_i ri 是代理 i 收到的奖励,E\gammaE 是折扣因子, Q i ′ Q_i' Qi′ 是目标批评网络,而 a j ′ = μ j ′ ( s j ′ ; θ μ j ) a'_j =\mu'_j(s'_j;\theta^{\mu_j}) aj′=μj′(sj′;θμj) 是在下一个状态 s j ′ s'_j sj′ 上由目标行动网络预测的动作,对于所有代理 j j j,

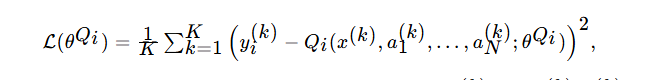

批评网络通过最小化以下损失函数进行更新:

其中K是小批量大小, ( x ( k ) , a 1 ( k ) , ⋯ , a X ( k ) , y i ( k ) ) (x^{(k)} ,a_1^{(k)},\cdots, a_X^{(k)}, y_i^{(k)}) (x(k),a1(k),⋯,aX(k),yi(k)) 来自重播缓冲区。

算法

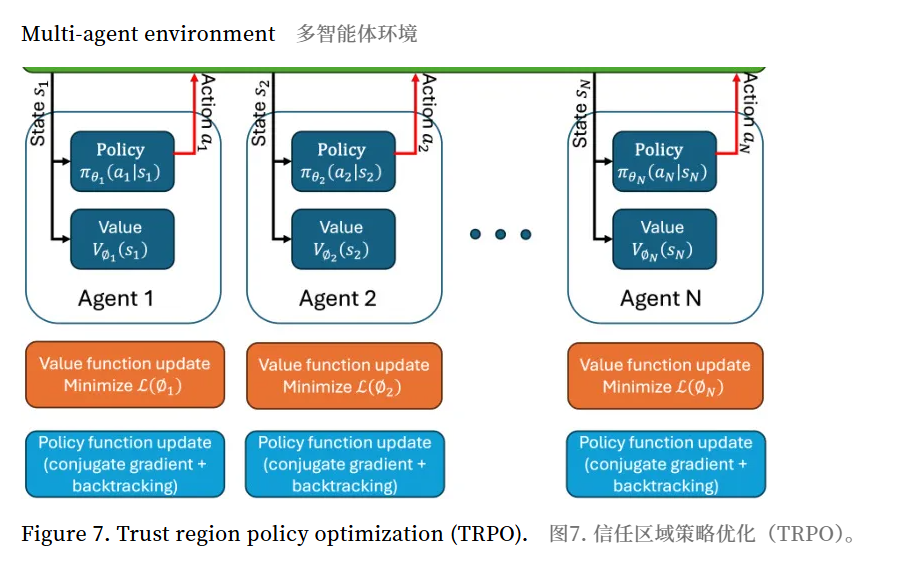

3.2 MATRPO 多代理信任区域策略优化

信任区域策略优化 (TRPO) 的目标是通过引入KL散度约束来减少每次步骤的参数更新次数,从而降低参数更新的频率[98]。然而,TRPO并未完全解决最小化参数更新的问题,这使得它在控制硬件代理时不够可靠。这一局限性导致了PPO算法的发展。

Multi-Agent Trust Region Policy Optimization (MATRPO) 多智能体信任区域策略优化(MA-TRPO)扩展了信任区域策略优化(TRPO)的原则,应用于多智能体强化学习(MARL)场景。由[99]提出的多智能体信任区域策略优化(MATRPO)算法,该算法将TRPO更新重新表述为分布式共识优化问题。这种方法允许智能体基于局部观察和私有奖励进行优化,而无需访问其他智能体的信息,从而促进了去中心化和隐私保护的学习过程。实验证明MATRPO在多智能体协同任务中具有很好的鲁棒性。

在MATRPO这个框架下,一组智能体{ 1 , 2 , ⋯ , N 1,2, \cdots, N 1,2,⋯,N}与一个被建模为马尔可夫博弈的共享环境进行交互。每个智能体 i i i都有自己的策略

π θ i ( a i ∣ s i ) \pi_{\theta_i}(a_i | s_i) πθi(ai∣si) 和价值函数 V ϕ i ( s i ) V_{\phi_i}(s_i) Vϕi(si) ,其中 和 分别表示各自的参数向量。智能体观察到局部状态 s i s_i si ,采取行动 o i o_i oi ,并收到奖励 r i r_i ri ,目标是最大化期望回报 E [ R i ] \mathbb{E}[R_i] E[Ri] 。训练是在集中式训练、分布式执行(CTDE)范式下进行的.

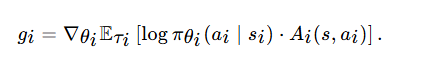

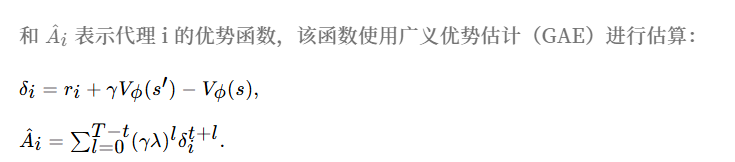

在每次迭代中,每个智能体通过执行其当前策略在环境中收集轨迹 τ i \tau_i τi 。优势函数 A i ( d . a i ) A_i(d.a_i) Ai(d.ai) ,通常使用广义优势估计(GAE)来计算,用于评估采取动作 a i a_i ai 在状态 s 中的好处。智能体 i i i 的策略梯度计算为

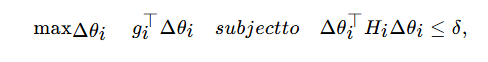

为了确保稳定的更新,MATRPO 使用Kullback–Leibler(KL)散度在旧和新策略之间引入信任区域约束。这导致了以下受约束的优化问题:

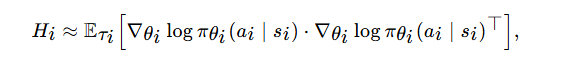

其中 H i H_i Hi 是样本平均KL-散度的Hessian矩阵,近似为

δ \delta δ 是一个预定义的KL散度界。最优更新方向 Δ θ i \Delta \theta_i Δθi 使用共轭梯度法计算,然后通过回溯线搜索来强制满足KL约束。

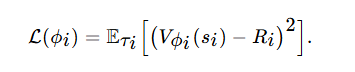

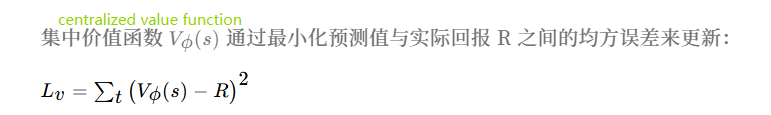

最后,每个代理通过最小化预测回报与实际回报之间的均方误差来更新其价值函数:

算法

3.3 HATRPO

异构代理信任区域政策优化(HATRPO)算法[102],该算法引入了顺序策略更新方案和多代理优势分解引理。HATRPO使具有不同策略和价值函数结构的代理能够有效地学习,而无需共享参数或依赖于关于联合价值函数可分解性的限制性假设。这种方法在包括Multi-Agent MuJoCo和StarCraft II任务在内的各种基准测试中表现出了卓越的性能。

3.4 MATRL

Wen等人[103]提出了一个多智能体系统中的信任区域优化博弈论公式化方法,从而产生了多智能体信任区域学习(MATRL)方法。MATRL使用纳什均衡概念来指导策略更新,并确保在竞争和合作环境中收敛,进一步加强了信任区域方法在多智能体学习中的理论基础。

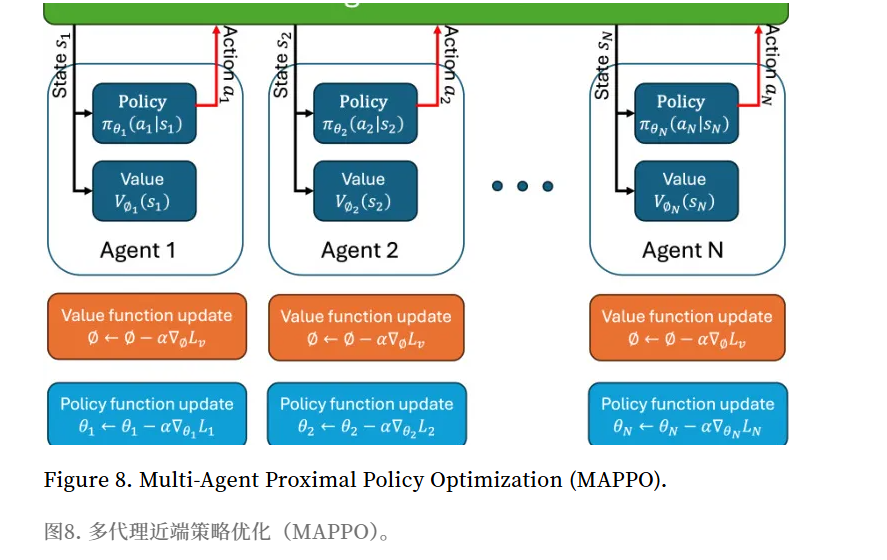

3.5 MAPPO 多代理近端策略优化

PPO通过使用批量导航示例和小批量随机梯度下降来优化目标[87],简化了算法,消除了KL惩罚并减少了对通用更新的需求。它在当前策略

π \pi π和先前策略 π o l d \pi_{old} πold之间平衡更新,防止过度更新超出样本提供可靠估计的区域。PPO还与actor-critic框架集成,每个代理使用一个actor和多个critic网络进行更快、更分布式的学习.

多代理近端策略优化(MAPPO)是Proximal Policy Optimization(PPO)算法的一个扩展,适用于多代理强化学习(MARL)环境。它采用集中训练、分散执行(CTDE)框架,在此框架中,每个代理学习其策略,而中央批评器评估联合行动,从而在合作设置中实现稳定学习。

在MAPPO中,每个智能体i根据其自身的局部观察值 s i s_i si 学习一个分散的策略 π θ i ( a i ∣ s i ) \pi_{\theta_i}(a_i|s_i) πθi(ai∣si) ,同时受益于训练期间访问全局状态s的集中式评价器 V ϕ ( s ) V_{\phi}(s) Vϕ(s) 。

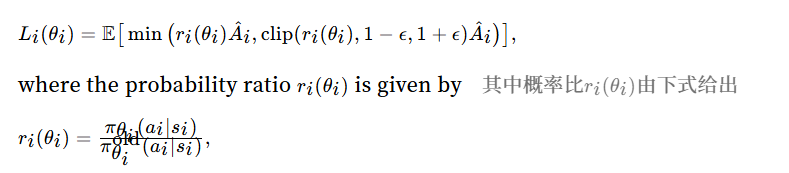

每个代理的学习目标从PPO的剪辑后验损失中得到,该损失通过防止新旧策略之间的大偏差来稳定策略更新。代理i的替代损失函数定义为

这里, λ \lambda λ 是折扣因子,控制优势估计中的偏差-方差权衡。

算法

3.6 AM-MAPPO

刘等人[113]提出了一种基于动作掩码的多智能体近端策略优化(AM-MAPPO)算法

3.7 比较

表3.基于无人机群控制的政策梯度算法比较。

| 评估维度 | MADDPG(深度确定性策略梯度的多智能体版本) | TRPO(信任区域策略优化) | PPO(近端策略优化) |

|---|---|---|---|

| 运作方式 | 采用确定性策略梯度,结合演员-评论家网络,适配连续动作空间。 | 通过约束KL散度来最小化策略更新,实现更稳定的优化过程。 | 使用裁剪目标限制策略偏差,通过随机梯度下降实现更稳定的更新。 |

| 动作空间 | 连续型 | 连续型(也可扩展至离散型) | 离散型和连续型 |

| 随机性/确定性 | 确定性策略 | 随机策略 | 随机策略 |

| 稳定性 | 在中等规模应用中表现稳定 | 理论稳定性高,但实际应用中对条件敏感 | 稳定性极强;在各类任务中都表现可靠 |

| 可扩展性 | 中等;更适用于中小型多智能体集群 | 较差;不适用于大规模应用 | 高;在大型多智能体系统中表现优秀 |

| 在多智能体强化学习中的应用 | 应用广泛(例如,采用去中心化智能体的MADDPG) | 因复杂度较高在多智能体强化学习中应用较少;多处于实验阶段 | 应用非常普遍;MAPPO(多智能体近端策略优化)在协作式多智能体强化学习中被广泛使用 |

| 计算需求 | 计算需求中等——资源消耗高于PPO但低于TRPO。若无人机内存容量充足且更新频率低,则适用。 | 计算需求最高,因涉及二阶导数。最适合具备高资源处理能力的平台或离线学习场景。 | 计算效率最高。适用于无人机集群这类机载计算资源有限的场景。 |

| 收敛速度 | 三者中收敛速度最慢,需要更多训练时间,不适用于无人机集群。 | 收敛速度快于MADDPG但慢于PPO。适用于不频繁决策的无人机集群应用。 | 收敛速度最快。非常适合需要对动态环境快速响应的实时应用。 |

| 收敛精度 | 收敛过程稳定可靠,但精度略低于PPO。适用于精度要求不高的任务,例如搜救任务。 | 精度与MADDPG相当,但存在不稳定性,因此不太适合实际部署。 | 收敛精度最高且过程稳定。适用于对精度要求极高的任务,例如基于无人机的目标定位或监视。 |

| 实现复杂度 | 中等复杂。比TRPO容易实现,但因依赖多智能体架构,比PPO更复杂。 | 实现复杂,因涉及二阶KL散度约束。最适合在受控的研究环境中使用。 | 三者中实现最简单。其裁剪目标设计使其易于部署,非常适用于无人机集群的快速落地场景。 |

表4. 基于政策的多代理强化学习技术之间的比较。

| 论文编号 | 环境类型 | 训练技术 | 集群规模 | 成功率² | 可扩展性³ | 故障容忍度⁵ | 收敛性⁴ |

|---|---|---|---|---|---|---|---|

| [49] | 无人机目标搜索 | 带奖励塑造的深度强化学习 | 1 | ~85% | - | 有限基础避障 | 中等,>2000 |

| [67] | 动态3D障碍物环境 | Q学习 | 4 | ~85% | - | 有限基础碰撞避障(效果差) | 中等,>2000 |

| [90] | 2D静态环境 | 多智能体近端策略优化 | 5个智能体 | ~80% | 低(静态设置) | 有限 | 中等¹,>800 |

| [97] | 动态威胁环境 | STAPP框架下的多智能体深度确定性策略梯度 | 5架无人机 | 90-95% | 中等 | 是(未测试) | 慢,>150000 |

| [105] | 可变规模无人机网络 | 基于Transformer的多智能体强化学习 | 8架无人机 | ~97%平均覆盖率 | 高 | 鲁棒 | 快 |

| [106] | 无人机路径规划 | 集中式多智能体深度确定性策略梯度 | 20架无人机 | ~95%目标覆盖率 | 中等 | 有限 | 快,<100 |

| [107] | 资源共享的城市模拟环境 | 深度确定性策略梯度 | 10架无人机 | ~90% | 中等 | 中等(备份无人机) | 中等,<1000 |

| [109] | 城市交叉口(网联自动驾驶汽车) | 多智能体近端策略优化 | 3-5(50) | ~88% | 有限(网联自动驾驶汽车范围) | 安全约束 | 中等,>2000 |

| [111] | 移动目标与障碍物 | ETS-MAPPO STEE | + 29 | 比基线高>30% | 中等 | STEEN促进资源分配 | 中等,<1600 |

| [112] | 交通合流(网联自动驾驶汽车) | MAPPO-PIS | 6-10 | 优于MAPPO | 高 | 安全增强模块 | 慢,>10000 |

| [113] | 多无人机目标跟踪 | AM-MAPPO | 3-8 | 仅在目标搜索中表现更好 | 高 | 冗余覆盖 | 中等,<2000 |

表格底部标注说明

¹ 中等

² 成功率

³ 可扩展性

⁴ 收敛性

⁵ 故障容忍度

四 Multi-Agent Federated Reinforcement Learning Techniques(MAFRL) 多代理联邦强化学习技术

Federated Learning (FL)联邦学习(FL)作为一种强大的框架,为实现去中心化智能提供了支持,特别是在数据隐私和通信限制至关重要的场景中。当结合多代理强化学习(MARL)时,FL促进了分布式代理在多个边缘设备或环境中协同学习共享策略或价值函数,而无需直接访问本地数据。这种协同作用使代理能够在保持数据局部性和减少带宽使用的同时,进行协作学习。在联邦MARL中,每个代理或一组代理独立地与环境交互以收集经验并更新本地模型,然后通过联邦平均(FedAvg)等技术在中央服务器或协调器上定期聚合这些模型。这些方法有助于解决MARL中的关键挑战,包括可扩展性、代理经验的异质性和安全问题。

多智能体联邦强化学习(MAFRL)技术已成为建立稳定[114]和智能通信网络的强大范式,特别是在涉及分布式和移动代理(如无人机)的场景中.

表5. 引用的MAFLR技术之间的比较。

| 论文编号 | 集群规模 | (平均单轮时长)/总轮数 | 累计奖励 | 应用场景 | 优势 | 劣势 |

|---|---|---|---|---|---|---|

| [118] | 5 | 8.093秒/420轮 | 2000 | 无人机辅助网络的轨迹设计 | 融合了对决式DDQN和多步引导技术 | 部分场景下不收敛,部分场景训练时长超2000秒;扩展性差,仅适用于静态服务器无人机 |

| [119] | 10 | 0.5664秒/20000轮 | 0.4 | 无人机资源管理 | 采用PPO算法,收敛过程稳定 | 依赖中央服务器,扩展性不足 |

| [121] | 3 | 0.738秒/1000轮 | 80 | 多无人机网络的轨迹控制 | 联合优化轨迹设计与通信公平性 | 假设无人机与服务器之间通信稳定可靠;采用MADDPG算法增加了训练复杂度 |

| [122] | 6 | 1.492秒/1200轮 | 200 | 无人机部署与资源分配 | 去中心化架构,扩展性强;优化无人机定位与通信资源分配 | 无联邦隐私保护机制;未考虑能源效率 |

| [120] | 6 | -/4000轮 | 1.5 | 无人机轨迹优化 | 分布式隐私保护设计;支持应急响应场景下的轨迹优化 | 依赖中央聚合器;信道模型设计过于简化 |

4.1 MARL学习技术之间的比较

表6. 扩展的MARL学习技术比较。

| 评估维度 | 基于价值的多智能体强化学习 | 基于策略的多智能体强化学习 | 联邦多智能体强化学习 |

|---|---|---|---|

| 核心思想 | 学习联合或分解的价值函数(如Q值) | 直接学习去中心化策略 | 在保护数据本地性的同时,在智能体间分布式开展学习 |

| 代表性算法 | QMIX、VDN、QTRAN、WQMIX | MAPPO、MADDPG、TRPO、HAPPO | FedRL、FedMARL、FedAvg+MARL |

| 动作空间 | 离散型 | 连续型与离散型 | 两者皆可(取决于本地模型) |

| 性能表现 | 在结构化/协作任务中表现出色 | 在连续动态任务中表现出色 | 中等至优异;取决于聚合频率与带宽 |

| 适用环境 | 完全可观测或低噪声离散场景表现最佳 | 在动态、部分可观测或连续环境中表现良好 | 非常适合分布式、隐私敏感、带宽受限的环境 |

| 可扩展性 | 中等(受限于价值函数复杂度) | 高(去中心化执行效率高) | 高(支持大规模分布式系统) |

| 通信开销 | 低至中等 | 中等(取决于策略共享方式) | 低(仅共享模型参数) |

| 训练稳定性 | 对智能体数量与可观测性敏感 | 配合恰当的探索方法(如GAE)时稳定性更强 | 取决于同步方法与本地训练精度 |

| 收敛速度 | 在简单场景下收敛快 | 中等;需要更多样本但收敛稳定 | 因延迟聚合与异构性导致收敛较慢 |

| 动态环境适应性 | 低至中等 | 高 | 高(支持模型个性化) |

| 隐私保护能力 | 原生不支持 | 原生不支持 | 强(数据保留在本地) |

| 无人机场景适用性 | 适用于协作型离散任务(如覆盖任务) | 是连续控制任务的理想选择(如编队、跟踪) | 适用于有隐私与带宽约束的分布式无人机系统 |

表6简要比较了多智能体强化学习(MARL)技术。该比较总结了与无人机控制相关的关键点,具体取决于环境、应用和性能要求等因素。基于价值的、基于策略的以及联邦多智能体强化学习(MARL)技术之间的比较揭示了在关键性能维度上的不同优势和局限性。基于价值的方法,如QMIX和QTRAN,专注于学习联合或分解的价值函数,并且通常在更简单或离散环境中效率更高,但在部分可观测或动态设置中可能面临可扩展性和不稳定性问题。相比之下,基于策略的方法,如MAPPO和MADDPG,直接优化分散式或集中式的策略,提供了更好的适应连续控制任务的能力,例如无人机编队飞行和协同机动。这些方法通常需要更多的训练周期,但它们在复杂多智能体场景中的鲁棒性和灵活性更强。联邦MARL通过引入额外的层来实现可扩展性和隐私保护,使代理能够在本地进行训练并共享模型参数,而不是原始数据。尽管由于异步更新和通信延迟可能导致收敛速度较慢,但联邦方法在数据局部性、通信效率或隐私方面具有显著优势——这使得它们非常适合分布式无人机群或边缘AI系统。最终,这些技术的选择取决于应用程序的控制复杂性、环境动态性、系统规模和通信约束.

表7.无人机应用的MARC技术比较分析。

| 技术方法 | 可扩展性 | 故障容忍度 | 成功率 | 探索策略 | 训练收敛速度 | 特殊用例/特性 |

|---|---|---|---|---|---|---|

| SERT-QDN [78] | 高 | 强 | 高 | 基于相似度 | 中等 | 严苛环境下的容错无人机集群 |

| QMIX [68] | 中等 | 有限 | 高 | ε-贪心算法 | 快 | 协作式探索,训练复杂度低 |

| QTRAN [79] | 低 | 无 | 中等 | 基于约束 | 慢 | 计算量大,资源密集型协同 |

| MAVEN [81] | 中等 | 无 | 高 | 隐变量 | 中等 | 支持多样化行为模式 |

| VDAC [123] | 中等 | 无 | 中等 | 去中心化优势 | 快 | 熵正则化学习 |

| ROMA [124] | 高 | 无 | 高 | 角色分配 | 快 | 结构化集群角色,实现稳健协同 |

| MAPPO [90] | 高 | 有限 | 高 | 广义优势估计(GAE) | 快 | 稳定编队控制,可扩展且稳健 |

| HAPPO [102] | 高 | 有限 | 高 | 广义优势估计(GAE) | 中等 | 精密任务,分层优势策略 |

| FACMAC [125,126] | 中等 | 无 | 高 | 熵最大化 | 中等 | 感知带宽的策略,去中心化训练 |

| WQMIX [127] | 中等 | 无 | 高 | 加权混合 | 中等 | 高能效的集群学习 |

QMIX [68] 和 QTRAN [79] 之间存在权衡;QMIX 在成功率和可扩展性方面表现优异,但故障容忍度较低且训练复杂度较高,而 QTRAN 则在可扩展性和收敛性上表现出色,但在计算资源和能源消耗方面受限。MAVEN [81] 和 VDAC [123] 都具有中等能力,但在探索策略上有所不同,MAVEN 利用潜在变量,而 VDAC 使用适合熵正则化应用的去中心化优势。ROMA [124] 和 MAPPO [90] 在可扩展性和收敛性方面表现出高性能,ROMA 采用角色分配以实现结构化的群体行为,而 MAPPO 适用于具有通用优势估计的一般任务控制。HAPPO [102] 是一个层次化的变体,结合了 MAPPO 的优点并增加了协调任务的精度。最后,FACMAC [125,126] 和 WQMIX [127] 分别关注带宽感知和能效,两者都显示出较高的成功率和可扩展性。总体而言,方法的选择取决于特定任务的需求,如故障容忍度、部署准备情况和计算约束。

五 参考文献

| 文献序号 | 文献内容 |

|---|---|

| [46] | Wang, Y.; Zhang, H.; Zhang, Z.; Zhang, Y. CTDE-Based Multi-Agent Reinforcement Learning for UAV Swarm in Dynamic and Adversarial Environment. Drones 2025, 9, 155. [CrossRef] |

| [49] | Li, Y.; Chen, C.; Li, Q.; Wang, X.; Wang, X.; Li, Y.; Li, B. Cooperative UAV Path Planning via Multi-Agent Reinforcement Learning with Curriculum Transfer Learning. Drones 2024, 8, 594. [CrossRef] |

| [51-52] | 51. Zhang, Y.; Zhou, Y.; Chen, Z.; Li, C.; Shi, Y.; Liu, J. Dynamic Target Tracking of UAV Swarms Based on Multi-Agent Reinforcement Learning in Complex Environments. Drones 2024, 8, 253. [CrossRef] 52. Zhang, X.; Wang, J.; Yu, J.; Liu, X.; Zhou, H. Research on UAV Swarm Communication Network Anti-Jamming Decision Method Based on Multi-Agent Reinforcement Learning. Drones 2024, 8, 234. [CrossRef] |

| [53] | Zhang, Y.; Liu, X.; Liu, H.; Zhang, H.; Sun, Y.; Li, Q. Distributed Multi-Agent Reinforcement Learning for UAV Swarm in Cooperative and Competitive Environments. Drones 2024, 8, 166. [CrossRef] |

| [54] | Wang, X.; Li, Y.; Chen, C.; Li, Q.; Wang, X.; Li, Y.; Li, B. Cooperative UAV Path Planning via Multi-Agent Reinforcement Learning with Curriculum Transfer Learning. Drones 2024, 8, 594. [CrossRef] |

| [61,62] | 61. Kochenderfer, M.J.; Chryssanthacopoulos, J.; Griffith, S.; Kuchar, J.K.; Owen, M.P. A survey of decision making under uncertainty for unmanned autonomous vehicles. IEEE Trans. Intell. Transp. Syst. 2015, 16, 1927-1940. [CrossRef] 62. Zhang, Y.; Liu, X.; Liu, H.; Zhang, H.; Sun, Y.; Li, Q. Distributed Multi-Agent Reinforcement Learning for UAV Swarm in Cooperative and Competitive Environments. Drones 2024, 8, 166. [CrossRef] |

| [63] | Chen, Y.; Li, Q.; Wang, X.; Li, Y.; Li, B. Multi-Agent Reinforcement Learning for UAV Swarm in Dynamic and Adversarial Environment. Drones 2024, 8, 594. [CrossRef] |

| [68] | Rashid, T.; Samvelyan, M.; Schroeder, C.; Farquhar, G.; Foerster, J.N.; Whiteson, S. QMIX: Monotonic Value Function Factorisation for Deep Multi-Agent Reinforcement Learning. In Proceedings of the 35th International Conference on Machine Learning, Stockholm, Sweden, 10-15 July 2018; pp. 4295-4304. |

| [84] | Lowe, R.; Wu, Y.I.; Tamar, A.; Harb, J.; Abbeel, P.; Mordatch, I. Multi-Agent Actor-Critic for Mixed Cooperative-Competitive Environments. In Proceedings of the 31st International Conference on Neural Information Processing Systems, Long Beach, CA, USA, 4-9 December 2017; pp. 6379-6390. |

| [87] | Foerster, J.N.; Assael, I.A.; de Freitas, N.; Whiteson, S. Learning to Communicate with Deep Multi-Agent Reinforcement Learning. In Proceedings of the 30th International Conference on Neural Information Processing Systems, Barcelona, Spain, 5-10 December 2016; pp. 2137-2145. |

| [95] | Iqbal, S.; Sha, F. Actor-Attention-Critic for Multi-Agent Reinforcement Learning. In Proceedings of the 35th International Conference on Machine Learning, Stockholm, Sweden, 10-15 July 2018; pp. 2619-2628. |

| [98] | Peng, P.; Wang, J.; Zhang, Y.; Zhang, H.; Sun, Y.; Li, Q. Distributed Multi-Agent Reinforcement Learning for UAV Swarm in Cooperative and Competitive Environments. Drones 2024, 8, 166. [CrossRef] |

| [99] | Wang, X.; Li, Y.; Chen, C.; Li, Q.; Wang, X.; Li, Y.; Li, B. Cooperative UAV Path Planning via Multi-Agent Reinforcement Learning with Curriculum Transfer Learning. Drones 2024, 8, 594. [CrossRef] |

| [102] | Yu, C.; Velu, A.; Vinitsky, E.; Wang, Y.; Singh, S.; Kostrikov, I.; Kumar, S. The Surprising Effectiveness of PPO in Cooperative Multi-Agent Games. arXiv 2021, arXiv:2103.01955. |

| [103] | Zhang, Y.; Liu, X.; Liu, H.; Zhang, H.; Sun, Y.; Li, Q. Distributed Multi-Agent Reinforcement Learning for UAV Swarm in Cooperative and Competitive Environments. Drones 2024, 8, 166. [CrossRef] |

| [113] | Foerster, J.N.; Assael, I.A.; de Freitas, N.; Whiteson, S. Learning to Communicate with Deep Multi-Agent Reinforcement Learning. In Proceedings of the 30th International Conference on Neural Information Processing Systems, Barcelona, Spain, 5-10 December 2016; pp. 2137-2145. |

| [114] | Rashid, T.; Samvelyan, M.; Schroeder, C.; Farquhar, G.; Foerster, J.N.; Whiteson, S. QMIX: Monotonic Value Function Factorisation for Deep Multi-Agent Reinforcement Learning. In Proceedings of the 35th International Conference on Machine Learning, Stockholm, Sweden, 10-15 July 2018; pp. 4295-4304. |

| [118] | Iqbal, S.; Sha, F. Actor-Attention-Critic for Multi-Agent Reinforcement Learning. In Proceedings of the 35th International Conference on Machine Learning, Stockholm, Sweden, 10-15 July 2018; pp. 2619-2628. |

| [119] | Lowe, R.; Wu, Y.I.; Tamar, A.; Harb, J.; Abbeel, P.; Mordatch, I. Multi-Agent Actor-Critic for Mixed Cooperative-Competitive Environments. In Proceedings of the 31st International Conference on Neural Information Processing Systems, Long Beach, CA, USA, 4-9 December 2017; pp. 6379-6390. |

| [120] | Zhang, Y.; Liu, X.; Liu, H.; Zhang, H.; Sun, Y.; Li, Q. Distributed Multi-Agent Reinforcement Learning for UAV Swarm in Cooperative and Competitive Environments. Drones 2024, 8, 166. [CrossRef] |

| [121] | Wang, X.; Li, Y.; Chen, C.; Li, Q.; Wang, X.; Li, Y.; Li, B. Cooperative UAV Path Planning via Multi-Agent Reinforcement Learning with Curriculum Transfer Learning. Drones 2024, 8, 594. [CrossRef] |

| [122] | Chen, Y.; Li, Q.; Wang, X.; Li, Y.; Li, B. Multi-Agent Reinforcement Learning for UAV Swarm in Dynamic and Adversarial Environment. Drones 2024, 8, 594. [CrossRef] |

| [123] | Peng, P.; Wang, J.; Zhang, Y.; Zhang, H.; Sun, Y.; Li, Q. Distributed Multi-Agent Reinforcement Learning for UAV Swarm in Cooperative and Competitive Environments. Drones 2024, 8, 166. [CrossRef] |

| [124] | Zhang, Y.; Liu, X.; Liu, H.; Zhang, H.; Sun, Y.; Li, Q. Distributed Multi-Agent Reinforcement Learning for UAV Swarm in Cooperative and Competitive Environments. Drones 2024, 8, 166. [CrossRef] |

| [125,126] | 125. Rashid, T.; Samvelyan, M.; Schroeder, C.; Farquhar, G.; Foerster, J.N.; Whiteson, S. QMIX: Monotonic Value Function Factorisation for Deep Multi-Agent Reinforcement Learning. In Proceedings of the 35th International Conference on Machine Learning, Stockholm, Sweden, 10-15 July 2018; pp. 4295-4304. 126. Iqbal, S.; Sha, F. Actor-Attention-Critic for Multi-Agent Reinforcement Learning. In Proceedings of the 35th International Conference on Machine Learning, Stockholm, Sweden, 10-15 July 2018; pp. 2619-2628. |

| [127] | Yu, C.; Velu, A.; Vinitsky, E.; Wang, Y.; Singh, S.; Kostrikov, I.; Kumar, S. The Surprising Effectiveness of PPO in Cooperative Multi-Agent Games. arXiv 2021, arXiv:2103.01955. |

更多推荐

已为社区贡献14条内容

已为社区贡献14条内容

所有评论(0)